前段时间介绍了一个开源的 Skill,可以让 Agent 控制你的 Mac。

纯视觉理解桌面上的任何软件界面,像人一样去操作,而且全程跑在你自己电脑上,数据不上云。

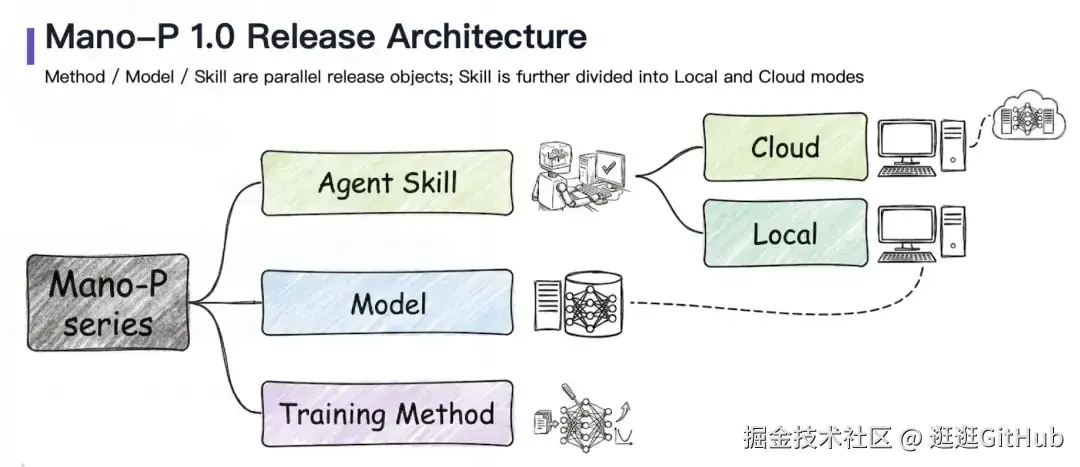

继 Skill 开源之后,最近他的端侧模型也终于开源了。

配套一起开源的还有一个叫 Cider 的推理加速框架,专门给 Apple Silicon 上的 MLX 模型做加速。

两个项目加在一起,基本把端侧 AI 从能跑推到了跑得快、跑得好。

后续这个团队还会开源 mano-p 模型的训练方法,帮助开发者利用自己的数据训练定制化 GUI Agent 模型。

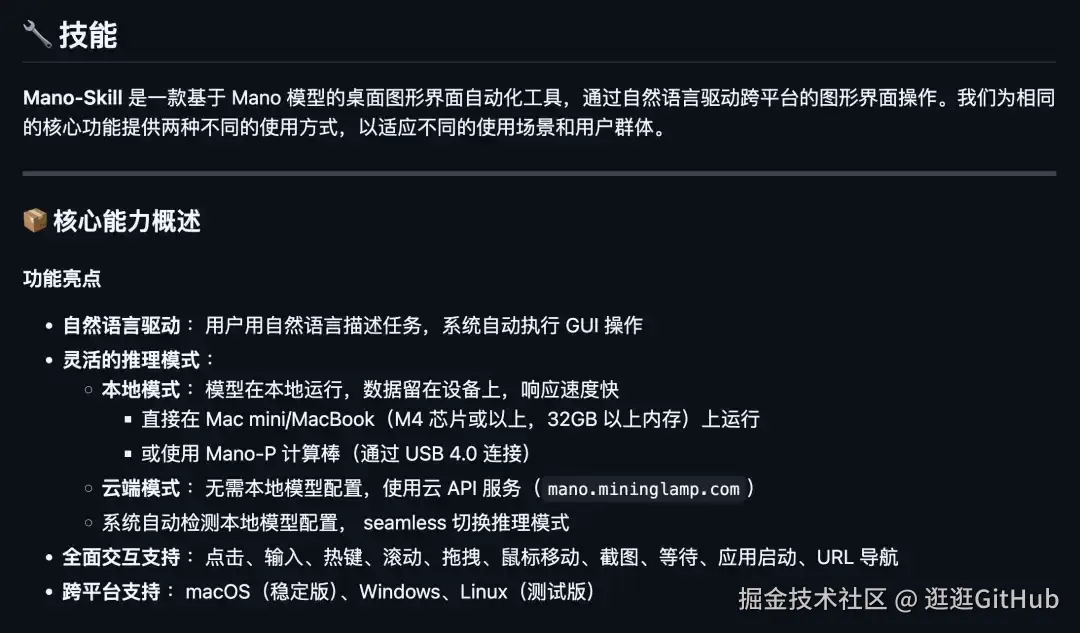

01、一个能在 Mac 本地跑的 GUI Agent

Mano-P 是一个 GUI-VLA 模型,说白了就是用纯视觉的方式理解和操作图形界面。

它不依赖 CDP 协议,也不解析 HTML,直接看屏幕截图就能定位界面元素、执行点击输入、完成复杂操作。

它不限于浏览器场景,桌面软件、专业工具、3D 应用都能操控。

训练数据方面,基于 6 万条 GUI 轨迹数据,覆盖 300 万+动作,涵盖主流桌面和 Web 操作场景。

性能数据也比较夸张。

4B 量化模型在 Apple M4 Pro 上实现 476 tokens/s 预填充、76 tokens/s 解码,峰值内存只有 4.3GB。

一个 4B 的小模型,在 CUA 任务上实现了和云端大模型相当的准确率,而且完全在本地运行,所有截图和任务数据不出设备。

支持离线长任务自主规划,复杂业务流程可以完全不联网就完成自主决策和纠错。

安装也很简单,一行命令:

bash

brew tap HanningWang/tap

brew install mano-cua装完就能用:

arduino

mano-cua run "打开微信告诉xxx会议延期"当然也支持 Skill 的方式接入。

02、Cider 让端侧模型跑得更快的加速框架

Mano-P 能在 Mac 上跑得这么快,背后靠的是 Cider。

Cider 是团队自研的推理加速框架,基于 Apple MLX 生态。

它补齐了 MLX 原生框架缺失的 W8A8 和 W4A8 量化计算能力。

MLX 目前支持 W4A16、W8A16 这些权重量化模式,但缺少激活量化。

Cider 通过调用 Apple 底层 Metal 4 API,首次在 Apple GPU 上实现了硬件加速的 INT8 TensorOps 计算。

实测数据:

W8A8 模式下,算子速度比 MLX 原生提升 1.4x 到 1.9x,具体取决于 batch size。

拿 Qwen3-8B 举例,FP16 原生预填充 1695 tokens/s,经过 Cider 的 W8A8 加速后能到 2531 tokens/s,接近 1.5 倍。

Llama3-8B 也类似,从 1727 提到 2520 tokens/s。

对于 Qwen3-VL-2B 这样的视觉语言模型,chunked prefill 场景中端到端预填充加速 57% 到 61%。

接入方式极其简单,一行代码就能把任何 MLX 模型的 Linear 层替换成 Cider 加速版本:

python

from cider import convert_model, is_available

model, proc = load("path/to/model")

if is_available():

convert_model(model)

# CiderLinear auto-detects:

# seq_len > 1 - W8A8 INT8 TensorOps (faster prefill)

# seq_len == 1 - INT8 MV kernel (near-native decode speed)

else:

pass # Falls back to standard MLX inference on M4它会自动判断:seq_len > 1 用 W8A8 INT8 TensorOps 加速预填充,seq_len == 1 回退原始权重保证解码最优。

不需要手动切换。

Cider 不只是给 Mano-P 用的。Qwen、Llama、Mistral,只要你的模型跑在 MLX 上,都能用 Cider 加速。

03、用 Mano-P 能干什么

全自动化应用构建流程。

你用自然语言描述需求,系统依次完成需求澄清、架构设计、代码生成、本地部署。

然后开始多层级测试,先是 API 接口测试,再是 LLM 页面视觉检测,最后通过 VLA 模型做端到端的 GUI 自动化测试。

测试没通过的话,自动定位问题、修复代码、重新部署,循环迭代直到全部通过。

整个流程不需要人工干预。

再比如,还能做商业视频智能系统,从下发指令开始,自动完成视频生成、上传、分析、剪辑到二次评测。

系统自己操作网页和剪辑软件,处理文件、修改字幕,最后生成包含主观评价和客观指标的分析报告。

这些场景的核心特点是一样的:大量截图和界面操作数据,全部在本地处理,不上传到任何云端。

从成本角度看这件事更有意思。

全自动编程流水线里,GUI 测试消耗的云端 token 占比超过 59%。

API 测试只能验证接口是否正常,但软件是否真的可用,得有人打开界面操作一遍才知道。

这个过程天然依赖多模态理解,模型要持续处理截图、定位元素、执行操作、判断结果,推理消耗非常大。

Mano-P 把这部分开销直接归零,不调 API,不传截图,不花一分钱。

和 Claude Computer Use 对比一下:

Claude 在 OSWorld 上的综合成绩确实更高(72.1% vs Mano-P 58.2%),但 Claude 需要云端 API 调用,你的截图和任务数据都要上传。

Mano-P 完全在本地运行,数据不出设备。

如果你的场景对隐私和安全有要求,比如企业内部系统测试、处理敏感数据的自动化流程,端侧方案是目前更现实的选择。

bash

开源地址:

Mano-P:https://github.com/Mininglamp-AI/Mano-P

Cider:https://github.com/Mininglamp-AI/ciderMano-P 证明了端侧 GUI Agent 的应用价值,Cider 则解决了端侧 AI 落地最底层的问题:如何让模型在 Mac 上更快、更省内存、更接近真实可用。

从 Mano-P 到 Cider,明略科技正在建设端侧 AI 、私有化AI的基础设施能力。