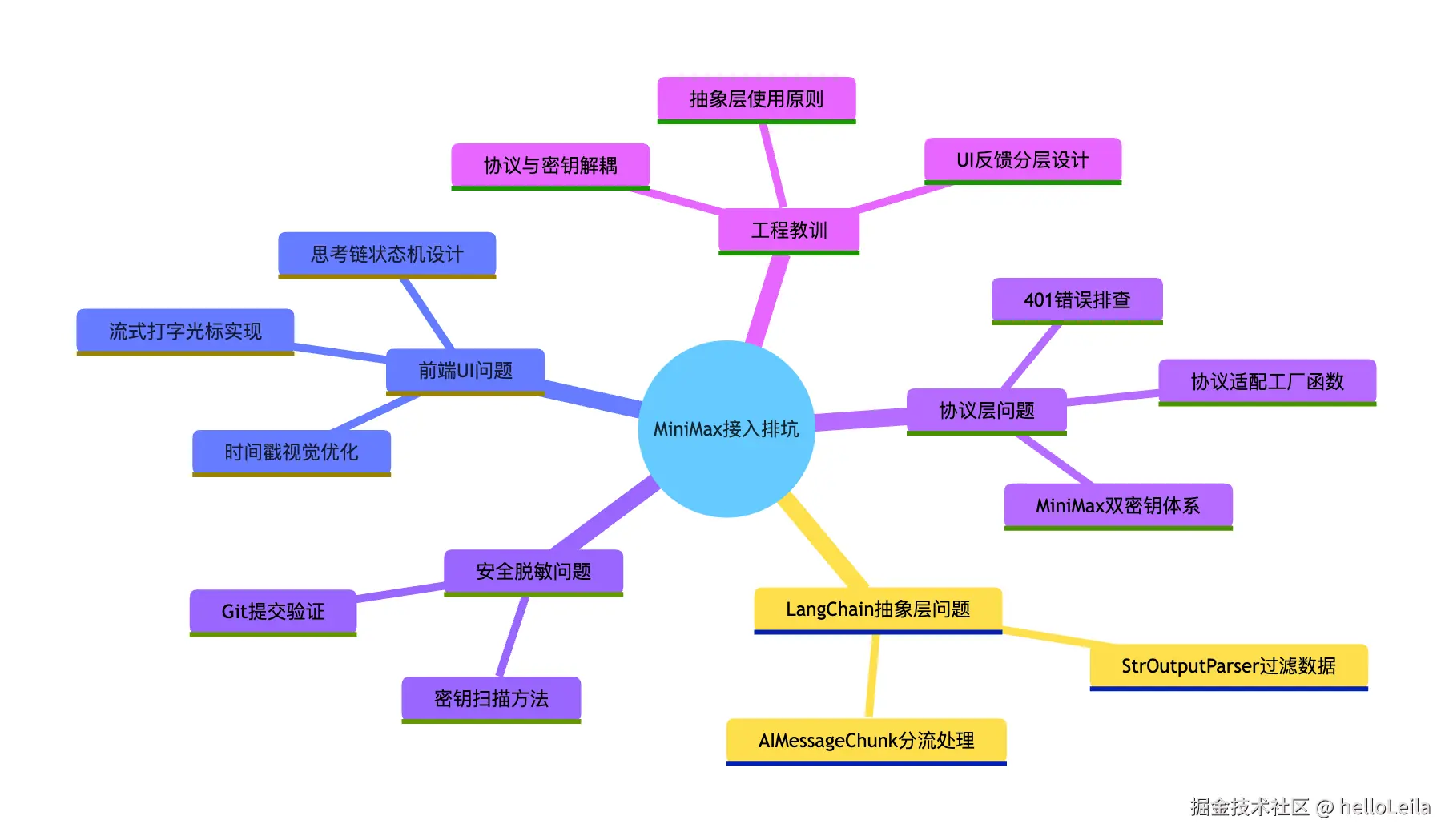

本文把企业级的技术问题拆解成小白能看懂的内容,包含代码逐行解析 、核心知识点标注 、可视化思维导图,帮你理解「协议错配 / 流式数据 / 前端状态机 / 安全脱敏」四类典型问题的解决思路。

一 概述

我做了一个企业内部的 AI 办公助手(前端用 Vue 3、后端用 FastAPI、AI 部分用 LangChain),集成 MiniMax 模型时踩了 4 个大坑:

- 密钥用错协议:MiniMax 的订阅密钥只能用 Anthropic 协议,我当成 OpenAI 协议用,一直报 401 错误;

- 思考链内容丢失:LangChain 的一个工具把「思考过程」偷偷过滤了,前端看不到 AI 思考的内容;

- 前端交互不友好:思考链默认折叠、打字时没反馈,用户以为系统卡了;

- 安全风险:第一次往 GitHub 传代码怕泄露密钥,做了全套脱敏检查。

二、问题 1:MiniMax 密钥报 401 错误(最坑的第一步)

2.1 现象(你会看到的报错)

后端配置文件 .env 里写了这些内容:

ini

ini

# 你可以把这些理解为「登录 MiniMax 的账号密码+服务器地址+使用的模型」

OPENAI_API_KEY=sk-cp-...QH4zMg # MiniMax的订阅密钥

OPENAI_BASE_URL=https://api.minimaxi.com/v1 # MiniMax的接口地址

OPENAI_MODEL=abab6.5s-chat # 要使用的MiniMax模型名然后后端报错:

json

json

{"error":{"type":"authorized_error","message":"invalid api key (2049)","http_code":"401"}}401 错误的意思是「身份验证失败」,但千万别直接认为是密钥写错了!

2.2 排查思路:先列假设,再逐个验证

新手容易犯的错是「看到报错就瞎改」,正确做法是先列「可能出错的原因」,再逐个排除:

表格

| 候选假设 | 验证方法(大白话) |

|---|---|

| H1:密钥字符串抄错了 | 把密钥复制回 MiniMax 控制台对比,确认没多 / 少字符 |

| H2:网络连不上 MiniMax | 看报错里有没有 MiniMax 专属的 request_id(有就说明能连到服务器) |

| H3:接口地址写错了 | 同时测试 3 个常用地址,看是不是地址的问题 |

| H4:模型名失效了 | 报错如果是「model not found」才是模型错,这里不是 |

| H5:密钥和接口协议不匹配(核心根因) | 排除前 4 个,只剩这个原因 |

2.3 关键:探针脚本(逐行解析)

写一个 Python 脚本测试 3 个接口地址,逐行解释每句代码的作用:

python

运行

ini

# 1. 导入发送HTTP请求的库(比requests 更适合异步,功能一样)

import httpx

# 2. 定义要测试的3个MiniMax接口地址(怀疑地址错,所以全测)

candidates = [

"https://api.minimaxi.com/v1", # 国内OpenAI兼容接口

"https://api.minimax.io/v1", # 海外OpenAI兼容接口

"https://api.minimax.chat/v1", # 老版本海外接口

]

# 3. 遍历每个地址,逐个发送测试请求

for url in candidates:

# 3.1 发送POST请求到「聊天完成」接口(AI对话的核心接口)

# url + "/chat/completions" = 完整的请求地址(比如第一个地址拼接后是 https://api.minimaxi.com/v1/chat/completions)

r = httpx.post(

url + "/chat/completions",

# 3.2 请求头:身份验证(Bearer + 密钥 是接口验证的标准格式,类似「密码牌」)

headers={"Authorization": f"Bearer {key}"}, # {key} 替换成你的真实密钥

# 3.3 请求体:告诉模型「用哪个模型」「发什么消息」(这里省略具体值,实际要填)

json={"model": "abab6.5s-chat", "messages": [{"role": "user", "content": "你好"}]}

)

# 3.4 打印测试结果:地址 + 状态码(200=成功,401=未授权) + 返回内容前200字

print(url, r.status_code, r.text[:200])脚本运行结果分析

如果 3 个地址都返回 401,且报错里有 MiniMax 的 request_id,说明:

- ✅ 网络能连到 MiniMax 服务器(排除「网连不上」);

- ❌ 不是地址错(3 个地址都拒绝);

- 🚨 最终结论:密钥和接口协议不匹配。

2.4 根因:MiniMax 的「双密钥体系」(重点加粗)

MiniMax 有两种密钥,对应不同的协议要记住「密钥前缀 + 协议」的对应关系:

表格

| 密钥类型 | 前缀 | 用途 | 协议(核心) | 接口地址 |

|---|---|---|---|---|

| 按量计费密钥 | sk-api- |

用多少扣多少钱 | OpenAI 协议 | api.minimaxi.com/v1 |

| 订阅套餐密钥 | sk-cp- |

按次数收费(订阅制) | Anthropic 协议 | api.minimaxi.com/anthropic |

核心知识点:协议就像「不同的语言」,OpenAI 协议和 Anthropic 协议是两种不同的「沟通规则」,密钥只能用对应「语言」的接口,跨了就报 401。

2.5 解决方案:协议适配工厂函数(代码逐行解析)

如果直接把所有代码里的「OpenAI」改成「Anthropic」,未来想切回 OpenAI 又要改一遍,这是「耦合性高」的坏代码。

正确做法是用「抽象层」(类比:不管是苹果手机还是安卓手机,都能插同一个耳机,因为耳机接口是统一的),代码如下:

python

运行

ini

# backend/app/core/llm.py

# 1. 导入LangChain的核心类(BaseChatModel是所有AI模型的「统一耳机接口」)

from langchain.chat_models.base import BaseChatModel

from langchain.chat_models import ChatOpenAI, ChatAnthropic

def get_chat_model() -> BaseChatModel | None:

# 2. 读取配置(比如密钥、协议类型)

settings = get_settings() # 这行是读取.env里的配置,不用深究

provider = settings.active_llm_provider # 要使用的协议类型(openai/anthropic)

# 3. 按协议类型返回对应的模型实例(核心:调用方不用管具体是哪种协议)

if provider == "anthropic":

# 返回Anthropic协议的模型(用订阅密钥)

return ChatAnthropic(

api_key=settings.anthropic_api_key, # 订阅密钥

base_url=settings.anthropic_base_url, # Anthropic协议的接口地址

model=settings.anthropic_model # 模型名

)

# 默认返回OpenAI协议的模型

return ChatOpenAI(

api_key=settings.openai_api_key,

base_url=settings.openai_base_url,

model=settings.openai_model

)!NOTE关键优势:后续 5 个业务模块调用 AI 时,一行代码都不用改!因为它们只认「BaseChatModel」这个统一接口,不管底层是 OpenAI 还是 Anthropic。

2.6 关键知识点总结(必记)

❌ 错误做法:看到 401 就重申请密钥、瞎改接口地址;

✅ 正确做法:先列假设→写探针脚本验证→定位根因→用抽象层解耦协议和业务代码;

核心概念:协议是「沟通规则」,密钥和协议必须匹配,抽象层能降低代码耦合性。

三、问题 2:思考链内容空白(LangChain 隐藏坑)

3.1 现象

密钥和协议改对后,前端能看到 AI 的回答,但「思考链」(AI 怎么想的)是空的,折叠栏显示「已深度思考 3s」,点开啥都没有。

3.2 排查:先看「原始数据」(别猜!)

容易「对着代码瞎想」,正确做法是打印 AI 返回的原始数据,代码如下:

python

运行

python

# 测试AI流式返回的内容

async for chunk in (prompt | m).astream({"q": "你好"}):

# chunk是AI返回的「数据块」,content是核心内容

c = chunk.content

# 打印内容类型 + 内容前100字(看数据长啥样)

print(type(c).__name__, repr(c)[:100])运行后看到的结果(简化版):

plaintext

python

list [{'type': 'thinking', 'thinking': '用户要求自我介绍,要简短...', 'index': 0}] # 思考内容

list [{'type': 'thinking', 'signature': '14d6beafe938f024...', 'index': 0}] # 防伪签名

str '\n\n你好!我是 AI 助手...' # 最终回答关键发现:AI 返回的内容有两种类型 ------list(存思考过程)和 str(存最终回答)。

3.3 根因:StrOutputParser 偷偷过滤数据

LangChain 的 StrOutputParser 是一个「数据过滤工具」,可以理解为「只保留纯文本,删掉所有额外信息」,它的核心源码(简化版):

python

运行

ruby

class StrOutputParser:

def parse_result(self, result):

# 只返回「text类型」的内容,思考过程(thinking)被过滤了!

return result[0].text !WARNING这不是 Bug!

StrOutputParser的设计目的就是「只给用户干净的文本」,但代价是删掉了思考过程这类「元信息」------ 文档没说清楚,这是最大的坑。

3.4 解决方案:自己处理数据(分流思考和回答)

删掉 StrOutputParser,自己写函数区分「思考内容」和「回答内容」,代码逐行解析:

python

运行

python

async def _stream_chunk_to_streamer(chunk_content: Any, streamer) -> str:

"""

把AI返回的内容分流:思考内容推到思考链,回答内容推到正文

:param chunk_content: AI返回的单块内容

:param streamer: 前端数据流工具(不用深究)

:return: 新增的回答文本

"""

visible_text = "" # 最终要显示的回答文本

# 情况1:内容是列表(存思考过程)

if isinstance(chunk_content, list):

for block in chunk_content: # 遍历列表里的每个数据块

if not isinstance(block, dict): # 只处理字典类型的数据

continue

block_type = block.get("type") # 获取数据类型(thinking/text)

# 子情况1:是思考内容 → 推到思考链

if block_type == "thinking":

thinking_text = block.get("thinking", "") # 提取思考文字

if thinking_text: # 有内容才推送

await streamer.push_thinking(thinking_text)

# 子情况2:是回答内容 → 累加进最终文本

elif block_type == "text":

text = block.get("text", "")

if text:

visible_text += text

await streamer.push_token(text) # 推到前端正文

# 情况2:内容是字符串(直接是回答内容)

elif isinstance(chunk_content, str):

if chunk_content: # 有内容才处理

visible_text = chunk_content

await streamer.push_token(chunk_content)

return visible_text # 返回新增的回答文本前端配合:新增「思考链」事件监听

前端用 EventSource 接收后端数据时,新增一个监听逻辑(Vue 代码简化版):

typescript

运行

ini

// 监听后端的SSE数据流

const eventSource = new EventSource("/api/chat/stream");

eventSource.onmessage = (e) => {

const payload = JSON.parse(e.data);

// 区分事件类型:思考内容/回答内容

if (payload.type === "thinking") {

// 把思考内容累加进思考链

message.thinking += payload.content ?? "";

} else if (payload.type === "token") {

// 把回答内容累加进正文

message.content += payload.content ?? "";

}

};3.5 关键知识点总结

❌ 错误做法:依赖工具却不看源码 / 不打印原始数据,瞎猜「思考链为啥空」;

✅ 正确做法:先打印原始数据→分析数据结构→针对性分流处理;

核心概念:流式返回是「分块传输数据」,工具类可能过滤你需要的信息,要主动验证数据结构。

四、问题 3:前端思考链交互优化(状态机 + 视觉反馈)

4.1 核心需求(用户体验)

- 思考阶段:思考链默认展开,显示「思考中 3.2s」(秒数实时变);

- 开始回答后:思考链自动折叠,显示「已深度思考 3.2s」;

- 回答过程中:显示打字光标,让用户知道「系统还在跑」。

4.2 思考链状态机(核心逻辑)

给每条 AI 消息定义 6 个状态字段(大白话解释):

表格

| 字段名 | 含义 | 变化时机 |

|---|---|---|

isThinking |

是否在思考 | 发消息时 = true,收到第一个回答字时 = false |

thinking |

思考内容 | 每次收到思考数据就累加 |

thinkingStartAt |

思考开始时间 | 发消息时记录(比如 1719000000000) |

thinkingEndAt |

思考结束时间 | 收到第一个回答字时记录 |

thinkingExpanded |

思考链是否展开 | 思考时 = true,回答时 = false |

isStreaming |

是否还在传输数据 | 发消息时 = true,传输结束时 = false |

状态流转(简化版):

plaintext

ini

用户提问 → 创建AI消息(isThinking=true,展开思考链)

↓

收到思考数据 → 累加思考内容,实时显示秒数

↓

收到第一个回答字 → 停止思考(isThinking=false),折叠思考链

↓

持续收到回答字 → 正文累加,显示打字光标

↓

传输结束 → 停止光标,禁用发送按钮4.3 实时秒表实现(代码逐行解析)

要让「思考中 3.2s」的秒数实时变,不能直接算时间(Vue 不会自动刷新),代码如下:

typescript

运行

javascript

// 1. 定义响应式变量:当前时间(Vue里变了就会刷新页面)

const liveNow = ref(Date.now());

// 2. 定时器变量:用来控制秒表启停

let liveTimer: ReturnType<typeof setInterval> | null = null;

// 3. 启动定时器:每250ms更新一次当前时间(4次/秒,兼顾流畅和性能)

function startTimer() {

if (liveTimer) return; // 防止重复启动(重要!避免内存泄漏)

liveTimer = setInterval(() => {

liveNow.value = Date.now(); // 更新当前时间

}, 250);

}

// 4. 停止定时器

function stopTimer() {

if (liveTimer) {

clearInterval(liveTimer); // 清除定时器

liveTimer = null; // 重置变量

}

}

// 5. 监听「是否在思考」状态:思考开始启动定时器,结束停止

watch(

() => props.message.isThinking, // 监听的状态

(isThinking) => {

isThinking ? startTimer() : stopTimer(); // 思考中=启动,否则停止

},

{ immediate: true } // 初始化时立即执行

);

// 6. 组件卸载时停止定时器(防止内存泄漏!必记)

onBeforeUnmount(stopTimer);

// 7. 计算思考时长(显示用)

const thinkingDurationLabel = computed(() => {

const start = props.message.thinkingStartAt;

if (!start) return "";

// 思考中用当前时间,思考结束用结束时间

const end = props.message.isThinking ? liveNow.value : props.message.thinkingEndAt ?? liveNow.value;

// 计算秒数,保留1位小数(比如3.2s)

return ((end - start) / 1000).toFixed(1);

});!NOTE内存泄漏:如果定时器不停止,组件删了之后定时器还在跑,会浪费内存,要记住「启动定时器就要有停止逻辑」。

4.4 打字光标实现(CSS 细节)

光标要像真实终端一样「硬闪」(不是渐变),代码如下:

css

css

/* 打字光标样式 */

.typing-cursor {

display: inline-block; /* 行内块,能设置宽高 */

width: 8px; height: 16px; /* 光标大小(和文字对齐) */

margin-left: 2px; /* 和文字的间距 */

background: currentColor; /* 光标颜色跟随文字颜色(自适应主题) */

opacity: 0.65; /* 透明度(不刺眼) */

/* 核心动画:硬闪,不是渐变 */

animation: typing-blink 1s steps(2, start) infinite;

}

/* 动画定义:从显示到隐藏,硬切 */

@keyframes typing-blink {

to { visibility: hidden; } /* 到最后一帧隐藏 */

}关键细节:steps(2, start) 是「硬切动画」,模拟真实终端光标;如果用 linear 会变成渐变,像「呼吸灯」,体验差。

4.5 关键知识点总结

✅ 前端交互原则:用户需要「明确的反馈」,思考时显示秒表、回答时显示光标,避免用户以为系统卡了;

❌ 常见错误:定时器不停止导致内存泄漏、光标用渐变动画体验差;核心概念:状态机是「按规则切换状态」,响应式变量是 Vue 刷新页面的核心。

五、问题 4:GitHub 提交前的安全脱敏(防密钥泄露)

5.1 为啥重要?

密钥一旦传到 GitHub,几分钟就会被爬虫扒走,就算删了代码,历史记录里还能找到,只能作废重申请 ------ 一定要养成「提交前脱敏」的习惯!

5.2 要扫描的文件(别漏!)

表格

| 类型 | 常见文件 | 处理方式 |

|---|---|---|

| 配置文件 | .env、.env.bak、.env.local |

加入 .gitignore,不让 Git 追踪 |

| 测试脚本 | probe_key.py(含真实密钥) |

加入 .gitignore |

| IDE 配置 | .idea/、.vscode/ |

加入 .gitignore |

| 代码 / 文档 | 所有 .py/.ts/.md 文件 |

搜索是否有密钥片段 |

5.3 验证方法(命令行逐行解释)

第一步:全局搜索密钥片段

bash 运行

php

# 搜索包含「sk-cp-Nl」「QH4zMg」的文件(替换成你的密钥片段)

# --include:只搜指定类型文件;--exclude-dir:排除不用搜的文件夹

grep -rn "sk-cp-Nl|QH4zMg" \

--include='*.py' --include='*.ts' --include='*.vue' --include='*.md' \

--exclude-dir=node_modules --exclude-dir=.venv .grep:Linux/Windows Git Bash 里的搜索命令;-rn:r= 递归搜子文件夹,n= 显示行号;|:表示「或」,搜多个关键词;- 结果为空 → 没找到密钥,安全!

第二步:检查 Git 待提交的内容

bash 运行

bash

# 先把文件加入暂存区

git add -A

# 搜索暂存区里是否有密钥(-S 是「精准搜字符串」)

git diff --cached -S "sk-cp-" -S "sk-api-" --statgit diff --cached:看暂存区的修改;-S "sk-cp-":搜包含「sk-cp-」的内容;--stat:只显示文件名,不显示具体内容;- 结果为空 → 暂存区没有密钥,安全!

5.4 关键知识点总结

❌ 错误做法:直接 git push,不检查是否泄露密钥;

✅ 正确做法:先加 .gitignore → 全局搜索 → 检查暂存区 → 再提交;核心概念:.gitignore 是 Git 的「忽略清单」,grep 是文本搜索工具,提交前必须验证。

六、工程教训(总结)

- 密钥和协议要匹配:别只看接口地址,要确认密钥对应的协议(OpenAI/Anthropic);

- 工具类有隐藏逻辑:用 LangChain 这类工具时,要打印原始数据,别依赖「看起来无害」的工具;

- 代码要解耦:用抽象层(比如 BaseChatModel)让「协议切换」不影响业务代码;

- 前端反馈要分层:思考时给「高活动反馈」(秒表 + 滚动文字),回答时给「低噪声反馈」(光标);

- 安全脱敏要主动 :提交代码前必须扫描密钥,

.gitignore不是万能的。

七、FAQ

表格

| 问题 | 大白话答案 |

|---|---|

| 401 怎么区分是密钥错还是协议错? | 用脚本测多个接口地址,有 MiniMax 的 request_id 就是协议错,否则是密钥 / 网络错 |

| 为什么不直接把代码里的 OpenAI 改成 Anthropic? | 改一处还好,改 5 处就麻烦,未来切回 OpenAI 又要改,抽象层能一次改完 |

| 思考链为啥会丢? | StrOutputParser 只保留纯文本,把思考过程过滤了,不是 Bug,是设计如此 |

| 定时器为啥要 250ms 刷新? | 1000ms 太卡,100ms 太耗性能,250ms 是流畅和性能的平衡点 |

| 不小心把密钥推到 GitHub 咋办? | 立刻去 MiniMax 控制台吊销密钥(重申请),再清理 Git 历史(次要) |