原作者:Linux教程

原文地址:https://mp.weixin.qq.com/s/OJQbEna8i80_Vx5kF6Va3A

在现代网络架构中,反向代理已成为不可或缺的核心组件,广泛应用于负载均衡、缓存加速、WebSocket支持等多种场景。

在互联网发展早期,客户端与服务器之间的几乎都是直接访问模式,用户通过浏览器发送HTTP请求直达服务器,服务器处理后再返回响应。这种模式在网站规模小、用户量少时简单易懂,但随着互联网飞速发展,其局限性日益凸显:安全方面,服务器真实IP完全暴露,易遭受DDoS等恶意攻击;性能方面,高并发场景下请求集中于单台服务器,无法实现负载均衡,易导致响应延迟甚至超时;运维方面,每台服务器需单独管理维护,服务增多时运维成本呈指数级增长,升级配置效率低下且易出错。

一、前置知识

在深入探究 HTTP 反向代理之前,我们先来梳理一些基础概念,搞清楚为什么要启用代理,代理服务器到底是什么,以及正向代理和反向代理的区别。这些概念是我们理解反向代理的基础。

1.1 为什么要启用代理?

网络规模与场景日趋复杂,启用代理是提升系统性能、增强安全性、提高可扩展性、简化运维管理的核心方式。

- 安全性:隐藏源站真实IP,避免攻击者直接定位目标;同时过滤验证请求、拦截恶意流量,守护源站安全。

- 性能:缓存图片、样式脚本等常用资源,减少重复请求、缩短响应时间;通过数据压缩提升网络传输效率。

- 可扩展性:实现负载均衡,均匀分发请求避免单服务器性能瓶颈;支持服务发现,动态调整转发策略,提升系统灵活性。

- 运维管理:提供统一请求入口,便于集中管控、日志记录、指标监控,降低运维成本,也方便审计分析与问题优化。

1.2 什么是代理服务器?

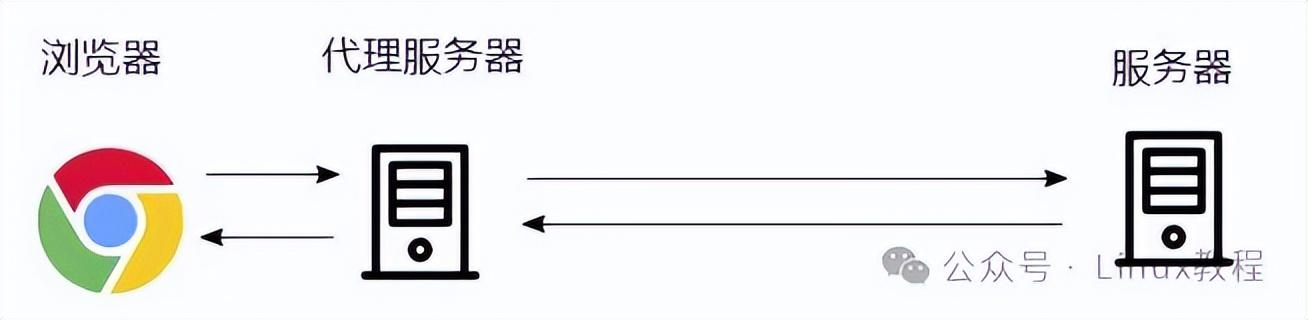

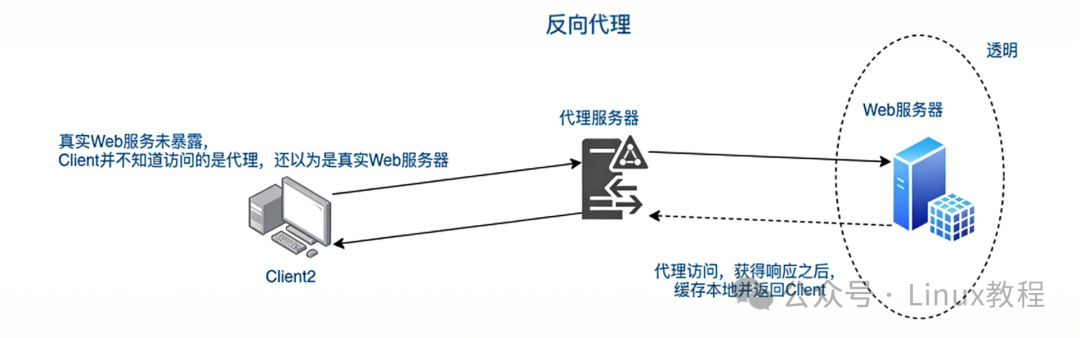

代理服务器,简单来说,就是位于客户端与后端服务器之间的一个中间服务器。它就像是一个 "中间人",负责接收客户端发送的请求,并将这些请求转发给后端服务器;同时,它也会接收后端服务器返回的响应,并将响应转发回客户端。

这个 "中间人" 角色有着重要的技术价值。它解耦了客户端和后端服务器之间的直接通信。想象一下,如果客户端直接与后端服务器通信,那么当后端服务器的地址或配置发生变化时,客户端就需要相应地修改配置,这无疑增加了系统的复杂性和维护成本。而有了代理服务器,客户端只需要与代理服务器进行交互,无需关心后端服务器的具体情况,后端服务器的变更也不会影响到客户端,从而提高了系统的灵活性和可维护性。

代理服务器还可以实现流量管控。它可以根据预设的规则,对客户端的请求进行限制和调度,比如限制某个客户端的访问频率,防止恶意的高并发请求对后端服务器造成压力;或者根据后端服务器的负载情况,动态调整请求的转发策略,确保后端服务器的负载均衡。

在协议转换方面,代理服务器也发挥着重要作用。不同的客户端和后端服务器可能使用不同的协议进行通信,代理服务器可以在不同协议之间进行转换,使得客户端和后端服务器能够顺利地进行交互。比如,客户端使用 HTTP 协议发送请求,而后端服务器使用的是 HTTPS 协议,代理服务器就可以将 HTTP 请求转换为 HTTPS 请求,转发给后端服务器,并将后端服务器返回的 HTTPS 响应转换为 HTTP 响应,返回给客户端。

1.3 正向代理 (Forward Proxy)

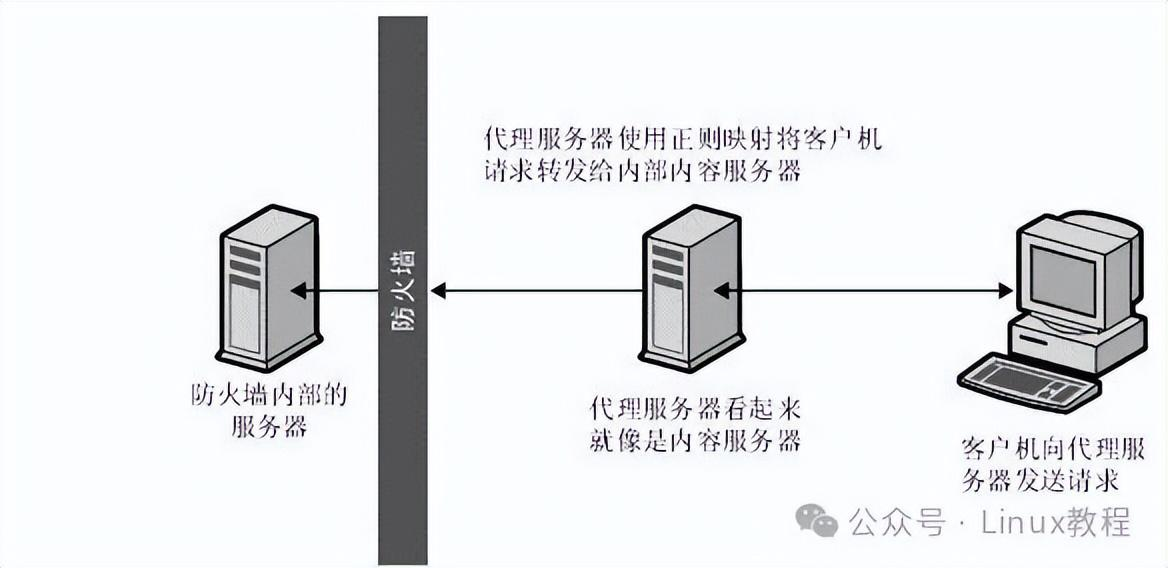

正向代理,是一种位于客户端和目标服务器之间的代理服务器,它的核心作用是代表客户端向目标服务器发起请求,并将目标服务器的响应返回给客户端。从本质上来说,正向代理是在保护客户端,隐藏客户端的真实 IP 地址,让目标服务器只能看到代理服务器的 IP。

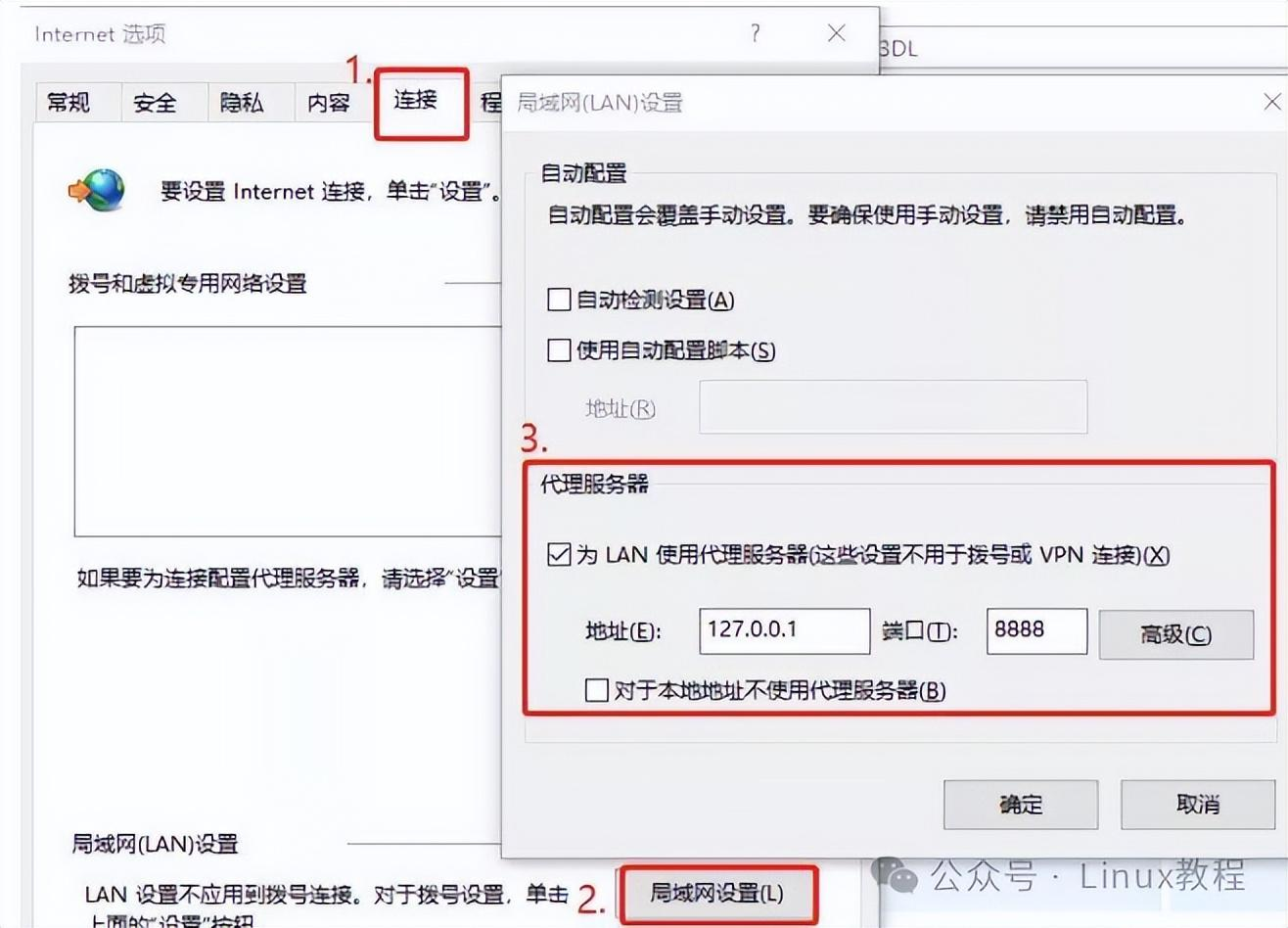

以翻墙为例,在某些地区,由于网络限制,用户无法直接访问国外的网站,如 Google、Facebook 等。这时,用户可以通过配置正向代理服务器,将请求发送到代理服务器上,代理服务器再代替用户去访问这些国外网站,并将获取到的内容返回给用户。在这个过程中,国外网站看到的请求来源是代理服务器的 IP,而不是用户的真实 IP,从而实现了隐藏用户身份和突破网络限制的目的。

正向代理的工作流程如下:

客户端首先向正向代理服务器发送请求,并在请求中指定目标服务器;正向代理服务器接收到请求后,根据请求中的目标服务器信息,向目标服务器发送请求;目标服务器处理请求后,将响应返回给正向代理服务器;正向代理服务器再将响应转发给客户端。在整个过程中,客户端与目标服务器之间并没有直接的通信,而是通过正向代理服务器进行中转。

1.4 正向代理 vs 反向代理 vs 直接访问

|-------------|------------|-----------------------|---------------------|

| 对比维度 | 直接访问 | 正向代理 | 反向代理 |

| 保护对象 | 无 | 客户端 | 服务器 |

| 客户端是否感知代理存在 | 否 | 是,需手动配置代理地址 | 否,对客户端透明 |

| 代理服务器位置 | 无 | 客户端与目标服务器之间 | 客户端与后端服务器之间 |

| 主要用途 | 简单场景下的直接通信 | 突破网络限制、隐藏客户端身份、企业上网管理 | 负载均衡、安全防护、性能优化、统一入口 |

| 配置复杂度 | 低,无需额外配置 | 较高,客户端需配置代理信息 | 较高,代理服务器需配置转发规则 |

| 对服务器性能影响 | 无 | 较小,主要影响在客户端与代理之间 | 较大,代理服务器需处理大量请求转发 |

二、为什么非反向代理不可?

早期Web应用以单体架构为主,客户端直连单台服务器,仅能适配小规模、低用户量的基础场景。随着业务爆发式增长,单体架构的性能瓶颈、扩展性差、维护成本高等问题彻底暴露,分布式微服务架构成为主流,而反向代理正是连接客户端与后端分布式服务的核心枢纽,也是规模化Web架构的刚需组件,其核心价值覆盖业务支撑、安全、性能、架构、运维五大维度。

2.1 核心驱动力:适配高并发业务规模

业务体量与请求量的指数级增长,是反向代理普及的核心动因。当下短视频、电商、社交等平台日均承载海量并发请求,纯直连模式会直接压垮后端单台服务器,引发服务宕机。反向代理通过负载均衡能力,将海量请求按算法均匀分发至多台后端服务器,避免单点过载,大幅提升系统吞吐量与稳定性;同时搭配基础缓存、请求压缩能力,直接减轻后端服务与数据库压力,适配日常高访问量与大促、峰值流量等极端场景,是大规模业务稳定运行的基础保障。

2.2 安全防护价值:筑牢Web服务安全屏障

反向代理是Web架构的核心安全前置层,能从多维度阻断网络攻击,保护后端核心服务:一是隐藏源站真实IP ,客户端仅接触代理服务器IP,彻底杜绝攻击者直接定位后端服务器发起恶意攻击;二是抵御DDoS攻击 ,通过流量限流、异常IP拦截、分布式分流等手段,阻断海量恶意请求冲击后端;三是集成WAF防护 ,前置Web应用防火墙,实时拦截SQL注入、XSS、CSRF等常见Web漏洞攻击;四是统一SSL/TLS加密,代理层完成证书管理、数据加解密工作,既保障传输数据安全,又剥离后端服务器的加密算力负担。

2.3 性能优化价值:提速请求响应效率

反向代理通过多项技术手段直击Web应用性能痛点,全面优化响应速度:一是静态资源缓存 ,将图片、CSS、JS等不变资源缓存至代理层,重复请求直接本地响应,免去后端调用耗时;二是动静分离 ,拆分静态与动态请求,分别转发至专属资源服务器与业务服务器,避免资源竞争;三是数据压缩 ,通过Gzip等算法压缩响应体积,减少网络传输耗时、节省带宽;四是连接复用,复用TCP连接处理多轮请求,降低握手开销,提升整体请求处理效率。

2.4 架构解耦价值:支撑灵活分布式部署

作为分布式架构的统一入口(API网关),反向代理实现了前后端、微服务之间的深度解耦。客户端仅需对接代理入口,无需关注后端服务的实际地址、部署细节,代理层统一完成身份校验、权限控制、请求路由等基础操作;同时完美支持灰度发布、蓝绿部署等现代化发布策略,可按规则分流流量至新旧版本服务,逐步迭代验证,全程无服务中断,大幅降低业务更新上线的风险,适配微服务的灵活迭代需求。

2.5 运维管理价值:降本增效简化运维

反向代理是运维环节的高效工具,通过集中化管理大幅降低运维复杂度:一是日志集中采集 ,统一归集所有客户端访问日志,方便全局分析流量、排查故障,无需逐台服务器梳理日志;二是监控指标统一上报 ,实时采集并发量、响应时长、服务负载等核心指标,便于运维人员全局监控系统状态,快速定位隐患;三是配置热更新,无需重启后端服务,即可动态调整负载策略、新增服务节点、修改缓存规则,实现无感运维,保障服务连续性。

三、工作原理

3.1 反向代理工作流程

当我们在浏览器中输入一个网址并按下回车键。

首先,客户端(浏览器)向反向代理服务器发送 HTTP 请求。这个请求包含了客户端的各种信息,如请求的 URL、请求方法(GET、POST 等)、请求头信息(如 User - Agent、Cookie 等)。反向代理服务器就像一个敏锐的 "门卫",时刻监听着来自客户端的请求。

反向代理服务器接收到请求后,会根据预先配置好的规则进行处理。这些规则通常定义在反向代理服务器的配置文件中,比如 Nginx 的 nginx.conf 文件。规则可能包括根据 URL 路径将请求转发到不同的后端服务器,或者根据请求头信息进行特殊处理。如果请求的 URL 路径是 "/static/" 开头,反向代理服务器可能会将其转发到专门存储静态资源的服务器;如果请求头中包含特定的认证信息,反向代理服务器可能会根据认证结果进行不同的处理。

确定了转发目标后,反向代理服务器将请求转发到后端服务器。在转发过程中,反向代理服务器会尽量保持请求的原始信息,同时可能会添加一些额外的信息,如 X - Real - IP(用于传递客户端的真实 IP 地址)、X - Forwarded - For(记录代理链中的 IP 地址)等,以便后端服务器能够获取更多的请求信息。

后端服务器接收到请求后,进行相应的处理。这可能涉及到从数据库中读取数据、执行复杂的业务逻辑、调用其他服务等。如果是一个电商网站的商品详情页请求,后端服务器可能需要从数据库中查询商品的详细信息,包括商品名称、价格、库存、图片等,然后根据这些数据生成 HTML 页面或者 JSON 数据。

后端服务器处理完请求后,将响应返回给反向代理服务器。响应中包含了处理结果,如生成的 HTML 页面、JSON 数据、图片、文件等,以及响应头信息(如 Content - Type、Content - Length、Cache - Control 等)。

反向代理服务器接收到后端服务器的响应后,会对响应进行一些处理,如缓存响应内容(如果配置了缓存策略)、对响应数据进行压缩(如 Gzip 压缩)、修改响应头信息等。反向代理服务器会将处理后的响应返回给客户端,客户端接收到响应后,浏览器会根据响应内容进行渲染,最终呈现给用户一个完整的网页。

3.2 核心组件架构

反向代理服务器的核心组件架构主要包括:请求接收模块、规则匹配模块、流量转发模块和响应处理模块。

请求接收模块负责监听网络端口,接收来自客户端的 HTTP 请求。它就像反向代理服务器的 "耳朵",时刻关注着网络上的请求信号。在 Nginx 中,通过配置 "listen" 指令来指定监听的端口和 IP 地址,比如 "listen 80;" 表示监听 80 端口,接收 HTTP 请求;"listen 443 ssl;" 表示监听 443 端口,接收 HTTPS 请求。

规则匹配模块是反向代理服务器的 "大脑",它根据预先配置好的规则,对接收到的请求进行分析和匹配,确定请求应该转发到哪个后端服务器。规则可以基于 URL 路径、请求方法、请求头信息等多种条件进行配置。在 Nginx 中,通过 "location" 块来定义规则,比如:

location /static/ {

proxy_pass http://static_server;

}:这段配置表示,当请求的 URL 路径以 "/static/" 开头时,将请求转发到名为 "static_server" 的后端服务器。

流量转发模块负责将匹配好的请求转发到后端服务器。它就像反向代理服务器的 "手臂",将请求准确地传递给目标服务器。在转发过程中,流量转发模块会处理好请求头信息的传递、保持连接等工作,确保请求能够顺利到达后端服务器。

响应处理模块负责接收后端服务器返回的响应,并对响应进行处理,如缓存、压缩、修改响应头信息等,最后将处理后的响应返回给客户端。它就像反向代理服务器的 "过滤器",对响应进行优化和调整,以提高用户体验。在 Nginx 中,可以通过配置 "proxy_cache" 指令来实现缓存功能,通过配置 "gzip" 指令来实现压缩功能。

后端服务器集群的配置方式通常有多种,常见的是通过 "upstream" 模块来定义后端服务器列表。以 Nginx 为例:

upstream backend_servers {

server 192.168.1.10:8080 weight=3;

server 192.168.1.11:8080 weight=2;

server 192.168.1.12:8080 weight=1;

}这段配置定义了一个名为 "backend_servers" 的后端服务器集群,包含了三台服务器,并且通过 "weight" 参数为每台服务器设置了不同的权重,用于实现负载均衡。

3.3 关键协议层解析

HTTP/1.1 是目前应用最为广泛的 HTTP 协议版本,它于 1999 年发布。HTTP/1.1 支持持久连接(Keep - Alive),可以在同一个 TCP 连接上发送多个请求,减少了 TCP 连接建立和关闭的开销。但是,HTTP/1.1 存在一些性能瓶颈,比如队头阻塞(Head - of - line blocking)问题。当一个请求在传输过程中出现延迟或者丢包时,后续的请求都需要等待,导致整个连接的性能下降。HTTP/1.1 的头部信息没有压缩,每次请求都需要传输完整的头部,增加了数据传输量。

HTTP/2 于 2015 年发布,它在性能上有了显著的提升。HTTP/2 引入了多路复用(Multiplexing)技术,允许多个请求和响应在同一个 TCP 连接上同时进行,解决了 HTTP/1.1 的队头阻塞问题。HTTP/2 采用二进制分帧(Binary Framing)技术,将数据分割成更小的帧进行传输,提高了传输效率。HTTP/2 还支持头部压缩(HPACK),减少了头部信息的传输量,同时支持服务器推送(Server Push),服务器可以主动向客户端推送资源,提前加载页面所需的资源,提高了页面的加载速度。

HTTP/3 是 HTTP 协议的最新版本,于 2020 年发布。HTTP/3 基于 QUIC 协议,取代了传统的 TCP 协议。QUIC 协议基于 UDP 实现,具有更低的延迟和更好的性能。HTTP/3 继承了 HTTP/2 的多路复用、头部压缩等特性,同时解决了 HTTP/2 在 TCP 层的队头阻塞问题。HTTP/3 支持 0 - RTT 连接,即客户端在第一次连接时就可以发送请求,无需等待握手完成,进一步减少了延迟。此外,HTTP/3 还支持连接迁移(Connection Migration),当网络环境发生变化时,比如从 Wi - Fi 切换到 4G,连接可以自动迁移,而无需重新建立连接。

在反向代理场景下,TCP 连接复用与长连接保持是提高性能的关键技术。TCP 连接复用是指多个请求可以复用同一个 TCP 连接,减少了 TCP 连接建立和关闭的开销。在 HTTP/1.1 中,通过设置 "Keep - Alive" 头信息来实现 TCP 连接复用;在 HTTP/2 和 HTTP/3 中,多路复用技术进一步优化了 TCP 连接的使用效率。长连接保持是指在一段时间内保持 TCP 连接的活跃状态,避免因为长时间没有数据传输而导致连接关闭。反向代理服务器可以通过配置合适的超时时间来实现长连接保持,比如在 Nginx 中,可以通过 "keepalive_timeout" 指令来设置长连接的超时时间。

WebSocket 是一种在单个 TCP 连接上进行全双工通信的协议,它使得客户端和服务器之间可以进行实时的双向通信。反向代理服务器对 WebSocket 双向通信的支持方案主要包括配置代理服务器以正确转发 WebSocket 请求和处理升级协议。

在 Nginx 中,配置 WebSocket 反向代理需要注意以下几点:

location /ws/ {

proxy_pass http://websocket_server;

proxy_http_version 1.1;

proxy_set_header Upgrade $http_upgrade;

proxy_set_header Connection "upgrade";

proxy_set_header Host $host;

}这段配置中,"proxy_http_version 1.1" 指定使用 HTTP/1.1 协议进行转发,"proxy_set_header Upgrade $http_upgrade" 和 "proxy_set_header Connection "upgrade"" 用于处理 WebSocket 的协议升级请求,确保 WebSocket 连接能够顺利建立。通过合理的配置,反向代理服务器可以有效地支持 WebSocket 双向通信,为实时性要求较高的应用场景,如在线聊天、实时监控等,提供稳定的服务。

四、反向代理的核心功能

4.1 负载均衡:流量分发的智能调度器

轮询算法是最为基础且常用的负载均衡算法。按照顺序依次将请求分发给后端服务器,确保每个服务器都有机会处理请求。在一个包含三台后端服务器(Server1、Server2、Server3)的集群中,第一个请求会被发送到 Server1,第二个请求发送到 Server2,第三个请求发送到 Server3,第四个请求又回到 Server1,以此循环。这种算法的优点是简单易懂、易于实现,适用于后端服务器性能相近、无状态服务的场景,如静态资源服务器集群、REST API 服务等。然而,轮询算法也有其局限性,它无法感知服务器的实际负载情况。如果某台服务器的性能较差或者当前处理的请求较为复杂,导致处理速度变慢,轮询算法仍会按照顺序将请求分配给它,这可能会导致该服务器过载,甚至引发雪崩效应,影响整个系统的稳定性。

加权轮询算法是在轮询算法的基础上进行了优化,它考虑到了后端服务器的性能差异。通过为每个服务器分配一个权重值,权重越高的服务器能够处理更多的请求。假设 Server1 的性能较强,分配的权重为 3;Server2 和 Server3 的性能相对较弱,权重都为 1。那么在分发请求时,每 5 个请求中,大约会有 3 个被发送到 Server1,而 Server2 和 Server3 各接收 1 个请求。这种算法适用于后端服务器硬件配置不均的场景,比如在一个集群中,既有新购置的高性能服务器,也有旧的配置较低的服务器,通过加权轮询可以让高性能服务器承担更多的负载,充分发挥其性能优势。加权轮询算法还常用于灰度发布或 A/B 测试场景,通过调整权重可以方便地控制流量比例,将少量的流量分配到新版本的服务上进行测试,确保新版本的稳定性后,再逐渐增加权重,扩大流量比例。

IP 哈希算法则是基于客户端的 IP 地址进行请求分发。它通过对客户端 IP 地址进行哈希计算,将相同 IP 的请求分发到相同的后端服务器上。这种算法的优势在于可以实现会话保持,对于一些需要保持会话一致性的应用程序非常有用,比如在线购物系统,用户在浏览商品、添加购物车、结算等一系列操作过程中,通过 IP 哈希算法可以确保这些请求始终被转发到同一台服务器上,保证了购物流程的连贯性和数据的一致性。IP 哈希算法也存在一些注意事项。在 CDN 或代理环境中,所有用户可能共享同一出口 IP,这会导致所有请求都集中到单台服务器上,造成负载不均衡;IPv4 与 IPv6 的哈希算法不同,在混合环境中使用时需要谨慎考虑;IP 哈希算法不能与 weight 参数同时使用,否则 Nginx 会忽略权重设置。

最少连接数算法是将请求发送到当前连接数最少的服务器上。它会实时监控后端服务器的连接数,将新的请求分配给最空闲的服务器,从而实现动态的负载均衡。这种算法更适合长连接或处理时间差异大的场景,比如 WebSocket 服务,由于每个连接的持续时间较长,如果使用轮询算法,可能会导致某些服务器上的连接数过多,而其他服务器上的连接数较少,造成负载不均衡。而最少连接数算法可以根据服务器的实时连接数进行动态调整,避免了这种情况的发生,确保每个服务器的负载相对均衡。

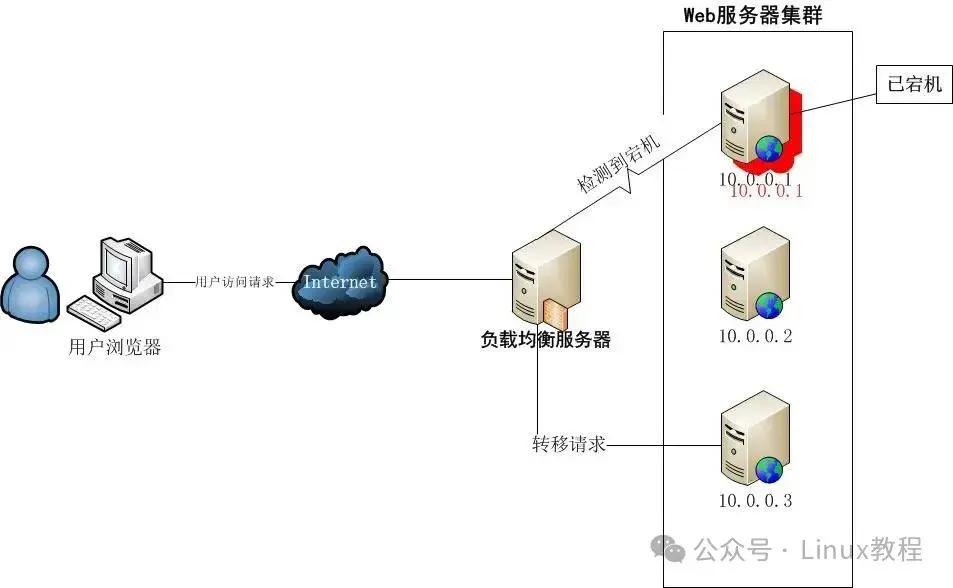

为了确保后端服务器始终处于健康状态,反向代理服务器通常会集成动态负载感知与健康检查机制。定期向后端服务器发送探测请求,比如发送 HTTP HEAD 请求或者自定义的健康检查接口请求,根据服务器的响应状态码、响应时间等指标来判断服务器是否正常运行。如果发现某台服务器出现故障,比如响应超时、返回错误状态码等,反向代理服务器会将其从可用服务器列表中剔除,不再将请求转发到该服务器上,而是将请求转发到其他健康的服务器上,实现故障自动转移。当故障服务器恢复正常后,反向代理服务器会重新将其纳入可用服务器列表,继续分配请求,从而保障了服务的高可用性和稳定性。

4.2 安全防护

隐藏真实源站 IP 是反向代理安全防护的第一道防线。在直接访问模式下,服务器的真实 IP 地址暴露在公网上,就像一座没有任何防护的城堡,攻击者可以轻易地发起攻击。而反向代理服务器作为客户端和后端服务器之间的中间人,客户端的请求首先到达反向代理服务器,反向代理服务器再将请求转发到后端服务器,这样后端服务器的真实 IP 地址就被隐藏了起来,攻击者只能获取到反向代理服务器的 IP 地址,大大降低了后端服务器被攻击的风险。即使攻击者对反向代理服务器发起攻击,由于反向代理服务器通常具备较强的防护能力和弹性,也能够在一定程度上抵御攻击,保护后端服务器的安全。

反向代理服务器在抵御 DDoS 攻击方面。它可以对请求进行流量限制,设置每个 IP 地址的请求频率上限。当检测到某个 IP 地址的请求流量超过设定的阈值时,反向代理服务器会对其进行限制或阻断,防止恶意请求对后端服务器造成冲击。反向代理服务器还可以利用自身的分布式架构和缓存机制,将部分请求进行缓存和处理,减少后端服务器的压力。当大量用户请求同一热门资源时,反向代理服务器可以直接从缓存中返回资源,而无需将请求转发到后端服务器,从而有效地减轻了后端服务器的负载,提高了系统的抗 DDoS 攻击能力。

反向代理服务器与 WAF 的集成,为后端服务器提供了更加严密的安全防护。当客户端的请求到达反向代理服务器时,WAF 首先对请求进行检测,分析请求的 URL、参数、请求头、请求体等内容,判断是否存在 SQL 注入、XSS 攻击、CSRF 攻击等恶意行为。如果检测到恶意请求,WAF 会立即将其拦截,阻止其访问后端服务器,从而有效地保护了后端服务器免受各种 Web 应用漏洞的攻击。通过合理配置 WAF 的规则,可以根据业务的特点和安全需求,对不同类型的攻击进行精准防御,确保 Web 应用的安全。

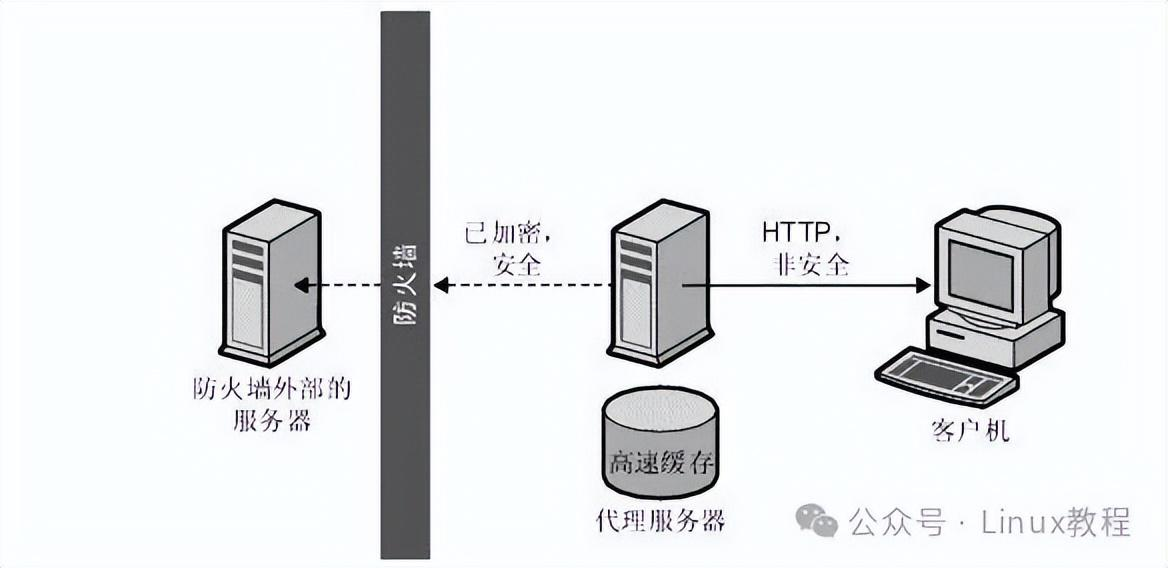

在数据传输过程中,SSL/TLS 协议是目前广泛应用的加密协议,它可以对数据进行加密传输,防止数据被窃取、篡改。反向代理服务器可以实现 SSL/TLS 终止,即客户端与反向代理服务器之间建立 SSL/TLS 加密连接,反向代理服务器再与后端服务器之间建立普通的 HTTP 连接。这样,反向代理服务器就承担了加密和解密的工作,减轻了后端服务器的加密负担,提高了系统的性能和安全性。反向代理还可以对 SSL 证书进行集中管理,方便证书的更新和维护。当证书即将过期时,运维人员可以在反向代理服务器上统一进行更新,而无需对每个后端服务器进行单独操作,大大提高了证书管理的效率和安全性。

4.3 性能优化:从缓存到压缩的极致调优

在 Web 应用中,静态资源如图片、CSS、JavaScript 文件等占据了大量的带宽和流量。如果每次请求都从后端服务器获取这些静态资源,不仅会增加后端服务器的压力,还会导致响应时间变长。反向代理服务器可以设置缓存策略,将常用的静态资源缓存到本地。当客户端再次请求这些静态资源时,反向代理服务器可以直接从缓存中返回,而无需向后端服务器请求,大大减少了响应时间,提高了访问速度。为了实现高效的静态资源缓存,需要合理设计缓存键。缓存键通常由请求的 URL、请求参数、请求头信息等组成,通过对这些信息进行哈希计算,生成唯一的缓存键。这样可以确保不同的请求能够准确地命中对应的缓存,提高缓存的命中率。在设置缓存过期时间时,需要根据资源的更新频率和业务需求进行合理配置。对于更新频率较低的静态资源,如网站的图标、全局样式表等,可以设置较长的过期时间,以减少缓存更新的频率;对于更新频率较高的资源,如用户上传的图片、动态生成的 JavaScript 文件等,则需要设置较短的过期时间,以确保用户能够及时获取到最新的资源。

反向代理服务器可以实现动静分离,将静态资源的请求直接转发到专门的静态资源服务器上,而动态请求则转发到后端的应用服务器上。这样,静态资源服务器可以专注于提供高效的静态资源服务,应用服务器可以专注于处理复杂的业务逻辑,从而提高了整个系统的性能和效率。在配置动静分离时,需要根据 URL 路径来区分静态资源和动态请求。可以通过在反向代理服务器的配置文件中设置不同的 location 块,对以特定路径开头的请求进行不同的处理。对于以 "/static/" 开头的请求,将其转发到静态资源服务器;对于其他请求,则转发到应用服务器。还可以对静态资源服务器进行优化,如使用高性能的文件系统、开启文件缓存等,以进一步提高静态资源的服务效率。

在网络传输过程中,数据传输量的大小直接影响着响应时间。反向代理服务器可以对响应数据进行压缩,如 Gzip、Brotli 等压缩算法,将数据的体积缩小,减少网络传输时间。当客户端请求一个网页时,反向代理服务器会将网页内容进行压缩后再返回给客户端,客户端接收到压缩后的内容后,再进行解压缩显示。在配置内容压缩时,需要注意一些参数的调优。可以设置压缩级别,压缩级别越高,压缩比越大,但同时也会消耗更多的 CPU 资源。一般来说,选择适中的压缩级别(如 Gzip 的压缩级别为 6)可以在保证压缩效果的同时,尽量减少对 CPU 资源的消耗。还需要指定需要压缩的文件类型,通常包括文本文件(如 HTML、CSS、JavaScript)、JSON 数据等,对于图片、视频等二进制文件,由于其本身已经经过压缩,再次压缩的效果不明显,且会消耗大量的 CPU 资源,因此一般不进行压缩。

五、反向代理方案怎么选?

5.1 Nginx

Nginx 是一款开源的高性能 HTTP 和反向代理服务器,同时也支持邮件代理、TCP/UDP 负载均衡等功能。它以其异步非阻塞的事件驱动架构而闻名,在高并发场景下表现卓越,能够轻松应对数万甚至数十万的并发连接,是众多大型互联网公司的首选反向代理工具。

Nginx 的核心优势主要体现在以下几个方面:

- 高并发处理能力:基于事件驱动的异步非阻塞架构,Nginx 在处理大量并发连接时,能够高效地利用系统资源,减少线程切换开销,从而实现高并发处理。与传统的多线程 / 多进程模型相比,Nginx 的事件驱动模型可以在单台服务器上支持更多的并发连接,大大提高了系统的吞吐量和响应速度。在处理静态资源时,Nginx 可以通过 sendfile 等技术实现零拷贝,进一步提高传输效率。

- 低资源消耗:Nginx 的内存占用低,对服务器硬件资源的要求相对较低,这使得它在资源受限的环境中也能稳定运行。在容器化部署中,Nginx 可以轻松地部署在资源有限的容器中,为容器化应用提供高效的反向代理和负载均衡服务。

- 灵活的配置与模块化设计:Nginx 支持丰富的指令和模块,通过配置文件可以灵活地实现各种功能,如 URL 重写、Gzip 压缩、缓存、负载均衡、SSL/TLS 加密等。Nginx 还支持第三方模块扩展,用户可以根据自己的需求添加自定义功能,如使用 ngx_lua 模块实现动态脚本处理,使用 ModSecurity 模块增强安全防护能力。

- 高可用性:Nginx 提供了强大的负载均衡功能,支持多种负载均衡算法,如轮询、加权轮询、IP 哈希、最少连接数等,可以根据后端服务器的性能和负载情况,动态地分配请求,实现高效的负载均衡。Nginx 还支持热更新,通过 "nginx -s reload" 命令可以在不中断服务的情况下更新配置文件或二进制文件,保证了服务的连续性和稳定性。

Nginx 适用于多种场景,如 Web 应用反向代理、静态资源服务、API 网关、负载均衡、SSL/TLS 终端等。在 Web 应用反向代理场景中,Nginx 可以隐藏后端服务器的真实 IP 地址,保护后端服务器的安全,同时可以对请求进行缓存、压缩等处理,提高响应速度。在静态资源服务场景中,Nginx 可以直接托管 HTML、CSS、图片等静态文件,减少后端应用服务器的压力,提高静态资源的访问效率。在 API 网关场景中,Nginx 可以作为微服务架构的入口,实现 API 请求的路由、限流、缓存、日志等统一管理。

下面是一个 Nginx 基础反向代理配置示例:

server {

listen 80;

server_name example.com;

location / {

proxy_pass http://backend_server:8080;

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_set_header X-Forwarded-Proto $scheme;

}

}在这个配置中,server块定义了一个虚拟主机,监听 80 端口,域名为example.com。location /块表示对所有请求进行处理,proxy_pass指令将请求转发到后端服务器http://backend_server:8080,proxy_set_header指令用于设置转发请求时的头部信息,将客户端的真实 IP 地址等信息传递给后端服务器。

Nginx 高性能背后的技术原理主要包括事件驱动模型、异步非阻塞 I/O 和 epoll 多路复用机制。事件驱动模型基于操作系统的高效 I/O 事件通知机制(Linux 下为 epoll,Mac 下为 kqueue),Nginx 利用事件循环处理连接的可读、可写、超时等事件,当某个事件发生时,Nginx 会及时响应并处理,避免了线程的阻塞和等待。异步非阻塞 I/O 使得 Nginx 在处理 I/O 操作时,不会阻塞线程,而是立即返回,线程可以继续处理其他任务,提高了线程的利用率。epoll 多路复用机制允许 Nginx 在一个线程中同时监听多个文件描述符(如 socket)的事件,当有事件发生时,epoll 会通知 Nginx,Nginx 再对相应的事件进行处理,从而实现了高效的并发处理。

5.2 其他主流方案

HAProxy:HAProxy 是一款支持 TCP 和 HTTP 协议的高性能负载均衡器,它专注于负载均衡功能,在四层和七层都能提供高效的流量分发。HAProxy 支持多种负载均衡算法,如轮询、加权轮询、最少连接数、IP 哈希、一致性哈希等,还支持会话保持、健康检查、故障转移等功能。HAProxy 的配置相对简单,性能出色,适合对负载均衡功能要求较高的场景,如数据库集群代理、缓存服务负载均衡、Web 应用的负载均衡等。在电商网站中,HAProxy 可以将用户的请求均匀地分配到多个后端服务器上,确保系统的高可用性和高性能。

Traefik:Traefik 是一款云原生的反向代理和负载均衡器,它具有自动服务发现功能,能够与 Docker、Kubernetes、Mesos 等容器编排工具无缝集成。Traefik 可以根据容器的标签自动生成路由规则,实现动态的服务发现和负载均衡。Traefik 还支持 HTTP/2、WebSocket、gRPC 等协议,提供了丰富的中间件功能,如认证、重定向、限流等。Traefik 适用于云原生环境,特别是在 Kubernetes 集群中,它可以作为 Ingress Controller,为集群内的服务提供外部访问入口,实现服务的路由和负载均衡。

Envoy:Envoy 是一款专为云原生应用和微服务架构设计的高性能代理。它主要用于服务网格中,作为服务间通信的代理,提供负载均衡、服务发现、流量管理、安全通信等功能。Envoy 采用了数据平面和控制平面分离的架构,数据平面负责处理实际的流量,控制平面负责管理和配置数据平面。Envoy 支持多种协议,如 HTTP/2、gRPC、TCP、UDP 等,具有强大的流量管理能力,如动态路由、熔断器、限流、重试等。在大型微服务架构中,Envoy 可以帮助实现服务之间的高效通信和管理,提高系统的可维护性和可扩展性。

Apache mod_proxy:Apache mod_proxy 是 Apache HTTP Server 的一个模块,它提供了反向代理和负载均衡功能。Apache 是一款历史悠久、功能强大的 Web 服务器,mod_proxy 模块使得 Apache 能够作为反向代理服务器,将请求转发到后端的服务器上。mod_proxy 支持多种协议,如 HTTP、HTTPS、FTP 等,还支持简单的负载均衡算法,如轮询、加权轮询等。Apache mod_proxy 的优势在于它与 Apache 服务器的紧密集成,对于已经使用 Apache 服务器的用户来说,配置和使用相对简单。它适用于对兼容性要求较高,且对反向代理和负载均衡功能需求不是特别复杂的场景。

下面是一个主流反向代理工具的对比表格:

|------------------|---------------------------|------------------------------------------|-----------------|----------|

| 工具 | 核心优势 | 适用场景 | 配置难度 | 性能表现 |

| Nginx | 高并发处理、低资源消耗、灵活配置、模块化设计 | Web 应用反向代理、静态资源服务、API 网关、负载均衡、SSL/TLS 终端 | 中等 | 高 |

| HAProxy | 专注负载均衡,支持多种算法和协议 | 数据库集群代理、缓存服务负载均衡、Web 应用负载均衡 | 中等 | 高 |

| Traefik | 云原生自动服务发现,与容器编排工具集成,丰富中间件 | 云原生环境,Kubernetes 集群 Ingress Controller | 中等 | 高 |

| Envoy | 微服务架构服务网格,强大的流量管理能力 | 大型微服务架构,服务间通信代理 | 高 | 高 |

| Apache mod_proxy | 与 Apache 服务器紧密集成,兼容性强 | 对兼容性要求高,反向代理和负载均衡功能需求不复杂 | 低(基于 Apache 配置) | 中等 |

六、实战:搭建反向代理

6.1 Nginx 反向代理基础配置

假设我们有一个后端服务,部署在192.168.1.100:8080,现在需要使用 Nginx 作为反向代理,将客户端对example.com的请求转发到该后端服务。以下是基本的 Nginx 配置文件:

server {

listen 80;

server_name example.com;

location / {

proxy_pass http://192.168.1.100:8080;

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_set_header X-Forwarded-Proto $scheme;

}

}在这个配置中:

- listen 80;:表示 Nginx 监听 80 端口,接收 HTTP 请求。

- server_name example.com;:指定了该虚拟主机的域名是example.com,当客户端请求这个域名时,会匹配到这个server块。

- location /:表示匹配所有的请求路径。

- proxy_pass http://192.168.1.100:8080;:将请求转发到后端服务器192.168.1.100:8080。

- proxy_set_header系列指令:用于设置转发请求时的头部信息。proxy_set_header Host host;传递原始请求的Host头,让后端服务器知道客户端请求的域名;proxy_set_header X-Real-IP remote_addr;传递客户端的真实 IP 地址;proxy_set_header X-Forwarded-For proxy_add_x_forwarded_for;记录经过代理链的客户端 IP 列表;proxy_set_header X-Forwarded-Proto scheme;传递请求协议(http或https) 。

6.2 关键配置参数详解

-

proxy_set_header 传递真实 IP:在反向代理中,后端服务器需要知道客户端的真实 IP 地址,以便进行日志记录、访问控制等操作。proxy_set_header X-Real-IP remote_addr;和proxy_set_header X-Forwarded-For proxy_add_x_forwarded_for;这两个指令就起到了传递真实 IP 的作用。remote_addr变量表示客户端的 IP 地址,proxy_add_x_forwarded_for变量会将代理服务器的 IP 地址添加到客户端 IP 列表中,这样后端服务器就可以获取到完整的客户端 IP 信息。如果不设置这两个头信息,后端服务器获取到的 IP 地址将是反向代理服务器的 IP,这会导致无法准确识别客户端,影响业务的正常运行。

-

proxy_connect_timeout 设置连接超时:proxy_connect_timeout用于设置 Nginx 与后端服务器建立连接的超时时间,默认值是 60 秒。例如:

location / {

proxy_connect_timeout 10s;

proxy_pass http://backend_server;

}

在上述配置中,将连接超时时间设置为 10 秒。如果在 10 秒内无法与后端服务器建立连接,Nginx 将返回错误信息给客户端。合理设置这个参数可以避免因后端服务器响应过慢而导致客户端长时间等待。如果设置过短,可能会导致正常的连接也被判定为超时;如果设置过长,在后端服务器出现故障时,客户端会等待较长时间才会收到错误提示。

-

proxy_buffering 缓冲区优化:proxy_buffering用于控制是否开启反向代理的响应缓冲。默认情况下,Nginx 会将后端服务器的响应数据缓冲到内存中,然后再返回给客户端。通过设置proxy_buffering off;可以关闭响应缓冲,适用于实时流等场景,如视频直播、实时日志输出等。例如:

location /live/ {

proxy_buffering off;

proxy_pass http://live_server;

}

在视频直播场景中,关闭响应缓冲可以让客户端更快地接收到直播数据,减少延迟。但关闭缓冲也会增加网络带宽的压力,因为数据会直接从后端服务器传输到客户端,而不经过缓存。在配置时需要根据具体的业务场景和服务器性能进行权衡。

6.3 负载均衡配置实战

假设我们有一个后端服务器集群,包含三台服务器,IP 地址分别为192.168.1.100:8080、192.168.1.101:8080和192.168.1.102:8080,现在要使用 Nginx 实现负载均衡。以下是配置示例:

upstream backend_servers {

server 192.168.1.100:8080 weight=3;

server 192.168.1.101:8080 weight=2;

server 192.168.1.102:8080 weight=1;

}

server {

listen 80;

server_name example.com;

location / {

proxy_pass http://backend_servers;

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_set_header X-Forwarded-Proto $scheme;

}

}在这个配置中:

- upstream backend_servers:定义了一个名为backend_servers的后端服务器组。

- server 192.168.1.100:8080 weight=3;等配置:定义了后端服务器列表,并为每台服务器设置了权重。权重越高,分配到的请求就越多。在这个例子中,192.168.1.100:8080的权重为 3,192.168.1.101:8080的权重为 2,192.168.1.102:8080的权重为 1,那么每 6 个请求中,大约会有 3 个被发送到192.168.1.100:8080,2 个被发送到192.168.1.101:8080,1 个被发送到192.168.1.102:8080。

为了实现健康检查和故障自动转移,我们可以使用第三方模块ngx_http_upstream_check_module。以下是配置示例:

upstream backend_servers {

server 192.168.1.100:8080;

server 192.168.1.101:8080;

server 192.168.1.102:8080;

check interval=3000 rise=2 fall=5 timeout=1000 type=http;

check_http_send "GET /health HTTP/1.0\r\n\r\n";

check_http_expect_alive http_2xx http_3xx;

}

server {

listen 80;

server_name example.com;

location / {

proxy_pass http://backend_servers;

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_set_header X-Forwarded-Proto $scheme;

proxy_next_upstream error timeout http_500 http_502 http_503 http_504;

proxy_next_upstream_tries 2;

proxy_next_upstream_timeout 10s;

}

}在这个配置中:

- check interval=3000 rise=2 fall=5 timeout=1000 type=http;:表示每 3000 毫秒(3 秒)检查一次后端服务器的健康状态,连续 2 次成功则认为服务器正常,连续 5 次失败则认为服务器故障,超时时间为 1000 毫秒(1 秒),检查方式为 HTTP。

- check_http_send "GET /health HTTP/1.0\r\n\r\n";:指定发送的健康检查请求为GET /health HTTP/1.0\r\n\r\n,后端服务器需要提供一个/health的健康检查接口,返回 2xx 或 3xx 状态码表示正常。

- check_http_expect_alive http_2xx http_3xx;:表示期望后端服务器返回 2xx 或 3xx 状态码来确认服务器正常。

- proxy_next_upstream error timeout http_500 http_502 http_503 http_504;:当出现错误、超时、后端返回 500、502、503、504 状态码时,将请求转发到下一台服务器。

- proxy_next_upstream_tries 2;:最多尝试转发 2 次。

- proxy_next_upstream_timeout 10s;:每次转发的超时时间为 10 秒。

通过以上配置,Nginx 可以实时监测后端服务器的健康状态,当发现某台服务器出现故障时,会自动将请求转发到其他健康的服务器上,实现故障自动转移,保障服务的高可用性。

6.4 WebSocket 反向代理实践

假设我们有一个 WebSocket 服务,部署在192.168.1.100:8081,现在要使用 Nginx 作为反向代理,将客户端对example.com/ws的请求转发到该 WebSocket 服务。以下是配置示例:

http {

map $http_upgrade $connection_upgrade {

default upgrade;

'' close;

}

server {

listen 80;

server_name example.com;

location /ws/ {

proxy_pass http://192.168.1.100:8081;

proxy_http_version 1.1;

proxy_set_header Upgrade $http_upgrade;

proxy_set_header Connection $connection_upgrade;

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_set_header X-Forwarded-Proto $scheme;

proxy_read_timeout 3600s;

}

}

}在这个配置中:

- map http_upgrade connection_upgrade:定义了一个映射,根据http_upgrade变量的值来设置connection_upgrade变量的值。当http_upgrade有值时(即请求是 WebSocket 升级请求),connection_upgrade设置为upgrade,否则设置为close。

- proxy_http_version 1.1;:必须使用 HTTP/1.1 协议,因为 HTTP/1.0 不支持Keep - alive和Upgrade。

- proxy_set_header Upgrade http_upgrade;和proxy_set_header Connection connection_upgrade;:传递Upgrade头部,告知后端进行协议升级,这是完成 WebSocket 握手协议升级的必要步骤。

- proxy_read_timeout 3600s;:适当延长读取超时时间,避免长连接因空闲被切断。WebSocket 通常保持长连接,默认的 60 秒超时往往不足,根据业务需求将其设置为 3600 秒(1 小时)。

配置完成后,我们可以通过前端代码来验证 WebSocket 反向代理是否配置成功。以下是一个简单的 JavaScript 示例:

<!DOCTYPE html>

<html lang="en">

<head>

<meta charset="UTF-8">

</head>

<body>

<script>

const socket = new WebSocket('ws://example.com/ws');

socket.onopen = function (event) {

console.log('WebSocket连接已建立');

socket.send('Hello, Server!');

};

socket.onmessage = function (event) {

console.log('收到服务器消息:', event.data);

};

socket.onerror = function (error) {

console.error('WebSocket连接错误:', error);

};

socket.onclose = function (event) {

console.log('WebSocket连接已关闭');

};

</script>

</body>

</html>在浏览器中打开这个 HTML 页面,如果控制台输出WebSocket连接已建立,并且能够成功发送和接收消息,说明 WebSocket 反向代理配置成功。通过以上配置和验证,我们成功实现了 WebSocket 反向代理,确保了 WebSocket 服务在反向代理环境下的正常运行,为实时通信应用提供了可靠的支持。

七、高级架构

7.1 多层代理架构

在大型互联网应用中,多层代理架构是提升系统性能和安全性的关键设计。以 CDN(内容分发网络) + 反向代理 + 后端服务的三层架构为例:

CDN 处于整个架构的最前端,它在全球范围内分布着大量的边缘节点。这些节点就像一个个 "快递驿站",将网站的静态资源,如图片、CSS、JavaScript 文件等,缓存到离用户最近的节点上。当用户发起请求时,CDN 会根据用户的地理位置和网络状况,智能地选择最近的节点,将缓存的静态资源直接返回给用户。这样,不仅大大减少了网络传输的距离和时间,提高了用户的访问速度,还减轻了后端服务器的压力。像淘宝、京东等电商平台,在 "双 11""618" 等促销活动期间,大量的用户请求会首先被 CDN 节点处理,通过 CDN 的缓存和智能路由,用户能够快速获取商品图片、页面样式等静态资源,确保了购物页面的快速加载,提升了用户体验。

反向代理位于 CDN 和后端服务之间,它连接客户端和后端服务。对于动态请求,如用户的登录、下单、查询订单等操作,CDN 会将请求转发给反向代理。反向代理根据预设的规则,将请求转发到合适的后端服务器上。反向代理还具备负载均衡的能力,它会实时监测后端服务器的负载情况,将请求均匀地分配到各个后端服务器上,避免单个服务器因负载过高而出现性能瓶颈。同时,反向代理可以对请求进行安全检测和过滤,如防止 SQL 注入、XSS 攻击等,保护后端服务的安全。在一个微服务架构的电商系统中,反向代理可以作为 API Gateway,统一管理各个微服务的入口,对用户的请求进行身份验证、权限控制、流量限制等处理,确保系统的安全性和稳定性。

后端服务由多个应用服务器和数据库服务器组成,负责处理业务逻辑和数据存储。在电商系统中,后端服务包括商品管理、订单管理、用户管理、支付管理等多个模块,这些模块协同工作,完成用户的各种操作。通过多层代理架构,后端服务可以专注于业务逻辑的处理,提高系统的性能和可维护性。

7.2 高可用设计

主备模式是一种常见的高可用部署方案,它通过设置一个主反向代理服务器和一个或多个备用反向代理服务器,来保证服务的连续性。主反向代理服务器负责处理客户端的请求,备用反向代理服务器则处于待命状态,实时监测主服务器的运行状态。当主服务器出现故障时,备用服务器会迅速接管主服务器的工作,继续为客户端提供服务。这种模式就像给系统安装了一个 "备用电源",当主电源出现问题时,备用电源能够及时启动,确保系统的正常运行。

集群化部署是另一种提高反向代理高可用性的有效方式。在集群化部署中,多个反向代理服务器组成一个集群,共同承担客户端的请求处理任务。集群中的每个服务器都可以处理请求,当某个服务器出现故障时,其他服务器可以自动接管其工作,从而保证系统的可用性。集群化部署还可以通过负载均衡算法,将请求均匀地分配到各个服务器上,提高系统的处理能力和性能。以 Nginx 为例,可以通过配置 Nginx 的 upstream 模块,将多个 Nginx 服务器组成一个集群,实现负载均衡和高可用性。

Keepalived 是一个基于 VRRP(Virtual Router Redundancy Protocol,虚拟路由器冗余协议)的高可用解决方案,它可以实现反向代理服务器的故障自动切换。Keepalived 通过监控反向代理服务器的状态,当发现主服务器出现故障时,会自动将备用服务器提升为主服务器,确保服务的连续性。Keepalived 还可以与负载均衡器配合使用,实现更高级的高可用架构。在一个使用 Nginx 作为反向代理的系统中,可以通过 Keepalived 监控 Nginx 服务器的状态,当某个 Nginx 服务器出现故障时,Keepalived 会自动将其从负载均衡器的后端服务器列表中移除,并将请求转发到其他正常的服务器上,同时将备用 Nginx 服务器加入到后端服务器列表中,实现故障自动切换,保障系统的高可用性。

7.3 可观测性建设

访问日志是了解系统运行状况的重要依据,标准化采集访问日志可以确保数据的一致性和准确性。通过配置反向代理服务器,如 Nginx,可以将访问日志按照统一的格式记录下来,包括客户端 IP、请求时间、请求 URL、响应状态码、响应时间等信息。这些日志可以存储在集中式的日志管理系统中,如 ELK(Elasticsearch、Logstash、Kibana)或 Graylog,方便进行查询和分析。通过分析访问日志,可以了解用户的访问行为,发现潜在的性能问题和安全隐患。如果发现某个 IP 地址频繁发起请求,且响应状态码为 403(禁止访问),可能存在恶意攻击的风险;如果某个 URL 的响应时间过长,可能需要对后端服务进行优化。

Prometheus 是一款开源的系统监控和警报工具,它可以用于采集反向代理的各种监控指标,如请求量、延迟、错误率等。通过在反向代理服务器上配置 Prometheus 的客户端,如 Nginx 的 nginx - prometheus - exporter,Prometheus 可以定期采集这些指标数据,并存储在时间序列数据库中。Prometheus 还提供了强大的查询语言 PromQL,可以对采集到的数据进行灵活的查询和分析。可以使用 PromQL 查询某个时间段内的平均请求延迟,或者查询错误率超过一定阈值的请求数量,从而及时发现系统的性能瓶颈和异常情况。

Grafana 是一款开源的可视化平台,它可以与 Prometheus 集成,将 Prometheus 采集到的监控指标数据以直观的图表形式展示出来。通过在 Grafana 中创建仪表盘(Dashboard),可以实时监控反向代理的运行状态。可以创建一个仪表盘,展示反向代理的请求量趋势、响应时间分布、错误率变化等指标,通过不同的图表类型,如折线图、柱状图、饼图等,清晰地呈现系统的运行状况。当某个指标出现异常时,如请求量突然飙升、错误率急剧上升,运维人员可以通过 Grafana 及时发现问题,并采取相应的措施进行处理,实现问题的快速定位和解决,保障系统的稳定运行。

7.4 安全加固实践

在生产环境中,限制访问 IP 是一种简单有效的安全策略,它可以通过配置反向代理服务器,只允许特定 IP 地址或 IP 地址段的请求访问后端服务。在 Nginx 中,可以使用 allow 和 deny 指令来实现 IP 访问限制。如果只允许公司内部的 IP 地址段 192.168.1.0/24 访问,可以在 Nginx 的配置文件中添加如下配置:

location / {

allow 192.168.1.0/24;

deny all;

}这样,除了 192.168.1.0/24 这个 IP 地址段的请求外,其他所有请求都会被拒绝,从而有效地防止了外部非法访问。

配置请求限速可以防止恶意用户通过大量的请求来耗尽服务器资源,从而保护后端服务的正常运行。在 Nginx 中,可以使用 ngx_http_limit_req_module 模块来实现请求限速。可以限制每个 IP 地址每秒最多只能发起 10 个请求,配置如下:

http {

limit_req_zone $binary_remote_addr zone=mylimit:10m rate=10r/s;

server {

location / {

limit_req zone=mylimit;

}

}

}在这个配置中,定义了一个名为 mylimit 的限制区域,大小为 10m,限制速率为每秒 10 个请求。当某个 IP 地址的请求速率超过这个限制时,Nginx 会返回 503 Service Temporarily Unavailable 错误,从而限制了恶意请求的频率。

隐藏 Nginx 版本信息可以避免攻击者通过版本信息来寻找已知的漏洞进行攻击。在 Nginx 中,可以通过配置来隐藏版本信息。在 Nginx 的配置文件中添加如下配置:

server_tokens off;这样,在 Nginx 返回的响应头中,就不会包含 Nginx 的版本信息,从而增加了系统的安全性。

WAF(Web 应用防火墙)是保障 Web 应用安全的重要工具,定期更新 WAF 规则可以确保其能够及时识别和拦截最新的攻击类型。WAF 可以对 HTTP 请求进行深度检测,识别并拦截各种恶意请求,如 SQL 注入、XSS 攻击、CSRF 攻击等。不同的 WAF 产品有不同的规则更新方式,一般可以通过官方提供的更新渠道,如在线更新、离线更新包等,来获取最新的规则。一些商业 WAF 产品会提供自动更新功能,确保 WAF 始终保持最新的防护能力。在使用 WAF 时,还需要根据业务的特点和安全需求,对规则进行合理的配置和调整,以实现精准防护,提高系统的抗攻击能力。

八、性能优化

8.1 连接池优化

在高并发场景下,频繁的 TCP 连接建立与断开会消耗大量的系统资源,严重影响反向代理的性能。Nginx 通过 keepalive 连接复用配置来解决这一问题。在 Nginx 的 upstream 模块中,可以设置 keepalive 参数,例如:

upstream backend_servers {

server 192.168.1.100:8080;

server 192.168.1.101:8080;

keepalive 32;

}上述配置表示 Nginx 与后端服务器之间将保持 32 个空闲的长连接。当有新的请求到来时,Nginx 会优先复用这些空闲连接,而不是重新建立 TCP 连接,从而大大减少了连接建立的开销,提高了请求处理效率。同时,还需要在 location 块中设置相关的 HTTP 版本和连接头信息,确保连接复用的正常工作:

location / {

proxy_http_version 1.1;

proxy_set_header Connection "";

proxy_pass http://backend_servers;

}proxy_http_version 1.1;指定使用 HTTP/1.1 协议,因为该协议支持长连接;proxy_set_header Connection "";则确保连接不会被意外关闭,保证了连接复用的有效性。

worker_connections 参数用于设置每个工作进程可以同时处理的最大连接数,它直接影响着 Nginx 的并发处理能力。在 Nginx 的 events 模块中进行设置,例如:

events {

worker_connections 1024;

}假设 Nginx 配置了 4 个工作进程(worker_processes 4;),那么 Nginx 理论上可以同时处理 4 * 1024 = 4096 个连接。合理调整 worker_connections 的值,需要综合考虑服务器的硬件资源,如内存大小。每个连接在处理过程中会占用一定的内存空间,若设置的值过大,可能导致内存不足;若设置过小,则无法充分利用服务器资源,限制了并发处理能力。可以通过监控服务器的内存使用情况和连接数,逐步调整该参数,找到最佳的配置值,以实现高效的并发处理。

8.2 缓存策略优化

缓存键的设计直接影响着缓存的命中率。一个精细化设计的缓存键应包含足够的信息,以确保不同的请求能够准确地命中对应的缓存。在 Nginx 中,可以使用 md5 函数对请求的 URL、请求参数、请求头信息等进行哈希计算,生成唯一的缓存键。例如:

proxy_cache_path /path/to/cache levels=1:2 keys_zone=my_cache:10m max_size=10g inactive=60m;

server {

location / {

set $cache_key "$uri$is_args$args";

proxy_cache my_cache;

proxy_cache_key "$md5($cache_key)";

proxy_cache_valid 200 302 10m;

proxy_cache_valid 404 1m;

proxy_pass http://backend_server;

}

}在上述配置中,cache_key变量包含了请求的 URI、是否有参数以及参数内容,通过md5(cache_key)生成唯一的缓存键,确保了缓存的精准命中。

搭建多级缓存架构可以进一步提升缓存的性能和命中率。以 CDN + Nginx 的两级缓存架构为例,CDN 作为一级缓存,在全球范围内分布着大量的边缘节点,将常用的静态资源缓存到离用户最近的节点上,实现快速响应。Nginx 作为二级缓存,在本地服务器上缓存部分资源,当 CDN 未命中缓存时,Nginx 可以提供缓存服务。这样,通过多级缓存的协同工作,大大提高了缓存的命中率,减少了后端服务器的压力。

缓存预热是指在系统上线或缓存失效后,提前将常用的资源缓存到反向代理服务器中,以提高首次访问的速度。可以通过编写脚本,模拟用户请求,将需要缓存的资源提前请求一遍,使其缓存到反向代理服务器中。例如,使用 Python 的 requests 库编写缓存预热脚本:

import requests

urls = [

"http://example.com/static/js/main.js",

"http://example.com/static/css/style.css",

"http://example.com/api/data"

]

for url in urls:

requests.get(url)缓存失效机制则是确保缓存中的数据始终是最新的。可以通过设置合理的缓存过期时间,如proxy_cache_valid指令,为不同的 HTTP 状态码设置不同的缓存时间。对于更新频率较低的静态资源,可以设置较长的过期时间;对于动态数据,如 API 接口返回的数据,设置较短的过期时间。还可以使用缓存更新策略,当后端资源发生变化时,主动清除相关的缓存,确保用户能够获取到最新的数据。

8.3 缓冲区与超时配置

Nginx 的缓冲区参数proxy_buffer_size和proxy_buffers对请求与响应的内存处理起着关键作用。proxy_buffer_size用于设置存储响应头的缓冲区大小,默认值通常较小,可能无法满足包含大量 Cookie、CSP 等大头信息的请求。在处理大型前端资源时,默认的缓冲区配置可能导致资源加载失败。合理调整这些参数可以有效解决此类问题,例如:

proxy_buffer_size 128k;

proxy_buffers 32 128k;上述配置将响应头缓冲区大小设置为 128k,响应体缓冲区设置为 32 个 128k 的缓冲区,总容量达到 4MB,足以覆盖常见的前端资源大小,避免了因缓冲区不足而导致的数据写入临时文件或加载失败的问题。

合理设置超时时间对于提升反向代理的并发处理能力至关重要。proxy_connect_timeout用于设置 Nginx 与后端服务器建立连接的超时时间,proxy_send_timeout控制两次写操作之间的间隔上限,proxy_read_timeout则规定从后端读取响应头或数据的超时间隔。在高负载或跨机房场景下,网络延迟可能较高,若超时时间设置过短,会导致连接建立或数据读取失败。将proxy_connect_timeout设置为 3 - 5s,proxy_read_timeout设置为 10 - 30s,可以在保证连接稳定性的同时,避免因后端偶发卡顿而拖垮整个连接池。所有的 timeout 值应明显小于客户端的client_header_timeout和client_body_timeout,防止 Nginx 卡在上游时客户端已断开,造成连接堆积,影响并发处理能力。

8.4 内核参数调优

在 Linux 系统中,调整文件描述符上限是提升反向代理性能的重要步骤。文件描述符是内核为了管理已打开的文件、socket 等资源而分配的一个整数。在高并发场景下,若文件描述符上限过低,Nginx 可能无法处理大量的并发连接。可以通过修改/etc/security/limits.conf文件来提高文件描述符上限,例如:

nginx soft nofile 65535

nginx hard nofile 65535上述配置将 Nginx 用户的软限制和硬限制文件描述符数量都设置为 65535,确保 Nginx 在高并发情况下能够正常处理大量的连接。修改完成后,需要重新登录或使用ulimit -n 65535命令使配置生效。

优化 TCP 协议参数可以进一步提升反向代理的性能。tcp_tw_reuse参数允许将处于 TIME_WAIT 状态的 socket 重新用于新的 TCP 连接,减少了 TIME_WAIT 状态的 socket 数量,提高了端口的复用率,从而提升了并发处理能力。可以通过修改/etc/sysctl.conf文件来启用该参数:

net.ipv4.tcp_tw_reuse = 1修改完成后,使用sysctl -p命令使配置生效。tcp_max_syn_backlog参数用于设置 TCP 连接建立过程中 SYN 队列的最大长度,在高并发场景下,适当增大该值可以避免因 SYN 队列溢出而导致的连接失败。例如,将其设置为 1024:

net.ipv4.tcp_max_syn_backlog = 1024通过合理调整这些内核参数,为反向代理提供了更强大的底层性能支撑,确保其在高并发场景下能够稳定、高效地运行。

九、常见问题与故障排查

9.1 典型问题

请求转发失败是较为常见的问题之一,例如反向代理服务器与后端服务器之间的网络线路出现故障、网络延迟过高或丢包严重等,都可能使得请求无法正常到达后端服务器。后端服务器故障也是一个重要原因,若后端服务器宕机、服务未正常启动或者资源耗尽,反向代理服务器就无法将请求成功转发。配置错误同样不容忽视,如反向代理服务器的配置文件中proxy_pass指令指定的后端服务器地址错误、端口号不正确,或者proxy_set_header指令设置的头部信息有误,都可能导致请求转发失败。当proxy_pass指令中的 IP 地址拼写错误,或者端口号与后端服务器实际监听的端口不一致时,请求将无法被正确转发。

缓存失效问题会导致用户无法获取到缓存中的数据,从而增加后端服务器的压力,降低服务的响应速度。缓存过期时间设置不合理是导致缓存失效的常见原因之一。如果缓存过期时间设置过短,数据可能会频繁从后端服务器获取,无法充分发挥缓存的作用;如果设置过长,又可能导致用户获取到的数据不是最新的。缓存穿透也是一个棘手的问题,即攻击者故意构造大量不存在的请求,使得反向代理服务器无法从缓存中获取数据,只能将请求转发到后端服务器,从而导致后端服务器压力过大。缓存雪崩同样不容忽视,当大量缓存同时过期时,所有请求都会直接转发到后端服务器,可能会造成后端服务器不堪重负,甚至崩溃。

在 WebSocket 反向代理场景中,连接断开问题会严重影响实时通信的稳定性。代理服务器配置不当是导致连接断开的常见原因,例如proxy_read_timeout和proxy_send_timeout设置过短,可能会导致在数据传输过程中,由于超时而断开连接。WebSocket 协议升级失败也可能导致连接断开,这可能是由于反向代理服务器在转发请求时,未正确处理 WebSocket 的协议升级请求,如未正确设置Upgrade和Connection头部信息。

SSL 证书配置错误会导致 HTTPS 连接无法正常建立,从而影响数据的安全性和服务的可用性。证书过期是最常见的问题之一,当证书过期后,浏览器会提示证书无效,用户无法正常访问网站。证书链不完整也会导致问题,即证书缺少中间证书或根证书,使得浏览器无法验证证书的合法性。证书与域名不匹配同样会引发问题,当证书绑定的域名与实际访问的域名不一致时,浏览器会提示证书错误,阻止用户访问。

9.2 调试技巧与工具

在修改 Nginx 配置文件后,可以使用nginx -t命令来检查配置文件的语法是否正确。如果配置文件存在语法错误,nginx -t命令会给出详细的错误提示,帮助我们及时发现并修正问题。当配置文件中存在指令拼写错误、括号不匹配等问题时,nginx -t命令会指出错误的位置和原因,我们可以根据提示进行修改,确保配置文件的正确性。

通过分析 Nginx 的访问日志,我们可以获取到请求的详细信息,如客户端 IP、请求时间、请求 URL、响应状态码、响应时间等。这些信息可以帮助我们判断请求是否正常转发、后端服务器的响应是否正常、是否存在异常流量等。如果发现某个 IP 地址频繁发起请求,且响应状态码为 403(禁止访问),可能存在恶意攻击的风险;如果某个 URL 的响应时间过长,可能需要对后端服务进行优化。

通过curl命令,我们可以发送各种类型的请求,如 GET、POST、PUT、DELETE 等,并查看响应结果。我们可以使用curl -I命令查看请求的响应头信息,了解响应的状态码、内容类型、缓存控制等信息;使用curl -v命令可以查看详细的请求和响应过程,包括 DNS 解析、TCP 连接建立、请求发送和响应接收等,有助于我们排查请求转发过程中的问题。

在排查反向代理问题时,我们可以使用 Wireshark 抓取反向代理服务器与后端服务器之间的网络数据包,分析 HTTP 请求和响应的内容,查看 TCP 连接的状态,以及排查协议层面的问题。通过 Wireshark,我们可以查看请求头和响应头的详细信息,判断是否存在头部信息丢失、错误设置等问题;还可以查看 TCP 连接的建立和断开过程,判断是否存在连接异常、超时等问题,从而深入了解反向代理的工作情况,快速定位问题所在。