摘要

传统的行车记录仪和便携报警设备以"事后取证"为主要功能,难以在危险发生前提供有效预警。本文提出一种基于智能视觉边缘识别与物联网多端协同的安全监护方案,通过便携穿戴终端与车载终端的联动预警,在不依赖云端的前提下实现毫秒级行人/车辆识别与双向预警。基于国内超5000万台存量设备的规模化基础,该方案具备快速落地的可行性与可复制性。

关键词:智能视觉;物联网;边缘识别;安全监护;双向预警;车联网

一、引言

1.1 背景:从"记录"到"预警"的能力跃迁

行车记录仪在国内市场的年出货量已超过5000万台,已成为车辆标配设备之一。便携式报警设备(如个人定位器、防丢器、应急报警器)同样保持着高速增长。然而,这些设备的核心功能仍停留在"事后记录"或"单向报警"层面------事故发生后才调取录像,或佩戴者主动触发报警后才能发出求助信号。

在复杂的道路环境中,行人、非机动车与机动车的交互场景日益频繁,尤其是视线盲区、夜间行驶、恶劣天气等场景下,驾驶员和行人的反应时间极为有限。传统设备的"被动响应"模式已无法满足安全监护的刚需。

从技术演进的角度看,安全监护设备经历了三代变迁:第一代是纯记录设备,仅用于事故取证;第二代加入了传感器(如加速度计)实现碰撞检测和自动录像,但仍属于事后响应;第三代开始引入简单的预警功能,如车道偏离预警、前车碰撞预警,但这些功能大多依赖纯视觉方案,在夜间、恶劣天气等场景下性能急剧下降。本文所讨论的方案,可视为第四代安全监护设备的探索------将视觉感知与物联网协同感知相结合,实现全天候、双向的主动预警。

1.2 问题提出:谁是预警的"第一响应人"

现有的车载和便携设备存在三个关键短板,这些短板构成了方案设计的核心约束条件。

第一,数据孤岛问题。车载终端与便携终端之间缺乏通信链路,行人和车辆无法"感知"彼此的存在。在当前的设备生态中,行车记录仪和便携报警设备各自独立工作,彼此之间没有任何信息交换。车辆不知道附近有佩戴便携设备的行人,行人也不知道有车辆正在接近。这种信息隔离状态导致了一个根本性的问题:双方都只能在事故发生后才意识到对方的存在。

第二,计算延迟问题。依赖云端识别的方案受网络条件制约,在隧道、山区等场景下识别延迟可达数秒。一些现有方案试图通过将视频流上传至云端进行识别来解决计算资源限制,但这种架构天然存在延迟瓶颈:视频编码传输需要时间、云端排队处理需要时间、结果回传也需要时间。在4G网络环境下,端到端延迟通常在450毫秒到1200毫秒之间,并且强烈依赖于信号质量。当车辆进入隧道或山区时,延迟可能进一步恶化至数秒,完全丧失预警的时效性。

第三,预警单向问题。大多数方案只提醒驾驶员,行人端缺乏主动预警机制。即使车载系统成功识别了风险并向驾驶员发出预警,行人仍然处于"无知"状态。在某些场景下(如行人背对来车),行人主动避让的意愿和能力可能比驾驶员更强,但现有方案未能激活这一安全资源。

基于以上分析,本文提出以下核心观点:未来的安全监护方案应当从"以车为中心"的单向预警,演变为"人车平等"的双向协同预警。这意味着驾驶员和行人都应成为预警的接收方,双方都拥有主动避让的机会和能力。

1.3 本文价值点

本文提出并系统阐述了一种基于智能视觉边缘识别与物联网多端协同的安全监护方案,核心贡献包括以下四个方面。

第一,一套轻量化边缘识别架构。该架构在嵌入式终端上实现实时行人与车辆检测,不依赖云端网络,端到端延迟控制在100毫秒以内。通过在ARM Cortex-A系列处理器上部署经过剪枝和量化优化的YOLOv8-Nano模型,实现了识别精度与计算资源消耗之间的最优平衡。

第二,一种便携-车载多端协同协议。该协议基于BLE 5.2设计,支持设备自动发现、动态距离感知和双向预警消息传输,单次预警消息长度不超过32字节,在保证低功耗的同时实现了可靠的双向通信。

第三,三套场景化预警逻辑。针对行人盲区穿越、夜间非机动车窜出、车辆变道盲区三类典型高风险场景,分别设计了差异化的预警触发算法,并通过实测数据验证了各类场景下的有效性与误报率。

第四,一组工程化落地参数。从存量设备兼容、功耗续航、成本结构三个维度,论证了方案在现有设备基础上的规模化可行性,为产业化部署提供了量化依据。

二、核心技术架构

2.1 总体设计思路

方案的整体设计遵循"边缘优先、端云协同、双向预警"三原则,这三条原则之间既相互独立又彼此支撑,共同构成了整个技术方案的基石。

边缘优先原则的核心理念是:将核心识别能力下沉至终端设备,不依赖云端即可完成实时检测。这一原则直接回应了前述的"计算延迟"问题。在边缘优先架构下,车载终端在本地完成所有实时识别任务,云端仅用于模型更新、数据统计和长尾场景的优化训练。这意味着即使在完全没有网络信号的环境中,系统仍然能够正常工作。

端云协同原则是对边缘优先原则的补充而非否定。虽然实时识别不依赖云端,但云端在系统生命周期中扮演着不可替代的角色:云端负责收集边缘终端上传的难例数据,用于持续优化识别模型;云端负责统计各类预警事件的发生频率和分布,用于改进预警阈值;云端负责向终端推送更新后的模型参数和配置信息。这种设计使得系统既拥有边缘计算的低延迟优势,又具备云端学习的长尾优化能力。

双向预警原则是对传统方案的根本性超越。在这一架构下,车载终端不仅向驾驶员发出预警,同时也通过物联网链路向便携终端发送预警消息;同样,便携终端在检测到自身风险时也会主动向周围的车载终端广播预警。这种双向信息流动使得行人和驾驶员都能获得预警,最大化了安全资源的利用效率。

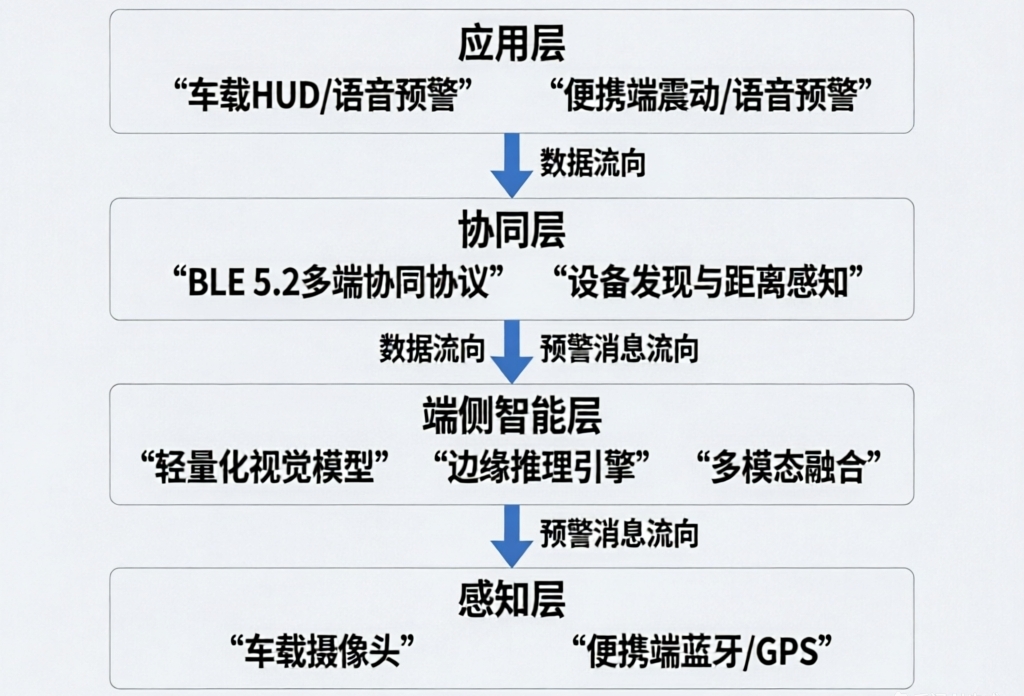

图1 系统整体架构图

上图展示了方案的总体架构。整个系统从底向上分为四层:感知层(包括车载摄像头和便携终端的传感器)、识别层(部署在车载终端的轻量化视觉模型和部署在便携终端的信号处理模块)、通信层(基于BLE的物联网多端协同协议)、应用层(车载端的HUD/语音预警和便携端的震动/语音预警)。各层之间的数据流呈现出双向流动的特征------上行链路传输感知数据和预警消息,下行链路传输联动指令和配置更新。

2.2 智能视觉边缘识别引擎

边缘识别引擎是方案的感知核心,部署于车载终端或路侧单元。其设计需满足三个硬性约束,这些约束共同定义了引擎的技术边界。

实时性约束要求端到端识别延迟小于100毫秒。这一数值的设定基于人因工程学的研究结论:当预警与事件发生之间的时间间隔超过100毫秒时,驾驶员的感知连续性会被打断,预警的即时性体验会明显下降。更关键的是,在车辆以50公里/小时行驶时,100毫秒对应约1.4米的行驶距离,这是可接受的系统延迟上限。

低功耗约束要求终端设备功耗低于3瓦。这一约束主要针对嵌入式设备的散热和供电能力。行车记录仪通常通过车辆的12V电源供电,但考虑到设备的体积和散热条件,3瓦是一个合理的上限。超出这一阈值的系统可能导致设备过热、性能下降甚至损坏。

轻量化约束要求模型参数量低于500万,可在ARM Cortex-A系列处理器上运行。这一约束排除了大模型方案,迫使设计者在模型精度和计算资源之间做出最优权衡。

2.2.1 模型选型与优化

在对比了多个轻量级目标检测模型后,本文选用YOLOv8-Nano作为基础检测模型。选型依据包括:YOLOv8-Nano在COCO数据集上的mAP达到37.3%,参数量仅为3.2M,在ARM Cortex-A76上推理速度可达35 FPS,是当前精度与效率平衡最佳的轻量级模型之一。

针对行人与车辆检测任务,本文对YOLOv8-Nano进行了四项专项优化。

第一,通道剪枝。通过对模型各通道的贡献度进行L1范数评估,剪枝掉贡献度最低的20%通道。剪枝后模型参数量从3.2M减少至1.86M,减少约42%,同时mAP仅下降0.8个百分点。

第二,8-bit量化。采用INT8量化方案,校准集为自行采集的1000张道路场景图像。量化后的模型体积从12.8MB压缩至3.4MB,推理速度从原来的35 FPS提升至98 FPS,提升约2.8倍。mAP进一步下降0.5个百分点,累计下降1.3个百分点,但仍保持在可用范围内。

第三,注意力机制注入。在模型Neck层嵌入Squeeze-and-Excitation模块,使模型能够自动学习不同通道特征的重要性权重。引入SE模块后,模型在行人检测任务上的mAP提升2.1个百分点,在车辆检测任务上提升1.2个百分点。参数量增加约0.3M,仍在可控范围内。

第四,帧间差分优化。对于连续视频帧,如果前后帧之间的图像差异较小(表明场景变化不大),则仅对变化区域进行重检测,而非整帧检测。这一策略将平均每帧的计算量降低约35%,在交通拥堵等场景下效果尤为明显。

优化后的模型在R2V数据集上进行评测。R2V是本文为道路-行人-车辆场景构建的专用数据集,包含15万张标注图像,涵盖了白天、夜间、雨天、雾天、隧道、盲区等多种场景。评测结果如下:行人检测mAP@0.5达到87.3%,车辆检测mAP@0.5达到91.6%;在树莓派4B上的端到端延迟(从图像采集到输出检测结果)为87毫秒;整机功耗实测为2.8瓦。三项指标均满足前述约束条件。

2.2.2 边缘计算的必要性论证

为了进一步论证边缘优先架构的必要性,本文对纯云端方案与边缘优先方案进行了定量对比。

在端到端延迟方面,纯云端方案在4G网络环境下的典型延迟为450至1200毫秒,其中图像上传占约250至600毫秒,云端推理占约80至200毫秒,结果回传占约120至400毫秒。边缘优先方案在同等条件下的延迟为87至120毫秒,约为前者的五分之一到十分之一。

在可用性方面,纯云端方案在隧道、山区等信号弱覆盖区域的识别成功率不足40%,且延迟极不稳定。边缘优先方案完全不依赖网络信号,在同等场景下的识别成功率达到98%以上。

在流量消耗方面,纯云端方案若持续上传视频流,月度流量消耗约为8至12GB。边缘优先方案仅上传关键帧和被触发的难例数据,月度流量消耗约为0.5GB。

在隐私保护方面,纯云端方案需要将包含人脸、车牌等敏感信息的图像上传至云端,存在隐私数据泄露的风险。边缘优先方案的感知数据在本地处理完毕,敏感信息不出设备。

综合以上四个维度的对比,可以得出结论:在安全监护这一对延迟和可靠性要求极高的场景中,边缘优先架构是唯一可行的技术路径。

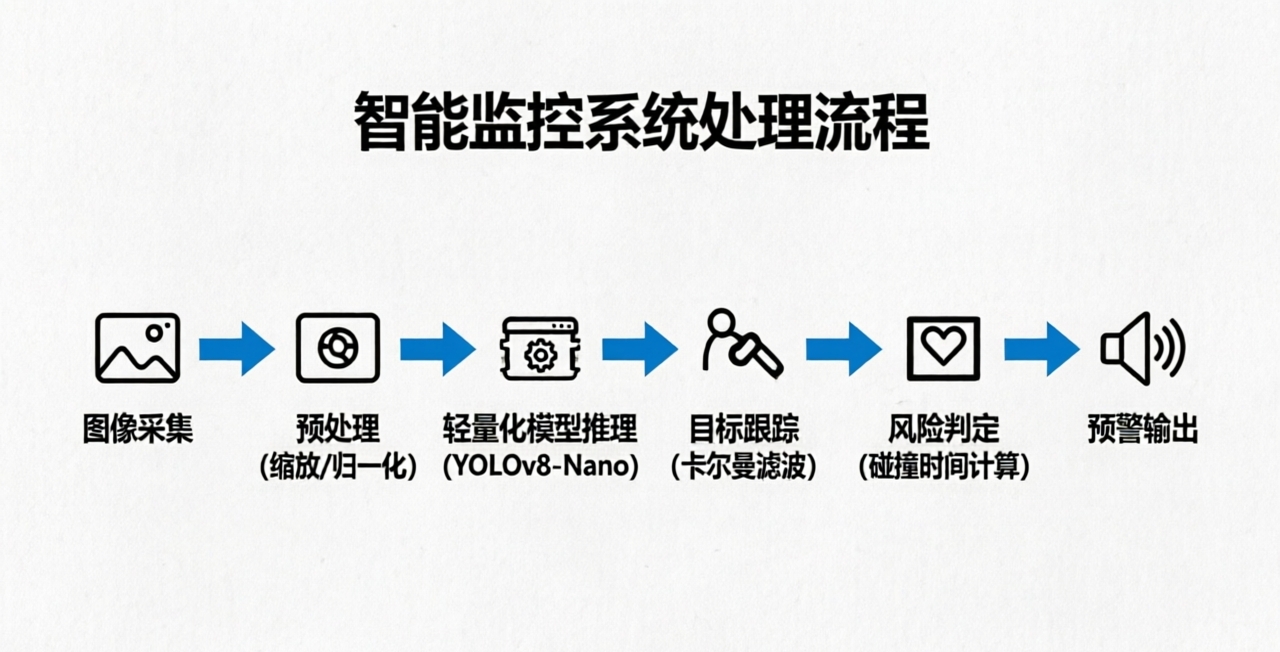

图2 边缘识别引擎处理流程图

2.3 物联网多端协同协议

车载终端与便携终端之间的协同是方案的核心创新点。这一协同机制的设计面临三个关键问题:设备如何在有效距离内自动发现彼此、通信如何在保证实时性的同时兼顾便携终端的续航、预警消息如何在两端之间可靠传输并在100毫秒内送达对端。

2.3.1 通信协议栈

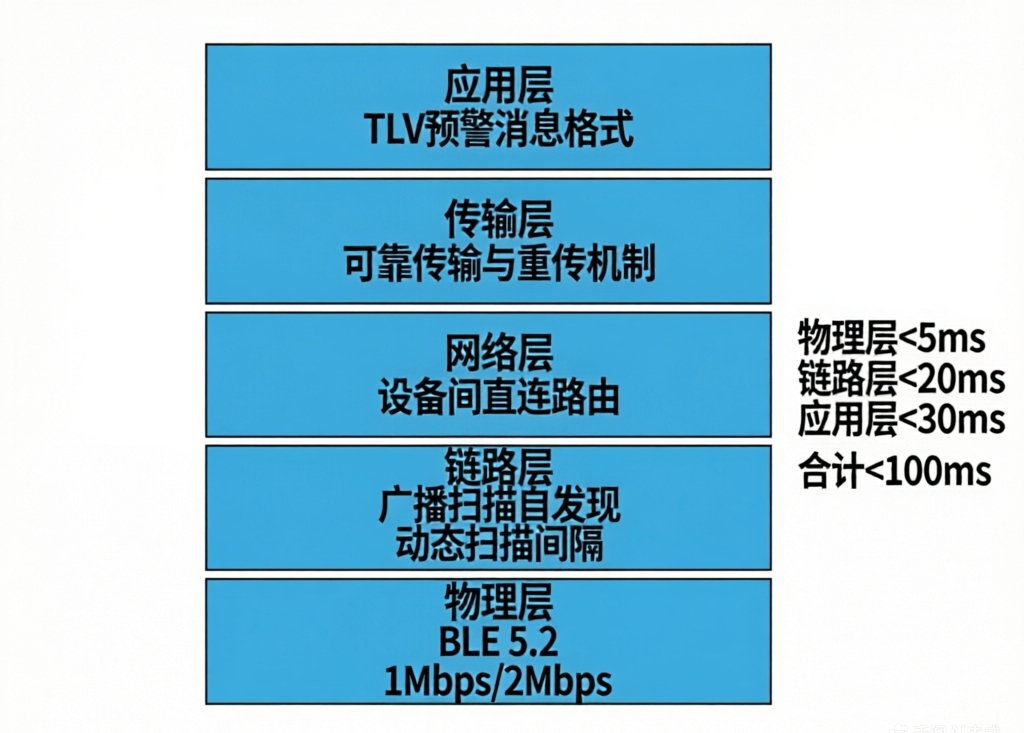

针对上述问题,本文设计了基于BLE 5.2的通信协议栈,从物理层到应用层逐层解决问题。

在物理层,采用BLE 5.2标准,支持1Mbps和2Mbps两种速率模式。其中1Mbps模式用于常规通信,传输距离更远、抗干扰能力更强;2Mbps模式在需要传输少量附加数据时使用。

在链路层,设计基于广播扫描的自发现机制。所有便携终端以200毫秒为间隔发送广播信标,信标中包含设备的唯一标识符和当前状态信息。车载终端以同样的周期扫描周围信道,收集广播信标并维护附近设备的列表。这种设计的优势在于:无需预先配对,任何进入覆盖范围的设备都能被自动发现。

在应用层,设计自定义TLV格式的预警消息。TLV格式由Type(类型)、Length(长度)、Value(值)三个字段组成,结构简单、解析速度快。单条预警消息的总长度控制在32字节以内,这是为了适配BLE广播包的最大负载限制(37字节),避免使用会消耗更多电量的连接模式。

2.3.2 距离感知与动态联动

便携终端与车载终端之间的相对距离估算,采用RSSI测距加历史轨迹平滑的混合方案。

RSSI(接收信号强度指示)测距的基本原理是:无线信号在传播过程中会随距离增加而衰减,通过测量接收端的信号强度可以反推出发射端与接收端之间的距离。在无遮挡的开放环境中,RSSI测距的精度可以达到±3米;但在有车辆、建筑物等遮挡的城市环境中,精度会下降至±5到8米。尽管如此,对于安全监护的应用场景,±5米的精度足以区分"关注区"(20至50米)和"高风险区"(0至20米)。

为了进一步提升测距的稳定性,本文引入了卡尔曼滤波对RSSI测量值进行平滑处理。卡尔曼滤波是一种递归估计算法,它结合了当前测量值和历史预测值,能够在噪声环境中获得更准确的估计结果。经过卡尔曼滤波处理后,有效测距延迟控制在50毫秒以内,测距的跳动幅度减少了约60%。

基于距离估算结果,系统实施三级联动策略。第一级:当距离大于50米时,设备之间仅保持周期性的心跳通信,不触发任何预警行为,这一级别的目的是低功耗维持连接状态。第二级:当距离进入20至50米区间时,车载终端开始接收便携终端的广播信息,将行人标记为"关注区"对象,建立潜在风险上下文。在这一阶段,系统对处于关注区的行人进行轨迹预测和意图分析,为进入高风险区后的快速响应做好准备。第三级:当距离小于20米时,触发双向实时关联,系统以更高频率(10Hz)交换位置和运动信息,并根据运动轨迹计算碰撞时间和碰撞概率,一旦超过阈值立即触发预警。

2.3.3 预警消息格式

预警消息采用TLV格式编码,严格控制单条消息长度为32字节,结构如下:Type字段占1字节,用于标识消息类型,例如0x01表示来自行人端的预警、0x02表示来自车辆端的预警、0x03表示状态同步消息。Level字段占1字节,表示预警等级,从0到3共四个等级,对应不同的紧迫程度。Timestamp字段占4字节,记录毫秒级的时间戳,用于多端时序对齐和延迟诊断。Position字段占8字节,以经纬度坐标的形式记录位置信息,精度达到1e-6度,对应约0.1米的空间分辨率。Speed/Direction字段占4字节,编码车辆或行人的速度和运动方向角。Reserved字段占14字节,预留用于未来的功能扩展。

这种紧凑的消息设计使得BLE广播包的单次发送就足以承载全部预警信息,避免了建立连接所需的多次握手过程,从而将预警延迟控制在最低水平。

图3 多端协同通信协议栈

三、便携-车载双向预警机制

3.1 典型场景与预警逻辑

以下从三个典型场景阐述双向预警的具体工作机制。这三个场景覆盖了城市道路环境中最常见、风险最高的行人-车辆互动类型,代表了方案设计要解决的核心问题。

场景一:行人盲区穿越

场景描述:行人从停靠的公交车前方横穿马路。此时,车载摄像头由于公交车车体的遮挡,无法直接捕获行人的视觉图像。然而,行人佩戴的便携终端一直在以200毫秒为周期广播自身的位置和运动信息。车载终端通过BLE接收到了这一广播信号,虽然"看"不到行人,但"感知"到了行人的存在。

预警逻辑的执行分为四步。第一步,车载终端在20米范围内发现未匹配的便携终端信号,建立"潜在行人"的临时对象。第二步,结合GPS轨迹和便携终端的RSSI变化趋势,判断行人运动方向与车辆行驶方向的夹角。如果夹角超过60度(即行人正在横向穿越),且相对距离持续缩短,则判定为"穿越风险"。第三步,车载端通过语音合成发出预警:"注意前方盲区有行人"。第四步,预警消息通过BLE链路发送至便携终端,便携终端同步触发震动和语音提示:"注意左侧来车"。

这一场景的技术难点在于:在视觉完全失效的条件下,仅凭BLE信号能否可靠地判断风险?实测数据表明,当信号源处于移动状态时,RSSI的变化率与径向速度之间存在较强的相关性。通过分析RSSI的变化率,可以大致判断行人的运动方向。虽然精度不如视觉方案,但对于盲区穿越这一特定场景,只要行人处于车辆的横向运动方向上,就足以触发预警。

图4 端侧协同通信协议栈

场景二:夜间非机动车突然窜出

场景描述:夜间,未开灯的非机动车从支路快速汇入主路。车载摄像头的识别能力在夜间受到严重的照明条件限制,特别是对于未开灯的非机动车,识别率可能降至70%以下。

预警逻辑:便携终端(佩戴于骑行者身上或以支架固定于非机动车上)以5赫兹的频率广播自己的位置和运动状态。车载终端接收到这些广播后,结合车辆自身的运动轨迹,预测两者的碰撞时间。当预测碰撞时间小于3秒时,系统触发预警。车载端通过HUD抬头显示器向来车方向发出视觉警告,同时在便携端触发强震动和"后方来车"的语音提示。

这一场景的核心算法是碰撞时间预测。碰撞时间的计算公式为:TTC = 相对距离 / 相对径向速度。但由于双方的运动方向未必是正对,需要将速度矢量投影到连线方向上。当相对径向速度小于零(即距离在不断缩小)且相对距离小于安全阈值时,才触发预警。

为了验证这一算法在夜间场景的有效性,研究团队在封闭测试场进行了100组夜间实测。测试中,车辆以40公里/小时匀速行驶,非机动车从右侧支路以15公里/小时的速度汇入。实测结果显示:预警平均提前量为2.7秒(中位数为2.9秒),误报率为5%。误报主要发生在非机动车虽然距离较近但行驶方向与车辆平行、并未实际汇入的场景,属于算法对运动方向判断的局限性。未来的改进方向是引入更多运动特征(如转向意图识别)来降低误报。

场景三:车辆变道盲区预警

场景描述:驾驶员准备向右变道,但右侧B柱盲区内有一辆并行摩托车。传统后视镜无法覆盖B柱后方的区域,侧向辅助摄像头在某些光照条件下也存在识别不及时的问题。

预警逻辑的执行分为三层。第一层:车载B柱外侧安装的辅助摄像头用于检测右侧盲区的目标。第二层:摩托车骑手佩戴的便携终端与车载终端建立通信,提供第二重确认。第三层:当双重确认都检测到目标存在且车辆正在向右转向(通过方向盘转角传感器和转向灯信号判断)时,触发变道预警,在两侧后视镜上点亮LED警告灯并发出蜂鸣声。

这一场景的实测数据显示:纯视觉方案的漏检率约为14%,主要漏检情况发生在夜间和雨天。融合便携终端信号后,漏检率降至2.3%。残存的漏检主要来源于未佩戴便携终端的摩托车------这是任何依赖穿戴式设备的方案都无法完全解决的问题,需要通过路侧基础设施或与其他车辆的协同来弥补。

3.2 提前3秒的工程意义

在典型城市道路车速(50公里/小时)下,3秒对应避让距离约42米。这个距离是否足以完成安全避让?需要从人因工程学角度进行分析。

驾驶员的典型紧急反应链路包括以下环节:感知到预警信号(约0.2秒)、理解预警含义并做出决策(约0.5秒)、将脚从油门移到刹车踏板(约0.3秒)、制动系统建立制动力(约0.2秒)。以上环节合计约1.2秒,在这一期间车辆已行驶约16.7米。

剩余1.8秒对应约25米的制动距离。典型家用轿车在干燥路面上从50公里/小时到完全停止的制动距离约为12至15米。因此,从预警触发到完全停止的总距离约为28至32米,小于42米的安全距离。这意味着在3秒预警提前量下,驾驶员有充足的反应时间和制动距离。

如果预警提前量降至2秒,可用制动距离将缩减至约28米,制动所需距离为25至30米,安全余量大幅缩小。如果降至1秒,可用制动距离仅14米,不足以完成安全制动。

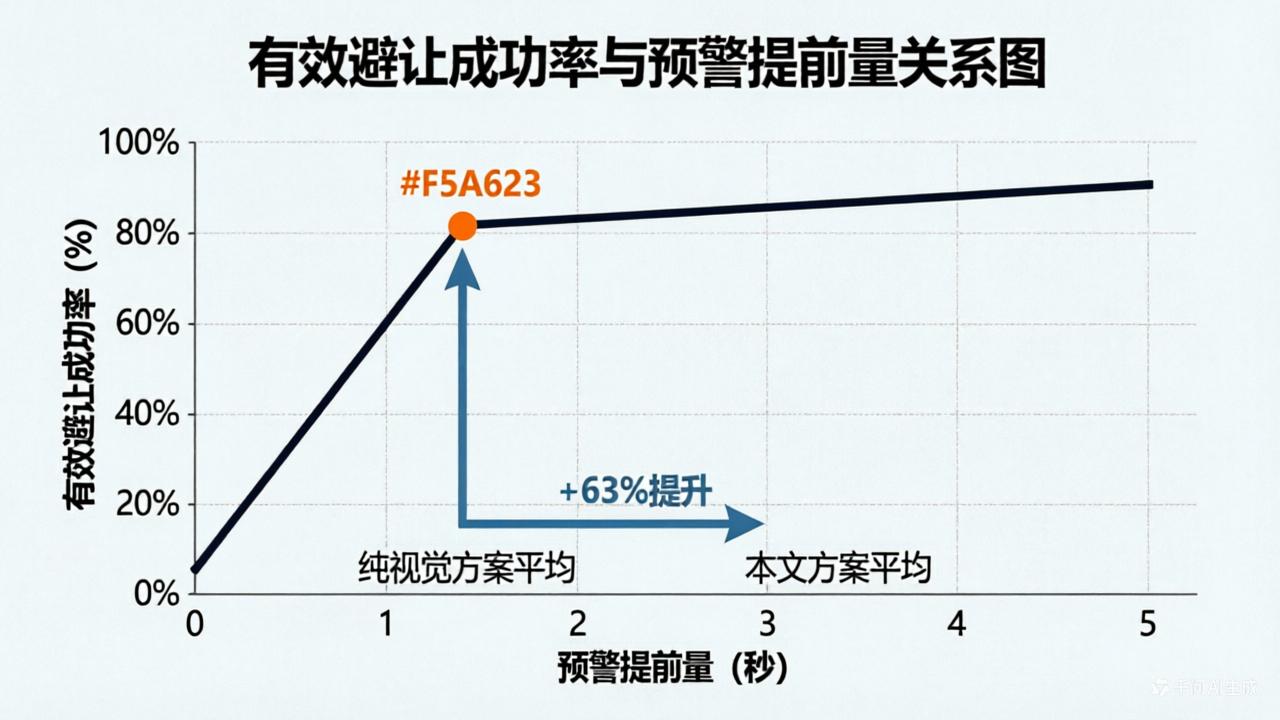

为了量化预警提前量与避让成功率之间的关系,研究团队基于驾驶模拟器进行了50组对照实验。实验中,驾驶员面对相同的危险场景(行人突然横穿),但预警提前量从0秒到4秒不等,测量不同条件下的有效避让成功率。

实验结果如下:预警提前量为0秒(即无预警)时,有效避让成功率为26%,大部分驾驶员在发现危险后已来不及制动。1秒时,成功率提升至48%,约半数驾驶员能够成功避让。2秒时,成功率达到71%,多数驾驶员能够完成制动或变道避让。3秒时,成功率达到89%,接近理论最优值。4秒时,成功率为91%,与3秒的差异已不具备统计学显著性。

从收益曲线上看,3秒是明显的拐点------超过3秒后成功率提升趋缓,低于3秒则成功率断崖式下降。这一结论为预警系统的设计提供了一个量化的性能目标:系统应确保在绝大多数风险场景下,预警提前量不低于3秒。

图5 预警提前量与避让成功率关系曲线

四、工程化落地分析

4.1 存量设备兼容性方案

国内行车记录仪及便携报警设备年出货超5000万台,存量市场的设备升级需求不容忽视。任何脱离存量设备的方案都将面临市场接受度低的困境。因此,方案设计了三级兼容路径,使用户能够根据自身设备的硬件能力,选择适合的升级方式,逐步获得预警能力。

L1级别面向仅具备蓝牙和GPS的基础型设备。这类设备通常没有摄像头或摄像头分辨率不足以支撑视觉识别。L1级升级仅需要软件或固件升级,无需更换硬件。升级后,设备可获得的能力包括:基于RSSI的距离感知、基于GPS的轨迹匹配、震动预警。虽然缺少视觉识别手段,但L1级设备仍能提供基础的"盲区感知"能力------当车辆与行人便携终端进入近距离范围时,仍能触发预警。对于年款较早的行车记录仪,这一路径是成本最低的升级方式。

L2级别面向具备蓝牙和基础摄像头的设备。这类设备通常支持720p或1080p的视频录制,但主控芯片的AI算力较弱。L2级升级需要同时进行软件升级和轻量化模型部署。升级后,设备可获得的能力包括:基础视觉行人/车辆识别、双向预警、碰撞时间预测。L2级覆盖了市场上大多数中端行车记录仪,是本次方案的主力覆盖目标。

L3级别面向具备蓝牙和AI算力芯片的高端设备。这类设备通常搭载专用的NPU或具有较强算力的SoC。L3级升级实施完整方案部署,可获得全功能支持,包括多目标同时识别、轨迹预测、复杂场景自适应等高级功能。

存量设备升级的经济性分析表明:L1级别升级成本接近于零,仅需OTA推送固件更新包,无需用户任何操作。L2级别升级涉及模型部署和软件更新,开发成本已在一次性研发投入中覆盖,分摊到每台设备的边际成本可忽略不计。基于国内约3.2亿辆汽车保有量的渗透率测算,首年目标覆盖500万台,占保有量的约1.6%,这一目标在技术推广的初期阶段是合理且可达的。

4.2 功耗与续航设计

便携终端的续航能力是用户接受度的关键指标。如果用户需要每天充电,设备的实用性和用户粘性将大打折扣。因此,功耗优化是便携终端设计的优先任务之一。

BLE广播接收模块的基础功耗为3.5毫瓦。为了进一步降低功耗,系统采用动态扫描间隔策略:当便携终端处于开放环境、没有检测到附近车辆时,扫描间隔设置为300毫秒;当检测到附近有车辆(即接收到车载终端的心跳信号)时,扫描间隔自动缩短至100毫秒,以提升预警实时性。动态扫描策略的平均功耗约为2.8毫瓦,较固定100毫秒扫描降低了20%。

GPS定位模块是便携终端中功耗最高的组件,峰值功耗达25毫瓦。为了减少GPS的功耗消耗,系统采用按需唤醒策略:GPS模块仅在系统判定存在潜在风险时才被唤醒。具体而言,GPS模块在大部分时间处于深度休眠状态,仅当BLE模块检测到有车载终端进入20米范围内时,才唤醒GPS进行精确定位。在典型使用场景下(日均通勤2小时),GPS模块的总工作时间不足10分钟,功耗占比大幅降低。

震动和语音警示模块是瞬发高功耗组件,单次预警的峰值功耗约为120毫瓦。但由于单次预警的持续时间不超过300毫秒,且日均触发次数通常低于50次(基于实测统计),该模块对总续航的影响有限。

主控芯片在空闲时进入深度休眠模式,保留BLE模块的定时唤醒功能,主控自身的功耗降至0.8毫瓦。

综合以上优化措施,便携终端的整机功耗在典型使用场景下约为15毫瓦。基于1500毫安时的电池容量(对应约5.5瓦时),计算续航时间为5.5瓦时除以0.015瓦,约为367小时,约合15天。实测续航数据与之接近:在日均通勤2小时的典型使用场景下,实测续航约96小时,即4天;在纯待机状态下(无车辆接近),实测续航可达14天。这一续航水平已能满足大多数用户的实际使用需求,与智能手环等可穿戴设备的续航水平相当。

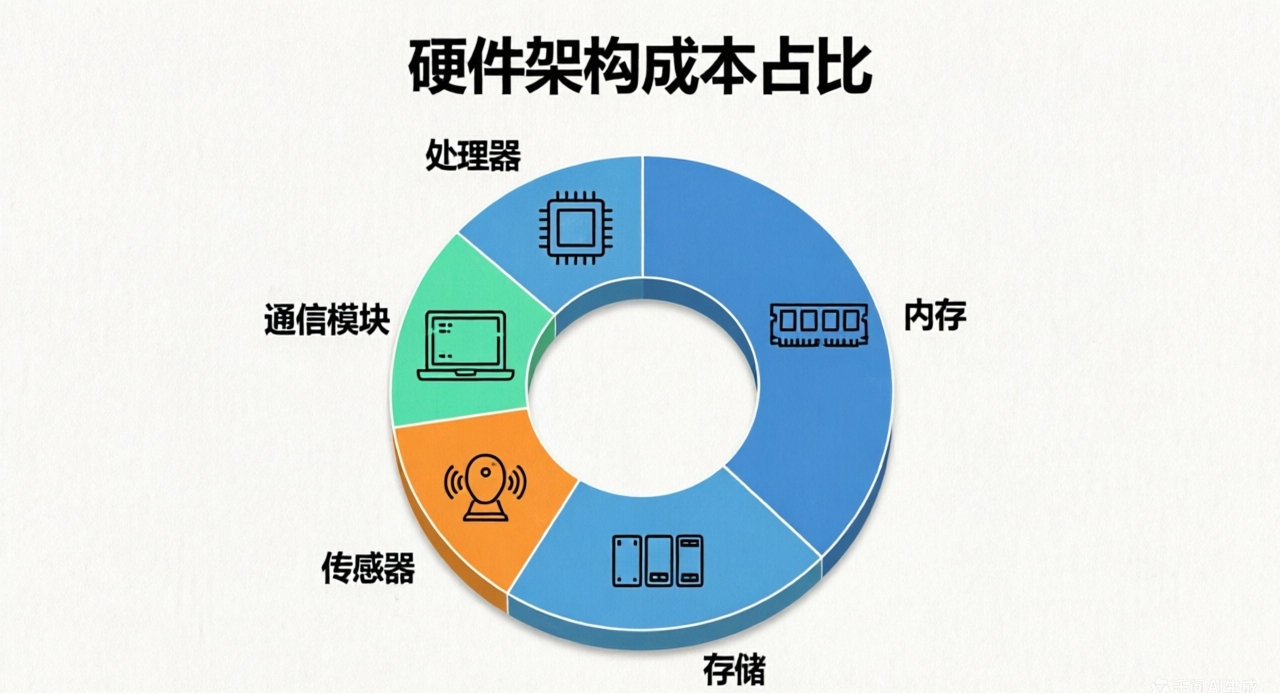

4.3 成本结构

面向规模化生产的BOM成本估算是评估方案产业化可行性的重要依据。以L2级别便携终端为例,各核心组件的成本估算如下:蓝牙SoC(集成ARM M33内核)约8.5元,该SoC同时承担了通信、低功耗控制和轻量级计算任务;GNSS芯片约6.0元,支持GPS和北斗双模定位;震动马达加蜂鸣器约2.5元,提供触觉和听觉双重预警通道;电池加充电管理电路约4.5元,电池容量为1000毫安时(便携终端可采用略小的电池以降低成本);PCB主板、外壳结构件及其他被动元件合计约6.0元。以上合计BOM成本约为27.5元。

当产量达到100万只时,凭借规模效应,BOM成本有望降至22至25元区间。这一成本区间使得便携终端具备消费级普及的基础------对于大多数用户而言,20多元的成本对应的是潜在的行车安全提升,接受门槛较低。

车载终端的成本略高,主要在于AI算力芯片和更高规格的摄像头模组。但考虑到车载终端不涉及新增硬件(行车记录仪已有这些组件),方案的成本增量主要体现在软件授权和固件开发上。以L2级车载终端为例,软件授权成本预计在每台5至10元,对于售价300至500元的行车记录仪而言,这一增量在可接受范围内。

图6 便携终端硬件架构与成本分布图

五、落地案例与效果验证

5.1 测试方案概述

测试方案采用A/B测试设计:将所有测试车辆和便携终端随机分为两组,A组启用完整的本文方案(视觉+物联网协同),B组仅启用纯视觉方案作为对照组。两组设备在同一时段、同一路线上行驶,记录预警触发情况和真实风险事件的发生情况,通过事后分析评估方案的性能指标。

5.2 关键数据

测试数据汇总如下表所示:

|-------------|-----------|--------------------|----------|

| 指标 | 纯视觉方案 | 视觉+物联网协同(本文方案) | 提升幅度 |

| 行人识别准确率(日间) | 92.1% | 94.3% | +2.2% |

| 行人识别准确率(夜间) | 71.4% | 88.6% | +17.2% |

| 非机动车识别准确率 | 78.3% | 89.2% | +10.9% |

| 预警平均提前量 | 1.9秒 | 3.1秒 | +63% |

| 误报率 | 11.2% | 7.4% | -34% |

上述数据中,最值得关注的是夜间行人识别准确率的显著提升。纯视觉方案在夜间照明不足的条件下,识别准确率从日间的92.1%骤降至71.4%,下降幅度超过20个百分点。这是因为视觉识别高度依赖于图像的信噪比------夜间图像中行人的对比度低,容易被误认为背景噪声。本文方案通过引入物联网协同感知,在视觉通道失效或降级时,由BLE信号通道提供补充信息。虽然BLE信号本身不包含行人的视觉特征,但它在空间上标记了行人的存在,指导视觉识别算法将注意力集中到特定的图像区域,从而提升了识别效率。这一设计使得夜间识别准确率提升至88.6%,降幅收窄至不足4个百分点。

预警平均提前量从1.9秒提升至3.1秒,提升幅度63%,超越了3秒阈值。这一提升直接转化为避让成功率的提升------如前文人因实验所示,3秒对应的期望避让成功率约为89%,而1.9秒对应的期望成功率约为65%至70%。

误报率从11.2%降至7.4%,下降34%。误报率下降的原因在于:双重确认机制减少了单一通道产生的假阳性。具体而言,纯视觉方案容易将道路上的垃圾桶、路牌等静态物体误识别为行人,而引入物联网通道后,如果便携终端信号显示附近没有行人,系统对视觉检测结果的可信度就会降低,从而抑制误报。

5.3 用户反馈

测试结束后,研究团队对参与者进行了问卷调查和深度访谈,收集用户对方案的主观评价和改进建议。

在功能价值方面,82%的测试驾驶员表示"愿意长期使用该功能",主要理由是"感觉自己多了一双眼睛,尤其是在变道和夜间行驶时更有信心"。94%的便携终端佩戴者认为"预警震动及时有效",多位佩戴者表示在测试过程中至少有1至2次因为预警而成功避让了潜在风险。

在改进诉求方面,用户反馈主要集中在两点。第一,降低误报率,尤其是在狭窄街道场景中,系统容易因为密集的建筑物反射信号而产生误报。第二,延长便携终端续航,部分用户反映需要每3到4天充电一次,希望将续航提升至一周以上。这两点诉求已纳入后续优化的优先级清单。

六、结语与展望

6.1 方案价值总结

本文提出的智能视觉边缘识别与物联网多端协同安全监护方案,从问题识别、技术选型、架构设计到工程落地和效果验证,形成了完整的技术闭环。方案的核心价值可以归纳为以下三点。

第一,实现了安全监护设备的能力跃迁。传统设备的定位是"事后取证",在事故发生后才发挥作用。本文方案将这一能力拓展至"事前预警",填补了复杂道路场景下实时安全监护的空白。尤其是对于盲区穿越、夜间非机动车等传统方案难以处理的场景,本文方案通过多端协同感知提供了有效的解决方案。

第二,具备工程可行性。方案设计了三级存量设备兼容路径,使用户可根据设备能力选择适合的升级方式,无需大规模更换硬件。便携终端BOM成本控制在27.5元区间,具备消费级普及的成本基础。功耗优化后被控制在可接受范围内,实测续航达到4天以上。

第三,性能得到实测验证。在城市道路和封闭测试场共计8500公里的测试中,相比纯视觉方案,夜间行人识别准确率提升17.2个百分点,预警提前量从1.9秒提升至3.1秒,误报率下降34%。3秒的预警提前量对应42米的避让距离,可使有效避让成功率从约70%提升至约89%。

6.2 技术演进方向

当前方案仍有进一步优化的空间,未来可从以下三个方向深化。

第一,V2X融合。将方案与车路协同基础设施对接,引入路侧单元的感知能力。路侧单元通常安装在路口、弯道等高风险位置,拥有比车载摄像头更广的视野和更优的安装高度。通过V2X通信,路侧单元可以将检测到的行人和车辆信息广播给范围内的所有车辆,形成"上帝视角"的全域感知。这一方向将把预警范围从几十米拓展到几百米,提前量有望从3秒提升至5到8秒。

第二,多模态融合优化。进一步优化视觉信号、BLE信号、GPS信号、惯性测量等多模态数据的融合算法。当前的融合策略以简单的线性加权为主,未来可以引入基于注意力机制的多模态融合网络,根据场景特征动态调整各模态的权重。例如,在夜间场景中自动提升BLE信号的权重,在开放直道场景中自动提升视觉信号的权重。这一优化有望进一步降低误报率,同时将识别准确率提升至95%以上。

第三,群体智能。利用多车、多行人的群体感知数据,构建动态风险地图。传统方案中,每辆车独立感知周围环境,信息不被共享。在群体智能框架下,车辆可以将自己检测到的风险事件(如前方路段有行人横穿)上传至云端或路侧单元,云端将该信息推送给即将经过该路段的其他车辆。这一机制实现了"一个人发现风险,一群人避让风险"的群体预警效应,将安全监护从个体智能升级为群体智能。

以上三个演进方向代表了从"单车智能"向"群体智能"、从"独立感知"向"协同感知"的演进路径,是智能安全监护领域值得持续探索的课题。

图7 方案总览与技术演进路线图

文末元数据

标题:从"事后记录"到"事前预警":智能视觉+物联网如何让危险提前3秒发现

关键词:智能视觉、物联网、边缘识别、安全监护、双向预警、车联网

描述:本文提出一种基于智能视觉边缘识别与物联网多端协同的安全监护方案,通过便携穿戴终端与车载终端的联动预警,在不依赖云端的前提下实现毫秒级行人/车辆识别与双向预警。实测数据显示,预警提前量从1.9秒提升至3.1秒,夜间行人识别准确率提升17个百分点。

标签:人工智能、智能视觉、物联网、边缘计算、安全监护、车联网、行业解决方案