文章目录

- [LocalAI 开源AI引擎,本地运行多模态模型无需GPU](#LocalAI 开源AI引擎,本地运行多模态模型无需GPU)

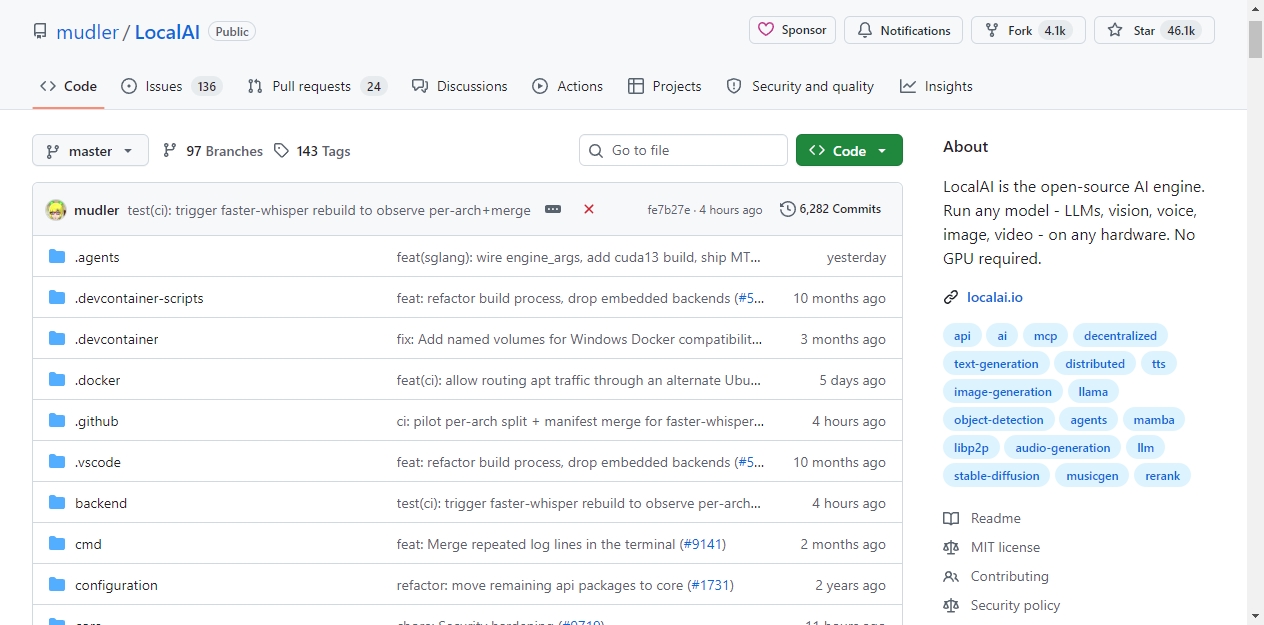

LocalAI 开源AI引擎,本地运行多模态模型无需GPU

mudler 开源的 LocalAI 项目,目前获得 46,139 个 Star:

LocalAI 是开源AI引擎,支持运行多种AI模型,包括大语言模型、视觉模型、语音模型、图像生成模型、视频生成模型,可在任意硬件上运行,无需GPU。

LocalAI 兼容 OpenAI、Anthropic、ElevenLabs 等主流API接口,现有36+后端支持,包括 llama.cpp、vLLM、transformers、whisper、diffusers、MLX 等。

LocalAI 适配多种硬件平台,包括 NVIDIA、AMD、Intel、Apple Silicon、Vulkan,也支持仅使用CPU运行。

LocalAI 支持多用户使用,提供API密钥认证、用户配额、角色权限控制等功能。

LocalAI 内置AI代理,支持自主代理工具调用、RAG、MCP、技能扩展等能力。

LocalAI 采用隐私优先设计,所有数据处理均在用户本地基础设施完成,不会向外传输。

项目由 Ettore Di Giacinto 创建,目前由 LocalAI 团队维护。

快速安装

macOS 安装

用户可直接下载DMG安装包,安装后需执行命令清除隔离属性:

bash

sudo xattr -d com.apple.quarantine /Applications/LocalAI.app容器安装

LocalAI 提供 Docker、podman 等容器镜像,用户可根据硬件选择对应版本:

仅使用CPU运行:

bash

docker run -ti --name local-ai -p 8080:8080 localai/localai:latest使用NVIDIA GPU运行:

bash

# CUDA 13

docker run -ti --name local-ai -p 8080:8080 --gpus all localai/localai:latest-gpu-nvidia-cuda-13

# CUDA 12

docker run -ti --name local-ai -p 8080:8080 --gpus all localai/localai:latest-gpu-nvidia-cuda-12使用AMD GPU运行:

bash

docker run -ti --name local-ai -p 8080:8080 --device=/dev/kfd --device=/dev/dri --group-add=video localai/localai:latest-gpu-hipblas使用Intel GPU运行:

bash

docker run -ti --name local-ai -p 8080:8080 --device=/dev/dri/card1 --device=/dev/dri/renderD128 localai/localai:latest-gpu-intel使用Vulkan GPU运行:

bash

docker run -ti --name local-ai -p 8080:8080 localai/localai:latest-gpu-vulkan模型加载

LocalAI 支持多种来源的模型加载:

bash

# 从模型库加载

local-ai run llama-3.2-1b-instruct:q4_k_m

# 从Huggingface加载

local-ai run huggingface://TheBloke/phi-2-GGUF/phi-2.Q8_0.gguf

# 从Ollama OCI registry加载

local-ai run ollama://gemma:2b

# 从YAML配置加载

local-ai run https://gist.githubusercontent.com/.../phi-2.yaml

# 从标准OCI registry加载

local-ai run oci://localai/phi-2:latestLocalAI 可自动检测GPU能力,下载对应后端,无需用户手动配置。

2026年4月更新内容包括语音识别、人脸识别、Ollama API兼容、视频生成、后端版本自动升级、模型固定与按需加载切换、通用模型导入器,新增sglang、ik-llama-cpp、TurboQuant等多个后端。

项目开源地址:https://github.com/mudler/LocalAI

增sglang、ik-llama-cpp、TurboQuant等多个后端。