一、为什么需要「阅读自动化流水线」?

-

每周需要花 3-5 小时筛选和阅读论文

-

读完就忘,笔记散落在各个 PDF 里

-

写综述时才发现"好像看过一篇相关的,但找不到了"

本文介绍一种基于心流平台的极简实现方案,可以很大程度提高效率------通过心流 Happy-Notes Skill、心流搜索 API,实现一个完整的"可检索、可关联、可生成"的个人Paper库。无需编写额外代码,仅需两次 Skill 安装即可在本地完成部署。

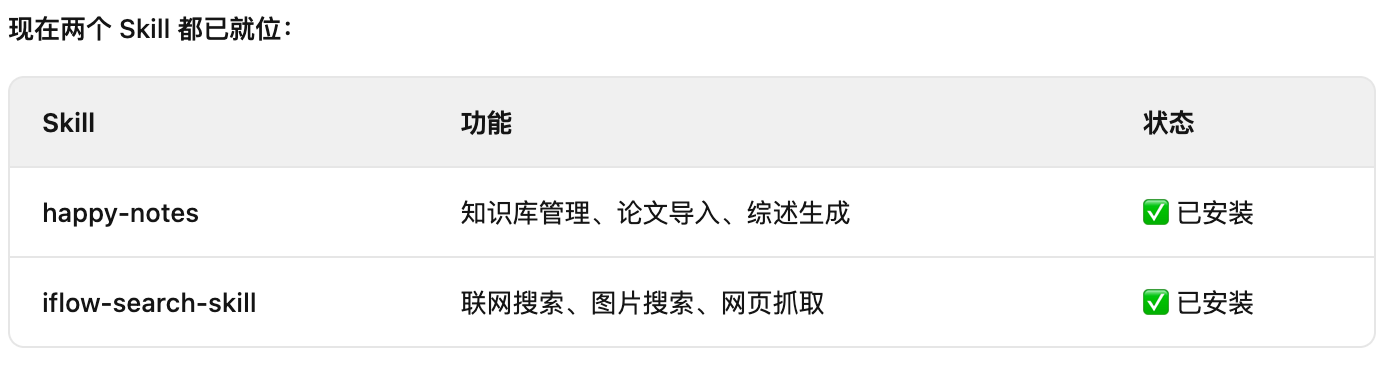

准备工作 - 安装与配置:

在你的Agent里安装两个Skill,通过APIKey完成配置。

知识库管理及功能使用 - Happy-Notes :https://iflow.cn/inotebook/skill

论文检索与动态追踪 - iFlow-Search-Skill :https://platform.iflow.cn/docs/skill

二、开启体验

我在我的龙虾中接好了两个Skills,以下是我们的对话:

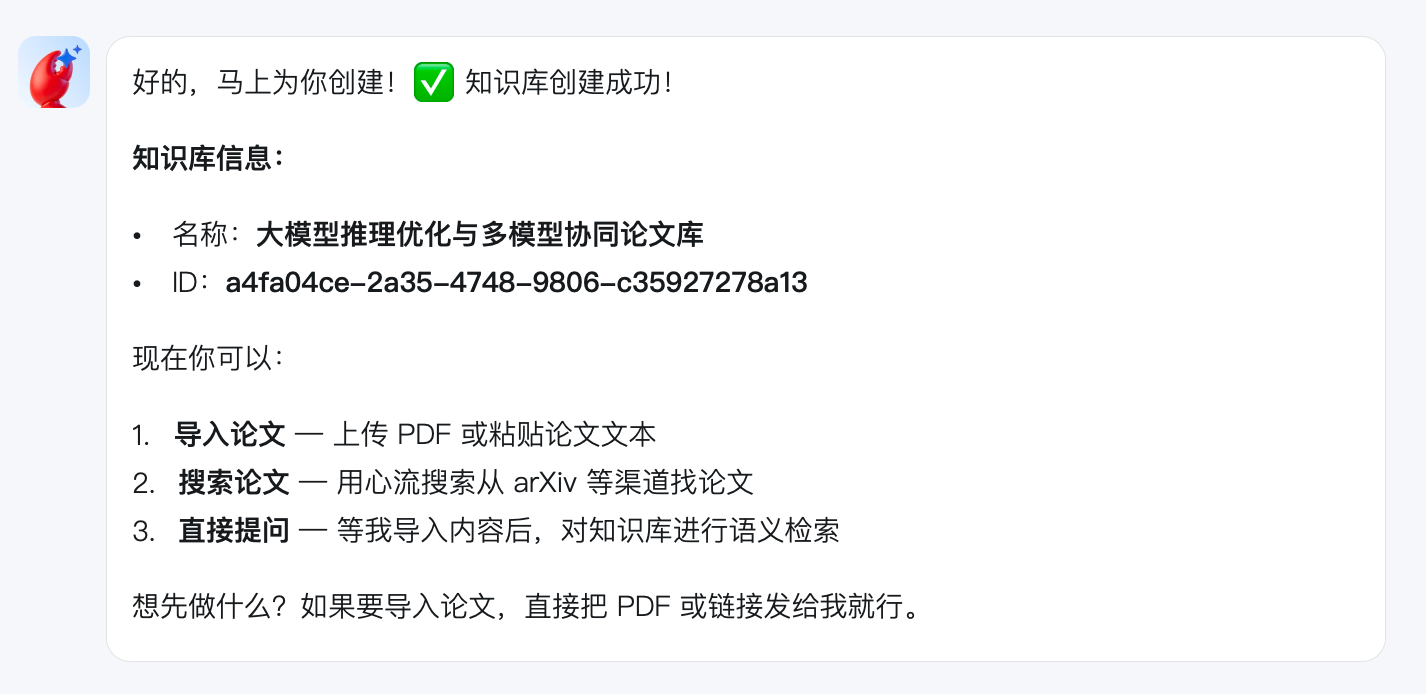

你好小虾,帮我新建一个知识库,我将用它作为我的大语言模型推理优化、多模型协同等方面的论文学习知识库。

这里是我比较关注的几篇论文,都加入到这个知识库里:https://arxiv.org/abs/2604.07725;When More Thinking Hurts: Overthinking in LLM Test-Time Compute Scaling;Scaling Test-Time Compute Without Verification or RL is Suboptimal

另外帮我用心流Search检索更多近期相关论文,一同加进去

我想验证它的内容准确度,发现没有将原文pdf提供给它,于是让它下载后重新放入知识库

1、多模型协同的调度策略能不能进一步优化(比如动态调整,而不是固定分配)?另外想问一下,你真的是看到了论文pdf总结的吗,还是仅仅只是看了论文摘要介绍?

2、帮我把这几篇的论文pdf都下载下来导入知识库

除了基于paper提问解答,最提升效率的是你让它帮你分析paper中最核心的观点、业界最关注的内容、你需要阅读的重点,以及你想关注和它认为你有可能忽略的点。

1、我是一名大四计算机学生,正在研究这领域的内容,帮我简单概括这六篇论文的内容,并提取出你认为这几篇论文的最核心的观点及内容

2、你认为对于现阶段想要研究动态调度优化的我来说,哪部分内容是必读的?

3、你刚才提到的第二优先级:MARBLE(如果论文里有调度协议细节)这一部分帮我精读后找到合适的段落

4、帮我补充这类论文,记得下载pdf后导入

你可以在此基础上继续学习,让他帮你生成论文综述、开题报告、汇报PPT等等,或者利用你的Agent设置定时任务,通过iflow-search-skill 帮你定时检索最新论文加入这个知识库。

请帮我为这些内容制定一个阅读计划,同时帮我生成简报,如有这个方向的论文帮我定时更新到这个知识库

等简报生成好了,直接发给我

综上,一套自动阅读流水线,不需要你花费大量时间筛选内容、通篇阅读,而是可以有轻有重、游刃有余地读完所有你所需要的精华内容。

并非替代你思考,而是放大你的阅读半径------Skill 负责"广度和记忆",你负责"深度和判断"。

当然,你也可以回到心流2.0平台,查看你通过agent实现的完整知识库。

三、系统架构

接下来我们细说如何实现的。

Stage 1:发现 ------ 如何不漏掉重要论文?

在构建论文库的第一步,核心挑战是如何在海量学术文献中精准定位目标论文,同时避免无效信息过载。

**技术实现:**通过 ilFow-Search-Skill 的 Web_Search.sh 脚本执行联网论文检索,支持 ArXiv、学术搜索引擎等数据源,返回结构化的论文列表(标题、作者、摘要、PDF 链接)。检索结果可直接用于后续的增量过滤和预筛选。

Stage 2:采集 ------ PDF 不是终点,结构化才是

下载 PDF 只是文献管理的第一步。真正决定知识库可用性的,是能否将非结构化的 PDF 文件转化为可检索、可关联的结构化数据。

**技术实现:**通过 Happy-Notes 的 PDF 上传能力,将论文文件导入知识库。系统会自动完成文本解析、索引构建和内容分块。支持批量导入(多文件逗号分隔传入)和自动去重,确保同一论文不会被重复索引。

Stage 3:理解 ------ 从"读过"到"读懂"的关键

文献阅读的最终目的不是"看完",而是建立论文之间的知识关联。这一阶段的核心是从被动阅读转向主动探索。

技术实现 :Happy-Notes 提供 pipeline_semantic_search.py 语义检索能力,不同于传统的关键词匹配,它能够理解查询语句的语义意图,返回跨论文的关联内容片段。同时支持按主题深度检索(如"多模型编排中的置信度路由设计"),而非简单的术语匹配。

Stage 4:生成 ------ 从"一堆论文"到"一篇综述"

文献管理的最终产出不是"存了多少篇论文",而是"能生成什么洞察"。这一阶段的核心挑战在于:如何让 AI 基于知识库中的原始材料,生成具有逻辑主线和分析深度的综述性内容。

技术实现: Happy-Notes 提供 pipeline_generate.py 内容生成能力,基于知识库中的全部或指定论文,生成结构化报告。支持多种输出格式:Markdown/PDF 报告(适合技术文档)、PPT(适合演示汇报)、思维导图(适合知识梳理)。生成时可通过 -query 参数指定创作要求(如"面向大四学生的对比分析"、"聚焦动态调度方向的5个核心要点"),确保输出内容的受众适配性和主题聚焦度。

进阶:让流水线 7×24 小时运转

基于Agent的定时任务等能力,实现自动化例如:

-

每周一自动搜索新论文

-

新论文自动入库并标记"待读"

-

每月自动生成"领域进展月报"

写在最后

Happy-Notes 负责知识管理,iFlow-Fearch-Skill 负责信息获取,两者的组合足以覆盖学术研究中最耗时的文献处理环节,替你完成检索、下载、索引和综述,把时间留给真正重要的思考。

产品已上线,同时提供免费额度,欢迎体验:

心流 Skill(Happy-Notes): https://iflow.cn/inotebook/skill

心流·搜索 API(iFlow-Search-Skill) :https://platform.iflow.cn/docs/skill