谷歌威胁情报小组 (GTIG) 的研究人员表示,针对一款流行的开源网络管理工具的零日漏洞很可能是使用人工智能生成的。

该漏洞可被用来绕过一款流行的开源、基于 Web 的系统管理工具(该工具名称未透露)中的双因素身份验证 (2FA) 保护。

虽然攻击在大规模利用阶段之前就被挫败了,但该事件表明,威胁行为者越来越依赖人工智能的帮助来发现和利用漏洞。

根据 Python 漏洞利用代码的结构和内容,谷歌高度确信攻击者使用了人工智能模型来发现并利用该漏洞。

"例如,该脚本包含大量教育性文档字符串,包括一个虚构的 CVSS 分数,并使用了结构化的、教科书式的 Python 格式,这是 LLM 训练数据的一个典型特征,"GTIG 在今天的一份报告中表示。

用于恶意任务的大型语言模型 (LLM) 仍然不清楚,但谷歌排除了 Gemini 参与该过程的可能性。

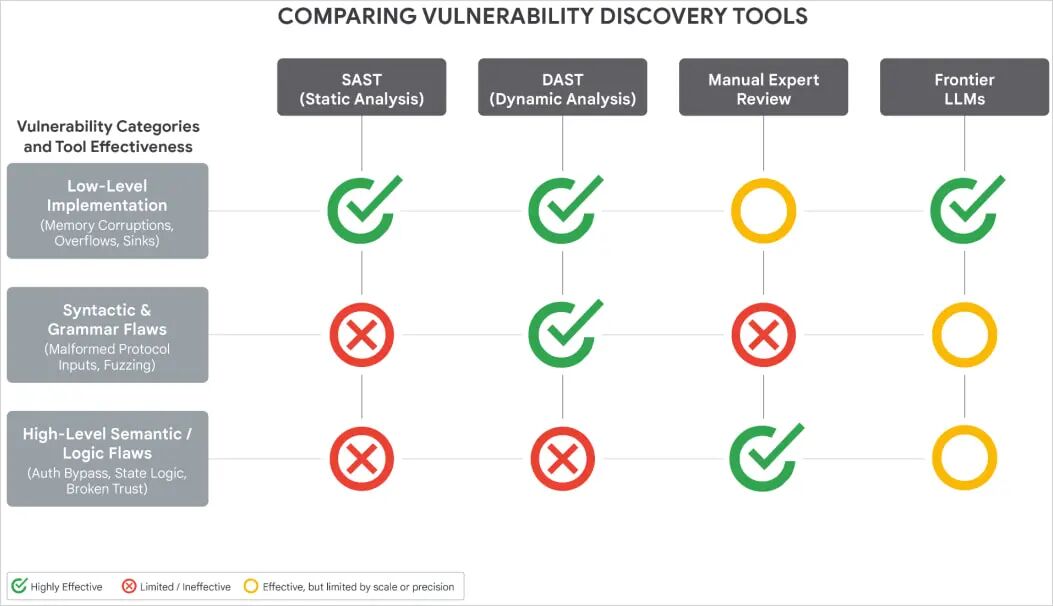

进一步的证据表明,LLM 工具在发现过程中得到了应用,缺陷的性质也印证了这一点------这是一个高级语义逻辑错误,人工智能系统擅长识别,而不是通常通过模糊测试或静态分析发现的内存损坏或输入清理问题。

来源:谷歌

谷歌已将这一重大威胁告知软件开发商,并及时采取行动阻止了攻击。

GTIG研究人员表示:"GTIG 首次发现了一个使用零日漏洞的威胁行为者,我们认为该漏洞是利用人工智能开发的。"

除了此案例之外,谷歌还指出,亚太地区的黑客,如 APT27、APT45、UNC2814、UNC5673 和 UNC6201,一直在使用 AI 模型进行漏洞发现和漏洞利用开发,延续了2 月份报告中观察到的趋势。

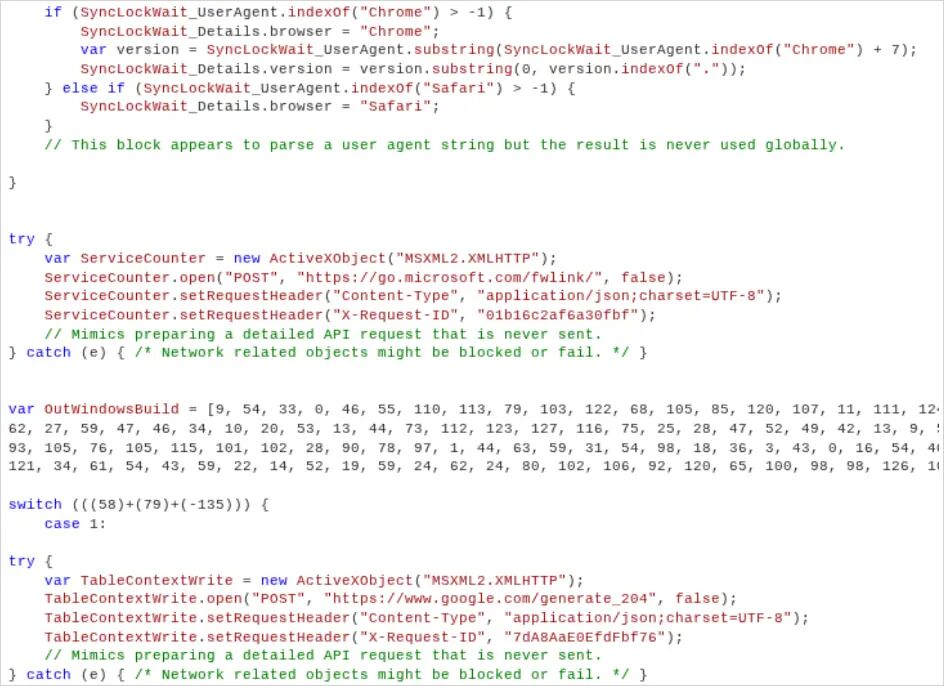

据观察,与俄罗斯有关联的攻击者使用人工智能生成的诱饵代码来混淆 CANFAIL 和 LONGSTREAM 等恶意软件。

诱饵逻辑的 CANFAIL 代码注释

来源:谷歌

谷歌还重点提及了一项代号为"过载"的俄罗斯行动,该行动中,社会工程威胁行为者利用人工智能语音克隆技术,在虚假视频中冒充真正的记者,宣传反乌克兰的论调。

今年早些时候,ESET 记录了Android 的PromptSpy 后门程序,谷歌的报告也重点介绍了该程序与 Gemini API 的集成,以实现自主设备交互。

然而,谷歌还发现了一个名为"GeminiAutomationAgent"的自主代理模块,该模块使用硬编码提示,使恶意软件能够以自动化的方式与设备进行交互。

研究人员表示,提示的作用是赋予设备一个无害的角色,使其能够绕过LLM的安全功能。其目标是计算用户界面边界的几何形状,PromptSpy可以利用该形状以多种方式与设备进行交互。

此外,谷歌研究人员表示,该恶意软件还利用基于人工智能的功能来重放设备上的身份验证信息,无论是锁定图案还是 PIN 码。

该公司警告称,威胁行为者现在正在利用自动创建帐户、代理中继和帐户池基础设施,将对高级 AI 模型的访问产业化。

本文引自:https://hackread.com/google-hackers-used-ai-develop-zero-day-exploit/