在AI大模型从云端向终端渗透的关键阶段,轻量化、高效率、隐私安全 已成为行业核心诉求。2026年5月11日,面壁智能联合清华大学正式开源MiniCPM‑V 4.6 端侧多模态大模型。该模型以1.3B参数实现同尺寸模型性能登顶,打破了"参数越大能力越强"的行业惯性,为端侧AI落地提供了全新的技术路径。

模型地址:

🤗 Hugging Face:https://huggingface.co/openbmb/MiniCPM-V-4.6

💻 GitHub:https://github.com/OpenBMB/MiniCPM-V

一、端侧多模态模型:AI普惠的核心突破口

传统大模型受限于高算力依赖、高延迟及隐私风险 ,难以实现规模化终端落地。相比之下,端侧轻量级多模态模型凭借低功耗、本地推理、毫秒响应的优势,成为AI普惠的关键载体,广泛适配手机、车机、AIoT等场景。

当前端侧模型呈现三大发展趋势:

1.参数精简化:1B左右参数模型成为主流,兼顾性能与部署成本;

2.能力专业化:在OCR、图像理解、文档解析等垂直场景超越大模型;

3.部署轻量化:消费级硬件即可运行,降低开发者与企业落地门槛。

MiniCPM‑V 4.6正是这一趋势的标杆产物,以小参数、高密度智能重新定义了端侧多模态模型的标准。

二、MiniCPM‑V 4.6核心优势:性能与效率双突破

(一)极致性能:1.3B参数超越行业标杆

在Artificial Analysis Intelligence Index等权威评测中,MiniCPM‑V 4.6全面超越阿里Qwen3.5‑0.8B、谷歌Gemma 4 E2B‑it,同尺寸模型智能密度全球领先。

•Token利用率极致 :仅用Qwen3.5‑0.8B2.5%的Token吞吐量,实现性能反超;

•多模态能力均衡:高清图像理解、复杂文本识别、多轮对话交互能力拉满;

•低幻觉率:信息提取、格式转换等任务准确率超越百亿参数大模型。

(二)推理效率:单卡4090实现工业级并发

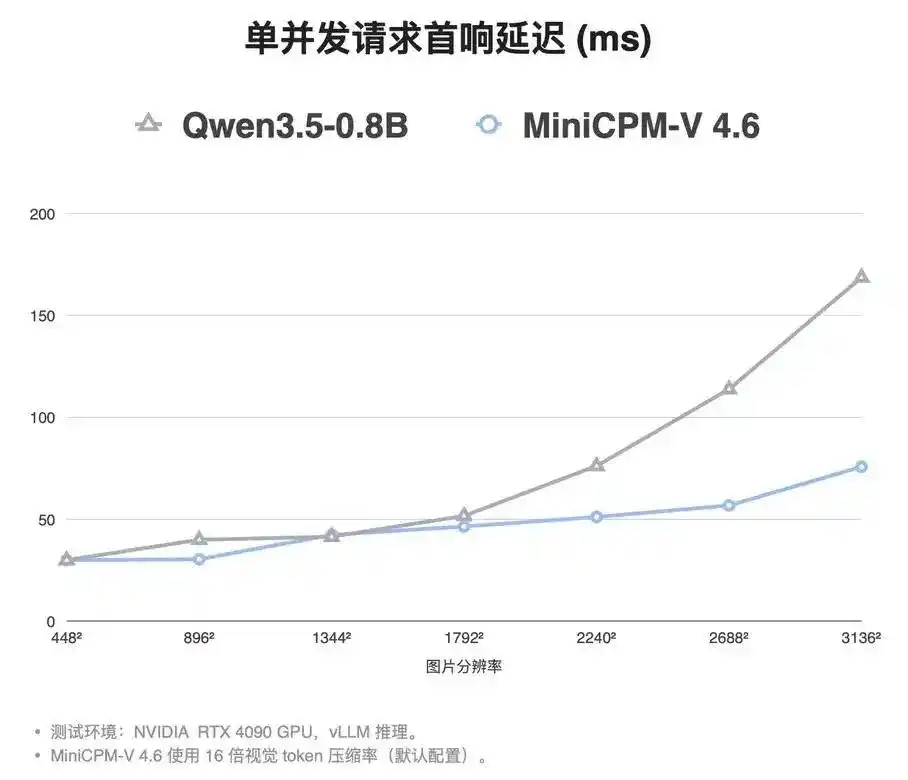

依托16倍视觉Token压缩核心技术,MiniCPM‑V 4.6在RTX 4090环境下表现惊艳:

1.首字响应延迟(TTFT) :处理3136²超高清图仅需75.7毫秒 ,较Qwen3.5‑0.8B快2.2倍,实现4K图片秒级响应;

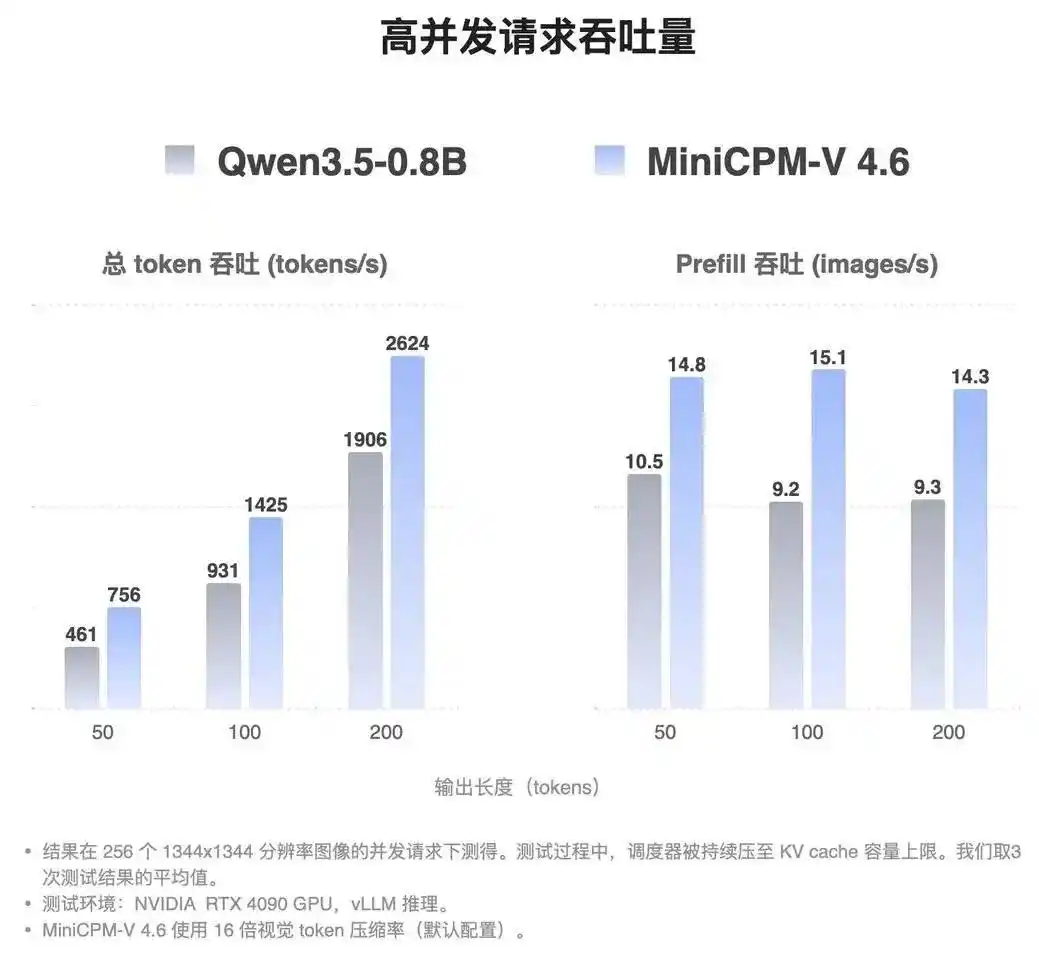

2.高并发吞吐量 :单卡每秒处理1344²分辨率图片14.3张 ,Token吞吐达2624 token/s ,是竞品的1.4倍,支撑千万级并发场景。

(三)部署门槛:消费级硬件即可全流程开发

•硬件要求极低 :单张RTX 4090即可完成微调,6GB内存手机可流畅运行,打破算力集群依赖;

•生态全面兼容:原生支持ms‑swift、LLaMA‑Factory微调框架,适配vLLM、SGLang、llama.cpp、Ollama等推理框架,开箱即用;

•端侧适配完善:支持iOS、Android、HarmonyOS系统,实现移动端离线毫秒级推理。

三、核心技术拆解:LLaVA‑UHD v4架构的创新突破

MiniCPM‑V 4.6的卓越性能,源于面壁智能与清华联合研发的第四代LLaVA‑UHD v4架构,两大技术创新解决了高分辨率图像处理痛点。

(一)ViT内部视觉Token早压缩

传统全局编码方案导致算力随分辨率二次方膨胀,LLaVA‑UHD v4采用切片编码+早期压缩:

•将大图分块处理,规避算力爆炸;

•在ViT浅层插入压缩模块,配合窗口注意力机制与参数复用,视觉编码计算量降低55.8%,兼顾性能与效率。

(二)4倍/16倍混合视觉Token压缩

首创双模式动态切换,兼顾精度与速度:

•4倍压缩模式:细粒度视觉解析,适配医疗影像、文档识别等高精场景;

•16倍压缩模式:极致吞吐量,适配手机实时交互、云端高并发业务,已在快手推荐系统验证落地,承载25%核心请求。

四、商业落地:端侧多模态模型的全场景应用

MiniCPM‑V系列已实现汽车、PC、手机、智能家居多领域商业落地,服务上汽大众、广汽、联想等企业,验证端侧模型实用价值:

1.移动端:离线OCR、隐私图像分析、无网智能助手,毫秒级响应保护数据安全;

2.车机端:智能座舱多模态交互、驾驶环境感知,低延迟保障行车安全;

3.工业端:产线缺陷检测、报表解析,本地推理降低带宽成本;

4.云端:作为大模型助手,分流请求、降低调用成本,提升整体系统效率。

五、行业价值:MiniCPM‑V 4.6引领端侧AI新方向

1.打破参数迷信 :证明智能密度优于参数规模,为轻量级模型研发提供范本;

2.降低落地成本:消费级硬件适配,让中小企业、独立开发者轻松入局AI;

3.推动隐私计算:本地推理实现数据不出设备,解决金融、医疗等场景隐私痛点;

4.完善端边云协同:与云端大模型互补,构建全场景AI生态,加速AGI普惠进程。

六、总结

MiniCPM‑V 4.6以1.3B参数 实现端侧多模态模型性能与效率的双重突破,凭借LLaVA‑UHD v4架构创新、混合Token压缩技术与极低部署门槛,成为端侧AI落地的标杆产品。它不仅验证了轻量级模型的巨大潜力,更推动AI从云端机房走向日常终端,让智能、高效、安全的多模态能力真正普惠每一个设备、每一位用户。

文章来源:AITOP100