前言

大家好,这里是程序员阿亮!最近做Agent项目面对着非常多的框架、语言选择,真的非常迷茫,一下学Python,一下又研究Java的Agent框架,不知道怎么做选择。但是看着我实习的公司、网上很多网友都一致认为,只有合适,没有最好的语言,只有最适合的语言。

作为一个后端开发者,我还是想先去深入研究一下自己语言的框架-SpringAI、SpringAIAlibaba

为什么Java深入Agent生态

在2026年的企业级软件开发领域,生成式人工智能(Generative AI) 与核心业务系统 的融合已经从早期的概念验证(PoC)阶段全面步入深水区 。对于占据企业级应用半壁江山的Java生态而言,如何将大语言模型(LLMs) 、检索增强生成(RAG) 、模型上下文协议(MCP) 以及复杂的多智能体(Multi-Agent) 编排能力无缝融入现有的微服务架构,成为了技术决策的关键。

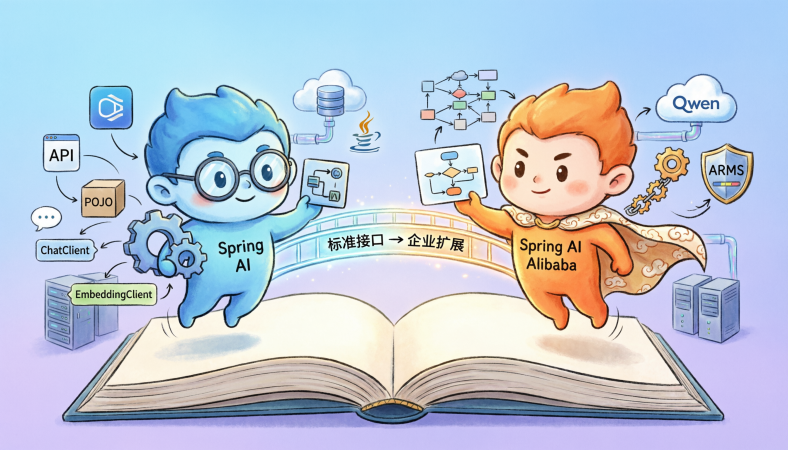

传统的Java后端开发通常依赖于强类型的面向对象范式 ,而在大模型时代,Python生态凭借LangChain和LlamaIndex等框架占据了先发优势 。然而,随着应用进入生产环境,企业对高并发、微服务治理、可观测性以及数据安全的要求急剧上升 ,这促使AI工程化范式向Java生态回归。在这一背景下,Spring AI与Spring AI Alibaba 作为当前Java生态中最受瞩目的两大AI工程化框架,分别代表了不同的设计哲学与能力边界。全面的技术审查表明,两者并非简单的替代关系,而是基础原子抽象与高级企业级编排运行时之间的互补关系

一. 架构理念与技术定位的深度剖析

理解这两个框架的核心差异,首先需要回归到它们的设计哲学与技术定位。两者在架构演进中扮演着截然不同但又紧密相连的角色。

1.1 Spring AI:AI工程化的"原子抽象"与可移植性底座

Spring AI是Spring官方推出的AI应用框架 ,其核心目标是将Spring生态系统 的设计原则(如高度的可移植性、依赖注入、模块化设计以及基于POJO的应用构建方式)引入AI领域 。它的核心价值在于解决AI集成的基础挑战:将企业的数据和API与各种AI模型连接起来。

Spring AI的设计灵感 来源于Python生态中的LangChain和LlamaIndex ,但它明确表示并不是这些项目的简单移植 。在Spring的哲学中,所有的外部依赖都应该被抽象为统一的接口,以避免供应商锁定(Vendor Lock-in)。其架构哲学强调**"编写一次,到处运行"** 的标准化接口。通过提供统一的**ChatClient、EmbeddingClient、ImageClient**等多模态API,Spring AI消除了开发者对底层模型提供商(如OpenAI、Anthropic、Google Gemini、Mistral等)特定SDK的强依赖 。

此外,Spring AI通过结构化输出(Structured Outputs)功能 ,将大模型返回的非结构化自然语言精准映射为强类型的Java POJO对象 ,这从根本上改变了开发者处理AI响应的方式,使其无缝接入现有的业务逻辑层 。在定位上,Spring AI类似于Java生态中的JDBC或Servlet API,它提供的是构建AI应用所必需的"原子化抽象" 。

1.2 Spring AI Alibaba:云原生环境下的复杂智能体编排中心

如果说Spring AI是Java领域的LangChain,那么Spring AI Alibaba则更接近于Java领域的LangGraph 。当大规模模型(如Qwen-2.5系列)在中国乃至全球市场被广泛应用时,仅仅拥有基础的对话抽象是远远不够的。Spring AI Alibaba不仅是基于Spring AI标准接口的本地化实现(如接入阿里云百炼平台、通义千问DashScope、DeepSeek等模型),它更是一个专为Java开发者量身定制的Agentic AI开发框架 。

Spring AI Alibaba在Spring AI底层抽象的基础上,补充了构建企业级生产系统所需的关键组件。其核心聚焦于多智能体编排(Multi-Agent Orchestration) 、基于长连接和长期状态的图(StateGraph)工作流引擎 、复杂的上下文工程(Context Engineering) ,以及与阿里云原生基础设施 (如Nacos动态配置、Higress网关、ARMS可观测性底座)的深度融合 。它解决的不再仅仅是"如何调用大模型"的问题,而是"如何在一个高并发、高可用、强监管的分布式系统中,稳定、可控地编排多模型和多智能体协同执行任务"的问题 。

1.3 核心定位与能力对比矩阵

通过对比矩阵可以清晰地看出这两个框架在抽象层级上的差异:

| 对比维度 | Spring AI (官方基础框架) | Spring AI Alibaba (企业级扩展框架) |

|---|---|---|

| 生态定位 | 底层AI通信标准与通用接口抽象 | 聚焦于复杂多智能体编排与企业级云原生最佳实践 |

| 主要参照物 | LangChain / LlamaIndex | LangGraph / 复杂工作流编排引擎 |

| 抽象粒度 | 原子级别(Prompt、ChatModel、VectorStore接口) | 复合级别(Graph API、Agent Framework、Nacos集成) |

| 模型对接 | OpenAI, Anthropic, Gemini, Ollama等国际主流模型 | 深度集成DashScope (Qwen, DeepSeek系列) 及阿里云百炼 |

| 工作流控制 | 依赖开发者手动编写业务代码或使用Advisors拦截 | 提供DAG有向无环图、StateGraph、持久化及多智能体协作模式 |

| 内容安全 | 基础的Mistral审核模型接口 | 提供企业级AI Guardrails,结合自定义黑白词图库与阿里云安全底座 |

| 可观测性支持 | Micrometer原生追踪与指标暴露 | 深度集成阿里云ARMS、LoongSuite、OpenTelemetry及提供可视化Admin控制台 |

二. 核心交互链路:ChatClient的流式演进与Advisors拦截机制

在与大语言模型交互的基础层面上,Spring生态提供了一套极为优雅的拦截与控制机制 ,这构成了所有高级智能体应用的基础。

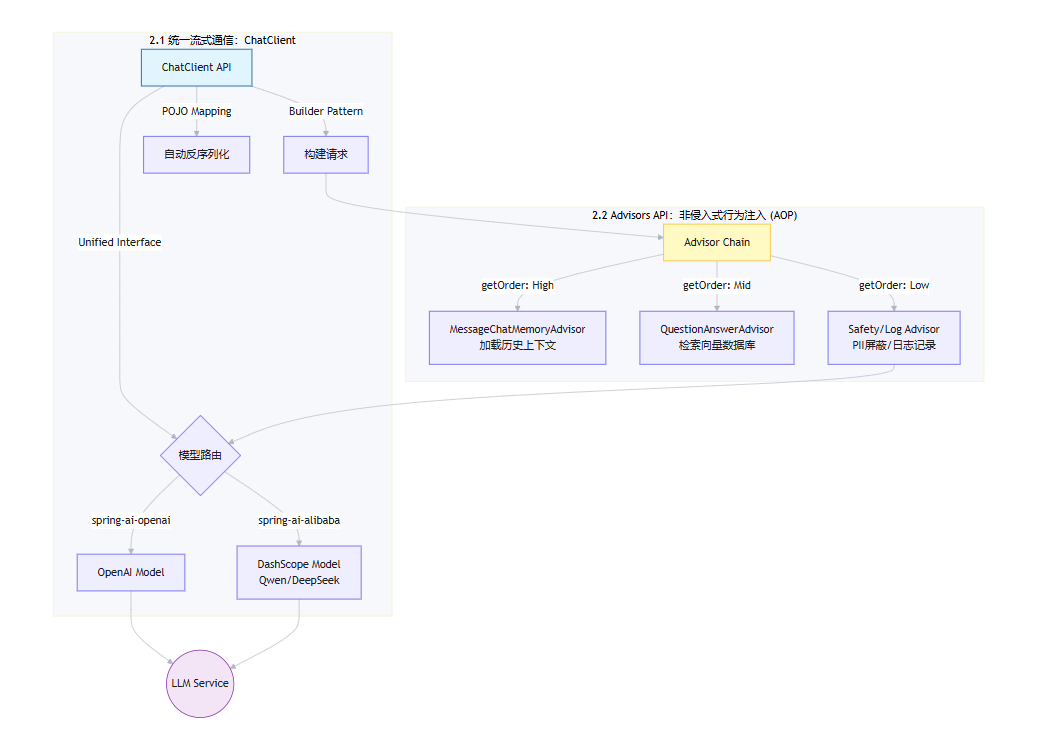

2.1 统一流式通信:ChatClient的抽象艺术

Spring AI通过**ChatClient API** 为开发者提供了一种流式且基于构建器模式 (Builder Pattern)的API体系,其设计风格高度契合Spring框架中广泛使用的WebClient或RestClient。这种设计允许开发者以极其简练的代码完成模型对话、Prompt占位符替换、以及基于系统指令的上下文设定。通过POJO的自动映射功能,模型返回的JSON或结构化数据可以被透明地反序列化,极大降低了由于大模型输出不稳定性带来的数据解析异常风险 。

在这一统一抽象之上,Spring AI Alibaba通过实现DashScopeChatModel 扩展了这一能力,使得应用不仅能够无缝对接OpenAI的API规范 ,还能在不修改应用核心业务代码的前提下,直接通过更换Starter依赖项 (如spring-ai-alibaba-starter-dashscope)调用阿里云通义千问系列和DeepSeek系列模型 。在2026年,随着中国顶级大模型(如Qwen 2.5和DeepSeek V3/R1)在Elo评分和各项基准测试中完全弥合了与西方领先模型(如GPT-4o和Claude 3.7)之间的差距 ,通过统一接口进行跨云厂商的模型动态路由和低延迟的中国区本地化部署,成为了企业应对地缘合规性和数据隐私要求的重要战略 。

2.2 Advisors API:非侵入式行为注入体系

随着AI功能的复杂化,开发者往往需要在模型调用前后执行一系列通用逻辑,如加载历史记忆、执行安全检查、或查询检索增强(RAG)数据。为了解决这些横切关注点(Cross-cutting Concerns),Spring AI在架构中引入了Advisors API 。

Advisors充当了LLM请求和响应链路中的AOP(面向切面编程)拦截器机制 ,能够封装和重用生成式AI模式,并提供跨各种模型和用例的可移植性 。该API由用于非流式场景的CallAdvisor和CallAdvisorChain ,以及用于流式场景的**StreamAdvisor和StreamAdvisorChain组成** 。

框架通过getOrder()方法管理多个Advisor的递归执行顺序(数值越小优先级越高,最先执行),最终由调用链的最末端向LLM发起真实的网络请求 。这种设计使得以下几种典型应用模式成为可能:

-

MessageChatMemoryAdvisor :自动从存储(如Redis、SQLite或传统关系型数据库)中提取指定**

ConversationId的历史会话上下文**,并将其附加到本次的系统提示词中,从而实现大模型本身无状态情况下的多轮对话状态保持 。 -

QuestionAnswerAdvisor :实现了基础的RAG逻辑,在请求大模型之前隐式地从向量数据库中检索高度相关的私域文档片段,并将这些事实依据安全地包裹在Prompt中,从而有效缓解模型的幻觉现象 。

-

安全与日志Advisors :在请求发送前屏蔽包含PII(个人敏感信息)的数据,或记录所有Prompt输入和Completion输出至日志系统,为后续的可观测性分析提供数据源 。

尽管Advisors API在处理单一的、线性增强任务时表现得极为轻量和高效,但其架构本质上依然是一个严格的请求/响应(Request/Response)修饰链 。当遇到需要大模型基于自身推理结果动态选择下一步工具、执行包含循环的纠错逻辑,或者在不同职能的Agent之间进行复杂状态传递时,仅仅依靠Advisors就会使得代码变得难以调试、状态极易丢失,这就催生了更高级的多智能体工作流引擎的出现 。

三. 从顺序链到复杂决策网络:Graph与Agent Framework

随着AI工程化在2025至2026年的迅猛发展,业界对于AI应用构建的共识已经从"单次提示词调优"转向了"多智能体编排与代理工作流(Agentic Workflows)" 。单纯依赖模型内部的ReAct(Reasoning and Acting)循环往往面临行为不可预测、Token消耗过大和极度缺乏可控性等问题。Spring AI Alibaba在这一领域展现出了显著的差异化优势。

为什么是豆包AI呢,因为Banana老师乱码,imgae2.0额度超了

3.1 基于DAG的有向无环图编排:StateGraph

完全自主的智能体就像是一次没有计划的公路旅行------充满灵活性与冒险,但缺乏可预测性。对于金融审批、客户投诉处理等严格的企业级场景,研发团队必须对系统流程有绝对的控制权 。Spring AI Alibaba Graph提供了一个基于图算法的底层执行引擎,它借鉴了有限状态机(FSM)与图 计算的理念,将复杂业务拆解为明确的节点(Node)和边(Edge) ,为AI执行提供"受控的自制性" 。

-

全局状态总线(OverAllState) :作为贯穿整个执行图的数据载体,解决了复杂上下文中参数传递的问题。开发者可以为不同的数据键 (Key )配置特定的状态合并策略:

ReplaceStrategy(新值直接覆盖旧值,常用于最终结论的存储)、AppendStrategy(将新结果追加为列表,适用于收集多步推理的过程日志)、以及MergeStrategy(智能合并Map等复杂数据结构) 。 -

计算节点(Nodes) :实现特定业务逻辑的原子工作单元(实现

NodeAction接口)。每个节点接收当前的图状态,执行大模型推理或外部API调用,然后返回增量状态以更新全局上下文 。例如,可以将一个节点配置为专门负责意图识别的QuestionClassifierNode,其唯一的任务就是输出高度结构化的分类标签 。 -

动态路由与边(Edges & EdgeAction) :定义状态流转的条件路由机制。智能体的执行不再是大模型内部的黑盒幻觉,而是由预先定义的业务边规则引导 ,沿着特定路径跳转 。

企业级案例深度剖析:多级智能客服分发工作流

在Spring AI Alibaba提供的一个经典客户反馈处理系统实践中,这种图编排的优越性体现得淋漓尽致:

-

触发阶段 :特殊的**

START状态节点** 接收到用户的自然语言反馈文本,并写入**OverAllState的input键**。 -

一级情感与意图分类 :状态机通过边直接流转至**

feedback_classifier(一级分类节点)** 。该节点内部调用经过特定角色配置的ChatClient,判定反馈是"正面"、"中性"还是"负面",并将结果写入classifier_output。 -

确定性路由分发 :系统通过自定义的

FeedbackQuestionDispatcher边逻辑读取分类输出。此时,业务规则介入:如果情感为"正面",则直接将图路径指向recorder(归档节点)完成流程;如果判定为"负面",则流转至下属的专职专家节点specific_question_classifier。 -

二级专家细分:该节点专门负责分析负面情绪的原因,细分为"售后服务"、"产品质量"或"物流运输"等具体工单类别,此时可调用RAG技术检索对应的退换货赔偿政策,输出高精度的处理建议 。

-

汇聚与结束 :无论是哪个子分支的处理结果,最终均通过预设的无条件边汇聚至数据入库节点 ,最后流向特殊的END状态彻底终止图执行 。

这种Graph-based Workflow架构使得大模型的不可预测性被严格限制在单一节点的微观推理范围内,而宏观的业务走向 依然保持着传统企业级软件的"确定性"、 "强类型"和"可审计性" 。更重要的是,底层运行时支持持久化与快照 (Checkpointing),这意味着长时间运行的工作流可以在服务重启后恢复,或者在关键节点暂停等待人类专家审核(Human-in-the-Loop),极大地提升了系统的容错率。

3.2 高阶Agent Framework与技能挂载

在Graph底层的坚实支撑之上,Spring AI Alibaba为开发者提供了一层更易用的Agent Framework,它预置了业界成熟的智能体协作设计模式:

-

SequentialAgent(顺序协同智能体):适用于严格的流水线任务加工机制,上一个Agent的输出严格作为下一个Agent的输入。

-

ParallelAgent(并行协同智能体):支持扇出(Fan-out)并发执行任务(如同时让三个不同的大模型分别进行代码审查),并在完成后进行状态聚合。

-

RoutingAgent(路由智能体):充当大流量入口的分发器,基于大模型的意图识别动态决定将任务委托给哪个子智能体。

-

LoopAgent(循环智能体) :执行批判-重试(Critique-Retry)循环。例如在代码生成场景中,不断生成代码并调用测试工具,直至测试用例完全通过或达到最大重试次数 。

同时,在智能体技能(Agent Skills)的管理 上,Spring AI(通过其实验性的spring-ai-agent-utils)引入了将提示词、Python/Bash执行脚本和上下文引用资料 统一封装为Markdown库的概念 。相比将大量系统指令硬编码在Java字符串中,这种渐进式暴露(Progressive Disclosure) 的技能机制允许智能体在启动时仅加载技能名称和摘要 ,而在真正需要时才读取全量指令,显著降低了常驻的Token开销 。这些便携式的通用技能兼容任意底层模型提供商,与Agent Framework结合使用,大幅降低了构建多智能体系统(如内部使用的通用编程助手JManus)的代码复杂度

四. 工具调用(Function Calling)与MCP协议栈的深层革新

在AI应用中,大模型本身是封闭的"大脑",它不具备 查询实时库存、执行退款操作或读取公司最新邮件的能力。工具调用(Tool Calling)是打破大模型沙盒 ,使其与现实世界(数据库、第三方API、企业核心系统)产生交互 的关键枢纽 。

4.1 传统本地函数的限制与Spring AI抽象

Spring AI通过原生的**@Tool注解** 为本地工具调用提供了极简的开发体验 。开发者只需在常规的Java组件方法上添加该注解及功能描述,Spring AI的ToolCallingManager便能在启动时利用反射自动推断该方法的输入参数结构,并生成符合OpenAI格式的JSON Schema。

在运行时,如果大模型推断需要执行特定工具,它会返回一个要求调用的特殊结构 (包含工具名和解析好的参数)。此时,框架会自动挂起当前对话,通过**ToolCallback** 在本地JVM内部执行真实的Java逻辑(例如查询某个城市的天气),并将执行结果封装为系统消息再次推送给大模型,最终模型结合工具返回的真实数据生成对用户的连贯答复 。

然而,随着系统规模的扩大,这种"本地绑定"机制暴露出了严重的架构缺陷:

-

强耦合 :AI处理服务必须在本地包含所有业务逻辑依赖 ,导致微服务演变成庞大的单体应用。

-

安全隔离差 :所有工具使用同一个服务的安全凭证,无法针对单一高危操作实施细粒度的鉴权。

-

异构语言难以接入:如果需要调用的算法库由Python编写,基于Java反射的本地注解便无能为力 。

4.2 破局之道:模型上下文协议(MCP)与Spring AI Alibaba的工业级实现

为了解决工具共享与跨语言交互的难题,2025年迅速崛起的模型上下文协议(Model Context Protocol, MCP) 确立了AI生态的互操作标准 。MCP采用客户端-服务器架构,将工具的定义与执行完全从AI大模型网关中剥离出来,封装在独立的MCP Server中。

Spring AI Alibaba在MCP的工业级落地方面进行了深度整合与改造:

-

Nacos MCP Registry(动态注册与自动发现) :通过引入

spring-ai-alibaba-starter-mcp-registry,开发者构建的微服务化MCP Server 可以在启动时自动将其包含的工具定义注册到Nacos配置中心。 这种去中心化的服务发现机制意味着,前端的AI Agent Client可以动态感知到全局环境中数百个可用的MCP节点 ,而无需硬编码URL 。更为强大的是,研发人员可以在Nacos控制台动态配置工具的启用/禁用状态 ,以及热更新工具参数的Schema描述,这一机制能够在不重启系统的情况下立即生效 ,满足企业对于高危接口的动态熔断需求 。 -

业界首创的Streamable HTTP传输层 :原生的MCP协议严重依赖 于本地标准输入输出(Stdio)或HTTP+SSE(Server-Sent Events)。 SSE本质上是单向推送的长时间阻塞连接 ,存在不支持断线自动恢复 和大规模并发 下耗尽 服务器连接池资源的致命缺陷 。在移动端网络不稳定的情况下,一旦SSE断开 ,分析超大文档的工具调用状态将会全部丢失 。Spring AI Alibaba联合阿里云Higress网关 ,推出了基于双向流复用 的Streamable HTTP 实现。它不仅大幅降低了多路并发调用的内存消耗 ,还支持智能断线重连 和全链路异步IO,使MCP技术真正达到了生产级高可用标准 。

-

内建庞大的生态工具库 :为了让Java开发者开箱即用,Spring AI Alibaba底层集成了超过40种预配置工具封装,覆盖了百度/阿里云智能搜索、主流多语言翻译API、高德地图定位、文档解析等基础功能,极大降低了构建"全能助理"的研发门槛 。

五、 RAG体系的演进:从数据切分到云原生向量生态的垂直整合

检索增强生成(RAG)是企业通过私有数据定制知识库以避免大模型幻觉的核心机制。随着技术演进,RAG已经从2023年简单的"文档切分->向量化->相似度检索 "的线性单体流水线,演变成了由智能体驱动的 、高度模块化的复杂架构(Agentic RAG) 。

5.1 Spring AI 的标准数据ETL与向量抽象

要实现RAG引擎,必须先解决数据入库(Ingestion)和检索(Retrieval) 两个独立链路。Spring AI为此提供了一套高度解耦的ETL数据工程框架 。 在数据载入阶段,框架通过抽象的**DocumentReader接口** (如支持读取本地文件系统的PagePdfDocumentReader )将异构的文档格式解析为框架内部的Document对象实体;随后,利用TokenTextSplitter等组件精确地将超长文本切分为符合当前模型上下文窗口限制的离散块(Chunks) 。接下来,这些文本块通过**EmbeddingClient** (如nomic-embed-text或阿里云的通义文本向量模型)被转化为高维数学向量 。

在数据存储与查询层面,Spring AI提供了统一的 VectorStore和VectorStoreRetriever接口,并原生支持Elasticsearch、PGVector、Redis、Neo4j等数十种流行的向量数据库。更具价值的是,框架设计了一种跨不同向量库实现的可移植、类似SQL的元数据过滤器API (Metadata Filter API)。这使得开发者在进行语义相似性搜索 (Similarity Search)时,能够精准过滤特定时间段、特定分类维度的文档,而不用去学习每种数据库复杂的私有查询方言 。

5.2 Spring AI Alibaba对中国区数据的深度适配

尽管Spring AI的官方组件库已经十分丰富,但面对中国特有的企业数据生态和公有云设施时,依然存在适配盲区。Spring AI Alibaba通过扩展机制弥补了这一短板:

-

企业级私域数据解析(DocumentReader) :中国企业的大量知识沉淀在协同办公软件体系内。Spring AI Alibaba社区提供了专门针对飞书(Feishu)和钉钉(DingTalk)文档库的

DocumentReader插件扩展。这使得开发者可以直接集成基于云端的富文本协议,快速读取知识空间数据,避免了手动开发API集成和复杂富文本降级转换的重复劳动 。 -

深度集成云原生向量计算服务(Vector Stores) :除了继承Spring AI的基础数据库支持外,Spring AI Alibaba专为海量并发检索场景深度对接了阿里云的AnalyticDB (ADB) 、OpenSearch 以及SeekDB等分布式服务 。

- 值得一提的是AnalyticDB GraphRAG解决方案。传统的语义检索在处理包含大量对比推理、关系推演的金融或法律文献时,由于文档切分破坏了上下文连贯性,容易导致检索质量急剧下降 。AnalyticDB与Spring AI Alibaba融合,将知识图谱(Knowledge Graphs)与向量检索相绑定。在构建知识库时,不仅将文本切分为片段存储,还同步抽取出文档中的实体及依存关系;在检索时,通过图计算游走寻找相关向量关联群。这一技术革新使得在复杂推理和内容推荐场景下的问答准确率提升了两倍以上 。

六. 企业级治理与安全:动态提示工程与AI Guardrails防线

当AI应用在企业网关对外暴露时,仅仅保证其"功能可用 "是不够的。模型输出的不可控性、提示词被注入攻击的风险 ,以及在不重启系统前提下的动态调优,是架构师构建生产级应用时必须攻克的最终壁垒 。

6.1 打破配置僵局:基于Nacos的动态Prompt治理

在传统的Spring Boot开发模式中,开发者习惯使用@Value注解从application.properties或application.yml读取静态配置。但在Prompt工程中,提示词本身就是核心业务逻辑的一部分,需要根据用户的实际反馈进行极高频率的A/B测试和微调 。如果每次修改哪怕一个形容词,都需要经历完整的代码提交、CI/CD编译、集群滚动重启过程 ,其效率将无法忍受。

Spring AI Alibaba充分利用了Spring Cloud生态中的配置中心标杆------Nacos,实现了零停机、无状态的动态提示词工程(Dynamic Prompt) 。 开发实施流程如下:

-

订阅配置 :在

application.yml中通过spring.ai.nacos.prompt.template.enabled: true开启监听,并指定特定的DataID(例如spring.ai.alibaba.configurable.prompt) 。 -

代码解耦 :在Controller层,不再注入死板的Java String或本地

.st文件,而是通过注入ConfigurablePromptTemplateFactory来动态创建模板实例 。 -

运行时热加载 :一旦运营人员或算法工程师在Nacos控制台中修改了Prompt的JSON定义并点击发布 ,底层的Nacos Client会立即通过长连接触发

OnPromptTemplateConfigChange事件 。此时,工厂类缓存自动刷新 ,毫秒级生效,下一个进入系统的高并发请求将自动采用全新的提示词逻辑进行模型交互,实现了业务敏捷性与系统稳定性的完美平衡 。

6.2 严守内容安全:AI Guardrails机制

在使用大模型分析用户生成内容 (UGC)或向外部返回指导建议 时,预防越狱注入攻击 (Prompt Injection)、过滤恶意负面信息 (如涉黄、涉暴、垃圾广告),以及拦截个人隐私数据(PII,如身份证号、信用卡号)是系统不可逾越的安全红线 。

Spring AI内置了轻量级的Advisor能力 来进行审查拦截 。但在面对中国大陆极为严格的合规审计标准时,简单的开源审核模型已无法满足业务需求 。为此,Spring AI Alibaba将模型网关与阿里云的AI Guardrails(内容安全)防线进行了工业级整合 。

这套企业级安防体系包含以下层次的立体保护:

-

前置脱敏与后置校验(Transformations & Validators) :在发送请求至模型之前,系统通过Transformations拦截器对输入中的敏感数据进行脱敏或掩码处理;当获取到大模型输出后,Validators将对其进行幻觉检验和内容倾向识别,一旦违背安全基线将直接触发阻断机制,实施一票否决并返回安全提示 。

-

自定义黑白名单与样本库(Custom Text/Image Libraries) :针对企业所属行业中特有的专有黑话、负面事件词汇以及竞争对手敏感信息 ,AI Guardrails允许企业通过自管理型(Self-managed)库配置细粒度的业务规则。这其中包括"阻断列表(Block list,绝对拒绝命中)"、"人工审核列表(Review list,需业务专员复核)"以及"信任白名单(Trust list,强制放行)"。更智能的是,由于引入了反馈驱动型(Feedback-based)机制,日常被安全员审核标记过的高危图片或变种恶意文本会自动沉淀到库中。下次系统遭遇相同变体请求时,能够不经过重复的大模型推断直接得出结论,极大节省了高昂的算力成本并提升了过滤效率 。

6.3 可观测性(Observability)与Admin全链路管理

在处理生产故障时,"大模型未按预期作答"是极为棘手的问题。Spring AI与Micrometer深度集成,在模型调用时提供了原生的Metrics与Trace数据结构暴露 。

Spring AI Alibaba在此基础上提供了更贴近企业研发管理的SAA Admin(Spring AI Alibaba Admin)平台 。它不仅是一个集中管理OpenAI、DashScope和DeepSeek密钥配置的地方,更深度集成了OpenTelemetry和阿里云ARMS。所有的RAG文档召回数量、MCP工具调用耗时 (Span时长)、最终的Prompt构建文本 、Token流片消耗,都可以通过LoongSuite探针汇聚并在Admin的UI控制台上进行可视化回放分析 。借助集成的Agent Studio功能,开发者还可以基于这些真实的线上Trace数据自动生成离线评测数据集(Evaluator Dataset),用于回归测试,形成不断迭代优化的"数据飞轮"体系 。

七. 2026年架构前瞻与选型建议

在2026年,AI能力的发展已经远远超出了单纯的测试基准,中美主流基础模型(如GPT-4o、Claude 3.7与Qwen 2.5、DeepSeek V3)在综合素质上的差距已缩小至百分之几以内 。模型本身正在从技术瓶颈向"标准化商品(Commodity)"演化。真正的护城河,已经转移到了如何在应用层高效、稳定地调度这些模型,以及如何深挖垂直场景的数据价值 。

同时,Java AI生态内部也在经历激烈的竞争。相较于LangChain4j侧重于对大模型的极致封装,或者JetBrains Koog等轻量级编排库,Spring AI体系(特别是结合Alibaba的高级增强)展现出了不可撼动的生产优势:它们与企业已经沿用了十年的Spring Boot依赖注入体系、Micrometer监控、以及安全拦截器做到了底层哲学级的对齐 。

在具体实践中,两者的选型边界十分清晰,它们代表着架构演进的两个阶段:

-

轻量级场景推荐采用纯粹的Spring AI核心框架 :如果企业的系统侧重于"文档辅助生成"、"翻译映射"或"结构化JSON提取",需求链路短、状态逻辑简单,且数据生态无需强绑定特定公有云基础设施。那么开发者可以直接利用其高度一致的

ChatClientAPI、轻量级的Advisors拦截体系及自带的基础RAG模块。该方式能够以极低的学习成本和运维负担,快速搭建起具备容错与多模型切换能力的健壮微服务节点 。 -

复杂关键任务系统必须转向Spring AI Alibaba体系 :当企业的AI系统肩负着客服自动化审批、跨系统业务流转 ,或是涉及大量的自动化代码分析生成等关键任务 时,单纯依赖提示词技巧和黑盒式的大模型自主规划不仅不可靠,更缺乏合规层面的可审计性。此时,必须引入Spring AI Alibaba Graph引擎进行确定性的节点图编排 (Workflow Orchestration),以实现长状态记忆、精准容错熔断及人工介入审批控制 。此外,当应用规模横向扩展时,借助其内置的Nacos MCP动态工具注册机制、双向流式的Streamable HTTP底层通信,以及深度的AI Guardrails安全合规防护,企业才能真正构建起支撑海量并发调用的数据驱动型多智能体平台(Data-Centric Multi-Agent Platform),进而在AI时代构建坚实的技术护城河 。

总结

回到前言,我们会发现SpringAI、SpringAIAlibaba是Java原生支持的框架,他们的功能和Python的LangChain、Graph在很大程度上有一定的覆盖性,并且Java在工程方面又有很强的生态能力,所以我认为与其焦虑语言,不如多想想idea、多提升自己工程能力,写出代码来!