这些天都在加强自己的CV基本功,之前做过的人脸识别项目里有很多思考,在学习了这些基础知识后,我再次回顾了之前的人脸识别项目。我发现,很多之前困惑不解的问题现在都有了清晰的答案。

一、什么是度量学习?

**度量学习也称为距离度量学习或相似度学习。目标是学习有效的距离或相似度度量,使同类样本之间的距离小、不同类样本之间的距离大,以提高分类或聚类准确性。**常见方法有对比学习、三元组学习和多视图学习,它们定义样本间距离或相似度,并优化模型参数。

二、三元组损失和度量学习什么关系?

(1)三元组损失函数的定义

三元组损失函数(Triplet Loss)是度量学习(Metric Learning)中常用的损失函数,通过最小化同类样本间的距离和最大化不同类样本间的距离来优化模型的度量。

它的基本思想是通过最小化"锚点(Anchor)"、"正例(Positive)"和"负例(Negative)"这三个样本之间的相对距离来优化模型。具体来说:

- 锚点(Anchor, A):是选取的一个样本。

- 正例(Positive, P):与锚点属于同一类别,但不是同一个样本。

- 负例(Negative, N):与锚点不属于同一类别。

三元组损失函数的数学表达式如下:

|--------------------------------------|---------------------------------------------------------------------------------|

| 符号 | 解释 |

| | 表示两个样本在特征空间中的距离,通常使用欧氏距离或余弦距离等 |

| | 表示锚点样本与正样本之间的距离 |

| | 表示锚点样本与负样本之间的距离 |

| | 是一个预先设定的边际(margin),用来确保正例与锚点的距离比负例与锚点的距离至少小

|

| | 如果这个条件不满足,损失函数的值就为两者之差加上

,否则损失为0 |

(2)损失函数的优化目标

目标是最小化锚点与正样本间的距离,同时最大化锚点与负样本间的距离。

三、对于余弦相似度而言三元组损失函数怎么表示?

对于余弦相似度,三元组损失函数目的是确保一个"锚点"样本与其同类的"正例"样本之间的余弦相似度比与一个不同类的"负例"样本之间的余弦相似度至少大一个固定的边际。

(1)三元组损失函数的定义

数学上这个目标可以表示为以下公式:

| 符号 | 解释 |

|---|---|

| 三元组损失函数,衡量锚点、正例、负例之间的相似度差异 | |

| 锚点(Anchor)样本的特征向量,用于比较的基准 | |

| 正例(Positive)样本的特征向量,与锚点属于同一类别 | |

| 负例(Negative)样本的特征向量,与锚点属于不同类别 | |

| 边际(Margin),一个正数,确保正例与锚点的相似度显著高于负例与锚点的相似度 | |

| 余弦相似度函数,衡量向量x和y之间的方向相似性,取值范围为-1到1,值越接近1表示方向越相似 |

(2)损失函数的优化目标

损失函数的目的是最小化锚点与正例之间的余弦相似度差距,与锚点与负例之间的余弦相似度差距加上边际m之间的差值。

当这个差值为负时,意味着负例与锚点的相似度大于正例与锚点的相似度加上边际,此时损失函数输出一个非零值,促使模型调整权重以增大同类样本间的相似度同时减小不同类样本间的相似度。当满足条件时,损失为0,无须更新模型参数。

四、度量学习和三元组损失在人脸识别任务中的应用

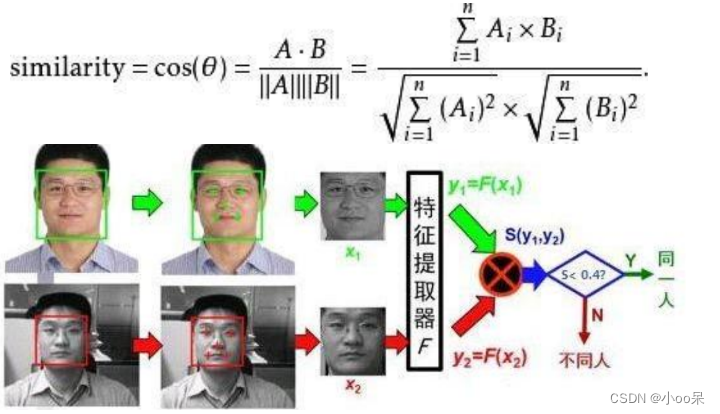

度量学习在人脸识别任务中的应用主要是通过学习一个高维特征空间,在这个空间中,属于同一人的不同人脸图像的特征向量尽可能靠近,而不同人的特征向量则相隔较远。这样,通过比较两个人脸特征向量的距离,就可以判断它们是否属于同一人。

在众多度量学习方法中,三元组损失函数是特别适用于人脸识别的常用方法之一。