大侠幸会,在下全网同名「算法金」

0 基础转 AI 上岸,多个算法赛 Top

「日更万日,让更多人享受智能乐趣」

今天我们来聊聊达叔 6 大核心算法之 ------ 优化 算法。吴恩达:机器学习的六个核心算法!

梯度下降优化算法是机器学习和深度学习中最常用的优化算法之一。它通过不断调整模型参数,使得损失函数的值逐渐减小,从而使模型逐步逼近最优解

梯度下降优化算法的优点

- 简单易实现:梯度下降算法的基本原理简单,容易理解和实现

- 广泛应用:无论是线性回归、逻辑回归,还是复杂的神经网络,梯度下降算法都可以应用

梯度下降优化算法的缺点

- 依赖初始值:梯度下降算法的收敛速度和最终结果可能会受到初始值的影响

- 容易陷入局部最优:在复杂的非凸损失函数中,梯度下降算法可能会陷入局部最优解,而无法找到全局最优解

梯度下降算法的改进

为了克服上述缺点,研究人员提出了多种改进算法,如动量法、Adagrad、Adam等。这些改进算法在加速收敛、避免局部最优等方面有显著效果。我们将在后续内容中详细介绍这些改进算法

2. 应用和普遍性

- 梯度下降法在优化神经网络中的应用和普遍性

梯度下降法在机器学习和深度学习中的重要性不可忽视。作为一种经典的优化算法,梯度下降法被广泛应用于各种模型的训练过程中,尤其是在神经网络的优化中。

梯度下降法的基本原理

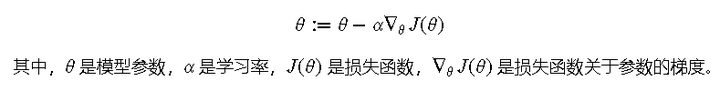

梯度下降法的核心思想是通过不断调整模型参数,使得损失函数的值逐渐减小,从而使模型逐步逼近最优解。具体来说,梯度下降法通过计算损失函数相对于模型参数的梯度,然后沿着梯度的反方向更新参数,以达到最小化损失函数的目的。

神经网络中的应用

在神经网络的训练过程中,梯度下降法起到了至关重要的作用。神经网络的训练过程本质上就是一个通过梯度下降法优化损失函数的过程。具体步骤如下:

- 前向传播:计算当前参数下的模型输出和损失函数值

- 反向传播:计算损失函数相对于模型参数的梯度

- 参数更新:使用梯度下降法更新模型参数

这个过程会反复进行,直到损失函数的值收敛到某个最小值。

普遍性

梯度下降法不仅在神经网络中广泛应用,还被应用于其他很多机器学习模型中,比如线性回归、逻辑回归、支持向量机等。它的普遍性和适用性使得它成为机器学习领域的一个重要工具。

在实际应用中,梯度下降法的具体形式有很多,比如批梯度下降法、随机梯度下降法和小批量梯度下降法。不同形式的梯度下降法在计算效率、收敛速度和收敛稳定性上各有优劣,我们将在下一部分详细介绍这些变形形式。

3. 梯度下降法的变形形式

- 批梯度下降法:使用整个数据集计算梯度

- 随机梯度下降法(SGD):使用单个样本计算梯度

- 小批量梯度下降法:使用小批量样本计算梯度

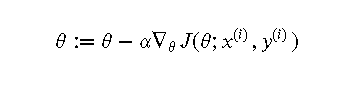

随机梯度下降法(SGD)

随机梯度下降法是一种通过每次仅使用一个样本来计算梯度的变形形式。它每次随机选择一个样本进行参数更新,这使得算法在处理大型数据集时更加高效。

优点

- 计算效率高:每次更新只需要计算一个样本的梯度,大大减少了计算开销

- 内存需求低:每次只需加载一个样本,节省内存

缺点

- 收敛不稳定:由于每次更新基于单个样本,梯度估计有较大噪声,可能导致收敛过程不稳定

- 可能震荡:在非凸损失函数中,更新方向可能来回震荡,难以到达全局最优解

公式

随机梯度下降法的更新公式如下:

用随机梯度下降来优化人生

参照李沐曾写过的一篇短文:用随机梯度下降来优化人生

李沐 | CMU,前亚马逊首席科学家

生活中很多事,听起来复杂,其实用简单的算法就能解决,比如随机梯度下降。这算法不仅能优化机器学习模型,也能用来优化我们的人生。

确立目标

首先,人生要有目标。短期的目标也好,长期的目标也罢,总得有个方向。就像随机梯度下降有个目标函数一样,有了目标,才有了努力的意义。目标不需要一开始就完美,重要的是,有了这个目标,你就有了努力的动力。

设立宏大目标

目标不宜太简单。若目标轻易就能达到,那未免太过无聊。大目标,哪怕一时达不到,至少给你一个奋斗的方向。初期可以定些小目标,比如期末考个 80 分,但更长远的目标要宏大些,比如财富自由、创业成功。这些目标虽然看似遥远,但正是因为有了这些大目标,你才会不断进步。

持续努力

随机梯度下降的核心是简单而持续的努力。每一步,找到一个大致正确的方向,然后迈出一步。生活也是如此,每一步的努力,都是朝着目标迈进。关键在于,持续不断地迈步。哪怕步子小,只要一直走,总会离目标越来越近。

迎接变化

改变是痛苦的,但没有改变,就没有进步。生活中的每一步,都是在调整自己的方向和步伐。你可能会感到痛苦,但这是前进的必要过程。反之,过于舒适,可能意味着停滞不前。要时刻挑战自己,不断突破舒适区。

合理休息

生活中的步伐不宜太快,也不宜太慢。步伐太小,进展缓慢;步伐太大,容易疲惫。就像随机梯度下降中需要调整步长一样,生活中也需要合理的休息和调整。适时休息,可以让你更持久地前行。

广泛探索

前进的方向取决于你对世界的认识。如果你只在一个地方打转,那么目标可能过于简单,或者你陷入了舒适区。随机梯度下降中的"随机"提醒我们,要不断探索新的领域,接受挑战,尝试新的事物,这样才能找到更好的路径。

不急不躁

不必急于找到完美的方向和步伐。虽然有人进展迅速,但随机梯度下降告诉我们,前期的徘徊和探索是必要的。如果一开始就找到最优解,反而后期可能乏力。所以,不要急于求成,前期的探索是为了更好的前进。

重要的起点

起点确实重要。如果你起点较高,自然会少走很多弯路。但即便起点不高,只要持续努力,也能达到目标。不要过分在意起点,重要的是过程中的努力和调整。

坚持到底

即使起点较低,前方的道路也许更加坎坷,但只要坚持不懈,按照正确的方向前进,最终都会达到目标。遇到困难时,调整步伐,重新出发,总能找到前进的方向。

独特之路

每个人的目标和路径都是独特的。虽然大家可能有相似的目标,但每个人的经历和路径各不相同。要找到适合自己的道路,虽然每次的参数不同,但最终的目标相似。

简单为上

虽然有比随机梯度下降更复杂的算法,但面对复杂的人生目标,简单的方法往往更有效。关注当下,每次迈出小步,快速做出决定,持续前行。只要有目标,不停步,就能达到目的。

总结

生活就像随机梯度下降,不断调整方向,迈出步伐,最终达到目标。不要怕犯错,不要怕徘徊,只要坚持,总能找到前进的路。

抱个拳,总个结

回归算法,逻辑回归,决策树算法, 神经网络,K-means,梯度下降(本文)

- 科研为国分忧,创新与民造福 -

日更时间紧任务急,难免有疏漏之处,还请大侠海涵

内容仅供学习交流之用,部分素材来自网络,侵联删