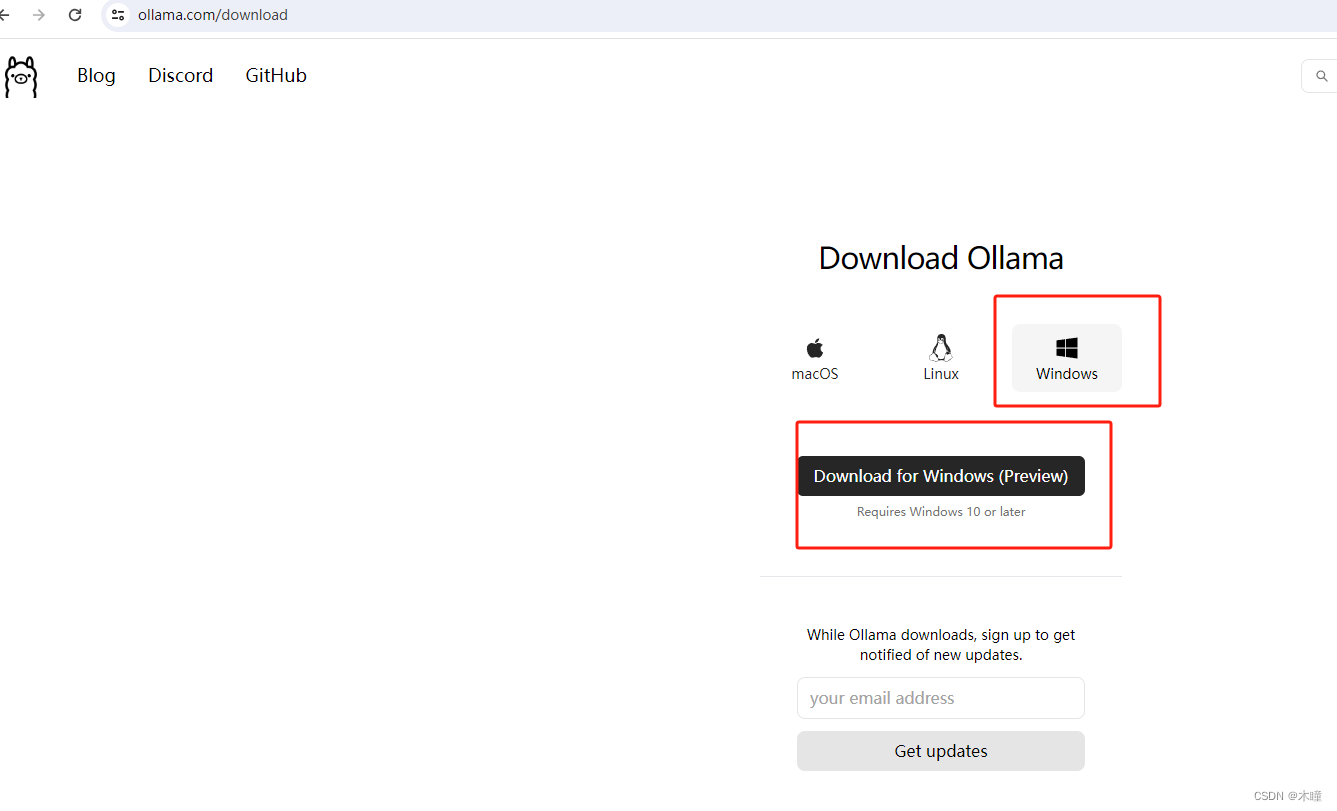

先来逛一下咱们的主角Ollama的官网地址:

大概长这个样子🤔

因为本地系统的原因,文章只提供Widows的安装方式,使用Linux和Mac的大佬,可以自行摸索🧐

下载完成后就是安装了🍕,安装完后就是大概这个样子⛅

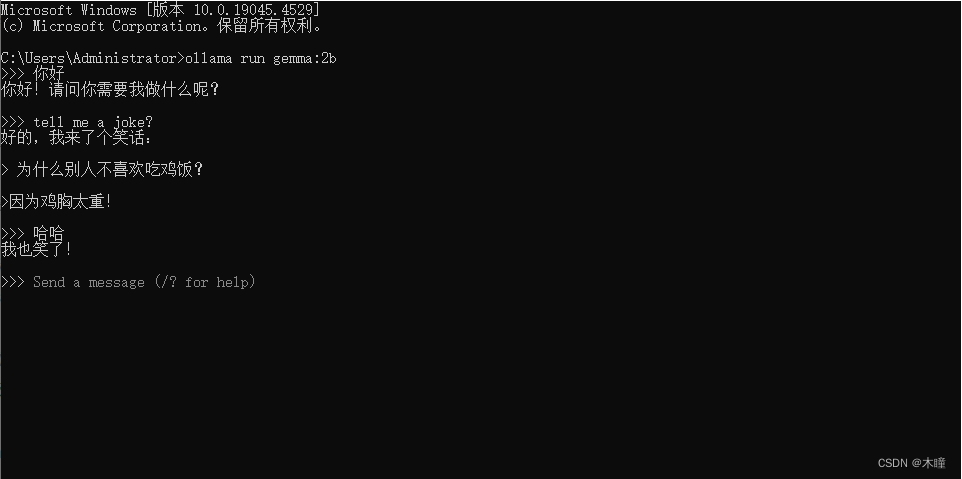

先打开cmd控制台黑窗口,下载个gemma:2b大模型耍一耍🐳

bashollama run gemma:2b这个命令执行后,会将大模型文件下载到本地,下载成功后,就可以愉快的和大模型聊天了,大概是这个样子🐞

如果单纯只拉取大模型到本地,不运行可以执行这个命令

bashollama pull gemma:2b删除本地大模型

bashollama rm gemma:2b

OK,Ollama在本地安装成功后,下一节咱们会脱离这个黑窗口,利用ollama提供的rest api接口利用Python语言与自然语言大模型进行交互。🦍