保存与加载

保存模型使用save_checkpoint接口,传入网络和指定的保存路径

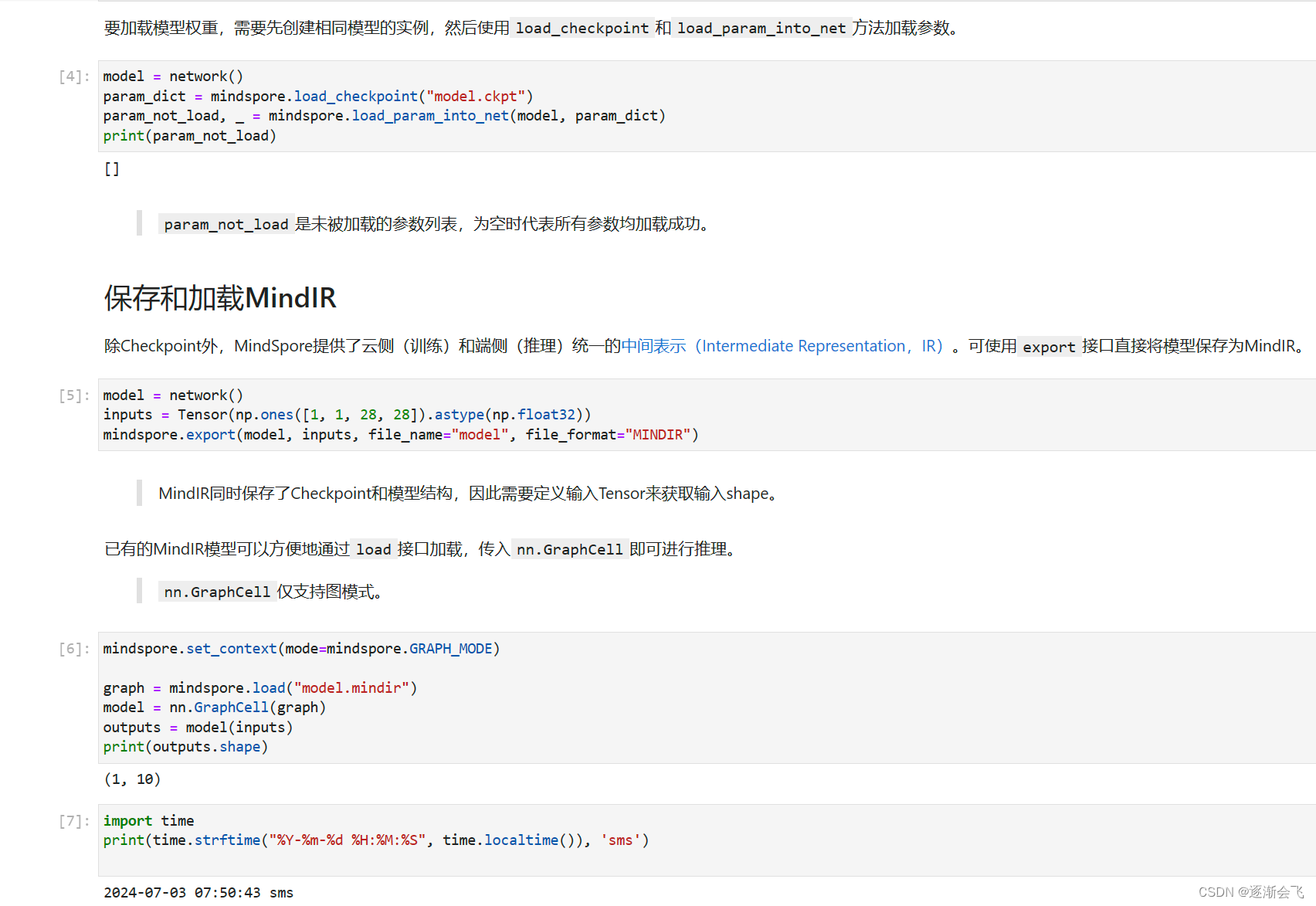

要加载模型权重,需要先创建相同模型的实例,然后使用load_checkpoint和load_param_into_net方法加载参数。

使用静态图加速

AI编译框架分为两种运行模式,分别是动态图模式以及静态图模式。MindSpore默认情况下是以动态图模式运行,但也支持手工切换为静态图模式。

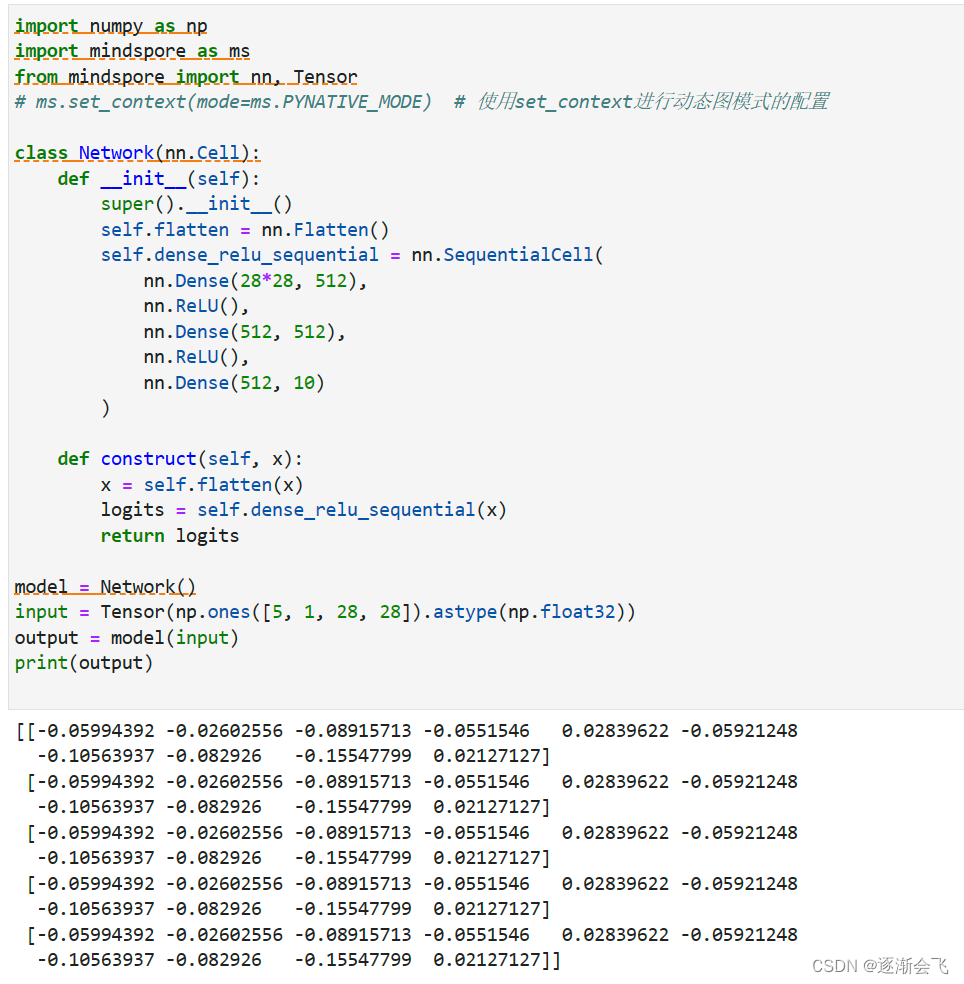

动态图模式

动态图的特点是计算图的构建和计算同时发生(Define by run),其符合Python的解释执行方式,在计算图中定义一个Tensor时,其值就已经被计算且确定,因此在调试模型时较为方便,能够实时得到中间结果的值,但由于所有节点都需要被保存,导致难以对整个计算图进行优化。

在MindSpore中,动态图模式又被称为PyNative模式。

python

import mindspore as ms

ms.set_context(mode=ms.PYNATIVE_MODE) # 使用set_context进行动态图模式的配置错误:

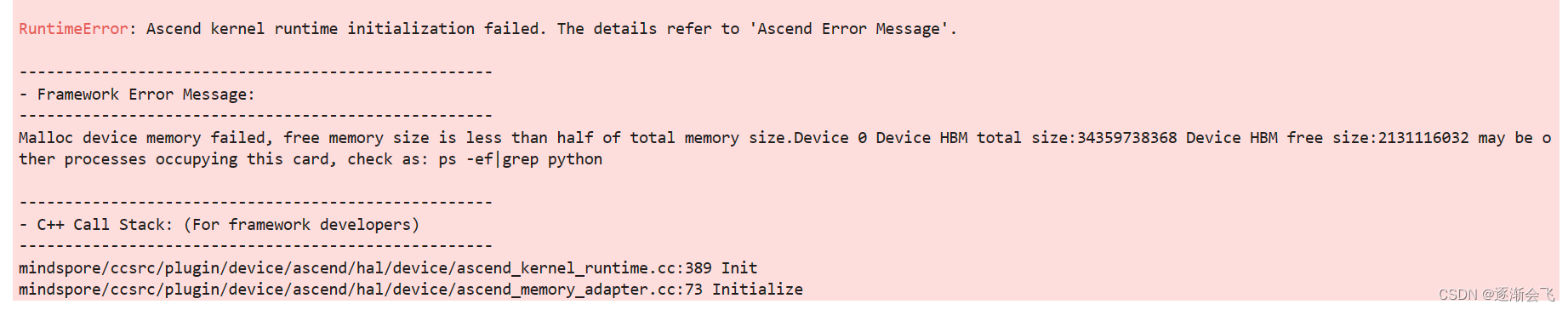

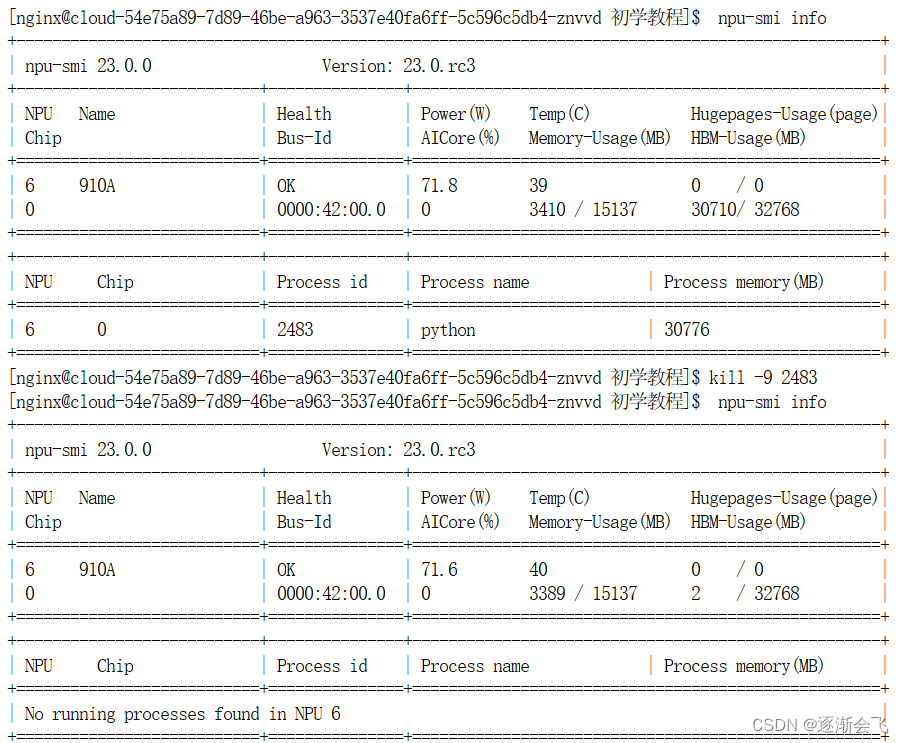

清理内存:

结果:

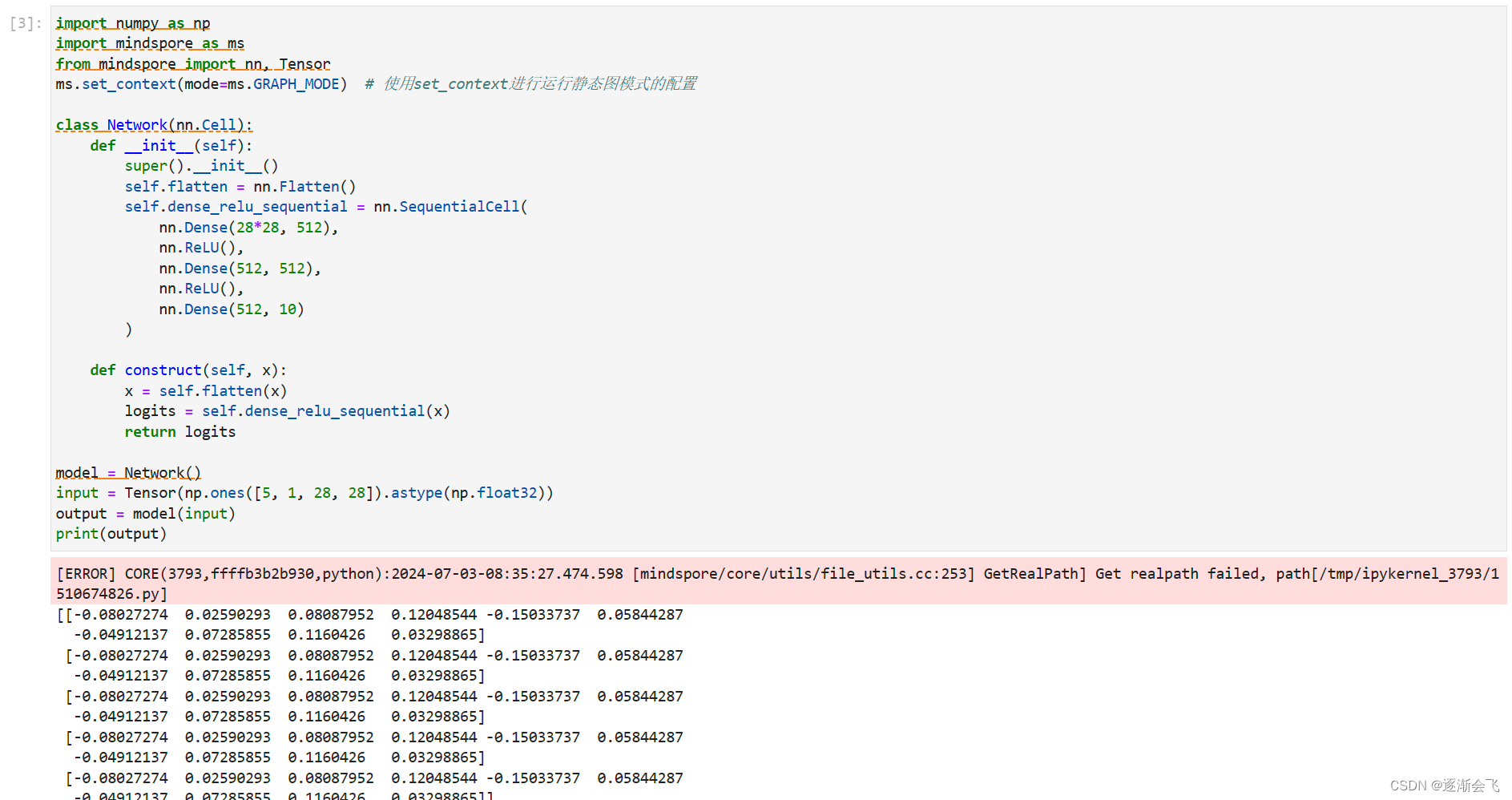

静态图模式

相较于动态图而言,静态图的特点是将计算图的构建和实际计算分开(Define and run)。

使用Graph模式设置

注意:静态图模式先编译后执行的模式导致其存在编译耗时。因此,如果函数无需反复执行,那么使用静态图加速也可能没有价值。

基于装饰器的开启方式

MindSpore提供了jit装饰器,可以通过修饰Python函数或者Python类的成员函数使其被编译成计算图,通过图优化等技术提高运行速度。此时我们可以简单的对想要进行性能优化的模块进行图编译加速,而模型其他部分,仍旧使用解释执行方式,不丢失动态图的灵活性。无论全局context是设置成静态图模式还是动态图模式,被jit修饰的部分始终会以静态图模式进行运行。

python

@ms.jit # 使用ms.jit装饰器,使被装饰的函数以静态图模式运行

def run(x):

model = Network()

return model(x)函数变换方式调用jit方法

ruby

def run(x):

model = Network()

return model(x)

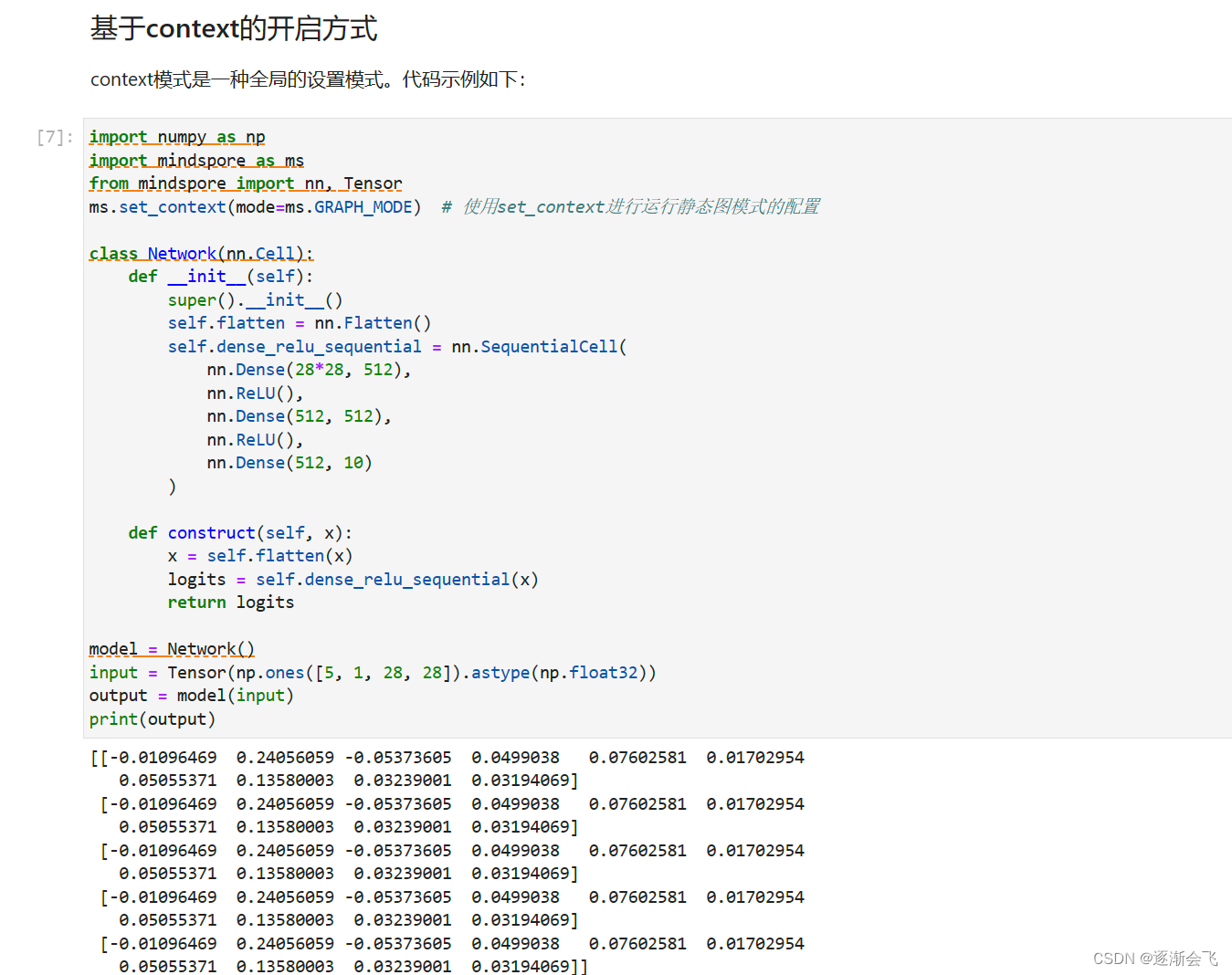

run_with_jit = ms.jit(run) # 通过调用jit将函数转换为以静态图方式执行基于context的开启方式