在安装深度学习及大模型微调环境时,经历了多次反复操作(如CUDA、cuDNN、PyTorch的安装与卸载)。为了避免走弯路,总结了以下步骤:

步骤 1:显卡驱动安装

首先在安装完Windows 11后,安装RTX 4090显卡的驱动。这是后续步骤的基础。请前往英伟达官网,下载并安装适用于您的显卡的最新驱动程序。

步骤 2:安装Ollama

在显卡驱动安装完成后,安装Ollama,安装后即可利用显卡性能进行大模型推理。

步骤 3:安装CUDA

在进行大模型微调时,需安装深度学习环境,包括CUDA。关键步骤如下:

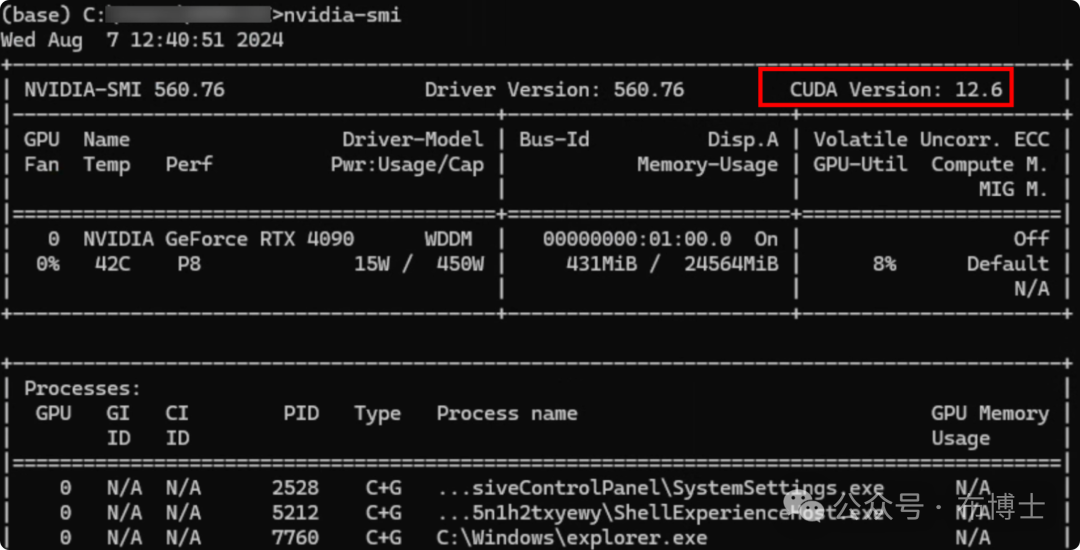

- 检查显卡支持的CUDA版本:在命令行中输入以下命令查看支持的CUDA版本:

nvidia-smi

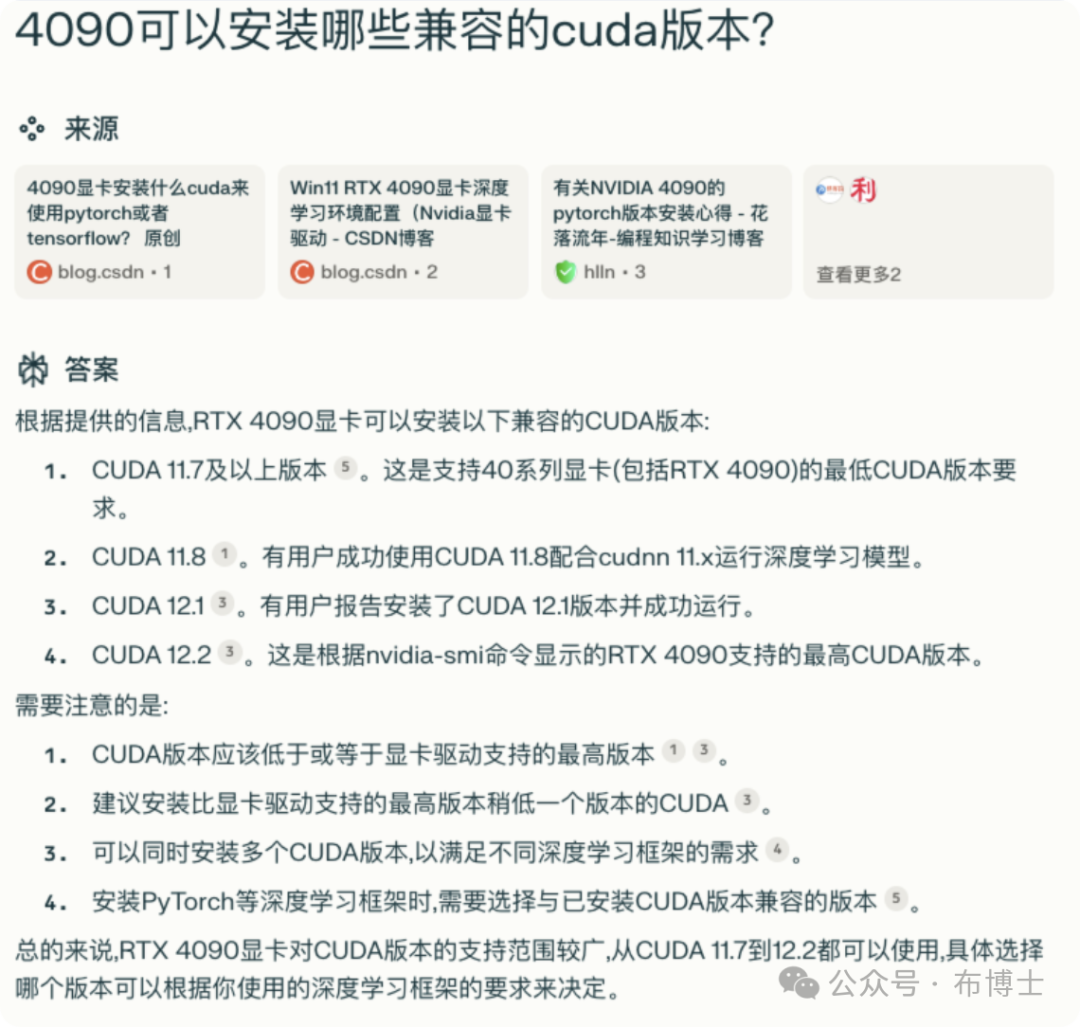

最大的坑是选择了不被支持的CUDA版本(如CUDA 12.6),导致PyTorch及TensorFlow都无法兼容4090显卡。因此选择低于12.6版本的CUDA。后来通过perplexity在线查询反馈上图中表示的是低于12.6版本的cuda都可以。

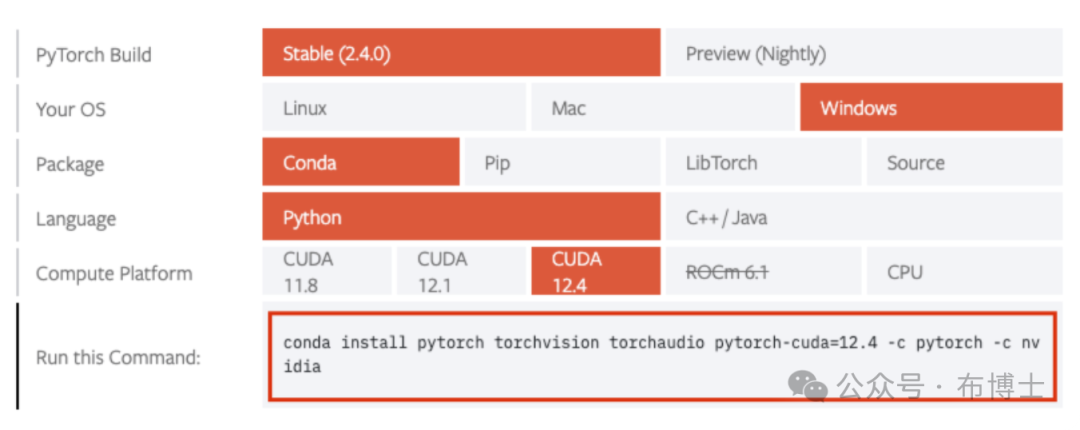

- 确认PyTorch兼容版本:由于是实验环境,因此我只考虑pytorch的兼容性,而没有考虑tensorflow。在 PyTorch官网(https://pytorch.org/get-started/locally/) 查询PyTorch支持的CUDA版本。最终选择CUDA 12.4与PyTorch 2.4.0,Python 3.10。

步骤 4:安装CUDA和cuDNN

前往英伟达官网,下载CUDA 12.4及相应的cuDNN版本。安装过程请参考这篇博客(https://blog.csdn.net/qq_40379132/article/details/124869378),其中详细介绍了安装步骤及系统环境变量的配置方法。

步骤 5:安装PyTorch

-

安装Miniconda:首先安装Miniconda。

-

创建虚拟环境:创建用于大模型开发的虚拟环境并激活该环境。

-

安装PyTorch:在激活的环境中,使用PyTorch官网提供的安装命令进行安装。推荐使用Conda安装方式,避免依赖包缺失问题。

conda install pytorch torchvision torchaudio cudatoolkit=12.4 -c pytorch步骤 6:验证安装成功

在Jupyter Notebook中运行以下代码,验证是否安装成功:

如上图:

-

true:代表cuda可用

-

0:代表当前设备编号,默认从0开始

-

1:gpu数量,本机只有一个4090

-

NVIDIA GeForce RTX 4090:代表第一个gpu名称

到此,恭喜安装完成。

注意:windows环境中,如果刚安装完,提示找不到dll文件之类的错误,建议重启,再执行如上代码。