小罗碎碎念

这篇文章介绍了语言模型在生物研究中的应用,提供了使用这些模型的最佳实践和资源,以促进生物学家利用AI技术解决复杂的生物学问题。

| 作者角色 | 姓名 | 单位名称(中文) |

|---|---|---|

| 第一作者 | Elana Simon | 斯坦福大学生物医学数据科学系 |

| 第一作者 | Kyle Swanson | 斯坦福大学计算机科学系 |

| 通讯作者 | James Zou | 斯坦福大学生物医学数据科学系、斯坦福大学计算机科学系、Chan-Zuckerberg Biohub(陈-扎克伯格生物中心) |

文章讨论了语言模型在人工智能(AI)和计算生物学中的日益重要的作用,特别是它们如何被应用于生物研究。这些模型能够学习序列中的复杂模式,比如句子中的单词或蛋白质中的氨基酸。文章主要面向对使用这些尖端AI技术感兴趣的生物学家,提供了最佳实践和关键资源的指导,以适应生物学的语言模型。

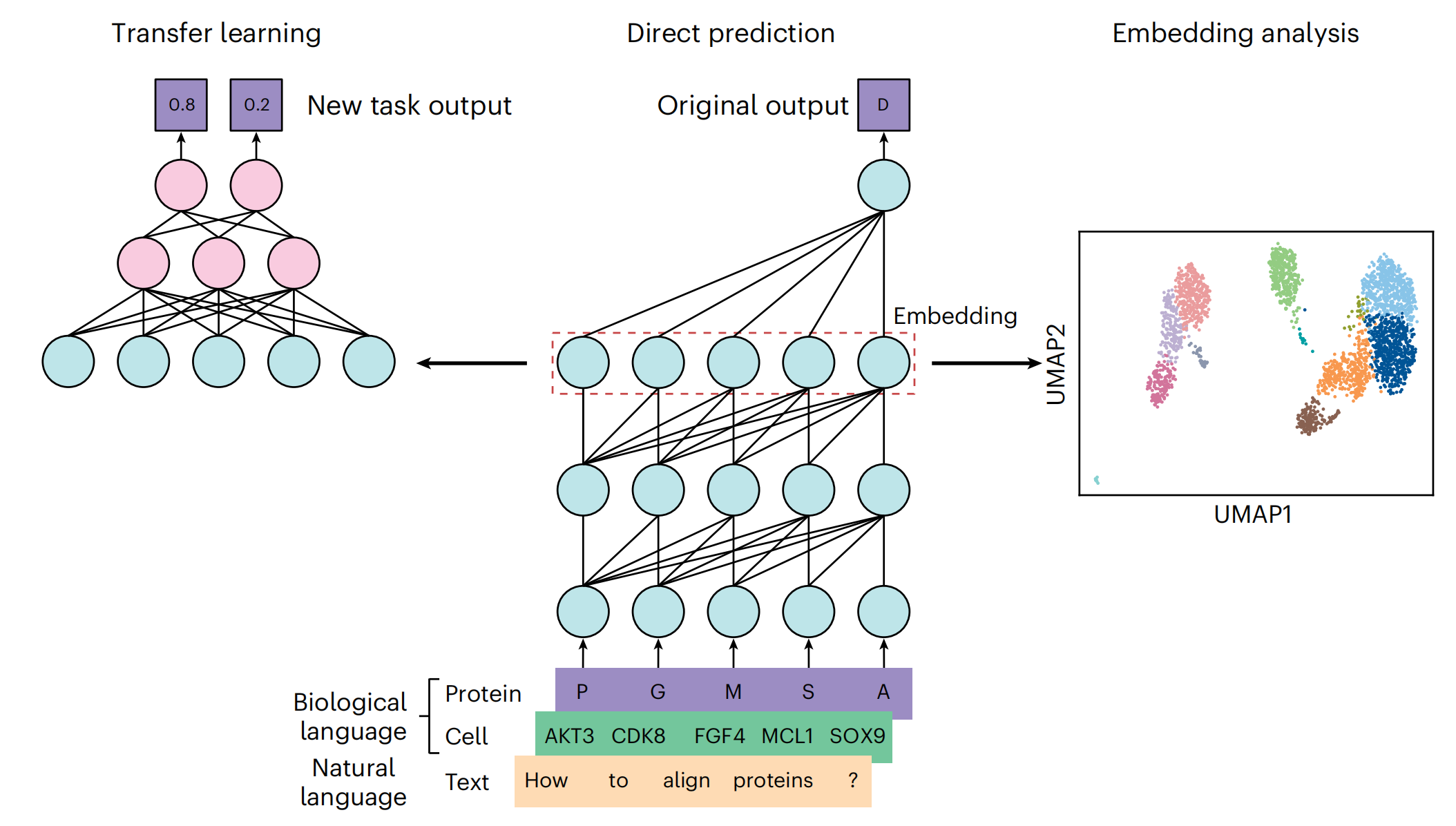

文章介绍了基于自然语言和生物序列的语言模型,它们都基于Transformer架构,这是一种能够捕捉长序列模式的人工神经网络。这些模型通常以无监督的、生成的方式进行训练,通过这一过程学习数据的底层规则。语言模型可以通过直接预测、嵌入分析和迁移学习三种常见方法应用于研究问题。

文章还讨论了自然语言模型在生物学中的应用,包括作为通用模型(如ChatGPT)和专业模型(如BioBERT),以及它们在理解生物文献、与软件交互(如编写和调试代码)等方面的应用。此外,文章还探讨了生物语言模型,如蛋白质语言模型和单细胞语言模型,它们在预测蛋白质稳定性、相互作用和设计具有特定结构的序列等方面的应用。

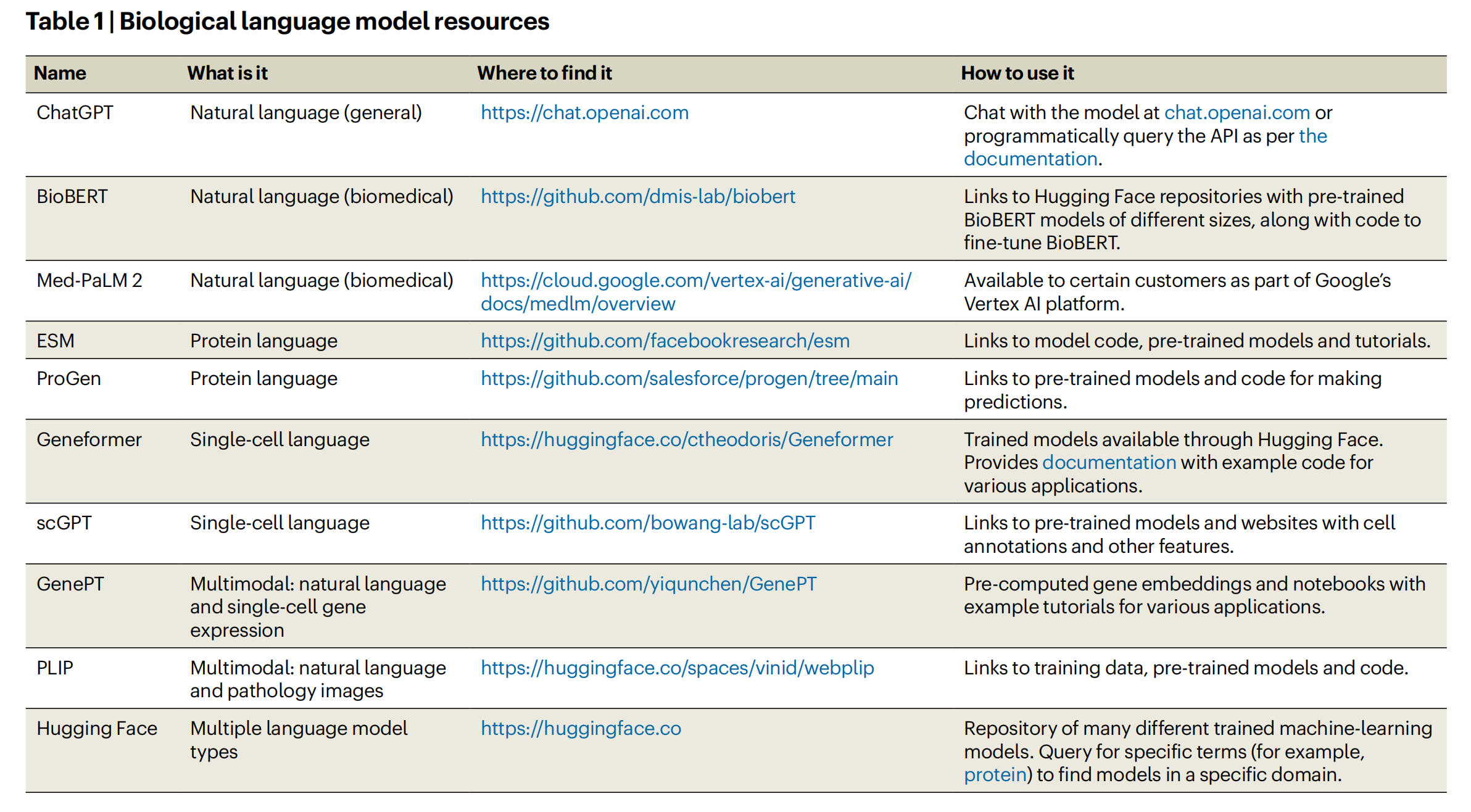

文章强调了使用语言模型进行生物学研究的最佳实践,包括何时使用每种方法以及考虑到当前模型限制时的注意事项。文章还提供了一些资源,如ChatGPT、BioBERT、Med-PaLM 2、ESM、ProGen、Geneformer、scGPT、GenePT和PLIP等,这些资源可以帮助研究人员在不同的生物学领域中应用语言模型。

最后,文章总结了语言模型在生物研究中的潜力,尽管它们在指导假设生成和帮助解释结果方面很有用,但它们也会犯错误,还不能取代实验验证。随着更多数据的生成和公开共享,预计语言模型将影响生物学中更多多样化的领域。

一、绪论

语言模型是一种人工智能,能够学习序列中的复杂模式,如句子中的单词或蛋白质中的氨基酸序列1。

近年来,由于开发了大规模、公开可访问的文本生成模型,如ChatGPT2,这些模型受到了广泛关注。这些模型在大型异构序列集合上训练,学会了灵活的模式,并能适应解决广泛的具体问题。

例如,ChatGPT最初被训练用于填补文本中的缺失单词,但该训练过程使其能够进行语言推理,并处理从总结论文到编写生物信息学代码等多种问题。此外,语言模型还能适应解决最初并未设计解决的问题,甚至超越专门针对这些问题训练的模型。

由于这种灵活性,语言模型通常被视为基础模型,支撑着广泛的下游应用。语言模型不仅限于自然语言(例如英语),还能处理生物语言,即由氨基酸3或基因4等生物实体组成的序列。

本文讨论的语言模型均基于Transformer架构5,这是一种能够捕捉长序列模式的人工神经网络(详见框1中的关键术语词汇表)。

例如,它可以学习到论文摘要是对后续文本的总结,以及蛋白质序列中相距较远的氨基酸之间的物理接触。这些模型通常以无监督、生成式的方式进行训练,意味着训练序列没有特定的标签供模型预测(无监督);相反,它学习再生训练输入序列(生成式)。通过这一生成过程,模型学会了支配数据形式的底层规则。

为了将这些模型定制用于其他目标,通常会在新数据上进一步训练已预训练的模型(微调)。

这一过程称为迁移学习,其中在较大数据集上的预训练使模型获得了数据的基本理解,从而在微调过程中更高效地学习新目标。

语言模型可应用于任何序列数据,无论序列的基本单位(称为token)是句子中的单词还是蛋白质中的氨基酸。尽管句子和蛋白质自然具有序列性,但是其他类型的生物数据也可以被构建成序列。

例如,单细胞基因表达数据通常不以序列形式表示,但可以通过创建一个基因序列来按其在细胞中的RNA表达水平顺序排列。通过将每个单细胞视为基因序列,生物语言模型可以使用这些序列作为输入,来模拟细胞间的单细胞RNA表达水平。在处理输入序列时,语言模型内部计算一个嵌入,这是输入的数值表示,能够简洁地捕捉其语义或功能属性。

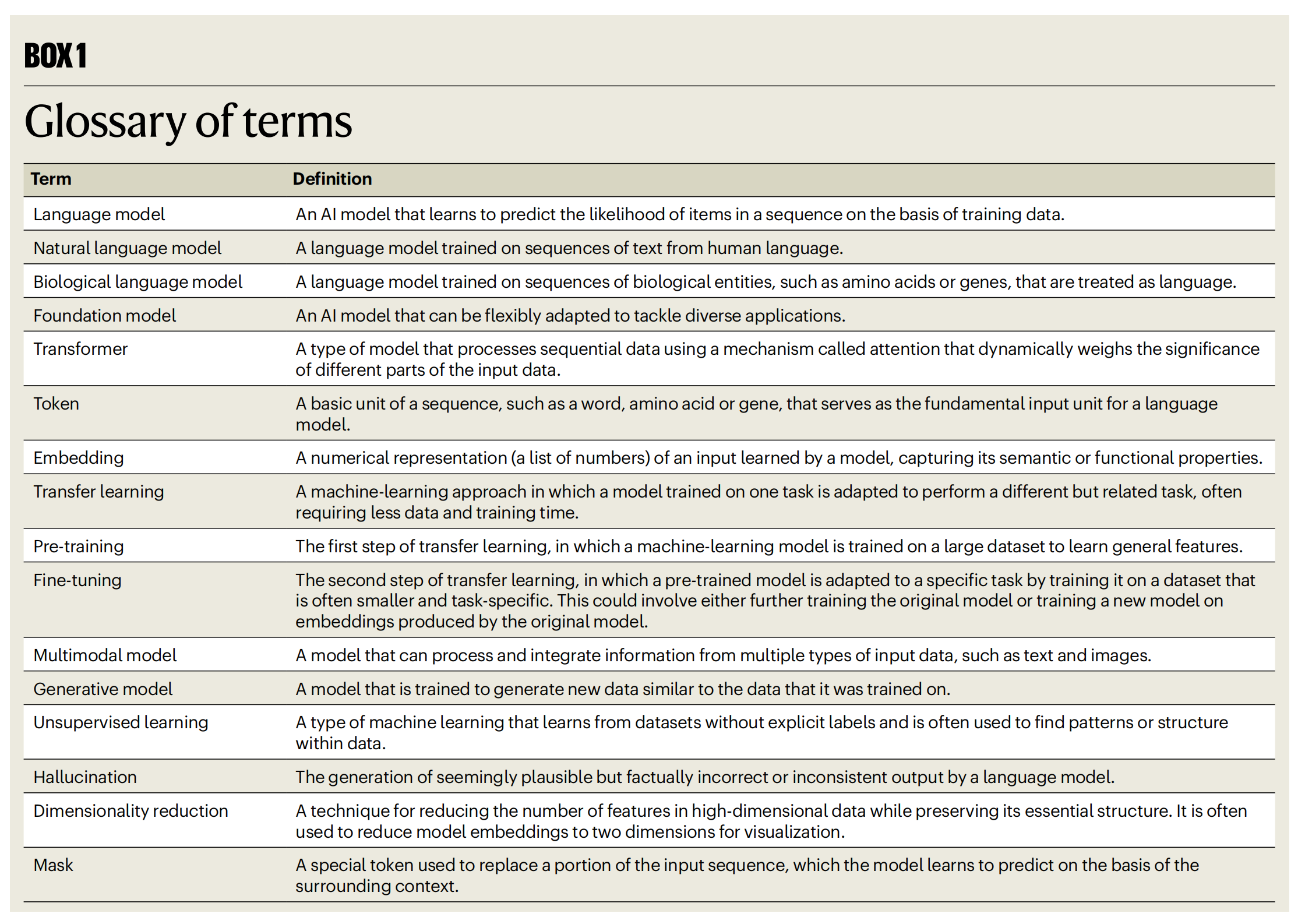

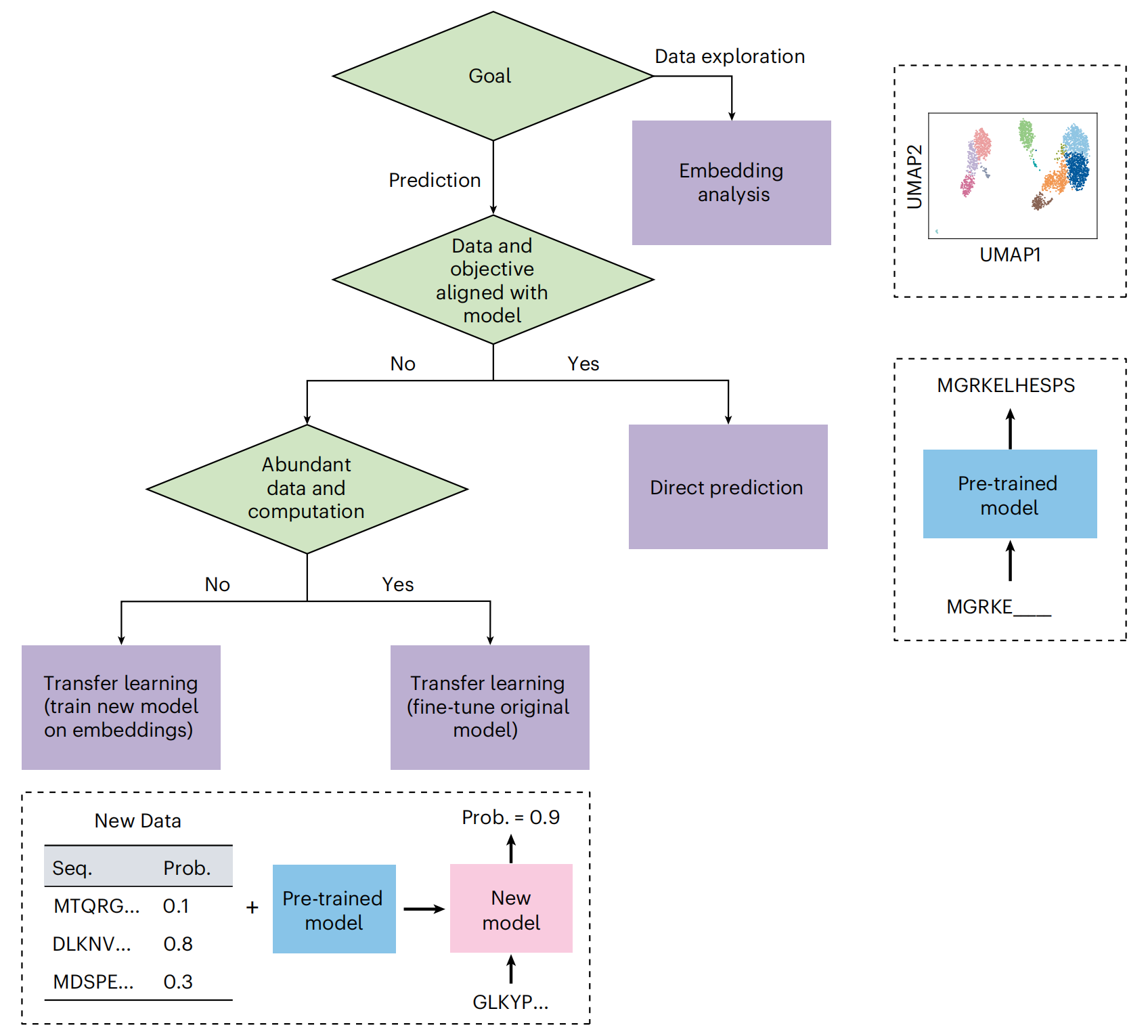

预训练的语言模型可以通过三种常见方法解决许多研究问题:直接预测、嵌入分析和迁移学习(图1)。

Fig. 1 展示了将语言模型应用于生物研究的三种方法:

-

迁移学习(Transfer Learning):

- 这是一种模型适应性训练的方法,其中预训练模型(已经在大量数据上训练过的模型)可能会进行一些修改(例如,扩展),然后进一步训练(微调)以解决模型最初未被训练解决的特定任务。这种方法适用于当研究任务与模型原始训练目标不完全匹配时,需要利用新数据对模型进行调整以适应新任务。

-

直接预测(Direct Prediction):

- 在这种方法中,模型直接应用于基于输入数据进行预测。例如,可以预测句子中的下一个单词。这是最简单的应用方式,模型使用其原始训练状态,直接对新的输入数据进行预测,而不进行任何额外的训练或调整。

-

嵌入分析(Embedding Analysis):

- 在这种方法中,模型计算输入的表示(即嵌入),这个嵌入是一个数值表示,能够捕捉输入的语义或功能属性。然后,这个嵌入可以用于分析,如降维和聚类。嵌入分析不直接进行预测,而是利用模型内部的数值表示来进行数据的分析和可视化。

这三种方法展示了语言模型在生物研究中的灵活性和多样性,它们可以处理自然语言(如英语)或生物语言(如单细胞数据中的基因序列或蛋白质序列),并将输入分解成单元(称为tokens,如单词或氨基酸),然后由模型进行处理。通过这些方法,语言模型能够帮助研究人员在生物信息学、基因表达分析、蛋白质工程等领域进行深入研究。

总结一下,直接预测方法最简单,即给语言模型一定的输入,直接用于做出预测。嵌入分析计算输入序列的嵌入,用于数据分析和可视化。

在迁移学习方法中,对与目标相关的全新数据进行额外训练。根据任务特定数据的可用性和计算资源,这可能涉及对原始语言模型的微调,或使用语言模型的嵌入训练新模型(这也被视为一种微调形式)。

二、自然语言模型在生物学中的应用

2-1:生物学研究中的自然语言模型介绍

尽管生物学从根本上依赖于物理实体------蛋白质、基因和细胞------的特征,但我们对这一领域的理解是通过科学论文、教科书、网页等自然语言文档记录的。因此,使用自然语言模型为生物学家提供便捷地访问这些文献资源中大量生物信息的方法,引起了越来越多的兴趣。

此外,自然语言模型可以结合来自其他模态的数据,如图像或基因序列,形成多模态模型6,从而为各种生物实体提供洞见。

下面,我们一起来探讨自然语言模型在生物学研究中的应用(主要使用直接预测方法)。

2-2:生物学中的通用型与专业型自然语言模型

自然语言模型可以训练为通用型模型(例如,ChatGPT2或Claude7),这些模型在包含生物源如PubMed的广泛文本语料库上进行训练。或者,它们可以被设计为专业型模型(例如,BioBERT8或Med-PaLM 2(参考文献9)),这些模型专门在生物文本上进行训练或微调。

当前的通用型模型在生物医学任务上,如回答医学考试问题,由于其广泛的知识10,可以胜过专业型模型。

2-3:用于理解生物文献的自然语言模型

自然语言模型的一个主要优势是它们能够在广泛的生物文献中进行推理,并将信息提炼成易于理解的回应。

例如,如果研究人员遇到一个不熟悉的技术概念(例如,多重序列比对),他们可以要求语言模型用简洁的段落解释该概念,而不必花时间查阅参考文献。

此外,研究人员可以根据自己的背景修改输入,以获得针对他们的回答(例如,"向具有初级生物学背景的人解释多重序列比对")。除了总结生物概念外,自然语言模型还可以帮助研究人员快速理解新的科学内容。

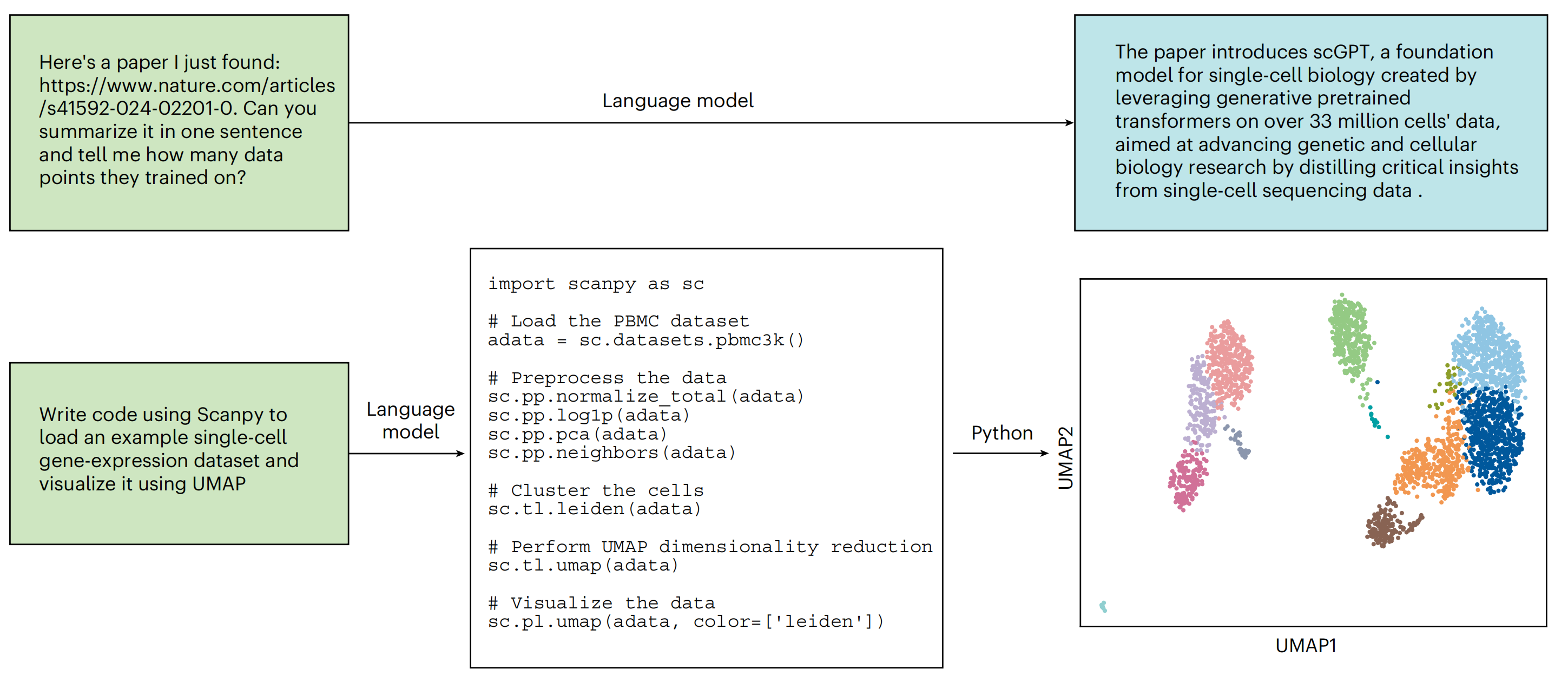

例如,科学家可以给语言模型一个新科学论文的链接,要求模型概括内容或回答关于其方法的具体技术问题(图2)。自然语言模型甚至可以根据现有研究文献提出新的生物医学研究想法(例如,利用AI处理多重序列比对的新方法)。

尽管自然语言模型是理解生物文献的强大工具,但它们的一个众所周知局限性是倾向于"虚构"11,即生成听起来连贯但包含事实错误的文本。

此外,这些模型可能不会批判性地评估它们处理的内容,可能只是反映作者的解释,而不质疑这些解释是否得到数据的支持。因此,核实自然语言模型输出的准确性,以及批判性地评估模型得出的任何结论,是至关重要的。

2-4:自然语言模型与软件交互

除了理解科学文献之外,自然语言模型还可以通过帮助科学家与软件交互,包括编写和调试代码,来加速研究进程。

自然语言模型蕴含了关于生物信息学分析的丰富知识,因此能够协助研究人员编写用于数据处理、结果分析、绘图等代码12。当研究人员对特定领域软件包不熟悉时(例如,单细胞分析的Scanpy),这些模型尤为有用,因为它们既知道何时使用这些软件包,也了解如何与每个软件包的各个组件进行交互(图2)。

Fig. 2 展示了自然语言模型在生物研究中的两个实际应用示例,这些示例通过与语言模型的对话形式呈现:

-

查询科学论文信息:

- 在顶部的示例中,用户向语言模型提出了一个关于科学论文的问题。语言模型(在这个案例中是ChatGPT的GPT-4模型)通过查找、阅读并总结论文内容来回应用户。这个过程展示了自然语言模型能够理解和处理大量科学文献的能力,为用户提供快速的信息获取和知识总结。

-

获取生物信息分析的示例代码:

- 在底部的示例中,用户请求一个生物信息分析的示例代码。语言模型提供了一段Python代码,这段代码可以用来生成数据的可视化分析。在这个例子中,语言模型(Claude 3)不仅理解了用户的需求,还提供了可以直接执行的代码,展示了自然语言模型在辅助生物信息学分析和软件开发中的潜力。

这两个示例说明了自然语言模型如何与用户交互,以及它们如何被用来解决生物研究中的实际问题。通过这些交互,研究人员可以更高效地获取信息、处理数据,并加速科学发现的过程。此外,这些示例还展示了语言模型在理解和生成自然语言方面的高级能力,以及它们在生物信息学和计算生物学中的潜在应用价值。

自然语言模型也是卓越的调试工具,可以接收损坏的代码及/或错误信息,并编写修正后的代码。此外,这些模型可以为原本需要领域专长的软件工具提供自然语言接口。

例如,ChemCrow13允许用户以自然语言提出问题(例如,"设计一个可溶性分子"),并修改用户的查询,使ChatGPT能够运行特定的化学软件工具(例如,分子合成规划)。这种能力使得更广泛的科学受众能够访问这些工具。

三、生物语言模型

自然语言模型旨在生成文本,而生物语言模型则训练生成生物数据序列(例如,氨基酸序列)。

本文探讨了两种强大的生物语言模型示例:蛋白质语言模型和单细胞语言模型。

3-1:蛋白质语言模型

大规模预训练的优势何在?

在大型蛋白质序列数据集上预训练的蛋白质语言模型能够学习到捕获进化约束和蛋白质关键属性的表示15。随后在较小标记数据集上对这些模型进行微调,可以准确预测下游任务,如稳定性、相互作用,甚至设计具有指定结构的序列。

蛋白质语言模型示例:ESM-2------ESM-2(参考文献3)是一种在超过2.5亿个蛋白质序列上进行训练的Transformer神经网络,可以预测周围上下文中随机掩码的氨基酸。在训练过程中,每个序列中的随机子集氨基酸被替换为伪"掩码"氨基酸,模型预测被掩码的原始氨基酸。

通过学习准确预测哪些氨基酸适合给定的序列上下文,模型学习到支配蛋白质结构和功能的模式和约束。正如存在大量自然语言模型一样,也有各种略微不同训练方式的蛋白质语言模型。

例如,一些蛋白质语言模型可能使用专注于单个蛋白质家族的数据进行训练,或者它们可能按顺序预测氨基酸,更类似于自然语言模型,而不是随机掩码氨基酸16,17。

应用:直接预测

这些模型可以按照其原始训练目标使用,直接预测每个氨基酸在序列中给定位置出现的概率。因为训练数据覆盖了已知功能蛋白质序列的全谱,这些模型有效地学习了蛋白质进化的模式。

无需实验测量突变的效果,模型可以隐式地学习哪些突变对蛋白质功能是有害的,因为这些突变根据进化过程中观察到的突变被视为不太可能发生。因此,这些预测可以开箱即用,用来估计蛋白质编码突变的影响18。

突变可能性可以通过专门掩码给定位置的正常氨基酸,并要求模型根据序列的其余部分推断掩码位置来获得。如果根据语言模型,突变比正常氨基酸的可能性更低,这表明突变可能是有害的。实验研究评估突变病原性已根据模型可能性验证了这些估计19。

将蛋白质序列建模为语言的一个优点是,这些序列不需要先前的对齐或注释20。语言模型对蛋白质序列可能性的估计还可以用来估计蛋白质序列是否可能形成功能结构,这使蛋白质语言模型能够评估和设计新序列21,22。

应用:嵌入分析

除了输出,蛋白质语言模型还提供了有用的蛋白质嵌入。

具体来说,当蛋白质序列通过模型运行时,可以提取模型内部对蛋白质中每个氨基酸的表示(嵌入)。每个氨基酸的嵌入可以单独使用,也可以组合成单个蛋白质表示。

例如,先前的工作发现,聚类蛋白质序列嵌入可以识别同源蛋白质。然后可以根据每个蛋白质中单个氨基酸嵌入之间的相似性,将这些同源蛋白质结构化为多重序列对齐23。

应用:迁移学习

从这些模型中学到的表示可以用来解决更具体的任务。因为微调蛋白质语言模型可能很昂贵,许多应用使用模型的嵌入作为输入,输入到另一个在下游任务上训练的较小模型。

例如,这些嵌入已被用于预测蛋白质稳定性24,病毒抗原突变的免疫逃逸25,以及使用少量标记数据预测错义变异的病原性26。

此外,还有更新的、更有效的微调技术,使计算资源较少的研究人员能够完全微调大型蛋白质语言模型27。

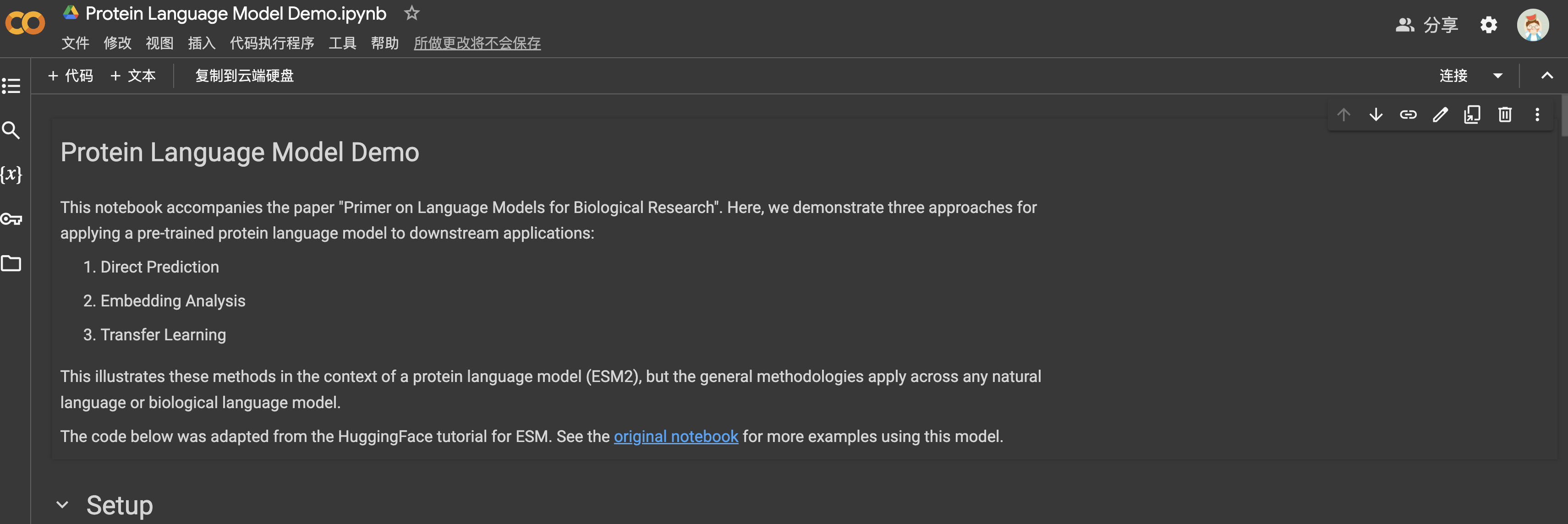

交互示例

为了展示蛋白质语言模型如何应用于各种下游任务,作者提供了一个交互式笔记本,其中包含使用ESM-2进行直接预测、嵌入分析和迁移学习的示例,可以通过Google Colab在浏览器中运行。

蛋白质结构模型

尽管蛋白质结构预测模型(如AlphaFold2(参考文献28)和ESMFold3)不是本文的重点,但值得一提,将结构信息与蛋白质序列结合训练模型,如蛋白质结构预测模型中所做的那样,可以提高蛋白质表示,用于各种下游任务。

像语言模型一样,蛋白质结构预测模型通过直接预测、嵌入分析和迁移学习,已被证明适用于广泛的下游应用。

3-2:单细胞语言模型

单细胞基因表达数据为理解单个细胞的细胞状态和功能提供了洞见,但其高维性使得解释具有挑战性。

近年来,人工智能方法的发展有助于分析这些复杂数据。公开可获得的单细胞基因表达数据的增长,使得可以在跨越多种细胞类型、组织、生物体和实验条件的数百万转录组上训练语言模型。

这些模型能够泛化到新数据集,并且可以针对各种下游任务进行微调,包括细胞类型注释和批次校正。

单细胞语言模型示例:Geneformer

Geneformer4是一种单细胞语言模型,与其他许多生物语言模型一样,它具有Transformer架构,训练目的是为许多下游应用提供基因和细胞的表示。

Geneformer将每个细胞表示为根据RNA表达水平排序的前2,048个表达基因的列表。其训练过程与之前描述的蛋白质语言模型相似,即掩码部分基因并训练模型预测缺失的基因。

为了正确预测按表达水平排序的缺失基因,模型必须理解各种基因表达水平之间的相互作用,并隐式学习特定于细胞类型的模式和上下文。Geneformer在涵盖40种组织类型的3000万个单细胞转录组上进行了训练,这有助于它学习多样的表达模式。

应用:直接预测

单细胞语言模型的直接输出使得可以进行各种创造性的体外实验。模型可以通过取单个细胞按表达排序的原始基因列表,修改基因的顺序,并量化这种变化如何影响输出,来估计遗传扰动对细胞的影响。

例如,Geneformer通过在细胞的基因排名顶部人工添加POU5F1、SOX2、KLF4和MYC,模拟了成纤维细胞的重新编程,从而在计算上使细胞向诱导多能干细胞状态转变。

类似地,单细胞语言模型可以通过从细胞的排名列表中人工删除基因,并检查对细胞嵌入的影响,来预测细胞对基因去除的敏感性。

应用:嵌入分析

单细胞语言模型包含每个基因的嵌入,这些嵌入可以组合(例如,平均)以创建每个细胞的单一表示。这些细胞嵌入可用于聚类、可视化和细胞类型标记。

由于训练数据的多样性和数量,这些模型可以在保持生物变异性的同时隐式减少批次效应,使得它们能够从包含许多实验批次的数据集中识别细微的细胞亚型4。

应用:迁移学习

尽管在这些嵌入中可以出现有意义的聚类,如细胞类型,但模型也可以微调以预测单个细胞的属性。例如,单细胞语言模型可以微调以跨实验条件整合数据,并预测细胞类型标签和细胞状态。

它们甚至可以支持基因的多模态表示。例如,scGPT可以微调以包括染色质可及性和蛋白质丰度以及基因表达水平,从而实现跨模态的数据集整合。

3-3:多模态生物语言模型

多模态模型能够在多种数据模态之间进行推理,如文本和图像,从而使这些模型能够解决本质上涉及不止一种数据类型的任务。

例如,病理学语言-图像预训练(PLIP)30在Twitter数据上进行了训练,以将病理学图像与其标题匹配,使用户能够为给定的图像获取标题或为给定的文本描述找到图像。

同样,Med-PaLM Multimodal31被训练用于基于生物医学图像回答问题,而MolT5(参考文献32)则被训练用于基于分子结构描述分子,包括其潜在生物学功能的信息。在有多模态数据点的足够示例的情况下,研究人员也可以训练其他类型的生物数据的多模态模型。

自然语言模型也可以在没有额外训练的多模态环境中应用,通过将生物文本的固定语言模型嵌入与来自其他领域的数据相结合。

GenePT33为单细胞数据提供了一个示例------利用语言模型的隐含基因组知识来嵌入细胞。

具体来说,GenePT首先使用ChatGPT嵌入来自NCBI的基因文本描述,然后通过将基于文本的基因嵌入加权平均单细胞表达来创建单细胞嵌入。

在某些应用中,这些从自然语言模型导出的嵌入与生物语言模型如Geneformer的嵌入相匹配或表现更佳。

类似的想法可以应用于生物学的其他领域;固定语言模型嵌入可以与来自另一种模态的数据或模型合并,而无需额外训练。

四、在生物学研究中使用语言模型的最佳实践

自然语言模型和生物语言模型在生物学研究中具有广泛的应用。

作者讨论了三种将这些模型应用于下游研究问题的方法:直接预测、嵌入分析和迁移学习。以下是作者确定适用于给定研究问题的方法的过程概述。最佳方法取决于研究问题本身,以及可用数据和计算资源。

图3展示了确定如何使用语言模型的主要决策点的简化工作流程。尽管这些规则并非绝对,但它们可以指导过程。

Fig. 3 展示了一个决策流程图,用于确定如何将语言模型适应于生物研究的不同方法。

这个流程图帮助研究人员根据他们的数据和研究目标选择最合适的方法来使用语言模型。以下是流程图的分析:

-

数据探索与预测目标:

- 首先,研究人员需要决定他们的研究目标是数据探索还是进行预测。如果目标是数据探索,比如理解数据的结构和模式,那么嵌入分析方法(Embedding Analysis)是合适的。这种方法可以通过语言模型生成的嵌入(embeddings)来可视化数据。

-

直接预测(Direct Prediction):

- 如果目标是进行预测,并且新问题的数据和目标与模型原始训练目标相匹配,那么可以直接使用直接预测方法。在这种情况下,可能需要对模型输入进行一些调整以优化预测结果。

-

迁移学习(Transfer Learning):

- 如果新问题与模型的原始训练目标不完全匹配,那么迁移学习方法是有益的。迁移学习有两种方式:

- 微调原始模型(Fine-tuning the original model):对原始的语言模型进行进一步的训练,使其适应新的特定任务。这种方法通常更强大,但需要更多的数据和计算资源。

- 训练新模型(Training a new model):使用语言模型生成的嵌入作为输入,训练一个新的、通常更小的模型来执行特定的任务。这种方法需要的资源较少,但可能不如微调原始模型强大。

- 如果新问题与模型的原始训练目标不完全匹配,那么迁移学习方法是有益的。迁移学习有两种方式:

这个流程图为研究人员提供了一个清晰的指导,帮助他们根据研究需求和资源限制选择最合适的语言模型适应方法。通过这种方式,研究人员可以更有效地利用语言模型来解决生物研究中的复杂问题。

首先,需要确定研究问题的目标。如果目标是数据探索,那么可以使用嵌入分析 approach,结合降维和聚类等技术,来揭示数据中的结构。然而,如果目标是从数据中做出预测,那么直接预测和迁移学习方法往往更有用。

如果问题基于模型的训练数据和目标匹配其固有能力,那么直接预测方法就适用,可能需要根据目标修改输入。如果项目目标与模型的能力偏差较大,或者有更具体于感兴趣任务的数据可用,那么迁移学习可能有用。

当有足够的数据和计算资源时,最佳方法可能是对部分或全部语言模型进行微调。然而,如果数据或计算资源有限,另一种方法是使用语言模型计算新数据点的嵌入,并将这些嵌入作为输入来训练一个单独的、通常更小的模型。

此外,一些模型仅作为网络界面或应用程序编程接口(API)提供,这可能限制它们仅用于直接预测。具有开源代码和训练模型参数的其他模型可以用于嵌入分析或迁移学习。

语言模型可以通过多种机制进行访问和适应。

例如,一些模型有用户友好的网络界面,可以在其中进行预测。在其他情况下,可以从Hugging Face或GitHub下载代码和训练好的模型。一些模型附有Jupyter笔记本或Google Colab笔记本,展示了如何将预训练模型用于各种应用。

当没有这些笔记本时,包含模型代码的GitHub仓库通常有文档或示例代码可供参考。作者在这里讨论的一些应用已经有这样的网站和笔记本可供使用(表1)。

尽管语言模型非常强大,但它们存在重要的局限性,用户应当了解。

首先,语言模型仍无法完美解决许多生物学问题,即使是它们最初被训练解决的问题。这可能是由于模型的局限性,可能无法学习所有支配训练数据的模式,以及训练数据的局限性。训练数据可能过时或含噪声,并且可能在某些类型的数据中存在数据缺口。

例如,自然语言模型仅包含其训练数据中的生物学知识,因此它们将不知道训练后发现的成果。蛋白质语言模型通常在标准氨基酸上训练,因此无法在输入表示中反映任何翻译后修饰的重要性。

单细胞表达数据可能含噪声,资金优先级可能导致数据量偏向特定的组织类型和疾病状态,这些因素都可能影响模型性能。此外,针对特定生物学应用定制的模型有时仍能胜过生物语言模型,特别是当先验知识可以告知模型设计时。

例如,包含蛋白质结构信息的方法已被证明胜过在蛋白质序列上训练的语言模型34,35。最后,评估适应其他任务的语言模型的性能也需要谨慎。语言模型是在大量可能未公开共享的数据上训练的,因此确保语言模型的训练数据与下游任务的测试数据之间没有数据泄露是一个挑战。

五、代码可用性

作者关于蛋白质语言模型的交互式示例代码是可用的,并且可以在Google Colab上运行。

相同的代码以及相关数据也可在GitHub上获得。