GPUStack 是一个设计用于运行大模型的开源 GPU 集群管理器,提供私有部署的大模型服务,支持大语言模型、Embedding 文本嵌入模型、Reranker 重排序模型、Vision 多模态模型等各种模型。它可以聚合不同平台(如 Apple Macbook、Windows PC 和 Linux 服务器)的 GPU,构建一个统一的异构 GPU 集群。

在 Linux 中十分推荐使用 Docker 方式安装 GPUStack,可以避免很多依赖和冲突问题,简化安装过程。

今天带来一篇关于如何设置 NVIDIA 容器运行时并使用容器方式运行 GPUStack 的操作教程。

前置准备

验证当前环境有 NVIDIA GPU 硬件:

shell

lspci | grep -i nvidia验证系统已安装 GCC:

shell

gcc --version安装 NVIDIA 驱动

参考:https://developer.nvidia.com/datacenter-driver-downloads

为当前内核安装内核头文件和开发包:

shell

sudo apt-get install linux-headers-$(uname -r)安装 cuda-keyring 包:

shell

wget https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2204/x86_64/cuda-keyring_1.1-1_all.deb

sudo dpkg -i cuda-keyring_1.1-1_all.deb安装 NVIDIA 驱动:

shell

sudo apt-get update

sudo apt-get install nvidia-open -y重启系统:

shell

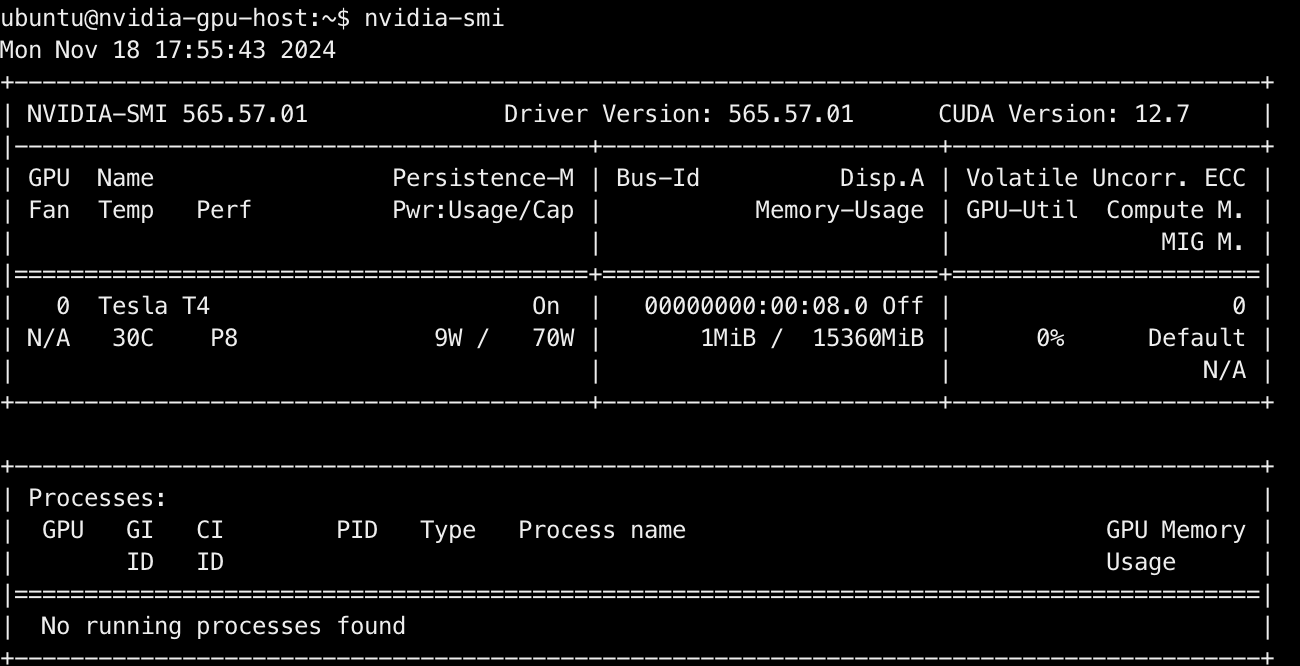

sudo reboot重新登录并检查 nvidia-smi 命令可用:

shell

nvidia-smi

安装 Docker Engine

参考:https://docs.docker.com/engine/install/ubuntu/

执行以下命令卸载所有冲突的包:

shell

for pkg in docker.io docker-doc docker-compose docker-compose-v2 podman-docker containerd runc; do sudo apt-get remove $pkg; done设置 Docker 的 apt 仓库:

shell

# Add Docker's official GPG key:

sudo apt-get update

sudo apt-get install ca-certificates curl

sudo install -m 0755 -d /etc/apt/keyrings

sudo curl -fsSL https://download.docker.com/linux/ubuntu/gpg -o /etc/apt/keyrings/docker.asc

sudo chmod a+r /etc/apt/keyrings/docker.asc

# Add the repository to Apt sources:

echo \

"deb [arch=$(dpkg --print-architecture) signed-by=/etc/apt/keyrings/docker.asc] https://download.docker.com/linux/ubuntu \

$(. /etc/os-release && echo "$VERSION_CODENAME") stable" | \

sudo tee /etc/apt/sources.list.d/docker.list > /dev/null

sudo apt-get update安装 Docker:

shell

sudo apt-get install docker-ce docker-ce-cli containerd.io docker-buildx-plugin docker-compose-plugin -y检查 docker 命令可用:

shell

docker info安装 NVIDIA Container Toolkit

参考:https://docs.nvidia.com/datacenter/cloud-native/container-toolkit/latest/install-guide.html

配置 NVIDIA Container Toolkit 的生产仓库:

shell

curl -fsSL https://nvidia.github.io/libnvidia-container/gpgkey | sudo gpg --dearmor -o /usr/share/keyrings/nvidia-container-toolkit-keyring.gpg \

&& curl -s -L https://nvidia.github.io/libnvidia-container/stable/deb/nvidia-container-toolkit.list | \

sed 's#deb https://#deb [signed-by=/usr/share/keyrings/nvidia-container-toolkit-keyring.gpg] https://#g' | \

sudo tee /etc/apt/sources.list.d/nvidia-container-toolkit.list安装 NVIDIA Container Toolkit:

shell

sudo apt-get update

sudo apt-get install -y nvidia-container-toolkit -y使用 nvidia-ctk 命令配置容器运行时:

shell

sudo nvidia-ctk runtime configure --runtime=docker检查 daemon.json 文件的配置:

shell

cat /etc/docker/daemon.json重启 Docker daemon:

shell

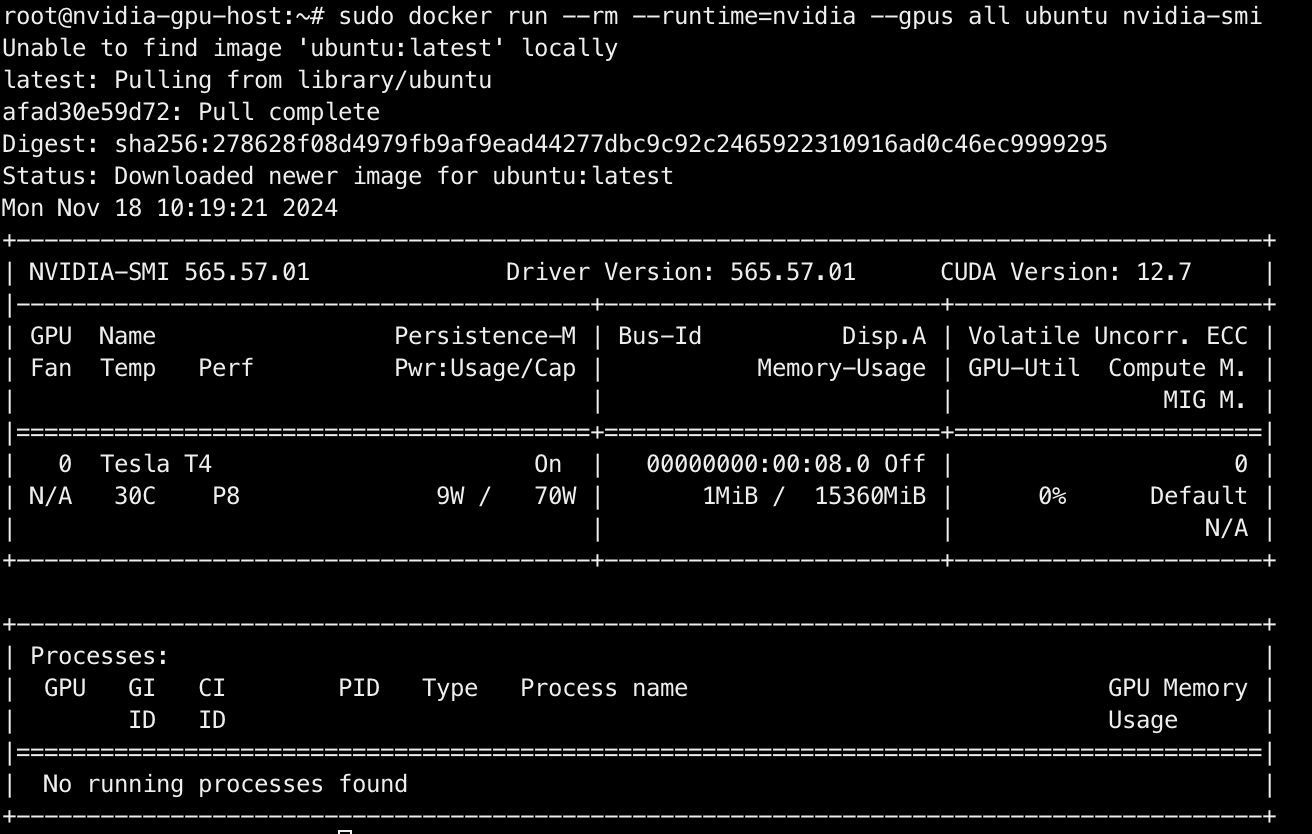

sudo systemctl restart docker运行一个示例的 CUDA 容器来验证安装:

shell

sudo docker run --rm --runtime=nvidia --gpus all ubuntu nvidia-smi

安装 GPUStack

参考:https://docs.gpustack.ai/latest/installation/docker-installation/

通过 Docker 安装 GPUStack:

shell

docker run -d --gpus all -p 80:80 --ipc=host --name gpustack \

-v gpustack-data:/var/lib/gpustack gpustack/gpustack使用以下命令查看登录密码:

shell

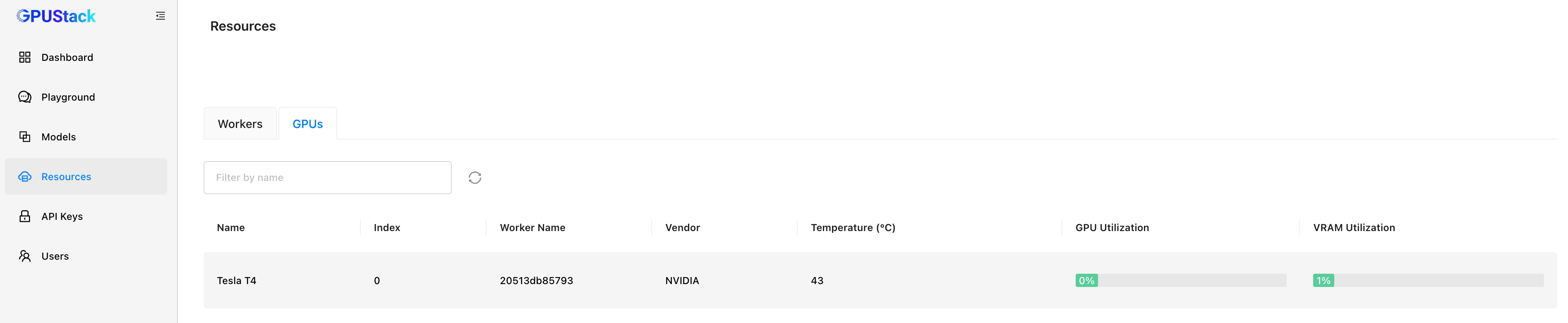

docker exec -it gpustack cat /var/lib/gpustack/initial_admin_password在浏览器访问 GPUStack( http://YOUR_HOST_IP )以用户名 admin 和密码登录。设置密码后,登录进 GPUStack,查看识别到的 GPU 资源:

(可选)要添加额外的 Worker 节点,构建 GPU 集群,在其它工作节点上执行以下命令:

bash

docker run -d --gpus all --ipc=host --network=host \

gpustack/gpustack --server-url http://YOUR_HOST_IP --token YOUR_TOKEN将其中的 http://YOUR_HOST_IP 替换为你的 GPUStack 访问地址,将 YOUR_TOKEN 替换为用于添加 Worker 的认证 Token。要从 GPUStack Server 检索 Token,使用以下命令:

bash

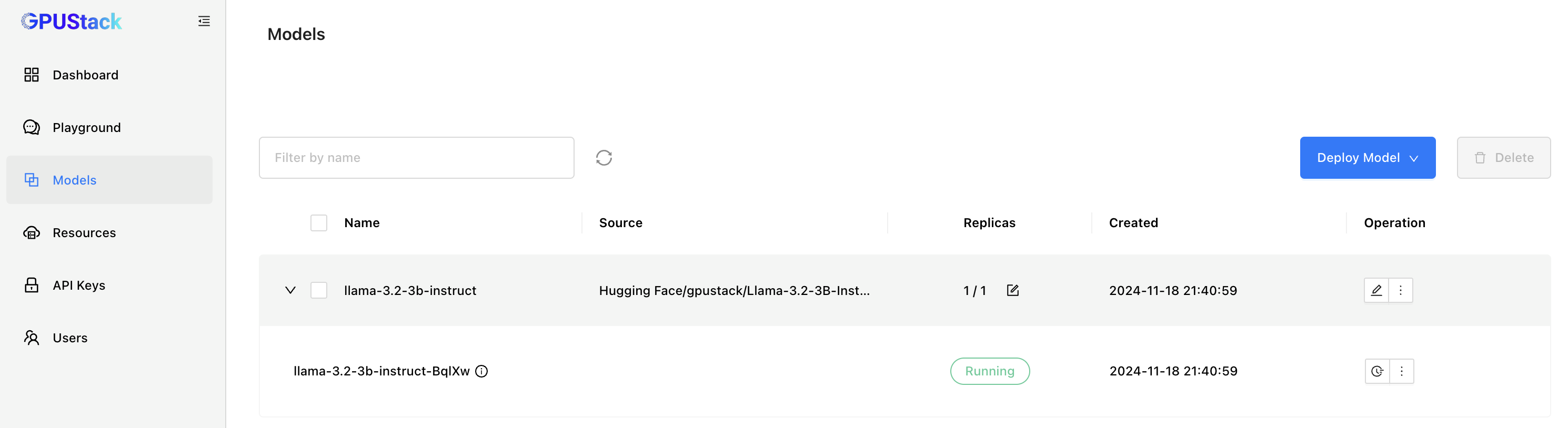

docker exec -it gpustack cat /var/lib/gpustack/token完成之后,尝试从 Hugging Face 或其它模型仓库部署模型:

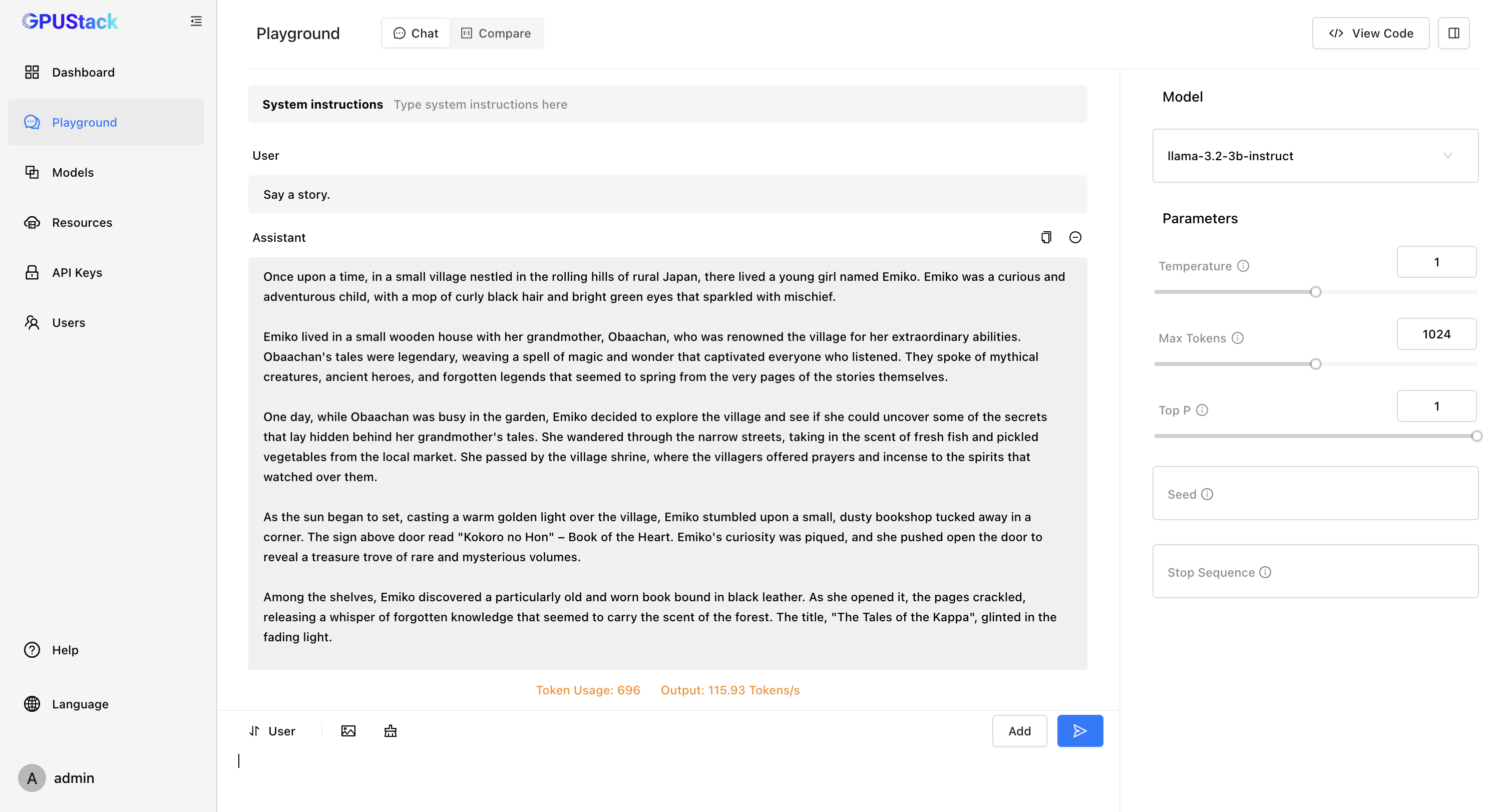

在 Playground 中调测模型:

加入社区

以上为配置 NVIDIA 容器运行时环境并使用容器方式运行 GPUStack 的操作教程。

对 GPUStack 感兴趣或者在使用过程中遇到问题,可以添加 GPUStack 微信小助手(微信号:GPUStack)入群交流。

如果觉得写得不错,欢迎点赞 、转发 、关注。