- 操作系统:ubuntu22.04

- IDE:Visual Studio Code

- 编程语言:Python 3.10

LLaMA-Factory 简介

LLaMA-Factory 是一个开源的 全栈大模型微调框架,支持从预训练到指令微调(SFT)、强化学习(RLHF)等全流程训练。其核心特点包括:

- 支持多种模型:Llama、LLaMA-3、Mistral、Qwen、Baichuan、ChatGLM 等。

- 灵活的微调方法:全参数微调(Full)、冻结微调(Freeze)、LoRA、QLoRA 等。

- 低资源训练:通过量化(INT4/INT8)和高效算法(如 GaLore、Unsloth)降低显存占用。

- 可视化界面:提供 llamafactory-cli webui 的网页界面,方便非开发者快速上手。

- 部署与推理:支持 API、Gradio Web 界面和命令行推理。

为什么学习 LLaMA-Factory

1.自从有了大模型后,不管企业还是个人都对大模型有了强烈的需求,通过公网访问这些大模型比如deepseek或者通义千问,用户担心隐私泄露,不愿意在公网上上传自己的私有数据,从而有了私有化部署大模型的需求。

2.用户可能会希望给大模型喂上自己的数据,这样就能对你的提问有了准确的回答,尤其是企业内部的一些数据,或者一些比较专业的行业数据。

- LLaMA-Factory 就能实现大模型微调,添加进去自己的数据进去。而且不需要重新训练大模型。

LLaMA-Factory 安装

1.先创建一个anaconda环境llama_factory

bash

conda create -n llama_factory python=3.10如下图:

2.进入llama_factory环境

2.进入llama_factory环境

bash

conda activate llama_factory

3.在github上下载llama_factory

bash

git clone --depth 1 https://github.com/hiyouga/LLaMA-Factory.git进入到目录:

bash

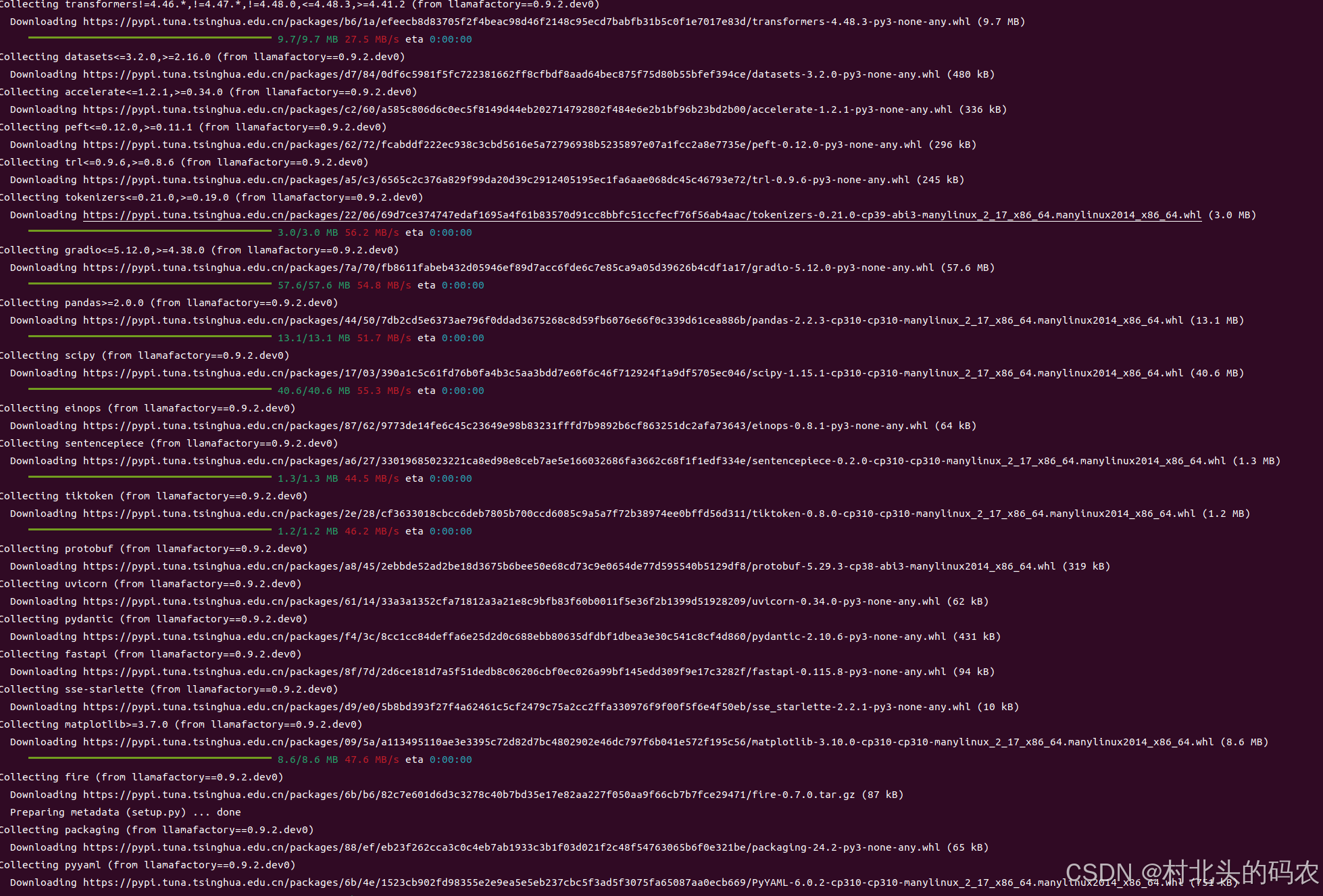

cd LLaMA-Factory4.安装 LLaMA Factory 相关依赖

bash

pip install -e ".[torch,metrics]"

5.检验是否安装成功

bash

llamafactory-cli version输出:

bash

----------------------------------------------------------

| Welcome to LLaMA Factory, version 0.9.3.dev0 |

| |

| Project page: https://github.com/hiyouga/LLaMA-Factory |

----------------------------------------------------------表示安装成功

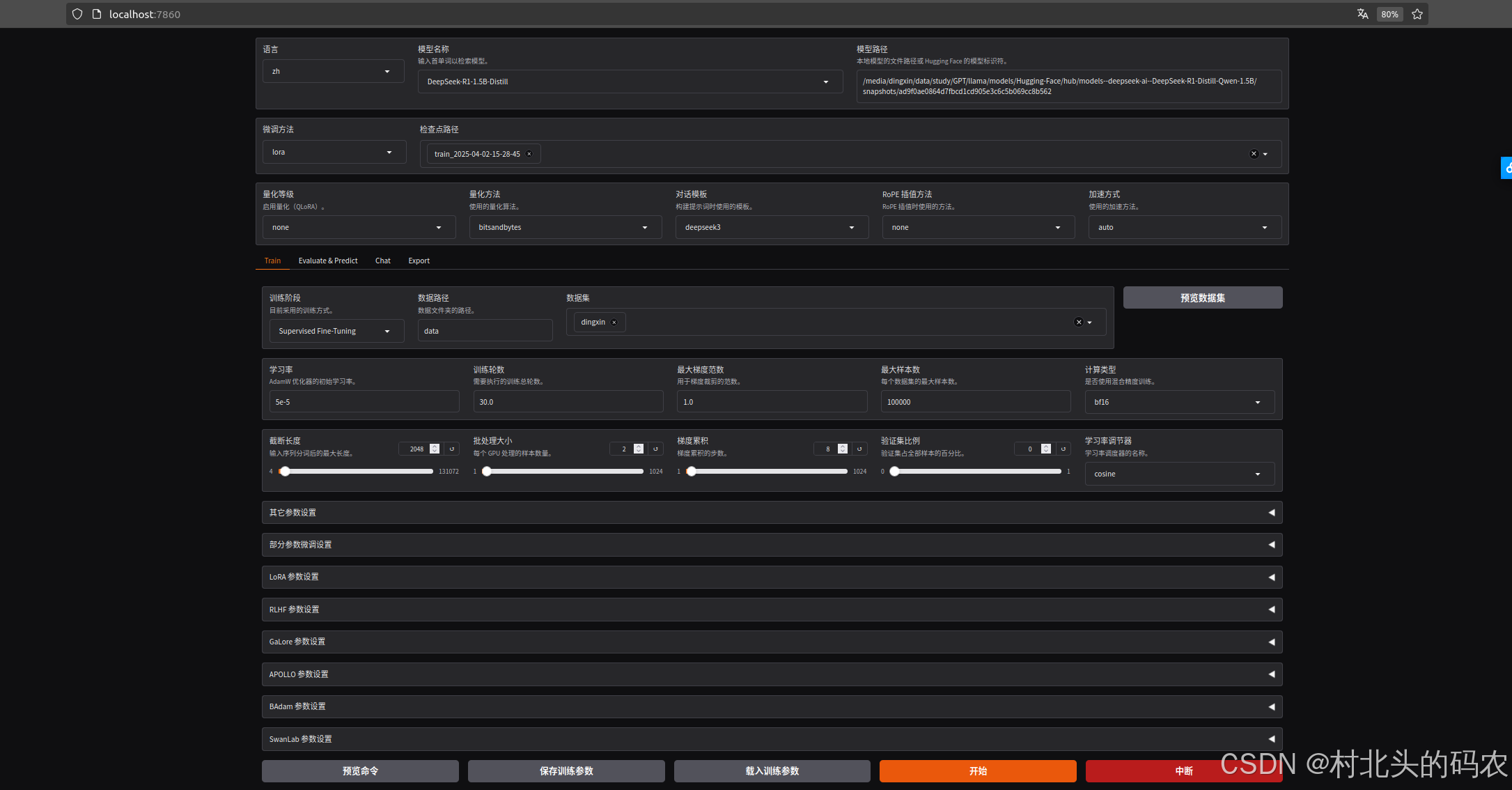

LaMA Board 可视化微调(由 Gradio 驱动)

bash

llamafactory-cli webui会跳出webui的界面,如下图: