Spark-Core编程(二)

RDD转换算子

RDD 根据数据处理方式的不同将算子整体上分为 Value 类型、双 Value 类型和 Key-Value 类型

Value类型

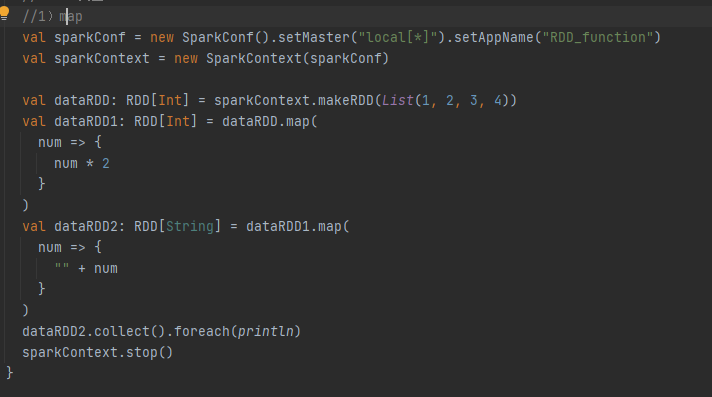

1)map

将处理的数据逐条进行映射转换,这里的转换可以是类型的转换,也可以是值的转换

实例:

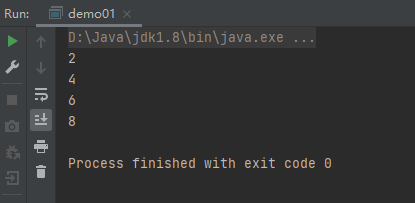

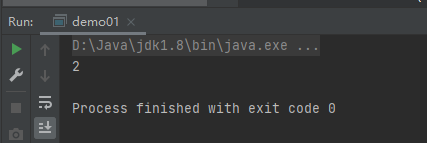

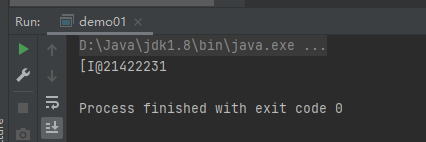

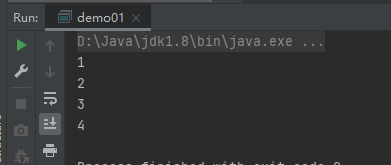

运行结果:

2)mapPartitions

将待处理的数据以分区为单位发送到计算节点进行处理,这里的处理是指可以进行任意的处理,哪怕是过滤数据

实例:

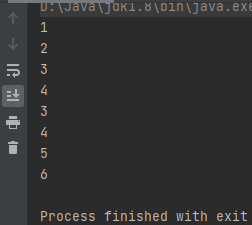

运行结果:

map和mapPartitions 的区别

1.Map 算子是分区内一个数据一个数据的执行,类似于串行操作。而 mapPartitions 算子是以分区为单位进行批处理操作

2.Map 算子主要目的将数据源中的数据进行转换和改变。但是不会减少或增多数据。MapPartitions 算子需要传递一个迭代器,返回一个迭代器,没有要求的元素的个数保持不变,所以可以增加或减少数据

3.Map 算子因为类似于串行操作,所以性能比较低,而是 mapPartitions 算子类似于批处理,所以性能较高。但是 mapPartitions 算子会长时间占用内存,那么这样会导致内存可能不够用,出现内存溢出的错误。所以在内存有限的情况下,不推荐使用

3)mapPartitionsWithIndex

将待处理的数据以分区为单位发送到计算节点进行处理,这里的处理是指可以进行任意的处理,哪怕是过滤数据,在处理时同时可以获取当前分区索引

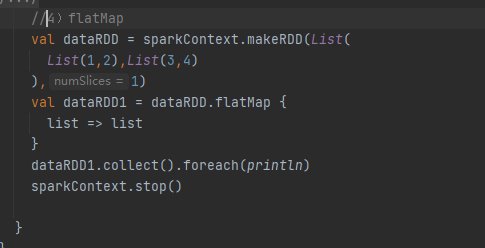

4)flatMap

将处理的数据进行扁平化后再进行映射处理,所以算子也称之为扁平映射

实例:

运行结果:

map和flatMap的区别:

map会将每一条输入数据映射为一个新对象

flatMap包含两个操作:会将每一个输入对象输入映射为一个新集合,然后把这些新集合连成一个大集合

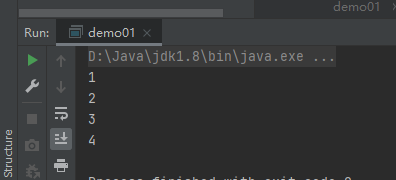

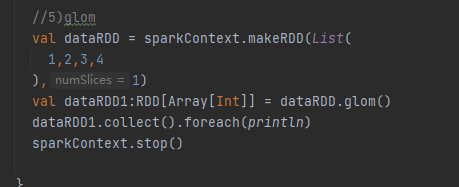

5)glom

将同一个分区的数据直接转换为相同类型的内存数组进行处理,分区不变

实例:

运行结果:

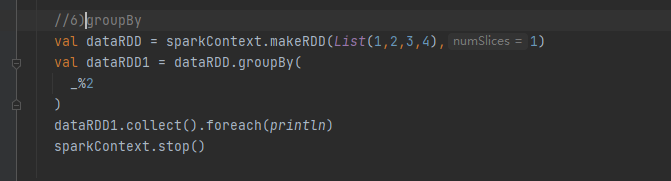

6)groupBy

将数据根据指定的规则进行分组, 分区默认不变,但是数据会被打乱重新组合,我们将这样的操作称之为 shuffle。极限情况下,数据可能被分在同一个分区中

实例:

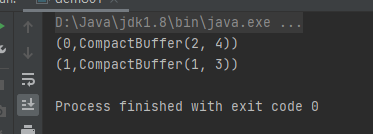

运行结果:

注:一个组的数据在一个分区中,但是并不是说一个分区中只有一个组

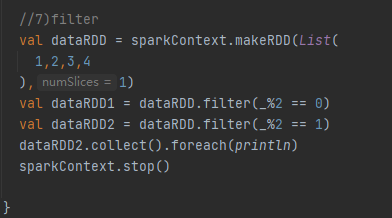

7)filter

将数据根据指定的规则进行筛选过滤,符合规则的数据保留,不符合规则的数据丢弃。

当数据进行筛选过滤后,分区不变,但是分区内的数据可能不均衡,生产环境下,可能会出

现数据倾斜

实例:

运行结果:

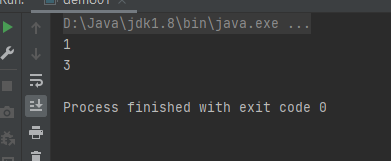

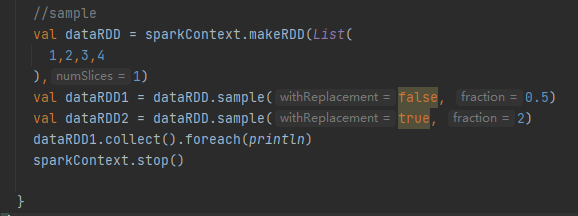

8)sample

根据指定的规则从数据集中抽取数据

实例

1.伯努利算法(抽取数据不放回)

2.泊松算法(抽取数据放回)

运行结果:

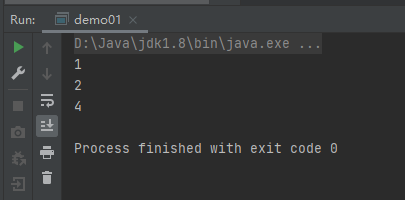

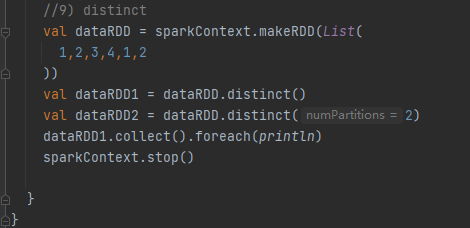

9)distinct

将数据集中重复的数据去重

实例:

运行结果:

10)coalesce

根据数据量缩减分区,用于大数据集过滤后,提高小数据集的执行效率

当 spark 程序中,存在过多的小任务的时候,可以通过 coalesce 方法,收缩合并分区,减少分区的个数,减小任务调度成本

实例:

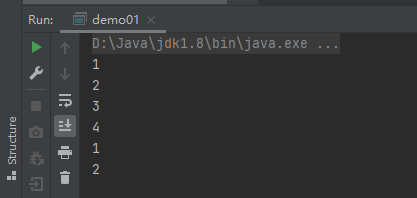

运行结果:

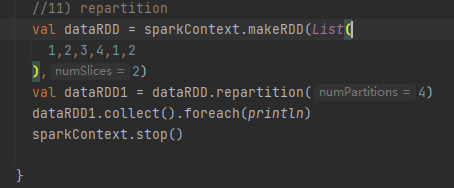

11)repartition

该操作内部其实执行的是 coalesce 操作,参数 shuffle 的默认值为 true。无论是将分区数多的RDD 转换为分区数少的 RDD,还是将分区数少的 RDD 转换为分区数多的 RDD,repartition操作都可以完成,因为无论如何都会经 shuffle 过程

实例:

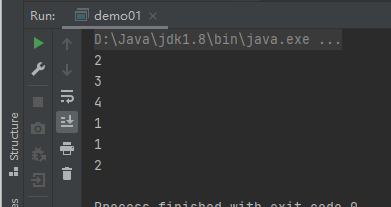

运行结果:

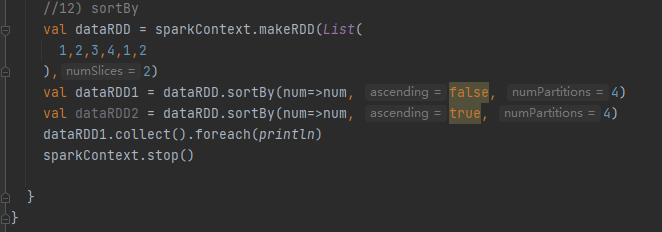

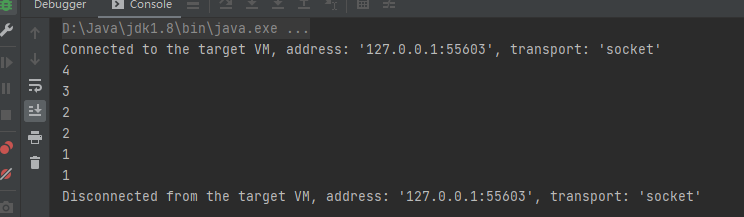

12sortBy

该操作用于排序数据。在排序之前,可以将数据通过 f 函数进行处理,之后按照 f 函数处理的结果进行排序,默认为升序排列。排序后新产生的 RDD 的分区数与原 RDD 的分区数一致。中间存在 shuffle 的过程

实例:

运行结果:

双Value类型

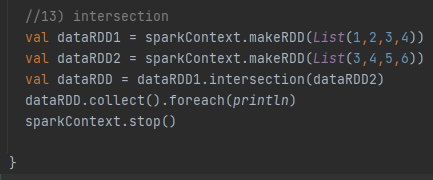

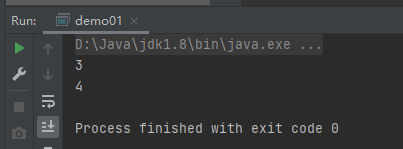

13) intersection

对源 RDD 和参数 RDD 求交集后返回一个新的 RDD

实例:

运行结果:

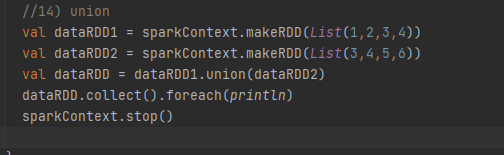

14) union

对源 RDD 和参数 RDD 求并集后返回一个新的 RDD(重复数据不会去重)

实例

运行结果:

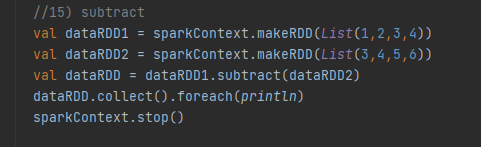

15) subtract

以源 RDD 元素为主,去除两个 RDD 中重复元素,将源RDD的其他元素保留下来。(求差集)

实例:

运行结果:

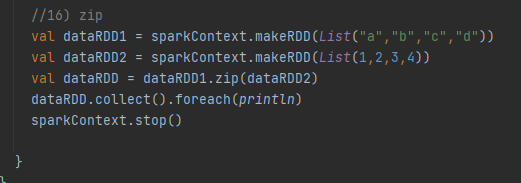

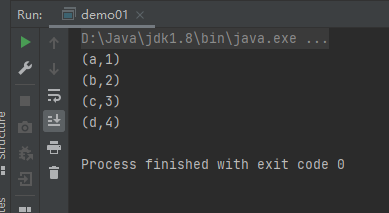

16) zip

将两个 RDD 中的元素,以键值对的形式进行合并。其中,键值对中的 Key 为第 1 个 RDD

中的元素,Value 为第 2 个 RDD 中的相同位置的元素

实例:

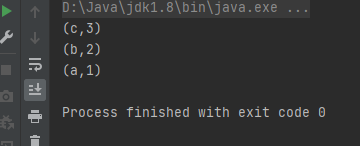

运行结果:

Key-Value类型:

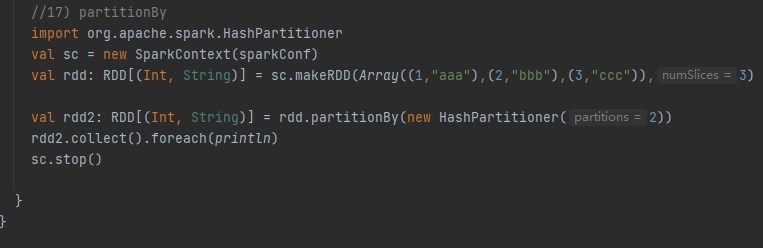

17) partitionBy

将数据按照指定 Partitioner 重新进行分区。Spark 默认的分区器是 HashPartitioner

实例:

运行结果:

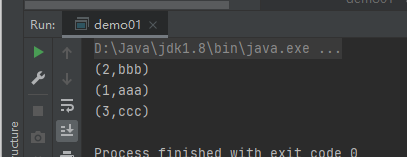

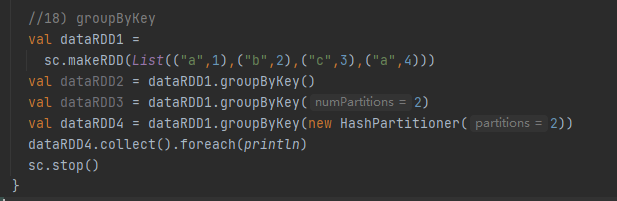

18) groupByKey

将数据源的数据根据 key 对 value 进行分组

实例:

运行结果:

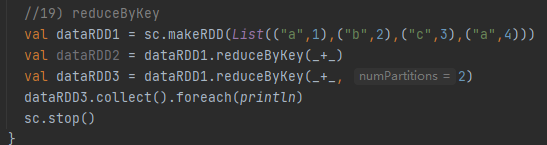

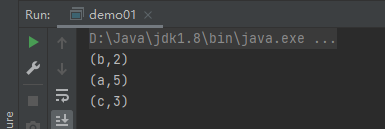

19) reduceByKey

可以将数据按照相同的 Key 对 Value 进行聚合

实例:

运行结果:

20) aggregateByKey

将数据根据不同的规则进行分区内计算和分区间计算

实例:

运行结果:

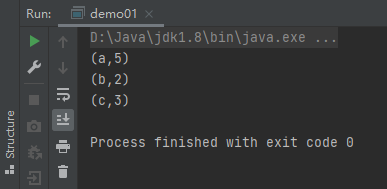

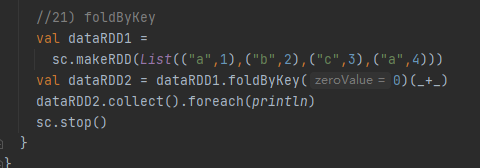

21) foldByKey

当分区内计算规则和分区间计算规则相同时,aggregateByKey 就可以简化为 foldByKey

实例

运行结果:

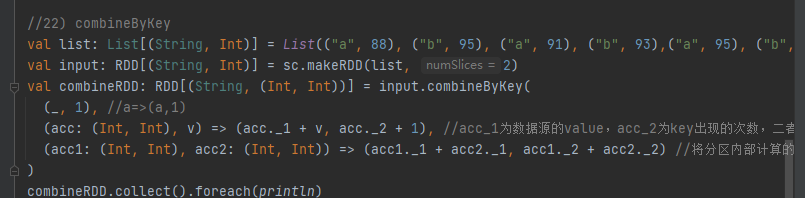

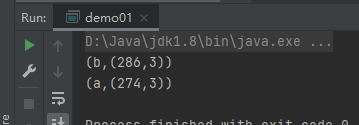

22) combineByKey

最通用的对 key-value 型 rdd 进行聚集操作的聚集函数(aggregation function)。类似于

aggregate(),combineByKey()允许用户返回值的类型与输入不一致

实例:

运行结果:

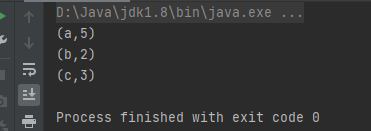

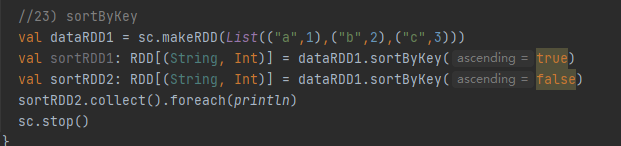

23) sortByKey

在一个(K,V)的 RDD 上调用,K 必须实现 Ordered 接口(特质),返回一个按照 key 进行排序

实例

运行结果: