目录

背景

最近deepseek本地部署的概念越来越火,勾起了我学习的兴趣。

我就在思考如何使用家用机或者平时打游戏的机器来本地部署deepseek,给自己开发个智能体来辅佐自己平时的工作生活需要。

那么看完这篇文章, 一步步跟着做你就可以完成Deepseek-r1蒸馏板的本地部署!

准备工作

你需要一台有显卡的机器,显存是主要指标,当然没有显卡也可以玩,其次你的电脑有足够的空间。

以下是需要准备的相关素材

- 显卡: 显存越大越好,型号没那么重要,主要是显存 笔者测试显卡为(4090D魔改48G);

- 内存: 16G就够,当然越大越好;

- cpu:这个没有啥强制要求,核心多一些留给下篇文章介绍的虚拟机。

注:最好有科学上网能力, 显卡的话没有也成。

开始部署

下载olloma

这东西你可以理解成就是个容器或者承载大模型的工具,可以以特定形式输入输出大模型的内容。

点击直达olloma官网 点击Download下载

安装olloma

没啥特殊操作 下载完直接双击安装

下载deepseek-r1模型

在olloma点击models或者https://ollama.com/search

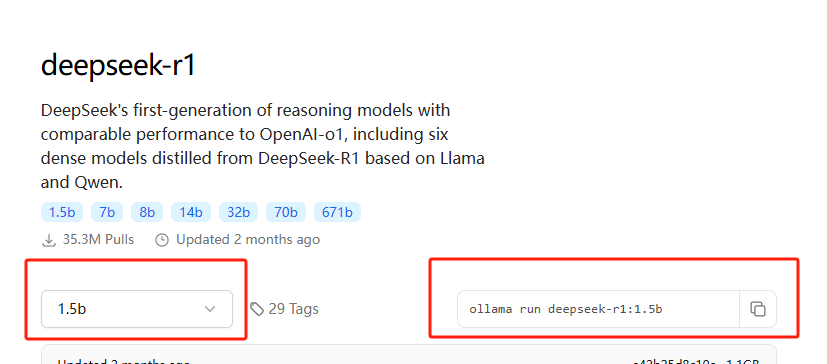

- 找到deepseek-r1

- 根据显存大小选择合适的模型

- 下载并安装模型

这里强烈建议下载 1.5b的版本,你先试试,会用了之后再下载更大模型

复制ollama run deepseek-r1:1.5b打开cmd粘进去 运行

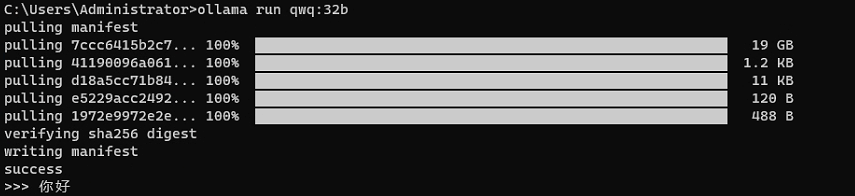

之后就是等待下载完成会见到类似于这样的状态

使用

至此你已经完成了本地部署!

如何使用

- 直接cmd内对话(这不优雅!)

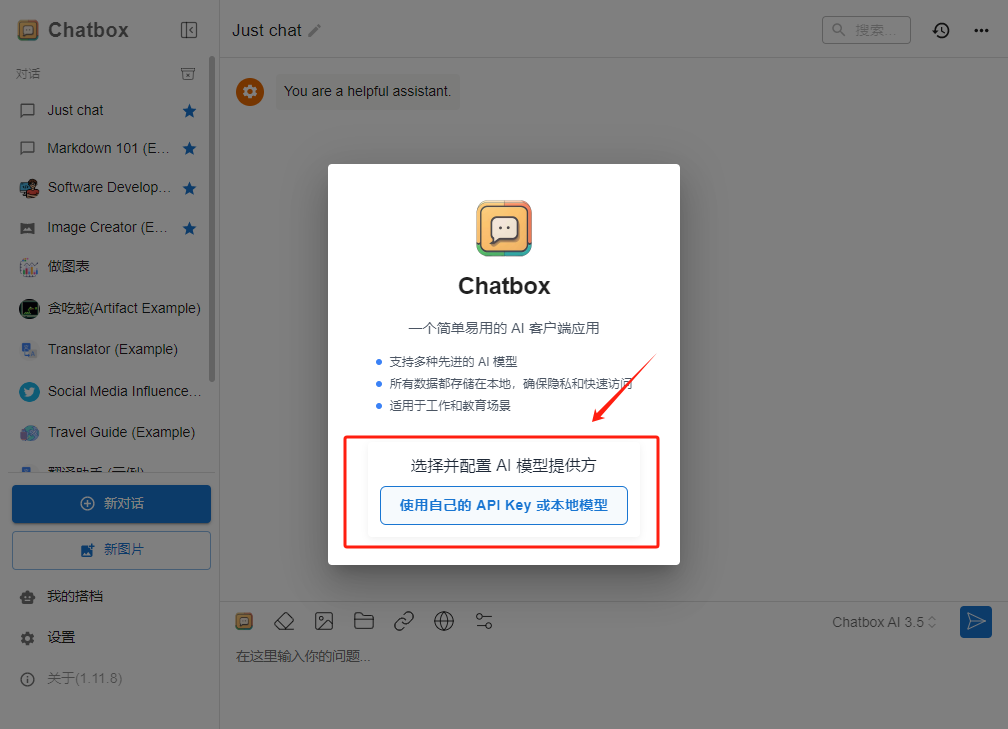

- 使用例如chatbox的工具(简单配置开箱即用) 官网:https://chatboxai.app/zh

(1)安装chatbox

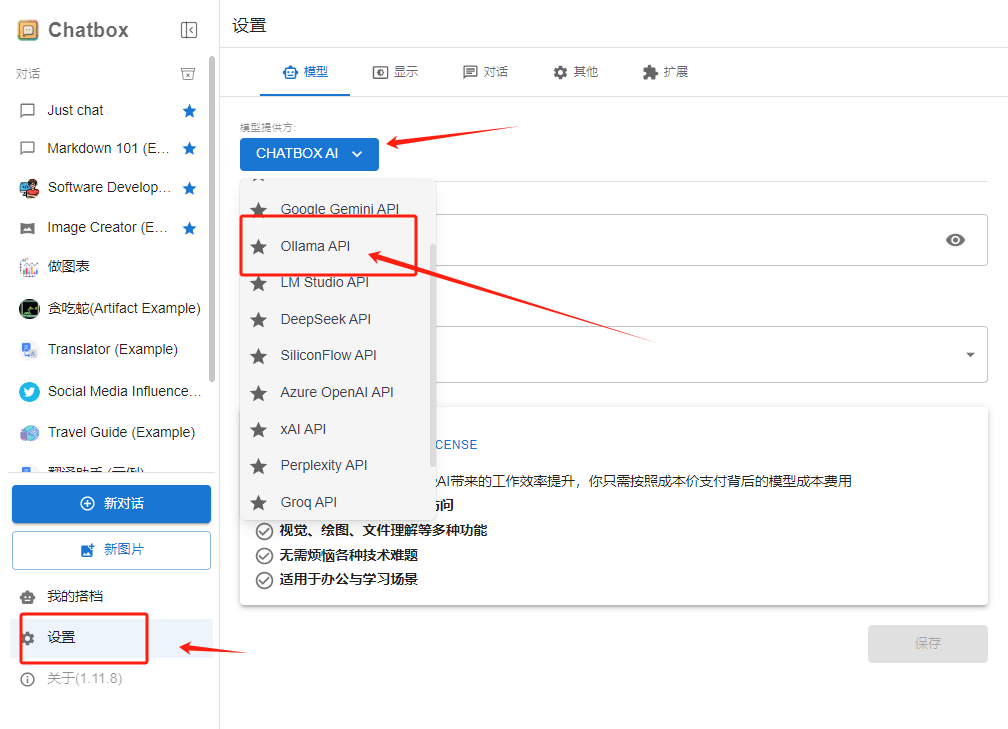

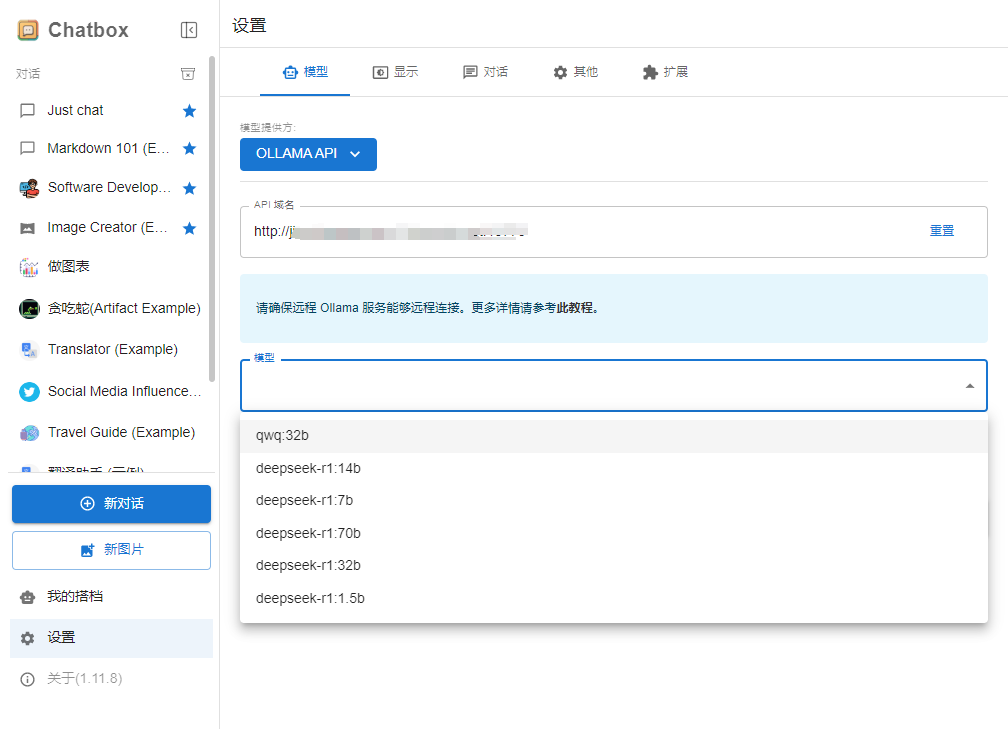

(2) 一步步跟着点

配置完成! 你可以新建对话后使用你本地的模型来对话了!

- 关于其他参数 上下文的消息数量上限:是控制一次对话中对多少个对话内容进行参考的(默认值即可)

严谨与想象:简单理解就是越低想象的越少。

Top-p: 用来控制输出的,越高的值输出的低分尾短(简单理解为废话越少)

结束语

恭喜, 你已经学会了如何本地部署大模型,并且简单的使用他!

下一篇文章我将提供本地部署大模型的高级用法(如:向量数据库,文件上传等等), 敬请期待!