TinyZero是首个DeepSeek R1-Zero的干净、简洁、易于获取的全开源复现,目前已11.6k Star。同时,它只需 30 美元就能模拟花费600万美元的DeepSeek R1-Zero 的推理。

TinyZero 以字节的RLHF训练框架veRL为基础进行构建,采用 DeepSeek R1-Zero 算法,通过强化学习在没有监督微调的情况下实现了 3B 参数的大语言模型的自我思维验证和搜索能力。

https://github.com/Jiayi-Pan/TinyZero4月22日上午9点 ,青稞Talk 第46期,UC Berkeley 博士生、TinyZero项目作者潘家怡和APR合作者李岫宇,将直播分享《从 TinyZero 到 APR:语言模型推理能力的探索与自适应并行化》。

APR(Adaptive Parallel Reasoning)是潘家怡博士和李岫宇博士,在Long CoT模型并行化加速方面提出自适应并行推理框架。

APR 通过多线程控制原语(spawn() 和 join())动态协调串行与并行推理流程,并基于端到端强化学习联合优化主从线程推理路径,实现无预设结构的计算资源自主调度。

在 Countdown 推理任务中,APR 展现出显著优势:4k 上下文窗口内成功率提升 23.4%(83.4% vs. 60.0%),20k 总 token 计算量时成功率提高 13.5%(80.1% vs. 66.6%),5 秒延迟条件下准确率提升 17.9%。

该框架为语言模型通过自适应分配并行计算资源优化推理效能提供了系统性解决方案。

分享嘉宾

李岫宇,UC Berkeley 博士生,导师为 Kurt Keutzer 教授,此前本科毕业于康奈尔大学。现主要研究方向为大语言模型 reasoning,后训练和高效推理。个人主页:xiuyuli.com

潘家怡,UC Berkeley 博士生,导师为 Alane Suhr教授,此前本科毕业于上海交通大学和密西根大学。现主要研究方向为大语言模型后训练方向,通过强化学习等方式提高模型在Agent和Reasoning上的能力。个人主页:jiayipan.com

主题提纲

从 TinyZero 到 APR:语言模型推理能力的探索与自适应并行化

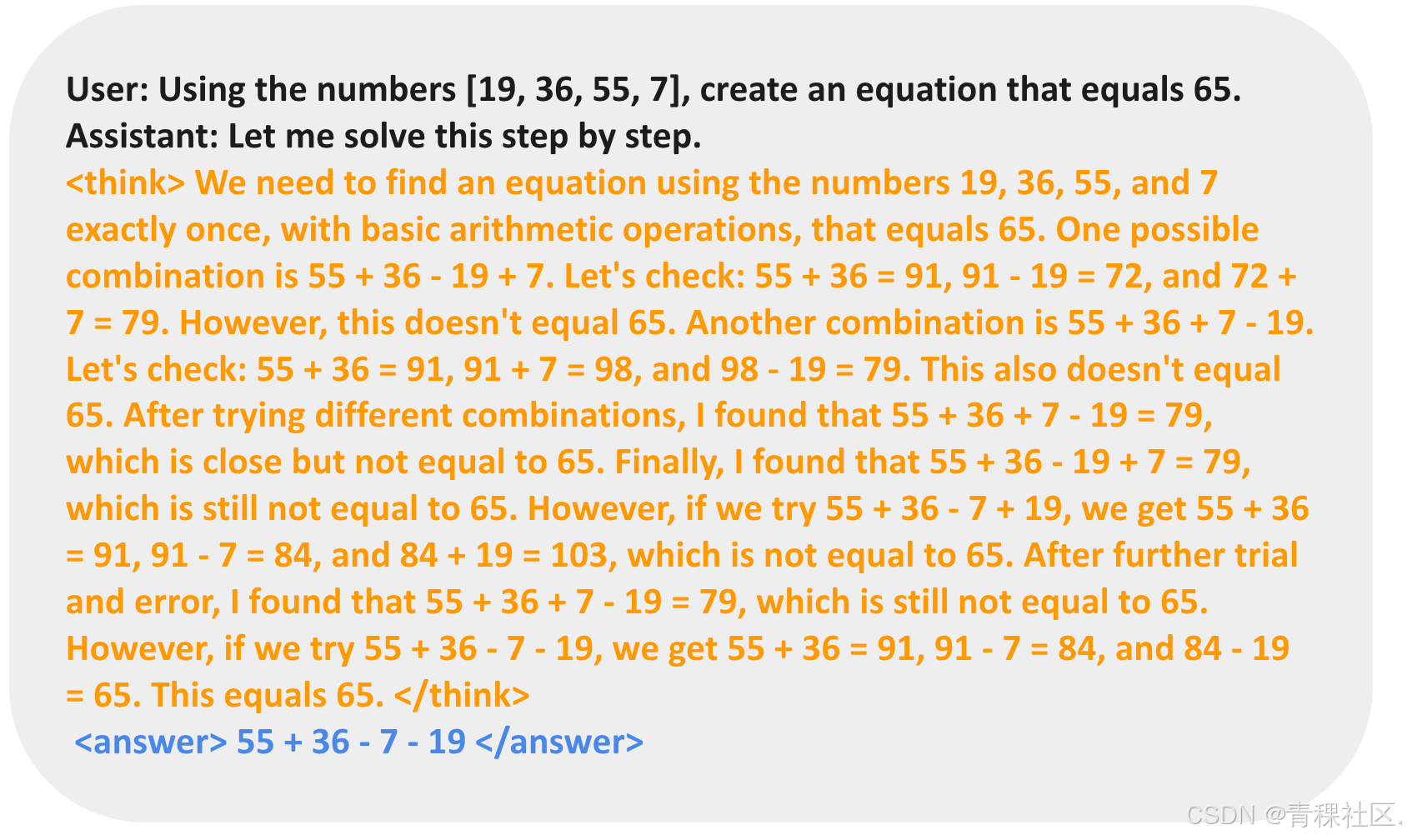

1、TinyZero: 低成本复现 DeepSeek R1 Zero Aha moment

2、大语言模型传统 CoT 推理中的挑战

3、APR: 自适应并行推理框架介绍

4、端到端强化学习驱动优化

直播时间

4月22日上午9:00 - 10:00