本文给大家带来一个实用的RAG框架------RAGFlow。我们来看看它的自我介绍吧!

还是老规矩,它是什么?有什么用?这些官方文档都可以简单的查到(官方中文README_zh.md)。下面我带大家一步步安装并实现一个知识库问答吧!

(1)快速安装

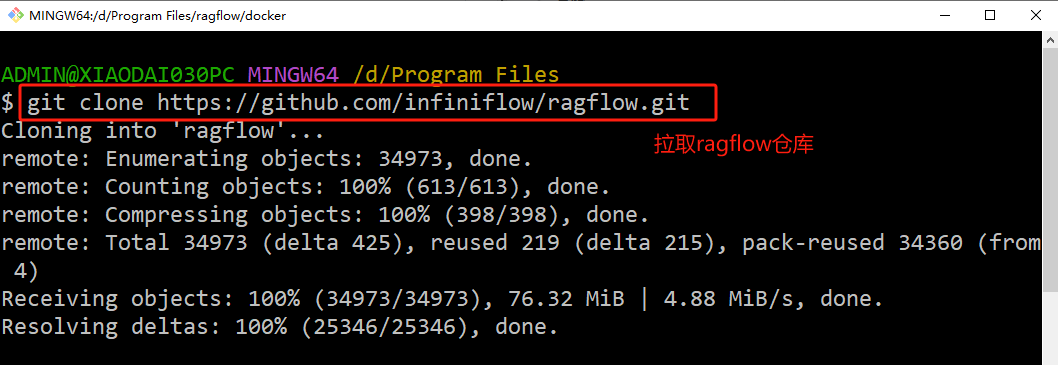

1、拉取官方github上的ragflow仓库

bash

git clone https://github.com/infiniflow/ragflow.git

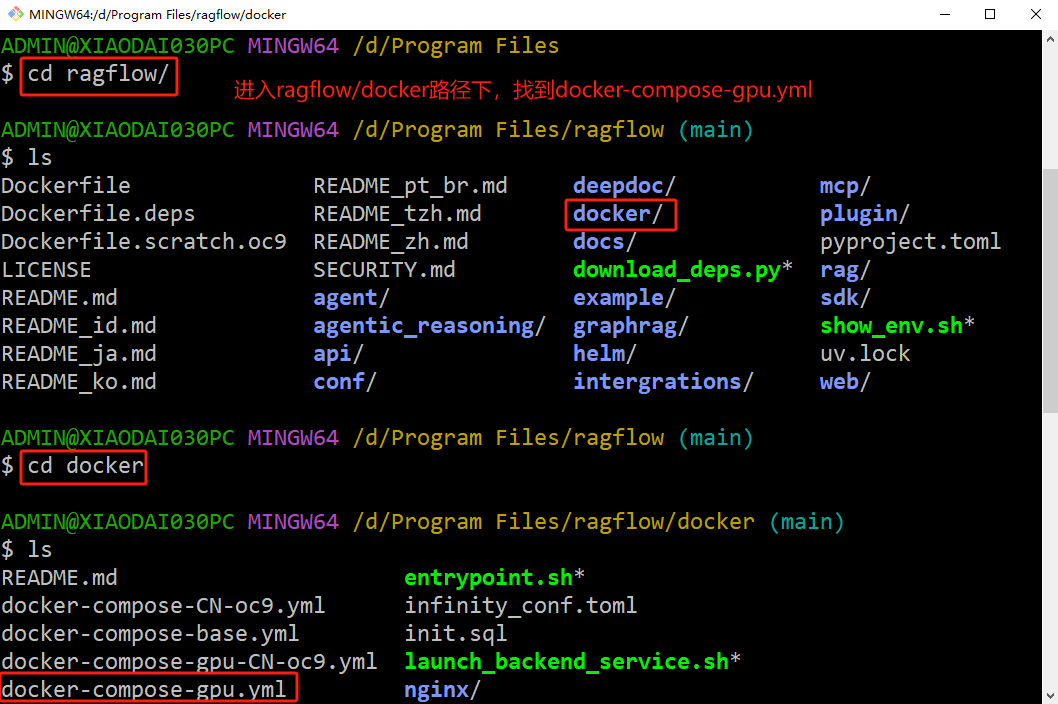

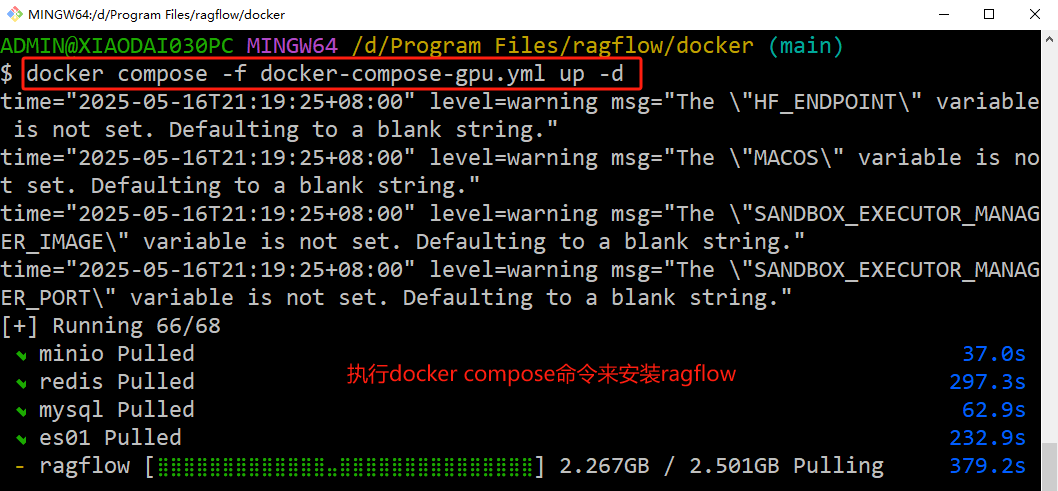

2、进入ragflow下面的docker目录,执行docker compose命令进行本地安装

bash

# 进入docker目录中

cd ragflow/docker

# 我们安装GPU版本的

docker compose -f docker-compose-gpu.yml up -d

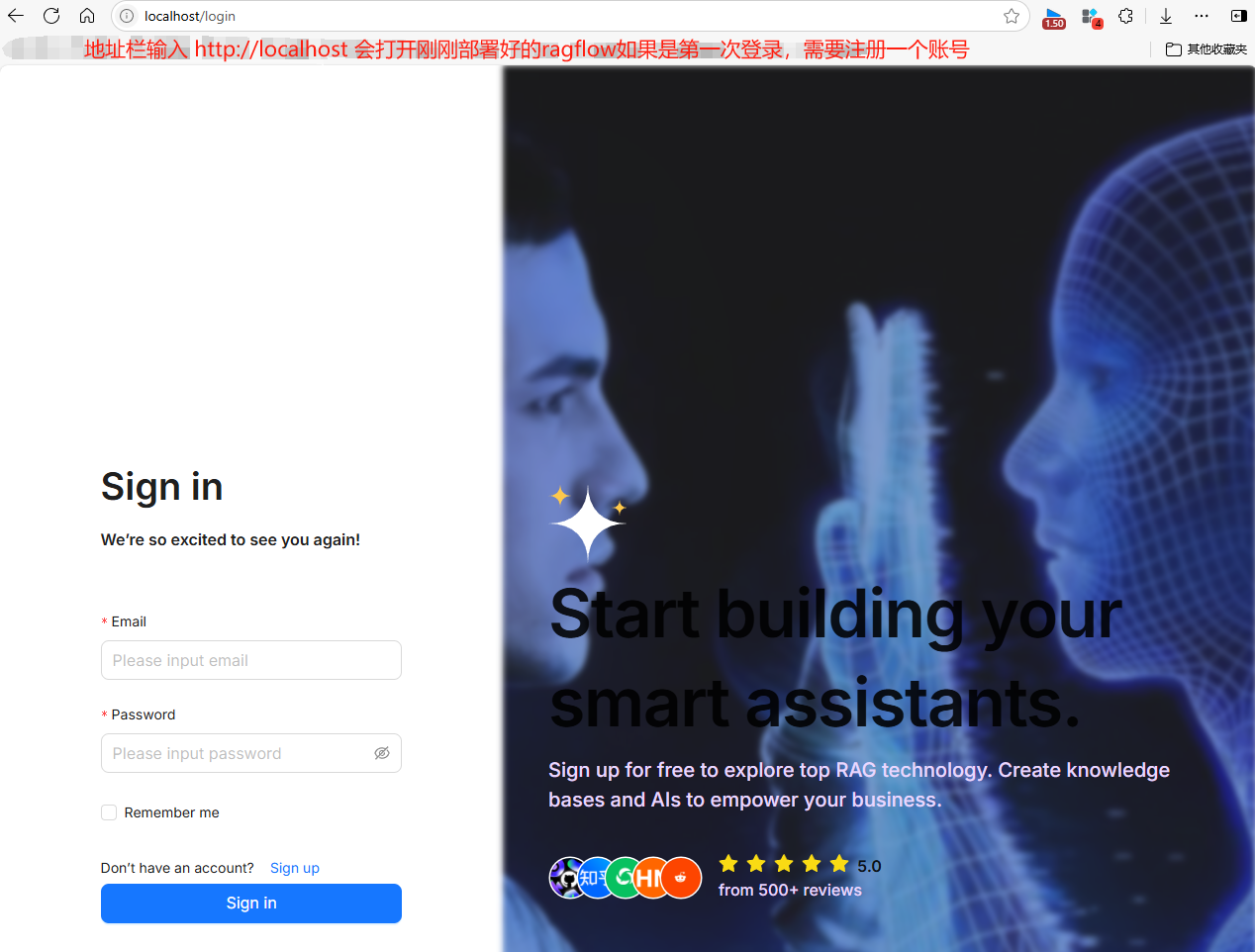

3、网页输入localhost进入ragflow的使用界面

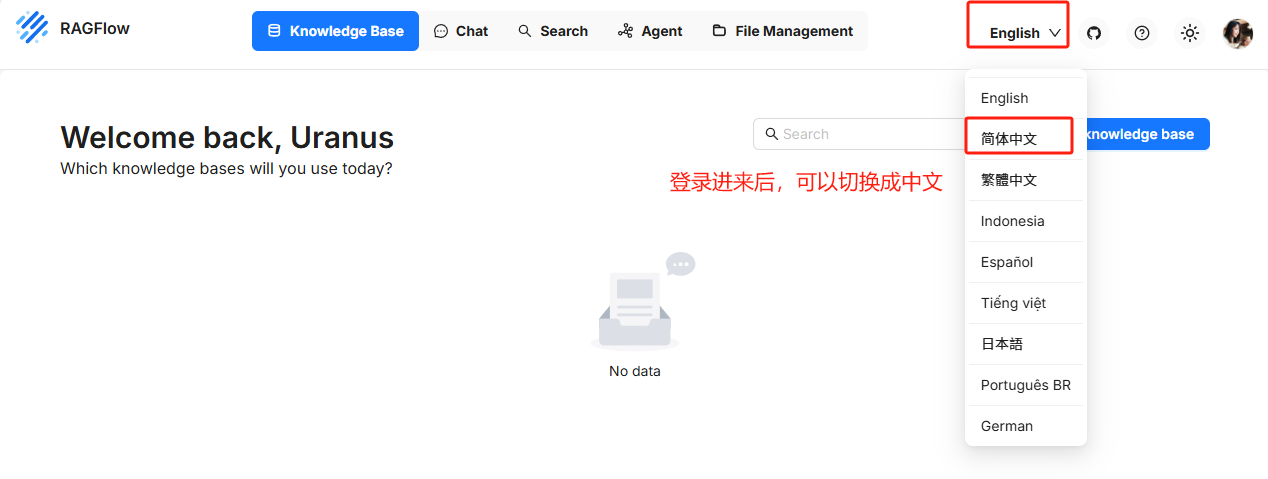

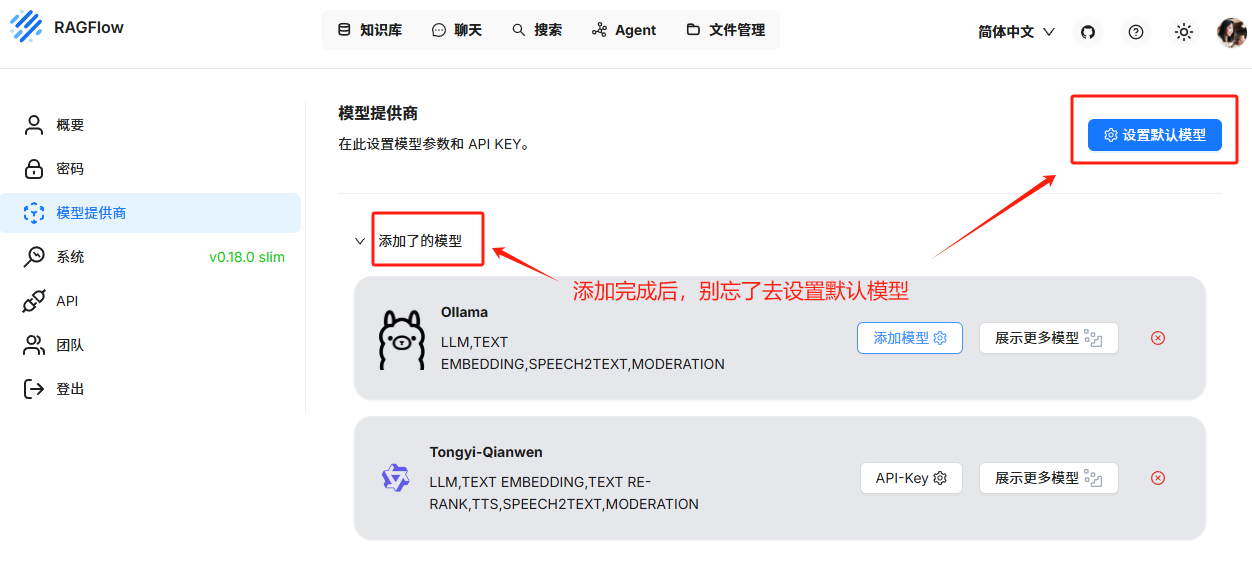

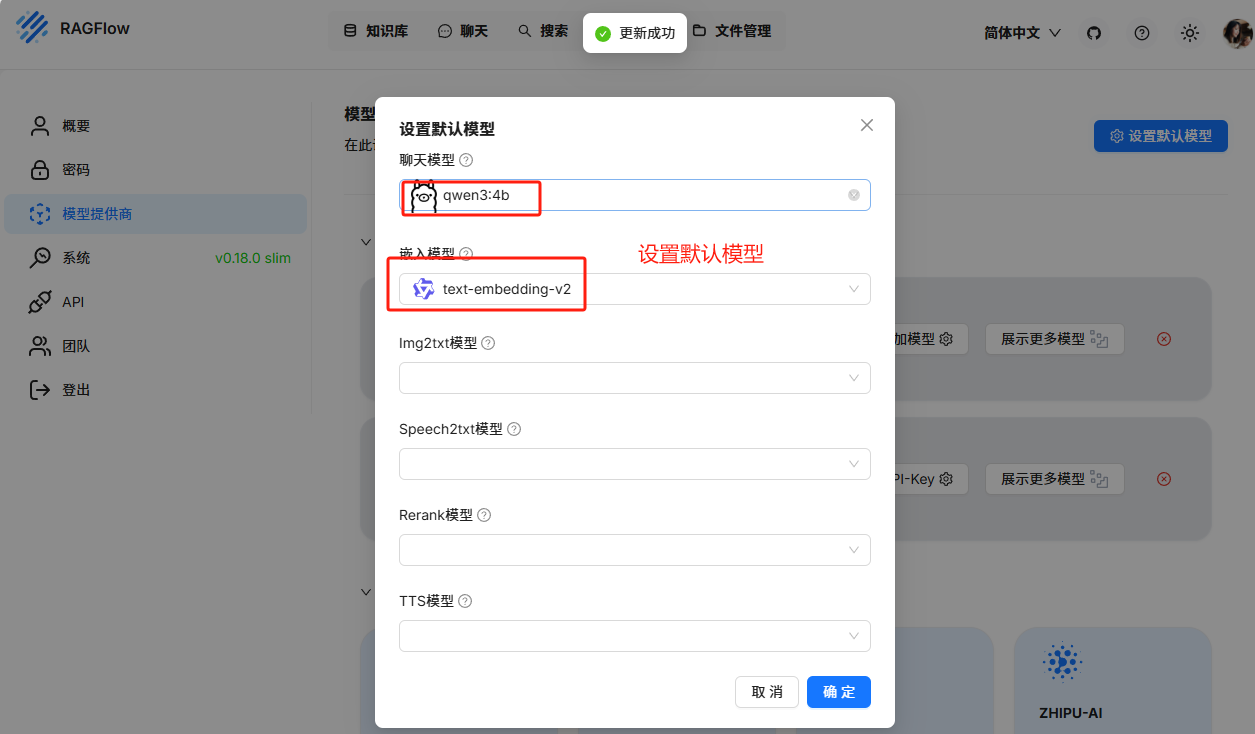

(2)设置默认模型

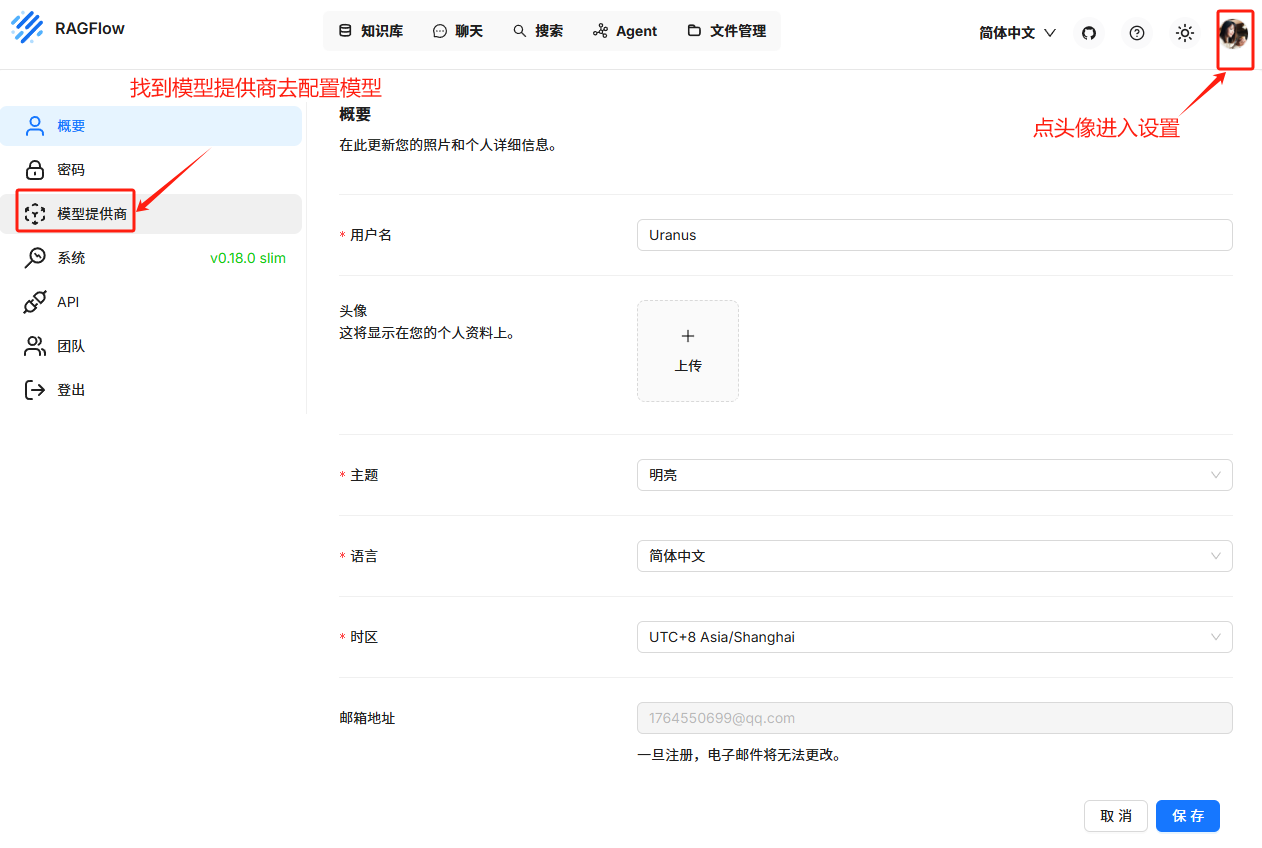

4、点击头像进入设置,在模型供应商里面配置大模型

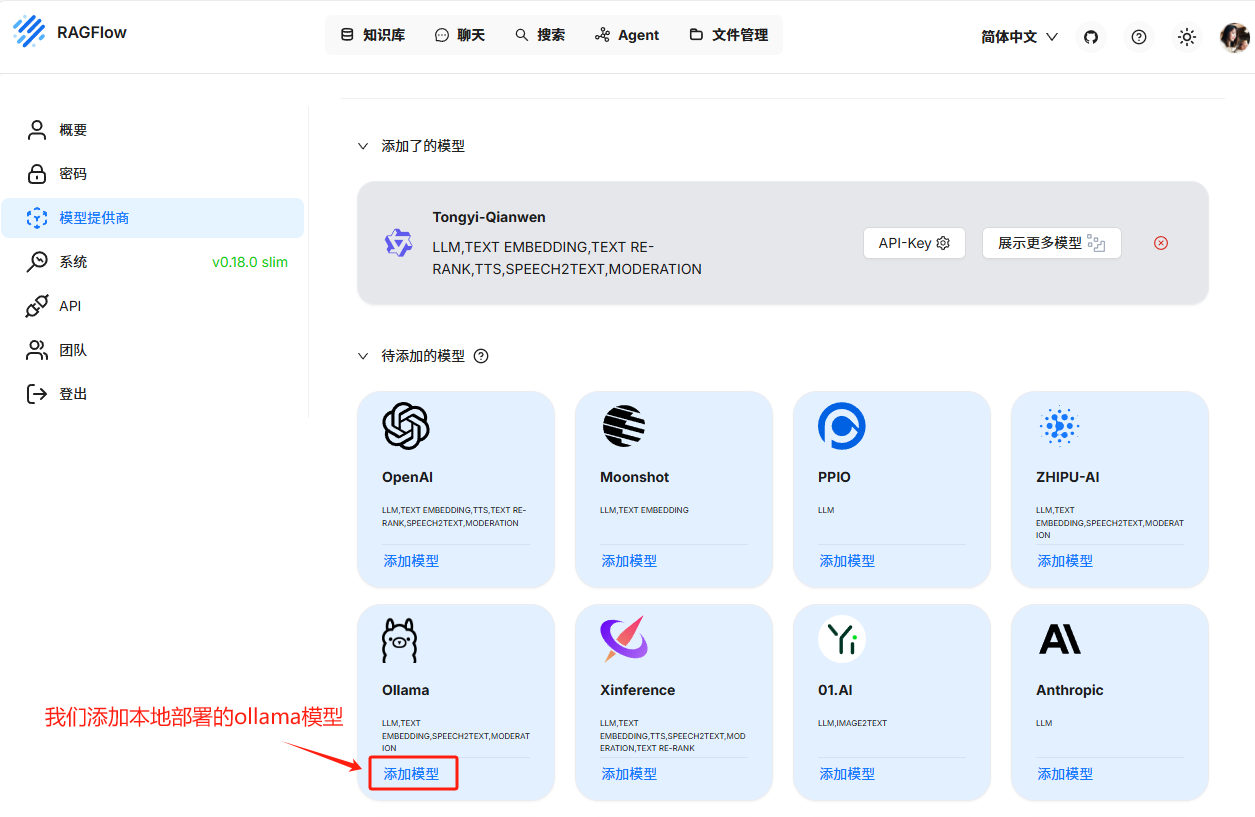

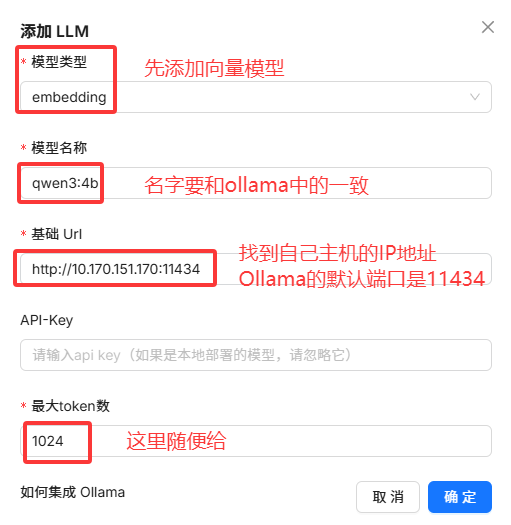

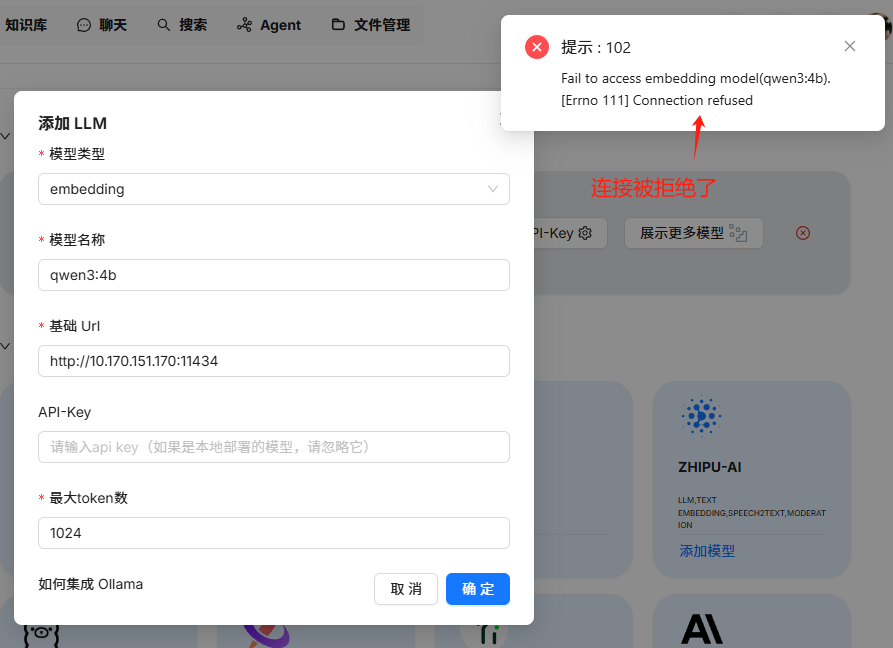

5、 因为要使用本地部署的模型,所以选择Ollama是最简单的

6、embedding模型也可以选择qwen3:4b

【坑】这里添加失败了,原因是Ollama的服务默认不是所有地址都能访问的,所以我们要去设置一个HOST环境,让宿主机的IP也能访问Ollama的API。

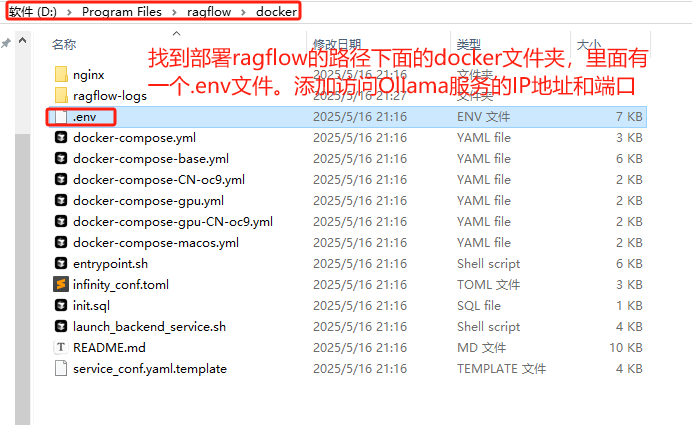

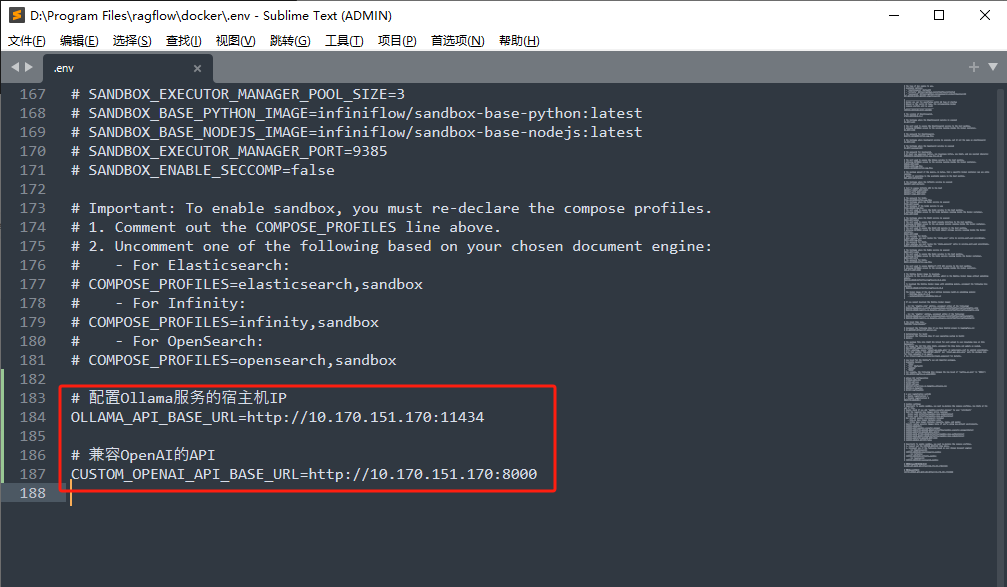

7、先配置一下Docker的.env文件

8、在.env文件里面添加环境变量,这样Docker里面的ragflow就可以正确访问Ollama的API

bash

# 配置Ollama服务的宿主机IP

OLLAMA_API_BASE_URL=http://10.170.151.170:11434

# 兼容OpenAI的API

CUSTOM_OPENAI_API_BASE_URL=http://10.170.151.170:8000

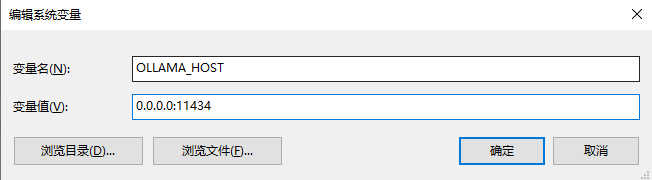

9、再去我自己的电脑(宿主机)去配置系统环境变量,允许ollama服务被所有地址访问

【坑】 配置好HOST之后一定要重启Ollama,不然不会生效

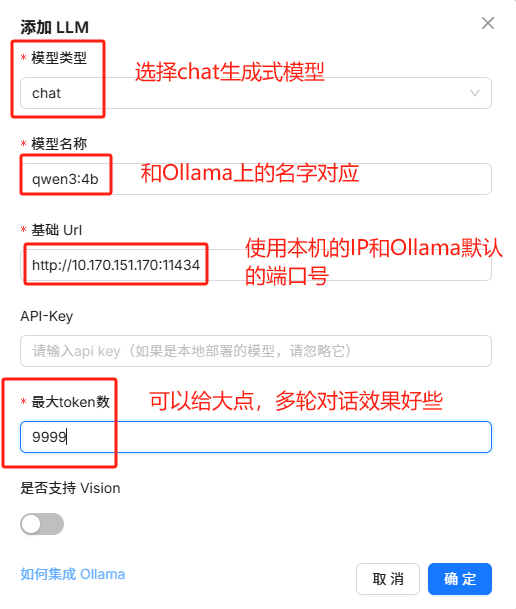

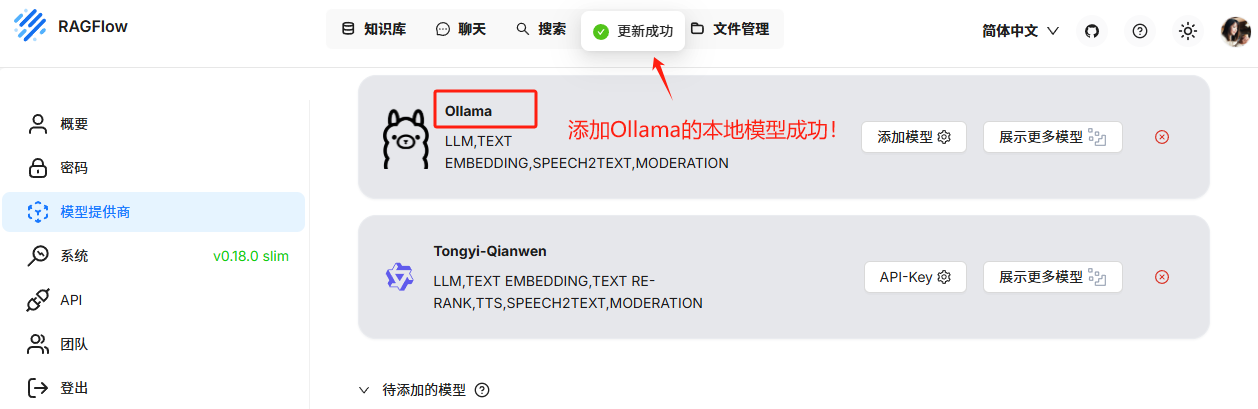

10、我们继续配置Ollama模型

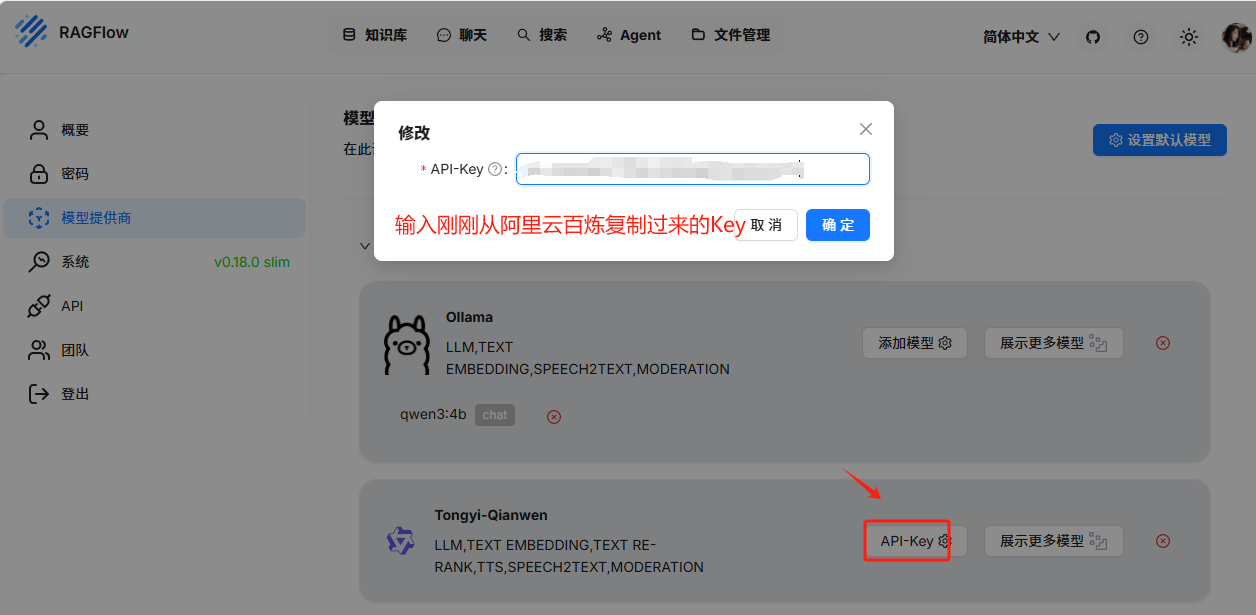

11、默认已经安装了通义千问的向量模型,给它填入API KEY

【注】现在去阿里云百炼注册账号,可以获得每个模型免费100万的额度!!!跳转链接:阿里云百炼![]() https://bailian.console.aliyun.com/

https://bailian.console.aliyun.com/

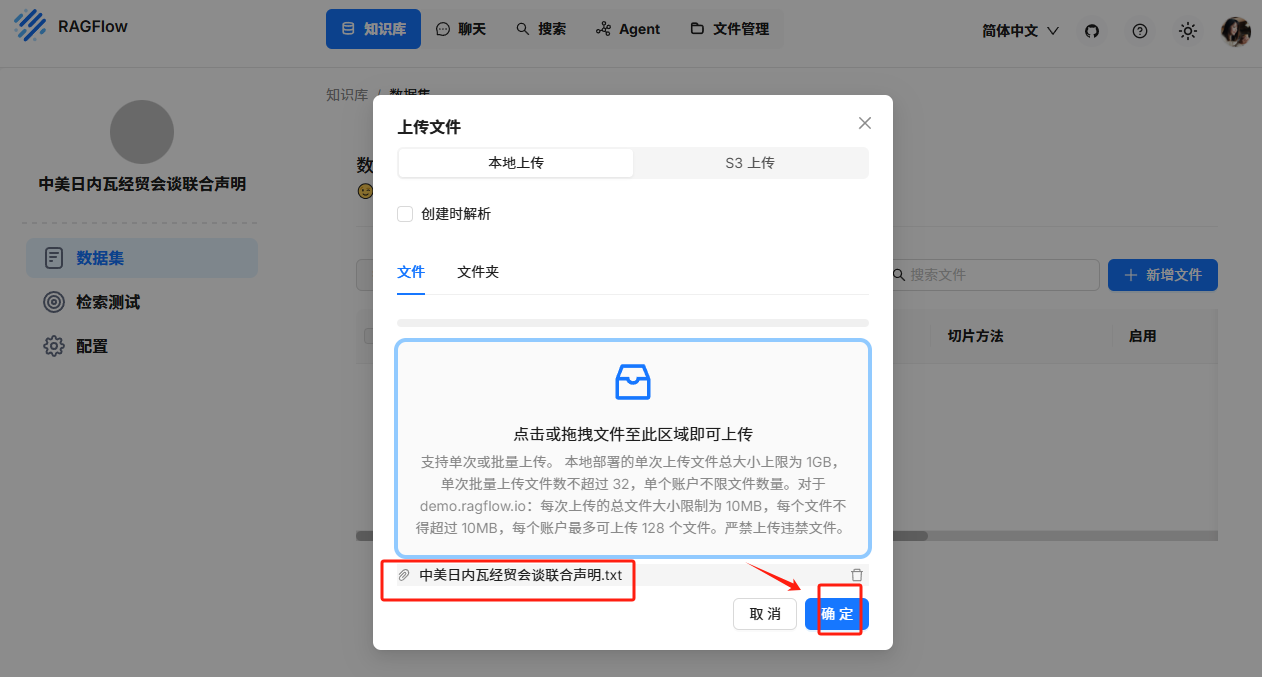

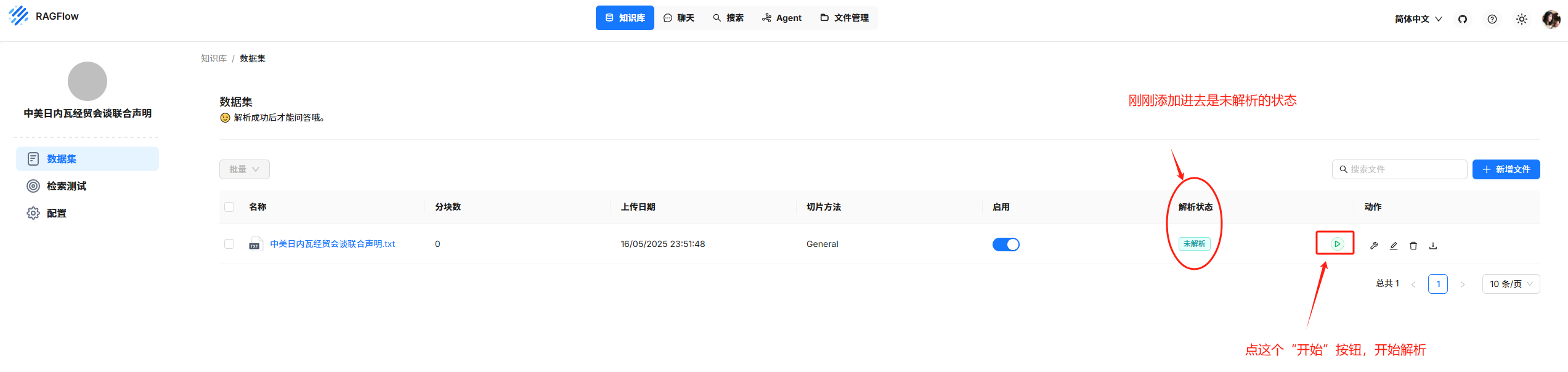

(3)创建知识库

12、点击上方的知识库去创建一个

13、添加文件成功之后,进行文本转向量处理

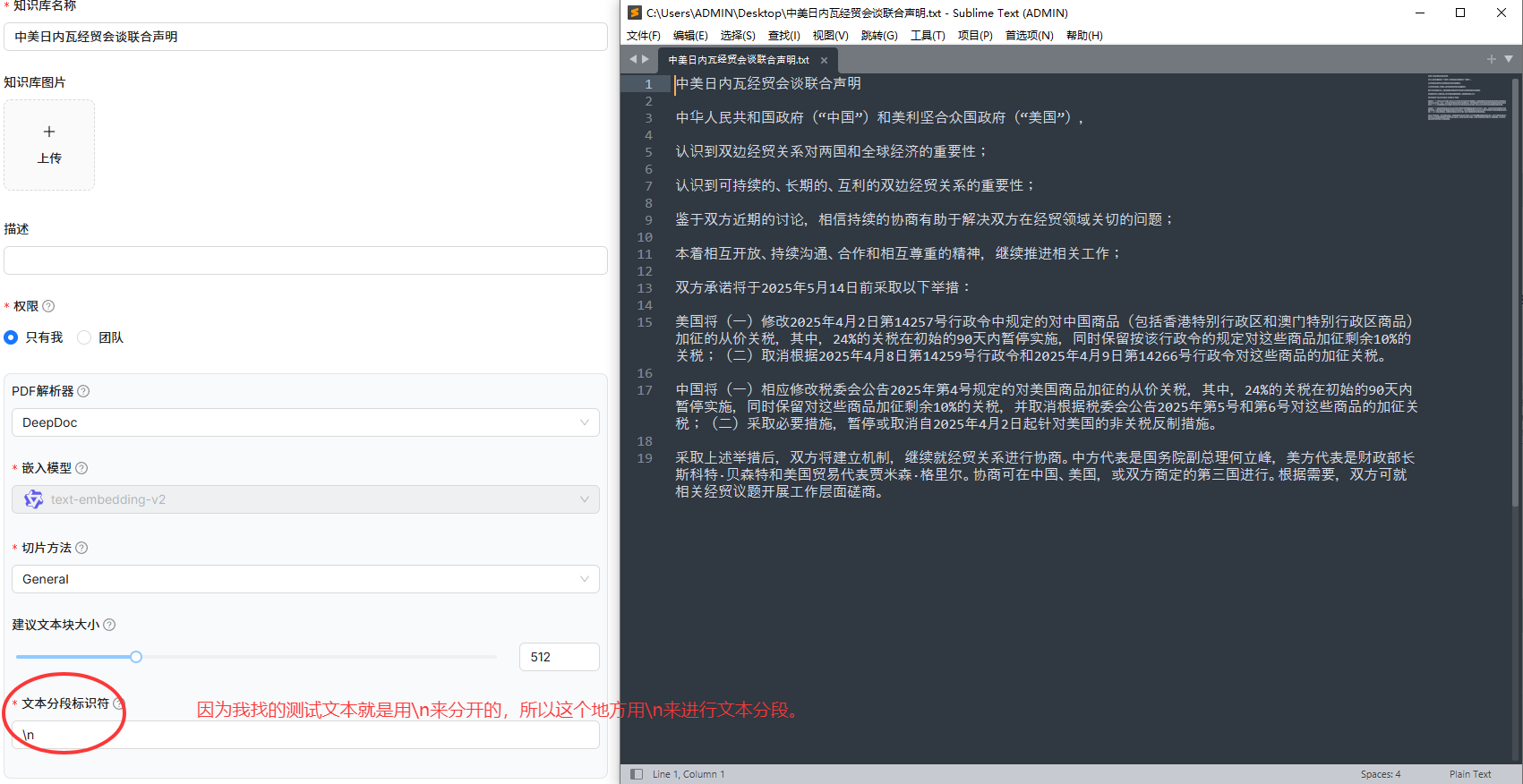

14、进行一些必要的配置(这些配置参数自行去官方doc里面查)

RAGFlow官方文档![]() https://ragflow.io/docs/dev/

https://ragflow.io/docs/dev/

(4)创建基于RAG的聊天

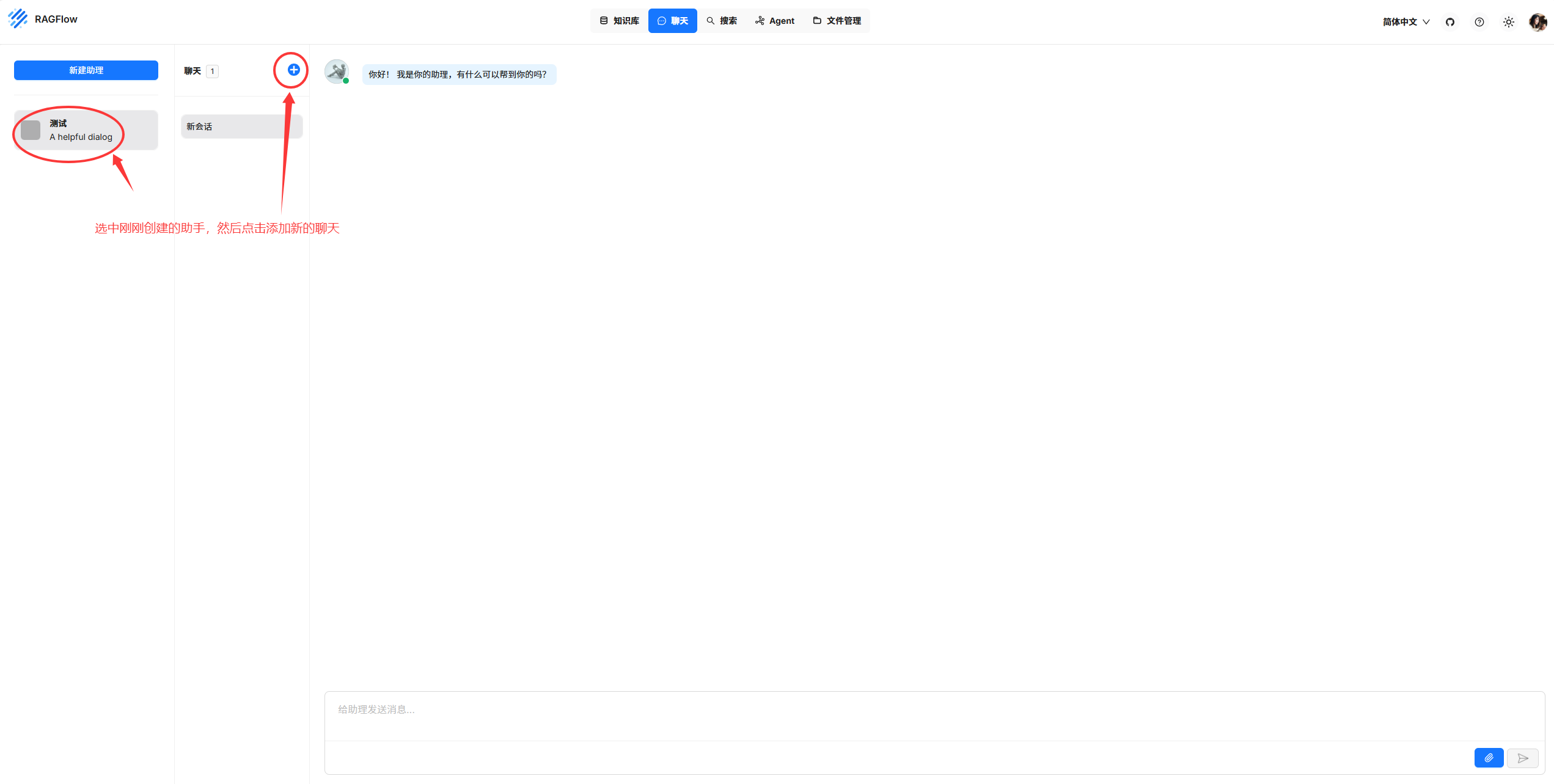

15、点击上方的聊天,新建一个助理

16、测试RAG对话