目录

-

- [1.3. 各种机器学习问题](#1.3. 各种机器学习问题)

-

- 1)监督学习(supervisedlearning)

-

- (1)回归(regression)

- (2)分类(classification)

- (3)标记问题

- (4)搜索

- [(5)推荐系统(recommender system)](#(5)推荐系统(recommender system))

- (6)序列学习

- 2)无监督学习

- 3)与环境互动

- 4)强化学习

1.3. 各种机器学习问题

1)监督学习(supervisedlearning)

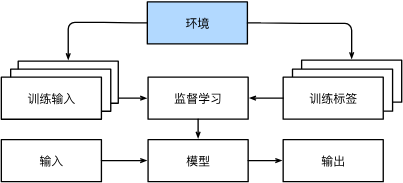

监督学习(supervised learning):

-

擅长在"给定输入特征"的情况下预测标签。

-

每个"特征-标签"对都称为一个样本(example)。

-

我们的目标是生成一个模型,能够将任何输入特征映射到标签(即预测)。

监督学习过程:

-

获取训练数据集:数据样本+标签。有时样本已有标签;有时样本需要被人工标记;

-

生成模型:有监督学习算法+训练数据集="已完成学习的模型";

-

预测标签:将没有见过的样本特征放到"已完成学习的模型"中,使用模型的输出作为相应标签的预测。

图1.3.1 监督学习:

(1)回归(regression)

回归(regression)是监督学习任务之一。

"回归"指的是通过建立输入变量(自变量)与输出结果(因变量)之间的数学关系模型,来预测一个具体的数值结果。简单来说,它就像用一条线或曲线来"拟合"数据点,从而根据已知因素推测未知数值。

(2)分类(classification)

分类 (classification)问题:希望模型能够预测样本属于哪个类别(category,正式称为类(class))。

-

二项分类(binomial classification):只有两个种类;

-

多项分类(multiclass classification):有多个种类;

-

层次分类(hierarchical classification):层次结构假定在许多类之间存在某种关系。

(3)标记问题

学习预测不相互排斥的类别的问题称为多标签分类(multi-label classification)。

举个例子,一篇典型的文章可能会用5~10个标签。

(4)搜索

在信息检索领域,我们希望对一组项目进行排序。搜索结果的排序也十分重要,学习算法需要输出有序的元素子集。

该问题一种解决方案:先为集合每个元素分配相应的相关性分数,然后检索评级最高的元素。

(5)推荐系统(recommender system)

推荐系统(recommender system),它的目标是向特定用户进行"个性化"推荐。

(6)序列学习

序列学习 是处理输入或输出是可变长度序列的机器学习方法,要求模型能"记住"历史信息来处理前后关联的任务。与传统模型(固定输入输出,如图像分类)不同。

序列学习几种典型的特殊情况:

-

标记和解析 :是对文本序列进行注释,输入和输出数量基本相同,例如标注出句子中的命名实体等。

-

自动语音识别 :输入是音频录音,输出是对应的文本记录,音频帧数远多于文本字符数,属于输出比输入短得多的序列到序列学习。

-

文本到语音 :与自动语音识别相反,输入是文本,输出是音频文件,输出比输入长很多。

-

机器翻译 :输入和输出的顺序及数量通常都不相同,像德语和英语间的翻译,存在词序调整等情况。

此外,序列学习还在确定用户阅读网页顺序、对话问题等众多其他学习任务中有应用,是当前热门的研究领域。

.

2)无监督学习

无监督学习(unsupervised learning):处理无标签数据,旨在自主发现数据内在模式或结构,无需明确的"目标"指导。

数据中不含有"目标"的机器学习问题通常被为无监督学习(unsupervised learning);

无监督学习可以回答什么样的问题呢?

-

聚类(clustering)问题:没有标签的情况下,我们是否能给数据分类呢?比如,给定一组用户的网页浏览记录,我们能否将具有相似行为的用户聚类呢?

-

主成分分析(principal component analysis)问题:我们能否找到少量的参数来准确地捕捉数据的线性相关属性?比如,一个球的运动轨迹可以用球的速度、直径和质量来描述。

-

因果关系 (causality)和概率图模型(probabilistic graphical models)问题:我们能否描述观察到的许多数据的根本原因?例如,如果我们有关于房价、污染、犯罪、地理位置、教育和工资的人口统计数据,我们能否简单地根据经验数据发现它们之间的关系?

-

生成对抗性网络 (generative adversarial networks):目标是,合成与真实数据分布一致的复杂数据(如图像、音频)。**机制,**通过生成器与判别器的对抗训练,使生成数据难以被区分真伪。

.

3)与环境互动

传统的监督学习和无监督学习通常属于离线学习(offline learning),即先收集大量数据,然后在与环境断开的情况下进行学习。

离线学习的优点是可以在孤立的环境中进行模式识别,但其应用范围有限。

与环境互动的学习模式推动机器学习从静态预测迈向动态决策,解决更复杂的现实问题,但需应对环境反馈、动态变化及策略影响等挑战。

图1.3.6 从环境中为监督学习收集数据。

.

4)强化学习

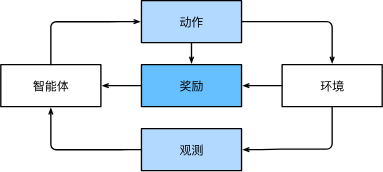

强化学习(Reinforcement Learning, RL)关注智能体(agent)通过与环境的动态交互学习最优决策策略,核心特点如下:

Agent交互循环:智能体在时间序列中持续与环境互动,循环流程为:

-

观察(Observation):接收环境状态信息(如游戏画面)。

-

行动(Action):根据策略选择动作(如移动角色)。

-

奖励(Reward):环境反馈即时收益(如得分增减)。

图1.3.7 强化学习和环境之间的相互作用

强化学习的目标是产生一个好的策略(policy)。 强化学习智能体选择的"动作"受策略控制,即一个从环境观察映射到行动的功能。

当环境可被完全观察到时,强化学习问题被称为马尔可夫决策过程 (markov decision process)。 当状态不依赖于之前的操作时,我们称该问题为上下文赌博机 (contextual bandit problem)。 当没有状态,只有一组最初未知回报的可用动作时,这个问题就是经典的多臂赌博机(multi-armed bandit problem)。

.

声明:资源可能存在第三方来源,若有侵权请联系删除!