在处理大数据时,Hadoop的性能和资源管理是至关重要的。Hadoop的分布式文件系统(HDFS)将数据切割成多个块(Block),并将这些块分布在集群中的不同节点上。在默认情况下,HDFS的块大小可能并不适合所有使用场景,尤其是在处理大规模数据时,可能会导致性能瓶颈或资源浪费。因此,调整Hadoop的块大小成为优化系统性能和存储效率的重要手段。本文将探讨为什么你需要修改Hadoop的块大小,如何根据实际需求进行调整,以及修改块大小对性能的潜在影响。

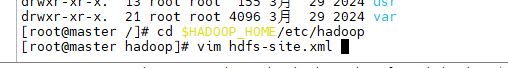

1.修改配置文件

cd $HADOOP_HOME/etc/hadoopvim hdfs-site.xml

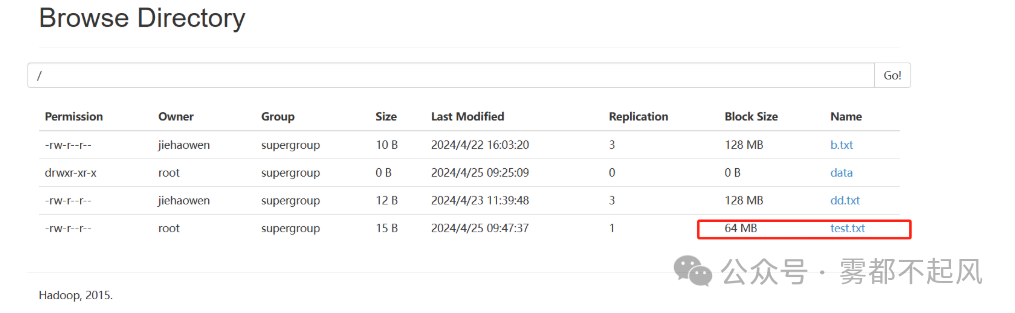

2.重启Hadoop并上传一个文件测试

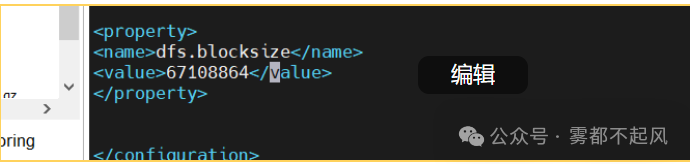

在Hadoop中,HDFS的默认块大小通常是 128MB(在一些较早的版本中是64MB)。然而,这个值可以根据需求在配置文件中进行调整,通常是通过修改`hdfs-site.xml`中的`dfs.blocksize`参数来实现。

修改Hadoop的块大小并非一成不变的解决方案,而是根据实际数据处理需求和集群资源状况的灵活调整。正确的块大小能够显著提升数据读取和写入的效率,同时还能够更好地利用集群的存储资源。通过理解块大小对HDFS性能的影响,管理员可以做出更加明智的决策,以确保Hadoop集群在处理不同规模的数据时都能够高效运作。总之,掌握块大小的调整技巧是优化Hadoop集群性能的关键一环。