线性代数是一种代数结构,通俗来讲,向量空间是这个结构的基石,我们要在向量空间中研究向量与向量的关系

一 对象:向量

各位都有对象嘛?如果没有对象,想不想知道你们的天命之人是谁捏?如果有对象的话,想不想知道你们是否能走到最后呢?我相信大家的回答都是肯定的,但是我们怎么知道什么是天命呢?

首先,我们的伴侣一定都是和人(大部分),那么既然是人,就有他的性格或者其他的一些特点,如果我们把这些特征列出来,就拿最近很火的16型人格来说,我们的性格有e/i ,n/s ,f/t ,p/j,这四种特征。把这四种特征量化为一个数组,比如【enfp】和【infj】(其中若e/i均用0/1代替就变成了数组),那么这个数组就能代表你和对象的性格,对这两个数组进行运算,也就是分析你俩的性格,要是契合度很高,那么恭喜你们有情人终成眷属啦!下面我们想象一下你的数组就是这里的向量,而我们的线性代数就是对你们的数组进行运算。

向量定义:拼在一起的有序数组,如[-1,1]。

**维数:**向量中数的个数

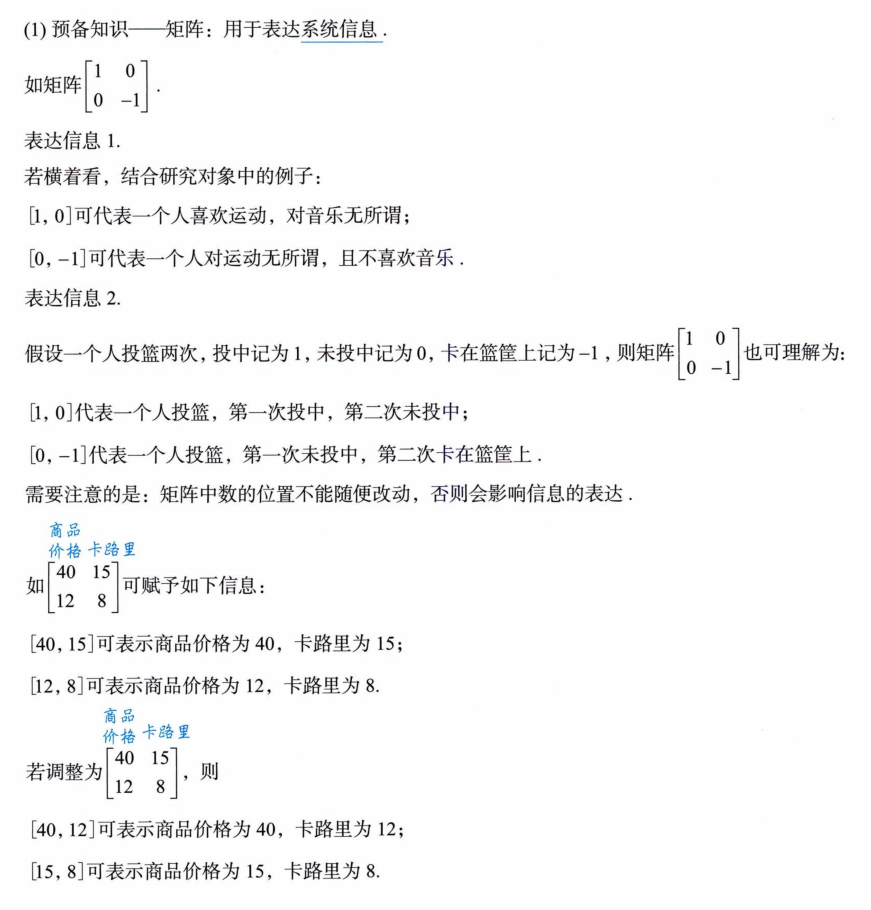

**意义:**数据可以表达的信息

实际上我们大部分时候都用x,y,z来描述向量(三维),因为用这些能比较方便的看出向量与向量的关系,也就是容易可视化。因为我们的向量这时候就能被我们画出来(例如数轴和坐标系),这样的话比较抽象的向量就被我们具象了。

而我们把这样的有序数组横着写就是行向量,竖着写就是列向量。

二 运算

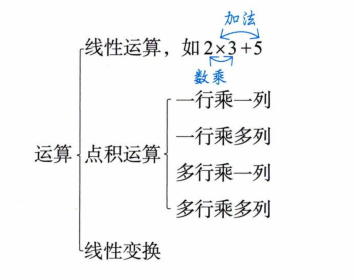

线性运算

加法就是把各位置加起来组成的新向量,数乘就是把各位置的数乘以一个数组成的新向量

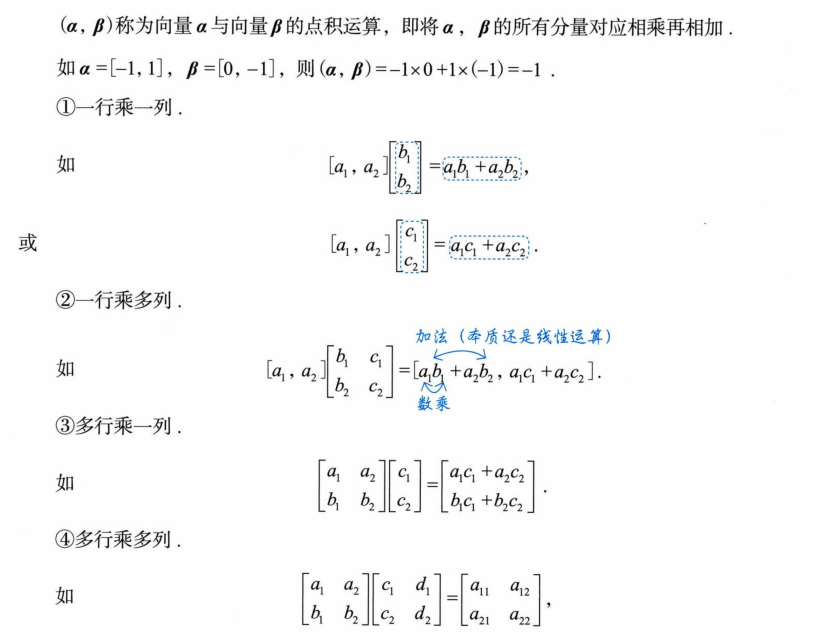

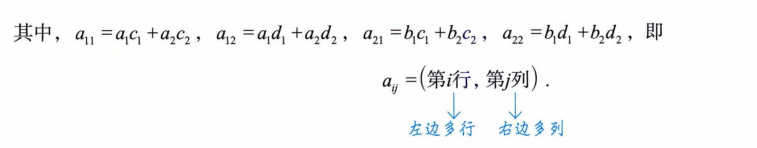

点积运算

一行乘一列就是对应位置相乘相加后的一个数,而一行乘多列则是对应的行列相乘相加组成的一个新向量。本质上还是线性运算,即我们可以把乘法看成一个不断的加法,但是我们这里的加不是结果相加,而是合并到一个新的数组里去。而合并位置则和我们原本点积左右两边的行列有关,一般是左边决定行,右边决定列。

从我们的计算方法可以看出,进行点积的两个向量必须是同维的。即左边的列数要等于右边的行数。

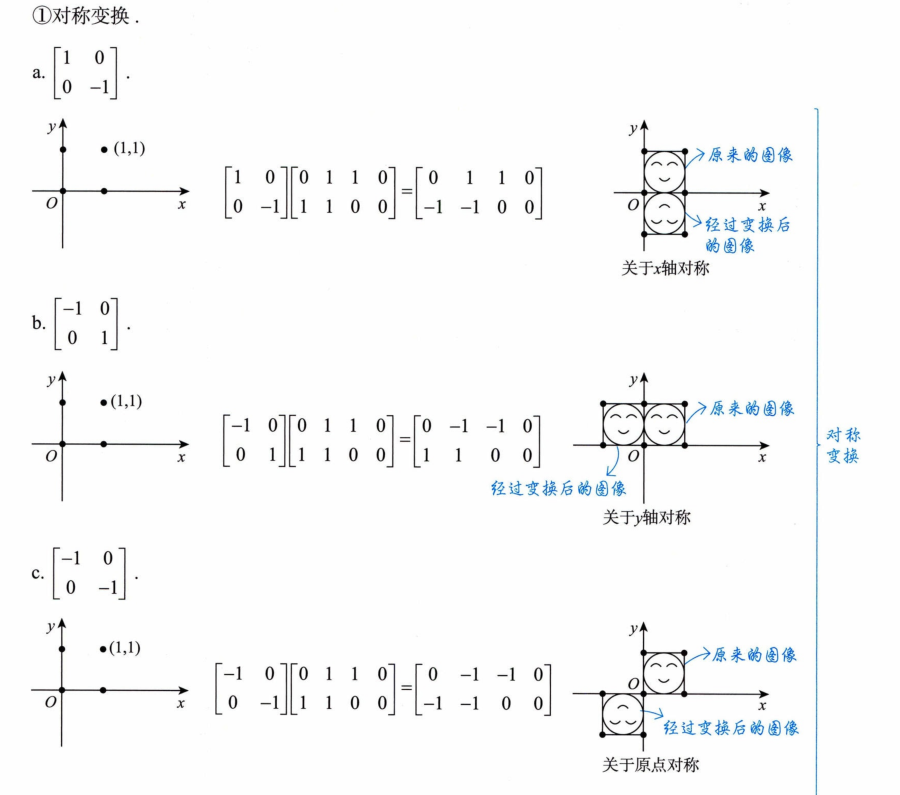

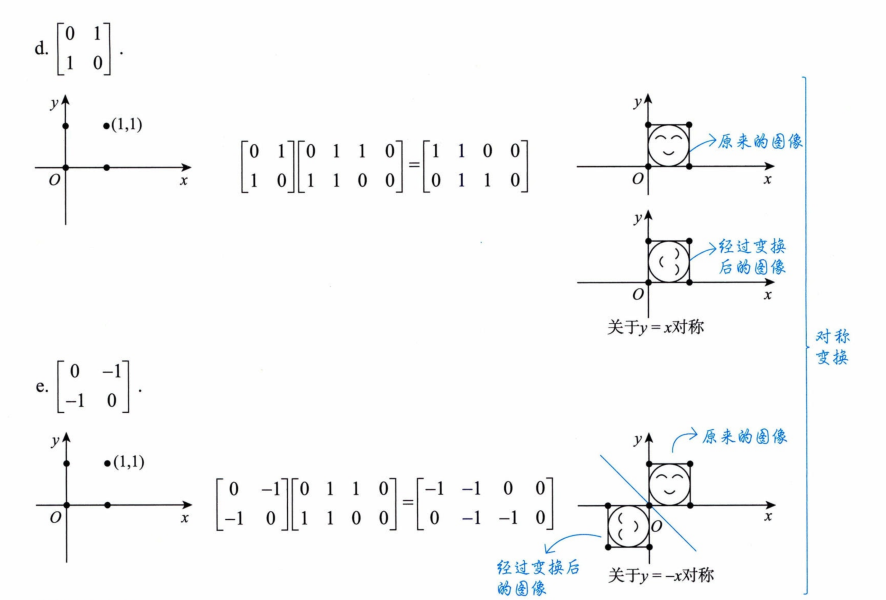

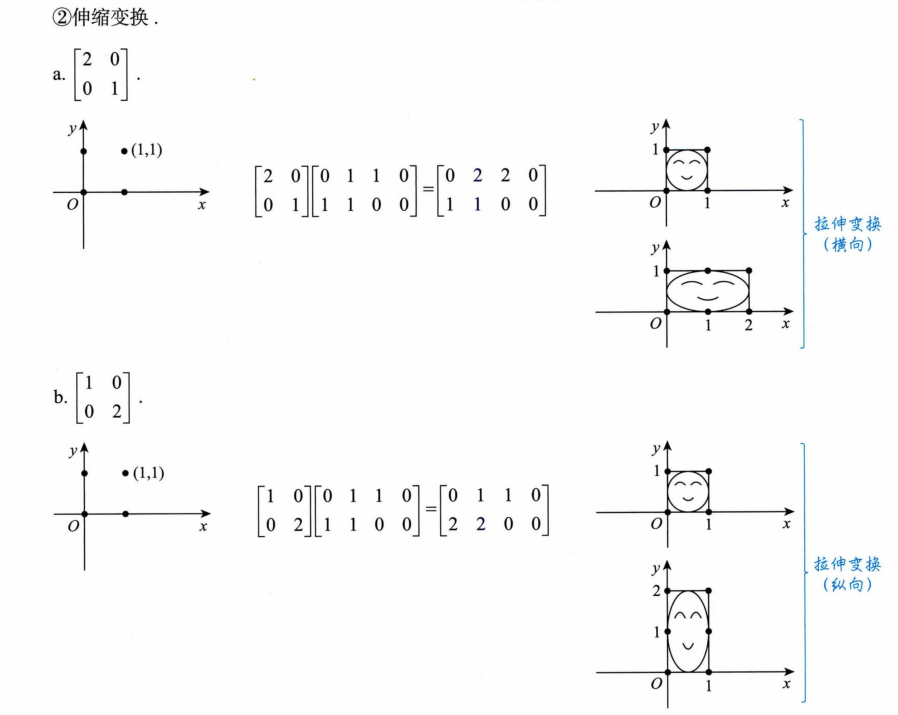

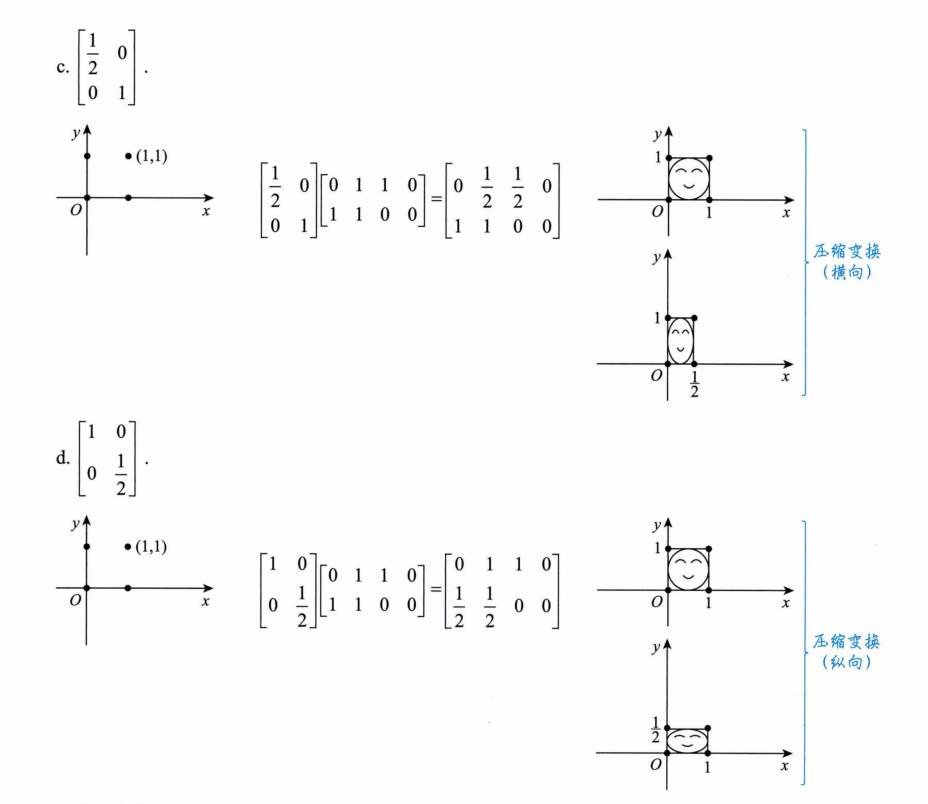

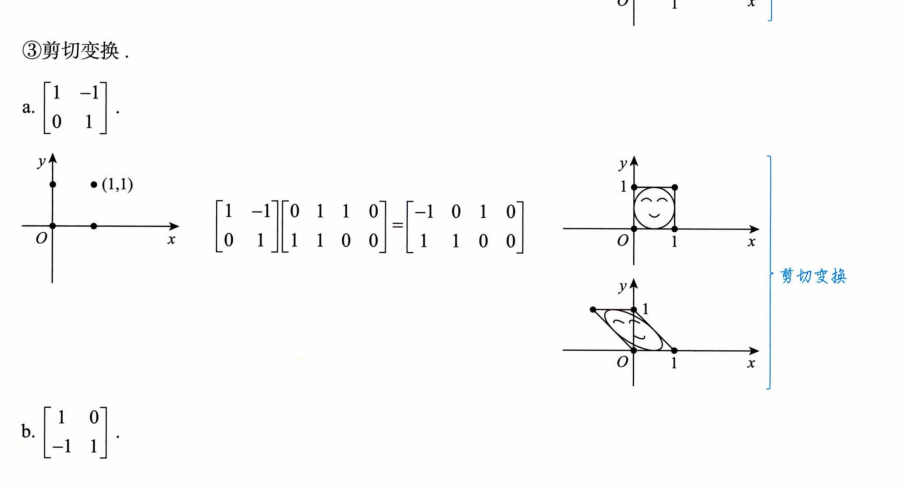

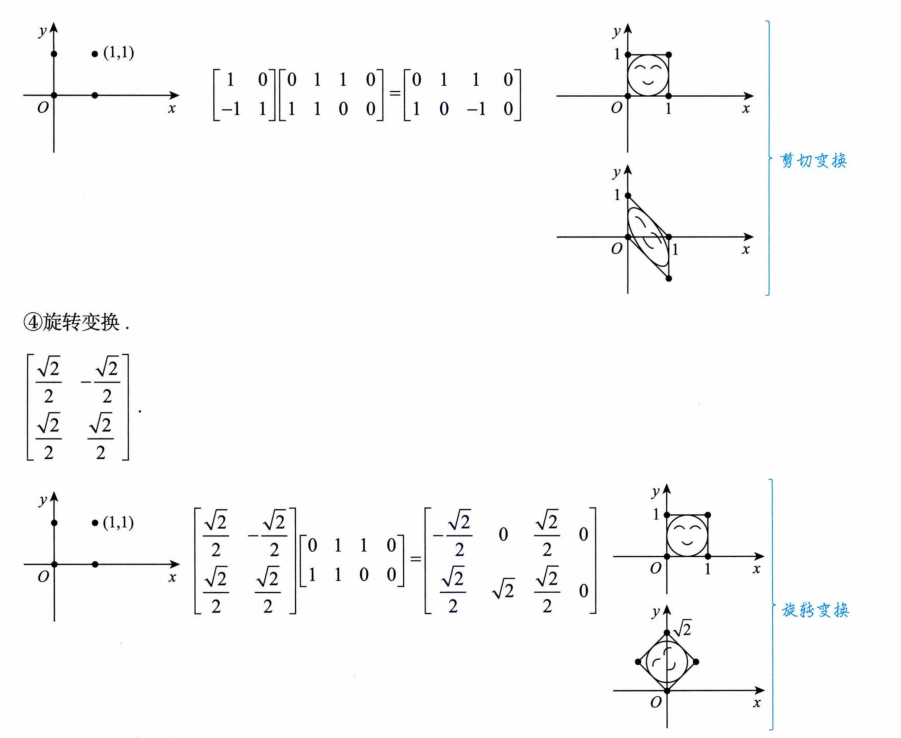

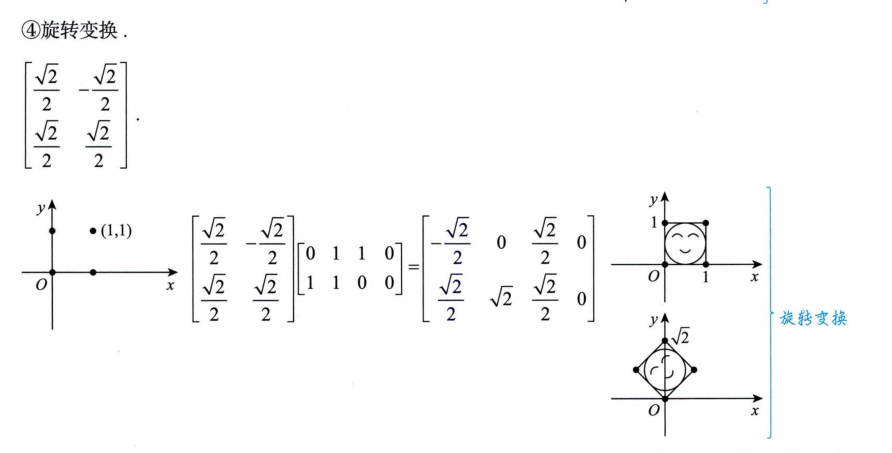

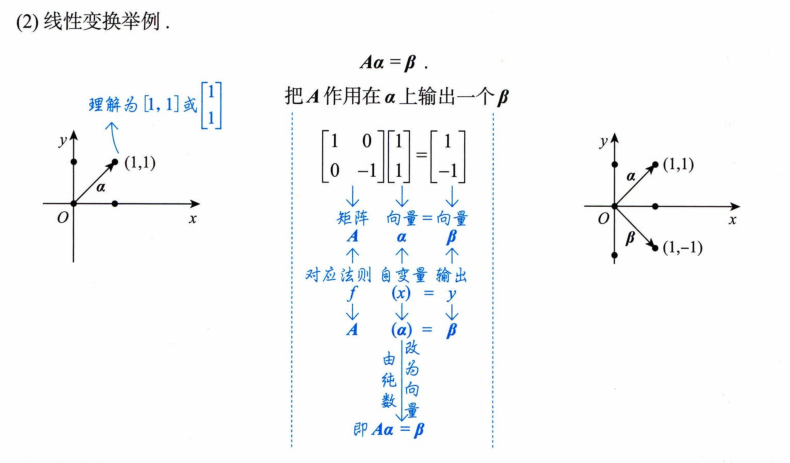

线性变换

一个向量和矩阵的点积实际上就是对这个向量做这个矩阵的对应的变换,这里的矩阵也可以近似看做高等数学里的函数f,矩阵A对向量α的变换类似于f对x的映射,f将x变为y,而A将α变为β。