Transformer-GRU、Transformer、CNN-GRU、GRU、CNN五模型时序预测对比

目录

预测效果

基本介绍

Transformer-GRU、Transformer、CNN-GRU、GRU、CNN五模型单变量时间序列预测对比 (Matlab2023b)

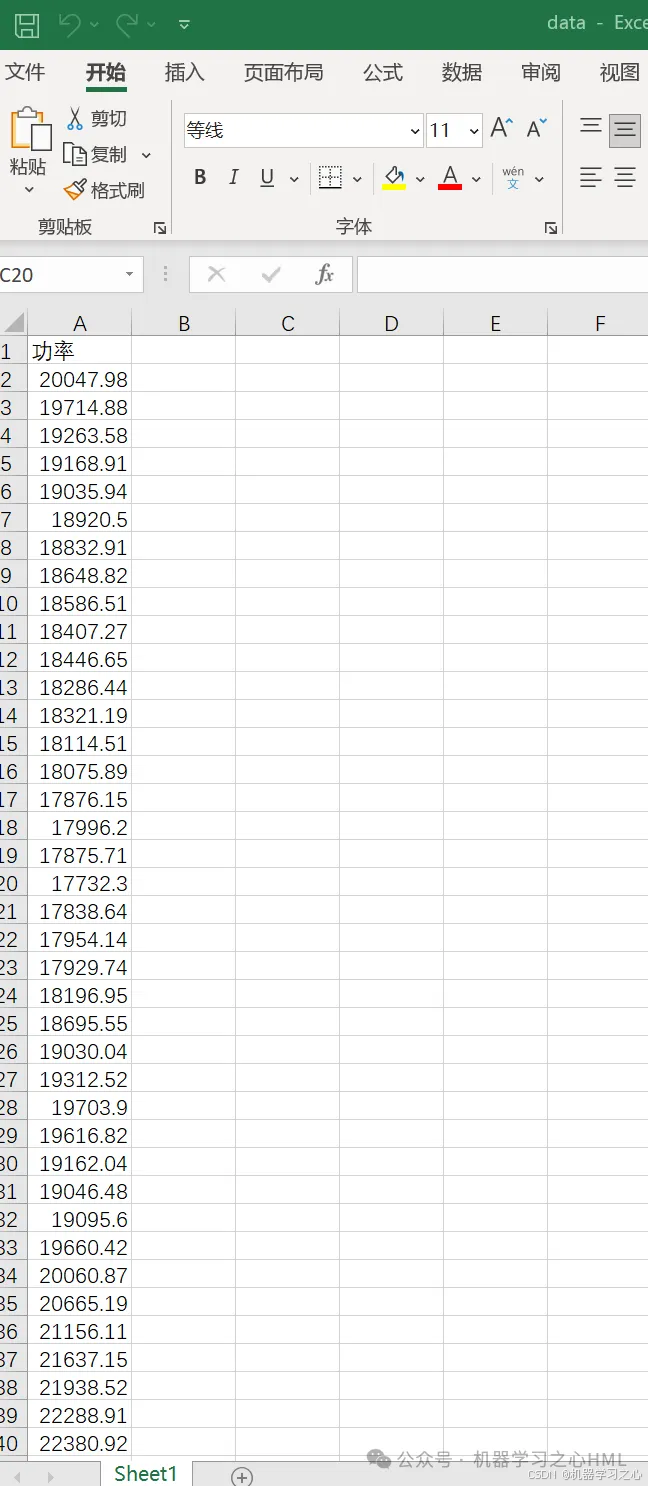

1.程序已经调试好,替换数据集后,仅运行一个main即可运行,数据格式为excel!!!

2.Transformer-GRU、Transformer、CNN-GRU、GRU、CNN五模型时间序列预测对比 (Matlab2023b 单变量时间序列预测)。

3.运行环境要求MATLAB版本为2023b及其以上。

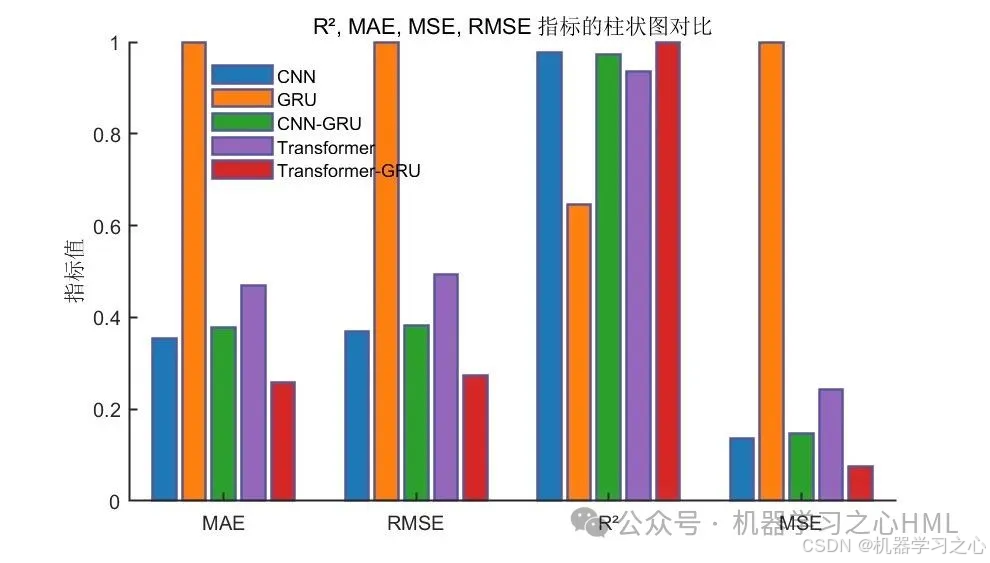

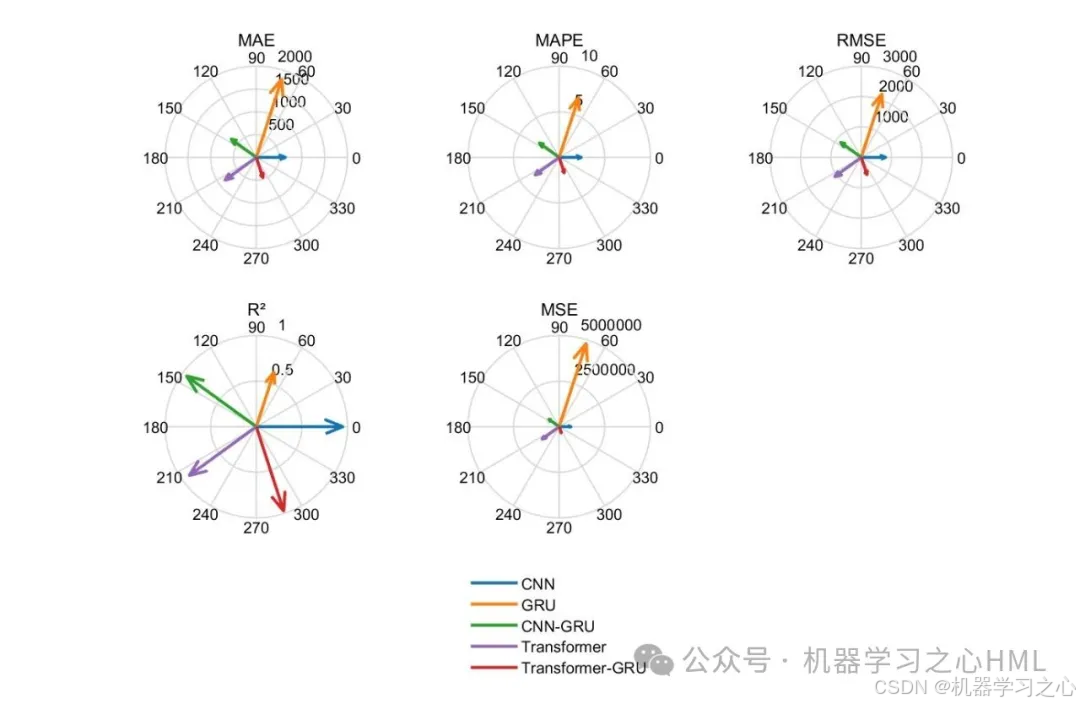

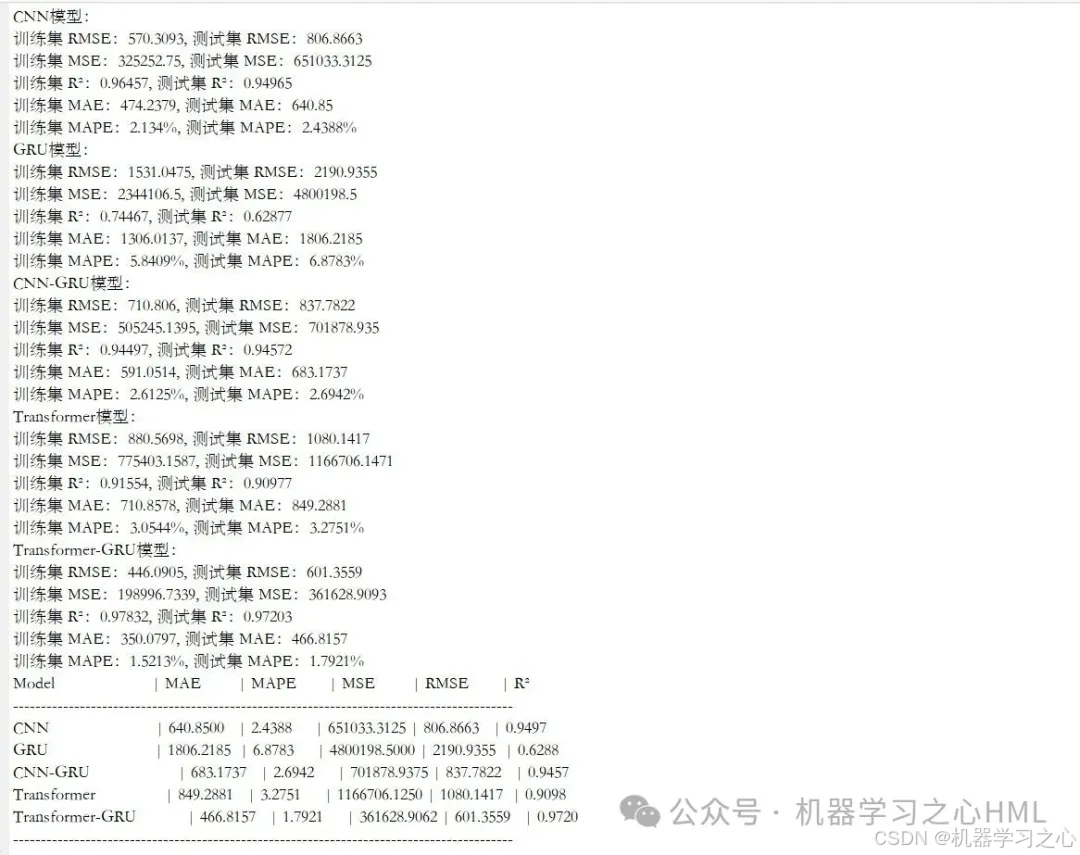

4.评价指标包括:R2、MAE、MSE、RPD、RMSE、MAPE等,图很多,符合您的需要代码中文注释清晰,质量极高。

代码主要功能

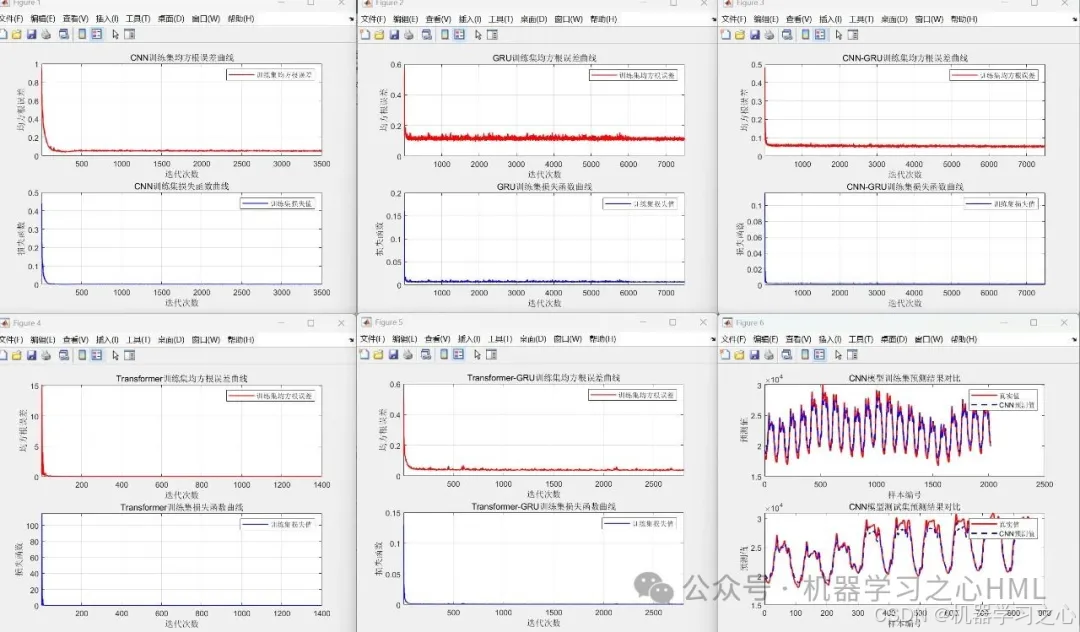

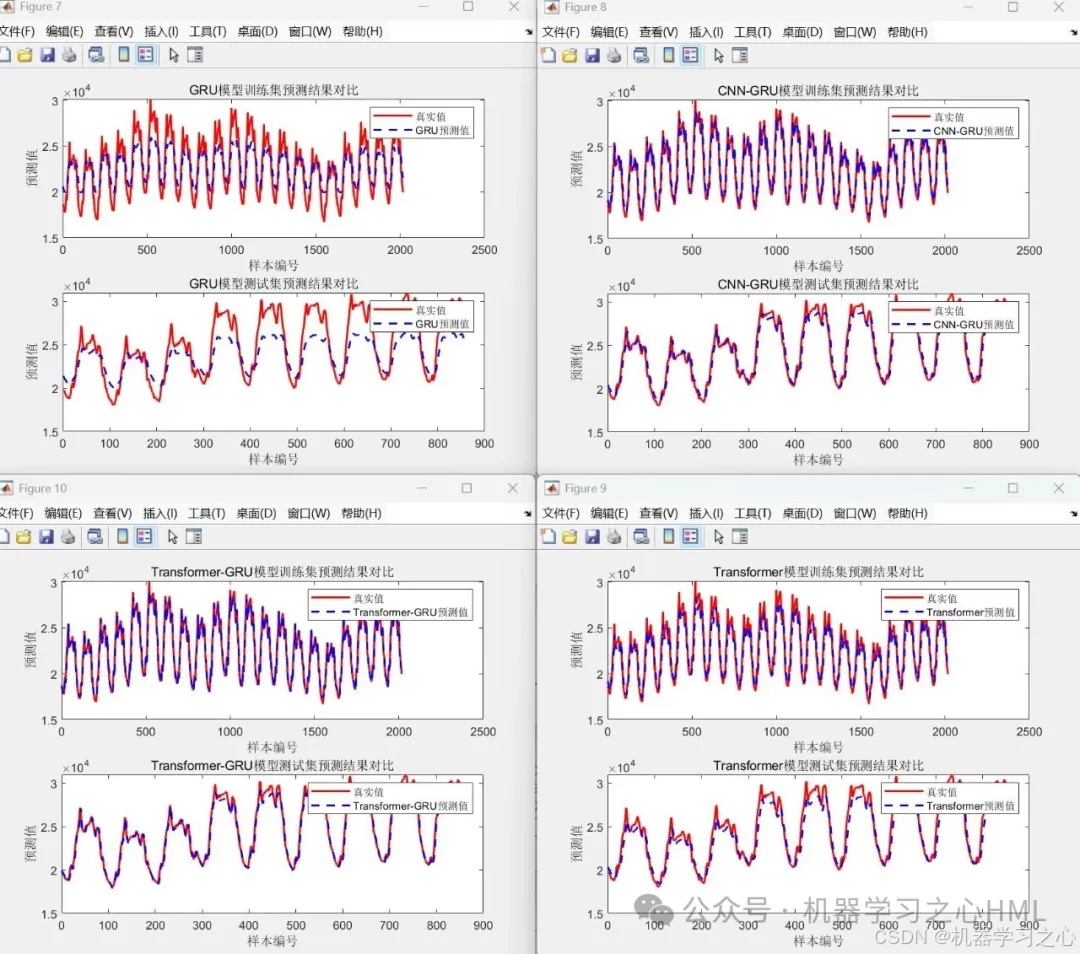

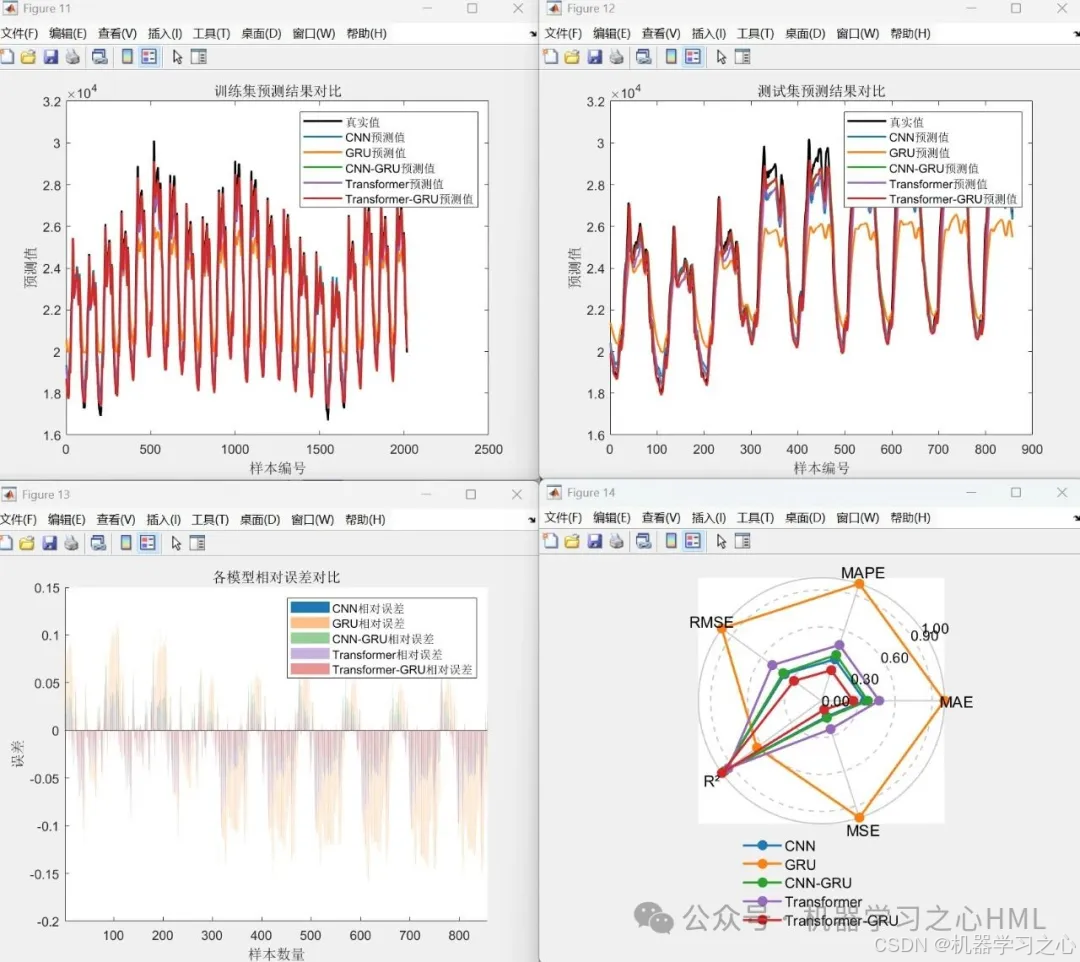

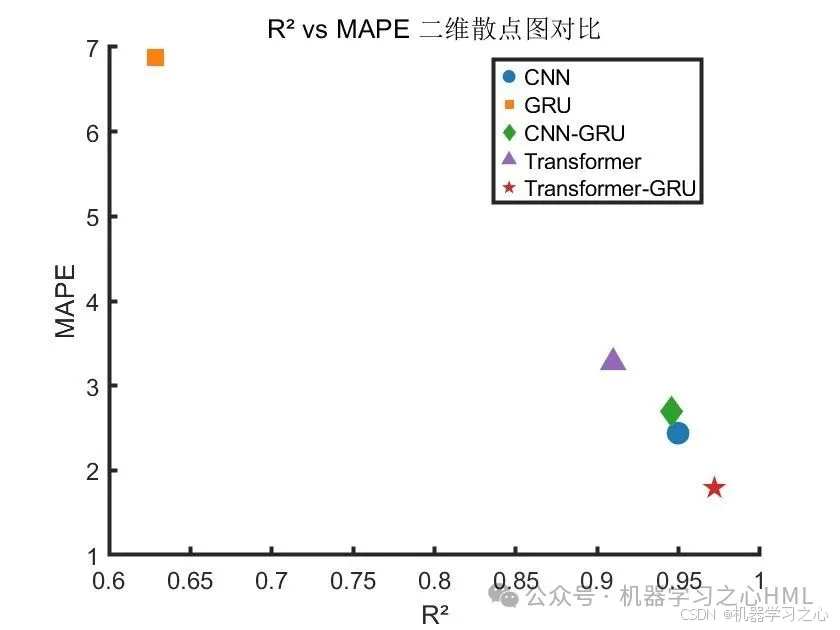

该MATLAB代码实现了一个多模型时间序列预测对比系统,使用5种深度学习模型(CNN、GRU、CNN-GRU、Transformer、Transformer-GRU)对单列时间序列数据进行预测,并全面评估模型性能。核心流程包括:

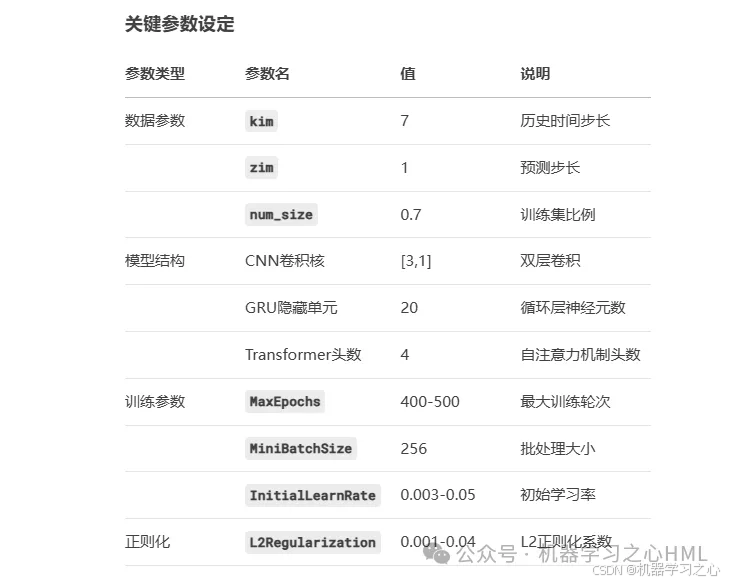

数据预处理:构建时间窗口样本(7步历史数据预测未来1步)

模型训练:并行训练5种深度学习架构

预测与评估:计算RMSE/MAE/MAPE/R²等指标

可视化分析:生成预测曲线、误差分布、雷达图等类图表

算法步骤

数据准备

导入Excel数据(data.xlsx)

构造时间窗口样本:X=[t-6,t-5,...,t] → Y=t+1

70%-30%划分训练/测试集

归一化数据到[0,1]区间

多模型训练(相同数据不同架构)

预测与反归一化

性能评估

计算5指标

生成误差分布直方图

绘制雷达图/罗盘图多维对比

可视化输出

各模型预测值 vs 真实值曲线

训练损失/误差下降曲线

五模型测试集预测对比

指标雷达图(MAE/MAPE/RMSE/R²/MSE)

程序设计

- 完整代码私信回复Transformer-GRU、Transformer、CNN-GRU、GRU、CNN五模型时序预测对比。

clike

%% 清空环境变量

warning off % 关闭报警信息

close all % 关闭开启的图窗

clear % 清空变量

clc % 清空命令行

%% 导入数据(时间序列的单列数据)

result = xlsread('data.xlsx');

%% 数据分析

num_samples = length(result); % 样本个数

kim = 7; % 延时步长(kim个历史数据作为自变量)

zim = 1; % 跨zim个时间点进行预测

%% 划分数据集

for i = 1: num_samples - kim - zim + 1

res(i, :) = [reshape(result(i: i + kim - 1), 1, kim), result(i + kim + zim - 1)];

end

%% 数据集分析

outdim = 1; % 最后一列为输出

num_size = 0.7; % 训练集占数据集比例

num_train_s = round(num_size * num_samples); % 训练集样本个数

f_ = size(res, 2) - outdim; % 输入特征维度

%% 划分训练集和测试集

P_train = res(1: num_train_s, 1: f_)';

T_train = res(1: num_train_s, f_ + 1: end)';

M = size(P_train, 2);

P_test = res(num_train_s + 1: end, 1: f_)';

T_test = res(num_train_s + 1: end, f_ + 1: end)';

N = size(P_test, 2);

%% 数据归一化

[p_train, ps_input] = mapminmax(P_train, 0, 1);

p_test = mapminmax('apply', P_test, ps_input);

[t_train, ps_output] = mapminmax(T_train, 0, 1);

t_test = mapminmax('apply', T_test, ps_output);

%% 数据平铺

% 将数据平铺成1维数据只是一种处理方式

% 也可以平铺成2维数据,以及3维数据,需要修改对应模型结构

% 但是应该始终和输入层数据结构保持一致

p_train = double(reshape(p_train, f_, 1, 1, M));

p_test = double(reshape(p_test , f_, 1, 1, N));

t_train = double(t_train)';

t_test = double(t_test )';参考资料

1\] https://blog.csdn.net/kjm13182345320/article/details/128577926?spm=1001.2014.3001.5501 \[2\] https://blog.csdn.net/kjm13182345320/article/details/128573597?spm=1001.2014.3001.5501