本文较长,建议点赞收藏,以免遗失。更多AI大模型应用开发及AI算法学习视频及资料,尽在聚客AI学院。

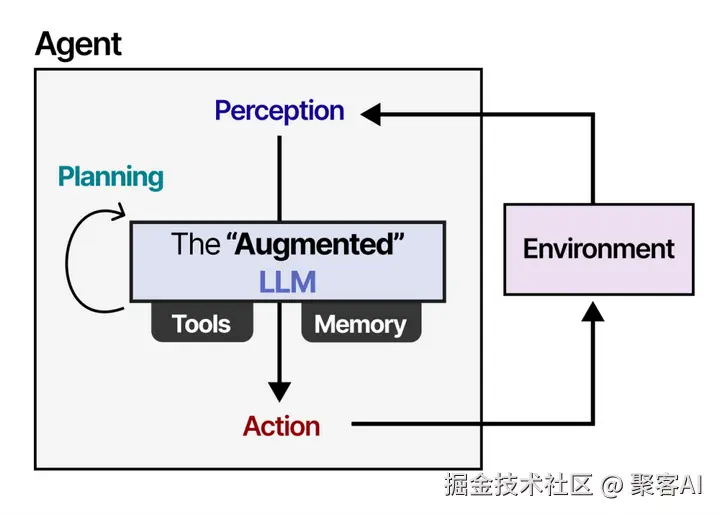

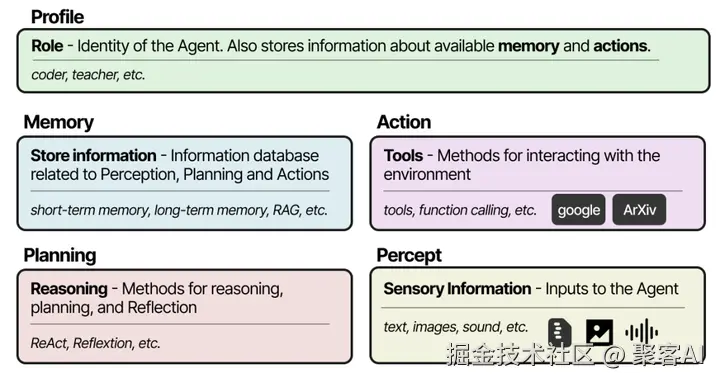

随着大语言模型(LLM)的 AI 智能体正在快速发展,逐渐超越传统对话式 LLM 的能力边界。这些智能体的强大功能依赖于多个组件的协同工作。今天我将带大家深入探索 AI 智能体的架构设计、关键技术及核心组成部分。

我们将重点关注14项关键技术:LLM智能体的基本概念、记忆机制、短期与长期记忆、工具使用、Toolformer、模型上下文协议(MCP)、规划与推理、推理与行动结合、反思机制、多智能体协作及模块化框架。

1. LLM 智能体的基本概念

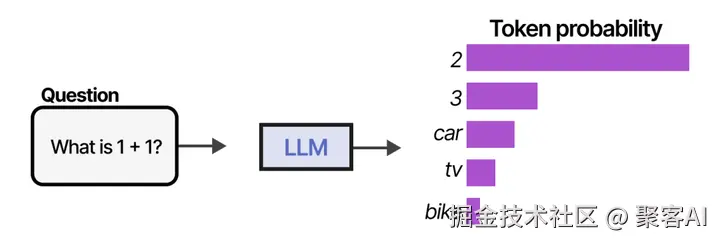

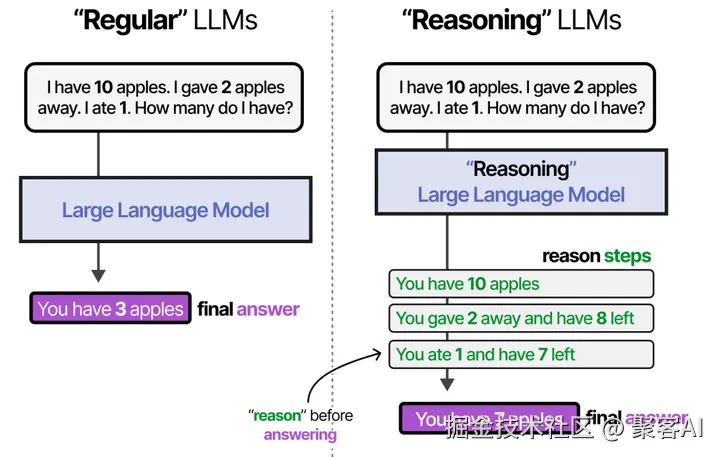

传统LLM的核心能力局限于next-token预测,通过连续采样生成对话和详细答案。但其存在明显缺陷:无法记忆对话历史,且在数学运算等任务上表现欠佳。

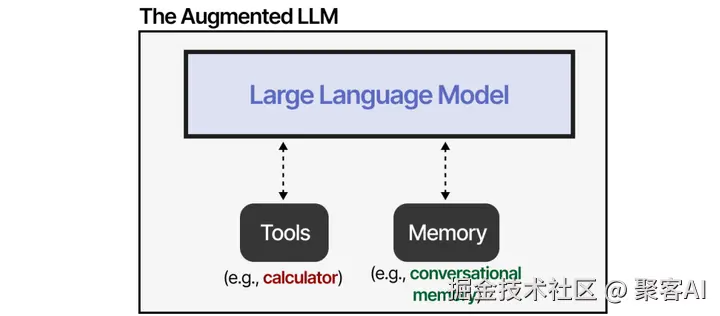

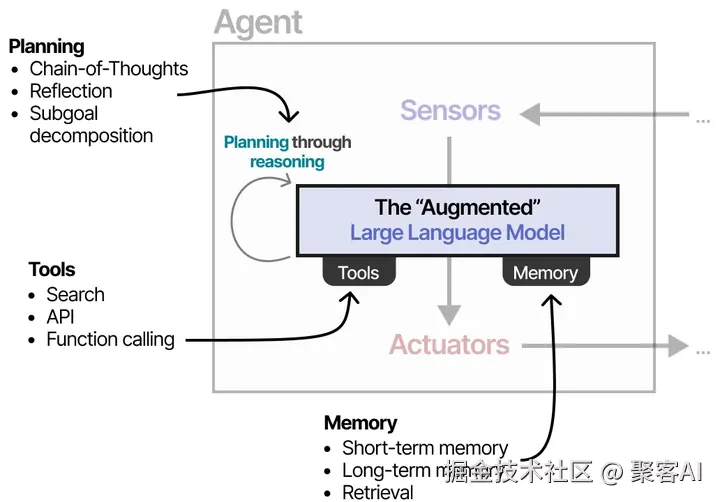

然而,通过引入外部工具、记忆和检索系统,LLM能力可获得显著增强。Anthropic将这种增强型LLM称为"增强型LLM"。

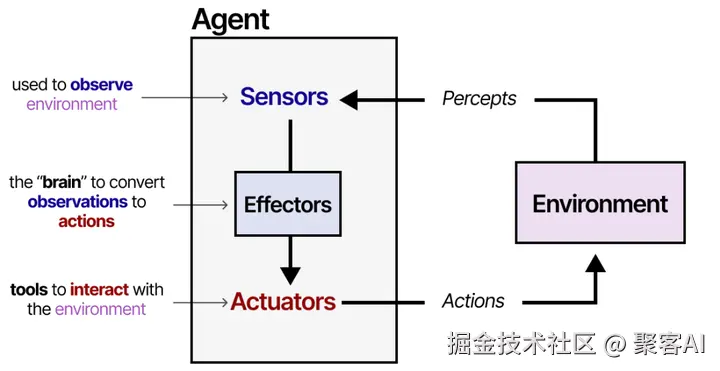

智能体的标准定义来自Russell & Norvig的《人工智能:一种现代方法》:能够通过传感器感知环境并通过执行器对环境采取行动的任何事物。智能体系统包含环境、传感器、执行器和效应器四个关键组件。

在LLM智能体中,规划能力至关重要。通过思维链等推理方法,智能体能够理解情况、规划行动、使用工具并跟踪执行过程。

2. 记忆机制

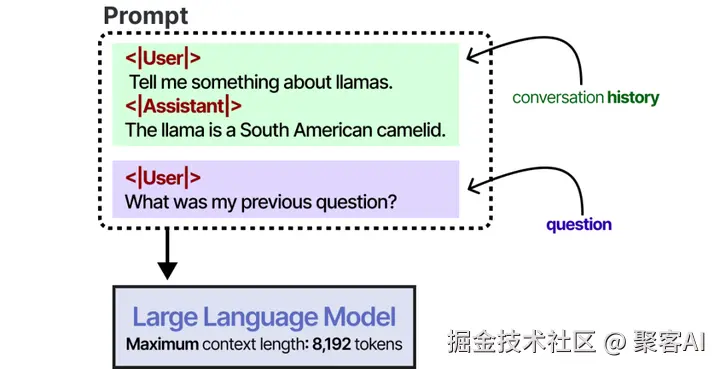

LLM本身不具备记忆能力,需要引入短期和长期记忆机制。

短期记忆使用模型的上下文窗口作为缓冲区,存储最近的对话和行动。当对话历史较长时,可通过总结方式压缩信息。

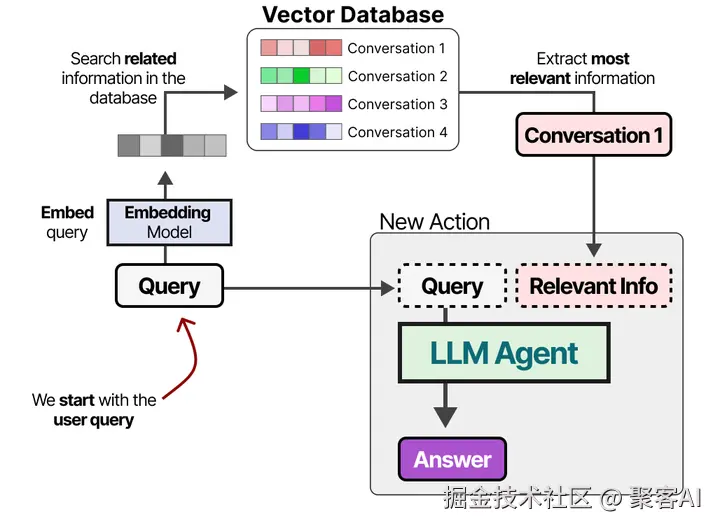

长期记忆通过外部向量数据库实现,存储所有历史互动记录。采用检索增强生成(RAG)技术,将对话嵌入为数值表示,建立可检索的记忆库。

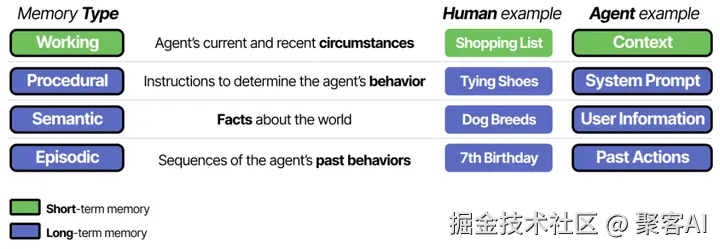

记忆系统可进一步细分为语义记忆、情景记忆、程序记忆和工作记忆,分别处理不同类型的信息存储和检索。

3. 工具使用

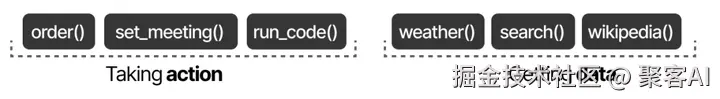

工具使LLM能够与外部环境和应用程序交互,包括数据获取和行动执行两类。工具调用通常通过JSON格式实现,也称为函数调用(Function Calling)。

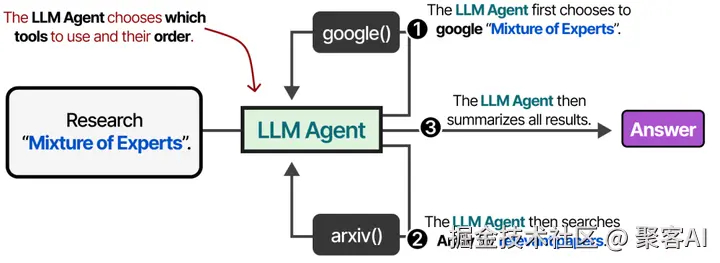

工具可按固定顺序使用,也可由LLM自主选择。智能体系统本质上是LLM调用的序列,但具备自主选择动作的能力。

4. Toolformer

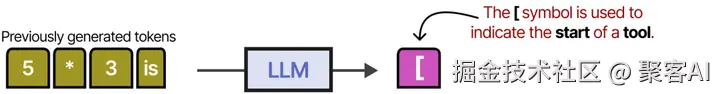

Toolformer通过训练使模型学会决定调用哪些API及如何调用。它使用特殊标记指示工具调用的开始和结束,通过精心构建的数据集训练LLM遵循工具使用格式。

5. 模型上下文协议(MCP)

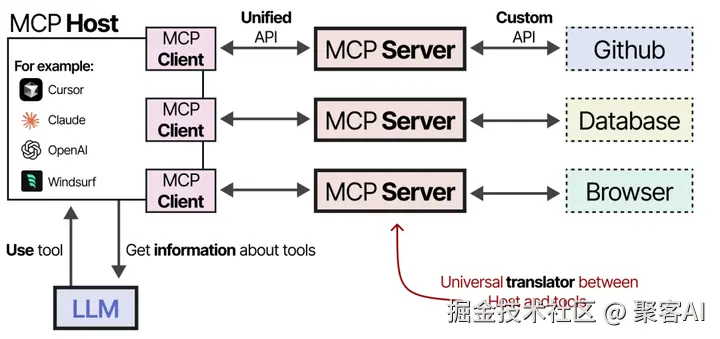

MCP标准化了对各种服务的API访问,包含三个组件:MCP主机(LLM应用程序)、MCP客户端(维护连接)和MCP服务器(提供上下文和能力)。

6. 规划与推理

规划涉及将任务分解为可执行步骤,需要复杂的推理能力。通过微调或提示词工程实现推理行为,思维链技术能引导LLM展现复杂的推理过程。

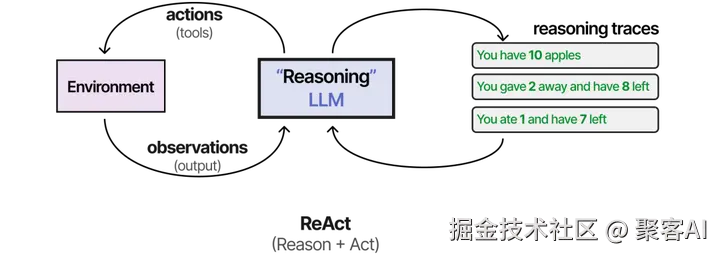

ReAct(推理与行动)框架将推理和工具使用结合,通过"思考-行动-观察"循环实现自主行为。

由于文章篇幅有限,关于ReAct(推理与行动)框架工作原理我之前整理了一个技术文档,这里作为补充,粉丝朋友自行查阅:《 Python 和 LLM 从头构建 ReAct 代理全流程》

7. 反思机制

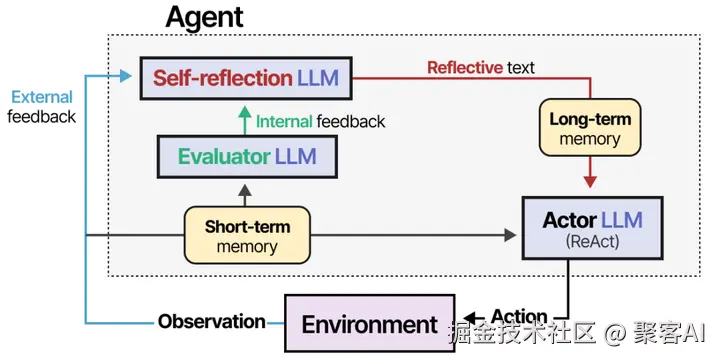

Reflexion技术通过语言强化帮助智能体从失败中学习,包含三个角色:行动者、评估者和自我反思。SELF-REFINE技术则通过同一LLM生成输出、细化输出和反馈。

8. 多智能体协作

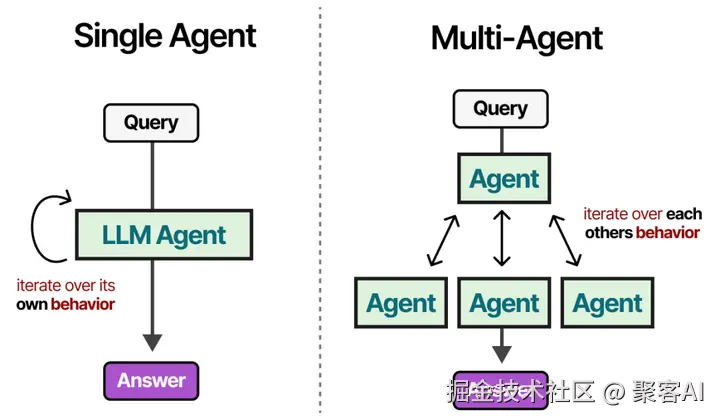

多智能体系统由专业化智能体组成,每个智能体配备专用工具,由主管协调通信和任务分配。

9. 模块化框架

流行框架如Spring AI Alibaba、AutoGen、MetaGPT和CAMEL采用不同的通信方式。CAMEL采用角色扮演方法,AutoGen和MetaGPT强调智能体间的协作沟通。

笔者总结

LLM智能体通过记忆、工具和规划三大核心组件的协同工作,实现了超越传统对话式LLM的能力。随着多智能体框架的快速发展,2025年将是智能体技术成熟和应用爆发的重要一年。好了,今天的分享就到这里,我们下期见。