今年,全球 AI 大模型持续快速迭代,无论是GPT、Gemini、Claude等系列,还是DeepSeek、Qwen、Doubao等系列,都在不断演进,近期备受关注的Gemini 3.0,据说也将正式发布。在这一发展浪潮中,Dify 作为一款开源低代码大模型应用开发平台,为开发者和企业提供了全新的 AI 应用构建体验。

本文将结合热门的 Dify 与 AiOnly 平台,以互动故事机的聊天机器人为例,逐步介绍如何从零开始调用模型,构建专属 AI工作流。

一、集成顶尖大模型的MaaS平台

1.1 常见的接入挑战

若想搭建专属 AI 工作流,第一步便是挑选合适的大模型API进行调用,然而,在考虑 GPT-5、Gemini 2.5、Claude 4.1等热门大模型时,却常常会遇到以下问题。

1.1.1 访问困境

网络访问是接入这些模型的首个挑战,即便使用魔法,简单的文本生成请求也可能耗时数秒甚至超时失败,而在进行多轮对话、图像生成等大流量交互时,连接中断更是家常便饭。

1.1.2 地区限制、注册门槛

除了网络问题,地区支持也是一大障碍,国内开发者即使完成注册,也可能因 IP 归属地问题被拒绝服务。注册本身也存在门槛,比如要求境外手机号、信用卡、邮箱等,让人难以触及。

1.1.3 多平台管理难、使用成本高

在模型调用方面,不同模型需要独立的 API 密钥、调用协议和参数格式, 开发者需为每个模型编写适配代码,仅参数配置文件就可能多达十余份。模型版本更新、密钥过期或权限调整时,需逐一登录相应平台进行操作,流程繁琐且容易出错,维护不及时还可能引发服务中断。

在Token费用方面,各平台计费规则也不统一, 比如订阅制、积分制等多种方式,不仅提高了使用成本,还可能因规则不透明,导致超额扣费或资源闲置。

1.2 AiOnly全球大模型服务平台

为了便于开发者一站式调用API,MaaS大模型服务平台日渐兴起,成为项目开发必不可少的工具。

除了集成自研大模型的厂商,我最近意外发现了AiOnly平台,提供企业级的API服务,极大降低了海外访问成本,以及模型Token使用成本,同时,高并发支持,多账号轮询超越原厂水平,尤其是高速专线,国内直连最新顶尖大模型,比如最近很火的Nano Banana。

深度体验了一下AiOnly,平台注册简便,开箱即用,并提供免费体验额度, 而且采用按量计费(Token或次数),灵活性高。模型广场涵盖了大部分主流和热门模型,满足文本、图像、视频、语音等多类场景需求,不仅支持API调用,也可在线体验各种AI多模态生成能力。

二、前期部署+环境准备

2.1 安装Docker 环境

Docker 是一个开源的容器化平台,用于开发、交付和运行应用,使应用及其依赖能够以轻量级、可移植的方式打包并运行在任何环境中。Dify 平台基于 Docker 进行部署,因此我们需要先安装 Docker 环境。

2.1.1 下载并安装Docker Desktop

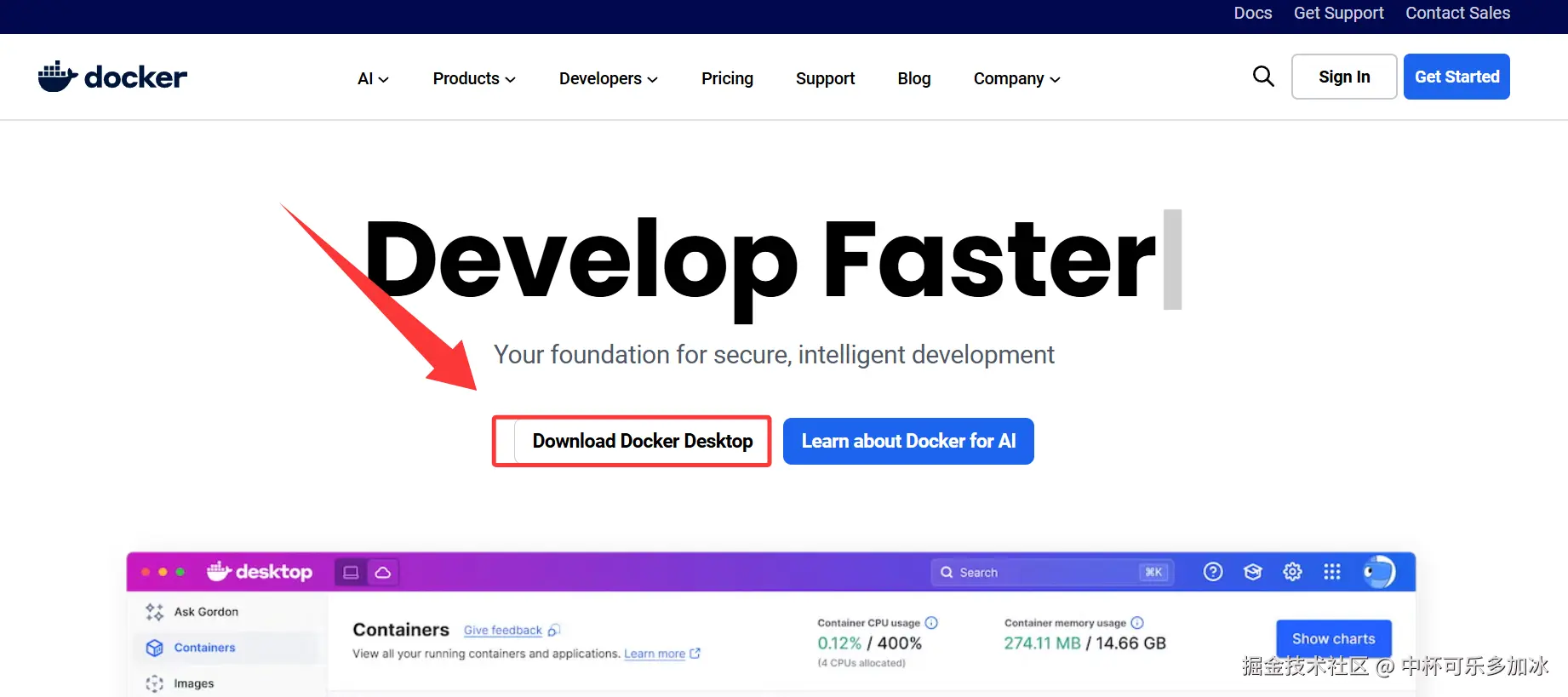

这里我们直接进入 Docker 的官网:www.docker.com/ ,选择Docker,Desktop点击下载

2.1.2 配置国内镜像源

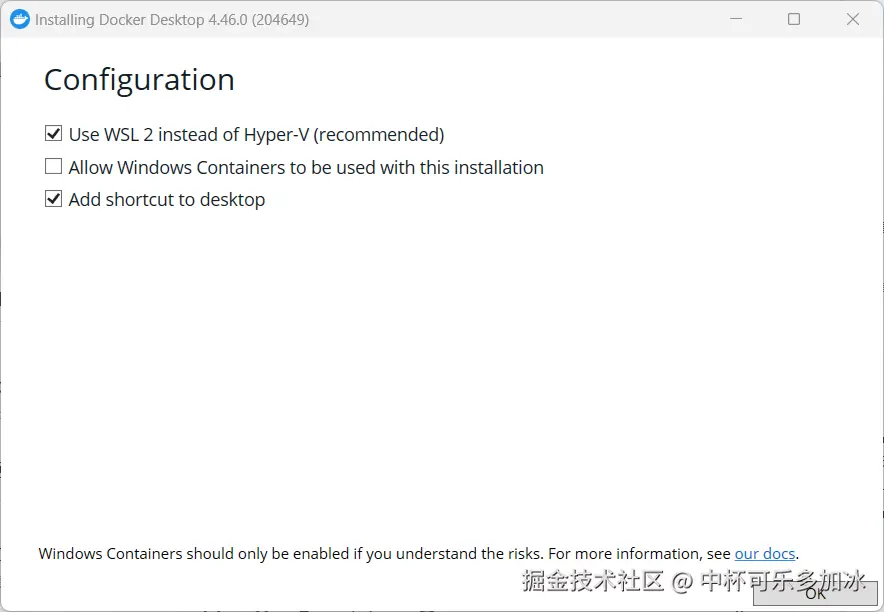

然后,点击 安装包 进行安装,出现这个界面后,直接点击 OK,进行下一步操作。

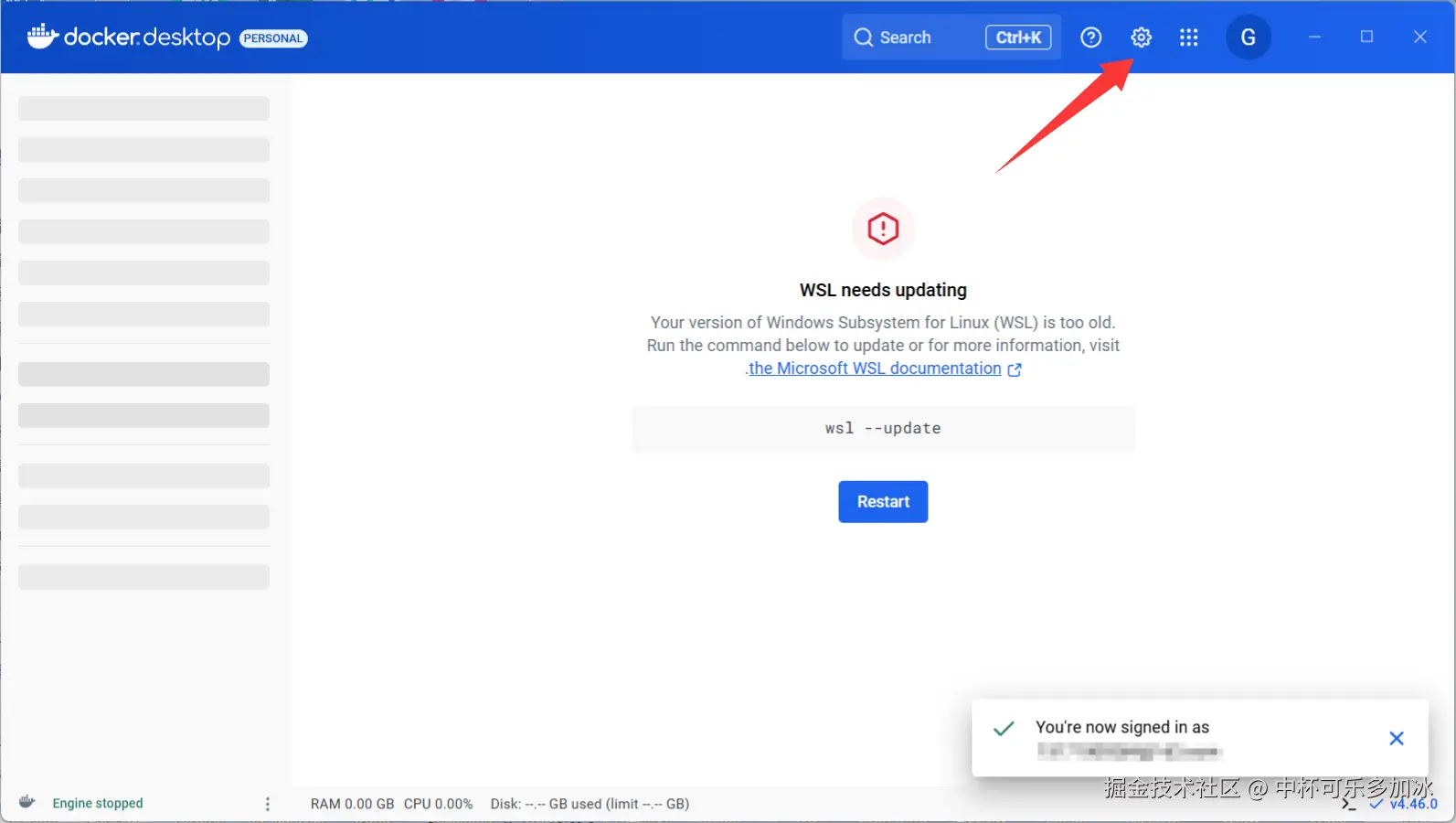

安装完成后,我们启动 Docker Desktop ,然后选择 Google 账号或 GitHub 账号登录即可。

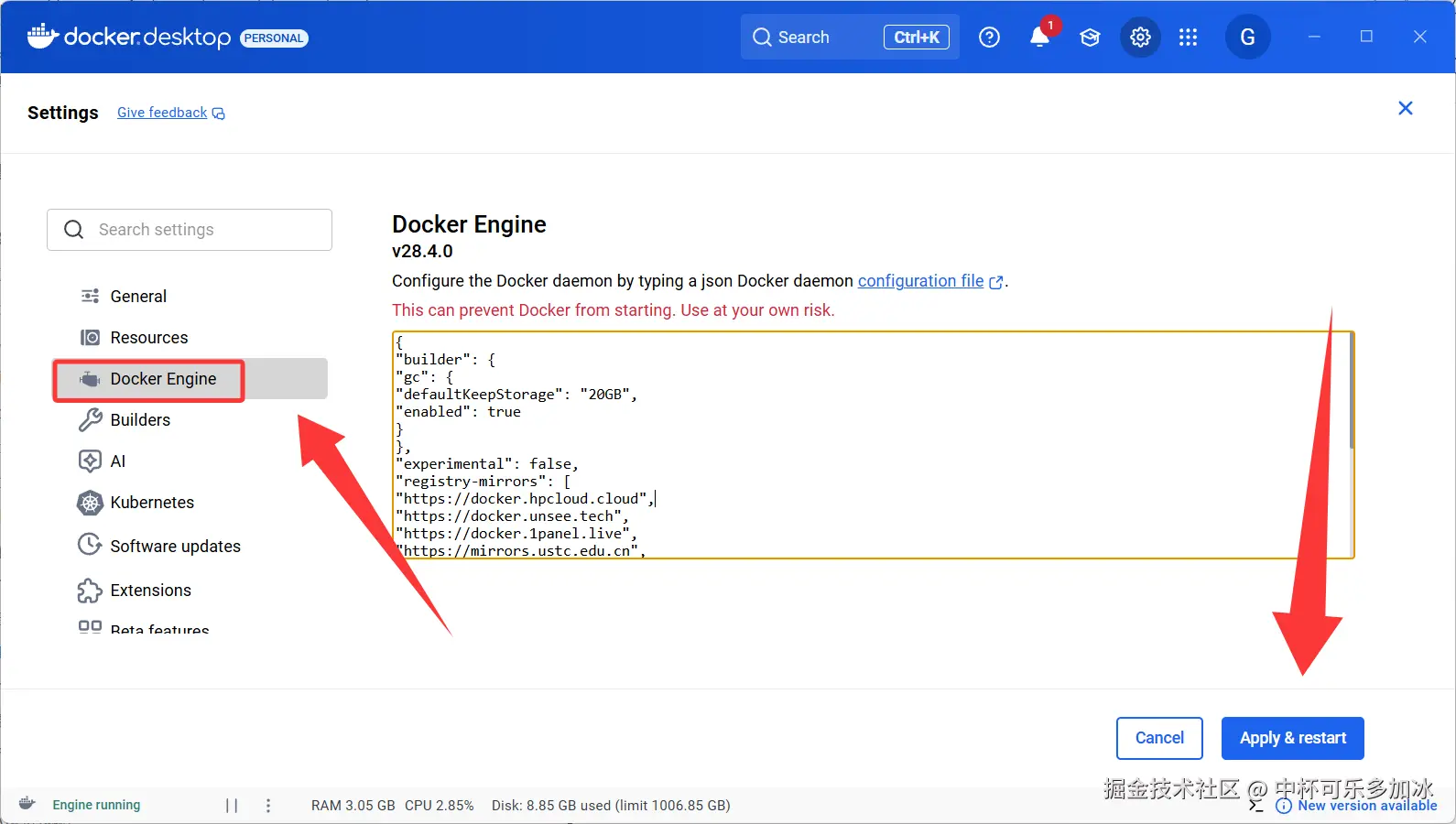

之后,点击 设置 更换为 国内镜像源,不然我们在部署Dify时会出现拉取报错、网络访问不畅等情况。

json

{

"builder": {

"gc": {

"defaultKeepStorage": "20GB",

"enabled": true

}

},

"experimental": false,

"registry-mirrors": [

"https://docker.hpcloud.cloud",

"https://docker.m.daocloud.io",

"https://docker.unsee.tech",

"https://docker.1panel.live",

"https://mirrors.ustc.edu.cn",

"https://docker.chenby.cn",

"https://mirror.azure.cn",

"https://dockerpull.org",

"https://dockerhub.icu",

"https://hub.rat.dev",

"https://proxy.1panel.live",

"https://docker.1panel.top",

"https://docker.m.daocloud.io",

"https://docker.1ms.run",

"https://docker.ketches.cn"

]

}复制粘贴到 **Docker Engine **,然后点击 重启与应用 就好了。

2.2 使用Docker快速部署Dify

2.2.1 拉取并部署Dify

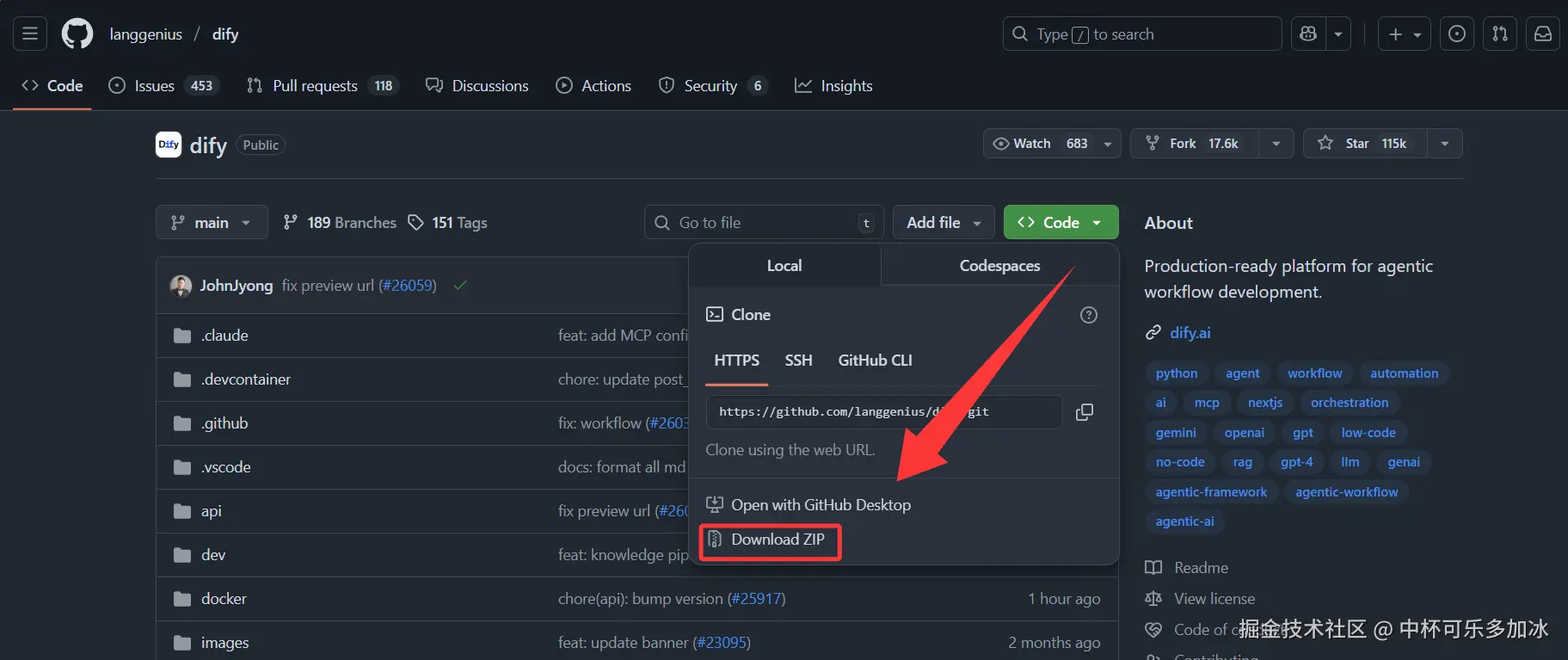

这里点击访问 <github.com/langgenius/... 本地部署的话,直接选择下载> ZIP 文件或使用 Git 克隆项目。

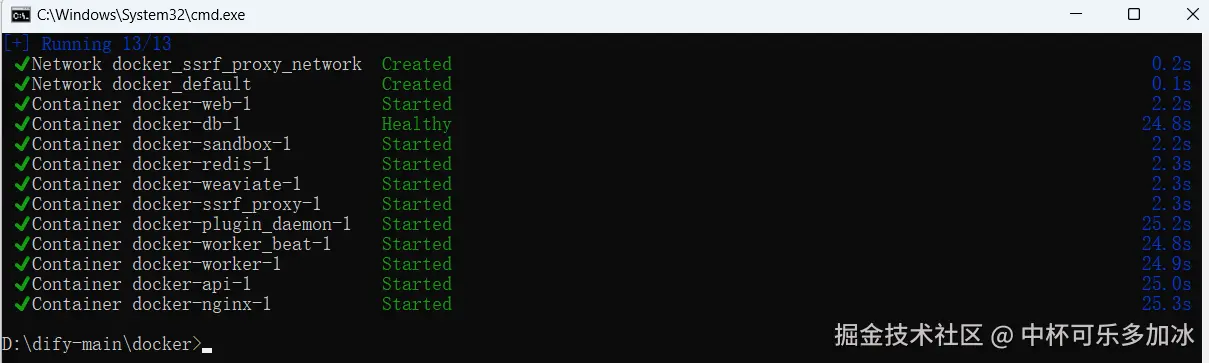

2.2.2 启动Dify服务

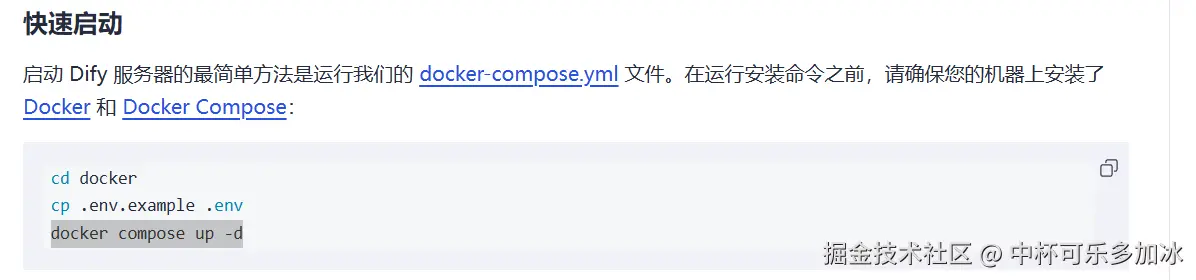

然后,解压进入 Dify 文件的Docker 文件,将隐藏文件** .env.example 改为 .env**

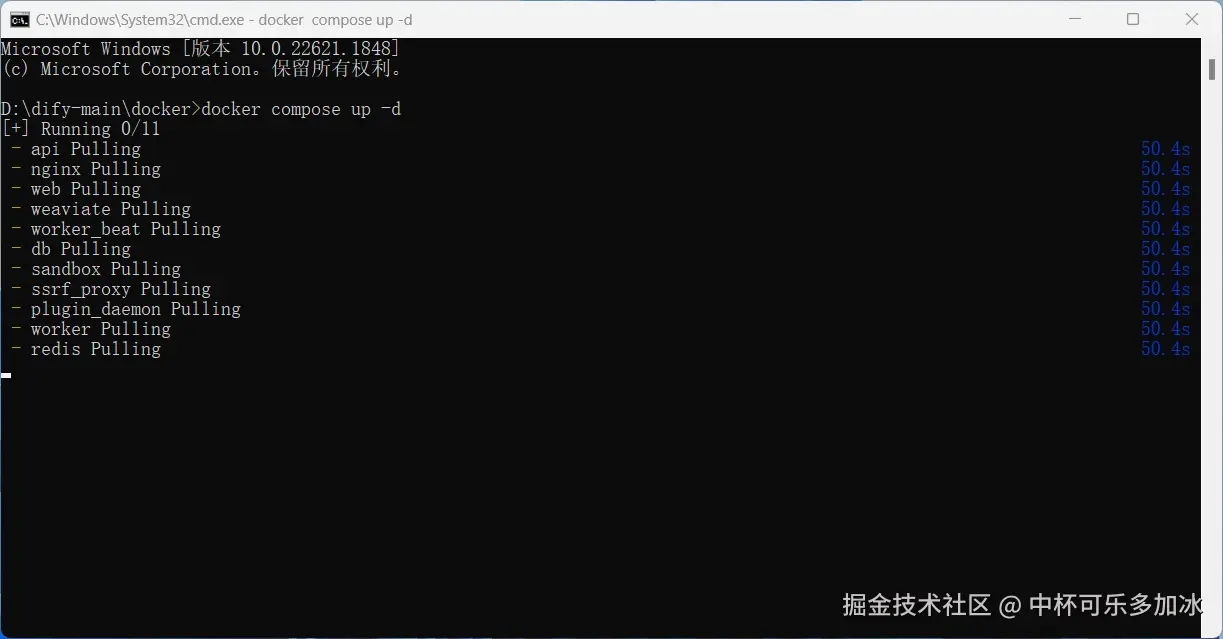

然后,进入该目录的终端操作界面,就可以一键部署Dify了。

2.2.3 访问 Dify 平台

等待部署完成后,我们只需要在浏览器输入 http://127.0.0.1 即可访问 Dify 平台, 进行注册使用即可。

三、AiOnly+Dify 应用构建实战

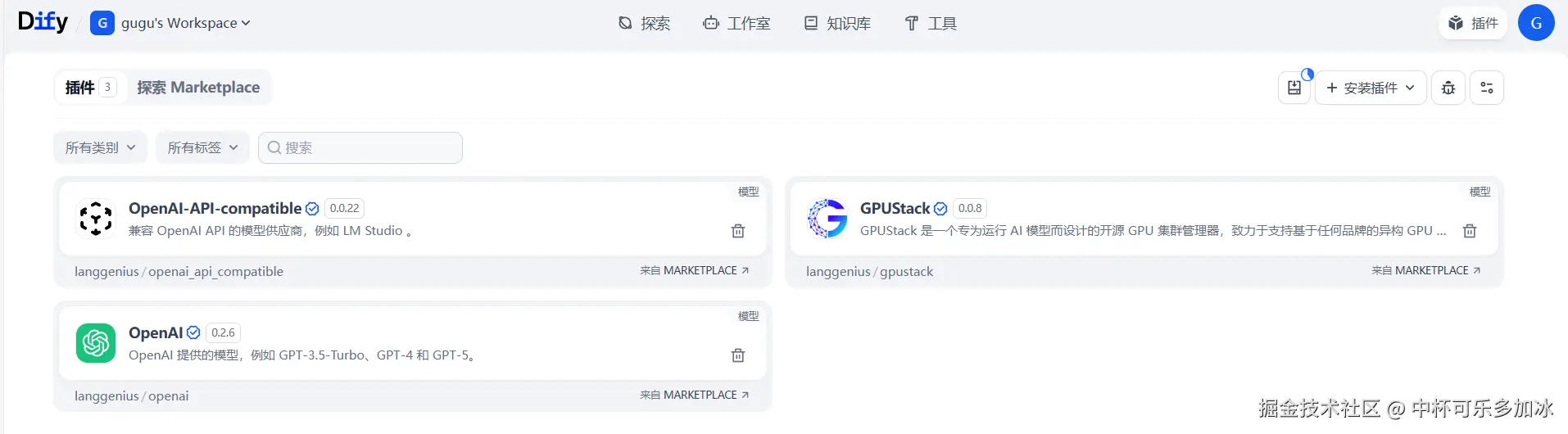

3.1 添加 OpenAI模型插件

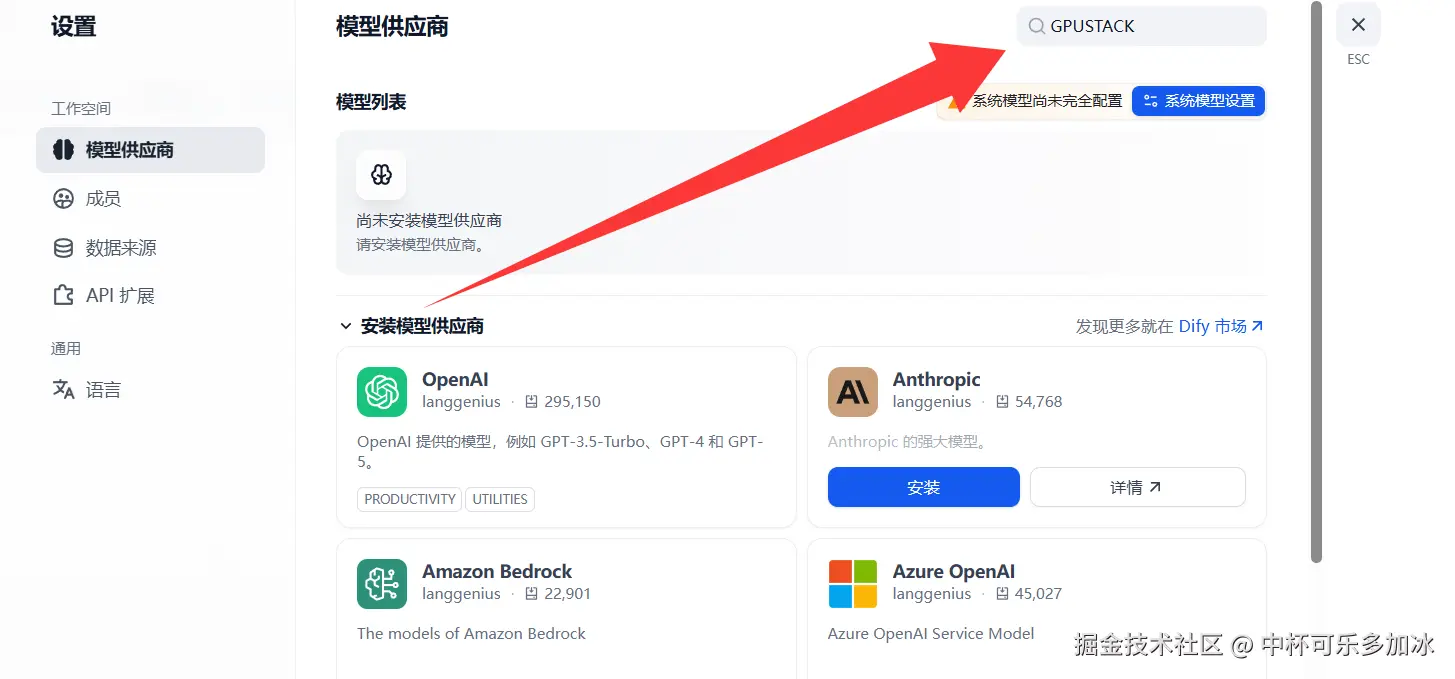

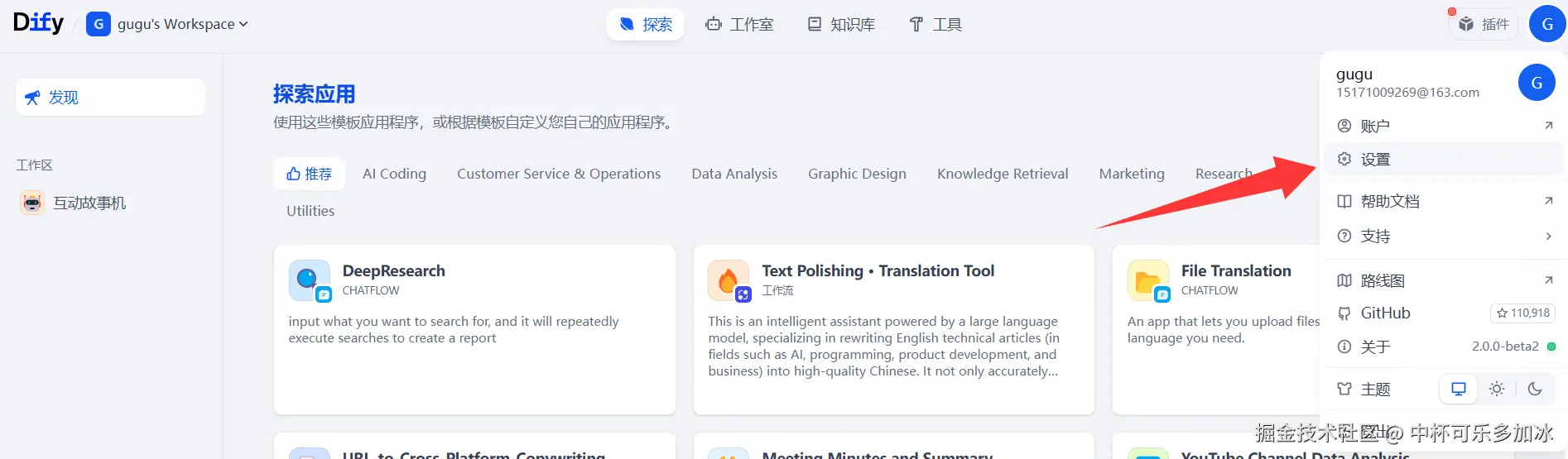

进入Dify前端界面后,打开 Dify 的Settings 进行设置。

选择导航栏 Model Provider ,添加兼容 OpenAI 接口的模型插件,比如 GPUSTACK。

然后,安装一下插件。

3.2 获取 AiOnly GPT-5 大模型 API

3.2.1 添加模型名称

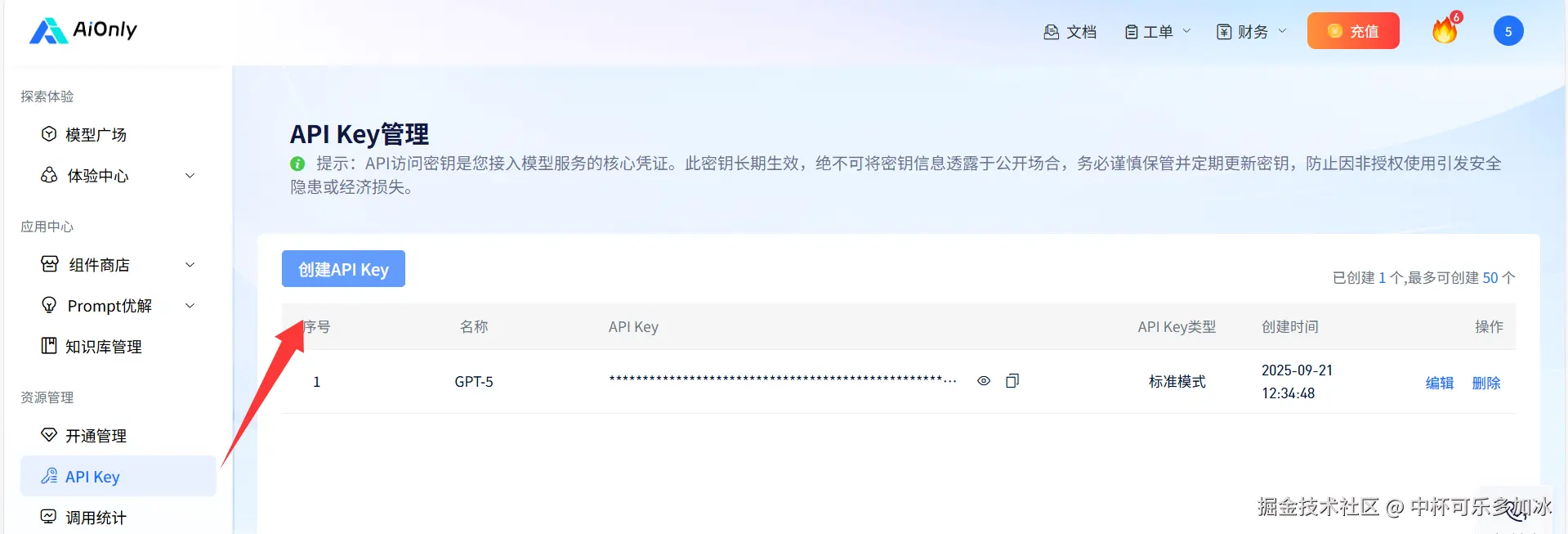

3.2.2 创建 AiOnly key

注册登录 AiOnly,进入控制台左侧的资源管理 ,点击 创建API Key 。

前往 模型广场 ,直接开通 GPT-5 的模型服务,然后,在开通管理里,就可以看到模型名称。

3.2.3 添加顶尖大模型

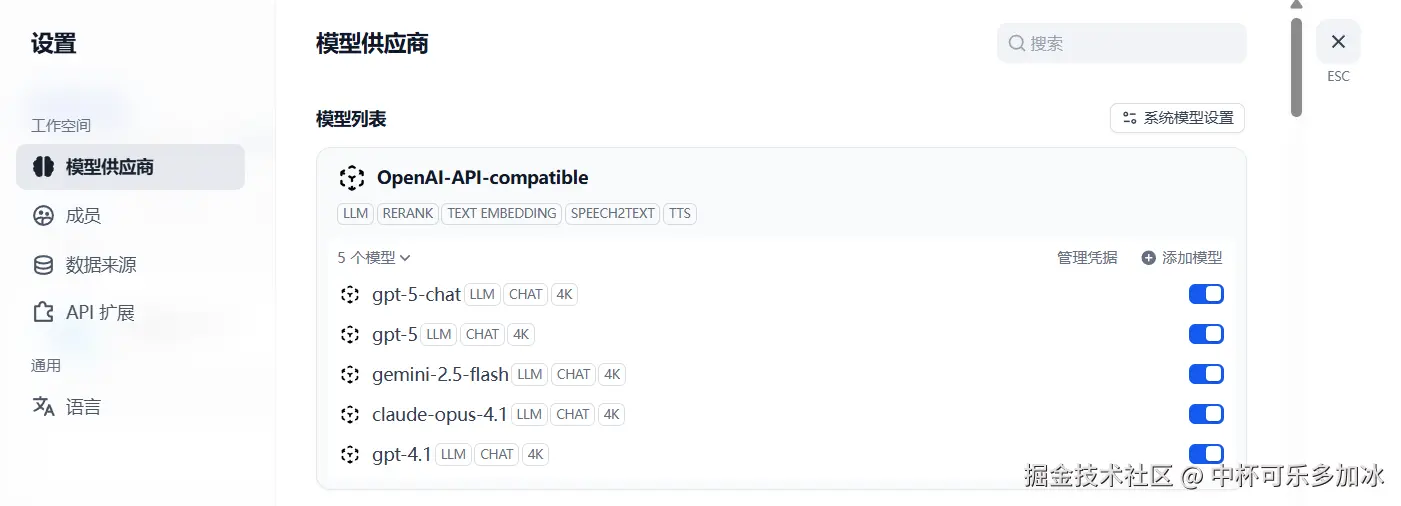

我们点击** Dify 的设置 , 进入模型供应商选项中,添加模型。**

然后,添加模型时,填写我们的 模型名称和API key,API endpoint URL 处填写: api.aiionly.com/v1

设置完成后,便可在模型列表中,看到我们新增的模型了。

3.3 构建 AI 应用

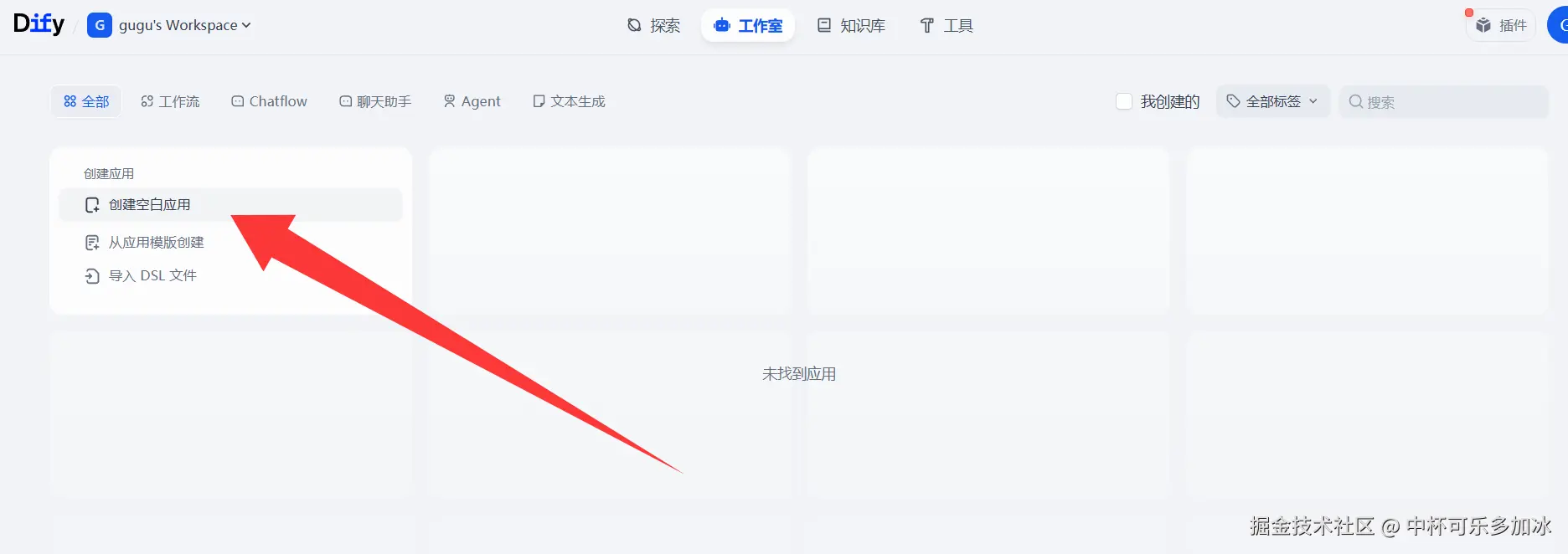

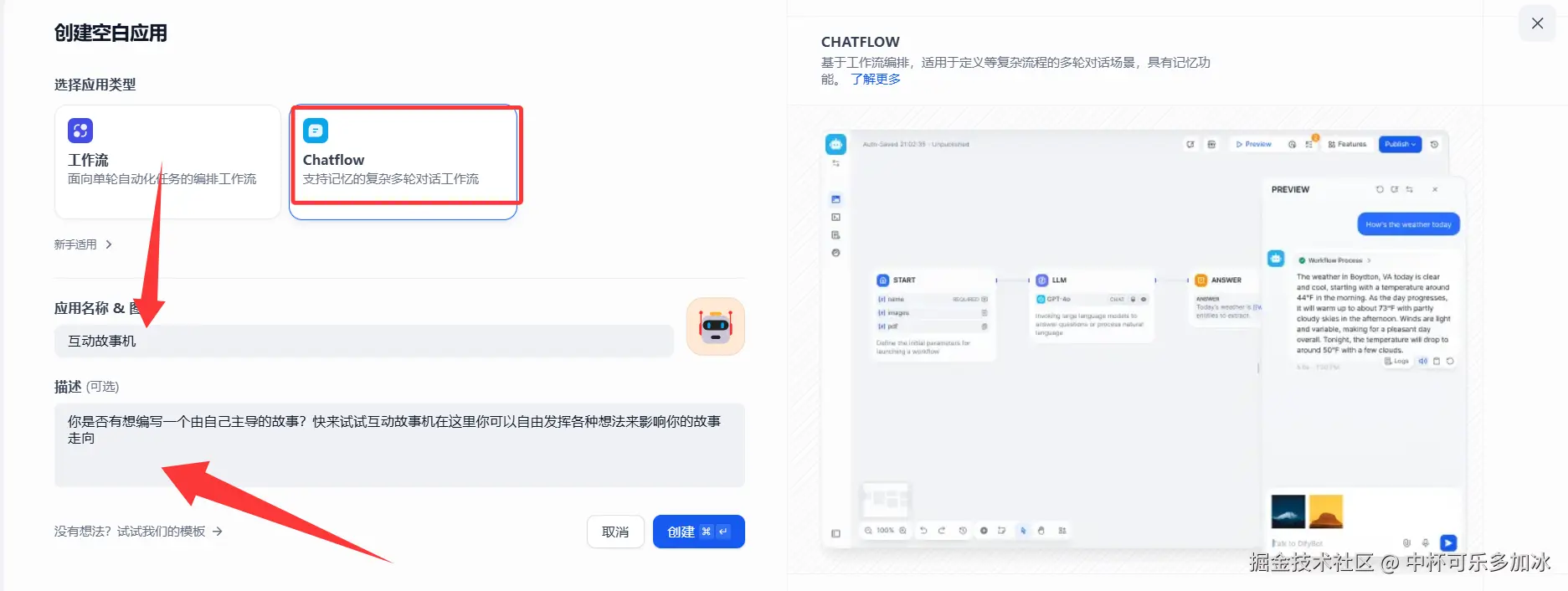

在** Dify 主界面**,选择 创建空白应用 。

由于我们此次要构建的是聊天机器人, 因此直接选择支持记忆功能的复杂多轮对话工作流 即可。然后,还需为聊天机器人拟定名称 ,并描述其所需具备的功能。

3.4 编排工作流节点

点击创建, 我们就进入到Agent里的工作流编排,在这里,可以对模型进行调整、预览效果等等。

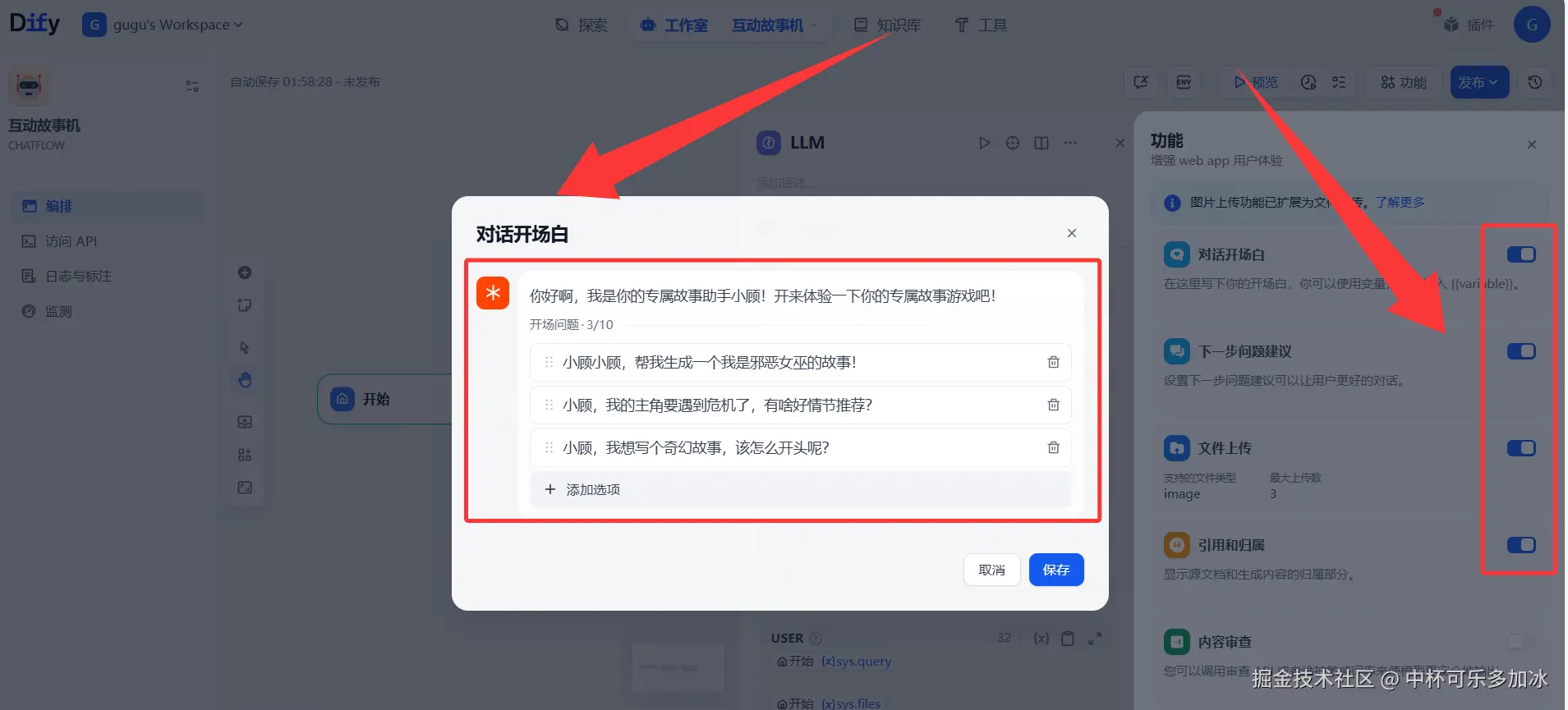

点击此处功能模块, 就可继续对** Agent 应用的搭建与配置。选择支持提供下一步操作建议、文件上传等实用功能,**让我们的聊天机器人进一步完善,提升交互体验与实用价值。

3.5 启动工作流查看运行效果

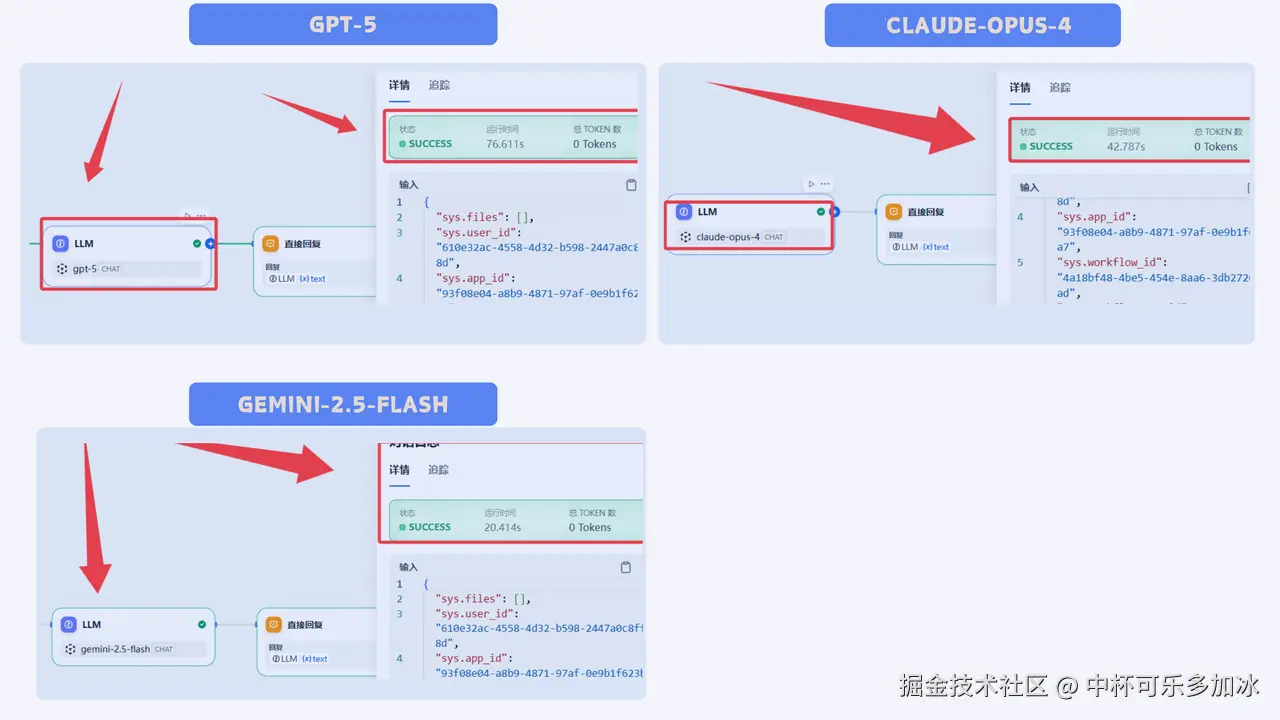

在Agent 工作流编排期间,我们还可以对应用进行调试,选择合适的大模型接入。在AiOnly平台,我们无需额外配置,仅一个接口就可以使用各种全球大模型。 这里我选择了 GPT-5、gemini-2.5-flash、claude-opus-4 进行了测试。

其中备受争议的GPT-5,推理和输出token效果最好,尽管生成用时略长,但它所创作的故事内容丰富详实、情节生动精彩。相比之下,Gemini 与 Claude 的其他版本,在文本故事生成场景中表现稍逊,不仅整体效果不及GPT-5,生成的故事文本长度也明显不足。由于版本能力差异,以上仅供参考。

四、AiOnly 平台更多实用功能

除了基础的大模型服务之外,AiOnly还提供一系列增强功能,例如 Prompt 优化工具与 RAG 知识库管理系统,帮助用户更高效地构建和应用AI能力。

4.1 Prompt优化工具的创作实践

对于缺乏 AI 使用经验的用户而言,编写有效的 Prompt 可能存在困难,很多并不擅长如何向AI表达自己的需求,要么表述过于笼统,比如仅一句 "帮我写篇文章",让 AI 无从判断内容方向、风格基调与核心重点,要么遗漏关键信息,而Prompt优化工具就可以完美帮我们解决这个事情。

当我们给 Prompt 优化工具分配任务时,它会按步骤展开工作:先分析输入 prompt 的结构,识别出指令不够明确、格式要求不清晰等问题,再直接将其优化重构为专业度极高的 prompt。

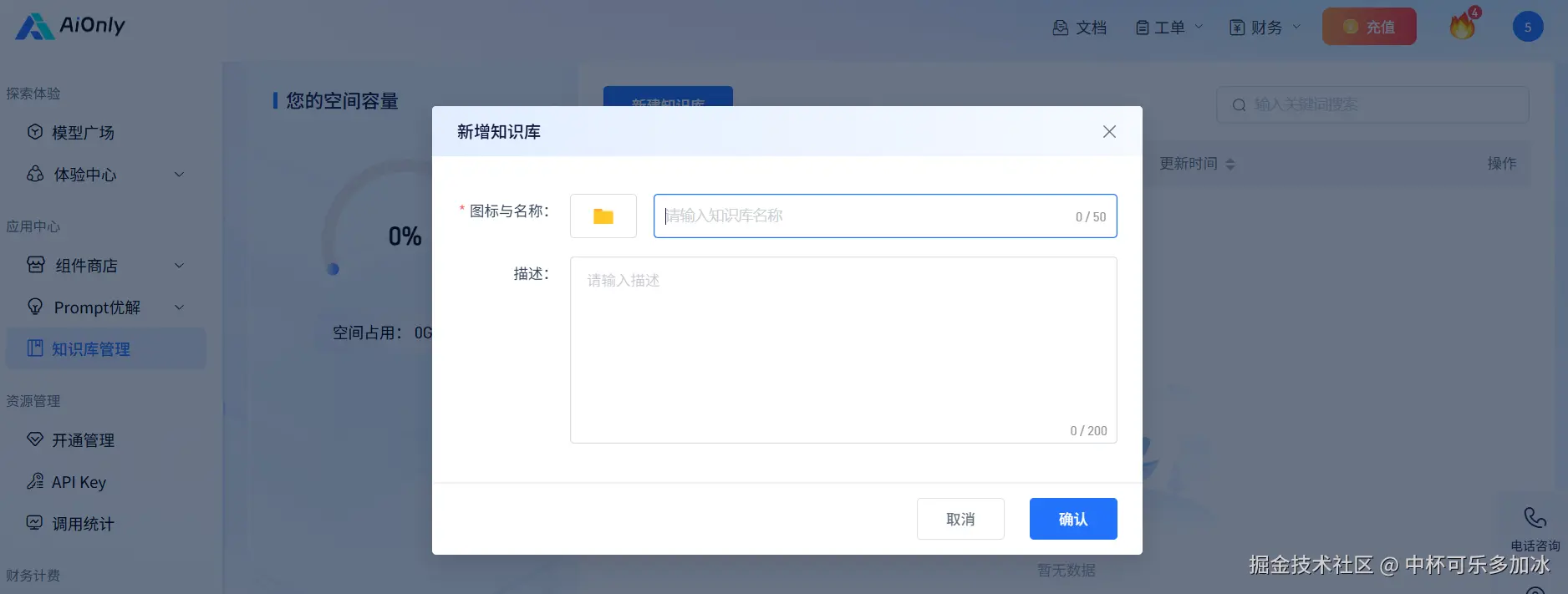

4.2 RAG知识库管理系统

要让 AI 应用提供更精准的服务,融合私有数据是核心前提。但自建完整 RAG 系统的高昂成本,成为了许多用户的痛点。AiOnly 的现成解决方案恰好解决了这一问题,其不仅支持多种格式文档上传,还能自动完成数据清洗与向量化处理, 通过多源数据的智能抽取与清洗,实现深度语言理解与向量检索的高效融合。

4.3 第三方集成工具的无缝衔接

除此之外,AiOnly 平台还支持与 WPS、Cherry Studio、纳米 AI 等常用工具及平台的深度集成。仅需在对应软件内完成 API 配置,即可轻松调用 AiOnly 平台所支持的全部模型,实现功能与数据的高效联动。

目前,平台的集成范围正持续拓展更新,以下工具 / 平台已完成适配并支持集成: 通用 AI 客户端 Cherry Studio、纳米 AI;代码开发工具 Cursor、Cline、Dify;浏览器插件 Sider、Glarity等,可参考平台具体配置文档。

结语

最后,全球AI大模型技术虽在飞速迭代,但对许多刚接触AI的新手而言,技术门槛和使用复杂度仍是一大挑战,往往令人望而却步。AiOnly 正如一把钥匙,帮助大家轻松打开这扇门,无需繁琐配置,不必担心成本,只需访问平台官网,即可一键调用全球顶尖AI大模型,再结合 Dify 等开发工具,快速落地我们的AI应用。