35篇文献拆解!LLM如何重塑软件配置的生成、验证与运维

一、论文信息

- 原标题:基于大语言模型的软件配置研究综述

- 主要作者及研究机构 :

- 张添翼(复旦大学计算机科学学院,上海数据科学重点实验室)

- 张晨曦(西安电子科技大学计算机科学学院)

- 彭鑫(复旦大学计算机科学学院,上海数据科学重点实验室)

- 赵文耘(复旦大学计算机科学学院,上海数据科学重点实验室)

- 收稿/网络首发日期:收稿2025-04-10,网络首发2025-05-21

- 发表期刊:《计算机应用与软件》(ISSN 1000-386X,CN 31-1260/TP)

- APA引文格式:张添翼, 张晨曦, 彭鑫, 赵文耘. (2025). 基于大语言模型的软件配置研究综述. 《计算机应用与软件》. https://link.cnki.net/urlid/31.1260.TP.20250520.1621.002

二、一段话总结

该综述聚焦2022年至今基于大语言模型(LLM)的软件配置研究,通过检索Google Scholar、ACM Digital Library等数据库筛选出35篇代表性文献,以软件运维人员的配置使用流程为框架,将研究划分为配置生成、配置验证、配置运维 三个阶段(文献占比分别为54%、20%、26%);系统分析了LLM在各阶段的应用技术(如配置生成的Few-Shot/CoT/RAG提示增强、微调与智能体,配置验证的约束挖掘与错误检测辅助,配置运维的故障诊断与修复),揭示了当前方法在泛化能力、可解释性、资源依赖上的挑战,并提出未来需重点突破方法迁移泛化、实际落地轻量化、闭环系统构建等方向,为LLM驱动的智能配置研究提供清晰视角 。

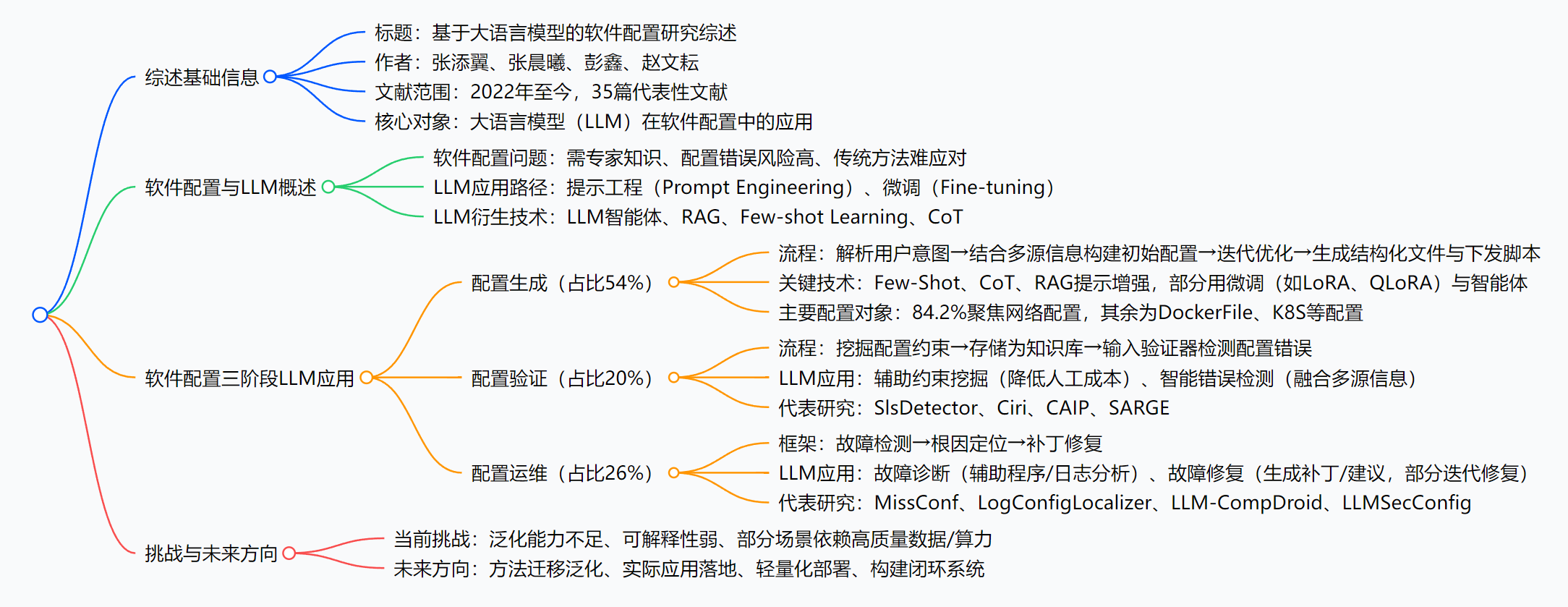

三、思维导图

四、研究背景

现代软件系统正面临"复杂性爆炸"的困境:一方面,软件需适配多样化的硬件平台、操作系统和网络架构,还要满足用户从功能定制到安全策略的个性化需求------比如一款云原生应用,可能需要同时配置K8S容器参数、数据库连接规则、网络防火墙策略,这些配置项往往多达数百个;另一方面,软件规模扩张导致代码量激增、依赖关系复杂,传统"人工编写+脚本测试"的配置管理方式逐渐失效。

举个具体例子:某企业的网络管理员需为SDN(软件定义网络)设备配置路由策略,不仅要熟悉Cisco、Juniper等多厂商设备的语法差异,还要确保配置符合RFC标准,避免因IP地址冲突或带宽分配不当导致服务中断。这种工作不仅需要深厚的专家知识,还容易因人工疏忽出现错误------有研究显示,约30%的系统故障源于配置错误,且排查这类故障平均耗时超过4小时 。

此前,已有研究针对软件配置故障诊断、运行时配置等方向做过综述,但最新的综述完成于两年前,未能覆盖LLM技术的应用成果。而LLM在文档分析、代码生成等领域展现出的强大能力,为解决配置难题提供了新可能------比如通过Few-Shot提示让模型快速学习配置规则,或用RAG检索厂商文档生成合规配置,因此亟需系统梳理LLM在软件配置领域的研究进展。

五、创新点

- 首次按"配置使用流程"构建分析框架:不同于以往按技术类型分类的综述,本文以运维人员的实际工作流(生成→验证→运维)为核心划分研究阶段,更贴合工业界实际需求,且通过量化35篇文献的阶段分布(54%/20%/26%),清晰指出当前研究聚焦配置生成、验证与运维仍待探索的现状。

- 系统拆解LLM在各阶段的技术路径:详细梳理了提示工程(Few-Shot/CoT/RAG)、微调(LoRA/QLoRA)、智能体三种技术在不同阶段的应用场景与效果------比如配置生成中84.2%的研究用提示增强,配置运维中部分研究用智能体实现"诊断-修复"闭环,为后续研究提供技术选型参考。

- 聚焦"落地痛点"的挑战分析:不仅总结技术成果,还针对性指出工业界关注的问题------如提示工程依赖高质量示例、微调对算力要求高、智能体可解释性弱等,并提出"动态提示模板""轻量级微调"等可落地的解决思路,而非泛泛而谈理论方向 。

六、研究方法和思路

6.1 文献检索与筛选

- 检索策略:以"Config(s)""Configuration(s)"与"LLM(s)""Large Language Model(s)"为组合关键词,在Google Scholar、ACM Digital Library、IEEE Xplore Digital Library三大数据库检索2022年至今的期刊与会议论文。

- 筛选流程 :

- 第一步:两名研究人员分别快速阅读论文,提取研究目标、方法流程、实验数据等关键信息;

- 第二步:通过讨论剔除与"LLM+软件配置"关联度低的研究(如仅用LLM做文档摘要、不涉及配置核心任务);

- 第三步:最终筛选出35篇代表性文献,确保覆盖配置生成、验证、运维全阶段。

6.2 分析框架构建

- 框架依据 :基于软件运维人员的实际工作流程,将软件配置生命周期划分为三个阶段:

- 配置生成:结合专家知识、软硬环境、个性需求制定配置策略,编写配置文件;

- 配置验证:通过静态检查、动态测试验证配置可用性,避免错误下发;

- 配置运维:监控配置运行状态,定位并修复配置故障。

- 分类方法:对35篇文献按"技术类型(提示工程/微调/智能体)""配置对象(网络/K8S/数据库等)""实验效果(BLEU/F1分数等)"进行多维度分类,形成如表1(配置生成)、表2(配置约束挖掘)、表3(配置故障修复)的结构化总结 。

6.3 核心技术拆解

以配置生成为例,LLM的应用流程可拆解为:

- 意图解析:用户用自然语言提出配置需求(如"为K8S集群配置资源限制"),系统通过LLM解析需求关键词;

- 初始配置构建:LLM结合历史配置案例、厂商文档(通过RAG检索)、软硬环境信息,生成初始配置;

- 迭代优化:若检测到意图模糊或资源冲突(如"CPU限制超过节点最大容量"),LLM调用知识库修正策略;

- 文件生成:输出YAML/JSON格式的结构化配置文件,并转化为Ansible Playbook或CLI指令等可执行脚本。

七、主要成果和贡献

7.1 三阶段核心成果(表格形式)

| 研究阶段 | 核心成果 | 具体案例/数据 | 领域价值 |

|---|---|---|---|

| 配置生成 | 1. 84.2%研究聚焦网络配置,验证LLM在该领域的成熟度; 2. 提示增强(Few-Shot+CoT+RAG)可提升BLEU分数12.3%(PreConfig); 3. 轻量微调(LoRA/QLoRA)实现低显存训练(12GB显存支持LLM4DistReconfig) | 1. LLMNDC用Baichuan2-13B+LoRA微调,路由配置BLEU值达0.49; 2. GPT-4o结合RAG与智能体,实现网络配置翻译自动化 | 降低网络配置人工成本,适配多厂商设备差异 |

| 配置验证 | 1. LLM可辅助程序分析降误报(LuaTaint); 2. 多智能体协作提升性能敏感配置识别效率(PerfSense); 3. 上下文感知提示提升错误检测准确率(CAIP) | SARGE结合RAG与智能体,实现云配置零样本错误检测 | 提前排查配置风险,减少生产环境故障 |

| 配置运维 | 1. LLM辅助日志分析定位故障配置(LogConfigLocalizer); 2. 部分研究实现"生成-验证-修复"闭环(LLM-CompDroid); 3. 针对Android/K8S/数据库等场景形成专用方案 | 1. LLM-CompDroid修复Android配置兼容性bug,F1分数达0.98; 2. GenKubeSec实现K8S配置故障诊断与修复一体化 | 缩短配置故障排查时间,提升运维自动化率 |

7.2 整体领域贡献

- 填补综述空白:首次系统梳理2022年至今LLM在软件配置领域的研究,弥补此前综述未覆盖LLM技术的不足;

- 提供实践指南:通过分类总结35篇文献的技术路径与实验数据,为工业界提供"提示工程选型""微调策略选择"等可落地的参考(如小样本场景用Few-Shot,领域适配用LoRA微调);

- 明确研究方向:指出"跨系统泛化""轻量化部署""闭环系统构建"三大核心方向,为后续研究提供优先级参考(如配置验证需加强复杂约束分析,配置运维需提升实时性)。

八、关键问题

Q1:LLM在软件配置的三个阶段中,技术应用的侧重点有何不同?为什么会有这种差异?

A1:差异主要体现在技术类型的占比上:

- 配置生成:以提示工程(Few-Shot/CoT/RAG)为主(约90%研究),少量用微调与智能体------原因是配置生成需快速适配多样化需求(如多厂商设备、多场景参数),提示工程迭代快、成本低,适合快速响应需求;

- 配置验证:侧重LLM与传统技术结合(如程序分析+LLM降误报)------原因是验证需高精度检测错误,单一LLM难以覆盖复杂约束,需依赖程序分析的严谨性,LLM仅辅助减少人工;

- 配置运维:部分研究用智能体构建闭环(如LLM-CompDroid的"修复者-检查者"架构)------原因是运维涉及"检测-诊断-修复"多环节,需动态调整策略,智能体的自主决策能力更适配 。

Q2:当前LLM在软件配置领域应用的最大瓶颈是什么?有哪些可能的突破方向?

A2:最大瓶颈是泛化能力不足 ------多数方法针对单一场景(如仅支持K8S或Android配置),跨系统迁移时效果大幅下降,且依赖高质量示例或知识库,缺乏数据时性能骤降

突破方向包括:

- 统一提示模板:设计适配多配置对象(网络/K8S/数据库)的通用提示结构,提取配置任务的共性逻辑;

- 跨领域迁移学习:用知识蒸馏将多场景配置知识融入基础LLM,减少对单一领域数据的依赖;

- 动态知识更新:结合系统运行日志、用户反馈实时更新知识库,提升模型对新场景的适配性 。

Q3:为什么配置生成阶段的研究占比最高(54%)?这是否意味着该阶段已无研究空间?

A3:配置生成占比高的原因有两点:

- 需求紧迫性:配置生成是软件部署的第一步,人工编写效率低、错误率高,工业界对自动化生成需求最迫切;

- 技术适配性 :LLM在文本生成(配置文件本质是结构化文本)、自然语言理解(解析用户需求)上的优势,与配置生成任务高度匹配

这并不意味着无研究空间------当前生成方法仍存在"动态适配性差"(无法实时响应系统负载变化)、"多配置联动生成难"(如网络与数据库配置协同)等问题,未来需结合实时监控数据与多模态信息(如拓扑图)提升生成鲁棒性

九、总结

该综述以"配置使用流程"为框架,系统梳理了2022年至今35篇基于LLM的软件配置研究,清晰呈现了LLM在配置生成(提示增强为主)、验证(传统技术+LLM辅助)、运维(诊断修复闭环探索)三阶段的应用现状。研究发现,当前LLM已在网络配置、K8S配置等场景展现出实用价值,但仍面临泛化能力弱、可解释性差、依赖高质量资源等挑战。未来,需通过轻量微调、跨领域迁移学习、智能体闭环架构等技术,推动LLM从"特定场景助手"向"通用配置专家"演进,最终实现软件配置全流程的智能化、自动化落地,为云计算、边缘计算等复杂场景的运维提供支撑。