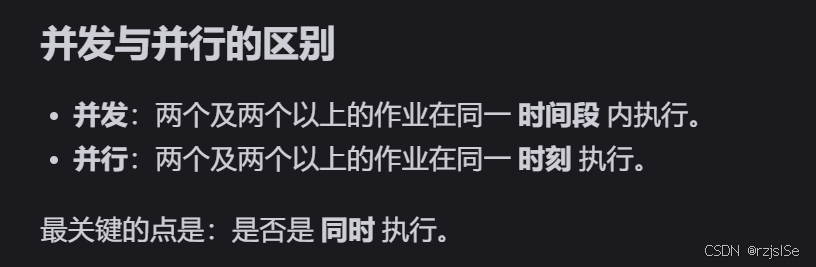

JavaGuide 中对于这部分的解释一笔带过,我在此展开讲述一下,下图是原文解释:

【📕Java->并发编程->Java并发(上)】

在计算机科学中,并发(Concurrency)和并行(Parallelism)是两个经常被混淆但又至关重要的概念。它们都涉及处理多个任务,但本质区别在于"是否真正同时执行"。本文将基于这一关键点,详细解释二者的定义、区别、实现方式以及实际应用,帮助开发者更好地把握这些概念。

基本定义

-

并发(Concurrency) :指两个或多个作业(任务、进程或线程)在同一时间段内执行。这并不要求它们在每一个精确的瞬间都同时运行,而是允许它们交替进行,看起来像是"同时"在处理多个任务。

- 例如:在单核CPU上,通过时间片轮转(time slicing)机制,系统快速切换任务A和任务B,让它们在短时间内轮流执行。用户感知上像是同时在跑,但实际上在任意一个微观时刻,只有一个任务在执行。

-

并行(Parallelism) :指两个或多个作业在同一时刻真正同时执行。这需要硬件支持,如多核处理器或分布式系统,每个任务可以独立占用一个处理单元。

-

关键区别:并发强调"处理多个任务的能力"(可能通过调度实现),而并行强调"真正同时执行"(依赖于多处理资源)。并发可以不并行(单核并发),但并行一定是并发的(因为多个任务在时间段内都在执行)。

图形化比喻

为了更直观地理解这两个概念,我们可以用日常生活中的场景来比喻:

想象一下厨师做饭的场景:

- 并发:一个厨师同时处理炒菜和煮汤。他先炒一会儿菜,然后切换去搅拌汤,再回来炒菜。虽然在一段时间内(比如10分钟)两件事都在推进,但同一时刻他只能做一件事(通过快速切换)。

- 并行:两个厨师同时工作,一个炒菜,一个煮汤。在同一时刻,两件事真正同时在进行。

这个比喻突出了并发的"伪同时"和并行的"真同时"。

技术实现

并发

- 常见在单线程或多线程环境中实现。

- 依赖操作系统或编程语言的调度机制,如Java的线程、Python的asyncio(异步并发)。

- 优势:提高资源利用率,适合I/O密集型任务(比如等待网络响应时切换到其他任务)。

- 潜在问题:需要处理共享资源(如锁机制),否则可能导致数据不一致(race condition)。

并行

- 需要多核CPU、GPU或集群(如Hadoop分布式计算)。

- 例如:使用多线程在多核上并行计算矩阵乘法,每个核处理一部分数据。

- 优势:加速计算密集型任务,提高吞吐量。

- 潜在问题:硬件成本高,编程复杂(需考虑负载均衡)。

在实际开发中,并发和并行往往结合使用,例如在多核系统上通过多线程实现并行,同时用异步机制处理并发。

实际例子

- 并发示例:浏览器同时下载多个文件。即使在单核机器上,下载任务可以并发进行(一个下载暂停时切换到另一个)。

- 并行示例:视频渲染软件利用多核CPU,同时处理多个帧的计算,每个核负责一部分。

- 结合示例:现代操作系统如Windows或Linux,通常是并发+并行的混合:在多核上实现并行,同时用并发处理更多任务。

这些例子展示了并发在资源有限环境下的灵活性,以及并行在高性能计算中的威力。

注意事项

- 在编程中,并发不一定提升性能(切换开销可能大),而并行通常能显著加速,但受限于Amdahl定律(程序中不可并行部分会限制整体 speedup)。

- 选择哪种取决于场景:Web服务器多用并发(处理大量请求),科学计算多用并行(大数据处理)。

总之,并发和并行是优化系统性能的核心工具。理解它们的区别,能帮助你设计更高效的软件架构。如果你有其他编程语言或场景的疑问,欢迎在评论区讨论!