新一代大模型的发布,都赶在了国庆假期前。

昨天,深度求索刚刚开源 DeepSeek-V3.2-Exp。

今天,另一国产大模型之光智谱 AI 也正式发布了旗下新一代旗舰模型 GLM-4.6,刚好撞车 Claude Sonnet 4.5。

但有一点不同,智谱的 GLM-4.6 会继续开源,它即将上线 Hugging Face、ModelScope 等平台,遵循 MIT 协议。

这一「节前惊喜」迅速点燃了技术圈的热情,海外开发者甚至发出了「Do the Chinese guys ever rest???」的感叹 。

但新模型也让大家非常期待,这不刚发出来,就被网友们给盯上了。

性能新高,token 消耗降低

突破开源上限

作为 GLM 系列的最新版本,GLM-4.6 在多个方面实现了全面提升,包括但不限于:

-

高级编码能力:在公开基准与真实编程任务中,GLM-4.6 代码能力对齐 Claude Sonnet 4,是国内已知的最好的 Coding 模型;

-

上下文长度:上下文窗口由 128K 增加至 200K,适应复杂的代码与智能体任务;

-

推理能力提升,并支持在推理过程中调用工具;

-

增强了模型的工具调用和搜索智能体,在智能体框架中表现更好;

-

更强的写作能力:在文风、可读性与角色扮演场景中更符合人类偏好。

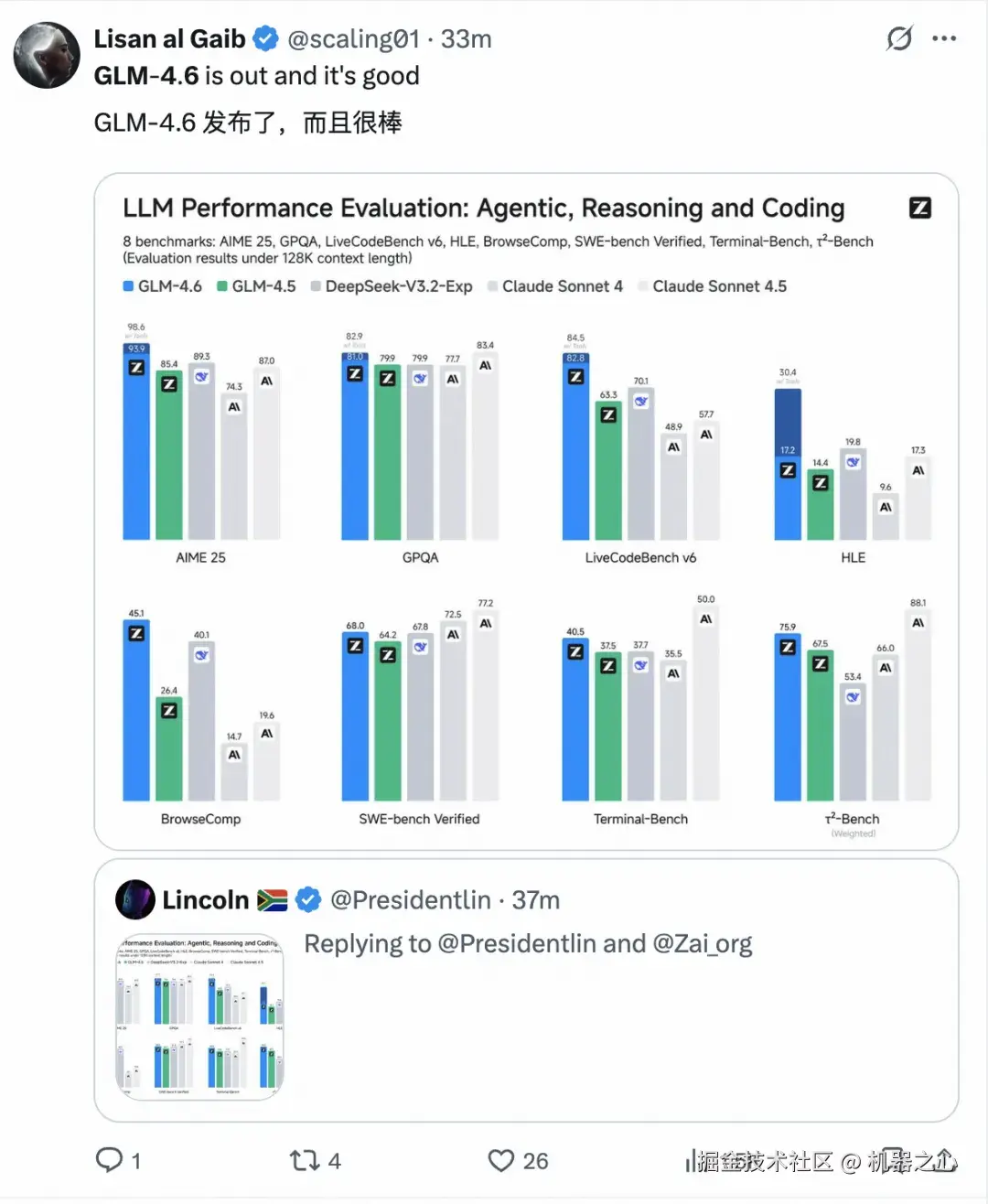

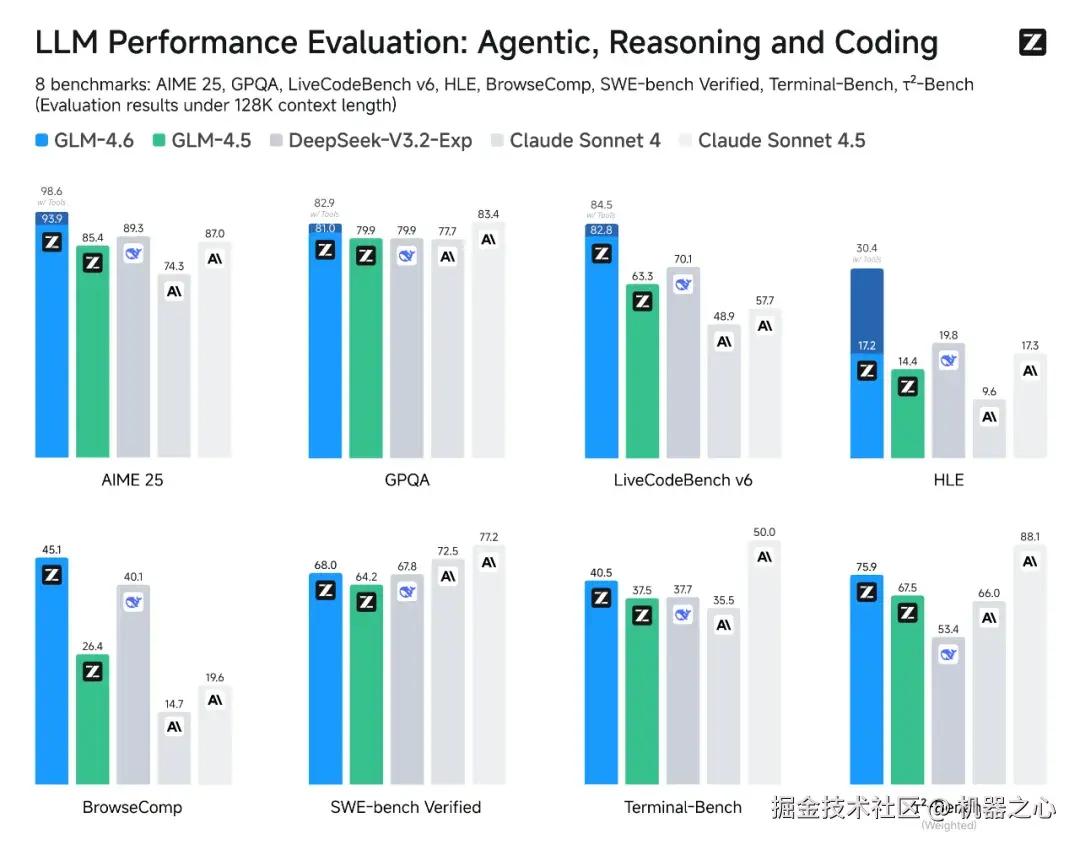

根据智谱报告,GLM-4.6 模型在八大权威基准评测上性能有了全面提升,包括:AIME 25、LCB v6、HLE、SWE-Bench Verified、BrowseComp、Terminal-Bench 和 τ²-Bench。新模型在其中多个基准上胜过了 Claude Sonnet 4/Claude Sonnet 4.5,位居国产模型首位。

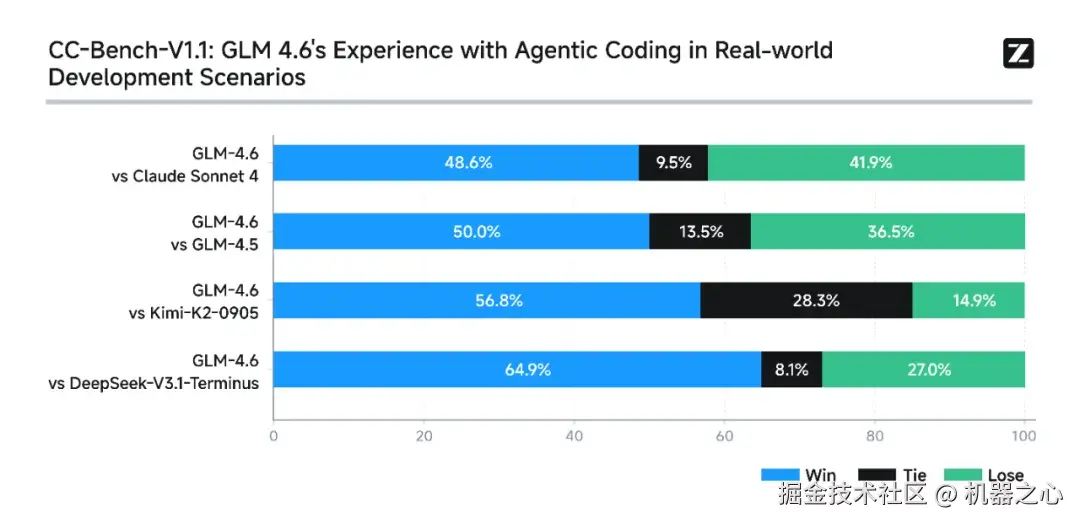

接下来是在 Claude Code 环境下进行的 74 个真实场景编程任务测试,GLM-4.6 实测性能超过了 Claude Sonnet 4,以及其他国产模型。

值得关注的是,在平均 token 消耗上,GLM-4.6 比 GLM-4.5 节省了 30% 以上,为同类模型最低。当然,它的 Coding API 价格也只是 Claude 的 1/7,性能更好,速度更快还更便宜。

新模型同时适配了国产 AI 硬件:GLM-4.6 已在寒武纪芯片上实现 FP8+Int4 混合量化部署,这是首次在国产芯片投产的 FP8+Int4 模型芯片一体解决方案。该方案在保持精度不变的前提下,可以大幅降低推理成本,为国产生态下大模型本地化运行开创了可行路径。

另外,基于 vLLM 推理框架部署,摩尔线程新一代 GPU 也可以基于原生 FP8 精度稳定运行 GLM-4.6。

一手实测

GLM-4.6 全方位提质

目前,GLM-4.6 已经上线 z.ai 等平台,用户在模型选择器中选择它即可开始尝试。

在这里可以看到,智谱为该模型设置的简短描述是「最先进的模型,擅长处理全方位任务」,同时也能看到智谱预设的一些工作模式和示例案例,包括 AI PPT、全栈开发、灵感画板、深度研究、写代码等等。我们也是第一时间进行了实测。

首先,我们先让 GLM-4.6 写一个「俄罗斯方块 + 贪吃蛇」游戏,看看其「写代码」的能力。开启「自动思考」,输入以下提示词:

用 Python(使用 pygame)编写一个融合俄罗斯方块和贪吃蛇的小游戏:画面分为上下两部分,上半部分有一条会自动移动的蛇,玩家需控制下落方块左右移动以躲避蛇;当方块进入下半部分后,按照俄罗斯方块规则继续下落,玩家需要把它放入合适位置以消除整行。若方块与蛇相撞则游戏结束;支持方向键移动、空格键加速下落;蛇可随机改变方向。程序需包含初始化、事件处理、逻辑更新和渲染绘制等模块,并写清注释。

可以看到,GLM-4.6 在详细分析了我们的需求之后便开始了码代码工作,并且完成之后还给出了非常详细的游戏说明,包括游戏特色、操作方式、游戏规则和程序结构。尤其值得一提的是其工作速度:完成该任务的时间仅 1 分钟左右!

复制出来运行一下看看效果,可以看到,除了 VS Code 默认字体设置问题之外,这个 GLM-4.6 一次性完成的「俄罗斯方块 + 贪吃蛇」游戏已经完整可玩,游戏逻辑也完全遵照了我们的提示词设定,表现堪称惊艳。

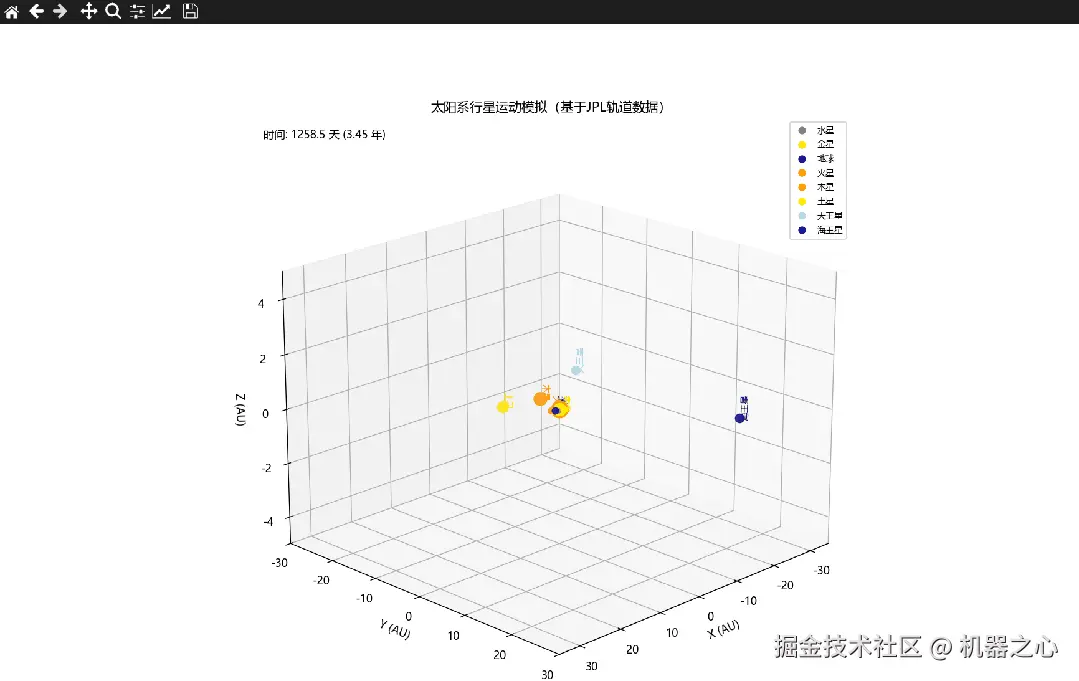

一个简单的游戏或许还不足以探知其代码能力的上限。接下来,我们将难度提升一个量级,要求它处理涉及真实物理数据和 3D 可视化的复杂任务:让 AI 构建一个相比扁平的圆形更接近真实的太阳系的演示模型:

请使用 Python 创建一个太阳系动态可视化演示,大体基于真实天文数据,但太阳大小可适当缩小以方便查看:包含太阳和八大行星(水星至海王星),采用 JPL 提供的轨道六根数初始化各行星轨道;以太阳系质心为参考点,利用牛顿万有引力定律构建运动微分方程,并通过数值积分模拟行星在三维空间中的轨迹;使用 matplotlib 的 3D 绘图功能实时动画展示行星绕日运动,正确体现轨道倾角、椭圆偏心率及相对公转周期;坐标轴单位为天文单位(AU),时间步长可调,并在图中标识各行星名称;代码需结构清晰、注释完整,并说明所作简化(如忽略行星间引力摄动或仅考虑日心引力)。界面使用微软雅黑字体。

这一次,GLM-4.6 同样很快就完成了任务(约 2 分钟)。这个任务的难点不仅在于代码量,更在于对天文学知识、物理公式(牛顿万有引力定律)以及专业数据库(JPL 轨道数据)的理解和应用。

将代码复制到运行环境,导入必要的库,运行:

结果再次令人印象深刻。GLM-4.6 再一次实现了「零修改」一次性运行成功!它不仅相当完美地基于 JPL 轨道数据生成了会随时间演进的 3D 太阳系模型,还贴心地加入了坐标轴设置功能,让我们能从不同视角清晰观察行星轨迹。并且,由于我们在提示词中明确指定了字体,上次实验遇到的显示问题也得到了完美解决。这证明了其代码能力不仅强大,而且对指令的遵循度极高。

当然,我们也可以将 GLM-4.6 接入到强大编程智能体 Claude Code 中。

配置完成后,我们让 GLM-4.6 尝试完成了以下任务:

写一个 Python 程序,使用 asyncio + aiohttp,并发爬取前 20 个知乎热榜问题页面,提取问题标题、回答数量、关注人数,然后将结果存储为一个 MD 文件。

可以看到,接入 Claude Code 的 GLM-4.6 的运行速度同样非常快。同时得益于 Claude Code 强大的框架设计,GLM-4.6 可以针对一个具体项目进行反复优化,比如视频中我们可以看到 GLM-4.6 对目标 Python 程序的反复验证和修改,最终得到了理想的结果。

当然,作为科技媒体小编,保持对新闻的关注自然非常重要,借助 Claude Code + GLM-4.6,这个任务可以变得更加简单。

检索 24 小时内发生的热门 AI 新闻,整理一份报告给我,结果保存为一个 Markdown 文件。

继续对话,我们还能让 GLM-4.6 将其设置成一个每天 8 点定时运行的任务,这样我们一上班就可以看到过去 24 小时最新的 AI 新闻报道了。

可以看到,GLM-4.5 编写并优化了实现该自动化任务的脚本,我们也只需一次运行即可将其变成我们计算机上的一个定时任务。

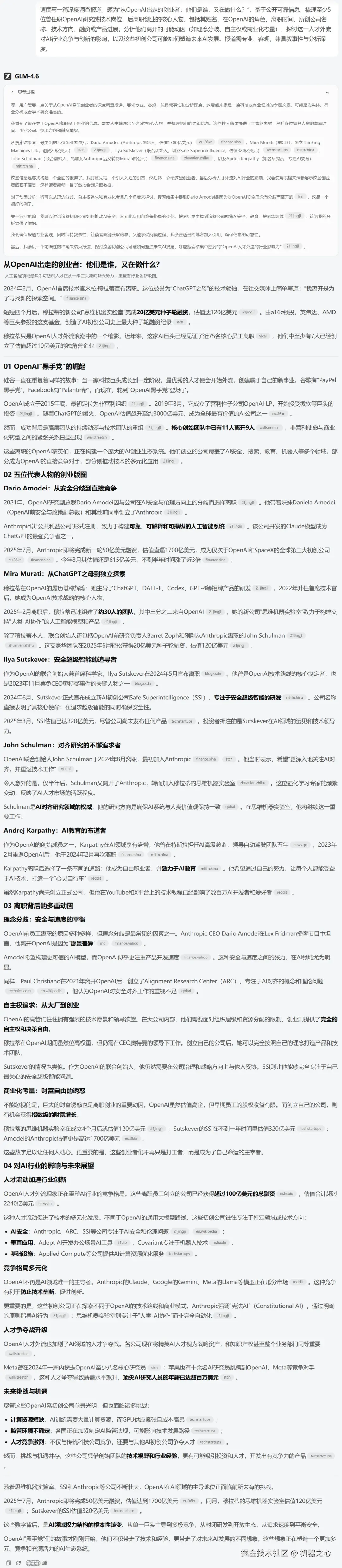

在连续验证了其强大的「理科」编程能力后,我们来看看这个「擅长处理全方位任务」的 GLM-4.6 模型在深度研究和内容创作上的「文科」表现。 我们打开「联网搜索」,给它布置一个科技媒体工作者日常可能遇到的真实任务:

请撰写一篇深度调查报道,题为 "从 OpenAI 出走的创业者:他们是谁,又在做什么?"。基于公开可靠信息,梳理至少 5 位曾任职 OpenAI 研究或技术岗位、后离职创业的核心人物,包括其姓名、在 OpenAI 的角色、离职时间、所创公司名称、技术方向、融资或产品进展;分析他们离开的可能动因(如理念分歧、自主权或商业化考量);探讨这一人才外流对 AI 行业竞争与创新的影响,以及这些初创公司可能如何塑造未来 AI 发展。报道需专业、客观,兼具叙事性与分析深度。

从其思考过程看,GLM-4.6 首先基于任务需求检索了网络,得到了足够的必要信息,然后为「OpenAI 黑手党」构建了一份相当全面的报道,其中不仅列出了大量关键信息和细节,同时还显式地索引了相关来源以供验证。

对于我们媒体工作者而言,这已经不是一个简单的「资料整理工具」,而是一个能够提供洞见、辅助分析的强大研究伙伴。

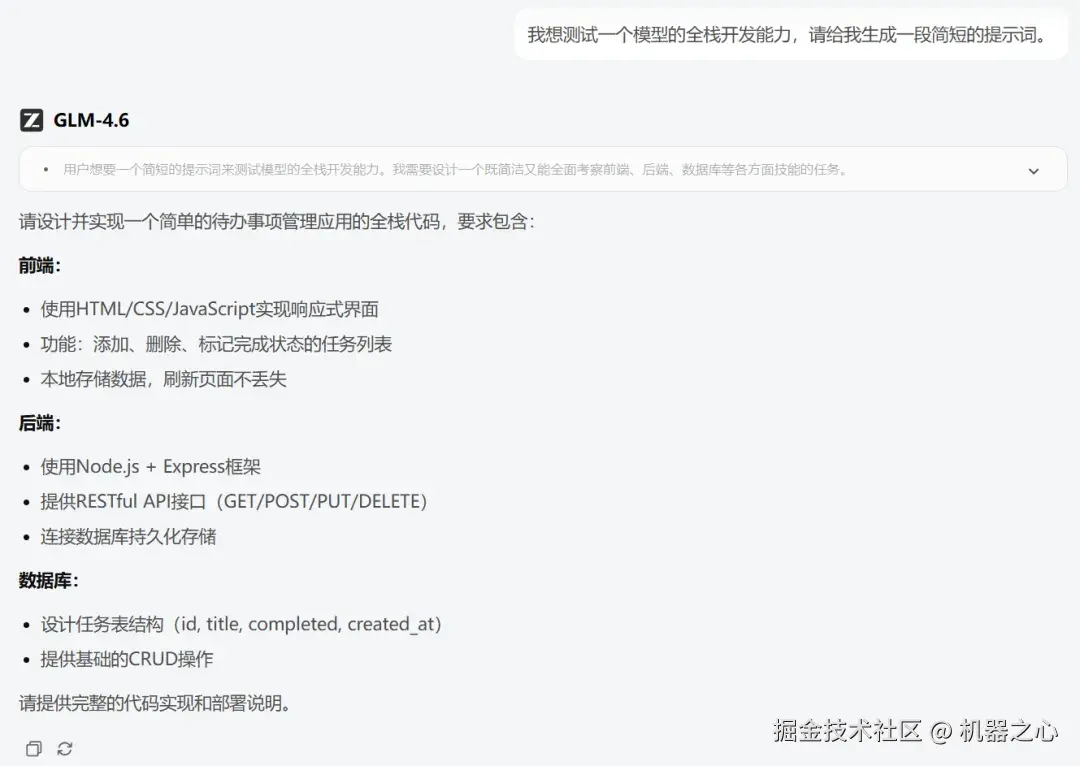

如果说代码生成和研究报告还是相对独立的任务,那么全栈开发则考验的是模型将前后端逻辑整合、构建一个完整产品的工程能力。这一次,我们采用了一个更有趣的方式,直接让模型自己给自己出题:

新开一个窗口,选择「全栈开发」模式,将这条由 GLM-4.6 自己生成的提示词再交还给它:

可以看到,GLM-4.6 在分析完任务后,首先构建了一个明确的待办事项,这本质上是它的项目开发路线图:包括设计 Todo 方案、创建前端、实现 RESTful API 路由、增加本地存储以供离线使用、测试功能。这种「先规划、后执行」的工作模式,非常接近人类程序员的思维方式。之后,它便一步步地完成了所有任务。经过实测,生成的应用功能完备,交互流畅。

更锦上添花的是,我们能直接将生成的结果以网页应用形式发布到 space.z.ai。感兴趣的读者可以访问下方链接,亲自试用这个由 GLM-4.6 在几分钟内新鲜出炉的待办事项管理应用:

a019u8vgp630-deploy.space.z.ai

除了上述硬核能力,GLM-4.6 也集成了多模态生成等便捷功能。在预设的 AI PPT 和灵感画板模式中,模型可以快速将想法变为现实。比如,我们让它生成了一张介绍「蕾姆」的小红书风格封面图。

执行该任务时,GLM-4.6 首先会联网检索并理解「蕾姆」这一角色,下载相关素材,然后再通过生成 HTML/CSS 代码来设计和构建版式,最终呈现出一张符合要求的图片。这展示了它理解、检索、设计、生成的综合能力。

不止于强大,更趋于全能

通过从代码生成、深度研究到全栈开发等一系列的实测,我们可以得出结论:智谱 AI 为 GLM-4.6 设定的「最先进的模型,擅长处理全方位任务」的描述并非虚言。

它的强大之处体现在:

-

极高的代码生成质量:在多个复杂项目中实现了「一次性成功」,代码逻辑严谨、功能完整。

-

深刻的需求理解与规划能力:无论是拆解游戏规则,还是规划全栈应用开发步骤,都展现了清晰的「思路」。

-

惊人的执行效率:分钟级的响应速度,大幅提升了开发和研究的效率。

-

全面的综合能力:无缝整合了联网搜索、多模态生成和应用部署,使其成为一个真正的「全能工作站」。

毫无疑问,GLM-4.6 已经展现出了顶级大模型应有的水准,它不仅是一个强大的工具,更是一个能够激发创造力、赋能专业工作的得力助手。

现如今,智谱的 GLM 系列大模型已成为全球开源 AI 领域的一支重要力量。新推出的 GLM-4.6 不论是在技术架构、性能表现,还是在使用成本上都为全球业界树立了新的标杆。我们有理由期待它在未来的应用中带来更多惊喜。

参考链接

GLM-4.6 技术博客:z.ai/blog/glm-4....