与阿里云一起

轻松实现数智化

让算力成为公共服务:用大规模的通用计算,帮助客户做从前不能做的事情,做从前做不到的规模。让数据成为生产资料:用数据的实时在线,帮助客户以数据为中心改变生产生活方式创造新的价值。

模型介绍

SOTA 性能:Wan2.1 在多个基准测试中始终优于现有的开源模型和最先进的商业解决方案。

支持消费级 GPU:T2V-1.3B 模型仅需 8.19 GB 显存,使其几乎兼容所有消费级 GPU。它可以在 RTX 4090 上大约 4 分钟内生成一段 5 秒的 480P 视频(不使用量化等优化技术)。其性能甚至可以与某些闭源模型相媲美。

多种任务:Wan2.1 在文本到视频、图像到视频、视频编辑、文本到图像以及视频到音频等方面表现出色,推动了视频生成领域的发展。

视觉文本生成:Wan2.1 是首个能够生成中英文文本的视频模型,具备强大的文本生成功能,增强了其实用性。

强大的视频 VAE:Wan-VAE 具有卓越的效率和性能,可以编码和解码任意长度的 1080P 视频,并保留时间信息,是视频和图像生成的理想基础。

Model Scope安装部署

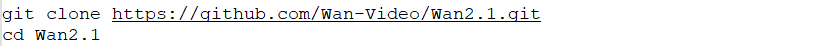

下载模型运行环境安装文件到Model Scope本地开发环境:

在Model Scope本地开发环境中安装运行环境依赖库:

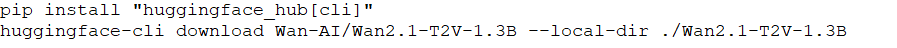

使用 huggingface-cli 下载模型:

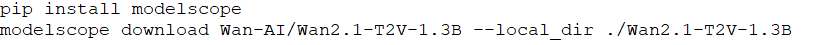

使用 modelscope-cli 下载模型:

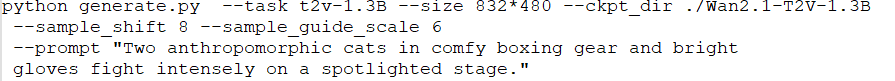

使用单 GPU 推理执行视频生成:

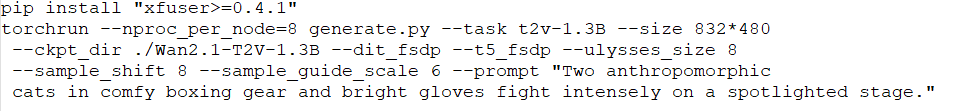

使用 FSDP + xDiT USP 进行多 GPU 推理执行视频生成:

阿里云模型训练

在阿里云人工智能业务平台PAI中,查找对应规格的视频生成大模型:

在视频生成大模型的详情页面中,点击部署或者训练按钮,开始设置部署或者训练的属性参数:

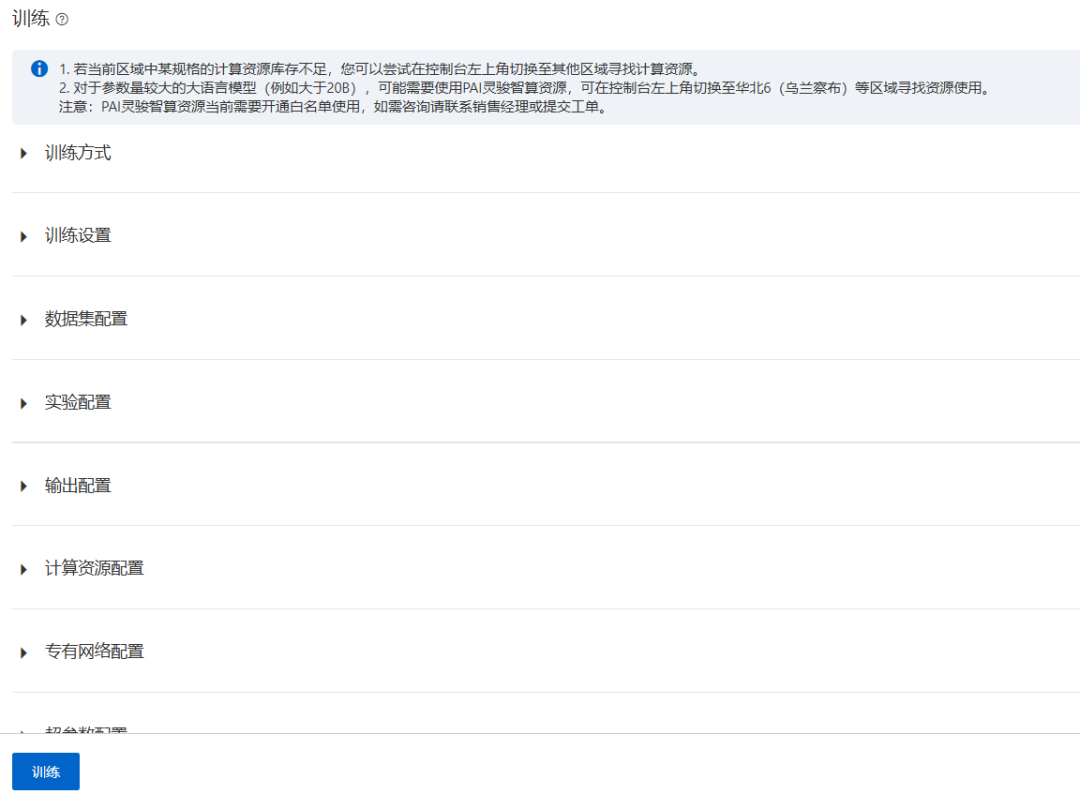

在视频生成大模型的训练的属性参数设置页面中,设置完成,点击训练按钮,开始执行模型训练:

阿里云模型部署

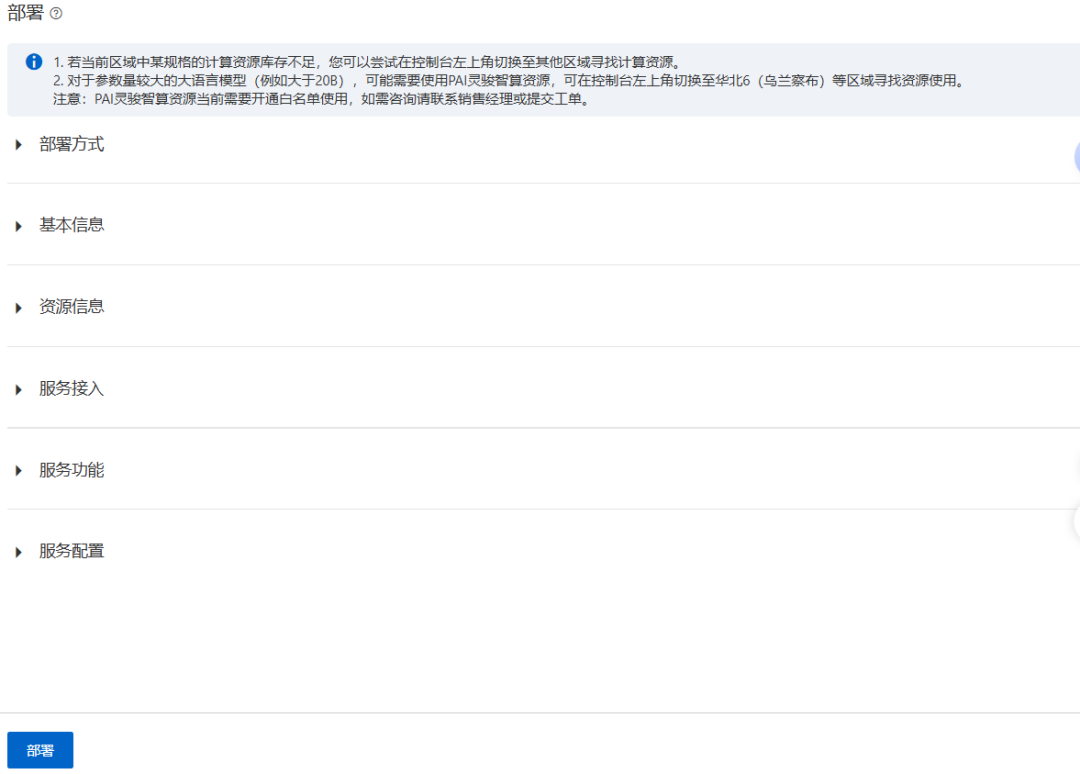

在视频生成大模型的部署的属性参数设置页面中,设置完成,点击部署按钮,开始执行模型部署: