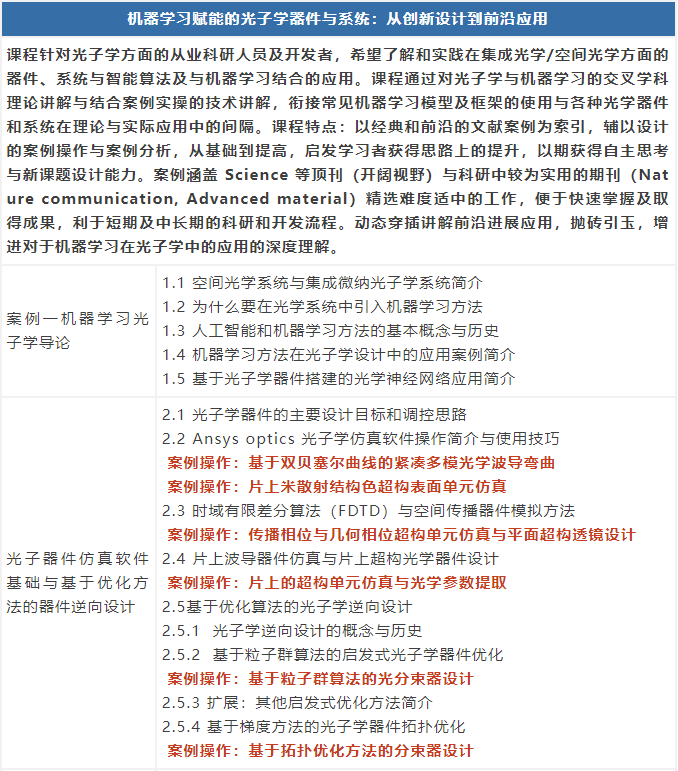

机器学习赋能的智能光子学器件系统研究

机器学习在光子学器件中的应用主要集中在设计优化、性能预测和实时控制等方面。通过数据驱动的方法,可以显著提升光子学器件的效率和功能。

逆向设计:利用深度学习模型如生成对抗网络(GAN)或变分自编码器(VAE)生成满足特定光学特性的光子结构。例如,纳米光子器件的拓扑优化可以通过神经网络实现,比传统迭代方法快几个数量级。

性能预测:卷积神经网络(CNN)或图神经网络(GNN)可用于预测光子晶体或超表面的光学响应,如透射谱、反射谱或场分布。模型训练数据通常来自有限元仿真或实验测量。

实时调控:强化学习(RL)适用于动态调控光子器件参数(如电压、温度),以实现自适应光学系统。例如,可调谐超表面的相位分布可以通过RL算法在线优化。

典型应用场景

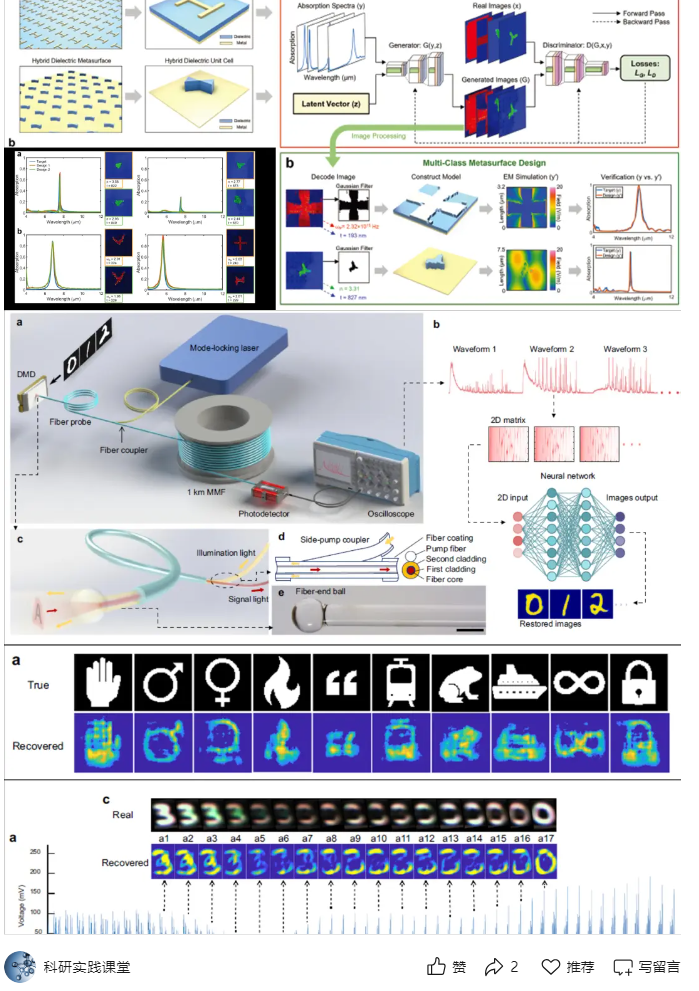

智能光学传感:结合光子学传感器与机器学习,实现高灵敏度、高选择性的化学或生物分子检测。光纤传感器阵列的数据可通过支持向量机(SVM)或随机森林分类。

光通信系统:机器学习用于光纤非线性补偿、模式识别和故障检测。长短期记忆网络(LSTM)可处理时序信号,优化相干光通信的误码率。

量子光子学:神经网络辅助设计量子光源或优化纠缠态生成。生成模型可用于模拟高维量子态,加速量子信息实验。

关键技术挑战

数据获取瓶颈:高质量光子器件数据集需要大量仿真或实验,解决思路包括迁移学习和小样本学习。物理信息神经网络(PINN)可结合麦克斯韦方程减少数据依赖。

模型可解释性:黑箱模型难以提供物理洞察,可尝试注意力机制或符号回归。光子学领域的先验知识应嵌入模型结构设计。

硬件实现限制:光子神经网络的片上集成面临损耗和噪声问题。解决方案包括设计鲁棒性更强的算法或开发新型光子计算架构。

未来发展方向

光子-电子协同计算:探索存算一体架构,利用光子器件的高速并行性加速机器学习推理。硅基光电集成是重要平台。

自主实验系统:闭环"设计-制备-表征"自动化平台,结合机器人实验与在线学习。贝叶斯优化可指导高效探索参数空间。

跨尺度建模:多物理场耦合模型(光-热-力-电)需要层次化机器学习方法。图神经网络适合处理多尺度关联问题。

代码示例(光子器件逆向设计):

python

import tensorflow as tf

from tensorflow.keras.layers import Dense, LeakyReLU

def build_generator(latent_dim):

model = tf.keras.Sequential([

Dense(256, input_dim=latent_dim),

LeakyReLU(alpha=0.2),

Dense(512),

LeakyReLU(alpha=0.2),

Dense(1024),

LeakyReLU(alpha=0.2),

Dense(2048, activation='tanh') # 输出纳米结构几何参数

])

return model数学公式(光子神经网络前向传播):

Eout=σ(∑i=1Nwi⋅ejϕiEin(i)) E_{out} = \sigma\left(\sum_{i=1}^N w_i \cdot e^{j\phi_i} E_{in}^{(i)}\right) Eout=σ(i=1∑Nwi⋅ejϕiEin(i))

其中wiw_iwi为可调权重,ϕi\phi_iϕi为相位调制,σ\sigmaσ为非线性激活函数。