在人工智能飞速发展的今天,AI助手已经从简单的问答工具演进为能够执行复杂任务的智能伙伴。而Windows MCP.Net项目,正是连接AI助手与Windows桌面环境的桥梁,让AI真正具备了"动手能力"。本文将深入剖析这一开源项目的架构设计、核心技术实现,并通过实际应用场景展示其强大功能,最后展望其未来发展趋势。

引言:当AI助手学会"动手"

想象一下,你正在为明天的重要会议准备一份报告,需要从多个网页收集数据、整理到Excel中,再制作成PPT。这个过程通常需要你手动操作浏览器、Excel和PowerPoint,重复着复制粘贴的机械动作。

现在,如果你的AI助手能够自动完成这些操作呢?它可以在你思考报告内容的同时,自动打开浏览器搜索数据、提取关键信息、整理到Excel并生成图表,甚至直接制作好PPT初稿。这不再是科幻电影中的场景,而是Windows MCP.Net项目为我们带来的现实可能。

Windows MCP.Net,一个基于.NET的Windows桌面自动化MCP(Model Context Protocol)服务器,正是实现这一愿景的关键技术。它赋予了AI助手直接与Windows桌面环境交互的能力,让AI真正学会了"动手"。

项目背景:为什么需要Windows桌面自动化

AI助手的"最后一公里"问题

当前的AI助手在处理纯文本任务时表现出色,无论是撰写文章、解答问题还是编程辅助,都能游刃有余。但在面对需要与桌面应用程序交互的任务时,却显得力不从心。这就像一个理论知识丰富的外科医生,却从未真正动过手术刀。

这种局限性源于AI助手与操作系统之间的鸿沟:

-

AI助手无法直接启动应用程序

-

无法操作鼠标键盘进行UI交互

-

无法读取屏幕上的视觉信息

-

无法直接操作文件系统

MCP协议:连接AI与操作系统的桥梁

MCP(Model Context Protocol)协议的出现,为解决这一问题提供了标准化方案。它定义了AI助手与工具服务器之间的通信规范,使得AI助手可以通过标准接口调用各种工具。

Windows MCP.Net正是基于这一协议构建的工具服务器,专门针对Windows桌面环境提供自动化能力。它就像一个"翻译官",将AI助手的高级指令转换为具体的Windows API调用,从而实现真正的桌面自动化。

技术架构解析:如何构建桌面自动化能力

整体架构设计

Windows MCP.Net采用了清晰的分层架构设计:

+-------------------+

| AI助手客户端 |

+-------------------+

|

MCP协议通信

|

+-------------------+

| Windows MCP.Net |

| (工具服务器) |

+-------------------+

| 核心服务层 |

| - DesktopService |

| - FileSystemService |

| - OcrService |

| - SystemControlService |

+-------------------+

| 工具实现层 |

| - Desktop Tools |

| - FileSystem Tools |

| - OCR Tools |

| - System Tools |

+-------------------+

| Windows API接口 |

+-------------------+核心组件详解

1. 服务层:统一接口抽象

项目采用了面向接口编程的设计思想,通过定义清晰的服务接口来抽象各种桌面操作能力:

// 桌面服务接口示例

public interface IDesktopService

{

Task<(string Response, int Status)> LaunchAppAsync(string name);

Task<string> ClickAsync(int x, int y, string button = "left", int clicks = 1);

Task<string> TypeAsync(int x, int y, string text, bool clear = false, bool pressEnter = false);

// ... 其他桌面操作方法

}这种设计的优势在于:

-

解耦合:工具实现与具体服务分离

-

可测试性:便于编写单元测试

-

可扩展性:易于添加新的服务实现

2. 工具层:MCP协议适配

每个工具类都通过MCP注解标记,使其能够被AI助手发现和调用:

[McpServerToolType]

public class LaunchTool

{

[McpServerTool, Description("Launch an application from the Windows Start Menu by name")]

public async Task<string> LaunchAppAsync(string name)

{

// 工具实现逻辑

}

}3. Windows API集成:底层能力支撑

项目通过P/Invoke技术直接调用Windows API,实现底层操作能力:

// 鼠标操作API导入

[DllImport("user32.dll")]

private static extern bool SetCursorPos(int x, int y);

[DllImport("user32.dll")]

private static extern void mouse_event(uint dwFlags, uint dx, uint dy, uint dwData, UIntPtr dwExtraInfo);技术亮点分析

1. 异步编程模型

项目全面采用异步编程模型,确保在执行耗时操作时不会阻塞主线程:

public async Task<string> TypeAsync(int x, int y, string text, bool clear = false, bool pressEnter = false)

{

// 异步实现逻辑

}2. 结构化日志记录

集成Serilog实现结构化日志记录,便于问题排查和系统监控:

Log.Logger = new LoggerConfiguration()

.MinimumLevel.Debug()

.WriteTo.Console()

.WriteTo.File("logs/winmcplog-.txt", rollingInterval: RollingInterval.Day)

.CreateLogger();3. 依赖注入容器

使用.NET的依赖注入容器管理服务生命周期:

builder.Services

.AddSingleton<IDesktopService, DesktopService>()

.AddSingleton<IFileSystemService, FileSystemService>()

// ... 其他服务注册核心实现思路:从概念到代码

桌面自动化的核心挑战

实现桌面自动化面临着几个核心技术挑战:

-

坐标系统映射:如何将屏幕坐标与UI元素精确对应

-

输入模拟:如何真实模拟用户的鼠标键盘操作

-

状态同步:如何确保操作的时序性和准确性

-

异常处理:如何处理各种不可预期的系统状态

解决方案设计

1. 精确的输入模拟

项目通过调用Windows API实现了高保真的输入模拟:

// 鼠标点击实现示例

public async Task<string> ClickAsync(int x, int y, string button = "left", int clicks = 1)

{

// 设置鼠标位置

SetCursorPos(x, y);

// 根据按钮类型执行点击

uint buttonFlags = button.ToLower() switch

{

"left" => MOUSEEVENTF_LEFTDOWN | MOUSEEVENTF_LEFTUP,

"right" => MOUSEEVENTF_RIGHTDOWN | MOUSEEVENTF_RIGHTUP,

"middle" => MOUSEEVENTF_MIDDLEDOWN | MOUSEEVENTF_MIDDLEUP,

_ => MOUSEEVENTF_LEFTDOWN | MOUSEEVENTF_LEFTUP

};

// 执行多次点击

for (int i = 0; i < clicks; i++)

{

mouse_event(buttonFlags, (uint)x, (uint)y, 0, UIntPtr.Zero);

await Task.Delay(100); // 点击间隔

}

return $"Clicked at ({x}, {y}) with {button} button {clicks} times";

}2. 智能的文本输入

文本输入不仅需要模拟键盘敲击,还需要处理各种特殊情况:

public async Task<string> TypeAsync(int x, int y, string text, bool clear = false, bool pressEnter = false)

{

// 移动到指定位置并点击获取焦点

await MoveAsync(x, y);

await ClickAsync(x, y);

await Task.Delay(100);

// 如果需要清空现有内容

if (clear)

{

// 全选并删除

await ShortcutAsync(new[] { "Ctrl", "A" });

await KeyAsync("Delete");

await Task.Delay(100);

}

// 逐字符输入文本

foreach (char c in text)

{

// 处理特殊字符

if (c == '\n')

{

await KeyAsync("Enter");

}

else if (c == '\t')

{

await KeyAsync("Tab");

}

else

{

// 模拟普通字符输入

INPUT[] inputs = new INPUT[2];

// 按下

inputs[0].type = INPUT_KEYBOARD;

inputs[0].ki.wVk = (ushort)VkKeyScan(c);

// 释放

inputs[1].type = INPUT_KEYBOARD;

inputs[1].ki.wVk = (ushort)VkKeyScan(c);

inputs[1].ki.dwFlags = KEYEVENTF_KEYUP;

SendInput(2, inputs, Marshal.SizeOf(typeof(INPUT)));

}

await Task.Delay(50); // 字符间隔

}

// 如果需要按回车

if (pressEnter)

{

await KeyAsync("Enter");

}

return $"Typed '{text}' at ({x}, {y})";

}3. 强大的OCR集成

项目集成了PaddleOCR引擎,实现了强大的文字识别能力:

public async Task<(string Text, int Status)> ExtractTextFromScreenAsync(CancellationToken cancellationToken = default)

{

try

{

// 初始化OCR模型

await InitializeModelAsync();

// 获取屏幕尺寸

int screenWidth = GetSystemMetrics(SM_CXSCREEN);

int screenHeight = GetSystemMetrics(SM_CYSCREEN);

// 截取全屏

using var bitmap = CaptureScreenRegion(0, 0, screenWidth, screenHeight);

// 转换为OpenCv格式

using var mat = OpenCvSharp.Extensions.BitmapConverter.ToMat(bitmap);

// 执行OCR识别

PaddleOcrResult result = _model.Run(mat);

// 提取识别文本

StringBuilder textBuilder = new StringBuilder();

foreach (PaddleOcrResultRegion region in result.Regions)

{

textBuilder.AppendLine(region.Text);

}

return (textBuilder.ToString(), 0);

}

catch (Exception ex)

{

_logger.LogError(ex, "Error extracting text from screen");

return (string.Empty, 1);

}

}实际应用案例:让AI助手真正"动手"

案例一:自动化数据收集与报告生成

假设你需要每天收集某个网站的数据并生成报告,传统方式需要手动打开浏览器、访问网站、复制数据、粘贴到Excel中。使用Windows MCP.Net,AI助手可以自动完成整个流程:

-

启动浏览器:调用LaunchTool打开Chrome浏览器

-

访问网站:使用OpenBrowserTool导航到目标网站

-

数据提取:通过ScrapeTool抓取网页内容并转换为结构化数据

-

Excel操作:使用文件系统工具创建Excel文件并写入数据

-

报告生成:调用PowerPoint工具生成报告

// AI助手可以发出这样的指令序列

await launchTool.LaunchAppAsync("chrome");

await openBrowserTool.OpenBrowserAsync("https://example-data-site.com");

string scrapedData = await scrapeTool.ScrapeAsync("https://example-data-site.com");

await createFileTool.CreateFileAsync("report_data.json", scrapedData);

// ... 后续处理步骤

案例二:智能客服机器人的桌面操作能力

在客服场景中,AI助手可能需要帮助用户完成软件安装、配置等操作:

-

下载软件:自动下载安装包

-

执行安装:模拟安装向导的点击操作

-

配置软件:自动填写配置信息

-

验证安装:检查软件是否正常运行

案例三:自动化测试助手

在软件开发中,Windows MCP.Net可以作为自动化测试工具:

-

启动应用:自动启动被测应用

-

执行操作:模拟用户操作流程

-

验证结果:通过OCR检查界面文本

-

生成报告:自动记录测试结果

未来发展趋势:桌面自动化的无限可能

技术发展方向

1. AI驱动的智能自动化

未来的Windows MCP.Net将集成更多AI能力:

-

智能元素识别:通过计算机视觉自动识别UI元素

-

自然语言操作:直接用自然语言描述操作意图

-

自适应学习:根据用户习惯优化操作流程

2. 更广泛的系统集成

项目将进一步扩展系统集成能力:

-

数据库操作:直接操作各种数据库系统

-

云服务集成:与主流云服务平台深度集成

-

IoT设备控制:扩展到物联网设备控制

3. 安全性与权限管理

随着功能增强,安全性将成为重点:

-

细粒度权限控制:精确控制每个工具的访问权限

-

操作审计:完整记录所有自动化操作

-

沙箱环境:在隔离环境中执行敏感操作

应用场景拓展

1. 企业级自动化平台

Windows MCP.Net有望发展成为企业级自动化平台的核心组件:

-

办公自动化:自动处理日常办公任务

-

IT运维:自动执行系统维护任务

-

数据处理:批量处理各种数据文件

2. 教育培训工具

在教育培训领域,项目可以:

-

编程教学:自动演示编程操作

-

软件培训:指导用户完成软件操作

-

考试评估:自动评估学生的操作技能

3. 辅助技术

对于有特殊需求的用户群体:

-

无障碍支持:帮助视障用户操作计算机

-

老年友好:简化复杂操作流程

-

学习障碍支持:提供结构化操作指导

结语:开启桌面自动化的新纪元

Windows MCP.Net项目不仅仅是一个技术工具,更是AI助手能力演进的重要里程碑。它将AI助手从"会说"提升到了"会做"的层次,真正实现了智能与行动的结合。

随着技术的不断发展和完善,我们可以预见一个更加智能、更加自动化的未来。在这个未来中,AI助手将能够处理更加复杂的任务,成为我们工作和生活中的得力伙伴。

对于开发者而言,Windows MCP.Net提供了一个优秀的学习案例,展示了如何通过现代.NET技术构建强大的系统工具。对于用户而言,它开启了桌面自动化的无限可能。

让我们一起期待,在Windows MCP.Net等开源项目的推动下,桌面自动化技术能够为我们的数字生活带来更多便利和惊喜。

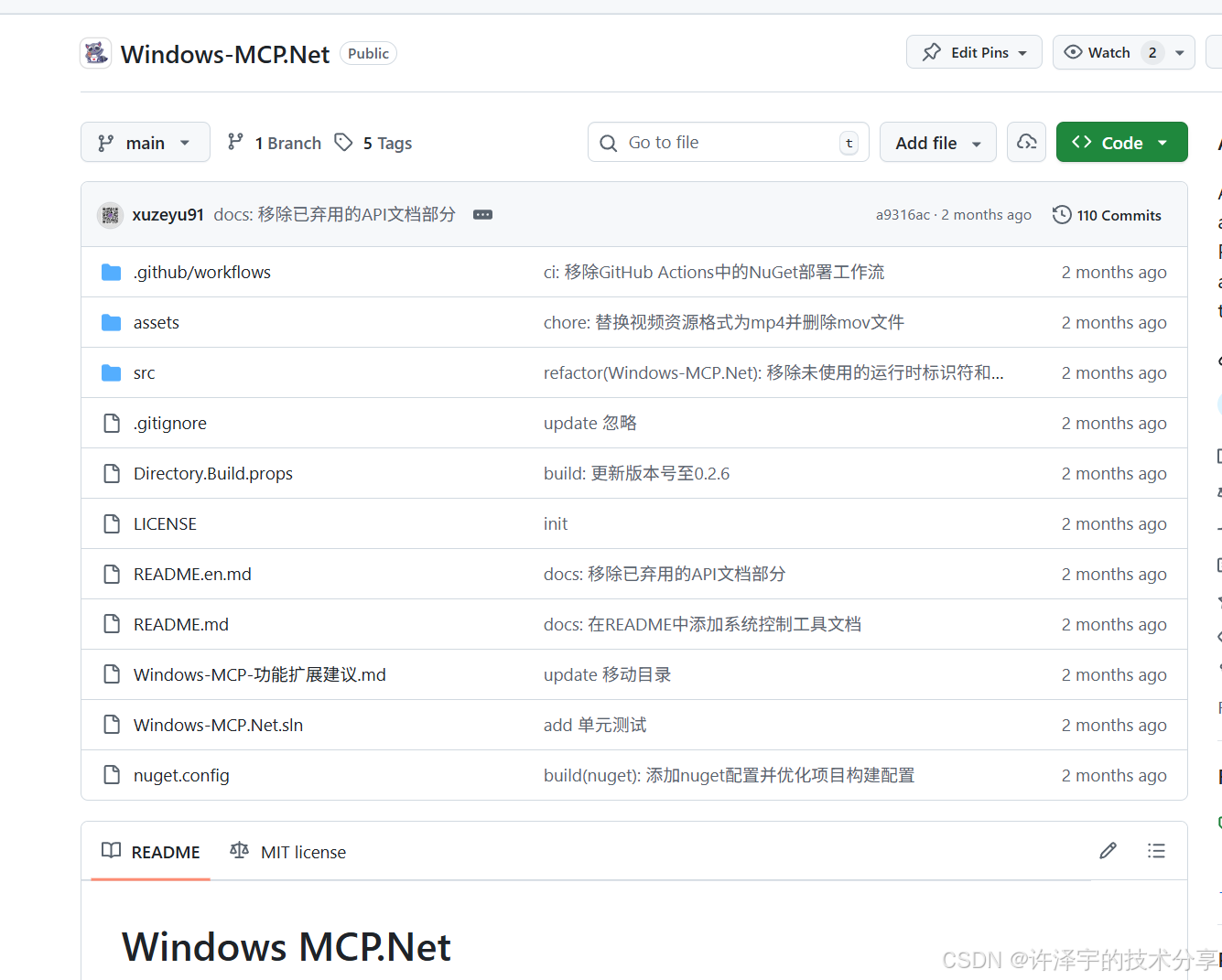

项目地址 :Windows MCP.Net GitHub仓库![]() https://github.com/AIDotNet/Windows-MCP.Net 技术交流:欢迎在项目Issues中提出问题和建议,共同推动桌面自动化技术的发展。

https://github.com/AIDotNet/Windows-MCP.Net 技术交流:欢迎在项目Issues中提出问题和建议,共同推动桌面自动化技术的发展。