本文较长,建议点赞收藏。更多AI大模型应用开发学习视频及资料,在智泊AI。

最近刷 GitHub 时刷到一个挺有意思的开源项目:Happy LLM

它在GitHub上十分火热,已经收获13.8k⭐。

它是 Datawhale 出品的,教你从0搭建一个215M的大模型!

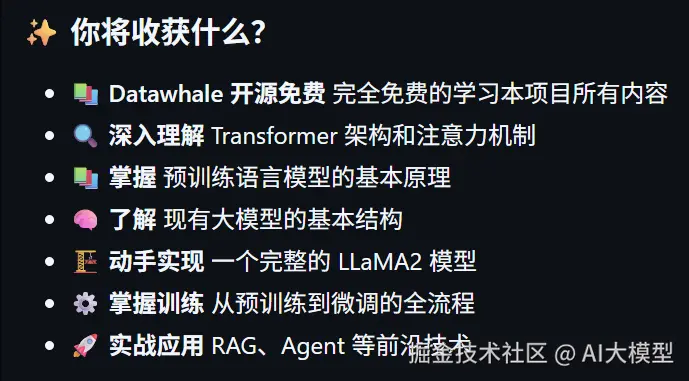

这套 LLM 学习材料啊,是从自然语言处理的基础知识开始讲的。之后会跟着 LLM 的思路和原理,一步一步往深了聊 ------ 比如它基本是啥结构啊,怎么训练出来的啊,都会拆解开来讲明白。

而且咱们不只是光说理论,还会用现在大家常用的代码工具,手把手教你怎么自己动手搭一个 LLM,怎么训练它。

说白了,就是不光给你现成的知识,更想教你怎么自己琢磨明白这事儿。

在内容安排上,Happy‑LLM 分为七大章节:

项目从 NLP 的基础概念出发,循序渐进地带你理解 Transformer 架构、注意力机制,以及各种预训练语言模型的设计思路。

项目团队同时提供了完整的代码示例,手把手教你如何从头实现一个小型 LLaMA2 模型,甚至覆盖了从预训练到微调(LoRA/QLoRA)的全流程实践,既能"拆解"原理,也能"上手"训练,真正做到授之以渔!

项目地址:

学习资源推荐

如果你想更深入地学习大模型,以下是一些非常有价值的学习资源,这些资源将帮助你从不同角度学习大模型,提升你的实践能力。

本文较长,建议点赞收藏。更多AI大模型应用开发学习视频及资料,在智泊AI。