研究背景

糖尿病视网膜病变(Diabetic Retinopathy, DR)是糖尿病患者常见的眼科并发症,是导致成年人失明的主要原因之一。随着全球糖尿病患者数量的不断增加,DR 的发病率呈现逐年上升趋势,尤其在低收入和中等收入国家中,糖尿病视网膜病变已经成为公共卫生领域的重要问题。根据世界卫生组织(WHO)的报告,DR 已成为全球范围内可预防性失明的主要原因之一。早期发现和及时治疗可以显著减缓病情的进展,从而有效防止视力丧失。然而,当前的临床诊断通常依赖眼科医生通过眼底检查手动评估视网膜图像,这一过程既耗时又依赖于专家的经验,容易出现误诊和漏诊。

近年来,随着深度学习和计算机视觉技术的迅猛发展,自动化的疾病诊断系统已成为解决上述问题的有效途径。特别是卷积神经网络(CNN)和 Transformer 模型在医学影像分类中的应用,已在癌症筛查、脑部疾病诊断等领域取得了显著成果。Swin Transformer,作为一种新兴的图像处理架构,凭借其强大的特征学习能力和优秀的全局信息建模能力,在视觉任务中展现出卓越的性能。

然而,在糖尿病视网膜病变的自动诊断研究中,如何准确地分类不同严重程度的 DR,尤其是针对轻度病变、中度病变和增殖性病变的区分,依然是一个挑战。现有方法大多依赖于传统的卷积神经网络(CNN),虽然在一定程度上可以识别病变区域,但面对多样的视网膜图像及细微的病变特征时,分类精度仍有提升空间。因此,基于 Swin Transformer 的新型深度学习模型,能够有效提高糖尿病视网膜病变的诊断准确性,并且能够在多个病变类别之间进行更精细的分类,为临床医生提供更为可靠的诊断工具,具有重要的学术价值和应用前景。

本研究旨在利用 Swin Transformer 模型开发一套自动化糖尿病视网膜病变分类与诊断系统,深入探讨如何通过深度学习技术提高糖尿病视网膜病变的自动诊断准确度,特别是在轻度、中度和增殖性病变的分类上,解决现有诊断方法的不足,为糖尿病患者的早期诊断和治疗提供更有效的辅助决策支持。

算法概述

1.Swin Transformer

Swin Transformer由微软公司的研究人员推出,是一种有效结合了 CNN 和 Transformer模型优势的新型架构。它旨在以类似 CNN 的分层方式处理图像,同时利用变换器固有的自我关注机制。这种混合方法使 Swin 变换器能够有效处理各种规模的视觉信息,从而使其在广泛的视觉任务中具有高度的通用性和强大的功能。

Swin Transformer 的核心创新在于其分层结构和基于移位窗口的自我注意力机制。与标准视觉转换器(ViT)在整个图像中应用自我注意力不同,Swin Transformer将图像划分为不重叠的小窗口,在这些窗口内计算自我注意力,从而减少了计算复杂性。此外,Swin Transformer引入了窗口移位技术,使得在连续的Transformer块之间,图像区域能在不同层之间相互影响,从而更好地整合局部与全局上下文信息。

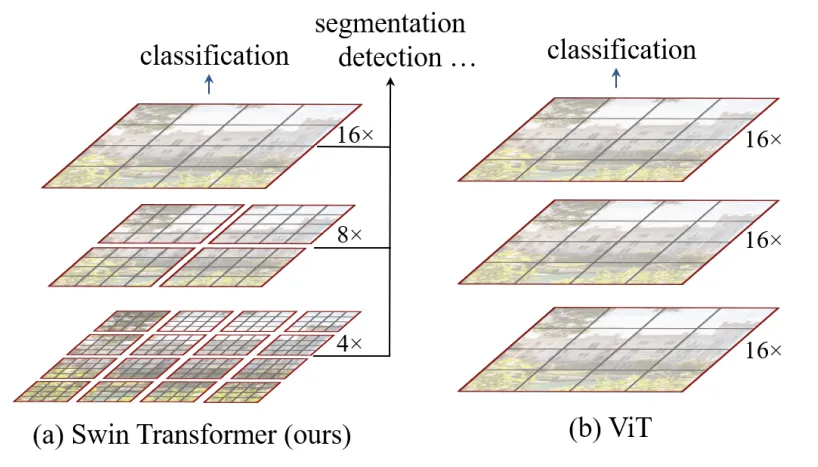

图1 Swin Transformer多层级表示和ViT对比

如图1所示,Swin Transformer从小的patch开始,通过在深层次逐步合并相邻patch的方式构建了一个层级化的表示。通过这些层级特征图,Swin Transformer可以像FPN和U-Net那样进行多尺度密集预测。通过对图像分区(用红色标出)进行非重叠窗口的局部自注意力计算实现了线性的计算复杂度。每个窗口的patch的个数是固定的,因此计算复杂度和图像的大小成线性关系。

相比于之前只能产生单一分辨率特征图和平方复杂度的Transformer模型,Swin Transformer适合作为各种视觉任务的通用主干网络(backbone)。

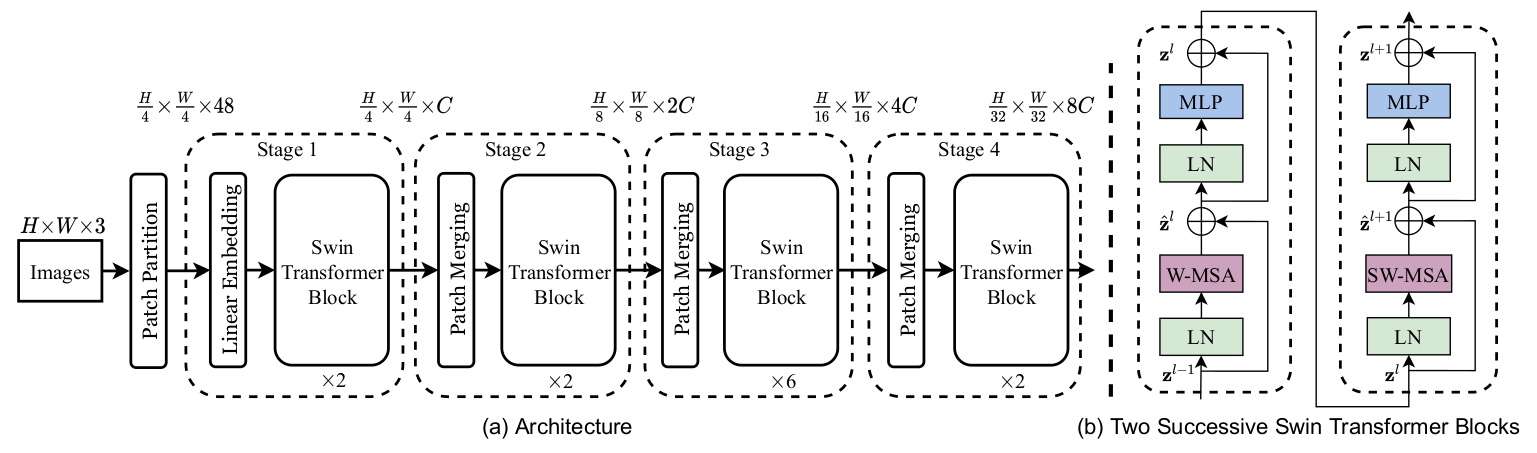

图2:Swin Transformer网络架构

该架构详细展示了 Swin-Transformer 模型如何通过逐层处理和 Patch Merging 实现高效的图像特征提取。每个阶段的 Swin Transformer Block 通过不同的自注意力机制(如 W-MSA 和 SW-MSA)逐步提升图像理解的深度。通过多层次的处理和特征合并,该模型在处理大规模图像数据时表现出色,特别适合于图像分类和目标检测等任务。

Swin Transformer解决了以往基于 CNN 和 Transformer的模型的几个局限性。首先,它的分层设计可以高效处理多种分辨率的图像,有助于完成需要同时了解精细细节和整体结构的任务,如物体检测和语义分割。其次,通过将自我关注机制定位到窗口并采用移位窗口,Swin Transformer 大幅降低了计算要求,使其更易于扩展到大型图像和数据集。最后,它的架构通过将局部特征无缝集成到更广泛的上下文中,实现了更好的特征学习,从而提高了各种视觉任务的性能。

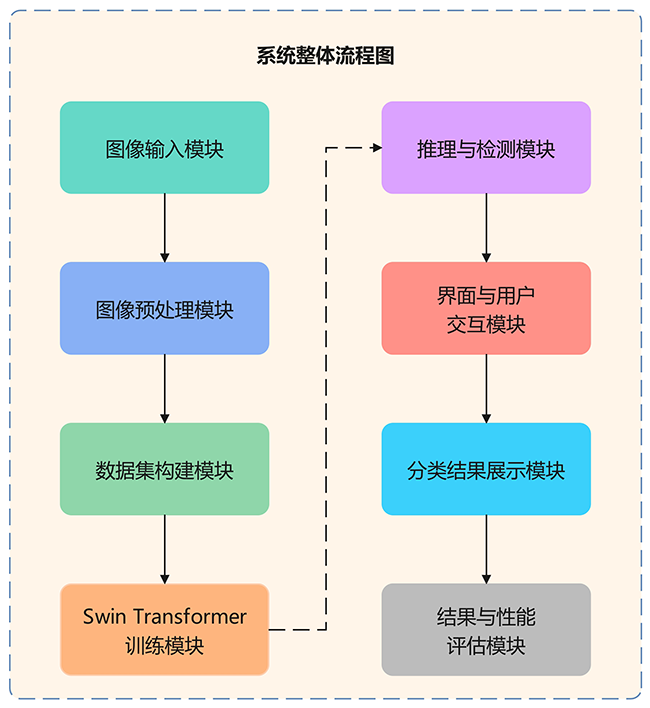

系统设计

本系统旨在实现糖尿病视网膜病变(DR)的自动化分析与诊断,采用"数据输入 + 模型推理 + 结果展示"的一体化工作流程。系统架构包括图像输入模块、图像预处理模块、数据集准备模块、Swin-Transformer训练模块、推理与检测模块、用户交互界面模块、检测结果展示模块以及实验结果与性能评估模块。通过图形用户界面(GUI),前端界面支持用户便捷地导入糖尿病视网膜病变相关影像数据并进行交互操作,而后端则通过Swin-Transformer模型进行实时的糖尿病视网膜病变影像分析与分类,精准区分不同类型的糖尿病视网膜病变,如轻度病变、中度病变、增殖性病变和重度病变。

图3 诊断系统整体流程图

在糖尿病视网膜病变(DR)影像分类任务中,Swin-Transformer模型表现卓越,具备高准确性和高效率,能够精确区分不同类型的视网膜病变,如"轻度病变"、"中度病变"、"增殖性病变"和"重度病变"等不同病理状态。该模型通过多尺度特征提取和局部窗口注意力机制,捕捉到糖尿病视网膜病变影像中的细微特征,展现出强大的分类能力。因此,本系统在糖尿病视网膜病变的早期诊断和治疗中具有巨大的应用潜力,能够为临床医生提供精确的辅助诊断工具,推动糖尿病视网膜病变筛查过程的智能化进步。

数据集构建

1.数据来源

本系统使用的医学影像数据主要来源于糖尿病视网膜病变(DR)影像数据集。该数据集包含了不同类型的糖尿病视网膜病变影像资料,主要来源于眼底照相检查和视网膜扫描,提供了丰富的视网膜病变特征数据。通过整理和筛选这些图像数据,本系统构建了一个多样化的糖尿病视网膜病变影像数据集,涵盖了轻度病变、中度病变、增殖性病变和重度病变等不同病变类型的影像特征。该数据集为深度学习和人工智能技术在糖尿病视网膜病变分类与诊断中的应用提供了高质量的训练数据,并推动了糖尿病视网膜病变早期诊断和智能化筛查的发展。

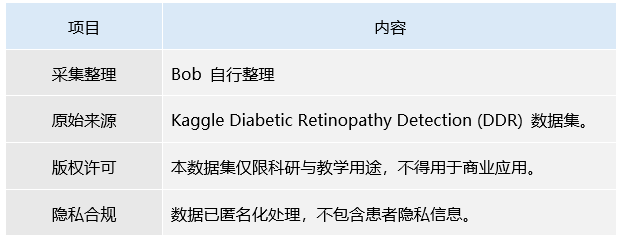

表2 数据集基本信息

该数据集包括"无病变"和不同程度的糖尿病视网膜病变(如"轻度病变"、"中度病变"、"增殖性病变"和"重度病变")四种不同的视网膜病变影像状态。数据集不仅涵盖了不同类型的糖尿病视网膜病变,还具有较高的影像质量,适用于糖尿病视网膜病变分类任务,为糖尿病视网膜病变的自动化诊断提供了高质量的训练数据。该数据集旨在推动深度学习和人工智能技术在医学影像分析领域中的应用,特别是在糖尿病视网膜病变检测中,提供强有力的数据支持,旨在提高糖尿病视网膜病变诊断的准确性和效率。

图4 数据集图片

本研究在对原始糖尿病视网膜病变影像数据进行清洗与筛选后,构建了一个包含"轻度病变"、"中度病变"、"增殖性病变"和"重度病变"四种糖尿病视网膜病变状态的影像数据集。该数据集的类别分布均衡,全面涵盖了不同糖尿病视网膜病变健康状态,能够真实反映糖尿病视网膜病变状态下的影像特征。数据集中每类状态的影像均经过标准化处理与质量控制,确保了样本的代表性与清晰度。该数据集为后续基于深度学习模型进行糖尿病视网膜病变健康状态识别与分类提供了坚实的数据支撑,为医学影像分析领域的智能化与自动化研究奠定了基础。

2.分类方法

本系统所使用的糖尿病视网膜病变影像数据的分类信息由专业人员完成。每个糖尿病视网膜病变影像都被分配到一个明确的病变状态,如"轻度病变"、"中度病变"、"增殖性病变"和"重度病变"。为确保分类的准确性和可靠性,分类过程由专业人员独立完成,并通过交叉验证的方式进行审核,从而有效降低个体差异带来的偏差,确保数据分类的一致性和权威性。该分类方法确保了数据集的高质量,并为后续基于深度学习模型的糖尿病视网膜病变健康状态分类模型训练提供了坚实的数据支持。

(1)分类数据集格式

该格式主要用于糖尿病视网膜病变分类任务,常见于Swin Transformer等深度学习模型的训练。其方法是将每张糖尿病视网膜病变影像归类为"轻度病变"、"中度病变"、"增殖性病变"和"重度病变"四种明确类别。该格式能够确保数据与模型在训练与推理过程中的高效匹配,从而提高分类精度和推理效率。Swin Transformer通过其分层结构和移位窗口自注意力机制,能够更好地处理影像中的局部与全局上下文信息,进一步提升了分类性能。这种格式简化了数据准备过程,并为基于Swin Transformer的糖尿病视网膜病变分类模型训练提供了高效且标准化的数据输入。

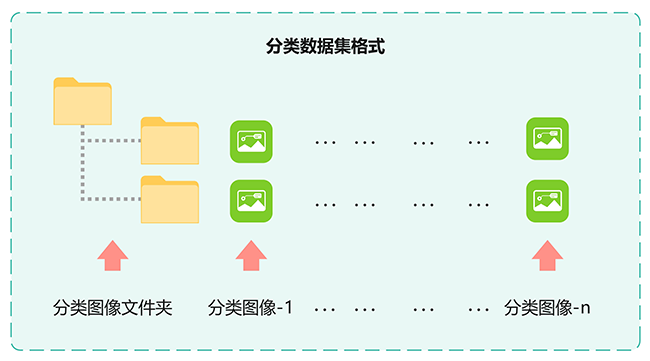

图5 分类数据集格式

(2)数据集划分

标注后的数据集不仅包括图像文件,还包含对应的分类信息。经过上述所有步骤处理和验证后的图像数据被划分成训练集和测试集,形成最终的数据集,用于算法训练学习模型。

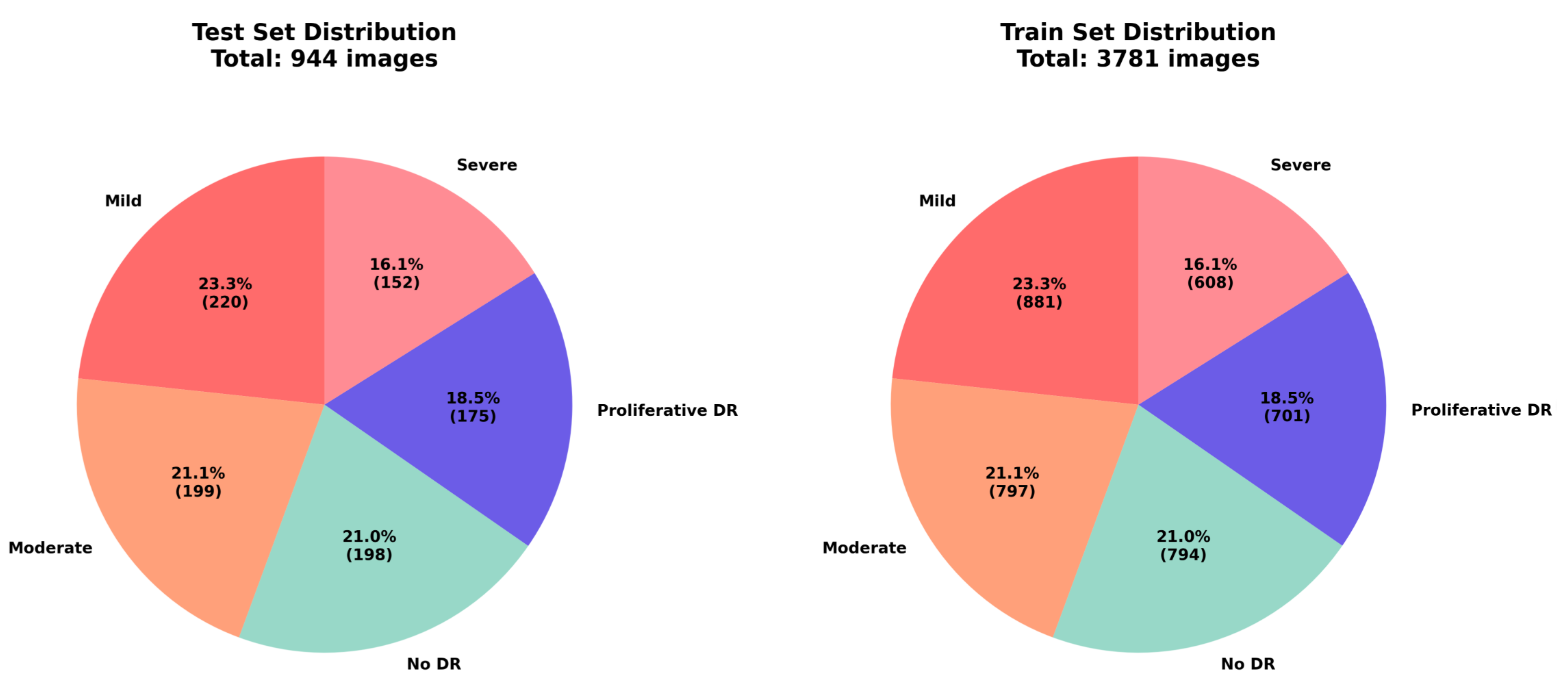

图5 数据集划分:测试集和训练集

模型训练

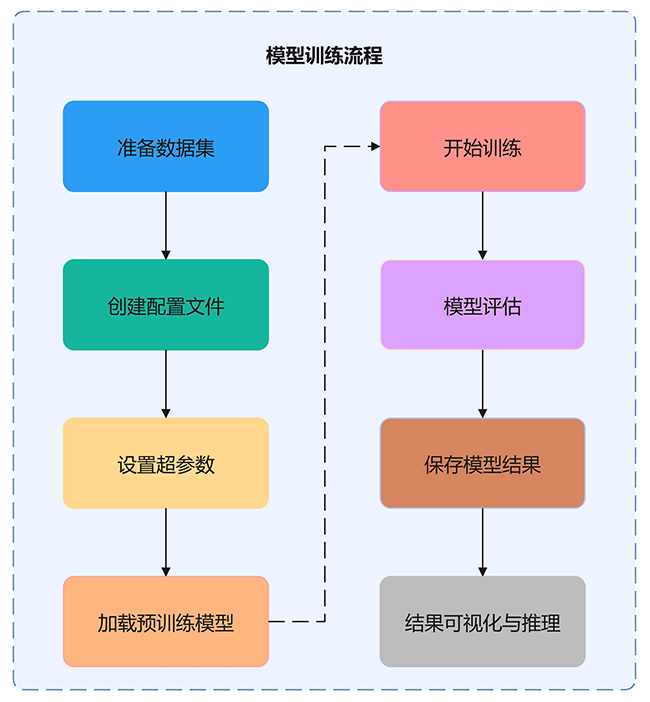

Swin Transformer 是一种常用于图像分类任务的深度学习模型。其训练过程主要包括以下几个步骤:配置文件与超参数的设置、训练过程的执行以及训练结果的可视化分析。Swin Transformer通过其分层结构和移位窗口自注意力机制,能够有效处理图像中的局部与全局上下文信息,进一步提升分类精度和效率。在训练过程中,Swin Transformer能够通过高效的计算方式应对大规模数据集,并且在多个图像分类任务中展现出了优异的性能。

图6 模型训练流程图

1.配置文件与超参数设置

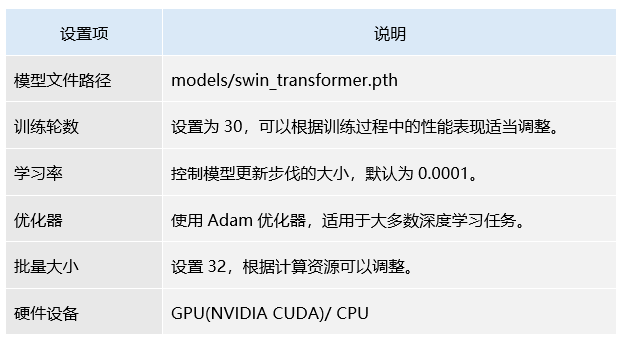

以下是关于Swin Transformer模型训练过程中的配置文件和超参数设置,并通过配置文件以及相关参数进行训练设置。

表4 Swin Transformer模型训练超参数设置

2.模型性能评估

在 Swin Transformer模型的训练过程中,模型性能评估是衡量其在图像分类任务中表现的重要环节,能够全面反映模型在分类精度和泛化能力方面的表现。科学而准确的评估不仅有助于揭示模型的优势与不足,还能为后续的改进与优化提供可靠依据。

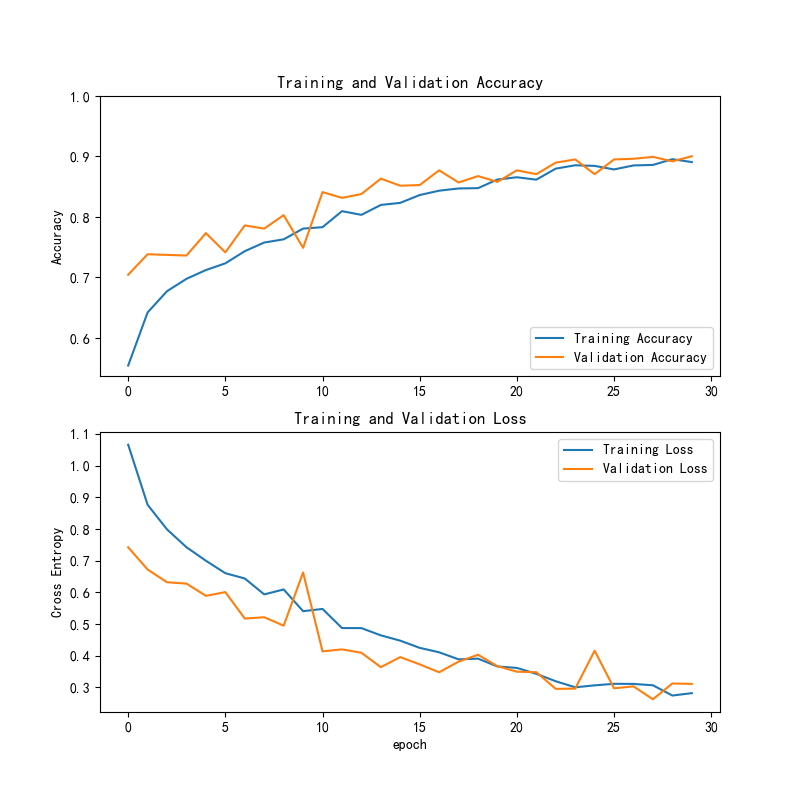

(1)训练与验证准确率和损失曲线

图7 Swin Transformer训练与验证准确率和损失曲线

该图展示了模型在训练和验证过程中的准确率和损失变化。训练准确率稳步上升,接近 90%,而验证准确率也随之提高,显示出模型在不同数据集上的良好适应性。训练损失和验证损失均呈下降趋势,表明模型在训练过程中有效地减少了误差,并且未发生明显的过拟合现象。这表明模型具有较强的泛化能力,能够在未见数据上保持较好的表现。

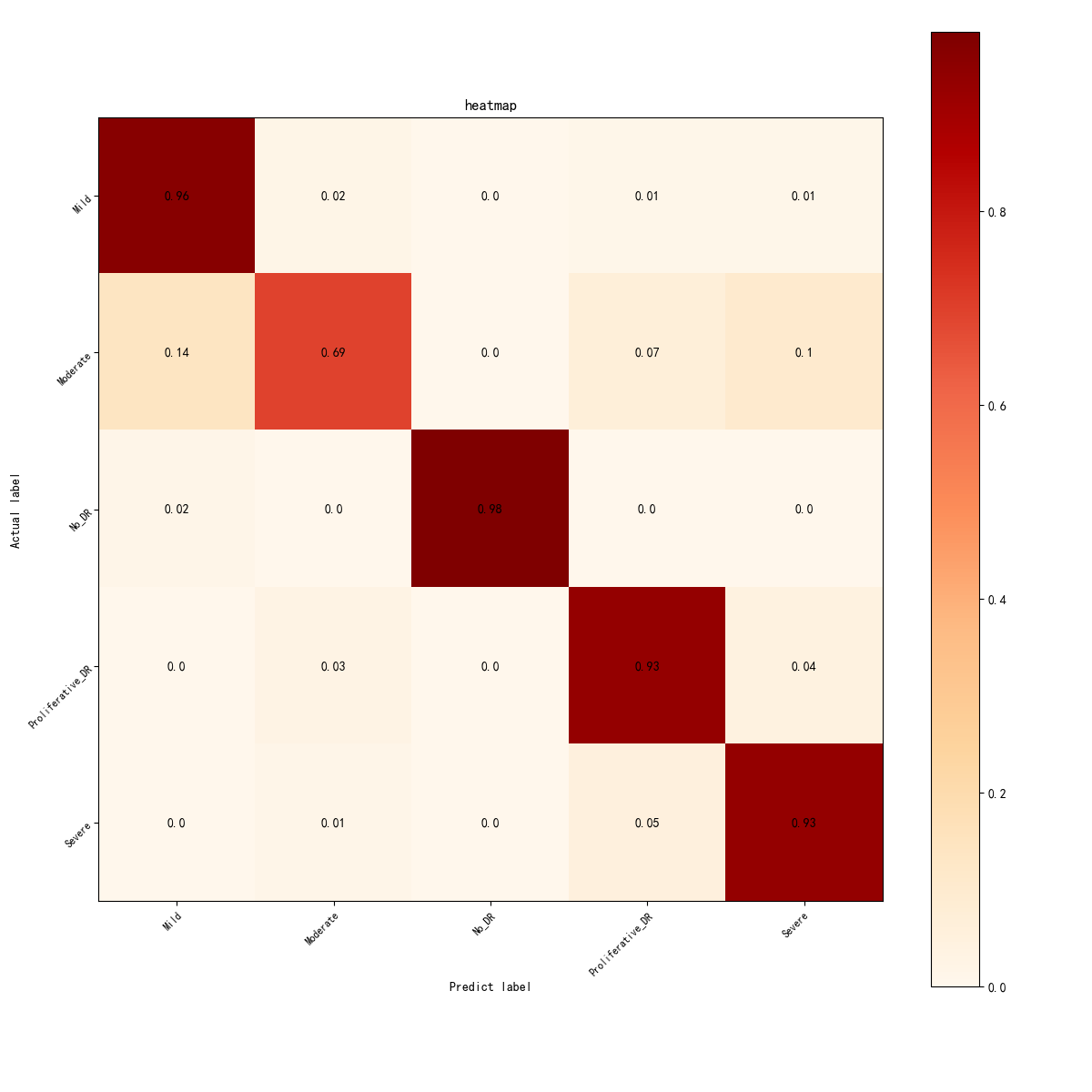

(2)混淆矩阵热力图

图8 Swin Transformer混淆矩阵热力图

混淆矩阵展示了不同类别的预测结果,其中轻度病变的准确率较高(0.96),中度病变的召回率较低(0.69),这表明模型在处理轻度病变时表现较好,但在中度病变的分类上存在一定挑战。其他类别,如无病变、增殖性病变和重度病变,表现较为均衡,分类精度较高。这表明模型在糖尿病视网膜病变的诊断中能较好地区分不同的病变类别。

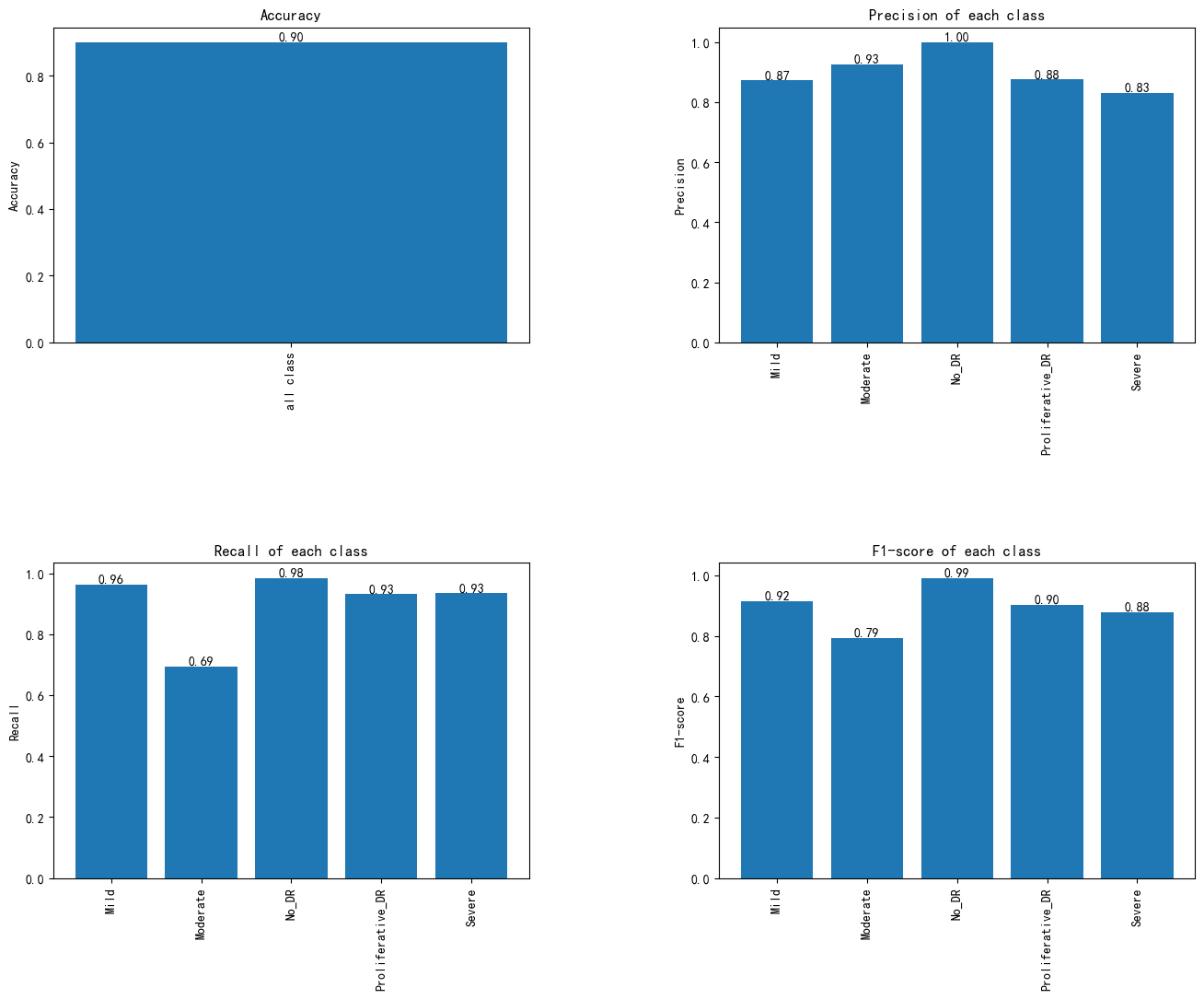

(3)各类认知障碍的分类性能评估:准确率、精确率、召回率与F1分数图

图9 各类认知障碍的分类性能评估:准确率、精确率、召回率与F1分数图

该图展示了模型在不同类别上的精确度(Precision)、召回率(Recall)和 F1 分数。整体而言,F1 分数较高,尤其是在无病变类别(1.00)和增殖性病变类别(0.90)上表现突出,说明模型在这两个类别上的预测能力非常强。其他类别也表现良好,尤其是轻度病变和重度病变,其精确度和召回率都接近于 1,这进一步证明了模型在这些任务中的优异性能。

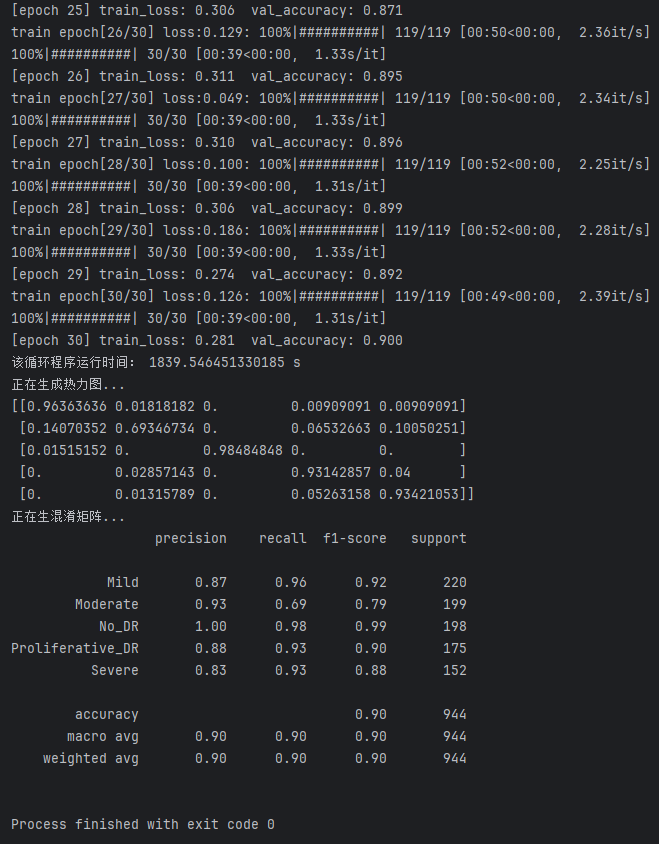

(4)训练日志(Training Log)

训练日志记录了Swin Transformer模型在训练过程中的详细信息,包括训练轮次、每轮的损失值、验证准确率以及训练时间等,这些信息帮助评估模型的训练效果和性能。

图10 Swin Transformer训练日志

图11 模型训练日志概要

功能展示

本系统基于深度学习的Swin Transformer模型,旨在实现糖尿病视网膜病变影像的自动诊断与分类。系统集成了Swin Transformer模型,用于对糖尿病视网膜病变影像进行特征提取、分类及诊断结果展示。通过对比不同模型的性能表现,本系统为糖尿病视网膜病变的智能化、标准化诊断研究提供了技术支撑。以下为主要功能界面的展示:

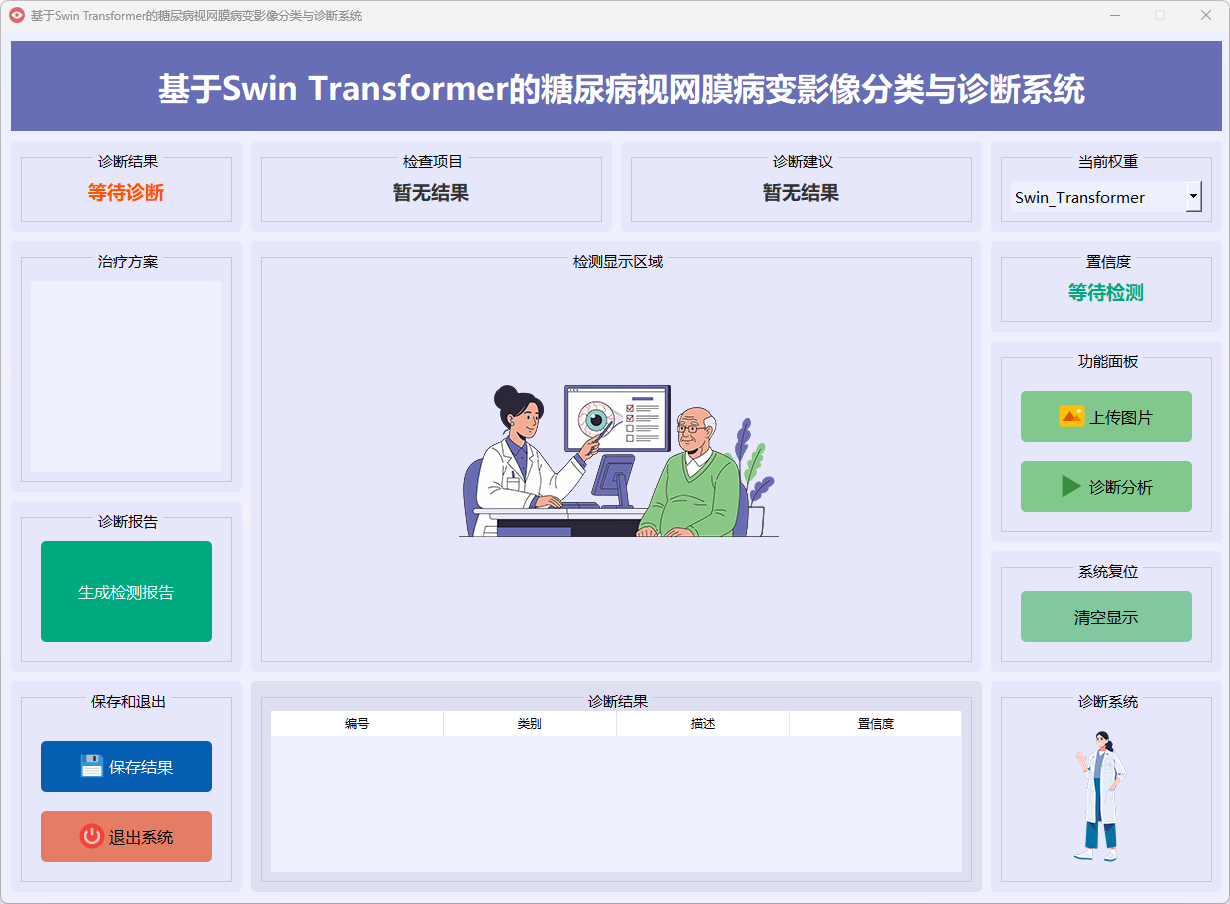

- 系统主界面展示

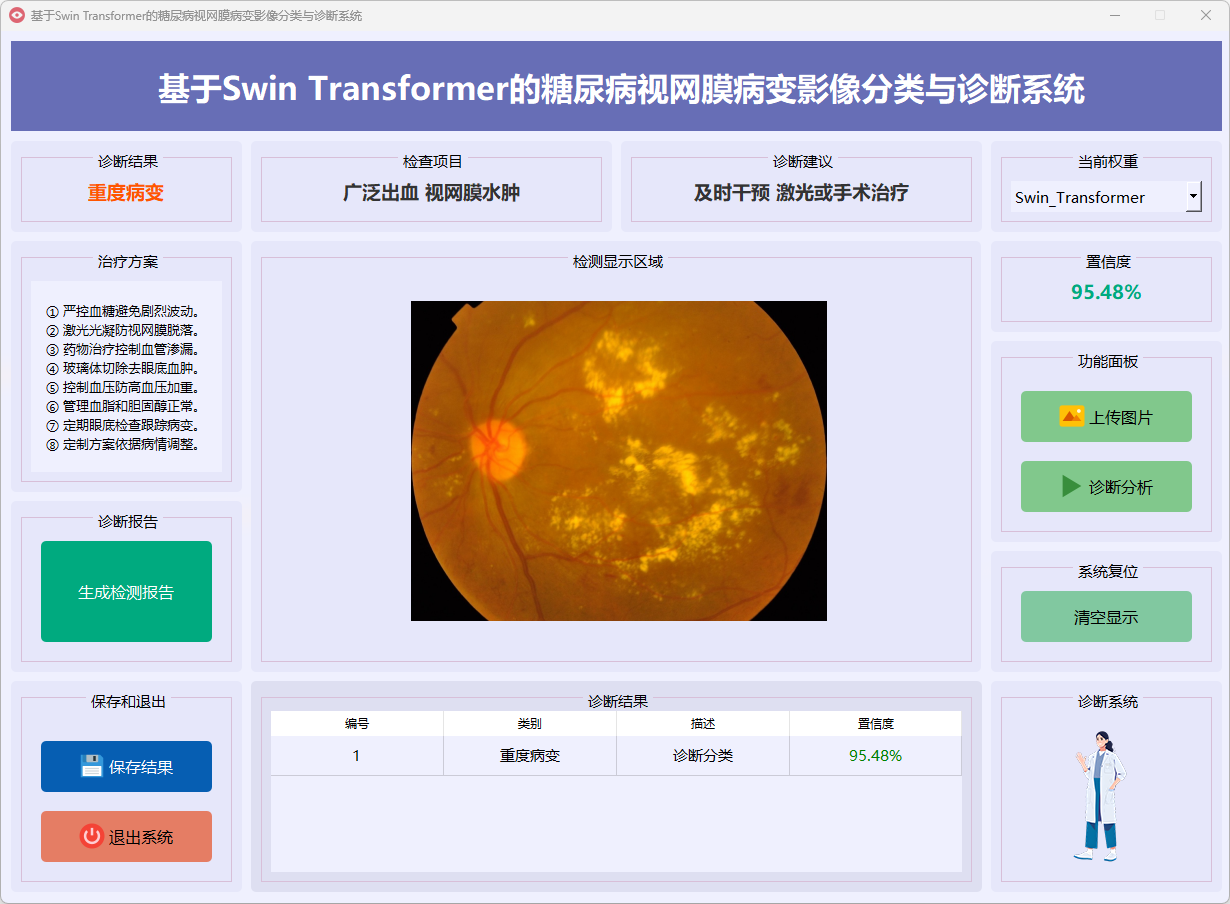

系统主界面集成了糖尿病视网膜病变影像上传、模型选择、实时分析及诊断结果展示等功能。用户可在界面中直观选择不同的深度学习模型(如Swin Transformer),上传糖尿病视网膜病变影像后,系统将自动进行特征提取与分类分析,并生成对应的诊断结果。界面支持对模型预测结果的可视化展示,方便医生和科研人员对比不同模型在糖尿病视网膜病变分类中的性能表现。系统支持诊断轻度病变、中度病变、增殖性病变和重度病变等多种糖尿病视网膜病变状态。

图12 系统主界面

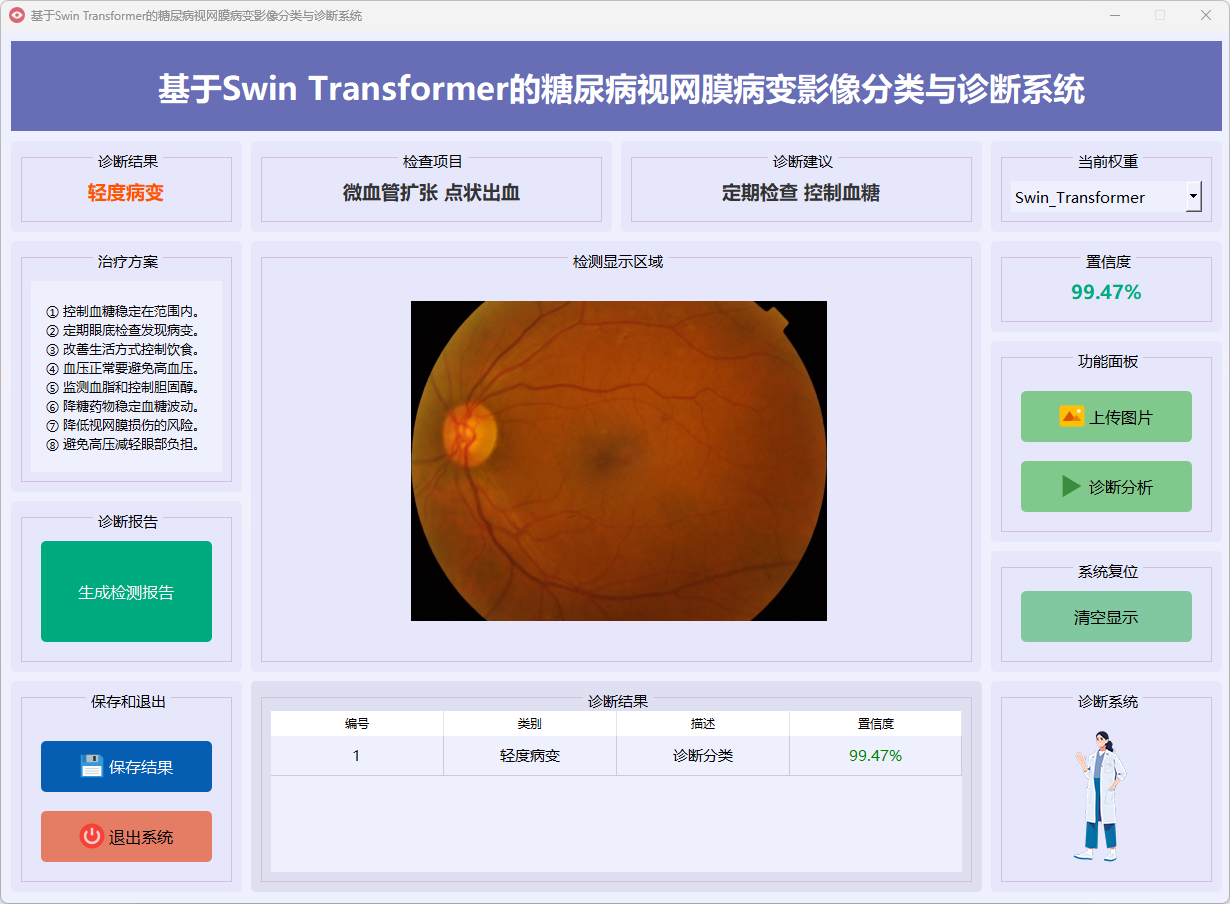

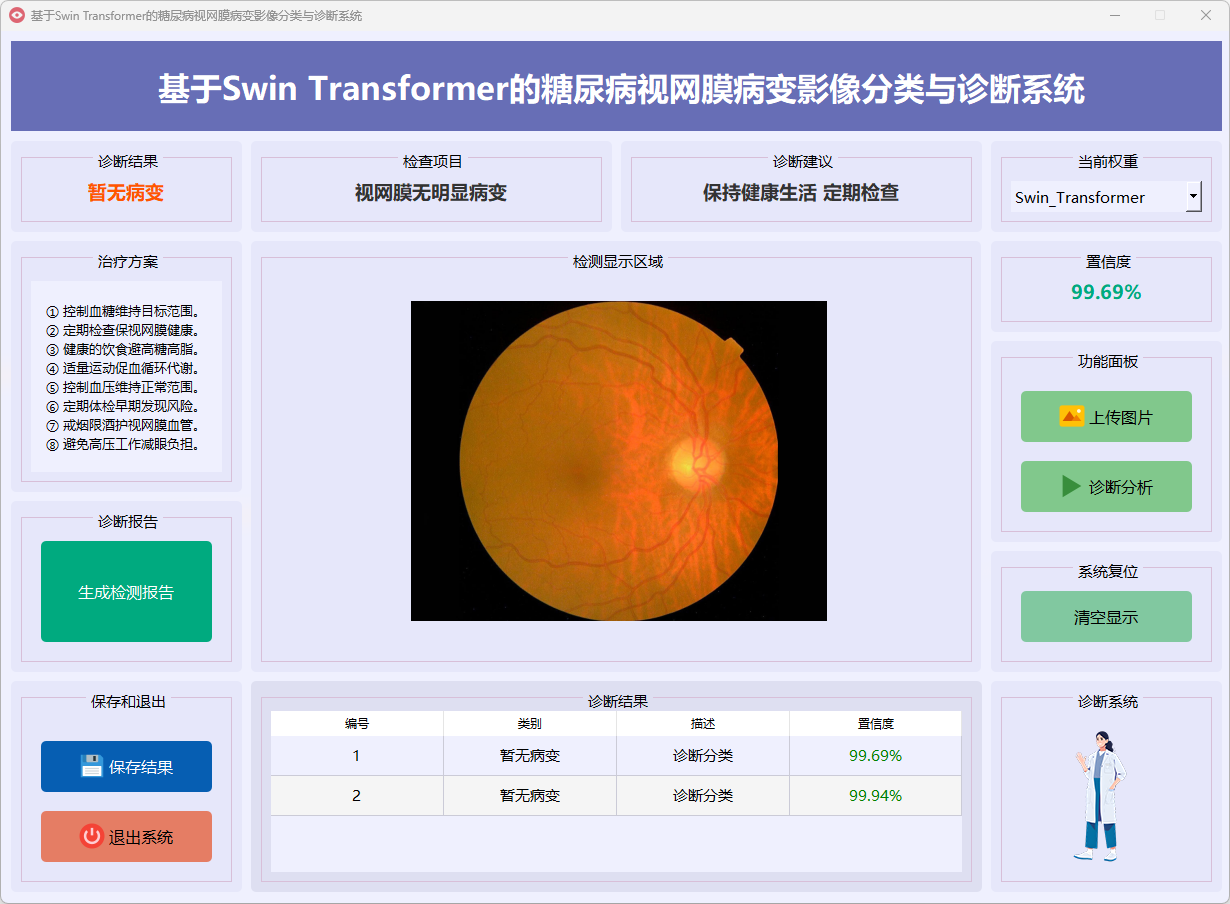

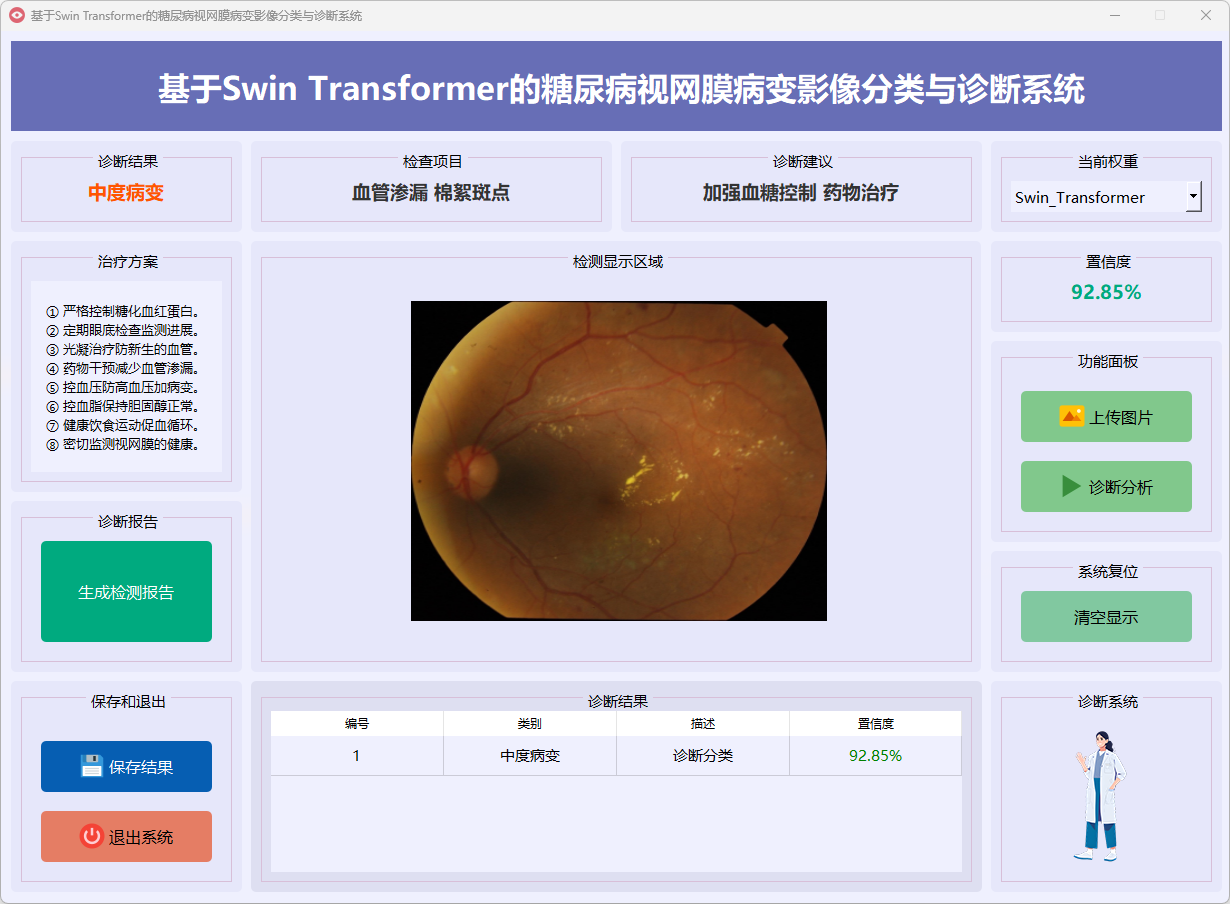

- 图片检测功能

本系统基于Swin Transformer模型,支持对糖尿病视网膜病变影像进行快速诊断。用户可以上传糖尿病视网膜病变影像样本,系统会自动进行分析,识别糖尿病视网膜病变的健康状态(如轻度病变、中度病变、增殖性病变、重度病变等),并给出诊断结果、分类标签和置信度评分。诊断结果通过清晰的文本和图表直观呈现,帮助医生和科研人员快速评估不同模型(如Swin Transformer)在糖尿病视网膜病变分类中的性能表现,从而为进一步的治疗决策提供支持。

图13 轻度病变

图14 暂无病变

图15 增值性病变

图16 中度病变

图17 中度病变

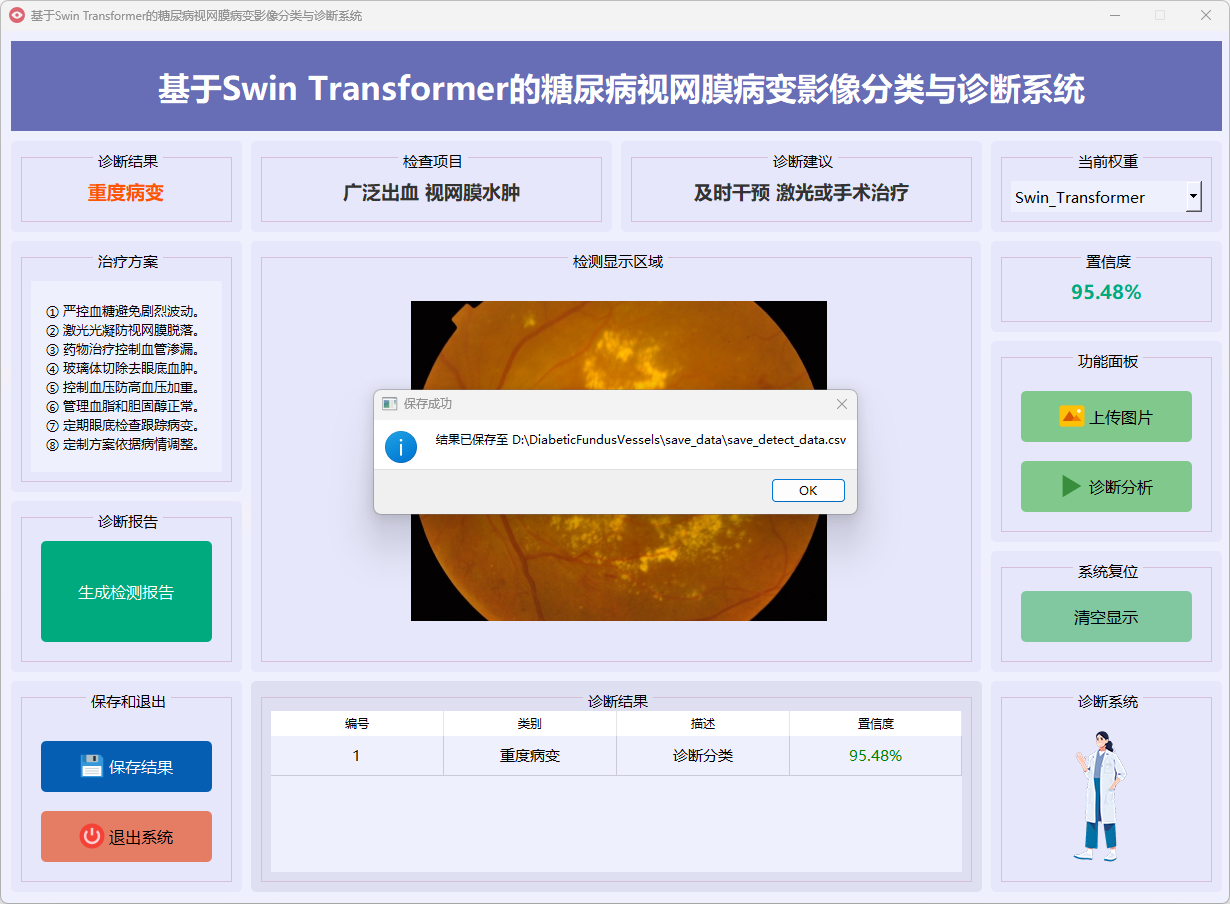

- 保存结果

图18 结果保存

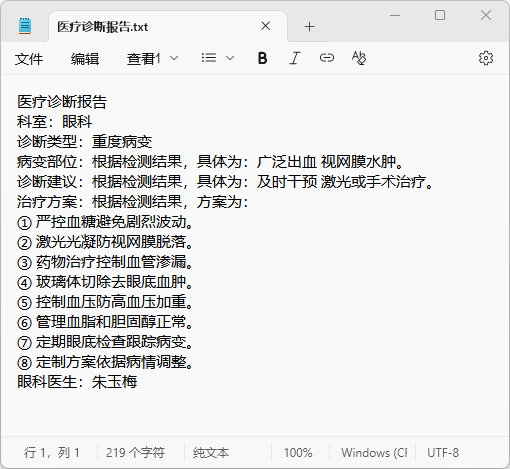

- 生成医疗影像诊断报告

图19 成功生成医疗影像诊断报告

图20 诊断报告

界面设计

本系统的图形用户界面采用PyQt5框架开发,致力于打造直观、高效且流畅的交互体验。通过精心设计的界面布局和模块化架构,系统功能得以清晰呈现,并确保各项操作的高效执行,全面提升用户使用体验。

图21 PyQt5主控面板界面

该界面展示了基于PyQt5框架精心设计的诊断系统,界面布局简洁、直观且高度集成。通过巧妙的模块化设计,系统涵盖了多项功能模块,确保用户能够高效、流畅地进行操作与交互,充分体现了系统在医学领域中的智能化与人性化设计。