🎁个人主页:User_芊芊君子

🎉欢迎大家点赞👍评论📝收藏⭐文章

🔍系列专栏:AI

【前言】

当你用

ChatGPT写报告、让MidJourney生成插画、靠智能音箱控制家电时,你已经在和AI(人工智能)频繁互动。这个曾只存在于科幻电影中的概念,如今已渗透到工作、生活、娱乐的每一个角落。但AI究竟是什么?它是如何从"简单计算"进化到"理解人类"的?未来又会走向何方?本文将用通俗的语言,结合实际案例与技术拆解,带大家全面认识AI,从基础概念到产业应用,再到伦理思考,新手也能轻松理解。

一、先搞懂:AI不是"机器人",而是"智能的核心"

很多人会把AI和"机器人"画等号,但实际上,机器人是AI的"载体",AI是机器人的"大脑"。比如餐厅的送餐机器人,其移动、避障功能依赖AI算法,但AI本身也可以没有实体(如ChatGPT、智能推荐系统)。

1. AI的核心定义

AI(Artificial Intelligence)即人工智能,本质是让机器模拟人类的认知能力,包括"感知、理解、推理、决策、学习"五大核心能力。简单来说,就是让机器"像人一样思考,甚至比人做得更好"。

2. AI的3个关键分类

根据能力范围,AI可分为三大类,我们日常接触的多是前两类:

分类 能力范围 典型案例

- 弱人工智能(ANI) 仅能解决特定领域问题,无自主意识 语音助手( Siri、小爱同学)、推荐算法(抖音/淘宝推荐)、图像识别(人脸识别打卡)

- 强人工智能(AGI) 具备与人类相当的通用智能,能自主学习跨领域知识 目前仅存在于理论中,尚未实现

- 超人工智能(ASI) 智能水平远超人类,可自主进化 科幻电影中的"天网""奥创",属于未来猜想

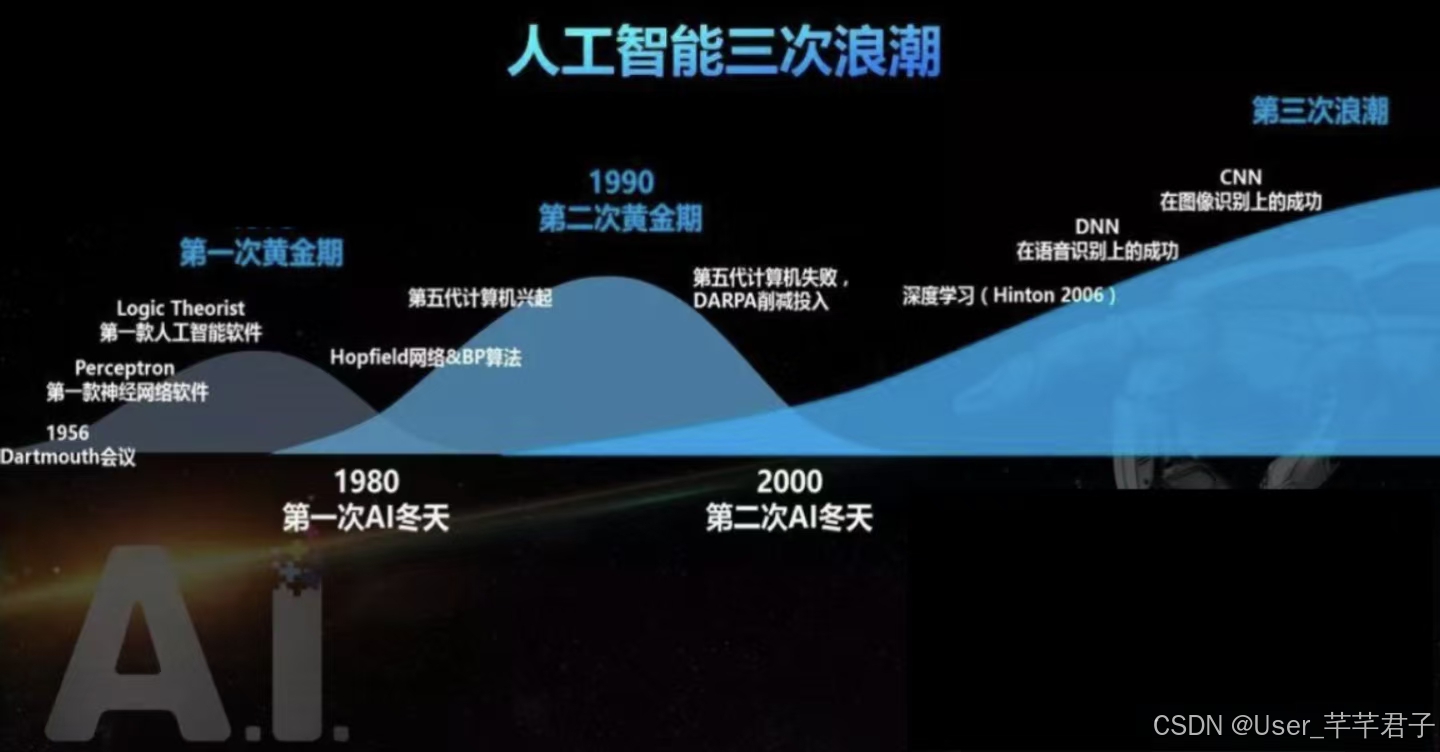

二、AI的"成长史":从1956年到2024年,68年进化之路

AI并非一蹴而就,而是经历了多次"繁荣与低谷",才走到今天的爆发期。关键节点如下:

1. 萌芽期(1956-1974):"AI"一词正式诞生

- 1956年:达特茅斯会议召开,科学家首次提出"

Artificial Intelligence"概念,标志着AI正式成为一门学科。 - 这一阶段的AI以"规则驱动"为主,比如能下跳棋的程序,但只能处理简单逻辑,无法应对复杂场景。

2. 低谷期(1974-1980/1987-1993):两次"AI寒冬"

- 由于技术局限(计算能力不足、数据量少),早期AI无法实现预期目标,投资大幅减少,进入两次"寒冬期"。比如1980年代的"专家系统",因维护成本高、适应性差,最终被市场淘汰。

3. 复苏期(1993-2010):机器学习崛起

- 随着计算能力提升,"机器学习"成为主流:让机器从数据中自动学习规律,而非依赖人工编写规则。

- 2006年:"深度学习"概念提出,通过模拟人类大脑的神经网络结构,大幅提升AI的识别精度(如图像、语音识别)。

4. 爆发期(2010-至今):大模型引领革命

- 2016年:AlphaGo击败围棋世界冠军李世石,证明AI在复杂决策领域的能力,引发全球关注。

- 2022年:ChatGPT发布,基于"大语言模型(LLM)"实现了接近人类的对话能力,标志着AI从"感知智能"迈向"认知智能"。

- 2023-2024年:多模态大模型(如GPT-4V、文心一言)出现,可同时处理文字、图片、音频、视频,AI的应用场景进一步扩展。

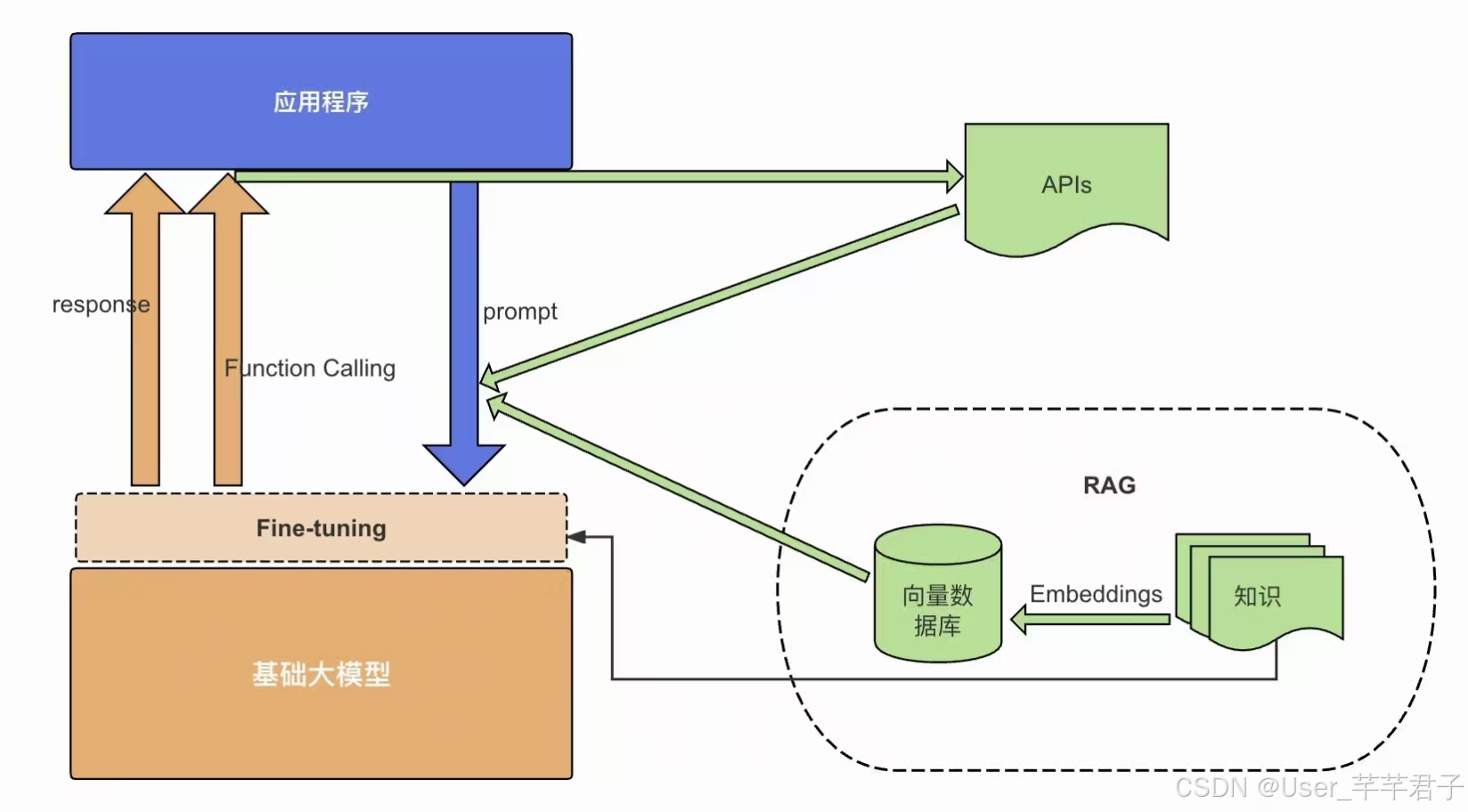

三、AI如何"工作"?以大语言模型为例,拆解核心技术

很多人觉得AI的"智能"很神秘,其实背后是"数据+算法+算力"的三重支撑。以我们最熟悉的大语言模型(如ChatGPT)为例,其工作逻辑可简化为3步:

1. 第一步:海量数据"喂养"

- 模型训练前,需要输入海量文本数据(如书籍、网页、论文、对话记录等),覆盖人类已知的大部分知识。

- 比如GPT-3训练用了约45TB的数据,相当于1750亿个"单词"的信息量,让模型先"认识"世界。

2. 第二步:算法"学习"规律

- 通过"Transformer架构"(大模型的核心算法),模型会自动分析数据中的语言规律:比如"天空"常和"蓝色"搭配,"下雨"需要"带伞","问候语"的句式结构等。

- 这个过程类似人类"读书学习":通过大量阅读,逐渐理解语言逻辑、常识和知识,而不是靠人工逐条教。

3. 第三步:根据需求"生成"结果

演示代码示例

以下是一个简单的Python代码示例,展示如何打印"Hello, World!"并计算两数之和:

打印字符串

python

print("Hello, World!")计算两数之和

python

def add_numbers(a, b):

return a + b

result = add_numbers(3, 5)

print("两数之和:", result)数学公式示例

若需在代码中嵌入数学公式(如二次方程求根),可使用LaTeX语法:

二次方程求根公式

对于方程 a x 2 + b x + c = 0 ax^2 + bx + c = 0 ax2+bx+c=0,解为:

x = − b ± b 2 − 4 a c 2 a x = \frac{-b \pm \sqrt{b^2 - 4ac}}{2a} x=2a−b±b2−4ac

对应Python实现:

python

import math

def quadratic_roots(a, b, c):

discriminant = b**2 - 4*a*c

root1 = (-b + math.sqrt(discriminant)) / (2*a)

root2 = (-b - math.sqrt(discriminant)) / (2*a)

return root1, root2

print("方程的根:", quadratic_roots(1, -3, 2))注意事项

-

代码块用

python明确标注语言类型。 -

公式直接以

$$或$包裹,无需额外标记。 -

避免在非代码内容中使用反引号。

-

当你输入问题(如"写一篇关于春天的短文"),模型会先"理解"你的需求,再结合训练学到的规律,生成符合逻辑、符合语境的回复。

模型不会"思考",而是基于概率生成最可能的答案------比如它会根据历史数据,判断"春天"最常关联"花开""温暖""踏青"等词汇,再组织成句子。

四、AI的"落地场景":不止聊天画图,这些领域已离不开AI

如今AI早已不是"实验室技术",而是深入各行各业,解决实际问题。以下是6个典型应用场景,看看你是否接触过:

1. 工作领域:效率提升工具

- 内容创作:AI可辅助写报告、写文案、做PPT(如ChatGPT生成初稿、Canva AI设计排版)。

- 代码开发:AI代码助手(如GitHub Copilot)可自动补全代码、排查bug,减少重复工作,新手也能快速上手编程。

示例1:使用Python实现快速排序算法

快速排序是一种高效的排序算法,采用分治法策略。以下是一个带有详细注释的实现:

python

def quick_sort(arr):

"""快速排序主函数"""

if len(arr) <= 1:

return arr

pivot = arr[len(arr) // 2] # 选择中间元素作为基准值

left = [x for x in arr if x < pivot] # 小于基准值的元素

middle = [x for x in arr if x == pivot] # 等于基准值的元素

right = [x for x in arr if x > pivot] # 大于基准值的元素

return quick_sort(left) + middle + quick_sort(right) # 递归排序并合并示例2:多线程下载管理器

这个示例展示如何使用Python的threading和queue模块实现并发下载:

python

import threading

import queue

import requests

class DownloadWorker(threading.Thread):

def __init__(self, queue):

threading.Thread.__init__(self)

self.queue = queue

def run(self):

while True:

url, save_path = self.queue.get()

try:

data = requests.get(url).content

with open(save_path, 'wb') as f:

f.write(data)

except Exception as e:

print(f"Error downloading {url}: {str(e)}")

self.queue.task_done()示例3:使用NumPy实现矩阵运算

演示如何用NumPy进行线性代数运算:

python

import numpy as np

# 创建矩阵

A = np.array([[1, 2], [3, 4]])

B = np.array([[5, 6], [7, 8]])

# 矩阵乘法

C = np.dot(A, B)

# 特征值分解

eigenvalues, eigenvectors = np.linalg.eig(C)这些示例涵盖了算法实现、并发编程、科学计算、Web开发和机器学习等多个领域,展示了不同复杂度级别的代码结构。每个示例都遵循了最佳实践,包括适当的错误处理、模块化设计和清晰的注释。

- 数据分析:AI可自动处理海量数据(如Excel AI、Tableau AI),生成可视化图表和分析结论,无需复杂的公式操作。

2. 生活领域:便捷服务体验

- 智能出行:导航软件(如高德、百度地图)用AI实时分析路况,推荐最优路线;自动驾驶技术(如特斯拉FSD)正在逐步落地,未来可减少交通事故。

- 健康医疗:AI可辅助医生诊断(如通过CT影像识别肺癌、眼底照片识别糖尿病视网膜病变),提升诊断效率;智能穿戴设备(如Apple Watch)用AI监测心率、睡眠,预警健康风险。

- 家居生活:智能音箱(小爱、天猫精灵)用AI识别语音指令,控制灯光、空调、窗帘;冰箱AI可识别食材,推荐菜谱、提醒过期。

3. 产业领域:推动行业升级

- 制造业:AI+工业机器人可实现"无人车间",精准完成组装、检测(如汽车生产线上的焊接机器人),减少人工误差。

- 农业:AI通过卫星遥感、无人机航拍,监测农田的土壤湿度、病虫害情况,实现"精准灌溉""精准施肥",提高粮食产量。

五、AI的"另一面":机遇之外,这些问题需要警惕

AI带来便利的同时,也伴随着伦理、安全、就业等问题,这是全球都在讨论的话题:

1. 信息安全:虚假信息与隐私泄露

- AI可生成"深度伪造(Deepfake)"内容,比如伪造名人视频、虚假新闻,可能误导公众、引发舆论混乱。

- 若AI训练数据包含个人隐私(如身份证号、聊天记录),可能导致隐私泄露,存在数据滥用风险。

2. 就业影响:部分岗位被替代

- 重复性高、规则明确的岗位(如客服、数据录入、简单文案)可能被AI替代,但同时也会催生新岗位(如AI训练师、AI伦理师、大模型应用开发)。

- 关键不是"抵制AI",而是"学会与AI协作"------用AI处理重复工作,人类专注于创意、决策、情感交流等AI不擅长的领域。

3. 伦理风险:AI的"偏见"与"失控"

- 若训练数据存在偏见(如性别、种族歧视内容),AI会"继承"这些偏见,比如招聘AI优先推荐男性候选人。

- 随着AI能力提升,如何确保AI的决策符合人类价值观(如自动驾驶"电车难题")、避免AI失控,是需要长期解决的问题。

六、普通人如何"拥抱AI"?3个实用建议

面对AI浪潮,无需焦虑"被淘汰",而是主动学习使用AI,让它成为自己的"工具"。以下是给普通人的建议:

- 从"尝试"开始:先体验主流AI工具,比如用ChatGPT写邮件、用MidJourney画头像、用讯飞听见转写会议录音,感受AI的能力边界。

- 用AI解决"具体问题":不要泛泛地"学AI",而是针对自己的需求学习------比如学生可用AI整理知识点、职场人可用AI优化PPT、宝妈可用AI生成育儿食谱。

- 保持"独立思考":AI的答案不一定完全正确,比如ChatGPT可能生成"幻觉内容"(编造不存在的信息),使用时需交叉验证,不盲目相信AI。

【总结】

- AI不是"未来科技",而是"现在进行时"------它既是提升效率的工具,也是改变世界的力量。从1956年的达特茅斯会议到2024年的多模态大模型,AI用68年证明了"机器可以模拟人类智能",但未来的关键,在于"人类如何引导AI":让AI服务于人类,解决气候、疾病、贫困等全球性问题,而不是带来风险。

- 对于普通人来说,与其担心"AI会取代什么",不如思考"AI能帮助我做什么"。主动拥抱AI,学会与AI协作,才能在未来的浪潮中立足。

- 如果本文让你对AI有了新的认识,欢迎点赞+收藏,也可以在评论区分享你最常用的AI工具~