本文较长,建议点赞收藏。更多AI大模型应用开发学习视频及资料,在智泊AI。

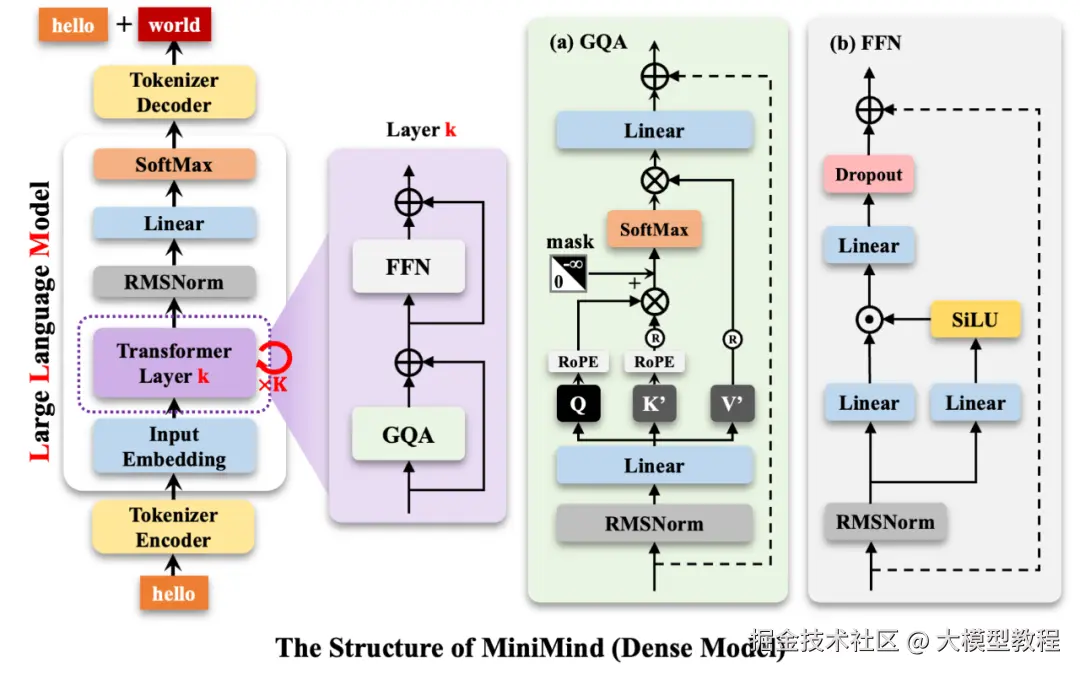

最近在GitHub上挖到一个宝藏项目------MiniMind,一个能让大家从零开始,用极低成本和极短时间玩转大模型全流程的开源项目。从预训练(Pretrain)到监督微调(SFT),从LoRA轻量化训练到DPO偏好优化,甚至模型蒸馏和多模态拓展,全部代码原生PyTorch实现,不依赖复杂第三方抽象接口。

作为一名AI从业者,亲测后发现它不仅是一个可落地的项目,更是入门大模型训练的绝佳教程。今天就带大家手把手体验这个"大道至简"的实战过程。

01 为什么MiniMind值得上手?

接触过大模型的同学都知道,训练一个模型往往意味着"高门槛":动辄千万级参数、数万元服务器成本、数周的训练周期,还得依赖一堆复杂框架。但MiniMind彻底打破了这个印象:

-

极致轻量化:最小的MiniMind2-small仅25.8M参数,是GPT-3的1/7000,普通个人GPU(比如NVIDIA 3090)就能轻松跑起来。

(本地实测)训练完成的 DPO 模型(out/dpo_512.pth)仅 2910 万参数,内存占用 55.52MB。从结构上看,它由 8 层网络组成,核心参数集中在 MLP 模块(59.4%),没有冗余设计

yaml

PyTorch Model Analysis: out/dpo_512.pth

==================================================

File Size: 58237621 bytes (55.54 MB)

File Type: PyTorch Model

Object Type: dict

Total Parameters:29,106,688

Model Size in Memory: 55.52 MB

Model Architecture Summary:

----------------------------

Number of Layers:8

Vocab Size: 6400

Hidden Size: 512

Output Vocab Size: 6400

Attention Heads:1

Head Dimension: 512

Component Breakdown:

Tokenizer Embeddings:3,276,800 parameters (11.3%)

- model.embed_tokens.weight

Attention Blocks:5,242,880 parameters (18.0%)

MLP Blocks:17,301,504 parameters (59.4%)

Layer Norms:8,192 parameters (0.0%)

Final Normalization: 512 parameters (0.0%)

- model.norm.weight

Output Projection: 3,276,800 parameters (11.3%)

- lm_head.weight-

低成本快迭代:单卡3090训练2小时、服务器成本仅3元,就能从0训出一个能对话的基础模型;8卡4090甚至能压缩到10分钟内,成本几乎不变。

-

全流程开源:从Tokenizer训练、数据清洗,到Pretrain、SFT、LoRA、DPO/PPO强化学习,再到模型蒸馏,每一步都有完整代码,且完全基于PyTorch原生实现,小白也能看懂底层逻辑。

-

扩展性强:不仅支持文本模型,还拓展了视觉多模态(MiniMind-V),兼容transformers、vllm、llama.cpp等主流工具,训练好的模型能直接集成到ChatUI里用。

02 实战前的准备:3分钟搭好环境

MiniMind的门槛低到离谱,不需要复杂的集群配置,个人电脑或云服务器(3090以上显卡)就能搞定。

- 环境依赖

核心依赖只有PyTorch,其他库(如transformers、datasets)按需安装,项目仓库里提供了requirements.txt,一行命令即可搞定:

pip install -r requirements.txt- 数据集准备

不用自己爬数据!项目开源了所有训练阶段的高质量数据集(预训练、SFT、DPO等),直接从ModelScope或HuggingFace下载,放到./dataset/目录即可。推荐先下这三个核心文件:

pretrain_hq.jsonl:高质量预训练数据(1.6GB)sft_*mini_*512.jsonl:精简版SFT指令数据(1.2GB)dpo.jsonl:偏好优化数据(55MB)

03 从零训练三步走:从"空白模型"到"能聊天"

第一步:预训练(Pretrain)------让模型"认识世界"

预训练是让模型学习语言规律的基础,MiniMind的预训练过程简化到极致:

-

下载并处理预训练数据(

pretrain_hq.jsonl),项目提供了自动清洗脚本,会过滤低质文本、统一格式。 -

运行预训练脚本,指定模型参数(以25.8M的small模型为例):

python train_pretrain.py

单卡3090上,2个epoch约1.5小时就能跑完,模型会初步具备语言生成能力。

第二步:监督微调(SFT)------教模型"懂指令"

预训练后的模型像个"识字但不懂任务"的孩子,SFT要教它理解人类指令(比如"推荐杭州美食""解释大语言模型"):

-

用

./dataset/sft_*mini_*512.jsonl作为微调数据,包含日常对话、知识问答等场景。 -

运行SFT脚本:

python train_sft.py

这一步更快,约30分钟就能完成,模型已经能回应简单指令了。

第三步:DPO优化------让模型"说人话"

直接微调的模型可能回答生硬,DPO(直接偏好优化)通过"好/坏回答对比",让模型输出更符合人类偏好的内容:

-

使用

dpo.jsonl数据集,里面包含"问题+好回答+坏回答"的三元组。 -

运行DPO脚本:

python train_dpo.py

20分钟左右完成,此时模型的对话流畅度会明显提升。

04 效果实测:3元成本的模型能做到什么?

训练完成后,用项目提供的eval_llm.py启动一个简单chat终端,就能直接和模型聊天了。实测效果超出预期:

- 基础对话:能清晰介绍自己("我是MiniMind,一个轻量级AI助手")。

- 知识问答:能解释"大语言模型"的基本概念,推荐杭州特色美食(虽然偶尔会混入其他地方的菜,但逻辑在线)。

- 多语言能力:支持简单英文对话,虽然不够流利,但作为25.8M的小模型已属难得。

(附一段实测对话)

markdown

MiniMind模型参数: 25.83 M(illion)

[0] 自动测试

[1] 手动输入

1

👶: 请介绍一下北京的美食

🤖️: 北京是中华人民共和国首都,拥有丰富的美食文化。以下是一些著名的美食:

1. **烤鸭**:北京烤鸭是北京最具代表性的美食之一,以其独特的皮脆肉嫩、皮脆肉嫩、鸭肉鲜嫩、鸭血粉腌制而闻名。

2. **豆汁**:豆汁是北京最具代表性的美食之一,以其浓郁的豆汁和鲜美的鸭肉汁而闻名。

3. **火锅**:火锅是北京最有名的中国菜之一,以其火锅底料、肉质鲜嫩、配料多样而闻名。

4. **葱油饼**:葱油饼是北京传统美食,通常由饼皮、葱花、肉馅、豆皮等配料组成,口感麻辣鲜香,是北京的代表美食之一。

5. **豆浆**:豆浆是北京著名的特色小吃,由豆浆、牛奶、蛋黄、糖等原料制成,口感丰富,可以搭配米饭食用。

05 一点建议:为什么MiniMind是最好的入门教材?

如果你是大模型初学者,MiniMind的价值远不止"能训模型":

- 代码极简:所有核心算法(如Transformer结构、LoRA权重分解、DPO损失函数)都用PyTorch原生代码实现,没有隐藏的第三方接口,能直接看到"模型怎么算出来的"。

- 文档详细:从数据清洗到训练参数调优,每个步骤都有注释和说明,甚至包含"为什么这么做"的思路解析。

- 可扩展性强:想尝试MoE(混合专家模型)?想做医疗领域微调?项目里有现成的代码和数据集(如

lora_medical.jsonl),改改参数就能跑。

06 结语:用"极简"打破大模型的"神秘感"

MiniMind最打动我的是它践行的"大道至简"理念------大模型不是只有大厂能玩的奢侈品,普通人也能完整体验从0到1的训练流程。如果你也想亲手摸透大模型的底层逻辑,不妨从这个项目开始:不需要高深的理论,不需要昂贵的设备,跟着步骤一步步跑,你会发现"训练大模型"原来这么简单。

学习资源推荐

如果你想更深入地学习大模型,以下是一些非常有价值的学习资源,这些资源将帮助你从不同角度学习大模型,提升你的实践能力。

本文较长,建议点赞收藏。更多AI大模型应用开发学习视频及资料,在智泊AI。