ADI 的ADTF3175 ToF 传感器模块

一、ToF技术核心与优势

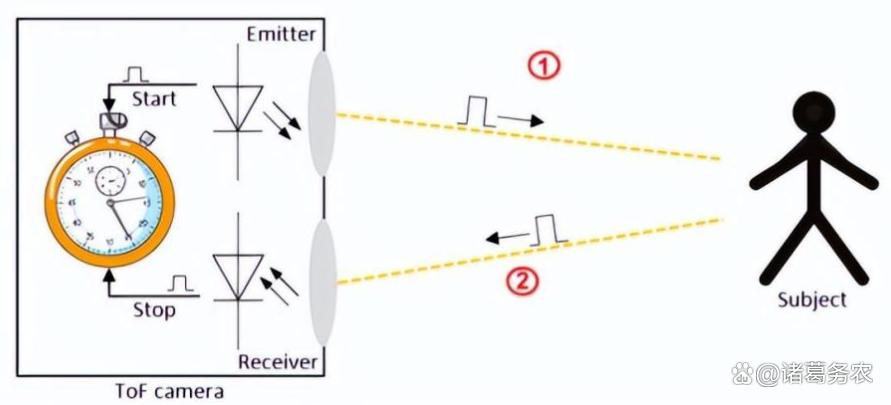

- 核心原理

ToF(Time-of-Flight,飞行时间)相机的核心原理是:通过向目标物体发射光脉冲(通常是不可见的红外光),并测量光脉冲从发射到经物体反射后返回传感器所需的时间(或相位差),利用光速恒定这一特性,直接计算出物体与相机之间的距离。

- 技术优势在

快速全局测量:能一次性获取整个场景的深度信息,无需像激光雷达那样进行扫描。

较高精度:通常能达到毫米级到厘米级的测距精度,且在一定范围内精度受距离影响较小。

主动感知:自身投射光源,不依赖环境光,在黑暗环境中也能正常工作。

计算效率高:深度计算原理相对直接,算法复杂度较低,易于实现实时处理。

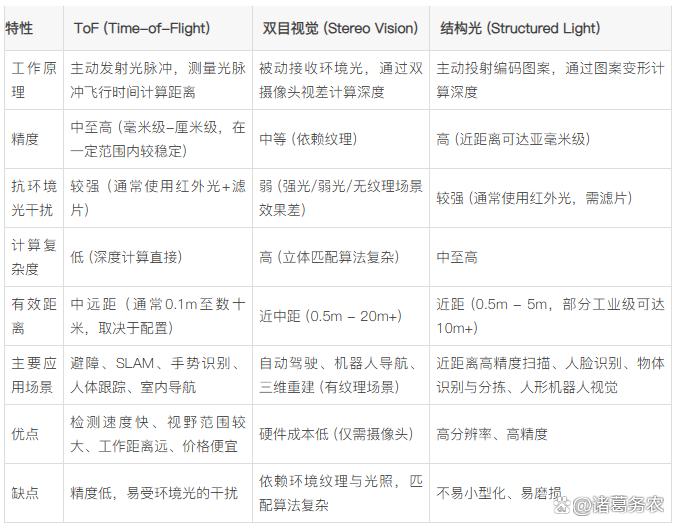

ToF技术并与其他主流3D传感技术区分

二、技术种类与工作原理

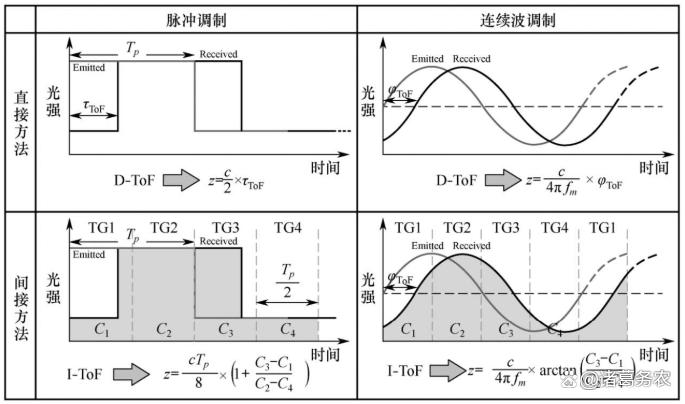

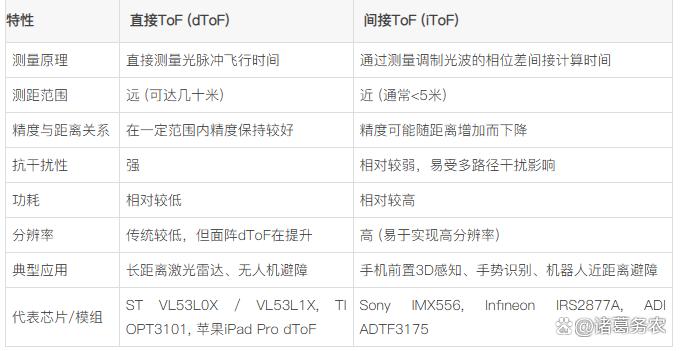

ToF技术依据其测量飞行时间的具体方式,主要分为两大类:

- 直接ToF(dToF, Direct Time-of-Flight)

工作原理:直接测量光脉冲从发射到返回的飞行时间。通常使用短脉冲激光和高精度计时器(如时间数字转换器TDC)。统计多次脉冲的飞行时间直方图,出现频率最高的时间即为目标的飞行时间。

特点:适合长距离测量(可达几十米甚至更远);抗干扰能力强,功耗相对较低;实现高精度需要非常精密的计时电路(如SPAD单光子雪崩二极管)。传统上在分辨率方面面临挑战,但新兴的面阵dToF技术正在突破这一限制。

ToF相机原理的分类

- 间接ToF(iToF, Indirect Time-of-Flight)

工作原理:不直接测量时间,而是通过测量发射调制光波与接收反射光波之间的相位差来间接计算飞行时间。常用连续波调制(CW-iToF),如正弦波或方波。

特点:更适合短距离(通常<5米)测量;易于实现较高的面阵分辨率,适用于需要细腻深度图像的场景;计算相对复杂,可能存在多路径干扰(光信号经多次反射后才返回传感器,导致测距错误)和相位卷绕(超出最大不模糊距离时出现测距错误)问题。

dToF和iToF技术对比

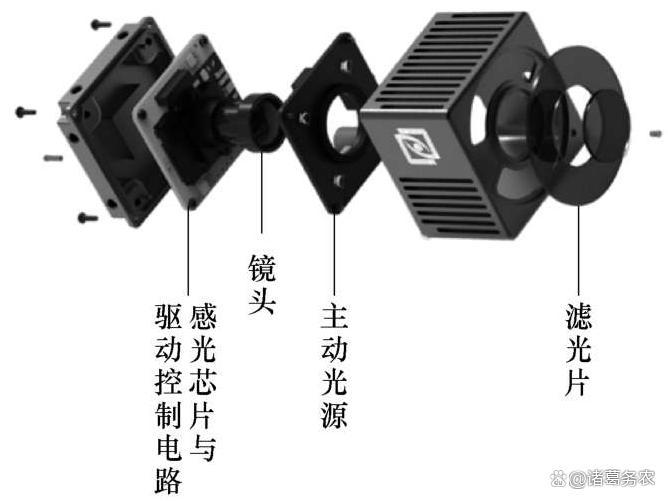

- 关键组件

ToF相机的关键组件通常包括:

光源:通常是VCSEL(垂直腔面发射激光器),用于发射调制后的红外光脉冲。

光学镜头与滤光片:聚焦发射光,并接收反射光。滤光片(通常为窄带)用于抑制环境光干扰。

光电探测器:接收反射光信号并将其转换为电信号。例如SPAD(单光子雪崩二极管,用于dToF)或ToF专用CMOS传感器(用于iToF)。

控制与处理电路:包括计时电路(如TDC)、调制解调器和计算单元,用于驱动光源、计算飞行时间/相位差,并最终输出深度信息。

Smart ToF相机结构

三、在人形机器人中的应用进展

ToF技术凭借其快速、中距、全局深度感知的能力,在人形机器人中找到了多样化的应用场景,尤其适用于实时性要求高的任务:

- 实时避障与安全防护:

这是ToF相机在人形机器人中最直接和重要的应用。通过实时提供周围环境的深度图,机器人可以快速识别出行进路径上或工作空间内的障碍物(包括动态障碍物),并触发紧急停止或规划绕行路径。其较高的帧率(通常可达30fps甚至更高)能够满足机器人运动过程中的实时避障需求。例如,苹果的人形机器人ARMOR据称在手臂和腿部集成了多达80个ToF传感器,构建了分布式感知网络,使其碰撞降低了63.7%,任务成功率提高了78.7%。

- SLAM(同步定位与地图构建)与导航:

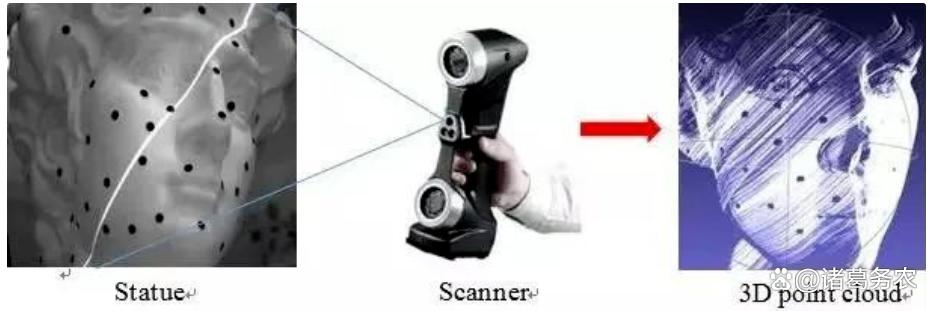

ToF相机可以作为机器人在室内环境中进行SLAM的主要传感器之一。它能够快速生成环境的3D点云地图,帮助机器人定位自身并构建可用于导航的地图。相比纯视觉SLAM,它对环境纹理的依赖性较低;相比激光雷达,它在成本上可能具有优势。

- 近距离交互与手势识别:

对于iToF相机,其较高的分辨率使其能够捕捉较为细致的手部运动。这使得人形机器人可以通过识别人的手势来实现非接触式的交互和控制。

- 全身感知与场景理解:

通过在机器人身体的不同部位(如头部、躯干、手臂甚至腿部)分布式部署多个ToF传感器,可以构建一个全方位的深度感知系统,极大减少感知盲区。这种方案有助于机器人更全面地理解自身所处的环境状态,为复杂的自主决策提供信息基础。苹果ARMOR机器人的实践就展示了这种分布式感知概念的潜力。

飞行时间3D成像

四、不足与限制

- 环境光干扰:

虽然ToF相机使用红外滤光片来抑制环境光,但强烈的太阳光(包含丰富的红外光谱)仍然可能饱和传感器,导致测距失效或精度严重下降。这是所有主动光学传感器面临的共同挑战。

- 测量精度与噪声:

iToF容易受到多路径干扰(Multi-path Interference)的影响,即光信号经过多次反射后才进入传感器,导致计算出的距离并非真实的直线距离。不同材质的物体表面(如高反光表面和纯黑吸光表面)会影响光的反射强度和特性,可能引入测距误差或导致数据丢失。在非常近的距离(例如<10厘米),iToF的测量误差可能较大。

- 分辨率与成本的权衡:

传统上,dToF传感器的空间分辨率相对较低,难以捕捉场景的精细细节,但这方面技术正在快速发展(如苹果激光雷达扫描仪中使用的面阵dToF)。

高性能的ToF相机(特别是那些具有高分辨率、高精度和抗干扰特性的)成本仍然较高,这可能限制了其在成本敏感型机器人产品中的大规模应用38。

- 功耗与散热:

主动发射激光的ToF相机需要一定的功耗,对于依赖电池移动工作的机器人而言,需要权衡感知性能与续航时间。大功率激光器的散热也是一个需要考虑的工程问题。

扫描3D成像

五、重点难点、主攻方向与前技术前沿

为了克服上述限制,让ToF感知更强大、更可靠,研究人员和产业界正致力于以下方向的突破:

- 抗干扰能力提升:

硬件层面:采用更窄带宽的滤光片、更高功率且特定波长的VCSEL激光器(如940nm波长比850nm受日光影响更小),以及光学衍射元件(DOE) 来优化光场。

算法层面:开发先进的抗多路径干扰算法和滤波算法,通过软件方式补偿和修正硬件测量的误差。例如,光鉴科技提出的mToF (modulated ToF) 方案,通过在系统端结合软硬件,引入调制光场的概念,通过空域、频域、时域上的巧妙设计,创新硬件协同前沿算法,在物理上提升iToF抗干扰、抗噪声能力9。

- 性能极限的突破:

dToF的革新:面阵dToF技术是前沿焦点。通过大规模SPAD阵列和高性能TDC的集成,dToF正在突破分辨率的限制,同时保持其长距离、抗干扰的优势。例如,ADI公司发布的ADTF3175 ToF模块采用了100万像素(1024x1024)的高分辨率传感器,实现了±5mm的高精度,显著提升了细节捕捉能力。

调制技术与精度:通过提高调制频率(对于iToF)或使用更短的光脉冲(对于dToF)来提升测距精度。

- 多传感器深度融合:

这是最切实有效的趋势。融合ToF与其他传感器的数据,取长补短。

ToF + 可见光相机:ToF提供深度信息,可见光相机提供丰富的纹理和颜色信息,两者融合可实现更鲁棒和语义丰富的环境感知。

ToF + IMU:IMU提供高频的运动信息,可以帮助补偿ToF相机在快速运动时可能出现的运动模糊,并辅助SLAM算法。

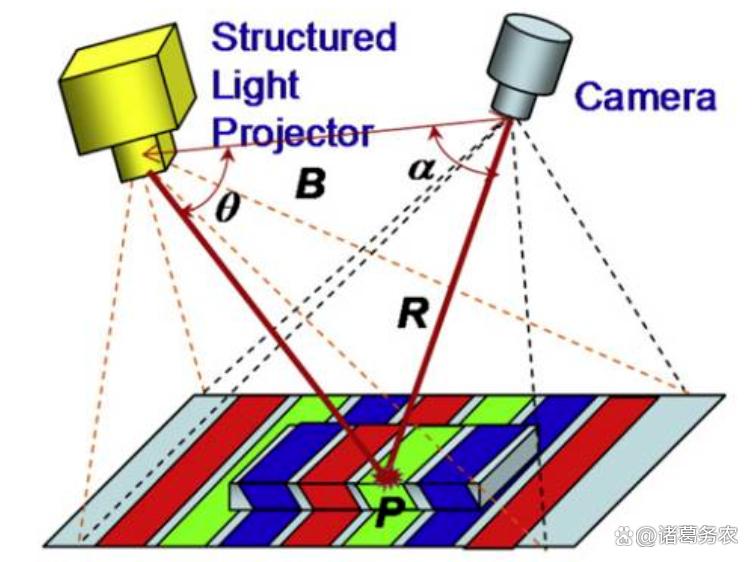

ToF + 结构光:如武汉灵途传感融合结构光与ToF,覆盖10毫米至10米测量范围,近距精度达0.1毫米2。结构光在近距离提供超高精度,ToF则在更远距离上发挥作用。

ToF + 毫米波雷达:毫米波雷达在恶劣天气下的穿透性可弥补光学传感器的不足。

- 智能化与集成化:

AI赋能:利用深度学习模型处理ToF产生的深度数据,用于点云分割、物体识别、手势识别等,提升感知的智能化水平。

算力下沉与模块化:将更多的处理算法集成到传感器内部或靠近传感器的处理单元上,实现边缘计算,降低主控处理器负担,减少延迟。例如ADI ADTF3175提供了一个即插即用的模块化方案,集成成像器、光学滤波器、红外光源及电源管理单元,简化了系统集成难度。

芯片级创新:dToF的发展很大程度上依赖于SPAD和TDC等核心元件的工艺升级和集成度提升,例如追求更低的暗计数率(DCR)、更高的光子探测效率(PDE)和更低的时间抖动(jitter)。

结构光投影3D成像

六、总结与展望

ToF传感技术为人形机器人提供了快速、中距离、全局的三维环境感知能力,是其实现实时避障、SLAM导航和交互的重要技术路径之一。

其发展正呈现出以下清晰趋势:

- dToF与iToF技术并行发展:

dToF凭借其抗干扰和测程优势,随着面阵技术的发展,将在移动机器人中扮演更重要角色。iToF则持续优化,在近距离、高分辨率应用场景中保持价值。

- 融合化:

与其他传感器(可见光、IMU、结构光等)深度融合,构成多模态感知系统,成为应对复杂环境的必然选择。

- 智能化:

与AI算法深度结合,从"提供数据"走向"理解场景"。

- 模块化与芯片化:

提供更集成、更易用的解决方案,降低开发门槛,成本也有望随着技术进步和规模化应用而逐步下降。

未来的理想状态是,ToF传感器将作为人形机器人多传感器感知网络中的重要一环,与其他传感器默契协同,以高可靠性、高实时性的深度感知能力,赋能机器人在动态和未知环境中安全、自主地行动和工作。

典型ToF传感器模块

【免责声明】本文主要内容均源自公开资料和信息,部分内容引用了Ai。仅作参考,不作任何依据,责任自负。