随着自动驾驶技术的发展,专利制度也遇到了新的挑战。

当自动驾驶技术方案涉及道德伦理问题时,是否仍可能成为专利法保护的客体?我国的专利制度是如何规定的?

例如,汽车失控,前面右边有一个小孩,左边有一个老人,在设定算法时,能不能做出设定∶让车辆传感器(摄像头)识别行人的年龄和体态,让车辆撞向老人而避开小孩?

在现实中,这个问题确实令人很挣扎。

我们要如何控制?我们能不能这样控制?

技术上,没有任何问题。

但是,在现实中会遇到非常棘手的法律和伦理的问题。我们的法律又如何规定?

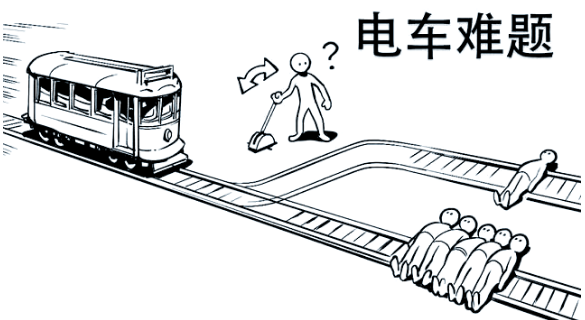

由此引出经典的电车难题。

电车难题

电车难题(Trolley Problem)是伦理学领域知名思想实验,由哲学家菲利帕·福特于1967年在《堕胎问题和教条双重影响》中首次提出。

电车难题核心内容:假设失控的电车将碾压轨道上的五人,旁观者可通过拉杆使电车转向另一轨道撞死一人,由此引发是否应以主动行为牺牲少数人挽救多数人的伦理争议。

紧急避险

选择牺牲一个人来拯救五个人,是否构成紧急避险?紧急避险要求牺牲一个较小的法益,而保全较大的法益。

举个简单的例子。

在公园里,一个小孩被一条不拴绳的名贵小狗(价值5万元)追咬。路人张三见状,遂跑过去,捡起地上的一根木棍将狗头打爆,使小孩免受伤害。

在这个爆打狗头的案例中,张三以牺牲较小的法益(毁坏财物),换取了更大的法益(小孩的生命健康),属于典型的紧急避险,且不过当,属于刑法上的违法阻却事由。

回到电车难题,如果电车选择撞死一个人,而保全了五个人,是否属于牺牲较小的法益而换取较大的法益?

与电车难题类似的案例还有"米丽雷特号"案。

"米丽雷特号"案(吃人保命案)

1884年的"米丽雷特号"案,1884年,"米丽雷特号"轮船经历狂风暴雨后最终沉没。当时幸存下来的有4名船员:船长杜德利、大副史迪芬斯、船员布鲁克斯以及船上的杂役帕克。"米丽雷特号"沉没后,这4人逃到救生艇上,后来,帕克不顾阻拦执意喝了海水,奄奄一息。救生艇上的食物有限,被4人吃完后,4人又挨了8天没有进食。遇难19天后,船长杜德利决定进行抽签,谁被抽到就会被杀,以此来拯救剩下的人员。船员布鲁克斯始终保持沉默。

最后,船长杜德利选择将行将就木的帕克杀死,大副史迪芬奇赞同这个决定,而气若悬丝的帕克即使不愿意也没有反抗之力,剩余三人最终靠帕克的血肉存活,帕克的大部分的血肉被杜德利和布鲁克斯分食,史迪芬斯则吃得很少。三人最终获救,获救后,船长杜德利和大副史迪芬斯以谋杀罪被起诉,而法官认定二人有罪。

自动驾驶场景下的电车难题

在自动驾驶场景中,问题更复杂:决策主体从人变为机器,责任归属从"人"转移到"算法设计者"或技术体系。

当自动驾驶技术方案遇到道德伦理问题

在我国,这类涉及伦理道德的技术方案,是否可以申请专利?

专利审查指南的新修订

在最新修改的专利审查指南中,对这类技术方案作出了明确的规定∶

示例2(伦理偏见):一项"无人驾驶车辆应急决策模型"发明,通过考虑行人性别和年龄来决定不可避让碰撞时的保护对象与撞击对象 。这种算法在事故中按性别和年龄区别对待生命,被认定违背了公众关于生命平等的伦理道德观念,强化了社会偏见并引发公众安全担忧。因此,该发明含有违反社会公德的内容,依据专利法第五条第一款不得授予专利。

自动驾驶电车难题在刑法上的处理

刑事责任:争议部分学者认为,自动驾驶汽车的"电车难题"是假问题,开发商无需设置紧急程序,但实际中探测系统存在局限,无法完全避免动态环境中的突发危险。

法律需明确:若机器决策导致伤害,责任应归属于算法设计者或车企,而非抽象的"技术"。

在法律上,为了保全自己或他人的合法权益,可以通过损害一个较小的利益来保全一个更大的法益。

但在"米丽雷特号"事件中,为了三人的生命牺牲一人是否成立紧急避险呢?

著名刑法专家罗翔的观点

罗翔老师认为,在危难来临的时候,我们可能有一种道德上的义务,可以为了保全别人的生命而牺牲自己,但这只是个人的一种道德义务。你不能把它演变为可以牺牲他人来保全自己或他人的生命,因为道德在绝大多数情况下都是一种自律,而不是他决。

对生命的尊重

"你希望别人怎么对你,你也要怎么对待别人"。

人不能成为他人目的的纯粹工具,无论为了保障何种社会利益,无辜个体的生命都不能被剥夺。

比如,如果你接受电车案中冷静的价值对比式的功利计算(功利论),那么------

如果在缺乏食物的情况下,是否可以牺牲病人和智力残疾者?

是否可以为了挽救年轻人,就可以任意割取无辜老人的器官?

是否可以为了挽救自己爱人的生命,就可以随意抽取不愿献血的他人的血液?

社会存在的前提是对生命的尊重,而离开了对生命的尊重,社会也就不复存在。

------但是,人在危难的时候,往往没有那么理性。

你如何选择?

在电车难题的案例中,如果是你,你会选择把电车转向那条铁轨?

--------End--------