会议背景

近日,AAAI 2026公布了录用结果,该会议是是人工智能领域极具影响力的国际顶级学术会议之一。据悉本次会议共有23680篇投稿进入审稿阶段,最终4167篇论文被录用,录取率为17.6%。

火山引擎多媒体实验室和北京大学合作的论文VQ-Insight: Teaching VLMs for AI-Generated Video Quality Understanding via Progressive Visual Reinforcement Learning 被选为本次会议口头汇报文章。

VQ-Insight:AIGC视频画质理解大模型

论文背景

随着视频生成模型的涌现,仅凭一句提示词或一张图片生成逼真、生动的高质感视频正逐渐成为现实。随着 AIGC 视频技术加速演进,如何在后训练阶段进一步提升模型的生成质量变得尤为关键。可靠的质量评估与偏好选择不仅是评价工具,更是后训练的重要驱动力,它们能够精确引导视频生成模型向人眼感知对齐,从而显著提升画面质量与时序一致性。

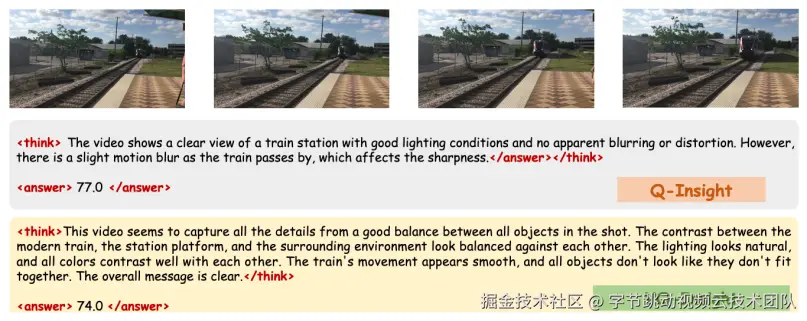

此前,北京大学与火山引擎多媒体实验室联合提出了首个基于强化学习训练的多模态大模型图像画质理解方案 Q-Insight 。该方法摆脱了对大规模文本标注的依赖,充分挖掘大模型的推理潜力,使其能够深入思考图像质量背后的本质因素。然而,将这一思路扩展到 AIGC 视频评估仍面临新的挑战,即:1) 如何更有效地激发大模型的时序感知能力与多维度画质理解能力;2) 如何建立评估模型与生成模型的反馈互动,使两者在优化过程中获得动态增强,相互促进。

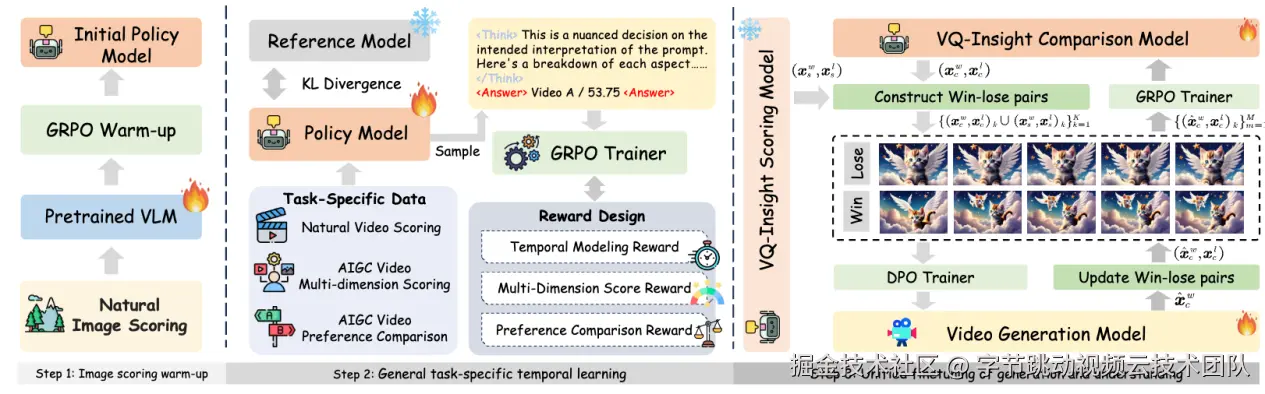

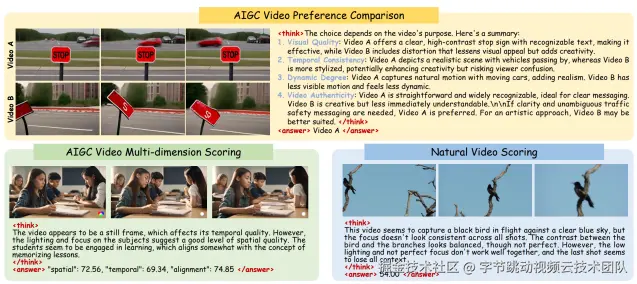

渐进式视觉质量强化学习框架

图像只捕捉视频的一个切片,用户真实的视频观看体验还取决于时间维度,例如运动是否自然?色彩是否在动态中稳定?因此,我们把Q-Insight的"推理式 + 强化学习"思路,拓展到自然视频和AIGC视频中,提出了推理式AIGC视频画质理解大模型VQ-Insight。该方法使用渐进式的视觉质量强化学习框架,包括图像打分预热阶段、任务驱动的通用时序学习阶段以及与视频生成模型的联合微调阶段。通过由易到难、由通用到具体的视频质量打分学习,仅使用少量数据就能教会AIGC视频偏好比较,AIGC视频多维度打分,自然视频打分等多项任务,并最终建立和下游生成模型的专项评估能力。同时,该方法引入时序建模奖励函数和长度控制奖励函数,鼓励大模型探索视频帧间的相关性和连贯性,并提供对于视频质量线索的丰富分析,增强偏好比较和分数回归的准确性。

进一步,该方法提出了一种生成模型与质量评估模型"共同进化"的联合训练方式:生成模型每一轮都会产生一批新视频,VQ-Insight自动从中挑选出更好的和更差的样本,构建高质量偏好数据;这些偏好数据既用于继续优化视频生成模型(如 DPO),也用于反向加强 VQ-Insight 的偏好理解能力,使其逐步适配并引导当前的生成模型。通过这种闭环式的协同优化,生成模型和评估模型会随着迭代不断变强,实现"越生成越懂、越懂越能生"的持续提升效果。

实验结果

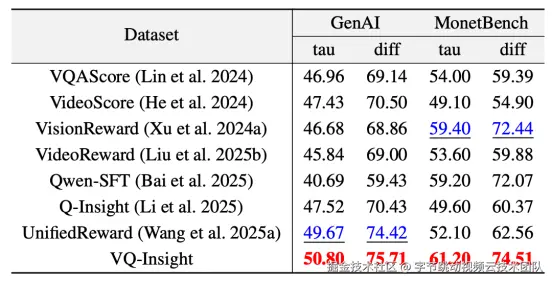

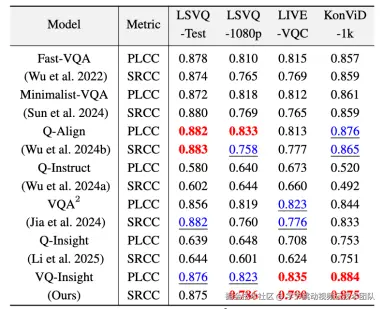

实验结果充分验证了VQ-Insight在AIGC视频偏好比较,多维度打分和自然视频打分任务中的卓越表现。

• 在AIGC偏好比较任务上,VQ-Insight在多个公开数据集上的表现均超过当前最先进的方法,并能够从视觉质量、时序一致性、动态程度和视频真实性方面提供完整详细的推理过程。

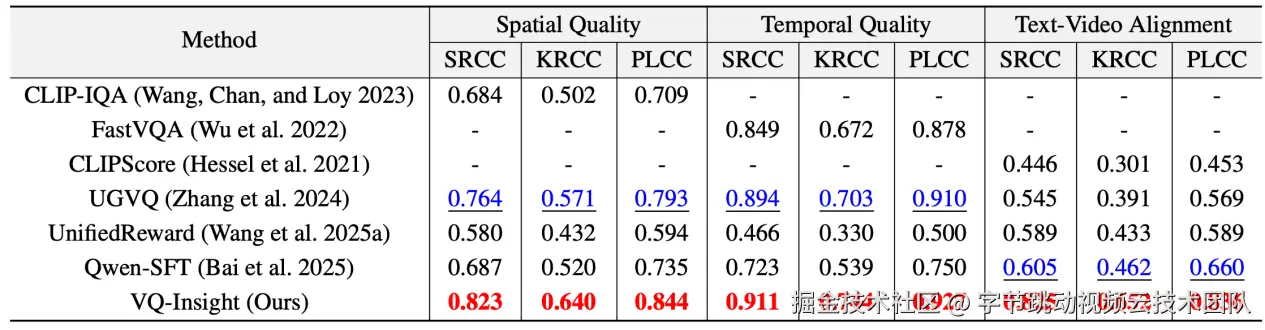

• 在AIGC多维度打分任务上,VQ-Insight能够在空间质量、时序质量和文本视频一致性打分上都取得最优性能。

• 在自然视频打分任务上,VQ-Insight同样表现出出色的分数拟合精确度,特别是在域外数据集上泛化能力突出。

• VQ-Insight强大的AIGC视频偏好比较能力,可直接应用于视频生成模型的直接偏好优化(DPO)。如图所示,基于VQ-Insight的方案相比于生成模型基线和对比方法,有效地缓解了错误生成的问题,并有着更鲜艳的色彩和动态。

总结

总结

VQ-Insight 将"推理式 + 强化学习"思路应用于AIGC视频画质理解任务中,在偏好比较、多维度画质打分与自然视频质量评估等任务上均取得了突破性表现。通过渐进式视觉质量强化学习框架与创新的时序奖励机制,VQ-Insight 能够以极少的数据实现强泛化和强解释性,精准捕捉视频的空间清晰度、动态一致性、内容真实性等多维度质量特征。更重要的是,VQ-Insight 已能直接用于生成模型的后训练,成为生成视频训练的可插拔奖励与偏好模块,把"看得准"转化为"生成得更好",为未来的视频生成模型带来更稳定、更符合人眼感知的画面质量,为下一代 AIGC 视频生成技术的发展奠定了关键基础。

相关链接

��VQ-Insight: arxiv.org/pdf/2506.18...

��Q-Insight: arxiv.org/pdf/2503.22...

⭐️训练与推理代码:github.com/bytedance/Q...

��开源模型:huggingface.co/ByteDance/Q...

团队介绍

多媒体实验室是字节跳动旗下的研究团队,致力于探索多媒体领域的前沿技术,参与国际标准化工作,其众多创新算法及软硬件解决方案已经广泛应用在抖音、西瓜视频等产品的多媒体业务,并向火山引擎的企业级客户提供技术服务。实验室成立以来,多篇论文入选国际顶会和旗舰期刊,并获得数项国际级技术赛事冠军、行业创新奖及最佳论文奖。