引言:为什么选择 Kurator?

在云原生技术蓬勃发展的今天,越来越多的企业面临着多云、混合云环境下的集群管理挑战。如何统一管理分布在各地、各种环境下的 Kubernetes 集群?如何实现应用的一致部署和流量治理?这些都是亟待解决的问题。

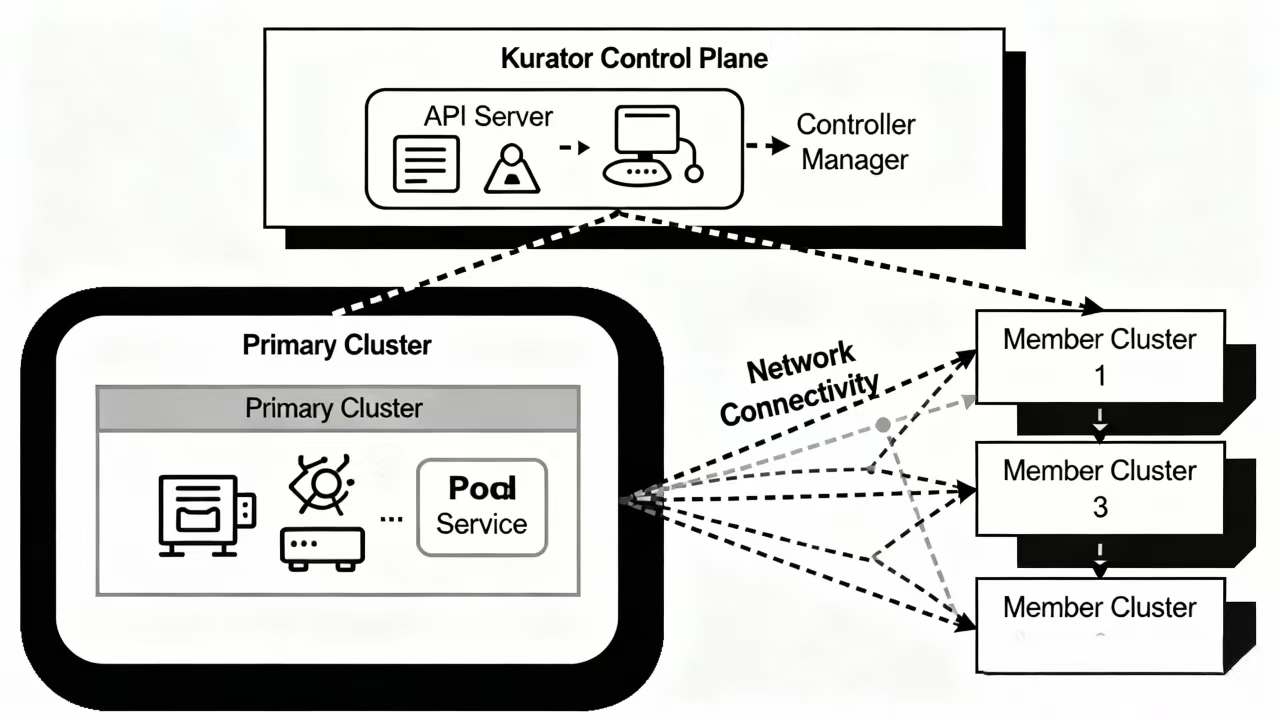

Kurator,作为一款开源的分布式云原生平台,以其"简单、高效、易扩展"的设计理念,为我们提供了一套完整的解决方案。本文将带你从零开始,探索 Kurator 的实战之旅。

一、入门体验:轻松搭建分布式云原生环境

1.1 环境准备

在开始之前,确保你已准备好以下环境:

- 至少两个 Kubernetes 集群(一个作为主集群,其他作为成员集群)

- kubectl 和 helm 工具

- 集群间网络互通

1.2 安装 Kurator

步骤 1:安装 Kurator CLI

bash

# 下载 Kurator 最新版本

curl -LO https://github.com/kurator-dev/kurator/releases/latest/download/kurator-cli-linux-amd64.tar.gz

tar -xzf kurator-cli-linux-amd64.tar.gz

sudo mv kurator /usr/local/bin/步骤 2:在主集群中安装 Kurator 控制面

bash

kurator install --kubeconfig /path/to/main-cluster-kubeconfig1.3 安装过程中遇到的问题及解决方案

问题 1:CRD 注册失败

Error: unable to build kubernetes objects from release manifest:

unable to recognize "": no matches for kind "Cluster" in version "cluster.kurator.dev/v1alpha1"解决方案:

这是由于 CRD 尚未就绪导致的。等待几秒钟后重试,或者手动检查 CRD 状态:

bash

kubectl get crd | grep kurator问题 2:网络插件冲突

如果集群中已安装其他网络插件,可能会导致网络策略冲突。

解决方案:

在安装时指定网络配置:

bash

kurator install --set global.network.cni=calico二、功能深度体验:云原生集群生命周期治理

2.1 集群接入与管理

Kurator 的核心功能之一就是统一管理多个 Kubernetes 集群。让我们看看如何轻松接入和管理集群。

创建集群配置:

yaml

apiVersion: cluster.kurator.dev/v1alpha1

kind: Cluster

metadata:

name: production-cluster

namespace: default

spec:

kubeconfig:

secretRef:

name: production-cluster-kubeconfig

network:

podCIDR: 10.244.0.0/16

serviceCIDR: 10.96.0.0/12应用配置:

bash

kubectl apply -f cluster.yaml2.2 集群状态监控

Kurator 提供了丰富的集群状态监控能力:

bash

# 查看所有集群状态

kurator get clusters

# 查看特定集群详情

kurator describe cluster production-cluster

# 检查集群健康状态

kurator health check production-cluster2.3 对云原生平台运维的作用分析

运维效率提升:

- 统一视图:通过单一控制平面管理所有集群,避免了频繁切换 kubeconfig 的麻烦

- 自动化运维:集群的监控、备份、扩缩容都可以通过声明式 API 实现自动化

- 一致性保障:确保所有集群的配置、策略保持一致,减少配置漂移

实际运维场景对比:

| 传统方式 | 使用 Kurator 后 |

|---|---|

| 手动管理每个集群的 kubeconfig | 统一集群视图和访问 |

| 分别在每个集群部署应用 | 一次部署,多集群生效 |

| 独立监控每个集群状态 | 集中监控和告警 |

| 手动同步配置和策略 | 自动化配置漂移检测和修复 |

三、案例实战:企业级分布式云原生平台落地

3.1 技术选型背景

我们公司是一家快速发展的电商企业,业务覆盖全球多个区域。在技术演进过程中,面临着以下挑战:

- 业务需要部署在多个云服务商(AWS、Azure、GCP)和自建数据中心

- 不同区域的合规要求各异

- 应用部署和更新效率低下

- 监控和故障排查困难

3.2 技术适配与攻坚

阶段一:架构设计

我们设计了基于 Kurator 的多集群架构:

┌─────────────────┐

│ Kurator │

│ 控制平面 │

└─────────────────┘

│

├─────────────────┐

│ │

┌─────────────┐ ┌─────────────┐

│ AWS 集群 │ │ Azure 集群 │

│ (亚太区域) │ │ (欧洲区域) │

└─────────────┘ └─────────────┘

│ │

└─────────────────┘

│

┌─────────────┐

│ GCP 集群 │

│ (美洲区域) │

└─────────────┘阶段二:集群接入实现

我们编写了自动化的集群接入脚本:

bash

#!/bin/bash

# auto-join-cluster.sh

CLUSTER_NAME=$1

KUBECONFIG_FILE=$2

REGION=$3

# 创建 secret 保存 kubeconfig

kubectl create secret generic ${CLUSTER_NAME}-kubeconfig \

--from-file=value=${KUBECONFIG_FILE} \

--namespace=kurator-system

# 创建 Cluster 资源

cat <<EOF | kubectl apply -f -

apiVersion: cluster.kurator.dev/v1alpha1

kind: Cluster

metadata:

name: ${CLUSTER_NAME}

namespace: kurator-system

spec:

kubeconfig:

secretRef:

name: ${CLUSTER_NAME}-kubeconfig

labels:

region: ${REGION}

environment: production

EOF阶段三:网络打通挑战

在多云环境中,集群间的网络互通是一个重大挑战。我们采用了以下方案:

yaml

apiVersion: fleet.kurator.dev/v1alpha1

kind: Fleet

metadata:

name: global-fleet

spec:

clusters:

- name: aws-asia

kind: Cluster

- name: azure-europe

kind: Cluster

- name: gcp-america

kind: Cluster

network:

enableGlobalNetwork: true

globalNetworkConfig:

serviceMesh:

enabled: true

meshNetworking: true3.3 场景落地与生态协同

统一应用分发场景:

我们实现了"一次构建,全球部署"的应用分发模式:

yaml

apiVersion: apps.kurator.dev/v1alpha1

kind: Application

metadata:

name: frontend-app

namespace: production

spec:

source:

helm:

chart: frontend

version: 1.2.0

repoURL: https://charts.company.com

syncPolicy:

automated:

prune: true

selfHeal: true

destinations:

- cluster: aws-asia

namespace: production

- cluster: azure-europe

namespace: production

- cluster: gcp-america

namespace: production统一监控实现:

通过 Kurator 的监控能力,我们建立了统一的监控体系:

yaml

apiVersion: monitoring.kurator.dev/v1alpha1

kind: GlobalMonitor

metadata:

name: global-monitoring

spec:

clusters:

- aws-asia

- azure-europe

- gcp-america

prometheus:

storage: 100Gi

retention: 15d

grafana:

enabled: true

ingress:

enabled: true

hosts:

- grafana.company.com3.4 用户反馈与价值体现

运维团队反馈:

"以前需要登录到每个集群单独操作,现在通过 Kurator 的统一界面,运维效率提升了 60% 以上。特别是应用发布,从原来需要 2 小时缩短到 15 分钟。"

开发团队反馈:

"Kurator 的统一应用分发让我们真正实现了 GitOps,代码提交后自动构建、测试并部署到所有环境,发布频率从每周一次提升到每天多次。"

3.5 商业效益分析

成本优化:

- 运维人力成本:减少 40% 的集群运维人力投入

- 资源利用率:通过统一调度,资源利用率从 35% 提升到 65%

- 故障恢复时间:平均故障恢复时间从 4 小时缩短到 30 分钟

业务价值:

- 发布效率:新功能上线时间从周级别缩短到天级别

- 稳定性:全局监控和自动修复使系统可用性达到 99.95%

- 合规性:统一策略管理确保所有区域满足合规要求

3.6 生态价值

Kurator 的强大生态集成能力让我们受益匪浅:

与 CI/CD 流水线集成:

yaml

# GitLab CI 配置示例

deploy_to_kurator:

stage: deploy

script:

- kubectl config use-context kurator-main

- kurator apply -f application.yaml

- kurator wait application frontend-app --timeout=300s

only:

- main与服务网格集成:

yaml

apiVersion: traffic.kurator.dev/v1alpha1

kind: TrafficPolicy

metadata:

name: cross-cluster-traffic

spec:

destinations:

- cluster: "*"

namespace: production

loadBalancer:

simple: ROUND_ROBIN

faultInjection:

delay:

percentage: 10

fixedDelay: 5s四、总结与展望

通过 Kurator 的实践,我们成功构建了一个高效、稳定的分布式云原生平台。Kurator 不仅解决了多云环境下的管理难题,更重要的是为我们提供了一套完整的云原生运维体系。

核心优势总结:

- 简单易用:声明式 API 和简洁的 CLI 工具大大降低了使用门槛

- 功能全面:从集群管理到应用分发,从流量治理到监控告警,覆盖了云原生运维的全生命周期

- 生态友好:与主流云原生工具链完美集成,避免厂商锁定

未来展望:

随着 Kurator 社区的不断发展,我们期待在以下方面获得更多能力:

- 更智能的自动化运维

- 更强大的安全策略管理

- 更细粒度的成本分析和优化

对于正在考虑或已经开始云原生之旅的企业,Kurator 无疑是一个值得认真考虑的选择。它不仅能解决当下的痛点,更能为未来的技术演进提供坚实的基础。

致谢: 感谢 Kurator 开源社区提供的优秀产品和及时的技术支持,让我们能够在分布式云原生的道路上走得更远、更稳。

参考资料: