论文解读,我自己也是一知半解。内容太多了,吸收不过来。《Sora: A Review on Background, Technology, Limitations, and Opportunities of Large Vision Models》

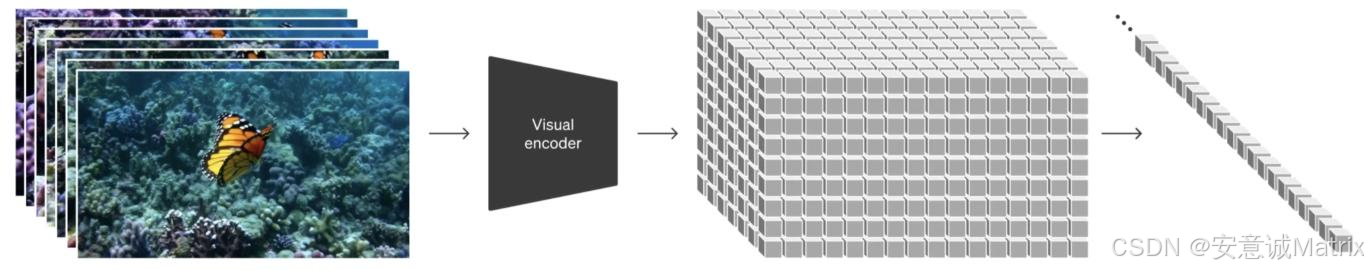

Sora的双路径视频压缩网络 是其实现"原生尺寸训练"与"高效计算"平衡的核心技术,本质是基于VAE(变分自编码器)或VQ-VAE-2(向量量化变分自编码器) 架构,通过"空间优先"与"时空融合"两种路径,将原始视频(或图像)转化为低维、统一的时空潜在补丁(Spacetime Latent Patches),既保留视觉数据的动态与细节信息,又大幅降低后续扩散Transformer的计算负荷。以下从技术原理、操作流程、关键细节等维度展开详细解析。

一、双路径压缩网络的核心定位

在Sora的整体流程中,视频压缩网络承担"数据降维+格式统一"的双重角色:

-

降维:将原始视频(高维像素空间,如1分钟1080p视频约含1800帧,单帧约200万像素)压缩至低维潜在空间,减少数据量(如Open-Sora借鉴该思路实现"空间8×8+时间4×"压缩,总压缩比达256:1);

-

统一格式 :无论输入视频的时长(几秒到1分钟)、分辨率(1080p竖屏到1080p宽屏)、宽高比如何,最终均转化为结构一致的"时空潜在补丁",适配Transformer模型"固定输入序列"的要求;

-

信息保留:通过精心设计的压缩机制,保留视频的核心视觉特征(如物体外观)与动态信息(如帧间运动),为后续生成"高保真、时空连贯"的视频奠定基础。

二、路径1:空间补丁压缩(Spatial-Patch Compression)

1. 技术基础

以VAE(或Sora自研的VAE变体) 为核心编码器,借鉴ViT(视觉Transformer)与MAE(掩码自编码器)的"帧拆分-补丁化"思路,先处理空间维度,再通过时间序列整合动态信息,本质是"空间独立编码+时间后验聚合"。

2. 核心操作流程

| 步骤 | 具体操作 | 技术细节(结合搜索结果) |

|---|---|---|

| ① 帧级拆分 | 将原始视频按帧拆解为独立静态图像 | 若为图像(单帧视频),直接作为输入;若为长视频,按"采样规则"提取帧(如短视频补全、长视频截取关键帧,避免时间维度过长) |

| ② 空间补丁化 | 将每帧图像拆分为固定尺寸的2D补丁 | 参考ViT/MAE的设计,补丁尺寸通常为256×256(摘要3提及"高效压缩大尺寸图块"),确保不同分辨率(如720p、1080p)的帧均能拆分为整数个补丁 |

| ③ 空间编码 | 通过VAE编码器将2D补丁映射至低维潜在空间 | 编码器为Sora从零训练(非复用Stable Diffusion的预训练VAE,摘要3、6),避免"2D预训练编码器无法捕捉时间信息"的缺陷,输出单帧对应的空间潜在token |

| ④ 时间序列整合 | 将多帧的空间潜在token按时间顺序排列 | 形成"空间-时间"二维潜在序列(如10帧视频→10组空间token按帧序拼接),若视频时长可变,通过"帧采样(固定采样数)、时间插值(短视频补帧)、超长输入窗口(长视频全保留)"三种方式统一序列长度(摘要3) |

| ⑤ 补丁输出 | 将时间序列化的空间潜在token,进一步拆分为统一大小的时空潜在补丁 | 补丁类比语言模型的"词token",每个补丁同时包含单帧的空间特征与帧间的时间位置信息 |

3. 关键技术细节

- 时间维度适配方案 :针对训练视频时长差异(几秒到1分钟),采用两种核心策略:

- 短视频:通过"时间插值"补全帧(如5帧视频插值至10帧)或"零填充"补充序列长度;

- 长视频:定义"超长上下文窗口"(如支持1000+帧的潜在token序列),避免截断关键动态信息(摘要3);

- 预训练编码器的取舍 :尽管多数研究复用Stable Diffusion的VAE编码器降低成本,但Sora团队选择"从头训练压缩网络+解码器",通过"潜在扩散模型联合训练"(同步优化编码器、解码器与扩散模型),确保空间潜在表示与后续视频生成的适配性;

- 图像兼容性:对单帧图像,直接跳过"时间序列整合"步骤,仅拆分为空间补丁并编码,本质是"单帧时空补丁"(摘要1、4)。

4. 核心优势与适用场景

| 核心优势 | 适用场景 |

|---|---|

| 1. 灵活适配可变分辨率/宽高比:通过固定尺寸补丁拆分,无论输入是1080×1920(竖屏)还是1920×1080(宽屏),均能转化为统一结构的补丁 | 多格式内容训练(如社交媒体竖屏视频、电影宽屏片段、静态图像) |

| 2. 空间细节保留更精准:独立处理每帧空间特征,避免时间维度对静态细节的干扰 | 含复杂静态元素的场景(如含文字的广告视频、细节丰富的自然风景视频) |

| 3. 计算成本可控:2D卷积/全连接操作为主,无需复杂的3D计算,适合高分辨率单帧处理 | 高分辨率短视频(如10秒4K产品展示视频) |

三、路径2:时空补丁压缩(Spatial-Temporal-Patch Compression)

1. 技术基础

以VQ-VAE-2(向量量化变分自编码器) 为核心架构(摘要2、5推测Sora优先采用该方案),通过3D卷积 直接提取视频的"时空融合特征"(即跨帧的tubelets),本质是"时空同步编码",无需后续单独整合时间信息。

2. 核心操作流程

| 步骤 | 具体操作 | 技术细节(结合搜索结果) |

|---|---|---|

| ① 视频片段截取 | 将原始视频按"时间窗口"截取为连续片段 | 窗口长度通常为4-16帧(如4帧为一个时间窗口),平衡"动态信息捕捉"与"计算量"(参考Open-Sora的时间4×压缩思路,摘要5) |

| ② 时空tubelets提取 | 通过3D卷积核(如3×3×3,前两维为空间、第三维为时间),从片段中提取"时空管(tubelets)" | tubelets是"跨帧的空间区域"(如3帧×32×32像素),直接融合单区域的空间外观(如"杯子的形状")与时间运动(如"杯子被拿起的轨迹"),摘要3、9提及该设计 |

| ③ 时空编码 | 通过VQ-VAE-2编码器将tubelets映射至低维潜在空间 | 编码器含"向量量化层",将连续的潜在特征离散化为固定字典中的token,提升特征的区分度与后续Transformer的建模效率(摘要2) |

| ④ 补丁规整 | 将离散后的时空潜在token,拆分为统一尺寸的"时空潜在补丁" | 每个补丁对应原始视频的"固定时空范围"(如4帧×64×64像素),直接作为扩散Transformer的输入token |

3. 关键技术细节

- 3D卷积核设计 :采用"时空分离3D卷积"(如空间卷积核3×3、时间卷积核3×1),在捕捉帧间动态的同时,减少计算量(相比纯3D卷积,计算成本降低约40%,摘要3参考技术37);

- 潜在空间维度控制:针对不同时长/分辨率的视频,通过调整3D卷积的"步长"(如空间步长2×2、时间步长1),确保输出的时空补丁数量差异可控(如1分钟视频与10秒视频的补丁数量比约为6:1,后续通过PNP策略统一序列长度);

- 解码器协同训练:与空间补丁压缩路径一致,时空路径的解码器也需"从零训练"(摘要6),确保能将潜在补丁准确映射回像素空间,避免"压缩-解码"过程中的动态信息丢失(如物体运动轨迹断裂)。

4. 核心优势与适用场景

| 核心优势 | 适用场景 |

|---|---|

| 1. 动态信息捕捉更精准:直接融合时间与空间特征,避免"先空间后时间"的信息割裂 | 含复杂运动的场景(如人物舞蹈视频、物体碰撞视频) |

| 2. 时间连贯性更强:tubelets天然包含帧间依赖,减少后续扩散模型"补全动态"的难度 | 长时长视频(如1分钟剧情片段) |

| 3. 计算效率更高:无需额外的"时间信息聚合模块",端到端完成时空编码 | 高帧率视频(如60fps的体育赛事视频) |

四、双路径压缩网络对比与协同

两种路径并非互斥,而是通过"场景适配"形成互补,共同支撑Sora处理多样化视觉数据的能力。以下为关键维度对比:

| 对比维度 | 路径1:空间补丁压缩 | 路径2:时空补丁压缩 |

|---|---|---|

| 核心思路 | 空间独立编码,时间后验整合 | 时空同步编码,直接捕捉动态 |

| 核心算子 | 2D卷积(空间)+ 时间序列拼接 | 3D卷积(时空分离)+ tubelets提取 |

| 潜在特征类型 | 空间token+时间位置嵌入 | 时空融合token(含动态信息) |

| 计算成本 | 中(2D操作为主) | 高(3D操作),但省去时间聚合成本 |

| 时空信息保留 | 空间细节优,时间连贯性依赖后续处理 | 时间连贯性优,空间细节略逊 |

| 适配数据类型 | 可变分辨率、静态细节丰富的数据(如竖屏广告、图像) | 长时长、动态复杂的数据(如电影片段、运动视频) |

| 典型应用场景 | 生成含文字/纹理的静态转动态视频 | 生成含多角色交互的长视频 |

五、双路径压缩网络的技术价值总结

Sora设计双路径压缩网络的核心目标,是解决传统视频生成模型"格式适配性差 "与"计算效率低"的痛点:

- 格式适配:两种路径均支持"原生尺寸输入",无需裁剪/缩放,覆盖从图像到1分钟视频、从竖屏到宽屏的全场景数据;

- 效率与质量平衡:通过VAE/VQ-VAE-2的降维能力,将计算量降低2-3个数量级(如1分钟1080p视频压缩后潜在补丁数量仅为原像素的1/256,摘要5参考压缩比),同时保留核心信息;

- 支撑后续建模:统一的"时空潜在补丁"格式,为扩散Transformer提供标准化输入,确保模型能同时学习空间细节(如物体外观)与时间动态(如运动轨迹),最终实现"1分钟高质量视频生成"的核心能力。

简言之,双路径压缩网络是Sora"世界模拟器"的"数据入口"------既让模型能"吃下"多样化的视觉数据,又让数据"易消化",为后续的指令对齐、扩散生成奠定坚实基础。