当你观察同一物体的两张图片时,比如一幅画和一张汽车照片,很容易注意到它们的共同之处。然而,对于机器来说,这并不那么直接。

要进行此类比较,机器依赖于计算机视觉------人工智能的一个分支,帮助机器解读和理解视觉信息。计算机视觉使系统能够检测物体、理解场景,并从图像或视频中提取模式。

特别是,有些视觉任务超出了分析单张图像的范畴。它们涉及比较图像以发现相似之处、找出差异或追踪随时间发生的变化。

视觉人工智能涵盖一系列广泛的技术,其中一项核心能力被称为图像匹配,其重点在于识别图像之间的相似性,即使光照、角度或背景发生变化。这项技术可用于机器人技术、增强现实和地理测绘等多种应用。

在本文中,我们将探讨什么是图像匹配、其核心技术以及一些实际应用。

什么是图像匹配?

图像匹配使计算机系统能够理解两张图像是否包含相似内容。人类可以凭直觉通过观察形状、颜色和模式来完成这项任务。

另一方面,计算机则依赖于数值数据。它们通过分析每个像素来解读图像,像素是数字图像的最小单位。

每张图像都存储为一个像素网格,每个像素通常包含红、绿、蓝(RGB)的值。当图像被旋转、调整大小、从不同角度观看或在不同光照条件下拍摄时,这些值可能会发生变化。由于这些变化,逐像素比较图像通常并不可靠。

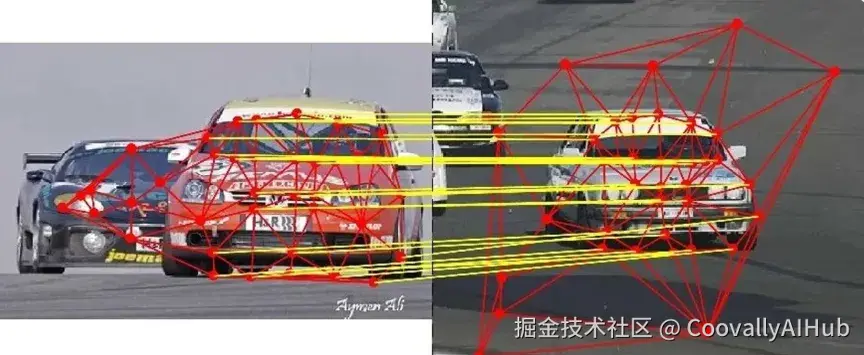

为了使比较更加一致,图像匹配聚焦于局部特征或角点、边缘和纹理区域,这些特征在图像发生轻微变化时往往能保持稳定。通过在多张图像中检测这些特征(或称关键点),系统可以更准确地进行比较。

这个过程被广泛用于导航、定位、增强现实、测绘、三维重建和视觉搜索等用例。当系统在不同图像或多帧画面中识别出相同的点时,它们就可以跟踪运动、理解场景结构,并在动态环境中做出可靠的决策。

理解图像匹配的工作原理

图像匹配涉及几个关键步骤,帮助系统识别和比较图像中的相似区域。每个步骤都在不同条件下提高了准确性、一致性和鲁棒性。

以下是图像匹配工作的逐步解析:

- 特征检测: 系统首先识别图像中独特的关键点,这些关键点在光照、尺度或视角变化时仍能保持稳定。它们突出显示诸如角点、边缘或纹理区域等在视觉上突出的区域。

- 特征描述: 然后将每个关键点转换为一个描述符,这是一个紧凑的数值向量,捕获了该点周围的视觉模式。这些描述符提供了一种可靠的方式来比较不同图像之间的特征。

- 特征匹配: 使用匹配算法比较来自两张图像的描述符,计算它们的相似度。此步骤将看似对应的关键点配对,并过滤掉较弱或不可靠的匹配。

- 几何验证: 最后,系统检查匹配的关键点是否构成合理的几何关系。它使用一种称为RANSAC(随机抽样一致) 的方法来移除不正确的匹配(称为离群值),确保只保留可靠的点对。一旦识别出良好的匹配,系统会估计最能关联两张图像的变换。这通常是一种仿射变换,用于调整缩放、旋转和平移等变化,或者是一种单应性变换,它还可以处理透视变化。使用这些变换,系统可以精确地对齐图像,即使它们是从略微不同的视角拍摄的。

图像匹配涉及的核心技术

在我们深入探讨图像匹配的实际应用之前,让我们先仔细看看计算机视觉系统中使用的图像匹配技术。

- 基于模板匹配的图像匹配

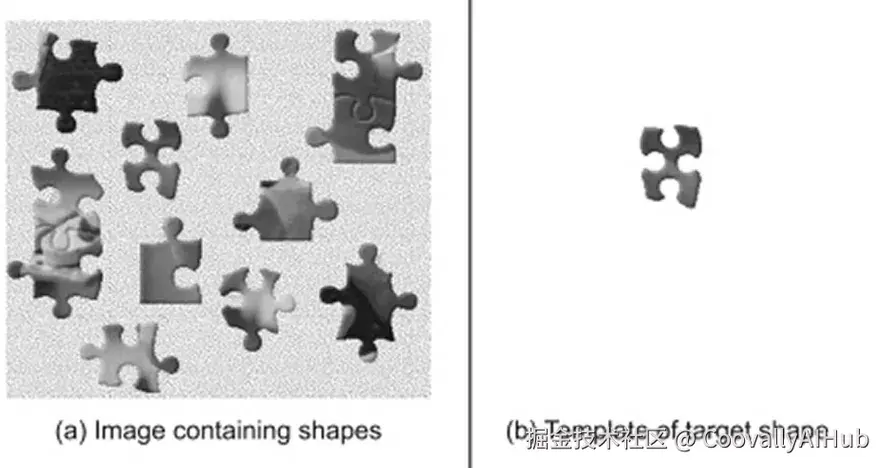

模板匹配是最直接的图像匹配方法之一。它通常被视为一种图像处理技术,而非现代计算机视觉方法,因为它依赖于直接的像素比较,并且不提取更深层的视觉特征。

它用于在较大的场景中定位一个较小的参考图像(即模板)。它通过算法实现:将模板在主图像上滑动,并在每个位置计算一个相似度得分,以衡量两个区域的匹配程度。得分最高的区域被视为最佳匹配,指示物体在场景中最可能出现的位置。

当物体的尺度、旋转和光照保持一致时,这种技术效果很好,使其成为受控环境或基线比较的良好选择。然而,当物体看起来与模板不同时,例如大小改变、旋转、部分遮挡或出现在嘈杂或复杂背景前时,其性能会下降。

- 用于图像匹配的经典特征技术

在深度学习被广泛采用之前,图像匹配主要依赖于在图像中检测独特关键点的经典计算机视觉算法。这些方法不比较每个像素,而是分析图像梯度(即强度的变化)来突出显示角点、边缘和纹理区域等视觉上突出的部分。

然后,每个检测到的关键点都使用一种称为描述符的紧凑数值摘要来表示。在比较两张图像时,匹配器会评估这些描述符以找到最相似的配对。

强相似性得分通常表明同一个物理点出现在两张图像中。匹配器还使用特定的距离度量或评分规则来判断特征的对齐程度,从而提高整体可靠性。

以下是一些用于图像匹配的关键经典计算机视觉算法:

- SIFT(尺度不变特征变换): 它通过分析图像强度梯度来识别关键点,使这些点在图像缩放或旋转时仍能被识别。

- SURF(加速鲁棒特征): 该算法类似于SIFT,但针对速度进行了优化。它使用梯度运算的快速近似,适用于需要快速响应的应用。

- ORB(定向FAST和旋转BRIEF): 它结合了FAST和BRIEF两种算法。FAST能快速在图像中找到类似角点的点,而BRIEF则为每个点创建一个紧凑的描述,以便跨图像匹配。ORB还通过增加旋转处理来增强这两个步骤,使其快速且可靠。

- 基于深度学习的图像匹配技术

与依赖特定规则的经典方法不同,深度学习可以自动从大型数据集(人工智能模型从中学习模式的大量视觉数据集合)中学习特征。这些模型通常在GPU(图形处理器)上运行,GPU提供了处理大批量图像和高效训练复杂神经网络所需的高计算能力。

这使得人工智能模型能够处理现实世界中的变化,例如光照、相机角度和遮挡。一些模型还将所有步骤整合到一个单一工作流程中,支持在具有挑战性的条件下实现鲁棒性能。

以下是一些基于深度学习的图像特征提取和匹配方法:

- 基于CNN的特征提取: 这些模型自动从大型数据集中学习关键的视觉模式。它们识别那些不太可能改变的特征,使其在跨不同场景匹配物体时更加可靠。

- 基于嵌入的匹配: 这种方法不是直接比较像素,而是将图像转换为紧凑的数值表示,称为嵌入。然后,匹配器比较这些嵌入以找到相似的视觉内容。遵循这种方法的模型包括:生成嵌入以识别和比较人脸的FaceNet;以及将图像和文本映射到共享空间中,用于图像搜索和语义匹配等任务的CLIP。

- 端到端匹配流程: 尖端的深度学习系统通常将关键点检测、描述和匹配整合到一个统一的工作流程中。像SuperPoint和D2-Net这样的模型直接从CNN特征图中学习关键点和描述符,而SuperGlue则充当一个学习型匹配器,能够比传统方法更可靠地配对这些描述符。这些组件共同创建了一个端到端的流程,在具有挑战性的条件下提供了比经典特征方法更高的准确性和更强的鲁棒性。

- 基于Transformer的匹配: 这种方法使用注意力机制来连接两张图像中对应的区域,使其即使在强烈的视角、光照或纹理变化下也能对齐图像块。像LoFTR(局部特征变换器) 这样的模型实现了更高的准确性,因为Transformer的全局感受野能够在传统检测器失效的低纹理、模糊或重复区域实现可靠的匹配。LoFTR产生半稠密、高置信度的匹配,并且在室内和室外基准测试上,其性能大幅优于先前的最先进方法。

- 注重效率的模型: 更新的图像匹配模型旨在提供高准确性的同时运行更快。像LightGlue这样的模型设计用于在计算能力有限的设备上高效运行,同时保持良好的匹配质量。

然而,对于开发者和研究者而言,获取、复现和比较这些先进的深度学习模型仍存在较高门槛,需要处理复杂的代码环境、准备庞大的数据集并配置昂贵的计算资源。这正是 Coovally 致力于解决的问题。Coovally 提供了开箱即用的模型仓库、统一的评估基准以及云端算力支持,让开发者能快速实验并找到最适合其应用场景的图像匹配解决方案,极大降低了先进计算机视觉技术的应用门槛。

当让如果你是技术小白,需要AI算法 ,或是需要AI解决方案的朋友,可以扫描二维码,我们来给你提供解决方案!!

点击阅读原文,即可体验Coovally平台!

图像匹配的实际应用

现在我们对图像匹配的工作原理有了更好的理解,让我们来看看它在其中扮演重要角色的一些实际应用。

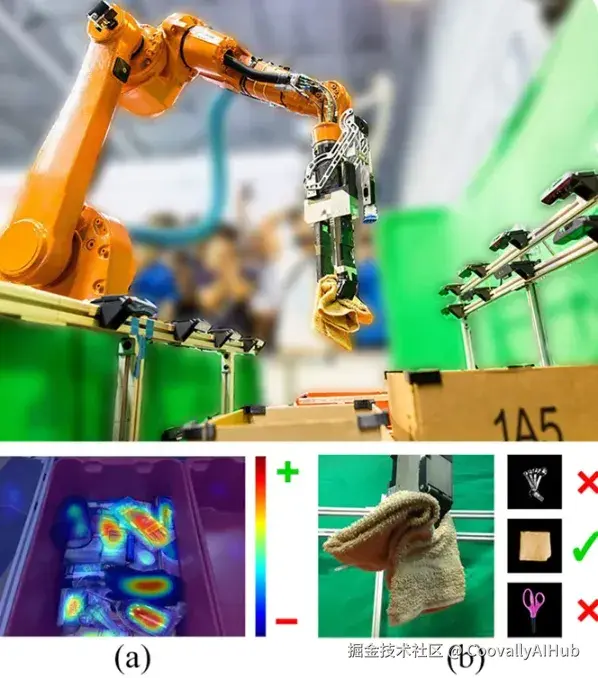

- 由图像匹配驱动的更智能机器人技术

机器人通常在繁忙且不断变化的环境中操作,需要了解环境中存在哪些物体以及它们的位置。图像匹配可以帮助机器人理解它们所看到的物体,方法是与存储的或参考图像进行比较。这使得机器人更容易识别物体、跟踪其运动,并在光照或相机角度变化时进行调整。

例如,在仓库中,机器人拣选系统可以使用图像匹配来识别和处理不同的物品。机器人首先抓取一个物体,然后将其图像与参考样本进行比较以进行识别。

一旦找到匹配项,机器人就知道如何正确地分类或放置它。这种方法使机器人能够识别熟悉的和新的物体,而无需重新训练整个系统。它还有助于它们做出更好的实时决策,例如整理货架、组装零件或重新排列物品。

- 通过改进图像匹配提升三维重建

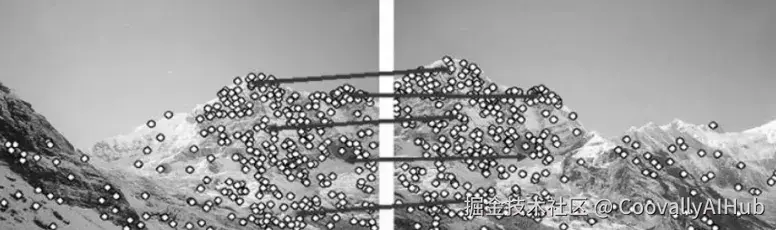

在无人机测绘、虚拟现实和建筑检测等领域,系统通常需要从多张二维图像重建三维模型。为此,它们依赖图像匹配来识别出现在多张图像中的共同关键点,例如角点或纹理区域。

这些共享点帮助系统理解这些图像在三维空间中是如何相互关联的。这个想法与运动恢复结构(SfM) 密切相关,SfM是一种通过从不同视角捕获的图像中识别和匹配关键点来构建三维结构的技术。

如果匹配不准确,生成的三维模型可能会出现扭曲或不完整。因此,研究人员一直在努力提高三维重建中图像匹配的可靠性,并且最近的进展已显示出有希望的结果。

一个有趣的例子是HashMatch,一种更快、更鲁棒的图像匹配算法。HashMatch将图像细节转换为称为哈希码的紧凑模式,这使得即使光照或视角发生变化,也能更容易地识别正确匹配并移除离群值。

在大型数据集上进行测试时,HashMatch生成了更干净、更逼真的三维重建模型,且对齐误差更少。这使其特别适用于无人机测绘、增强现实系统和文化遗产保护等对精度要求极高的应用。

- 图像匹配在增强现实中的作用

在增强现实领域,保持虚拟物体与现实世界对齐常常是一个挑战。室外环境会随着光照和天气等环境条件的变化而不断变化。现实世界中的细微差异可能导致虚拟元素看起来不稳定或略有偏差。

为了解决这个问题,增强现实系统使用图像匹配来解读周围环境。通过将实时摄像机画面与存储的参考图像进行比较,它们可以理解用户的位置以及场景发生了哪些变化。

例如,在一项涉及使用XR(扩展现实)眼镜进行军事风格室外增强现实训练的研究中,研究人员使用了SIFT和其他基于特征的方法来匹配真实图像和参考图像之间的视觉细节。精确的匹配确保了虚拟元素即使在使用者快速移动或光照变化时,也能与现实世界正确对齐。

总结

图像匹配是计算机视觉的核心组成部分,使系统能够理解不同图像之间的关系,或场景随时间如何变化。它在机器人技术、增强现实、三维重建、自主导航以及许多其他对精度和稳定性至关重要的实际应用中扮演着关键角色。

借助像SuperPoint和LoFTR这样的先进人工智能模型,今天的系统比早期方法要稳健得多。随着机器学习技术、专门的视觉模块、神经网络和数据集的不断进步,图像匹配很可能会变得更快、更准确、适应性更强。