什么是模型上下文协议(MCP)?

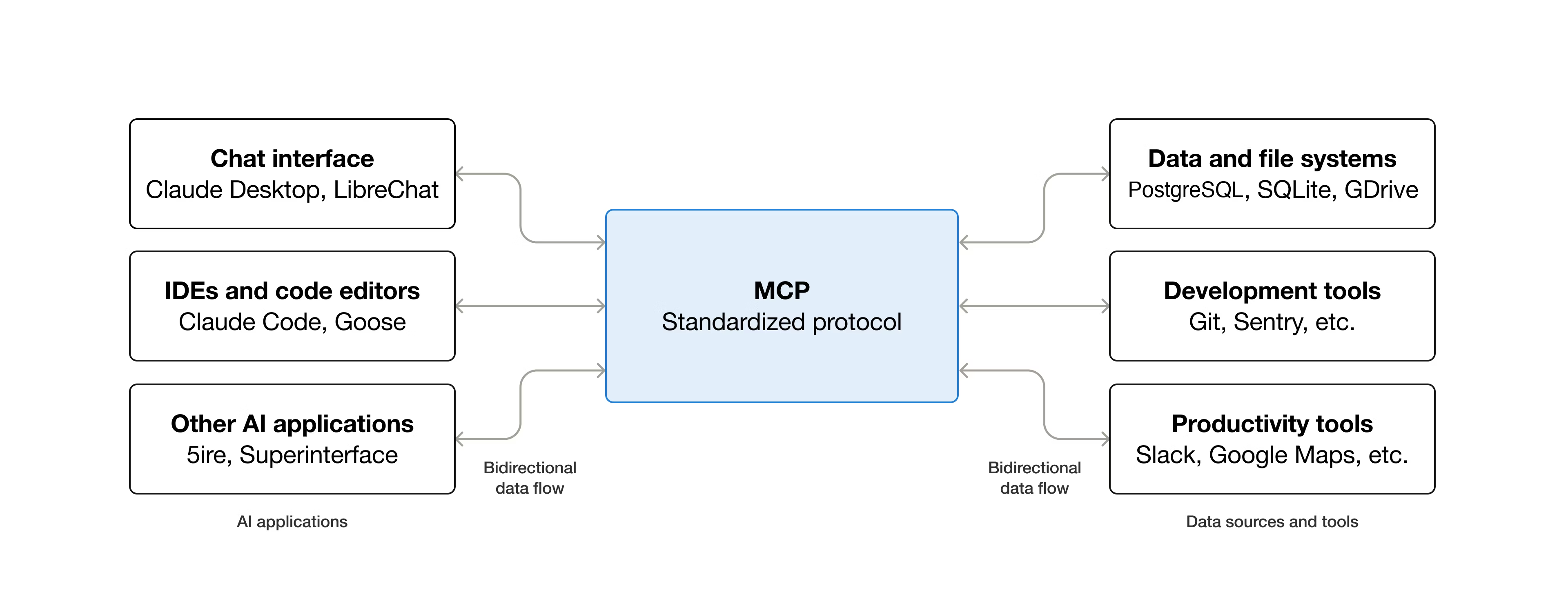

MCP(模型上下文协议)是一个开源标准,用来把AI应用连接到外部系统。

通过MCP,像Claude或ChatGPT这样的AI应用就能连上各种数据源(比如本地文件、数据库)、工具(比如搜索引擎、计算器)和工作流(比如专门的提示词)------让它们能获取关键信息、完成各种任务。

你可以把MCP想象成AI应用的USB-C接口。就像USB-C给电子设备提供了一个统一的连接方式,MCP也给AI应用提供了一个统一的方式来连接外部系统。

简单说就是:MCP让AI能方便地"插上"各种外部工具和数据,就像手机插USB-C线一样简单标准。

MCP能做什么?

- AI助手可以访问你的Google日历和Notion,变成更懂你的个人助理

- Claude Code能根据Figma设计稿直接生成一个完整的网页应用

- 企业聊天机器人可以连接公司里的多个数据库,让员工用聊天的方式就能分析数据

- AI模型可以在Blender上创建3D设计,然后直接用3D打印机打印出来

MCP为什么重要?

对生态系统里的不同角色来说,MCP都有好处:

开发者: MCP能大大减少开发时间和复杂度,不管是开发AI应用还是跟AI应用做集成都更简单了

AI应用或智能体: MCP让它们能接入一整个生态系统的数据源、工具和应用,功能更强大,用户体验也更好

普通用户: MCP让AI应用和智能体变得更能干------它们能访问你的数据,必要时还能帮你做事情

说白了就是:MCP让AI从"只会聊天"变成"真能帮你干活"的得力助手。

开始动手:用Python开发你的第一个MCP服务器

下面我们就来实战,用Python快速搭建一个MCP服务器。整个过程非常简单,跟着步骤走就行!

第一步:安装uv包管理器

uv是一个超快的Python包管理器,我们用它来管理项目依赖。

macOS和Linux系统:

bash

curl -LsSf https://astral.sh/uv/install.sh | shWindows系统:

打开PowerShell,执行:

powershell

powershell -ExecutionPolicy ByPass -c "irm https://astral.sh/uv/install.ps1 | iex"安装完成后,重启终端让环境变量生效。

第二步:安装Python 3.13

使用uv安装最新的Python 3.13版本:

bash

uv python install 3.13uv会自动下载并配置好Python环境,省去了很多麻烦。

第三步:创建MCP项目

创建一个新的项目目录并初始化:

bash

uv init mcp-server-demo

cd mcp-server-demo这会生成一个基础的Python项目结构。

第四步:添加MCP依赖

将MCP库添加到项目中:

bash

uv add "mcp[cli]"这条命令会安装MCP核心库以及命令行工具。

第五步:运行MCP

执行以下命令验证安装:

bash

uv run mcp如果看到MCP的帮助信息,说明安装成功了!

了解MCP的三种通信方式

MCP支持三种不同的通信协议,你可以根据实际场景选择:

1. 标准输入输出(stdio)

- 适用场景: 本地应用、命令行工具

- 特点: 最简单,通过标准输入输出进行通信

- 典型用途: 本地文件处理、系统工具集成

2. 服务器发送事件(SSE)

- 适用场景: Web应用、实时推送

- 特点: 单向推送,服务器主动向客户端发送数据

- 典型用途: 实时通知、数据流更新

3. 可流式传输的HTTP(streamableHttp)

- 适用场景: 远程服务、云端部署

- 特点: 支持双向通信和流式传输

- 典型用途: 企业级应用、跨网络服务