目录

[1️⃣ Animate Anyone(传统版,非 Diffusion)](#1️⃣ Animate Anyone(传统版,非 Diffusion))

[2️⃣ DreamPose(强烈推荐,焕发新版本)](#2️⃣ DreamPose(强烈推荐,焕发新版本))

[3️⃣ EasyAnimate(视频生成 + 人体动作支持)--- 华为开源](#3️⃣ EasyAnimate(视频生成 + 人体动作支持)— 华为开源)

[4️⃣ MagicAnimate(Meta 发布,效果好)](#4️⃣ MagicAnimate(Meta 发布,效果好))

[5️⃣ Everybody Dance Now(EDN)--- 经典方案](#5️⃣ Everybody Dance Now(EDN)— 经典方案)

[✅ 二、云端/在线商用支持"人体动作动画"的工具](#✅ 二、云端/在线商用支持“人体动作动画”的工具)

[1️⃣ D-ID(官方支持全身动作)](#1️⃣ D-ID(官方支持全身动作))

[2️⃣ HeyGen(部分模板支持全身)](#2️⃣ HeyGen(部分模板支持全身))

[3️⃣ Runway Gen-2 / Gen-3 Alpha](#3️⃣ Runway Gen-2 / Gen-3 Alpha)

DreamPose

EasyAnimate

https://github.com/aigc-apps/EasyAnimate

| 模型 | 支持全身动作 | 真实度 | 部署难度 | 推荐指数 |

|---|

|----------------------------|-----|-------|-----|-------|

| DreamPose(EasyAnimate) | ✅ 强 | ⭐⭐⭐⭐⭐ | 中-高 | ⭐⭐⭐⭐⭐ |

|------------------|---|------|---|------|

| MagicAnimate | ✅ | ⭐⭐⭐⭐ | 高 | ⭐⭐⭐⭐ |

|--------------------|---|-----|---|-----|

| Animate Anyone | ✅ | ⭐⭐⭐ | 低 | ⭐⭐⭐ |

|-------------------------|---|----|---|----|

| Everybody Dance Now | ✅ | ⭐⭐ | 低 | ⭐⭐ |

|--------------------|---|-------|------|------|

| Runway Gen-2/3 | ✅ | ⭐⭐⭐⭐⭐ | 无需部署 | ⭐⭐⭐⭐ |

|-------------------|----|------|------|------|

| D-ID / HeyGen | 部分 | ⭐⭐⭐⭐ | 无需部署 | ⭐⭐⭐⭐ |

一、开源(可本地跑)全身人体动作迁移模型

1️⃣ Animate Anyone(传统版,非 Diffusion)

特点:

-

输入:一张人物全身照 + 一个动作序列(人体关键点)

-

输出:人物按照给定动作跳舞、摆 pose

-

早期版本是较经典的 pose-transfer 方法

优点:

-

支持全身/四肢动作

-

发挥稳定,不用显卡特别强

缺点:

-

风格化不强

-

人物可能有变形

开源仓库:

https://github.com/HumanAIGC/AnimateAnyone

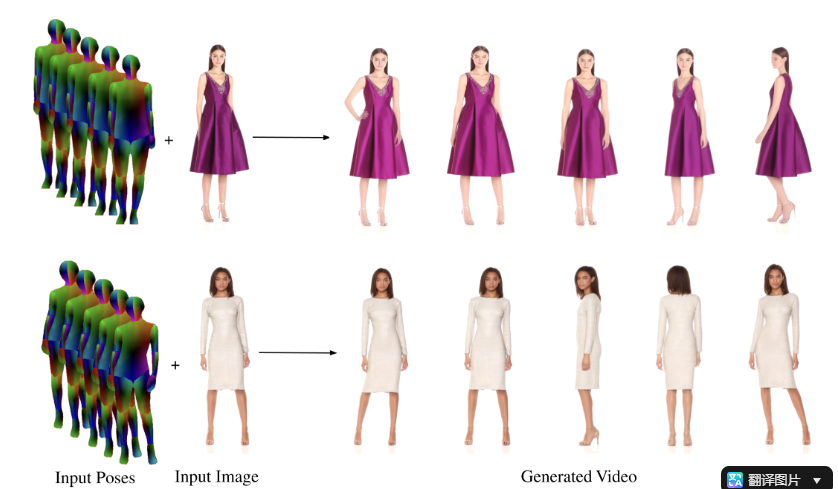

2️⃣ DreamPose(强烈推荐,焕发新版本)

特点:

-

输入:一张人物照片

-

驱动:OpenPose / MediaPipe 动作序列

-

生成:全身动作视频(跳舞、走路、挥手都行)

优点:

-

目前开源中最稳定、最像真人的 pose-to-video

-

对四肢动作迁移非常好

-

身体比例不会乱掉

缺点:

- Diffusion 模型,速度相对较慢

开源仓库:

https://github.com/huawei-noah/EasyAnimate

DreamPose 是在 EasyAnimate 框架里。

看pose转video效果不是特别好,

https://github.com/aigc-apps/EasyAnimate

3️⃣ EasyAnimate(视频生成 + 人体动作支持)--- 华为开源

特点:

-

文生视频、图生视频、动作控制

-

支持"人物 + 动作姿态"的大型模型

优点:

-

输出质量高(类似 Stable Video Diffusion 的升级版)

-

有全身动作转移 pipeline

-

有控制模块(ControlNet-Pose)

缺点:

- GPU 至少 24GB 才跑得舒服

开源:

https://github.com/huawei-noah/EasyAnimate

4️⃣ MagicAnimate(Meta 发布,效果好)

特点:

-

输入:静态人像

-

驱动:人物动作视频(关键点序列)

-

输出:全身跳舞、行走等动作视频

优点:

-

真实度较高

-

皮肤、衣服细节保持较好

缺点:

-

原版不完全开源(有推理代码)

-

使用门槛稍高

仓库:

https://github.com/facebookresearch/MagicAnimate

5️⃣ Everybody Dance Now(EDN)--- 经典方案

特点:

-

输入:一张全身照

-

驱动:一个跳舞视频(提取骨架)

-

输出:整个人一起跳舞

优点:

-

简单易用,老显卡也能跑

-

效果在"练舞/跳舞动作"上很自然

缺点:

-

分辨率低

-

面部和衣服容易糊

开源:

https://github.com/carolineec/EverybodyDanceNow

✅ 二、云端/在线商用支持"人体动作动画"的工具

如果你不想自己部署,可以用下面的:

1️⃣ D-ID(官方支持全身动作)

-

人像 + 全身 AI actor

-

支持"动作模板"驱动

2️⃣ HeyGen(部分模板支持全身)

-

有"全身 presenter" 模式

-

能跟随动作模板做肢体动作

3️⃣ Runway Gen-2 / Gen-3 Alpha

-

直接支持"动作控制(pose control)"

-

可做复杂身体动作