🧠 从零到可用:Windows 下使用 Anaconda 创建 Python 3.8 环境 + 安装 PyTorch + CUDA(完整教程)

文章目录

- [🧠 从零到可用:Windows 下使用 Anaconda 创建 Python 3.8 环境 + 安装 PyTorch + CUDA(完整教程)](#🧠 从零到可用:Windows 下使用 Anaconda 创建 Python 3.8 环境 + 安装 PyTorch + CUDA(完整教程))

- [📌 1. 检查你的显卡、驱动和 CUDA 运行时版本](#📌 1. 检查你的显卡、驱动和 CUDA 运行时版本)

-

-

- [🔍 如何理解"CUDA Version: 12.8"?](#🔍 如何理解“CUDA Version: 12.8”?)

-

- [📌 2. 你到底需不需要安装 CUDA Toolkit?](#📌 2. 你到底需不需要安装 CUDA Toolkit?)

- [📌 3. 创建 Conda 虚拟环境(Python 3.8)](#📌 3. 创建 Conda 虚拟环境(Python 3.8))

- [📌 4. 安装 PyTorch(选择合适的 CUDA 版本)](#📌 4. 安装 PyTorch(选择合适的 CUDA 版本))

-

- [⭐ 最稳定的命令:安装 PyTorch + CUDA 12.1](#⭐ 最稳定的命令:安装 PyTorch + CUDA 12.1)

- [📌 5. 验证 PyTorch 是否正确启用 GPU](#📌 5. 验证 PyTorch 是否正确启用 GPU)

- [📌 6. 可选:验证 GPU 是否真正工作](#📌 6. 可选:验证 GPU 是否真正工作)

- [📌 7. 推荐的一些系统查询命令(方便写脚本或排查)](#📌 7. 推荐的一些系统查询命令(方便写脚本或排查))

-

-

- [✔ 查询 Python 环境](#✔ 查询 Python 环境)

- [✔ 查询 conda 环境](#✔ 查询 conda 环境)

- [✔ 查询显卡驱动](#✔ 查询显卡驱动)

- [✔ 查询 Windows GPU 信息](#✔ 查询 Windows GPU 信息)

-

- [📌 8. 常见问题 FAQ](#📌 8. 常见问题 FAQ)

-

-

- [❓ torch.cuda.is_available() = False?](#❓ torch.cuda.is_available() = False?)

- [❓ 我一定要安装 CUDA Toolkit 吗?](#❓ 我一定要安装 CUDA Toolkit 吗?)

- [❓ CUDA 12.8 和 CUDA 12.1 不匹配吗?](#❓ CUDA 12.8 和 CUDA 12.1 不匹配吗?)

-

- [📌 9. 全流程总结(最关键的5步)](#📌 9. 全流程总结(最关键的5步))

在深度学习开发中,我们最常用的环境组合是 Anaconda + PyTorch + CUDA。但初学者往往会遇到各种疑问:

- 我要怎么查询电脑 CUDA 版本?

- NVIDIA 驱动版本怎么查?

- CUDA Toolkit 要不要安装?

- conda 虚拟环境怎么建?

- PyTorch 版本如何和 CUDA 匹配?

- GPU 怎么验证?

这篇文章会从 最基础的检查 到 最终 GPU 能跑起来,一步一步完整讲清楚。

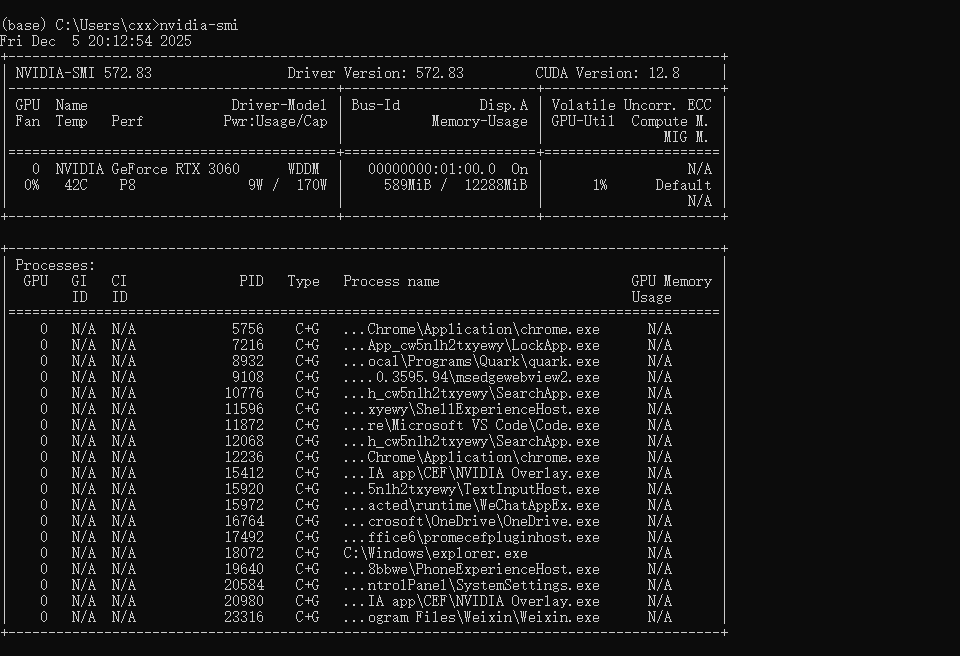

📌 1. 检查你的显卡、驱动和 CUDA 运行时版本

如果你已经安装了 NVIDIA 显卡驱动 ,可以通过 nvidia-smi 来查看系统支持的 CUDA 版本。

在 Windows CMD 或 Anaconda Prompt 输入:

bash

nvidia-smi你会看到类似这样的输出:

Driver Version: 572.83

CUDA Version: 12.8

GPU: NVIDIA GeForce RTX 3060

📌 这里有几条非常重要的信息:

| 信息 | 说明 |

|---|---|

| Driver Version | 显卡驱动版本,越新越好 |

| CUDA Version | 驱动内置的 CUDA Runtime,和 CUDA Toolkit 不是一回事 |

| GPU Name | 你的显卡型号 |

🔍 如何理解"CUDA Version: 12.8"?

这表示:

- 你的 GPU 驱动 支持最高到 CUDA 12.8

- 不代表你本地安装了 CUDA 12.8

- PyTorch 可以选择 任何 <= 12.8 的 CUDA 版本

目前 PyTorch 官方提供的最高版本是 CUDA 12.1。

因此,即使你的驱动显示 12.8,你也应该安装 PyTorch 的 CU121。

📌 2. 你到底需不需要安装 CUDA Toolkit?

✔ 绝大多数深度学习开发者不需要安装 CUDA Toolkit!

因为 PyTorch 的 CUDA 版本是「内置」的(Runtime)。

只要你安装的 torch 是 cu118 / cu121,就能直接使用 GPU。

⚠️ CUDA Toolkit 只有在以下情况才需要安装:

- 你需要编译 CUDA C++ 代码

- 你开发 GPU kernel

- 你构建需要 CUDA 的 C++ 扩展

普通用户 完全不需要 安装 CUDA Toolkit。

📌 3. 创建 Conda 虚拟环境(Python 3.8)

在命令行输入:

bash

conda create -n python38 python=3.8 -y

conda activate python38你现在已经进入了 python38 环境。

📌 4. 安装 PyTorch(选择合适的 CUDA 版本)

官方选择器地址:

👉 https://pytorch.org/get-started/locally/

在中国访问较慢,可以提前确认你的版本需求:

- Python:3.8

- 系统:Windows

- 安装方式:pip/conda

- CUDA:12.1(推荐)

⭐ 最稳定的命令:安装 PyTorch + CUDA 12.1

bash

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu121如果访问失败,可以使用国内镜像方式(比如清华源 + 官方源混合)。

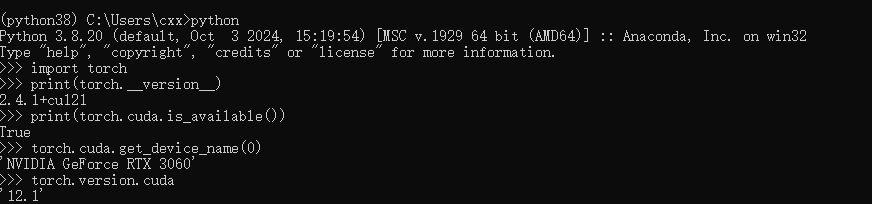

📌 5. 验证 PyTorch 是否正确启用 GPU

进入 python:

bash

python输入:

python

import torch

print("PyTorch version:", torch.__version__)

print("CUDA available:", torch.cuda.is_available())

print("GPU:", torch.cuda.get_device_name(0) if torch.cuda.is_available() else "None")

print("CUDA used by PyTorch:", torch.version.cuda)如果输出如下:

CUDA available: True

GPU: NVIDIA GeForce RTX 3060

CUDA used by PyTorch: 12.1

说明你的 GPU 环境配置成功。

📌 6. 可选:验证 GPU 是否真正工作

输入一个矩阵乘法测试:

python

import torch

a = torch.randn(3000, 3000).cuda()

b = torch.mm(a, a)

print("计算成功,GPU 在工作")如果跑起来没有报错并且显卡有响应(风扇加速、GPU 占用提升),说明 CUDA 真正可用了。

📌 7. 推荐的一些系统查询命令(方便写脚本或排查)

✔ 查询 Python 环境

bash

where python

python --version✔ 查询 conda 环境

bash

conda info

conda env list✔ 查询显卡驱动

bash

nvidia-smi✔ 查询 Windows GPU 信息

bash

dxdiag生成的 dxdiag 文件能包含完整 GPU、驱动、DirectX 信息。

📌 8. 常见问题 FAQ

❓ torch.cuda.is_available() = False?

可能原因:

- 你安装了 CPU 版本的 PyTorch

- 显卡驱动没有安装好

- 驱动太老,不支持你安装的 CUDA

- 虚拟环境未激活

- 使用了清华镜像安装 torch 时,没有安装 GPU 版本

❓ 我一定要安装 CUDA Toolkit 吗?

不用。

PyTorch 带了自己的 CUDA Runtime。

❓ CUDA 12.8 和 CUDA 12.1 不匹配吗?

驱动支持高版本(12.8),可以兼容低版本(12.1)。

CUDA 的兼容性是:

✔ 驱动版本 >= CUDA Runtime 版本即可使用

❌ 反之不行

所以你的驱动完全可以用 cu121。

📌 9. 全流程总结(最关键的5步)

# 1. 查显卡

nvidia-smi

# 2. 建环境

conda create -n python38 python=3.8 -y

conda activate python38

# 3. 安装 PyTorch GPU 版

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu121

# 4. 验证

python -c "import torch;print(torch.cuda.is_available(), torch.cuda.get_device_name(0))"运行成功即可开始你的深度学习开发。