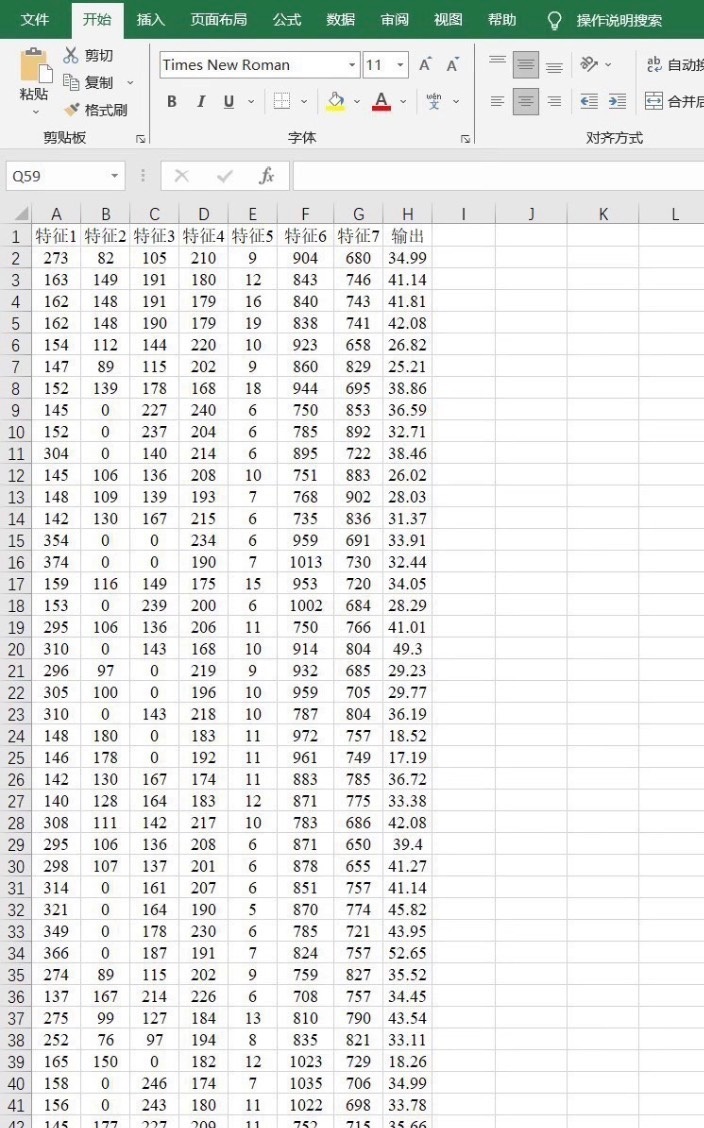

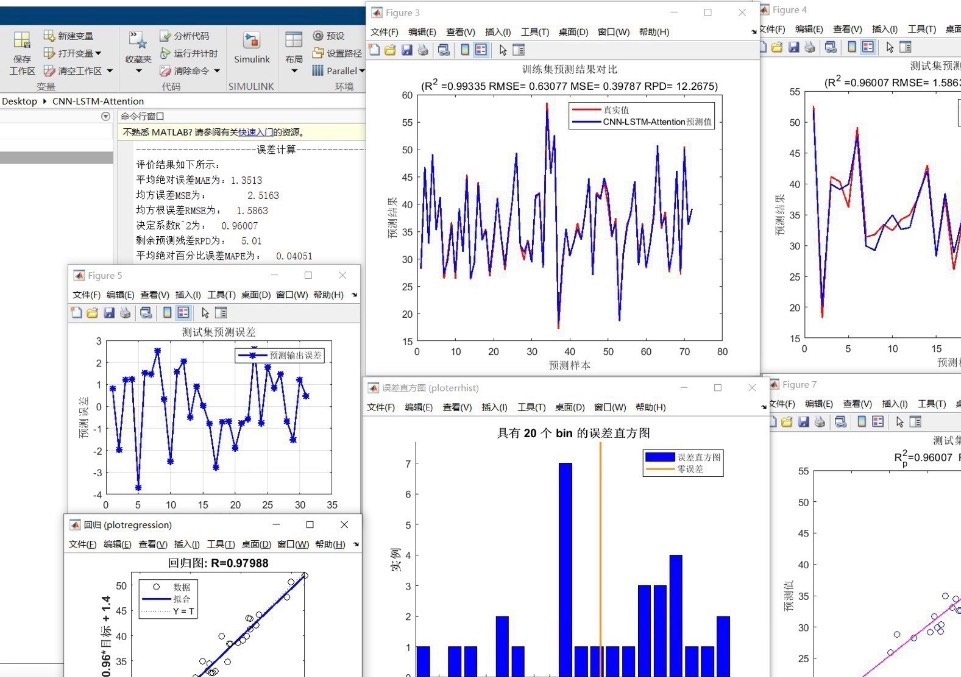

CNN-LSTM-Attention CNN-BiLSTM-Attention CNN-GRU-Attention 基于卷积神经网络-长短期记忆网络结合注意力机制的多变量/时间序列预测 Matlab语言 0.联系三个都发 1.多特征输入,单输出,可实现回归预测或超前预测,Matlab版本要在2020B及以上。 2.特点: [1]卷积神经网络 (CNN):捕捉数据中的局部模式和特征。 [2]长短期记忆网络 (LSTM):处理数据捕捉长期依赖关系。 [3]注意力机制:为模型提供了对关键信息的聚焦能力,从而提高预测的准确度。 3.直接替换Excel数据即可用,注释清晰,适合新手小白 4.附赠测试数据,输入格式如图2所示,可直接运行 5.模型只是提供一个衡量数据集精度的方法,因此无法保证替换数据就一定得到您满意的结果

嘿,各位小伙伴!今天咱来聊聊基于卷积神经网络 - 长短期记忆网络结合注意力机制的多变量/时间序列预测,而且是用 Matlab 语言实现哦,Matlab 版本得在 2020B 及以上哈。

模型简介

1. CNN - LSTM - Attention

- CNN(卷积神经网络):它就像是一个数据"侦察兵",能够敏锐地捕捉数据中的局部模式和特征。比如说,在时间序列数据里,它可以发现那些短期内呈现的特定规律。

- LSTM(长短期记忆网络):专门用来处理数据中的长期依赖关系。时间序列数据往往有着过去信息影响未来的特性,LSTM 就能很好地记住这些长期依赖,不会像普通 RNN 那样容易"忘事"。

- 注意力机制:这可是个厉害的玩意儿,它赋予模型聚焦关键信息的能力。就好比你在看书,注意力机制能帮你一下子抓住重点段落,从而大大提高预测的准确度。

2. CNN - BiLSTM - Attention

和 CNN - LSTM - Attention 类似,只不过这里的 LSTM 换成了 BiLSTM(双向长短期记忆网络)。BiLSTM 不仅能像 LSTM 那样从前往后处理数据,还能从后往前处理,这样就能更全面地捕捉数据中的信息啦。

3. CNN - GRU - Attention

GRU(门控循环单元)是 LSTM 的"精简版",它在保持处理长期依赖能力的同时,结构更简单,计算量也相对较小。结合 CNN 和注意力机制后,同样能在时间序列预测中发挥出色。

模型特点总结

- 多特征输入,单输出:可以实现回归预测或者超前预测,非常实用。想象一下,你有一堆不同的特征数据,比如天气的温度、湿度、气压等,最后要预测未来某一时刻的温度,这就是多特征输入单输出的场景。

- 直接替换 Excel 数据即可用,注释清晰,适合新手小白:咱这个模型对新手超友好的,你只要把自己的数据整理成 Excel 格式,直接替换就行,代码里注释也都写得明明白白。

- 附赠测试数据,输入格式如图 2 所示,可直接运行 :为了方便大家上手,还送了测试数据,按照给定的输入格式,一键运行就能看到效果啦。不过得注意哦,模型只是提供一个衡量数据集精度的方法,无法保证替换数据就一定得到您满意的结果,毕竟不同的数据特性不一样嘛。

代码示例与分析(以 CNN - LSTM - Attention 为例)

数据预处理部分

matlab

% 加载数据,假设数据保存在 data.xlsx 文件中

data = readtable('data.xlsx');

% 将表格数据转换为数值矩阵

data = table2array(data);

% 划分训练集和测试集,这里简单地按照 80% 训练,20% 测试划分

trainRatio = 0.8;

trainSize = floor(size(data, 1) * trainRatio);

trainData = data(1:trainSize, :);

testData = data(trainSize + 1:end, :);

% 归一化数据,这里使用最大最小归一化

minVals = min(trainData);

maxVals = max(trainData);

normTrainData = (trainData - repmat(minVals, size(trainData, 1), 1))./(repmat(maxVals - minVals, size(trainData, 1), 1));

normTestData = (testData - repmat(minVals, size(testData, 1), 1))./(repmat(maxVals - minVals, size(testData, 1), 1));代码分析:首先从 Excel 文件读取数据并转换为数值矩阵。然后按照设定的比例划分训练集和测试集。最后对数据进行归一化处理,这样能让模型训练得更好,避免某些特征因为数值范围过大而主导训练过程。

构建 CNN - LSTM - Attention 模型

matlab

inputSize = size(normTrainData, 2) - 1; % 输入特征数量,最后一列是目标值

outputSize = 1; % 单输出

layers = [

sequenceInputLayer(inputSize) % 序列输入层

convolution1dLayer(3, 16, 'Padding', 'same') % 1D 卷积层,3 个卷积核,16 个滤波器,same 填充保证输出尺寸不变

batchNormalizationLayer % 批归一化层,加速训练

reluLayer % ReLU 激活函数

maxPooling1dLayer(2) % 最大池化层,下采样

bilstmLayer(32, 'OutputMode', 'last') % BiLSTM 层,32 个隐藏单元,输出最后一个时间步

attentionLayer % 注意力层

fullyConnectedLayer(outputSize) % 全连接层

regressionLayer]; % 回归层,用于回归预测代码分析:先定义输入和输出的尺寸。然后开始搭建模型,sequenceInputLayer 接收序列数据,卷积层捕捉局部特征,批归一化和 ReLU 层配合提升模型性能,最大池化层进行下采样减少数据量。BiLSTM 层处理长期依赖,注意力层聚焦关键信息,最后通过全连接层和回归层得到预测结果。

训练模型

matlab

options = trainingOptions('adam',...

'MaxEpochs', 100,...

'InitialLearnRate', 0.001,...

'ValidationData', {normTestData(:, 1:end - 1), normTestData(:, end)},...

'ValidationFrequency', 10,...

'Verbose', false,...

'Plots', 'training-progress');

net = trainNetwork(normTrainData(:, 1:end - 1), normTrainData(:, end), layers, options);代码分析:这里使用 Adam 优化器,设置最大训练轮数为 100,初始学习率 0.001 。将测试数据作为验证集,每 10 轮验证一次。训练模型并保存训练好的网络。

模型预测与评估

matlab

predicted = predict(net, normTestData(:, 1:end - 1));

% 反归一化预测结果

predicted = predicted.* (maxVals(end) - minVals(end)) + minVals(end);

testTarget = testData(:, end);

% 计算均方误差

mse = mean((predicted - testTarget).^2);代码分析:用训练好的模型对测试数据进行预测,然后对预测结果反归一化恢复到原始数据范围。最后计算预测值和真实值之间的均方误差来评估模型性能。

CNN - BiLSTM - Attention 和 CNN - GRU - Attention 的实现思路和这个类似,主要区别在于把 BiLSTM 层或者 GRU 层替换相应的部分就行啦。感兴趣的小伙伴可以自己动手试试,在时间序列预测的世界里畅游一番!希望这篇博文能对大家有所帮助哦。