音频是什么?

1 基本知识

音频数据的承载方式最常用的是脉冲编码调制,即 PCM。

在自然界中,声音是连续不断的,是一种模拟信号,那怎样才能把声音保存下来呢?那就是把声音数字化,即转换为数字信号。

我们知道声音是一种波,有自己的振幅和频率,那么要保存声音,就要保存声音在各个时间点上的振幅。

而数字信号并不能连续保存所有时间点的振幅,事实上,并不需要保存连续的信号,就可以还原到人耳可接受的声音。

根据奈奎斯特采样定理:为了不失真地恢复模拟信号,采样频率应该不小于模拟信号频谱中最高频率的2倍。

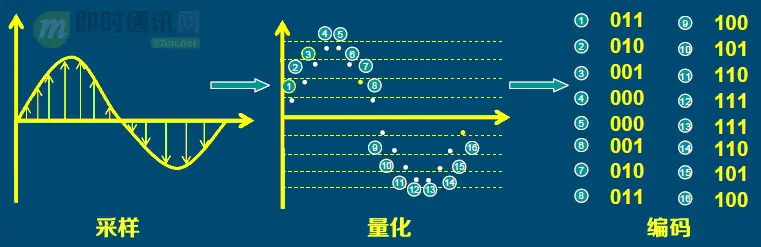

根据以上分析,PCM的采集步骤分为以下步骤:

模拟信号 -> 采样 -> 量化 -> 编码 -> 数字信号

2 采样率和采样位数

采样率,即采样的频率。

上面提到,采样率要大于原声波频率的2倍,人耳能听到的最高频率为20kHz,所以为了满足人耳的听觉要求,采样率至少为40kHz,通常为44.1kHz,更高的通常为48kHz。

采样位数,涉及到上面提到的振幅量化。波形振幅在模拟信号上也是连续的样本值,而在数字信号中,信号一般是不连续的,所以模拟信号量化以后,只能取一个近似的整数值,为了记录这些振幅值,采样器会采用一个固定的位数来记录这些振幅值,通常有8位、16位、32位。

位数越多,记录的值越准确,还原度越高。

3 编码

最后就是编码了。由于数字信号是由0,1组成的,因此,需要将幅度值转换为一系列0和1进行存储,也就是编码,最后得到的数据就是数字信号:一串0和1组成的数据。

整个过程如下:

4 声道数

声道数,是指支持能不同发声(注意是不同声音)的音响的个数。

(声道越多,音量就越大,音质也就越好,细节也就越丰富)

单声道:1个声道

双声道:2个声道

立体声道:默认为2个声道

立体声道(4声道):4个声道

(环绕也不能原音重现)

唯一有资格重塑声音现场的,其实是耳机,因为它真的把进入左耳与右耳的声音彻底分离。

用特殊设备欺骗听觉。

3D电影得用特殊设备拍摄,而3D声音也得用特殊设备录制,这特殊设备,就是假人头麦克风。在人头模型的两耳放置麦克风,就能够收录到如同我们两耳听到的环境声音,在耳机上回放,就会欺骗我们的听觉,让我们认为置身于声音的现场。

5 码率

码率,是指一个数据流中每秒钟能通过的信息量,单位bps(bit per second)。

码率 = 采样率 * 采样位数 * 声道数

零基础入门:实时音视频技术基础知识全面盘点本文引用自公众号"开发的猫",本次收录时有改动,感谢原作者"开发的猫"的分享。 - 掘金 https://juejin.cn/post/6854573217722400776即时通讯音视频开发(一):视频编解码之理论概述-实时音视频/专项技术区 - 即时通讯开发者社区!

https://juejin.cn/post/6854573217722400776即时通讯音视频开发(一):视频编解码之理论概述-实时音视频/专项技术区 - 即时通讯开发者社区! http://www.52im.net/thread-228-1-1.html

http://www.52im.net/thread-228-1-1.html

单声道音频(Mono Audio)是什么意思?

单声道(Mono) 是指音频信号仅通过 一个声道(单通道) 录制或播放,所有声音信息混合在一起,没有左右声道的区分。

单声道(Mono) vs 立体声(Stereo)

| 特性 | 单声道(Mono) | 立体声(Stereo) |

|---|---|---|

| 声道数量 | 1个(单通道) | 2个(左+右)或更多 |

| 音场表现 | 声音集中,无方向感 | 有空间感,能分辨左右 |

| 录制方式 | 单麦克风录制 | 多麦克风/立体声录制 |

| 常见用途 | 电话、广播、老唱片、留声机 | 音乐、电影、游戏 |

示例对比:

-

单声道:听广播时,主持人的声音从单一方向传来。

-

立体声:听音乐时,鼓声在左,吉他声在右,有临场感。

单声道音频的特点

? 优点

-

兼容性强:所有设备(包括老式收音机、电话)都能播放。

-

文件体积小:相比立体声,单声道音频占用的存储空间更少。

-

语音清晰:适合通话、播客等以人声为主的内容。

? 缺点

-

缺乏空间感:无法呈现音乐、电影中的立体声效果。

-

听感单调:长时间聆听可能显得枯燥。

单声道的应用场景

如何判断音频是单声道?

-

用耳机听:如果左右耳声音完全一致,没有左右区分,则是单声道。

-

音频软件查看:在Audacity、Adobe Audition等软件中,单声道音频只有 1条波形,立体声有 2条(L+R)。

单声道 vs. 双声道 vs. 环绕声

| 类型 | 声道数 | 特点 | 典型应用 |

|---|---|---|---|

| 单声道 | 1 | 无方向感,声音集中 | 电话、广播 |

| 立体声 | 2(L+R) | 有左右区分,增强临场感 | 音乐、耳机 |

| 环绕声 | 5.1/7.1 | 多声道,360°沉浸式体验 | 影院、家庭影院 |

-

误区1:"采样频率越高越好"

→ 过度采样会增加数据量和处理负担,需根据信号带宽选择。

-

误区2:"24bit音频一定比16bit好听"

→ 人耳动态范围有限,16bit已足够,24bit主要在录音中减少后期处理损失。

-

采样频率:决定能捕获的信号频率,需满足奈奎斯特定理。

-

采样位数:决定信号的幅度精度和噪声水平,影响动态范围。

二者共同作用:采样频率"横向"切割信号,位数"纵向"量化幅度,缺一不可。

示例:CD音质(44.1kHz/16bit)是权衡质量与存储的经典方案

多声道

超过2个声道的话统称为多声道(Multi-Channel)。

2.1声道

在2.0声道的基础上加上低音炮就是2.1声道。

包括了两个卫星箱和一个低音炮,2.1里的"2"指的是2个卫星箱,这个".1"指的是低音炮。

这是一个最最最普通的2.1声道设备配置,作为参考!

3.1声道

在2.1声道上增加了一个中置声道, 中置声道用于人声对白。所以是包括了3个声道和一个低音炮。

以Sonos为例,一台SONOS Beam回音壁+一台Sub mini组成3.1声道系统。Wifi音箱系统的好处是免去了繁杂的接线和链接过程,有网就行。

看起来只有两个设备啊?其实是因为Sonos Beam回音壁里面4个中低频+1个高频扬声器的配置,省下来三台独立设备的繁琐。

回音壁音响最早由雅马哈YAMAHA公司发布。它将 多个声道的音箱和功放整合在一个长条状的箱体内。重现回音壁音响的现场感。

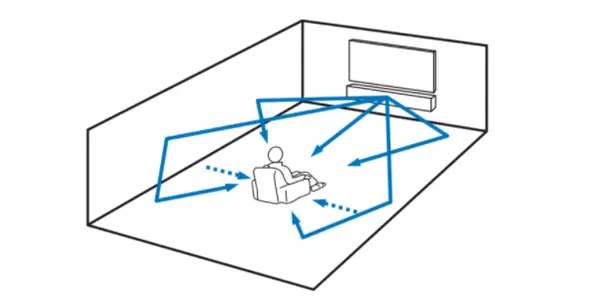

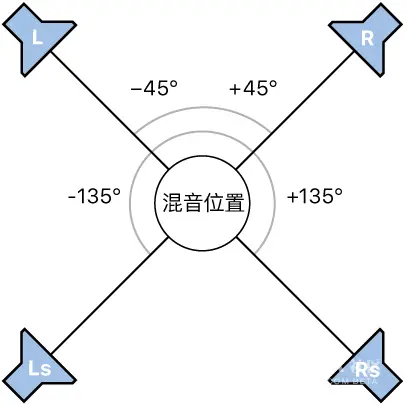

4声道 四声环绕

四声道环绕规定了4个发音点:前左、前右,后左、后右,听众则被包围在这中间。

4.1声道

增加一个低音音箱可以加强对低频信号的回放处理,这也是如今4.1声道音箱系统广泛流行的原因。

5.0声道

5.0声道的"5"是指五个3-20,000Hz的全局喇叭

以Sonos为例,5.0声道家庭影院的解决方案是SONOS Beam + 2台Sonos Era100

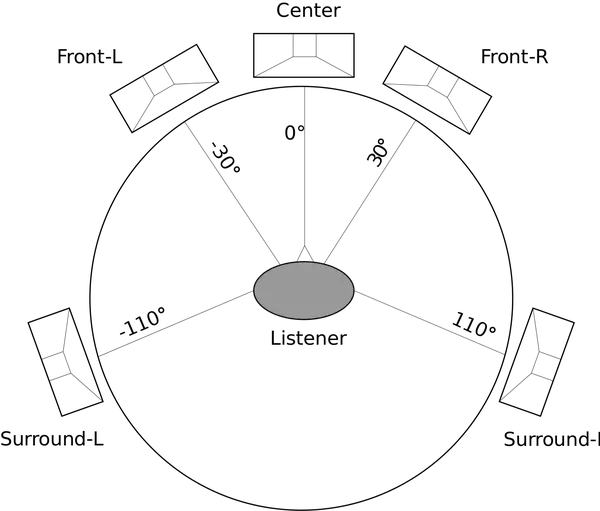

5.1声道

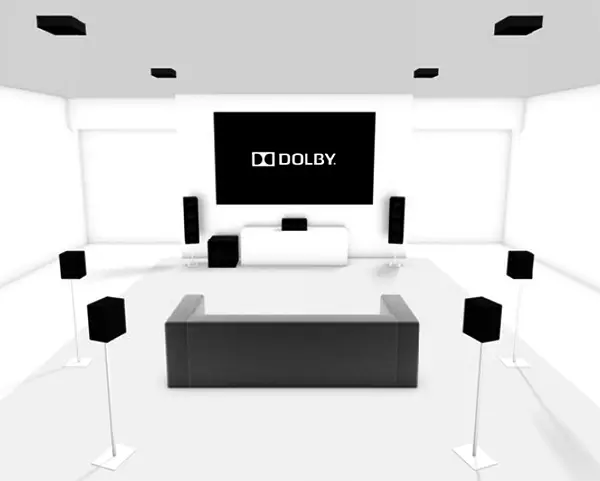

5.1声道的"5"是指五个3-20,000Hz的全局喇叭,".1"是指3-120Hz的重低音喇叭。这其实是一种的六声道环绕声系统,广泛用于电影院及家庭影院。

它包括以下几只音箱:

- 前置声道主箱(Front):2只

- 中置声道中置(Center):1只

- 环绕声道 环绕(Surround):2只

- 低音声道低音炮(Subwoofer):1只

具体空间分布是这样的(左+中+右+左环绕+右环绕+低音)图上没有把低音标注出来。

具体位置解释:

- 使用五个相同大小的全局喇叭

- 五个全局喇叭与用户距离相等

- 位置中央0°/前置±30°/环绕±110°

- 若用作观看电影,前置则放在±22.5°

5.1声道的第一次使用,追溯到1976年,当时杜比实验室修改了Todd-AO 70毫米胶片上6个类比音轨的使用方式,但当时在电影《洛根的逃亡》中杜比实验室的光学矩阵编码系统中,没有使用独立的环绕声,因此还不是真正的5.1,杜比实验室第一次在70毫米胶片中使用真正的5.1声道,是在1979年的《现代启示录》中,萤幕方向设置三个声道,另外两个环绕声以及一个低音通道。

我们以Sonos杜比全景声家庭影院套装为例,SONOS Arc+Sub+2个Era300,一个完整的5.1声道配置成本在25000元左右。

这里面,Sonos Arc有11个扬声器单元(3个高音扬声器、8个低音扬声器),一台机器充当了2台前置声道主箱+1台中置声道的功能。

一般家庭影院配置5.1声道就已经足够,后面的不同声道系统选择其实都是基于5.1声道进行的进一步升级和优化。

5.1.2声道

5.1.2其实就是前面的5.1声道的升级版,后面的".2"指的是添加了两只顶置音箱,也有人管它们叫天空声道。

因为传统的5.1、7.1,虽然都是环绕效果,但声音都局限在平面上,顶部是没有声音信号的。但很多电影中都会有诸如飞机掠过头顶、雨水打落在头顶、雷声在天空涌动等等场景,这些场景只靠平面声场是难以做到完美还原的。

顶置音箱怎么装?

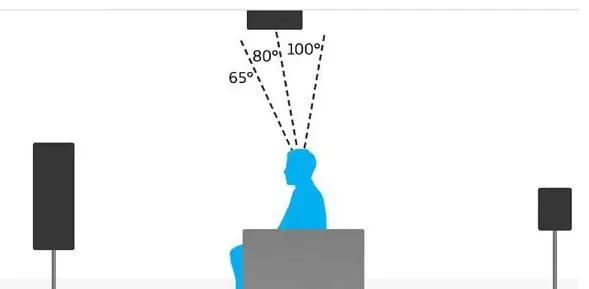

按照杜比官网推荐的摆位,5.1.2全景声顶置音箱的位置建议左右方向与前置音箱对齐,前后方向在与水平夹角65-100°之间,这个夹角换算成距离是多少呢?

建议是控制在65°夹角的左前上方和右前上方。

5.1.4声道

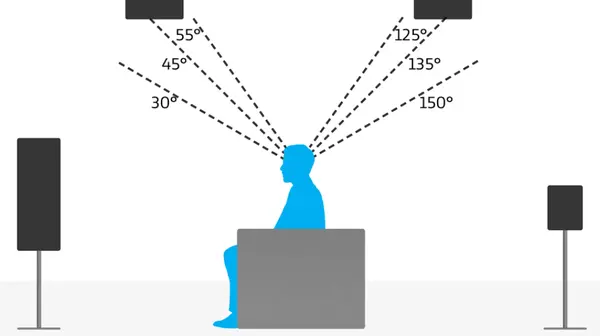

就如同5.1发展到7.1后声场衔接更为顺畅,5.1.2中的2只顶置音箱仍不足以覆盖较大的听音空间,为了让顶部空间的声场更完美,人们可以选择安装4只顶置音箱,也就是5.1.4声道。

因为头部音箱增加,所以角度也变大了不少。

7.1声道

相较于5.1声道,7.1声道在听音者后方增加了两个环绕声道 ,分别叫做左后、右后声道。

其实逻辑上很好理解,在传统的5.1声道系统中,声道集中在前半部分,后方声源比较薄弱。

7.1.2声道

在资金投入没有限制的情况下,完美设计的家庭影院中,声道数量越多,临场感越强烈,当然投资也会更多。当然也不是声道越多越好,比较支持这么多声道的音源内容有限。

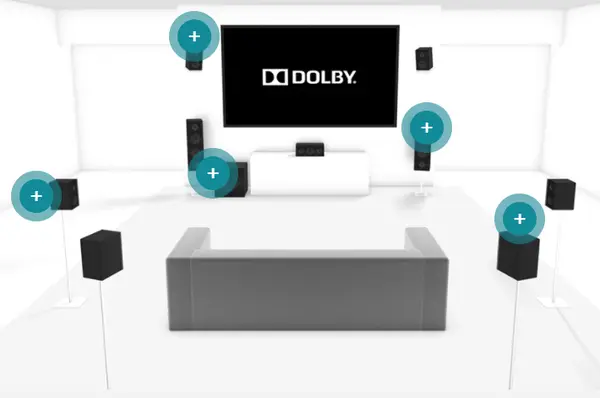

采用两个顶部扬声器,或是两个支持杜比全景声 (Dolby Atmos) 的扬声器或模块。

7.1.4声道

采用四个顶部扬声器,或是四个支持杜比全景声 (Dolby Atmos) 的扬声器或模块。

9.1声道

9.1 环绕声通过九个扬声器和一个超低音音箱提供影院体验。为此,它利用两个前置纵向声道。

9.1.2声道

9.1.2声道系统均采用两个顶部扬声器,或是两个支持杜比全景声 (Dolby Atmos) 的扬声器或模块。

11.1.4

更有甚者,推出11.1.4声道系统!例如三星Q990C就是11.1.4杜比全景声!

关于用5.1多声道与全景声"听音乐",了解到的一些相关情况,供参考了解,请多多指正吧~~~ - 知乎

上述作者资料不错。是个专注乐器音效的智者。

Ambisonics声音格式及麦克

Amd LocationSound同期录音网

推荐大家关注这个公众号了解更多内容

https://mp.weixin.qq.com/s/I5_wHE97ZYEdnEYL6wffhw

Soundfield麦克风以Ambisonics为基础,这是一种在一个点或一个空间表现或描述声场的方法。起源于20世纪70年代英国的一个研究项目,当时牛津大学的高材生迈克尔·格森(Michael Gerzon)、杰弗里·巴顿(Geoffrey Barton)和彼得·费尔格特(Peter Fellgett)是其中的重要参与者,但这些想法的要素却源于杜安·库珀(Duane Cooper)和T·希加(T.Shiga)的主要工作。(请看精彩的系列文章往事并不如烟:SoundField的过去现在及未来 连载1|连载2|连载3|连载4|连载5)

Ambisonics 本质上能够还原三维 360 **声场的格式,**因此非常适合沉浸式音频应用。这项技术在某些方面被认为是深奥的或"学术的",主要是由于需要一些复杂的数学知识才能实现声场,而另一个原因是它走在了时代的前列。

Ambisonic不能像处理基于通道的声音格式那样,简单地拾取特定扬声器的信号,或者执行基本的振幅移动,它还可以对用于特定扬声器阵列或两极性耳机系统进行解码。具有讽刺意味的是,这就是为什么现在人们对它重新产生了兴趣。

音频工程师们意识到,有太多可能的沉浸式音频渲染呈现格式,以至于不能实现用这些格式制作出单独的内容最终馈送到扬声器。而Ambisonic无论是"基于对象object"或"基于场景Scene"的声场声音录制都有很强的应用价值,Soundfield麦克的发明者迈克尔·格森(Michael Gerzon)在40年前就一直这样说,但当时的世界显然还没有准备好。

"基于场景"的代表是标准团体(例如,MPEG-H)中为声场格式采用的术语。例如,一些数字音频工作站和主流的沉浸式音频创作平台现在均提供处理Ambisonic内容的功能。

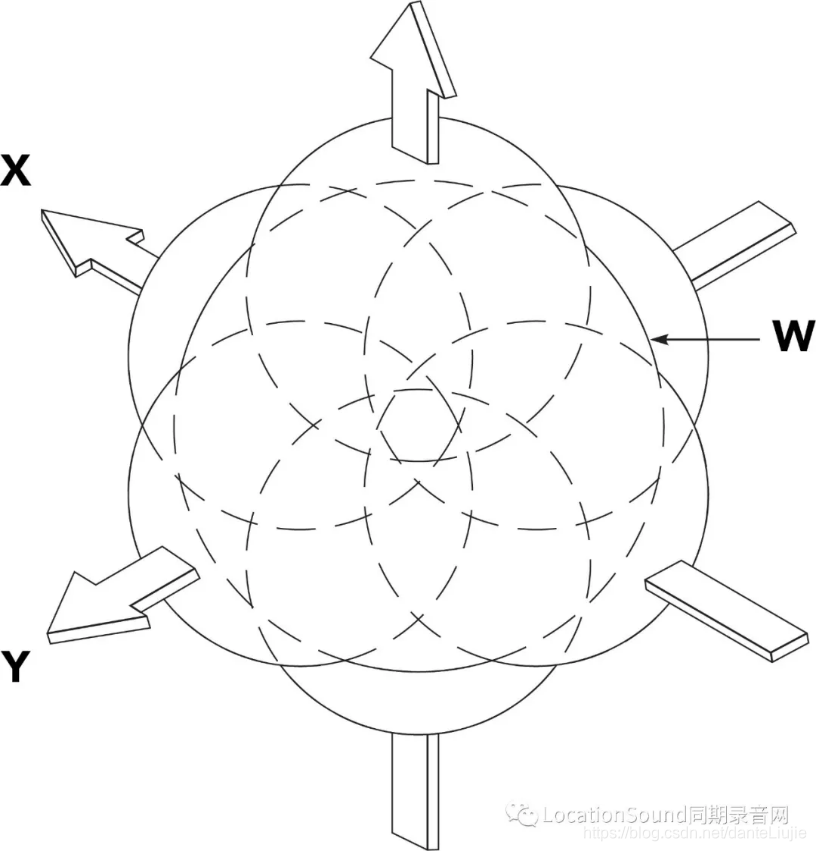

基础一阶 Ambisonics 的原理其实与中侧 (MS) **立体声非常相似。**中间格式的Sound field格式称为B格式。它根据全向压力分量(W)和三个数字8或压力梯度(速度)分量(X、Y和Z)对一点处的声场进行编码,这些组件具有解码多个扬声器,完整3D 360声场所需的基本信息。

上图以图形形式显示了这些内容。W基本上是一个球形图案,就像一个全向麦克风,而X是一个朝前的8字指向,Y是一个侧向的8字指向,Z是一个上下的8字指向。可以使用四个这些类型的麦克风来制作B格式Ambisonic麦克阵列,这些麦克风指向正确的方向,并尽可能地安装在一起,而过去一些人"自制"Sound Field捕获声音最大难题就是使各个振膜足够靠近。

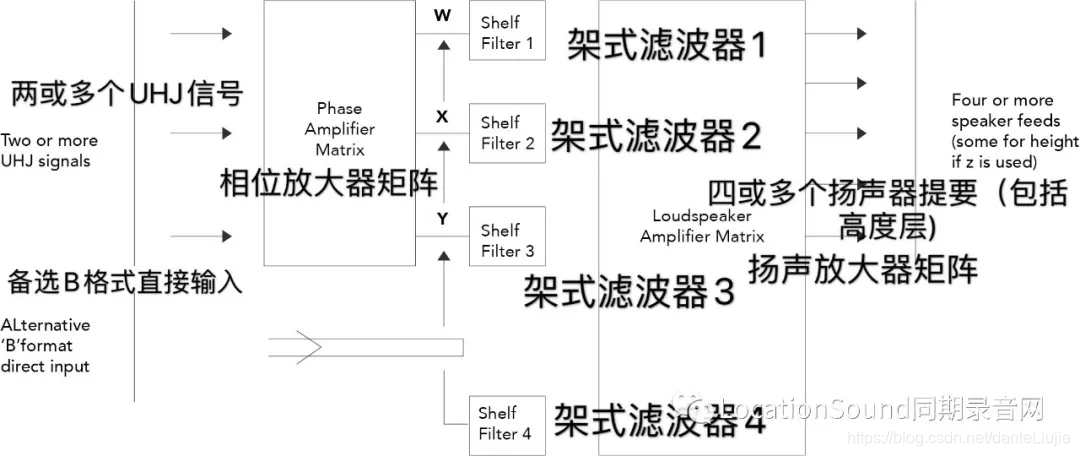

Ambisonic D-format表示用于呈现内容的目标扬声器阵列。对于给定数量和布局的扬声器,可以使用更多的信号处理来解码B格式,其中可以包括高度层级。

上图显示了基本原理,其中有一个相位幅度解码矩阵以及可选的一组架式滤波器,可以帮助补偿头部阴影和衍射。

SoundField麦克基础知识

麦克形式

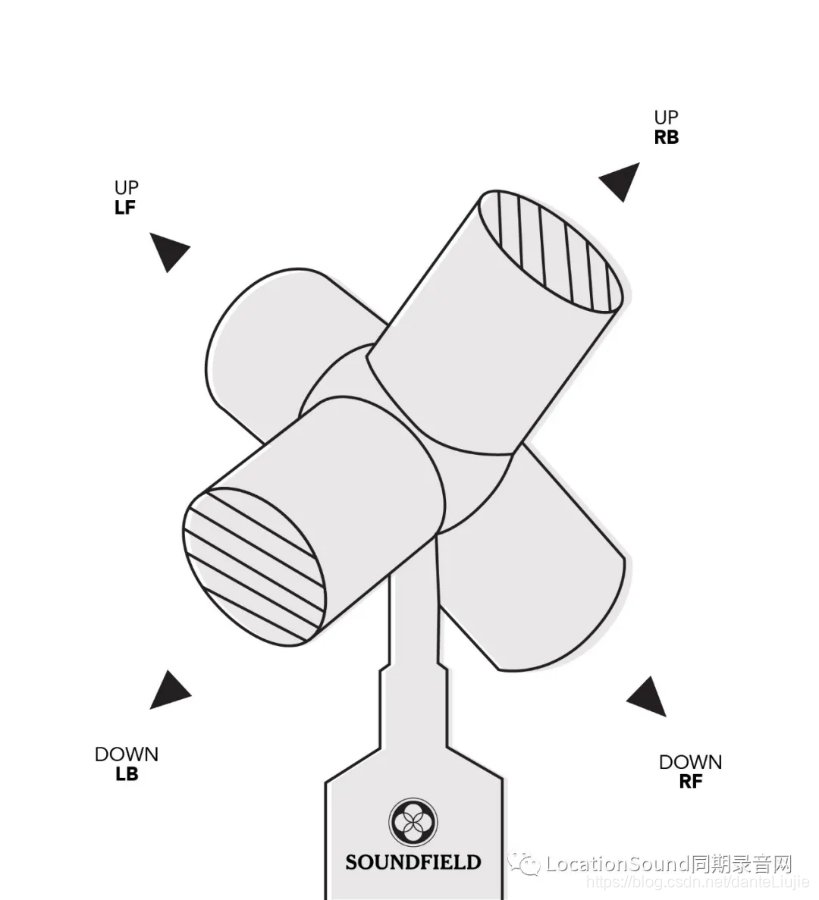

SoundField麦克风实际上不是由以B-format阵列排列的麦克风组成。相反他们使用一种称为A-format的阵列组。A-format采用安装在四面体表面上的四个宽心形(副心形)振膜(极性响应介于全向与心形指向两者中间),如上图所示。

振膜输出在某种程度上进行电子均衡以使它们在一定频率下看起来是一致的。A-format输出的基本求和差处理生成B-format分量。X = 0.5((LF-LB)+(RF-RB)),Y = 0.5((LF-RB)--(RF-LB)),Z = 0.5((LF-LB)+(RB-RF)) ,且W = 0.5(LF + LB + RF + RB)。由此产生的B-format输出经过仔细均衡以补偿电平差异,例如W输出可能缺少低频,因为它来自可能缺少低音的振膜。

四个四面体形式安装的振膜可以获得Sound field的基本一阶所需的所有东西,并且对它们微小间距的电子补偿使得产生的B-format看起来像是高度一致的立体声麦克风。对于水平轴立体声只需要使用W、X和Y分量,而如果要包括高度维度则需要考虑Z分量。

从A格式到B格式的解码是在外部控制设备或信号处理器或后期软件中完成的,因为这样就可以对信号进行不同的处理,以创建具有各种极性模式的水平或沉浸式录音。尽管Soundfield麦克风振膜非常匹配,但拾取A-format的信号并将其代码转换为B-format的另一个小优势是,振膜之间的任何微小变化都将同样有助于对B-format产生同等影响并被取消。

由于A-format的麦克风振膜经过电子处理以生成随后使用的B格式组件,因此可以做一些有用的事情。比如将麦克风颠倒过来,将其从立式使用转换为横向使用,甚至只需改变信号处理的方式,就可以确定麦克风指向的方向。

因此,Soundfield麦克风不仅仅是一个外壳中的简单重合对,而是一个复杂的多模式、可操控的沉浸式音频拾取设备,其输出可以通过适当的解码在几乎任何扬声器阵列上重现。如果你不需要这些复杂性,它仍然可以表现为一个非常灵活可操控的立体声麦克对,同时拥有可选择的极性模式!

操作Soundfield麦克风

麦克形式

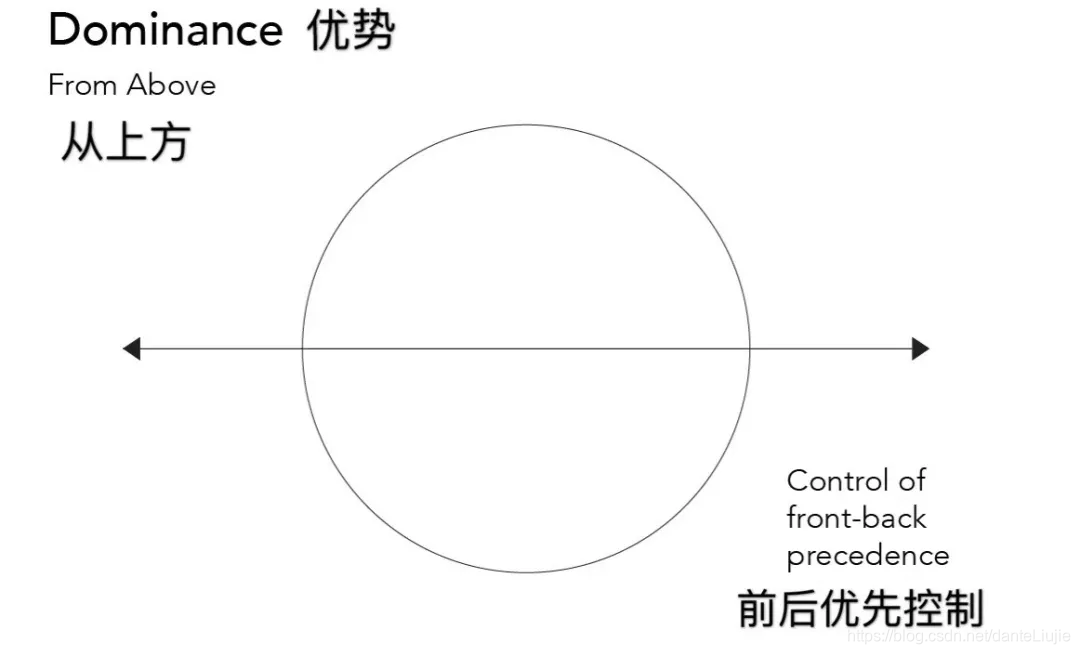

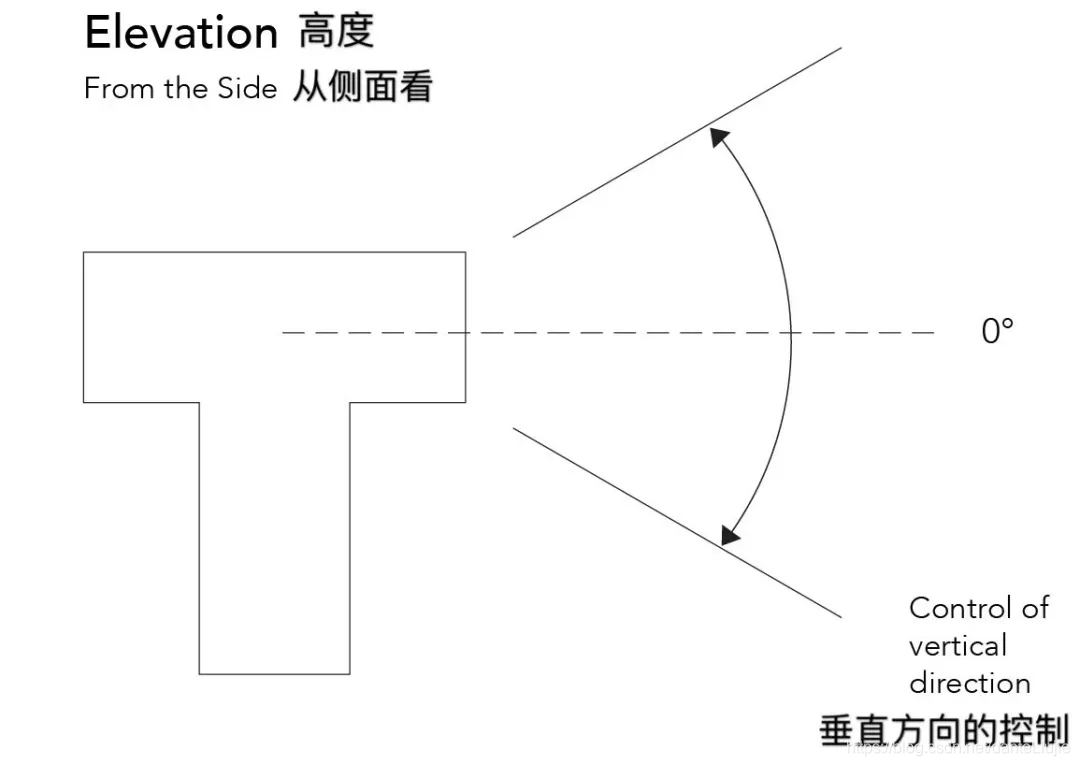

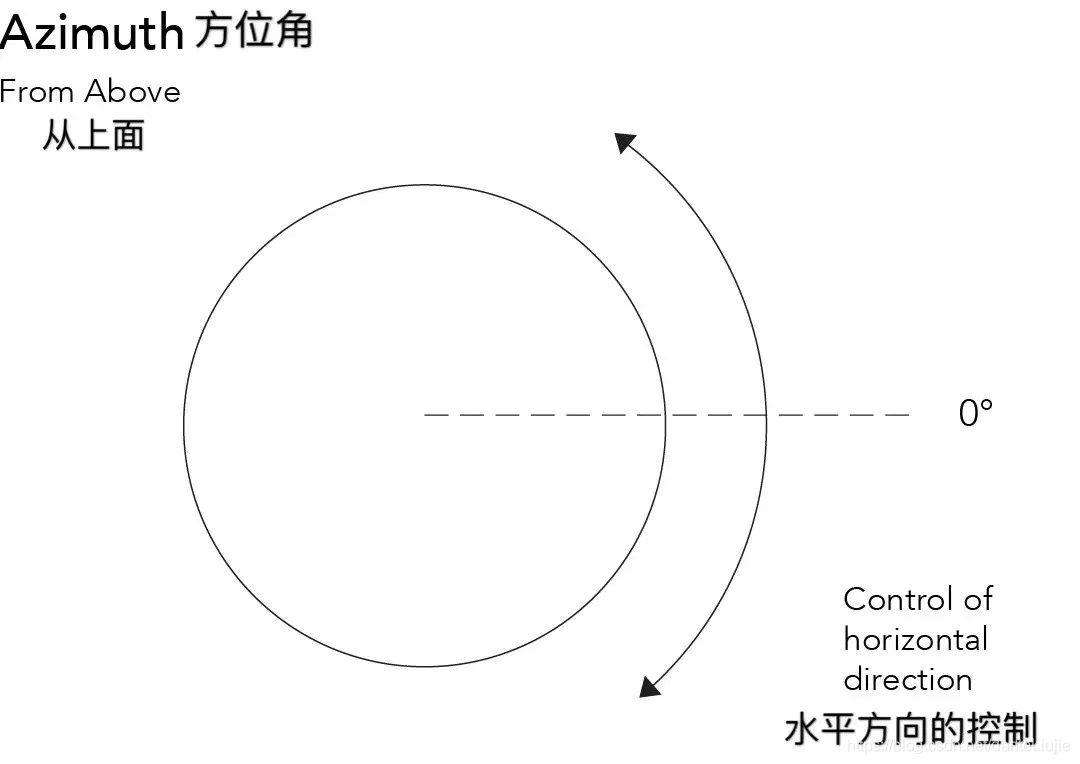

Soundfield麦克风最令人兴奋和有用的功能之一是可以通过电子方式"控制"其输出。可以将麦克风安装在录制声学空间的适当位置,然后调整各种B格式组件之间的关系,以改变方位、仰角和极性。

上图显示了每个转向参数的概念,可以看到方位角能够控制麦克风指向的水平方向,仰角能够控制垂直方向,而极性本质上是一种"前后景"优先控制,其作用有点像"缩放"功能(可以使麦克风偏向于从前面或从后面发出的声音)。这样做的最大好处是,虽然从声学的角度来看,物理方式麦克风的录音位置很重要,但Soundfield可以进行相当多的调整。可以将Soundfield麦克风悬挂在大厅中,而不必过于精确地确定其确切的物理方向,然后从控制设备后者后期软件调整转向参数,以便调整结果**。**

为了说明这是如何实现的,方位角是通过组合的正弦和余弦电平控制来处理X和yb格式的分量,然后以和差方式组合输出来创建修改的X和Y信号。如果θ是方位角偏移角,则X'=Xcosθ+Ysinθ和Y'=Ycosθ--Xsinθ。麦克风的电子反转可以通过反转Y和Z分量的相位来实现。

Soundfield麦克风灵活性的另一个方面是,表观的极性模式也是可以调整的。不难看出,通过对X和Y信号进行基本和差处理,可以合成一个90°的基本8字水平对。交叉心形可以通过涉及W(Omni)成分的元素来合成。简单水平对的"虚拟"麦克风之间的有效角度可以通过改变正弦/余弦关系中X和Y B格式分量之间的比率来调整。

录制Soundfield麦克风的A-format或B-format输出是很好的做法,即使用实时解码器来获得所需的处理输出也是如此。无论录制了A或B格式,关于声场和极地模式的各种操作的决定均可以在以后的后期制作中做出。它所需要的只是适用于您工作站的Soundfield插件。这提供了在后期制作中调整麦克风参数的完全灵活性,以及根据需要为任何类型的扬声器阵列供电的能力。