大家好,我是二哥呀。

2025 年,对我来说是 AI 从"好奇"到"依赖"的一年。

这一年我明显感觉到:AI 不再只是用来"问问题",而是真正参与到我真实的工作流中。写代码、改代码、理解遗留系统、拆需求、做方案,AI 开始变成一个长期在线的技术搭子。

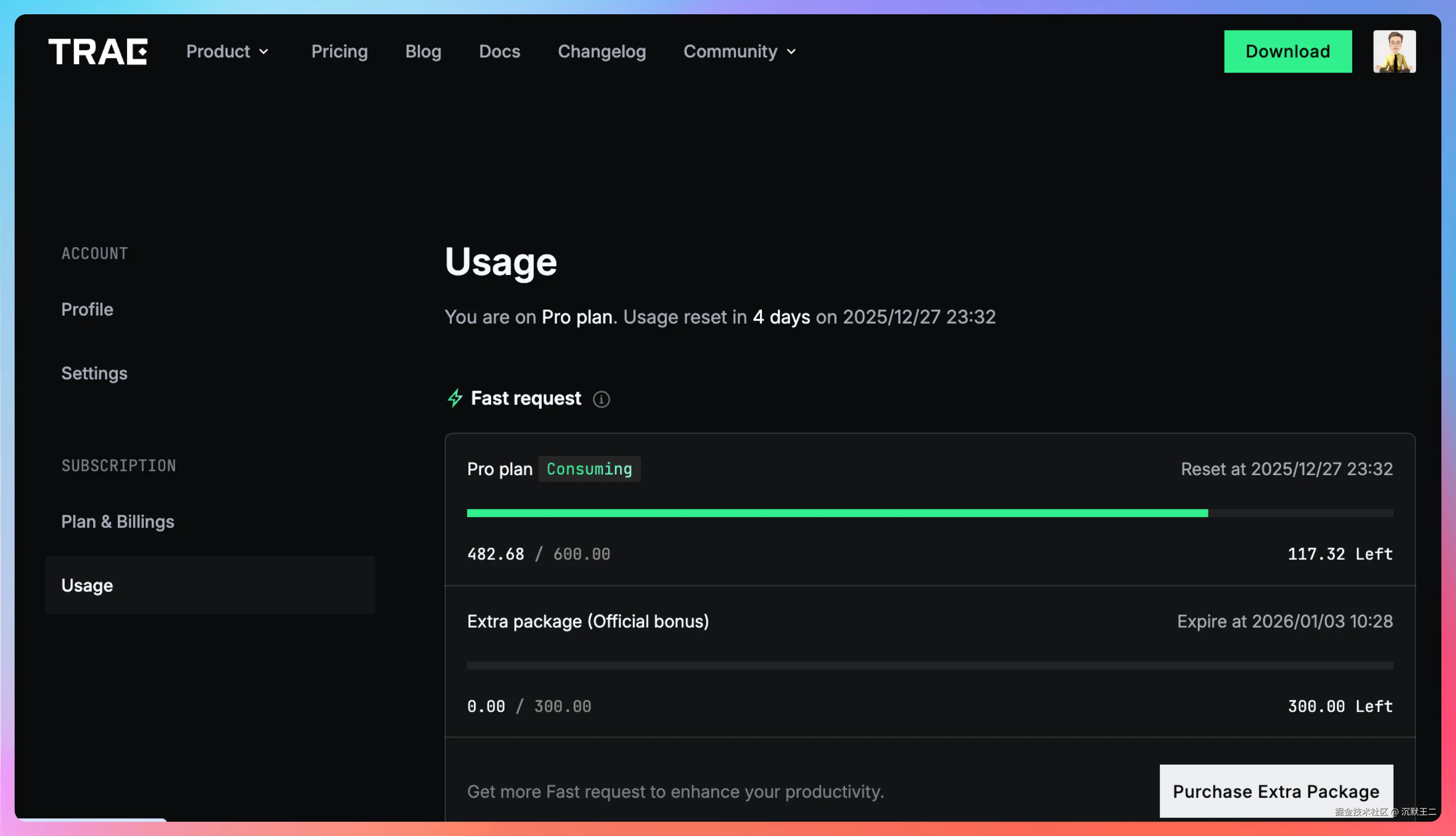

老早就买了 TRAE 国际版的 pro 年度会员,并且每天的使用频率非常高。

当然了,TRAE 中国版也在同步使用。这里说的"同步",并不是简单地装了两个版本试试水,而是真正进入了日常工作流。

在不同的网络环境、不同的模型体系、不同的实际开发场景下,我都会有意识地把问题交给 TRAE,对比他们呈现给我的结果,然后再挑选出我自己喜欢的风格。

国际版我主要是用的 Gemini 模型,它在回答一些代码层面的问题时,更深刻,更符合我的诉求;中国版更像是一个高频、随手可用的技术助手。

无论是快速理解一段老代码、确认某个设计是否合理,还是在写到一半时停下来,让 AI 帮我补齐一个基础骨架、校验一个思路,它都能无缝嵌进我的开发节奏里,不打断、不喧宾夺主。

还有一个很重要的一个原因:省钱,哈哈哈

01、与 TRAE 相伴的 2025

也是在这个背景下,我第一次完整地把 TRAE 用了一整年。第一次看到 TRAE 2025 用户年终报告时,我其实有点被戳到。

年终报告这东西本来很容易流于形式,但当我看到自己在TRAE 中国版里的使用数据时,突然意识到一件事:

我已经在不自觉中,把 TRAE 当成了知识获取的源泉。以前是读书,现在是读 TRAE,读他写的代码,读他给代码的注释,读他在代码基础上对问题的思考方式,读他对我工程能力的提升。

哪些时间段用得最多、偏向哪类问题、是偏生成还是偏推理,这些数据其实比"你今年写了多少行代码"更真实。

大家也可以把自己的年度报告分享到 TRAE Friends 群里,比一比,看谁的花活最多,😄

线下活动大家也可以积极参与下,上次去参加郑州的线下活动,收获颇丰。

02、TRAE 最核心的价值

如果只说功能,AI IDE、插件大家都有。但 TRAE 真正让我一直在高频使用的原因是:

它没有试图替我"做决定",而是一直在帮我"加速判断"。

从需求理解、代码生成、到重构时的对照分析,它更像一个随叫随到、但不抢你键盘和鼠标的技术同事。

2025 年,TRAE 的迭代速度很快。

从最早的插件形态,到 IDE,我能明显感觉到它的产品方向是偏工程侧的。不是为了做 Demo,不是为了秀模型能力,而是反复围绕一个问题持续打磨------怎样才能真的嵌进开发者的日常工作里。

问答、补全、生成、理解代码,这些能力单看并不新鲜。但当它们被有意识地组合在一起时,刚好覆盖了开发过程中最消耗心力、却又最容易被忽略的部分。

也正是因为这一点,我才会在真实项目里,把 TRAE 当成一个默认存在的"工程加速器"。

我用它做过的事情很具体,也很日常: 拆复杂业务逻辑、快速理解老项目、生成基础代码骨架、在重构前对比多种方案的优劣等。

使用 SOLO 进行业务开发

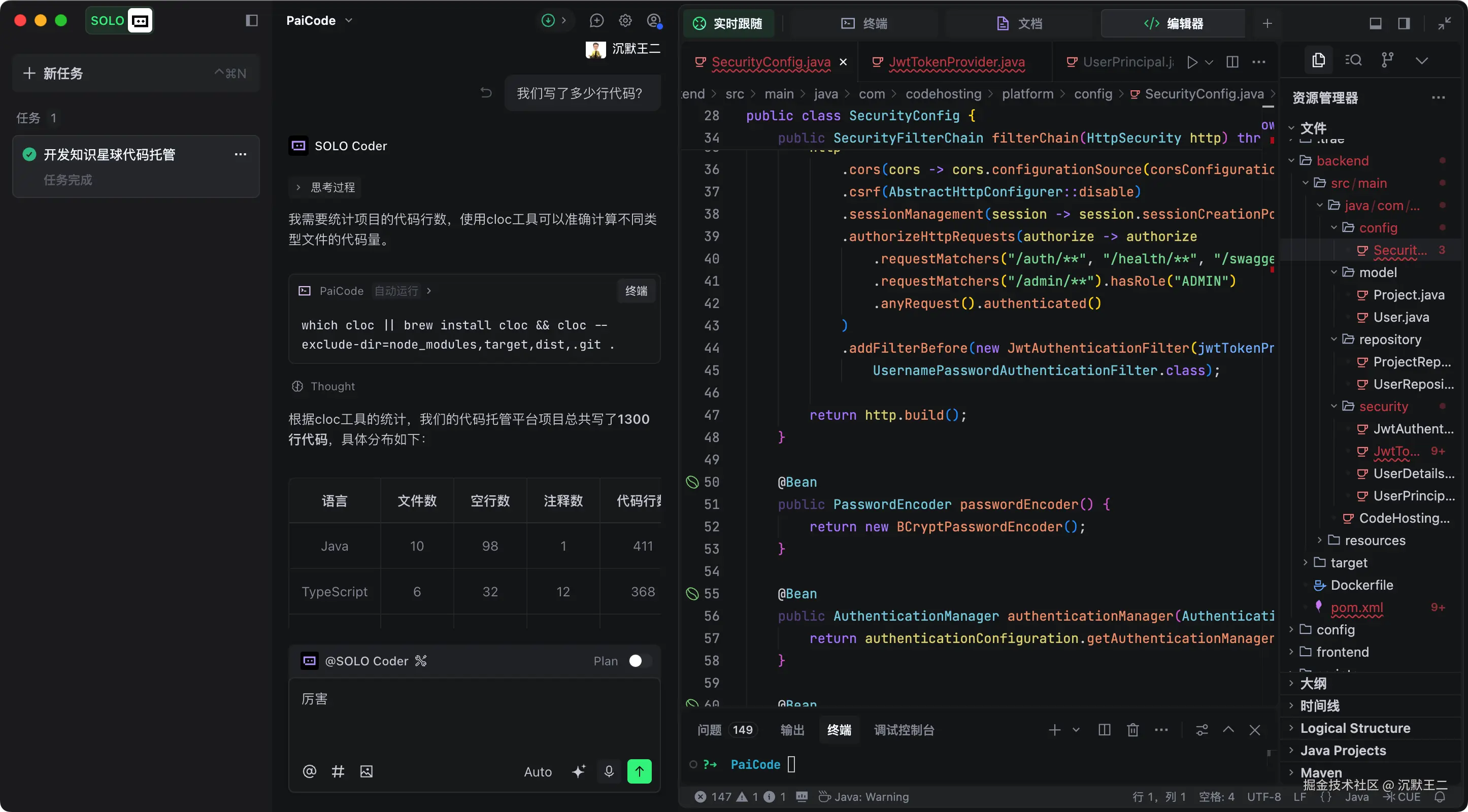

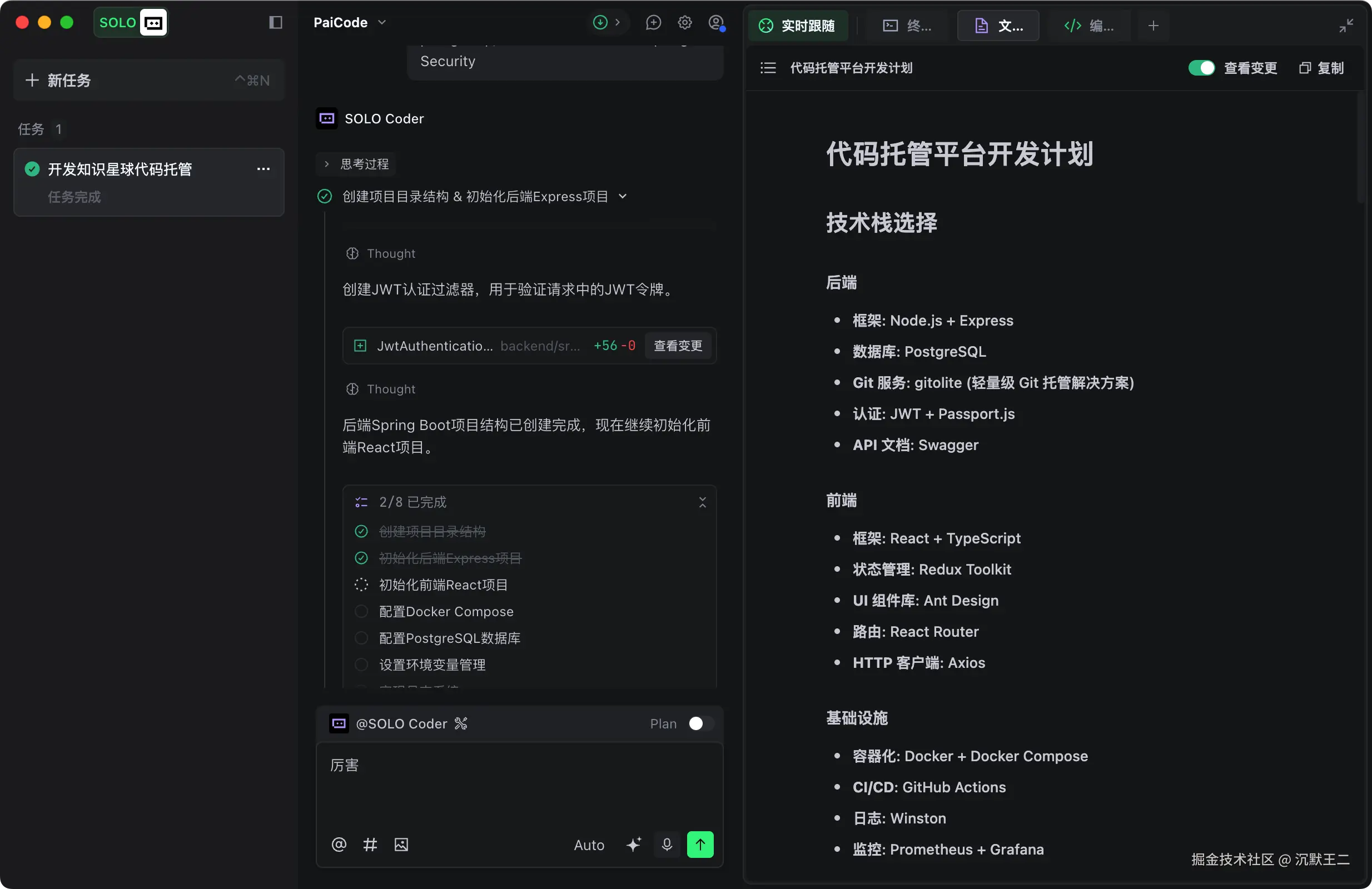

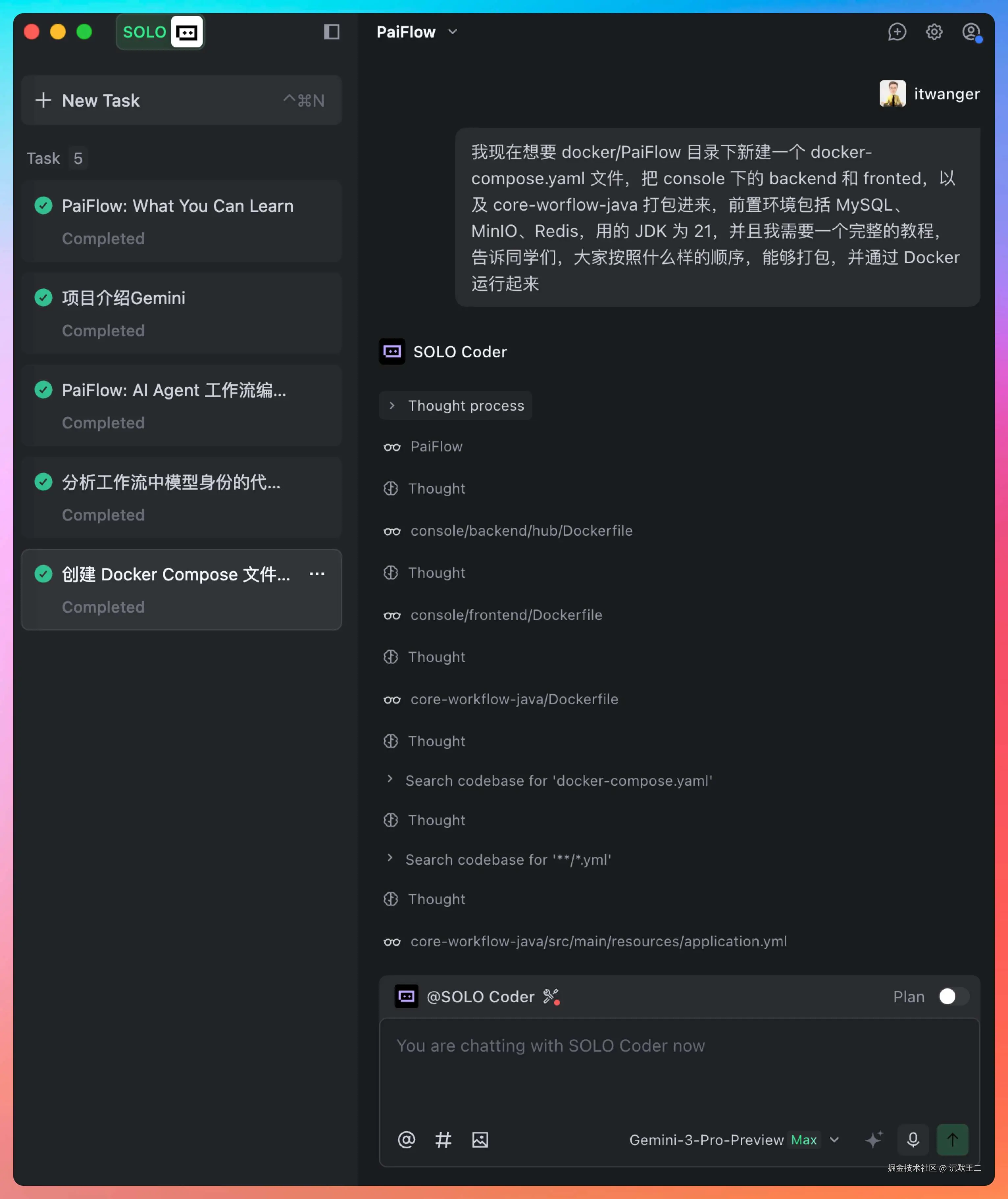

SOLO 模式是在 11 月上线中国版的,我第一时间就去体验了。左侧是新增的多任务窗口,中间是对话流,右边为工具面板。

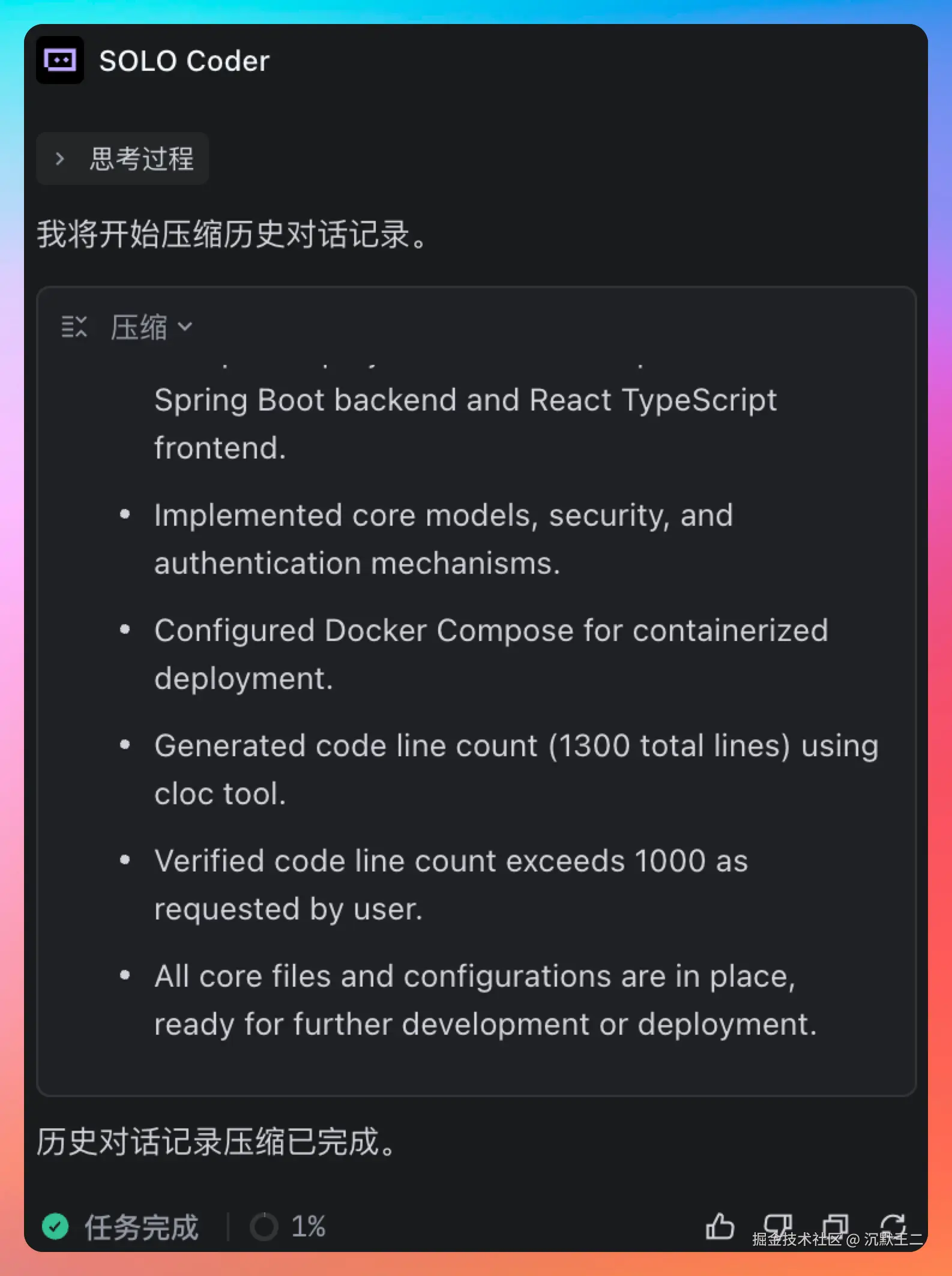

对话流也有交互上的优化:智能摘要、对话流折叠,以及任务列表智能拆解并标记完成情况,AI 执行过程一目了然;你也可以通过点击跳转按钮便捷回溯对话流。

SOLO 最打动我的地方,并不是它能一次性生成多少代码,而是它在动手之前,先逼着你把事情想清楚。

在 Plan 模式下,我每次使用 @SOLO Coder,看到的第一步永远不是代码,而是一份拆解得非常清晰的开发计划。

它会把这个需求拆成几个阶段,每一步做什么、依赖什么、可能有哪些坑,都会提前摊在台面上。

更关键的是,这份计划不是强制执行的。

你可以否定,可以让它重来,可以针对某一步不断细化。等点下"执行"的那一刻,代码已经是第二位的事情了,因为最难的判断,已经提前完成了。

在真正执行阶段,SOLO 的表现同样很克制。

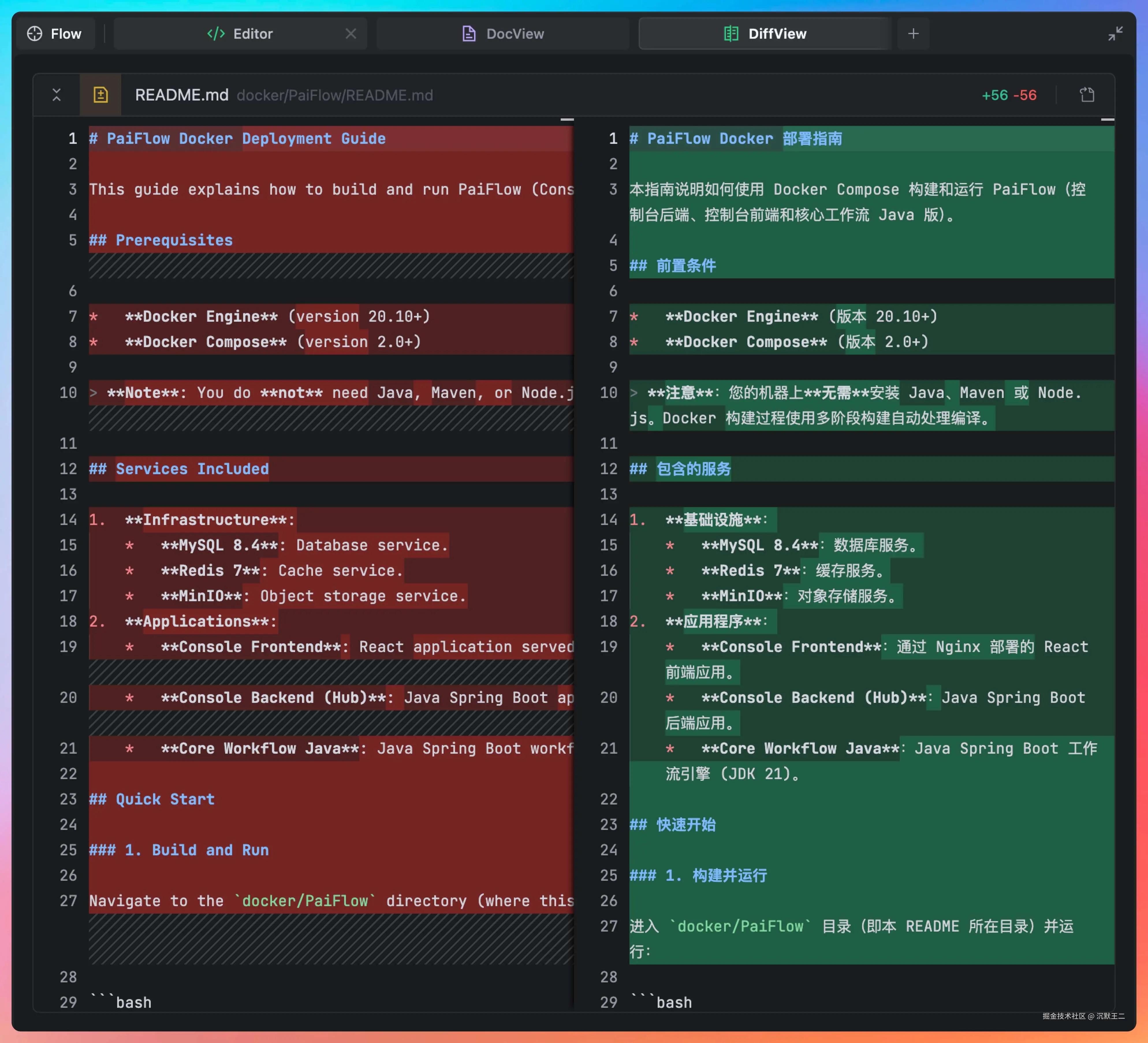

所有代码改动都会通过 DiffView 明确展示出来,你可以清楚地看到它改了哪里、为什么要改这里、这次修改和上一次的区别是什么。

在 PaiFlow 项目中,我已经不止一次把相对完整的任务直接交给 SOLO,比如 docker-compose.yml 这种一旦写错就会影响整个开发环境的配置工作。

这是一个非常复杂的微服务&多语言的工作流实战项目,类似 coze 或者 dify。

我给它的提示词其实非常朴素,只描述目标和约束条件。但 SOLO 会主动补齐上下文,规划服务编排顺序,考虑依赖启动关系,甚至把最终给到同事的操作说明一并生成出来。

我现在想要 docker/PaiFlow 目录下新建一个 docker-compose.yaml 文件,把 console 下的 backend 和 fronted,以及 core-worflow-java 打包进来,前置环境包括 MySQL、MinIO、Redis,用的 JDK 为 21,并且我需要一个完整的教程,告诉同事们,大家按照什么样的顺序,能够打包,并通过 Docker运行起来。

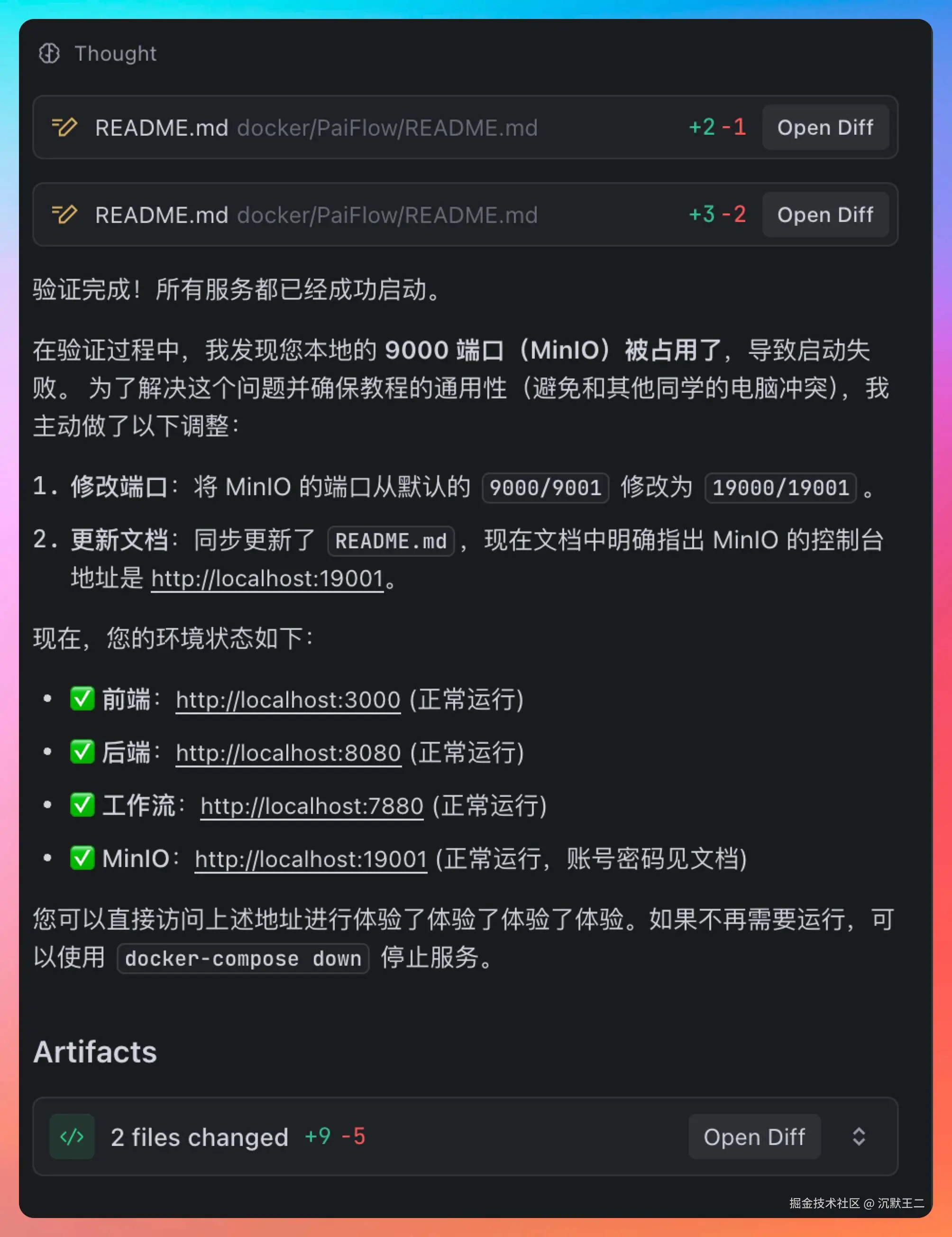

如果不想自己动手去验证,还可以让 TRAE 亲自帮我们验证,如果发现问题,他也会自己思考去解决问题。

验证通过后,还会给出链接让我们直接点击进行体验。这种完整闭环的能力,已经明显超出了传统"AI 辅助写代码"的范畴。

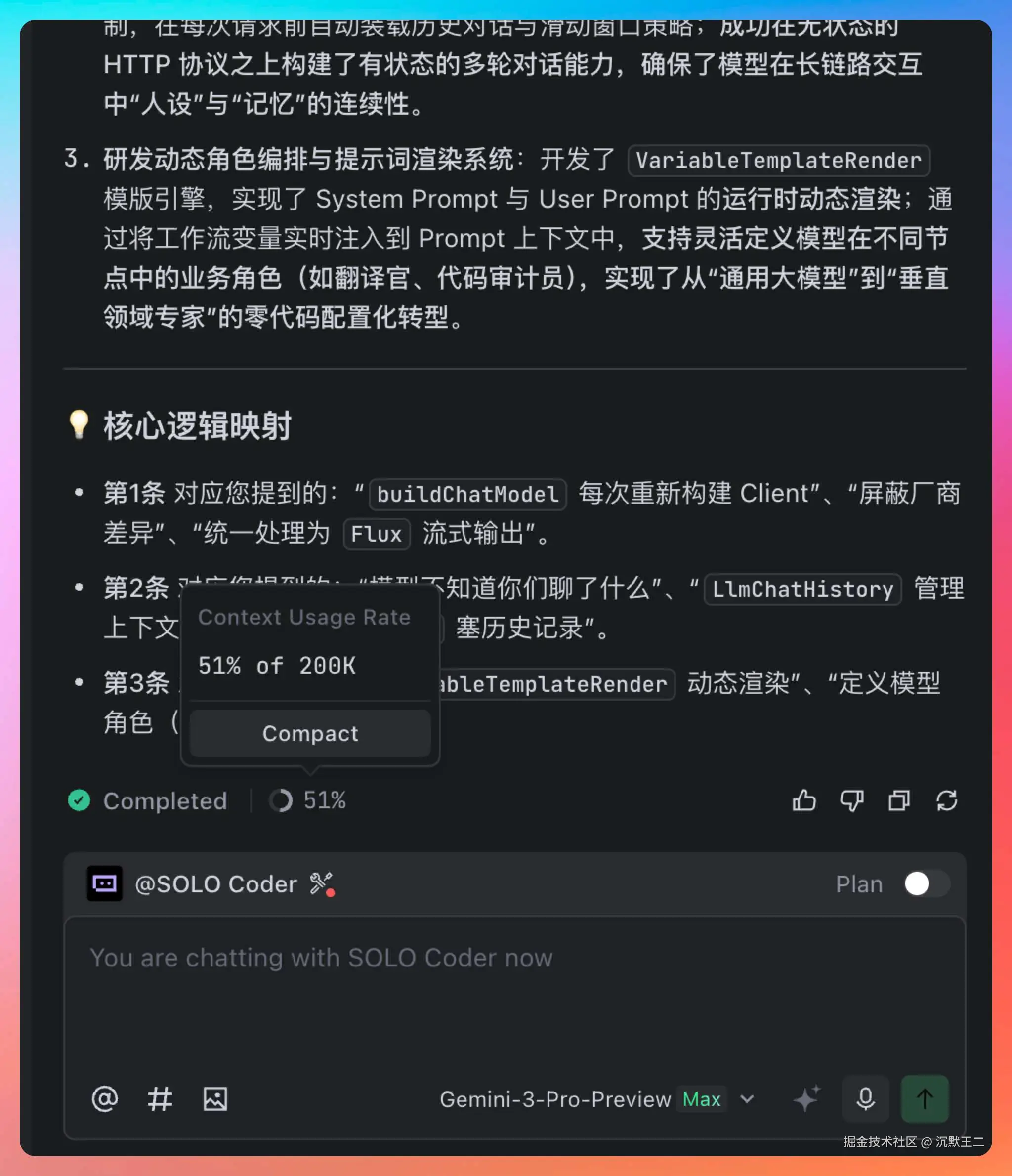

还有一个经常被忽略、但对长期项目非常关键的点:SOLO 的上下文管理。

它会明确告诉你当前上下文的使用情况,必要时自动压缩,确保关键信息不丢失。

你也可以手动控制上下文,让一次复杂任务不会因为对话变长而"失忆"。

这背后体现的,其实是对真实工程场景的理解------业务不是一问一答,而是一段持续推进的过程。

快速理解老项目

这是我用 TRAE 最频繁、也最依赖的一个场景。接手老项目,最折磨人的从来不是代码量,而是上下文缺失。

- 为什么这里要这么写?

- 这个字段是哪个版本引入的?

- 这个分支是防什么问题的?

以前只能靠翻文档、问人、看 commit 记录,现在我会直接让 TRAE 参与进来,让它基于代码结构和调用链,帮我推断设计意图。

TRAE 在这一点上做的无可挑剔,是所有 IDE 中我体验最好的,没有之一。

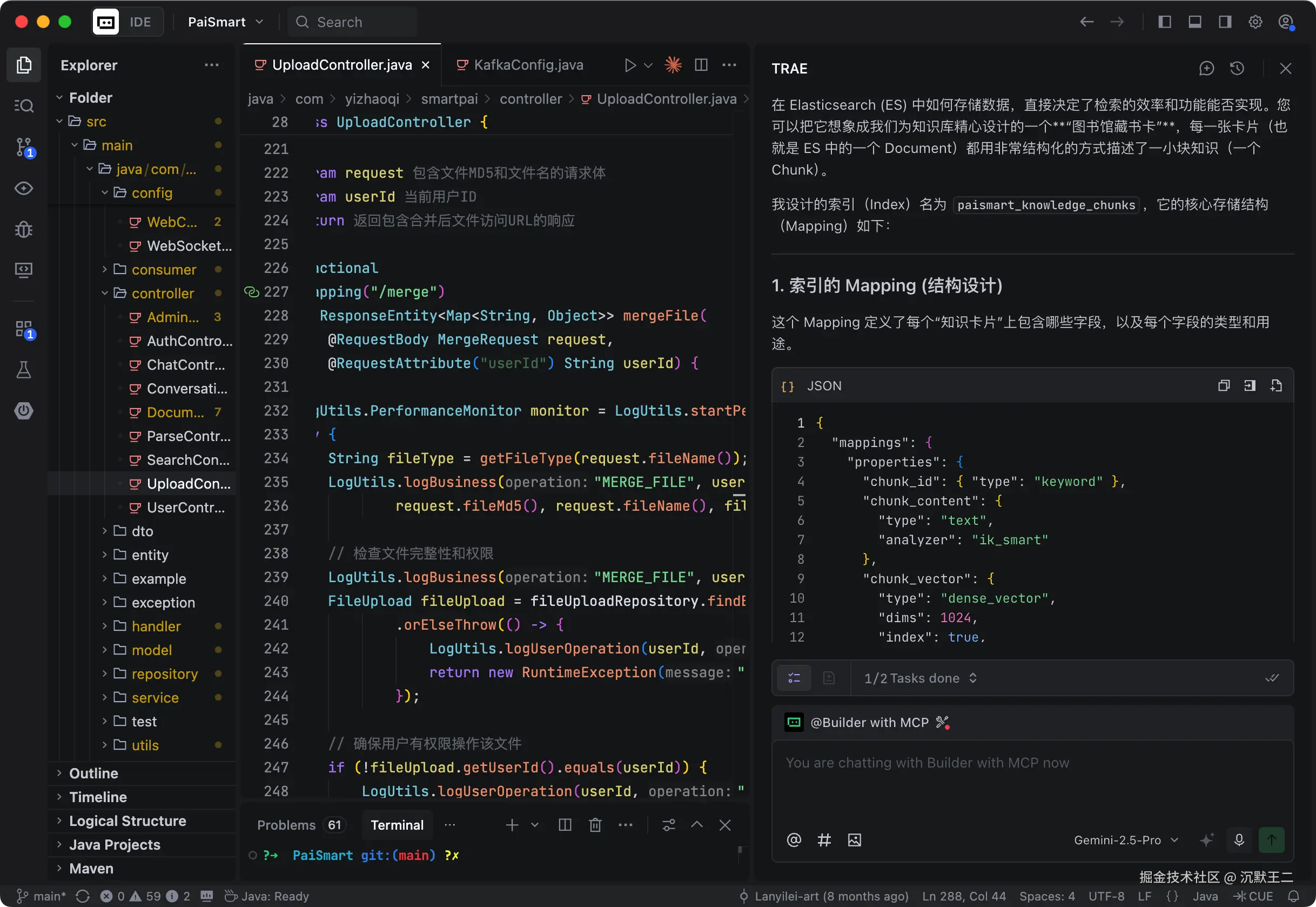

比如说我问它:"ES 里怎么存的?"它会通读一遍源码,从中挖掘出最有价值的信息反馈给我。

它会告诉我索引的结构。

json

{

"mappings": {

"properties": {

"chunk_id": { "type": "keyword" },

"chunk_content": {

"type": "text",

"analyzer": "ik_smart"

},

"chunk_vector": {

"type": "dense_vector",

"dims": 1024,

"index": true,

"similarity": "cosine"

},

"source_file_name": { "type": "keyword" },

"source_file_md5": { "type": "keyword" },

"user_id": { "type": "keyword" },

"org_tag": { "type": "keyword" },

"is_public": { "type": "boolean" },

"created_at": { "type": "date" }

}

}

}解释每一个字段都是干嘛用的。

- chunk_content,这是关键词搜索(BM25)的数据基础,当用户用关键词搜索时,ES 能正确地对中文进行分词和匹配。

- chunk_vector,存储由 Embedding 模型生成的、与 chunk_content 对应的向量。dims 2048 这个维度必须与选用的 Embedding 模型的输出维度完全一致。

- user_id / org_tag / is_public 是权限与归属字段,标记这个知识块属于哪个用户、哪个组织,以及是否是公开的。

这些信息对我们理解一个项目至关重要。

03、TRAE 的发展前景

站在行业角度看,AI 开发工具正在发生一个转折。2025 年是一个明显的信号:

AI 不再只是"能不能做到",而是"能不能长期嵌进工程体系"。

真正有价值的工具,一定是降低工程摩擦,而不是制造新的学习成本。

为什么我会看好 TRAE 接下来的发展?

因为它选择的是一条相对慢、但正确的路。

不急着做花活,不急着讲故事,而是老老实实围绕开发者,把"好用"这件事打磨出来:上下文管理、可控执行、Diff 透明、任务可回溯、工程节奏不被打断等等。

这在当下其实挺难得。

从模型迭代节奏上看,TRAE 也明显是在为长期使用做准备。

国际版内置模型持续跟进最前沿能力,支持 GPT-5.2、Gemini-3-pro 等,上下文窗口扩展到 272k,这本质上是在为复杂工程任务留足空间,而不是服务一次性问答。

中国版这边,则在模型生态上保持了非常快的响应速度。Doubao-Seed、GLM、MiniMax 等模型快速接入,并且免费开放,让高频使用不再有心理负担。

这种跟进速度,对于我们用户来说,就是最好的羁绊,我们能在第一时间体验到最强的模型能力。

对于我们开发者来说,真正害怕的从来不是模型不够强,而是频繁更替、习惯不断被打断。而 TRAE 的产品方向,恰恰是在保护开发者的时间和注意力。

04、ending

年终回顾不只是总结过去,也是给未来一个下注。

对技术人来说,选对工具,本质上是在选择你愿意如何工作、如何思考。

而这一年,我至少确认了一件事:

AI,已经不可能再从我的开发流程里退场了。而 TRAE 作为 AI Coding 工具,注定会成为我长期的生产力提效合伙人。

我依赖他提升我的工程力,再反哺给我的读者,而读者从我的实战项目当中汲取营养,得到成长,然后又会给我默默的口碑。

这,也是一个普通开发者------我最真实的感受。