0. 融合简介

0.1 GNSS + IMU ------ 组合导航算法 (Fusion)

这部分算法通常运行在 P-Box (定位盒) 或域控中,目标是输出高频、高精度的 Pose (位姿)。

- 松耦合 (Loose Coupling):

- GNSS 输出位置,IMU 输出增量,两者在结果层融合。

- 紧耦合 (Tight Coupling) - 主流方案:

- ESKF (Error State Kalman Filter - 误差状态卡尔曼滤波):

- 将 GNSS 的原始伪距/载波相位 与 IMU 的积分数据直接融合。

- 即便 GNSS 信号短时丢失,利用 IMU 和里程计 (Odometry) 进行航位推算 (Dead Reckoning, DR),维持定位不漂移。

- 因子图优化 (Factor Graph Optimization):

- 利用历史信息进行全局优化,精度比卡尔曼滤波更高(常用于SLAM)。

0.2 传感器融合 (Sensor Fusion) ------ 最终的感知

将上述所有传感器的结果拼在一起,形成一个统一的世界模型。

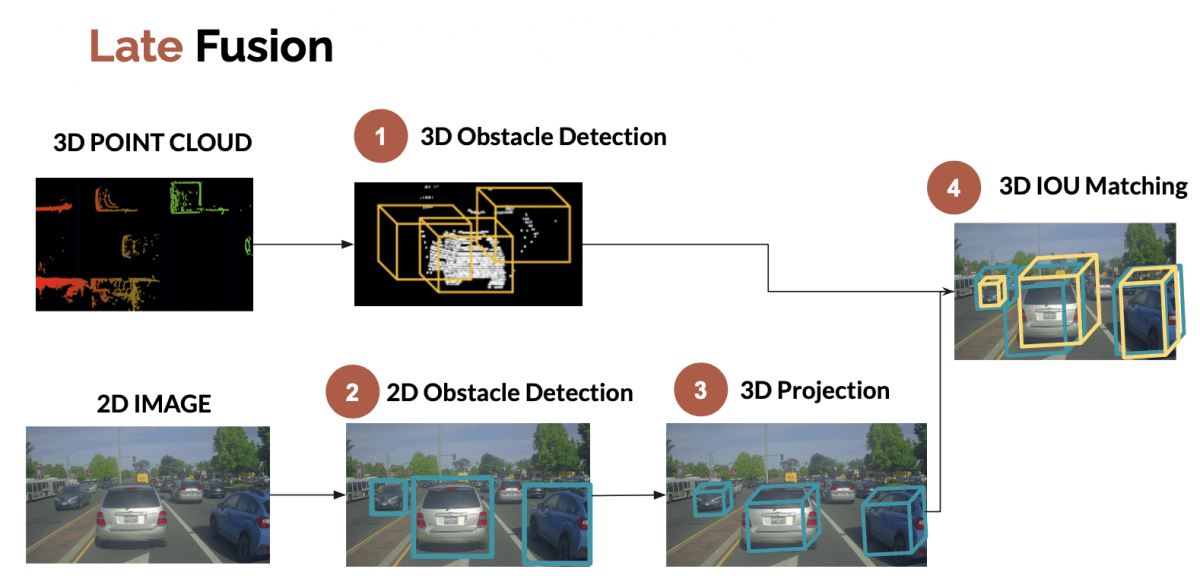

- 后融合 (Late Fusion / Object-Level Fusion):

- 摄像头说前面有辆车(置信度0.8),雷达说前面有障碍物(置信度0.9)。

- 算法(如贝叶斯过滤器)合并两者,输出:前面确信有辆车,位置以雷达为准,类别以视觉为准。

- 前融合 (Early Fusion / Feature-Level Fusion) - 当前趋势:

- 将 LiDAR 的点云投影到 Camera 的图像特征层,或者将图像特征转换到 BEV 空间。

- Deep Fusion: 在神经网络内部融合多模态数据,直接输出检测结果。

- 地图融合 (Map Fusion):

- 将感知到的车道线、地标与高精地图 (HD Map) 进行匹配,实现高精定位 (Map Matching Localization)

1. 首选应该是目标级融合

目标级融合(Object-Level Fusion / Late Fusion) 是指各个传感器(摄像头、雷达、LiDAR)已经各自完成了检测,输出了"目标列表(Object List)",然后由融合算法将这些列表合并成一个唯一的、高精度的感知结果。

这套算法流程通常被称为 MSF (Multi-Sensor Fusion) ,其核心数学工具是概率论 和最优估计理论。

车载目标级感知融合算法概述

在自动驾驶系统中,车辆需要同时利用摄像头、激光雷达(LiDAR)、毫米波雷达、超声波等多源传感器获取环境信息。目标级(后融合)感知是指各传感器先独立完成目标检测,得到 目标边界框、类别、置信度 等高层结果后,再在决策层进行统一融合。相较于数据级或特征级融合,目标级融合计算开销低、模块解耦好,适合算力受限的车载平台。

1. 数据关联算法 (Data Association)

目的: 解决"谁是谁"的问题。判断摄像头看到的"目标A"和雷达看到的"目标B"是不是现实世界中的同一个物体。

- 距离度量 (Distance Metric): 用于计算两个目标相似度的"打分公式"。

- 欧氏距离 (Euclidean): 简单的几何距离。

- IOU (Intersection over Union): 摄像头框与LiDAR框的重叠率。

- 马氏距离 (Mahalanobis Distance) - 最常用: 它不仅仅看位置差异,还考虑了协方差(不确定性) 。

- 例子: 雷达的横向误差大,纵向误差小。马氏距离会"原谅"横向的偏差,但严厉惩罚纵向的偏差。

- 匹配/分配算法 (Assignment Algorithm): 根据打分结果进行配对。

- 最近邻法 (Nearest Neighbor, NN): 简单贪婪算法,易出错。

- 匈牙利算法 (Hungarian Algorithm / Munkres): (工业界标准) 在二分图中找到总代价最小的全局最优匹配方案。

- JPDA (Joint Probabilistic Data Association): 联合概率数据关联。认为一个测量可能源于多个目标(软关联),适用于杂波非常多的复杂路况。

2. 状态估计与滤波算法 (State Estimation)

目的: 解决"它在哪、跑多快"的问题。融合不同传感器的观测值,并平滑轨迹。

- 卡尔曼滤波家族 (The Kalman Family):

- KF (标准卡尔曼滤波): 用于线性系统(较少用于复杂的车辆运动)。

- EKF (扩展卡尔曼滤波): (绝对主流) 通过泰勒级数展开将非线性运动线性化。用于融合雷达的极坐标数据(距离、角度)和摄像头的笛卡尔坐标数据。

- UKF (无迹卡尔曼滤波): 使用 Sigma 点采样处理非线性,精度比 EKF 高,但计算量大。

- 信息滤波器 (Information Filter):

- 卡尔曼滤波的变种(对偶形式)。在多传感器融合中,它可以方便地将多个传感器的信息矩阵直接相加,适合分布式融合架构。

- 运动模型 (Motion Models): 滤波器的物理基础。

- CV (Constant Velocity): 恒速模型(适合高速公路)。

- CTRV (Constant Turn Rate and Velocity): 恒定转弯率和速度模型(适合弯道)。

- CA (Constant Acceleration): 恒加模型。

3. 属性融合算法 (Classification Fusion)

目的: 解决"它是什么"的问题。摄像头说是"车",雷达说是"未知障碍物",怎么信?

- 贝叶斯推理 (Bayesian Inference):

- 利用先验概率和似然度更新后验概率。

- 逻辑: 既然视觉识别是"卡车"的置信度是 0.9,雷达虽然看不出是啥但确认有大物体,那么融合结果就是"卡车"且置信度提升。

- D-S 证据理论 (Dempster-Shafer Theory): (高阶算法)

- 比贝叶斯更先进,因为它引入了**"不可知 (Ignorance)"**的概念。

- 场景: 摄像头被遮挡(无信息),雷达看到了物体(有存在信息但无分类信息)。D-S 理论能很好地处理这种"不确定"与"冲突",避免错误的分类。

- 加权投票法 (Weighted Voting):

- 简单的工程策略。视觉的分类权重设为 1.0,雷达设为 0.2。

4. 其它特定融合逻辑

A. 摄像头 + 毫米波雷达 (Camera-Radar Fusion)

这是 L2 级辅助驾驶最常见的组合。

- 横纵向分离逻辑:

- 纵向(距离/速度): 高度信任雷达。因为单目视觉测距不准,测速更不准。

- 横向(方位角): 高度信任摄像头。因为雷达的角度分辨率低,容易把隔壁车道的车看成本车道的。

- 幽灵目标抑制:

- 视觉没看到,雷达看到了(可能是井盖或路牌):算法通常会丢弃该目标(为了不误刹车)。

- 视觉看到了,雷达没看到(可能是车身吸波或干扰):通常保留目标但降低置信度。

B. GNSS + IMU (组合导航)

虽然它们主要输出自车定位,但也是目标融合的前提。

- 姿态补偿算法:

- 在融合前,必须利用 IMU 提供的 Pitch(俯仰)和 Roll(横滚)角,将雷达和摄像头相对于地面的坐标进行实时旋转补偿。否则,车身一颠簸,感知到的障碍物坐标就会乱跳。

C. 超声波融合 (Ultrasonic Fusion)

主要用于低速泊车。

- 卡尔曼滤波平滑: 超声波数据跳动很大,必须用滤波器平滑距离。

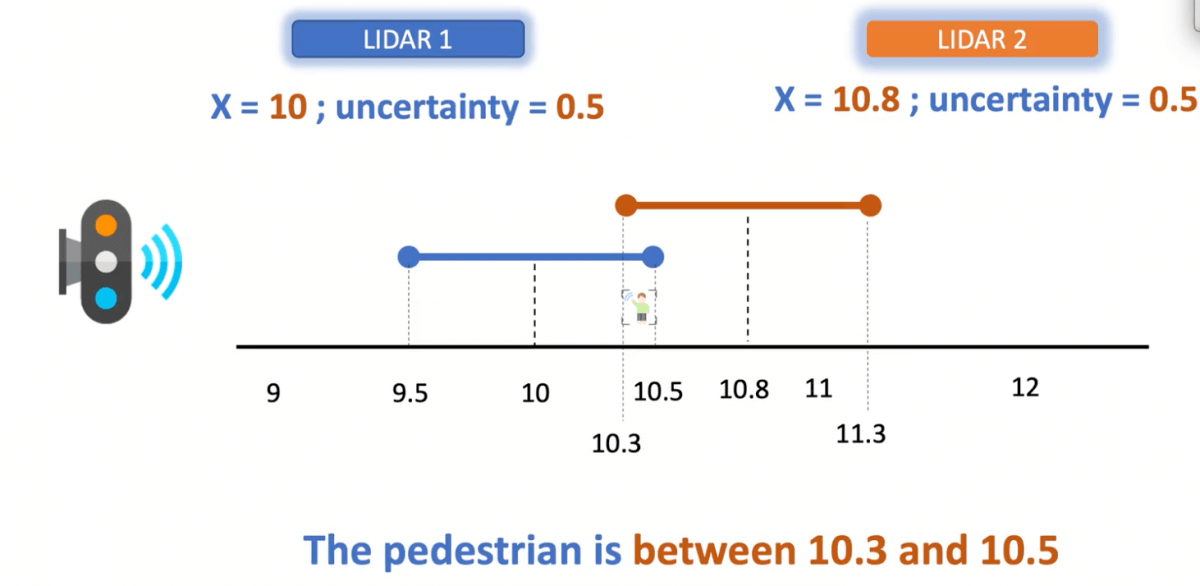

- 三边测量法: 利用多个探头的距离交汇计算坐标。

- 栅格地图 (Occupancy Grid Map): 将超声波数据填入局部栅格地图,融合生成可行驶区域。

5. 轨迹管理 (Track Management)

目的: 决定什么时候新建一个目标,什么时候删掉一个目标。

- 生命周期机 (Lifecycle State Machine):

- 状态流转:Tentative (暂定) -> Confirmed (确认) -> Coasted (预测/丢失) -> Deleted (删除)。

- M/N 逻辑: 在最近 N 帧中检测到 M 次(例如 3/5),才确认为真实目标。

- 航迹维持 (Coasting):

- 当视觉被遮挡、雷达漏检时,利用卡尔曼滤波的预测步骤 (Prediction Step) 继续"脑补"目标的运动轨迹,直到传感器再次捕捉到它。

总结:一个典型的融合周期

- 输入: 视觉目标列表 (t1t 1), 雷达目标列表 (t2t 2), 自车定位 (tnowtnow).

- 时间同步: 利用匀速模型将所有目标的位置推演到 tnowtnow 时刻。

- 坐标转换: 将所有目标转到自车坐标系(利用外参和IMU姿态)。

- 关联: 计算马氏距离,用匈牙利算法配对(Radar ID #5 <-> Camera ID #12)。

- 更新: 用 EKF 融合两者的坐标和速度,更新轨迹状态。

- 分类: 用贝叶斯/DS理论融合类别(Result: 车辆)。

- 管理: 新建未匹配的轨迹,删除长期未更新的轨迹。

- 输出: 融合后的 Object List 给规控。

1.1 目标级融合的典型流程

| 步骤 | 说明 |

|---|---|

| 1)单传感器检测 | 摄像头使用 YOLO、Faster‑RCNN 等视觉检测网络;LiDAR 使用 PointPillars、SECOND、VoxelNet 等 3D 检测模型;雷达使用基于 ROI 的传统检测或轻量化 CNN。 |

| 2)目标对齐 | 通过坐标转换(外参标定)将不同传感器的检测框映射到统一坐标系(常用车体坐标或世界坐标),并利用最近邻、IoU 阈值或时间同步窗口进行匹配。 |

| 3)信息融合 | 对匹配到的同一目标进行 置信度加权、属性融合(如位置取加权平均、类别采用多数投票或贝叶斯更新),或使用 D‑S 证据理论 对冲突进行冲突消解。 |

| 4)输出决策 | 生成最终的目标列表,送入后续路径规划与控制模块。 |

上述流程在实际系统中往往配合 时空同步、外参标定误差校正 等技术,以保证融合精度。

1.2 主流算法与实现方式

| 类别 | 代表方法 | 关键特点 |

|---|---|---|

| 规则/统计融合 | 加权平均、卡尔曼滤波、贝叶斯融合、D‑S 证据理论 | 计算简单、可解释性强;对检测器性能依赖较大,信息损失明显。 |

| 基于学习的后融合 | Late‑Fusion 网络(如 Fusion‑RCNN、CenterFusion)、多模态 Transformer(BEV‑Fusion、VLA) | 将检测框特征(类别、置信度、几何信息)拼接后送入轻量化 MLP/Transformer,实现数据驱动的权重学习;能够在冲突场景下自动调节融合策略。 |

| 协同感知(V2X)目标级融合 | 基于 C‑V2X 的车路协同检测框共享、非极大值抑制(NMS)融合 | 将多车/路侧检测结果在中心节点统一融合,显著提升远距离或遮挡场景的检测覆盖率;通信开销低,适合车联网环境。 |

| 证据理论融合 | 改进的 D‑S 证据分配与冲突消解 | 在多源证据不一致时提供冲突度量与再分配机制,降低误检率(实验中误检率下降约 3.6%)。 |

| 深度学习端到端融合的目标级变体 | Modular End‑to‑End:先进行独立检测,再用神经网络进行目标级融合(如 Fusion‑Transformer) | 保留模块化优势的同时,引入端到端的特征学习,兼顾算力与精度。 |

1.3 近期研究热点(2023‑2025)

- 多尺度序列融合:在路侧感知与车载感知之间引入时间序列特征,提升远距离目标的检测鲁棒性。

- 基于 D‑S 证据的两级融合:先在目标级进行 ROI 关联,再在决策层使用改进的 D‑S 证据理论,实现隧道等光照不佳环境下的 9.5% 准确率提升。

- VLA(视觉‑语言‑动作)模型:将视觉特征、语言描述与动作意图统一映射到 BEV(鸟瞰视图)空间,利用 Transformer 完成目标级融合,已在部分 L3 级自动驾驶平台验证。

- 车路协同目标级融合框架:利用 C‑V2X 将车间检测框共享至路侧边缘服务器,采用 NMS 与置信度加权实现跨车协同感知,显著提升遮挡目标的检测召回率。

- 轻量化后融合网络:针对算力受限的嵌入式平台,研发基于 1‑D 卷积和注意力机制的轻量化 Late‑Fusion 网络,保持 100 TOPS 以下算力即可实现 0.1 s 延迟的实时融合。

1.4 优缺点对比

| 维度 | 优势 | 局限 |

|---|---|---|

| 算力需求 | 只需处理检测框,算力开销低,适配 100 TOPS 以内车载平台 | 失去原始点云/图像的细粒度信息,融合精度受限。 |

| 模块解耦 | 各传感器检测模块可独立升级、替换,系统维护便利。 | 跨传感器信息冲突难以通过规则方式完全消除。 |

| 实时性 | 数据量小,通信延迟低,适合 V2X 协同感知。 | 在高密度目标或高速场景下,匹配与冲突消解可能成为瓶颈。 |

| 鲁棒性 | 融合多源检测结果可抵御单传感器失效(如雨雾对摄像头的影响)。 | 对单传感器检测质量高度依赖,若检测器误检率高,融合后仍会受影响。 |

| 可解释性 | 基于置信度加权或证据理论的融合过程易于解释。 | 深度学习后融合网络的决策过程相对黑箱,需要额外可解释性工具。 |

1.5 实际落地建议

- 先行目标级融合:在算力受限的量产车型中,先实现基于规则的置信度加权或 D‑S 证据融合,以快速提升感知可靠性。

- 逐步引入学习融合:在算力提升的高阶车型中,可采用轻量化 Late‑Fusion Transformer,对检测框特征进行端到端学习,进一步提升复杂场景下的检测精度。

- 结合 V2X 协同:在车路协同平台(如 C‑V2X)中,利用目标级协同感知框架共享检测框,降低带宽需求的同时扩大感知视野。

- 持续标定与同步:目标级融合对外参标定、时间同步要求高,建议部署在线标定与时钟同步模块,确保跨传感器对齐误差在厘米级范围。

- 安全与可验证性:采用 D‑S 证据理论或贝叶斯融合时,加入冲突度量阈值,若冲突超过阈值则触发冗余检测或降级模式,满足功能安全(ISO 26262)要求。

1.6 未来发展方向

- 多模态 Transformer 与 BEV 融合:将视觉、LiDAR、雷达的检测框映射到统一的 BEV 表示,利用自注意力机制实现更细粒度的目标级融合。

- 自适应融合权重学习:基于场景上下文(天气、光照、道路类型)动态调整各传感器的置信度权重,实现感知的自适应鲁棒性。

- 边缘协同感知:在车载边缘计算节点上预处理检测框,再通过低时延 V2X 网络进行目标级协同,形成车路云一体化的感知网络。

- 可解释性融合框架:结合证据理论与可视化工具,为每一次融合决策提供冲突来源与权重分配的可解释报告,满足监管与安全审计需求。

结语

目标级感知融合是当前车载自动驾驶系统实现高可靠感知的关键技术之一。通过规则融合、证据理论以及轻量化深度学习网络的组合,可以在算力、实时性与鲁棒性之间取得平衡;而结合 V2X 的协同目标级融合则为未来车路协同感知提供了可扩展的路径。持续关注 2023‑2025 年的最新研究(如 D‑S 证据两级融合、VLA‑Transformer、车路协同框架)并结合实际算力约束进行分层实现,将有助于在实际产品中快速落地并提升安全水平。